KANs简介

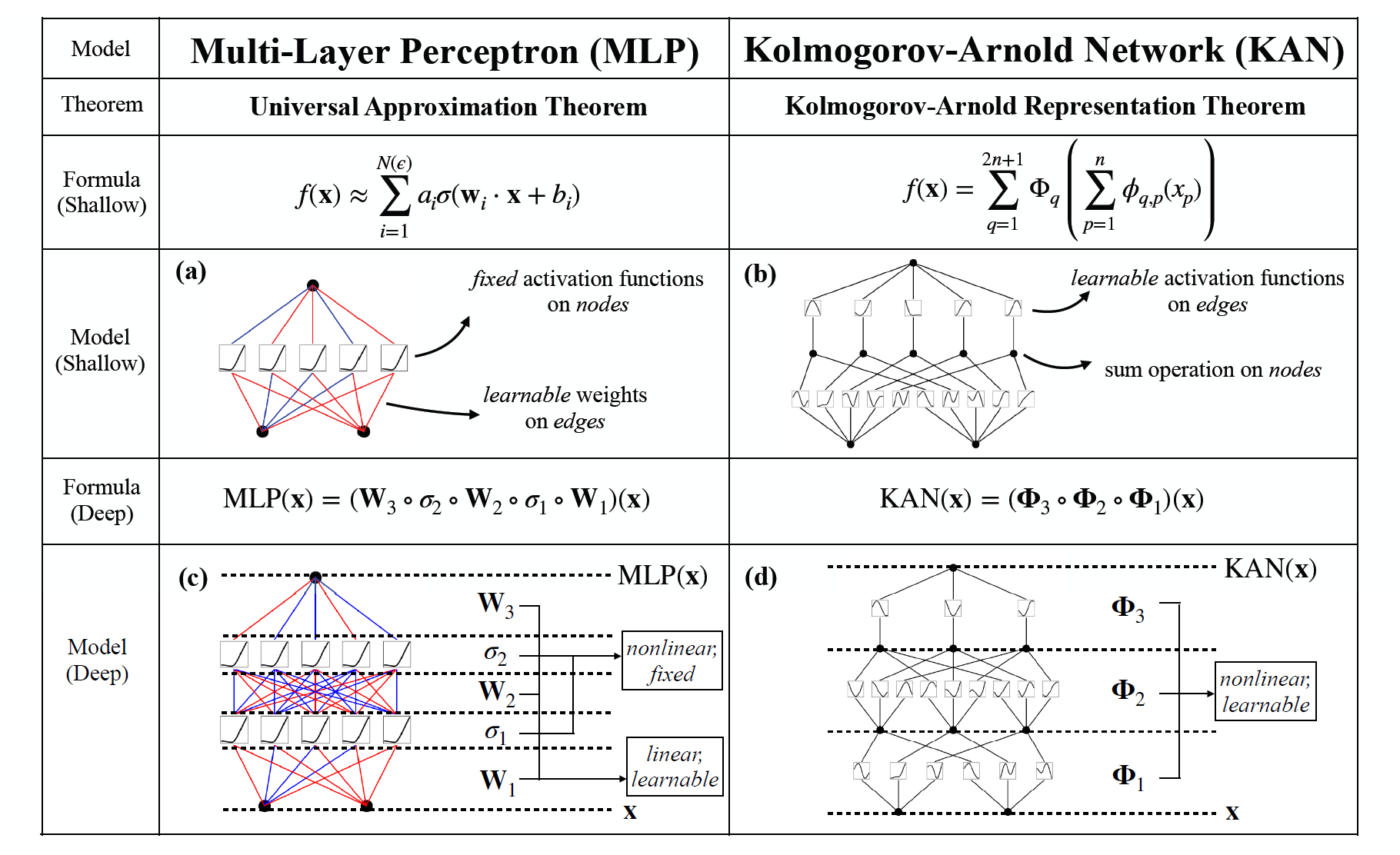

Kolmogorov-Arnold Networks (KANs) 是一种创新的神经网络模型,它挑战了传统多层感知器(MLPs)的设计,通过将激活函数从节点转移到边上来提升模型的性能和可解释性。KAN的核心在于,其所有权重参数均被单变量的样条函数代替,这些函数可根据训练数据自适应调整,从而提供了比固定激活函数更高的灵活性和适应性。

性能优势

准确性提升:与同等规模或更大规模的MLPs相比,KANs在数据拟合和偏微分方程求解任务上展现了更高的准确率。研究显示,即使是小型KANs也能达到或超过大型MLPs的表现。

神经缩放律:KANs表现出比MLPs更优的神经缩放律,意味着随着模型参数数量的增加,KANs的性能提升更加显著。

可解释性增强:KANs的结构允许直观可视化,用户可以直接与网络“互动”,进行调试和优化,这在符号回归等任务中特别有利。用户可以手动指定或由系统建议合适的符号函数来代表激活函数,进而得到可读性强的最终表达式。

训练过程

KANs的训练流程包括几个关键步骤,其中涉及到参数初始化、激活函数的动态调整以及符号公式的提取,以下是具体细节:

参数初始化

激活函数基底: 激活函数b(x)通常设置为sigmoid-like函数,例如silu(x) = x / (1 + e^(-x))。

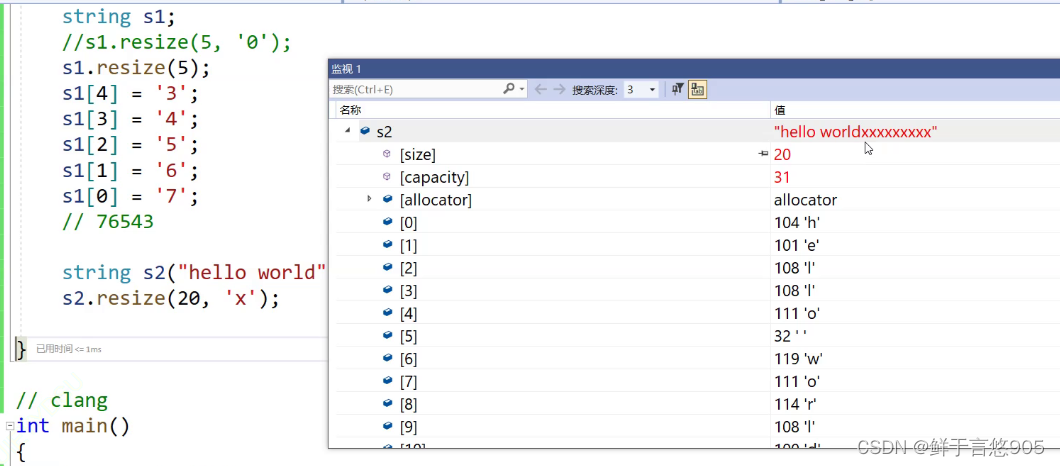

样条函数参数: 样条函数spline(x)通过B样条的线性组合来参数化,即 [ spline(x) = \sum_i c_i B_i(x) ] 其中,c_i是可训练参数。为了使初始激活接近零,B样条系数c_i从正态分布N(0, σ^2)中抽取,通常选择小的σ,如σ=0.1。

权重初始化: 权重w遵循Xavier初始化,保证了良好的梯度传播特性。

动态更新样条网格

由于样条函数定义在有界区域上,而训练过程中激活值可能超出预设区间,因此,每接收到新的输入激活值时,KANs会相应地更新每个网格点的位置,以确保覆盖所有可能出现的激活值范围。

模型训练与符号化

初步训练: KANs首先像常规神经网络一样进行训练,此时激活函数是基于样条函数的灵活表达。

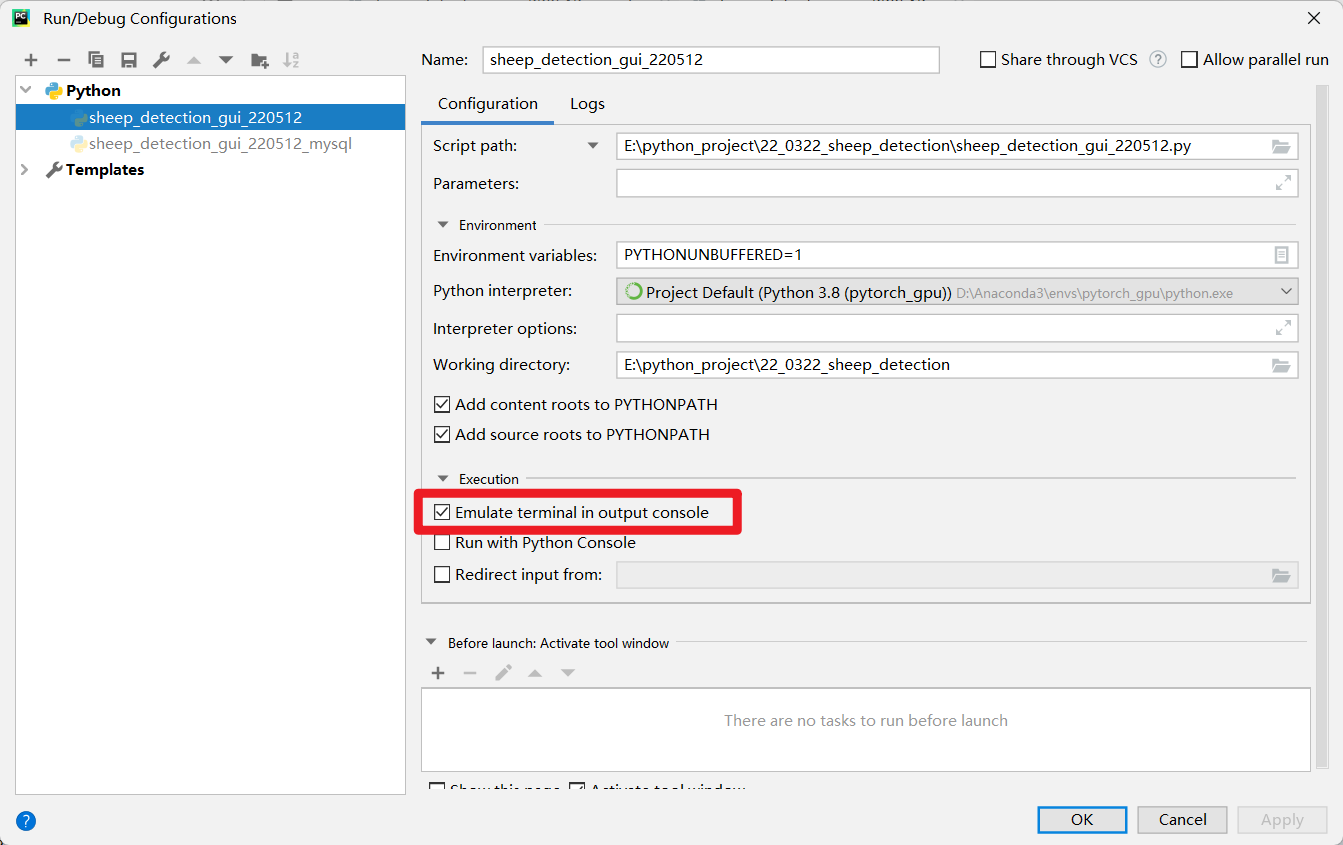

修剪与符号化: 自动修剪过程可能会移除所有隐藏层的节点,只保留最后一个,形成一个简化的网络结构。随后,用户可通过观察网络图来猜测或使用suggest_symbolic函数推荐合适的符号函数来替换激活函数。

精调: 当所有激活函数都符号化后,仅剩的参数是仿射参数,继续训练这些参数直到损失降到极小值,表明找到了正确的符号表达。

输出公式: 使用Sympy等数学软件计算输出节点的最终符号表达式,例如得到1.0e1.0y^2 + 1.0sin(3.14*x)。

参数量与效率

虽然KANs的参数量级看似比MLPs更高(约O(N2LG)对比O(N2L)),实际上KANs往往能在较小的N值下达到更好的泛化能力,从而减少参数量,同时提升模型的通用性和可解释性。对于一维问题,KAN甚至简化为单个样条近似。

结论

KANs作为MLPs的有力竞争者,不仅在提高深度学习模型的准确性和可解释性方面展现出了巨大潜力,而且在面对非符号函数学习时提供了比符号回归方法更强的鲁棒性和适应性。论文通过数学和物理领域的实例验证了KANs作为研究工具的有效性,为未来人工智能和基础相互作用领域的发展开辟了新的路径。