当我们谈到RVM(Relevance Vector Machine,相关向量机)、CNN_RVM(卷积神经网络结合相关向量机)以及RVM-Adaboost(相关向量机结合AdaBoost算法)时,每种模型都有其独特的原理和结构。以下是对这三种模型的详细介绍:

1. RVM(Relevance Vector Machine)

原理

RVM是一种基于贝叶斯框架的稀疏概率模型,用于回归和分类问题。它基于稀疏贝叶斯学习理论,通过最大化后验概率来自动确定相关向量(即那些对模型输出有显著影响的输入数据点)。与SVM(支持向量机)类似,RVM也试图在高维空间中寻找一个超平面来分隔数据,但RVM引入了概率解释,并且它生成的模型通常比SVM更稀疏,这意味着它使用更少的支持向量。

结构

RVM的结构相对简单,主要包括以下几个部分:

- 输入层:接收原始输入数据。

- 特征映射层(对于回归问题可能不存在):将数据映射到高维空间,以便更好地拟合非线性关系。

- 相关向量层:通过训练确定哪些输入数据点对模型输出有显著影响,并将这些点作为相关向量。

- 输出层:根据相关向量计算输出。

2. CNN_RVM(Convolutional Neural Network 结合 Relevance Vector Machine)

原理

CNN_RVM是将卷积神经网络(CNN)和RVM结合起来的模型,旨在利用CNN的特征提取能力和RVM的稀疏性来提高回归或分类性能。CNN用于从原始输入数据中提取有意义的特征,然后这些特征被送入RVM进行进一步的建模和预测。

结构

CNN_RVM的结构包括以下几个部分:

- CNN部分:

- 输入层:接收原始图像或序列数据。

- 卷积层:使用卷积核提取局部特征。

- 池化层(可选):对卷积层的输出进行下采样,以减少计算量和参数数量。

- 全连接层(可选):将卷积和池化后的特征展平并连接到全连接层,以便进行进一步的特征变换。

- RVM部分:

- 接收CNN输出的特征向量。

- 使用RVM算法对这些特征进行建模和预测。

3. RVM-Adaboost(Relevance Vector Machine 结合 AdaBoost)

原理

RVM-Adaboost是将RVM和AdaBoost算法结合起来的模型。AdaBoost是一种集成学习算法,它通过迭代地训练多个弱分类器并将它们组合成一个强分类器来提高分类性能。在RVM-Adaboost中,我们首先将训练数据划分为多个子集,并使用RVM在每个子集上训练一个弱分类器。然后,AdaBoost算法根据每个弱分类器的性能(即错误率)为它们分配权重,并将这些弱分类器组合成一个强分类器。

结构

RVM-Adaboost的结构包括以下几个部分:

- 数据划分:将原始训练数据划分为多个子集。

- RVM弱分类器训练:在每个数据子集上使用RVM训练一个弱分类器。

- AdaBoost集成:

- 初始化权重:为每个训练样本分配相同的权重。

- 迭代训练:在每个迭代中,使用当前权重训练一个RVM弱分类器,并计算其错误率。根据错误率更新样本权重(分类错误的样本权重增加,分类正确的样本权重减少)。

- 组合弱分类器:将所有训练好的RVM弱分类器按照它们的权重组合成一个强分类器。

这种结合方式可以充分利用RVM在稀疏性和概率解释方面的优势以及AdaBoost在集成学习方面的优势,从而提高分类性能。

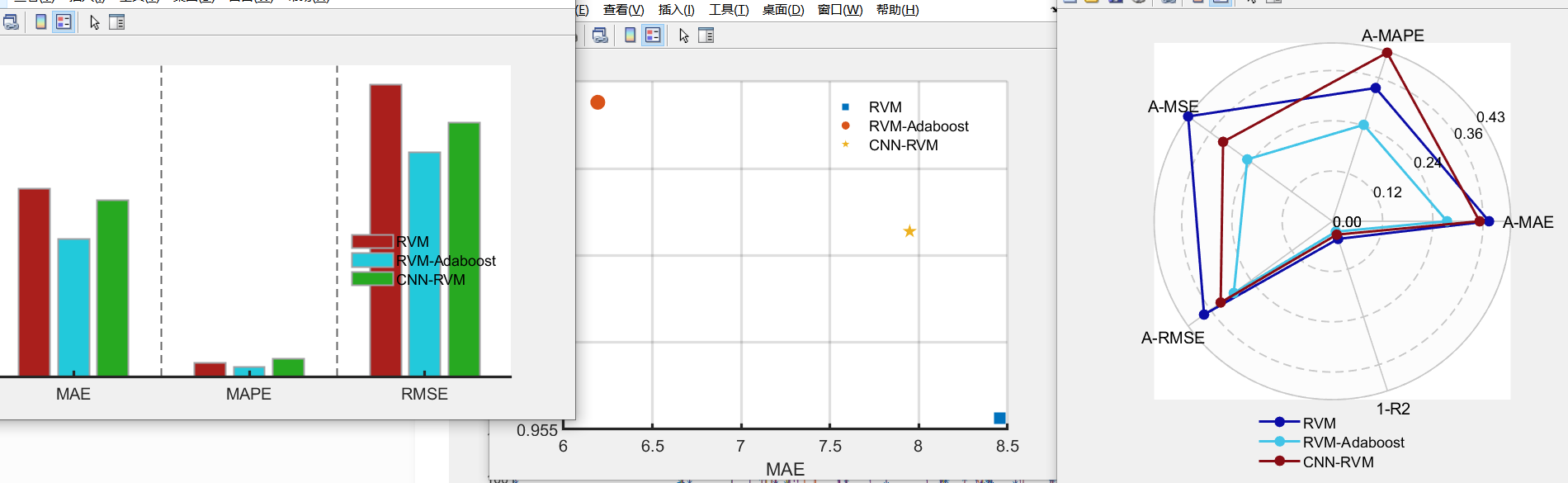

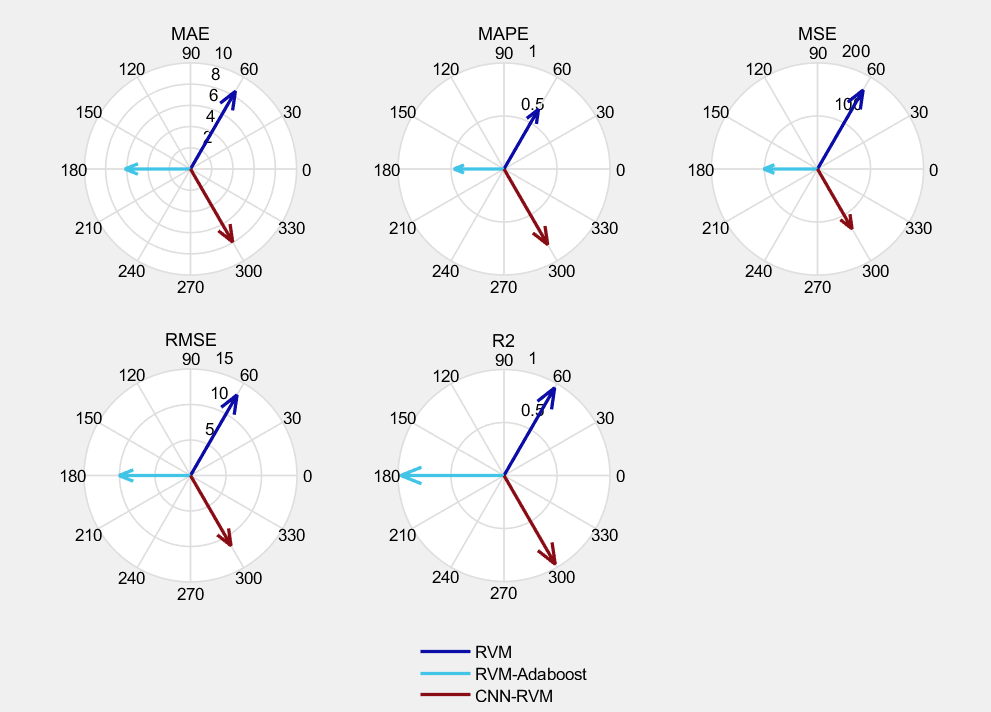

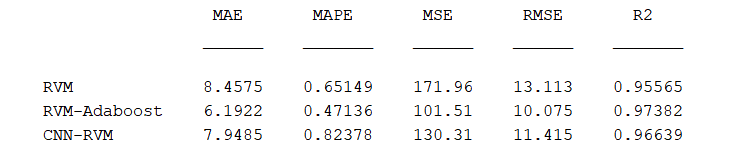

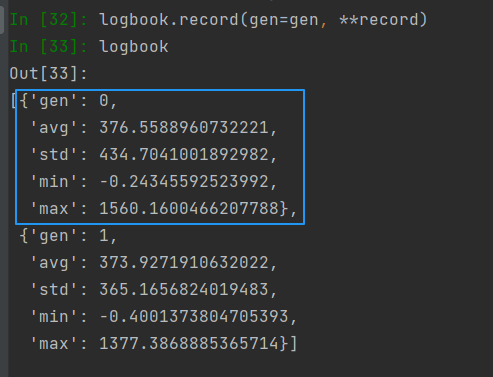

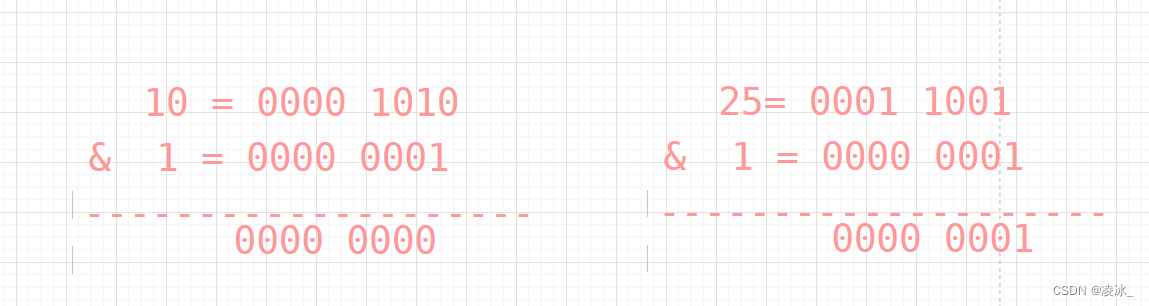

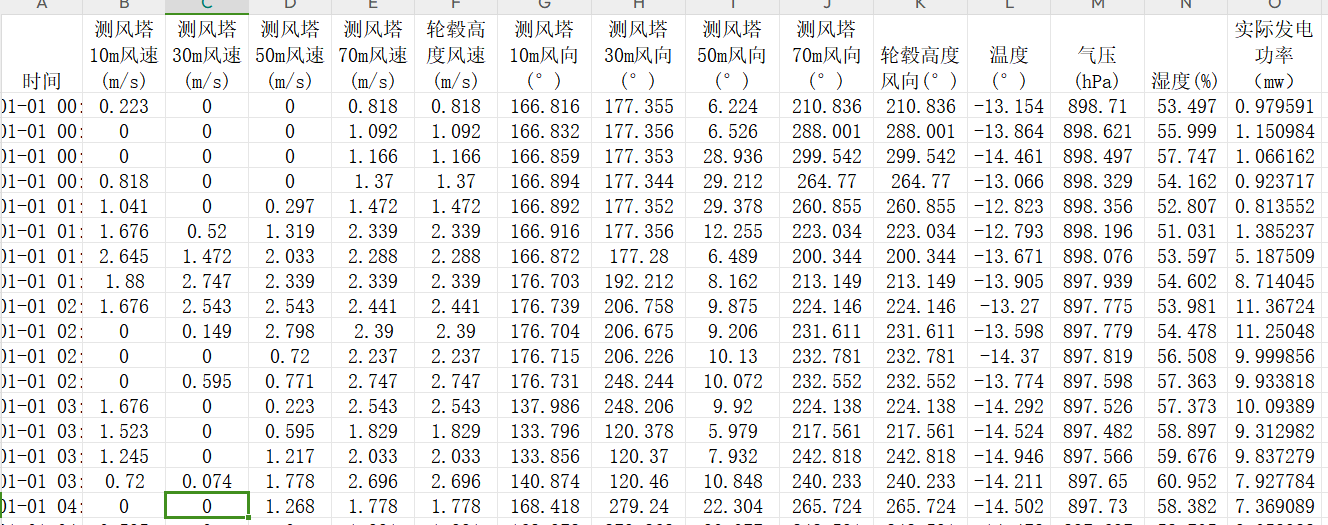

基于风电预测数据集:

预测结果对比: