目录

一、什么是大模型微调

二、指令微调

三、微调的目的

三、微调的方式

四、微调的步骤

五、微调数据准备

六、微调的数据质量

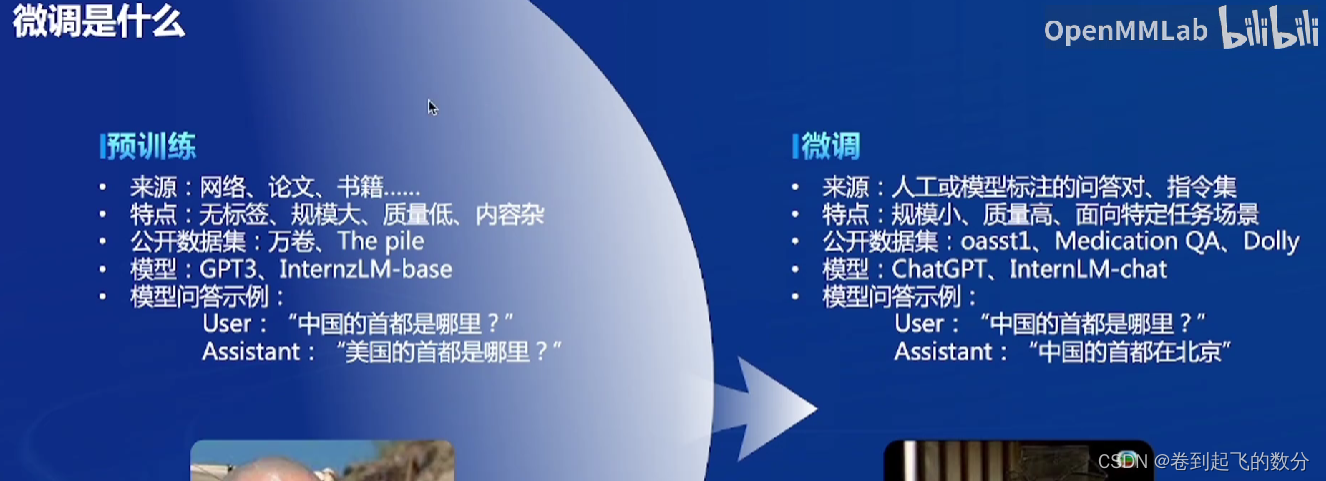

一、什么是大模型微调

预训练和微调的区别,这个很关键

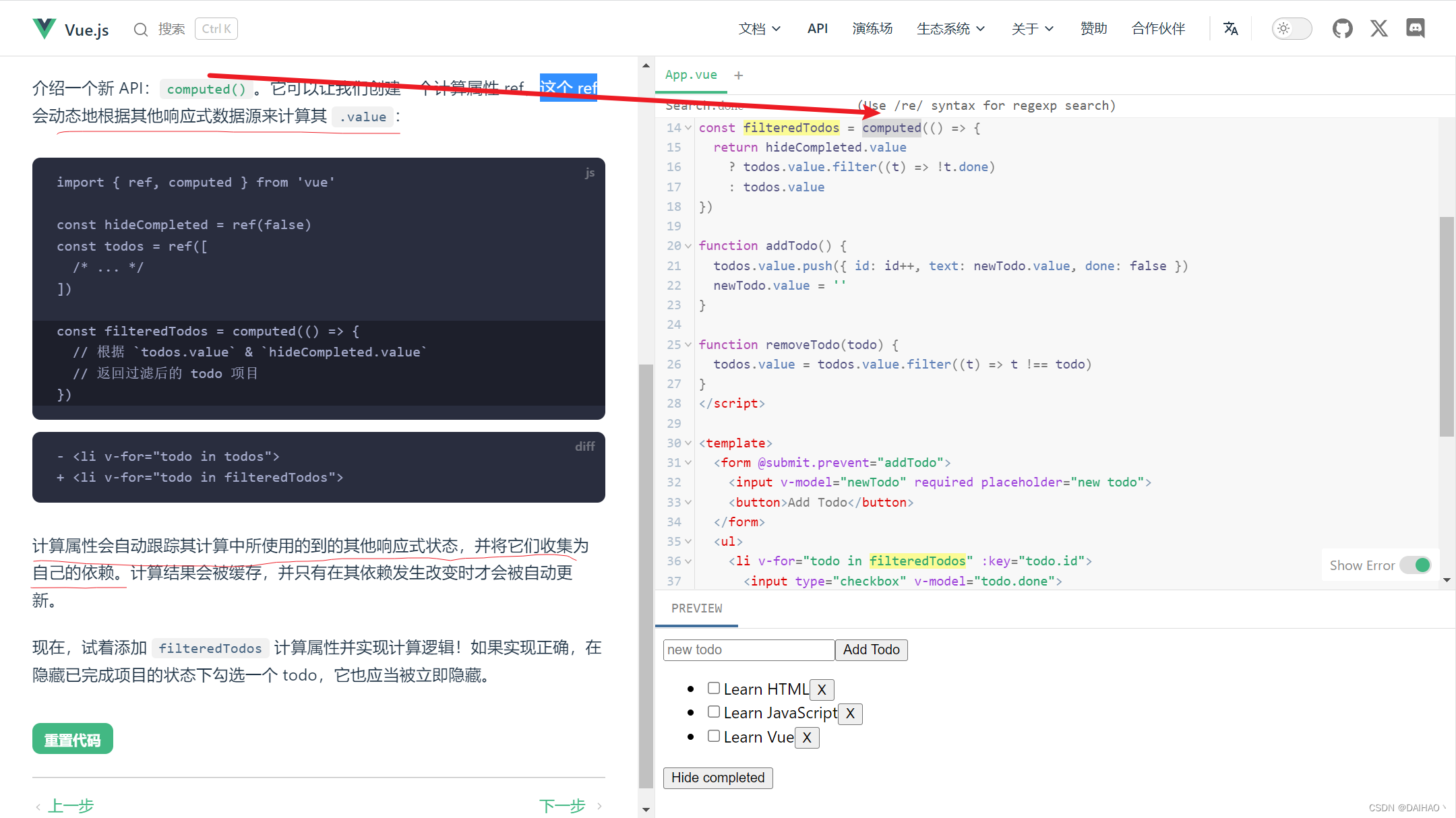

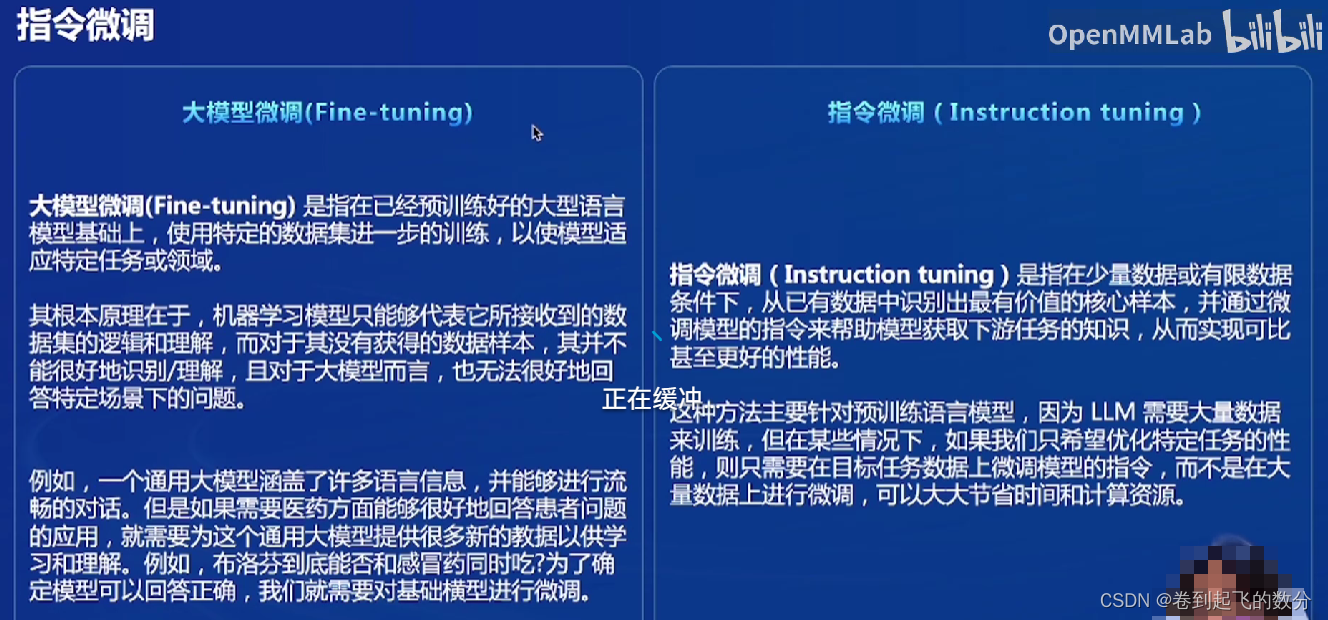

二、指令微调

这个地方主要是微调的角度不同,简单理解:前一个是相当于直接修改大模型的参数,后一个是更加精确的回答问题,让回答的泛化(其他内容的拓展)更少

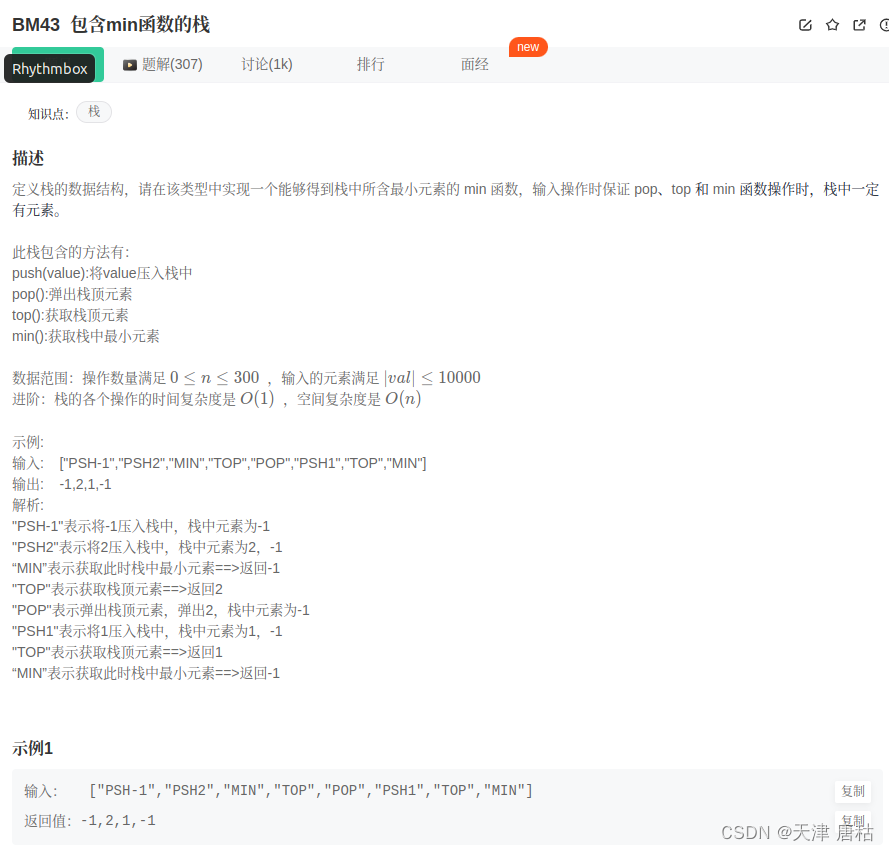

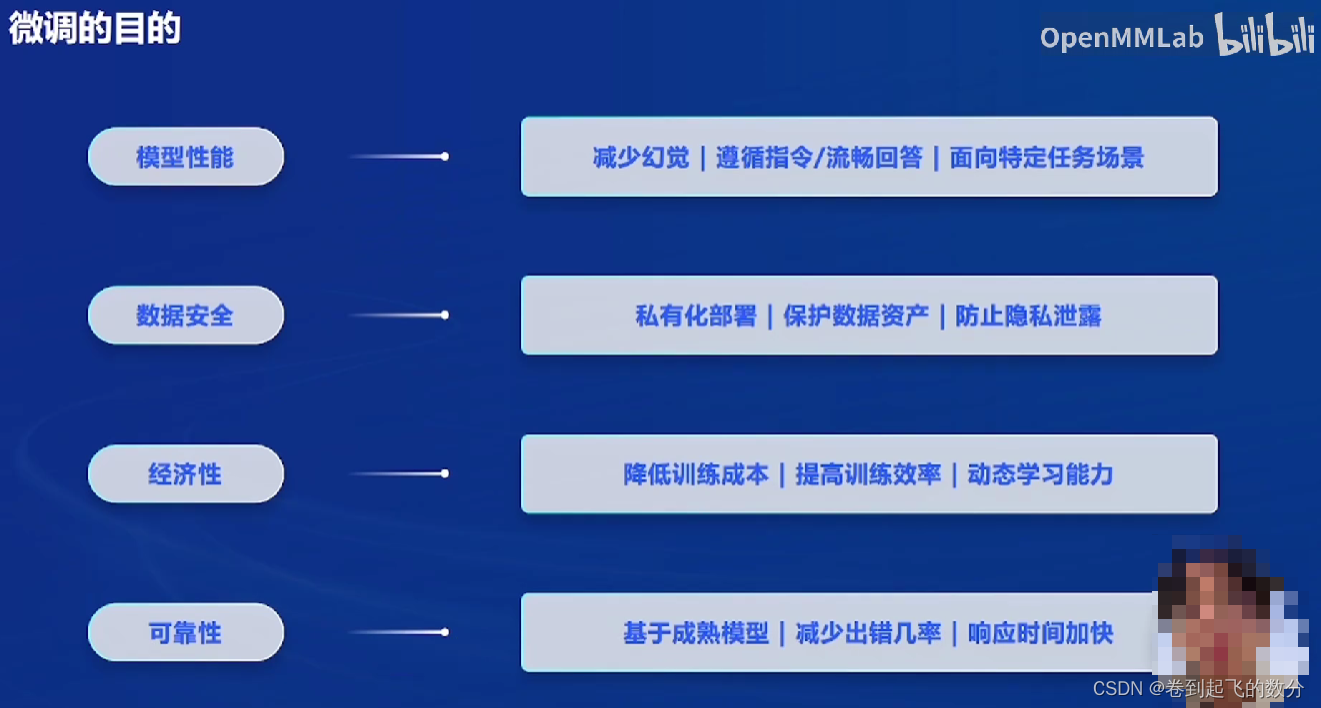

三、微调的目的

四个问题对应四个目的

三、微调的方式

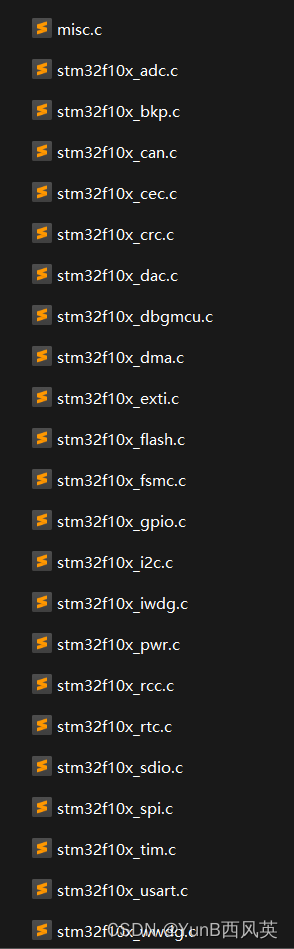

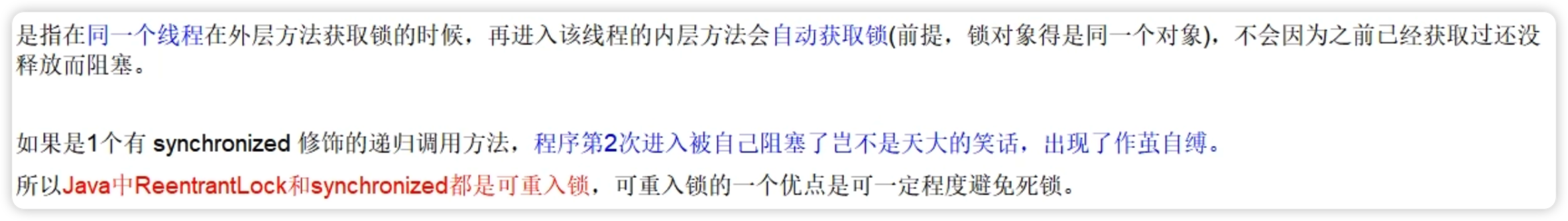

全量微调FFT:一般指全参数的微调(全量微调),指是一类较早诞生的微调方法,全参数微调需要消耗大量的算力,实际使用起来并不方便(其实就是第二部分的大模型微调)

PEFT:特指部分参数的微调方法,这种方法算力功耗比更高,也是目前最为常见的微调方法,比如lora微调、Prefix-Tuning、Prompt Tuning、P-Tuning v2等方法(就是第二部分的指令微调)

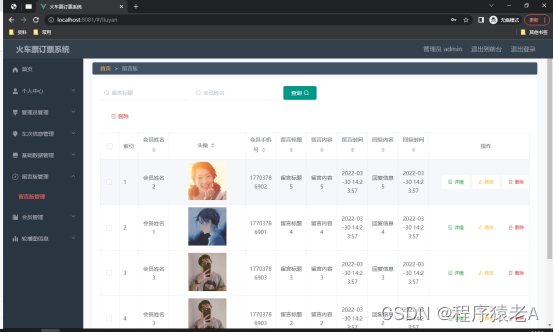

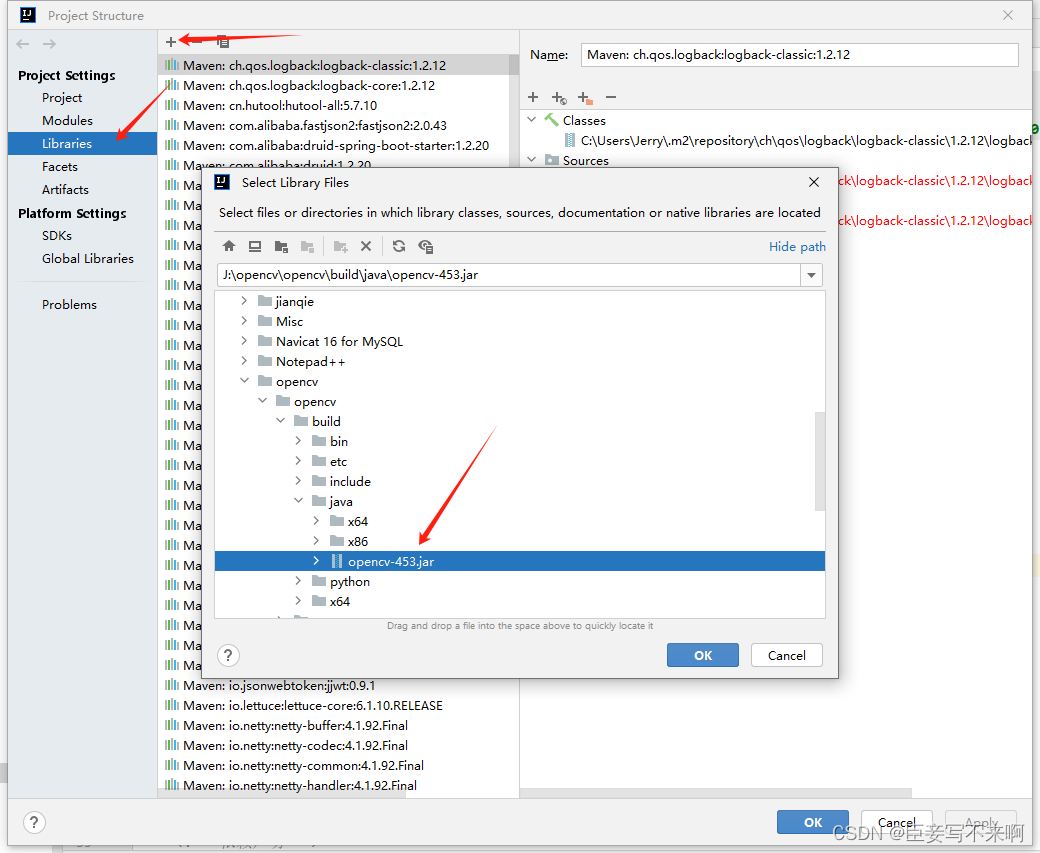

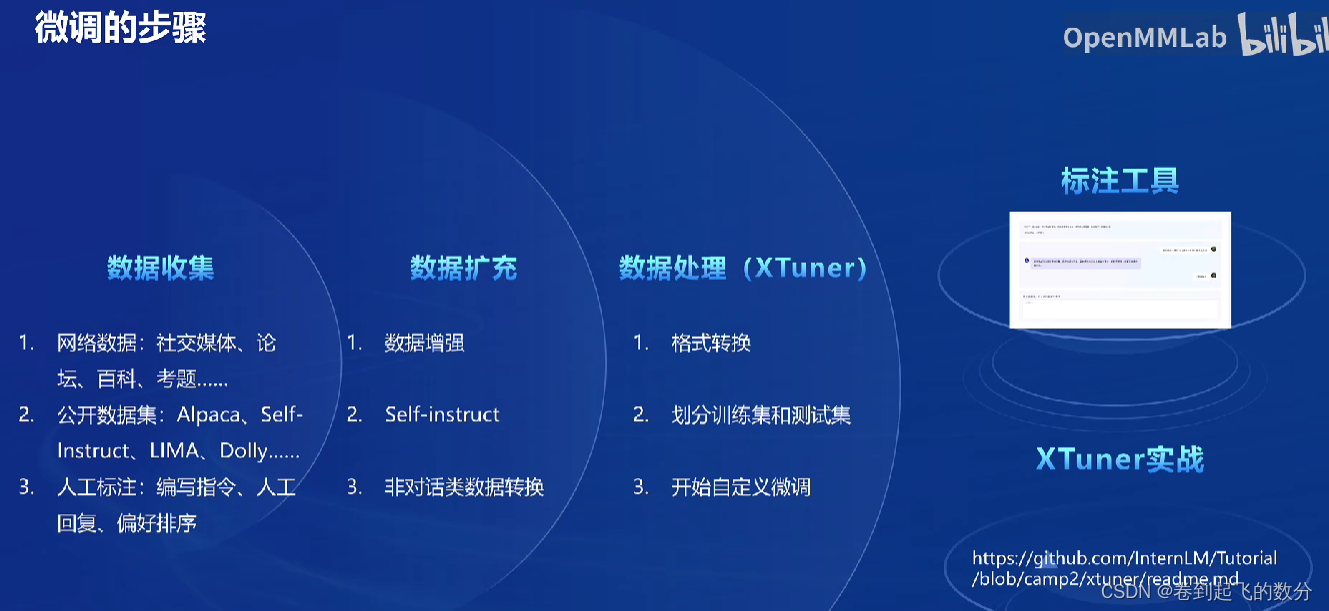

四、微调的步骤

主要步骤比较关键

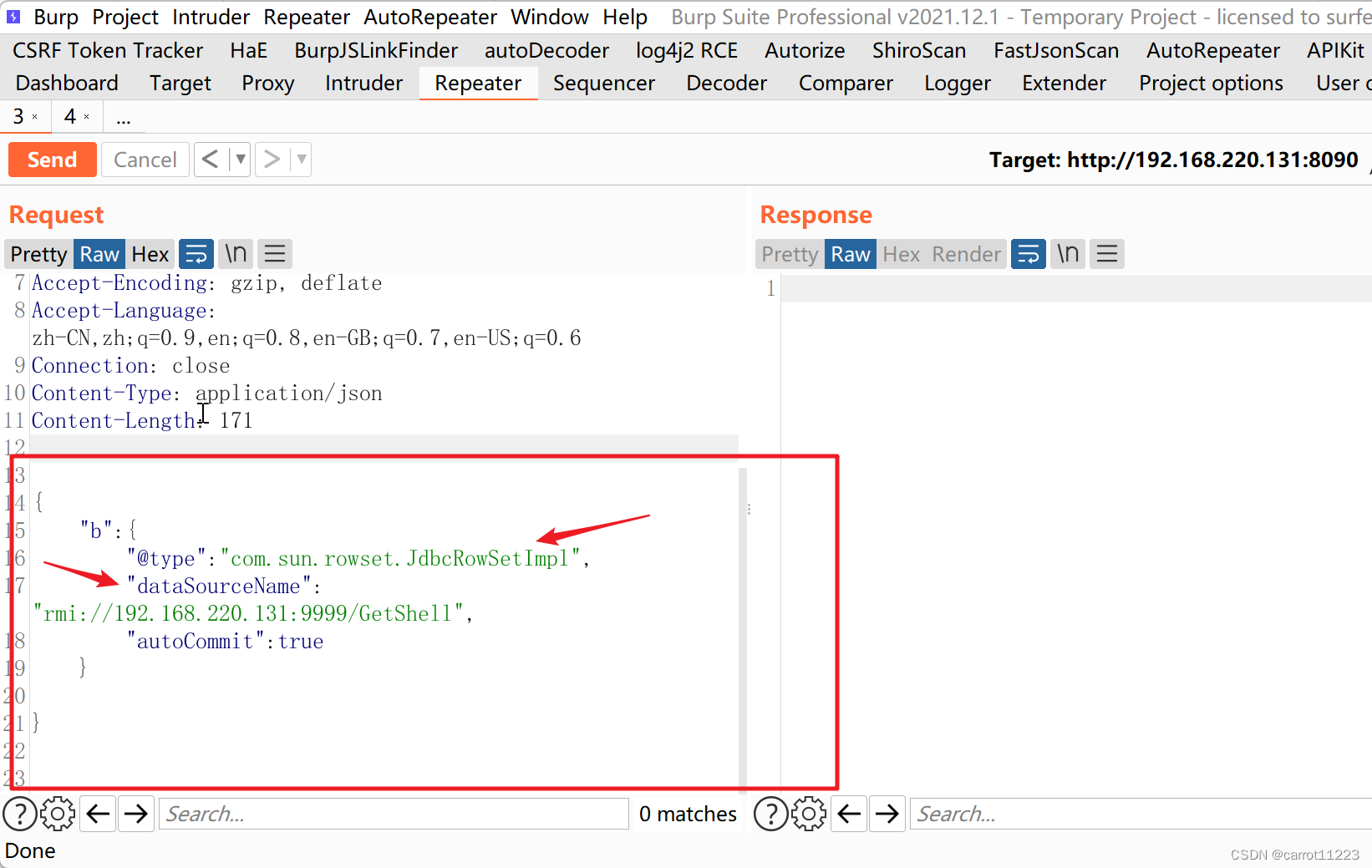

这里主要是微调的数据(集)相关

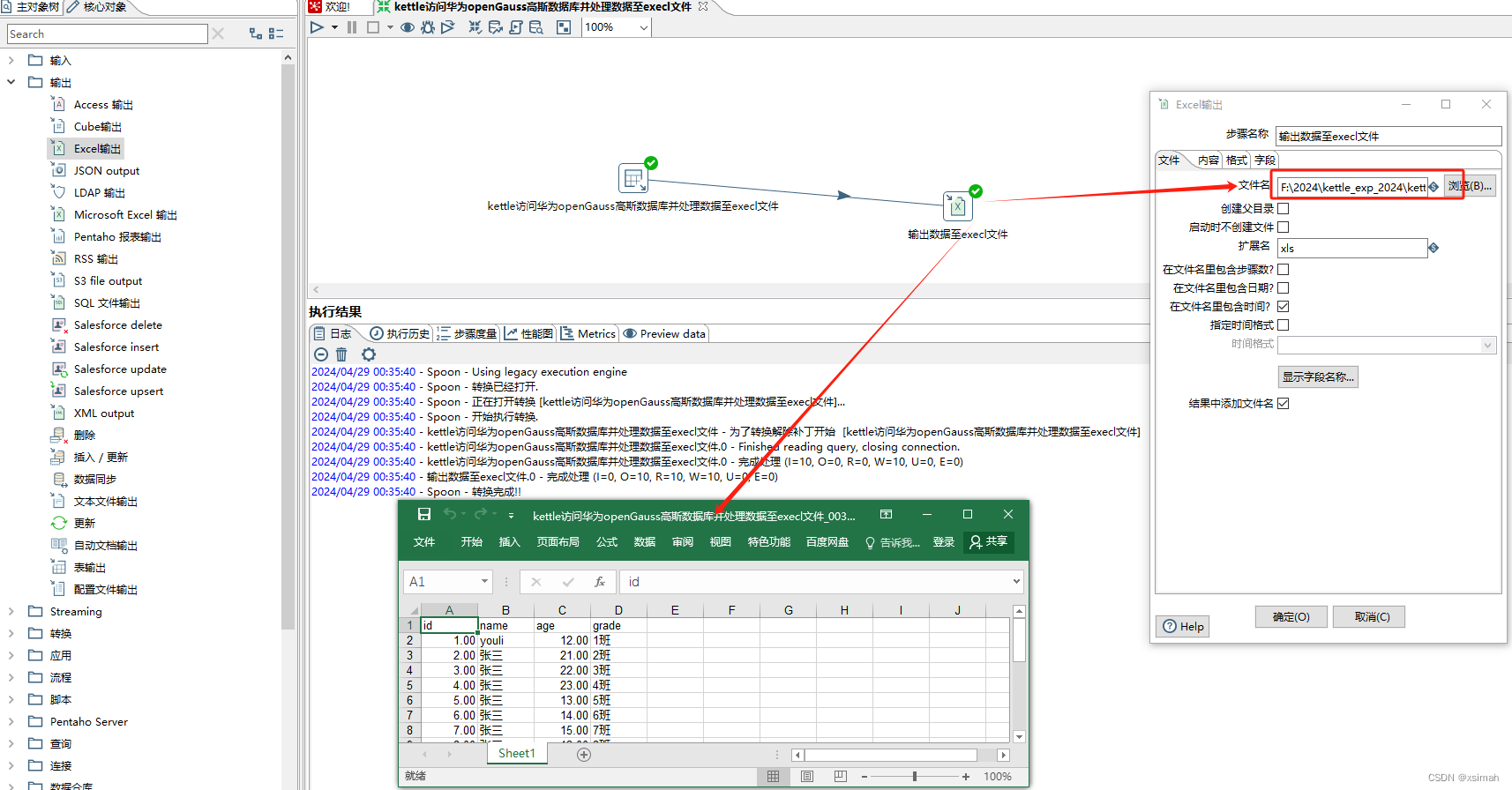

五、微调数据准备

数据(集)直接决定了模型的最终效果。当然数据是什么样的取决于你的需求,你将收集、整理什么样的数据(集)。

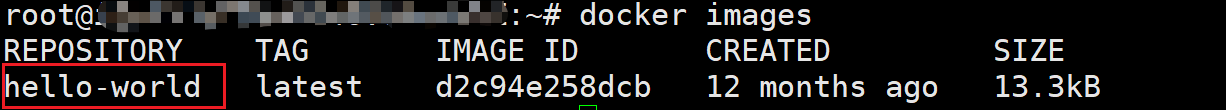

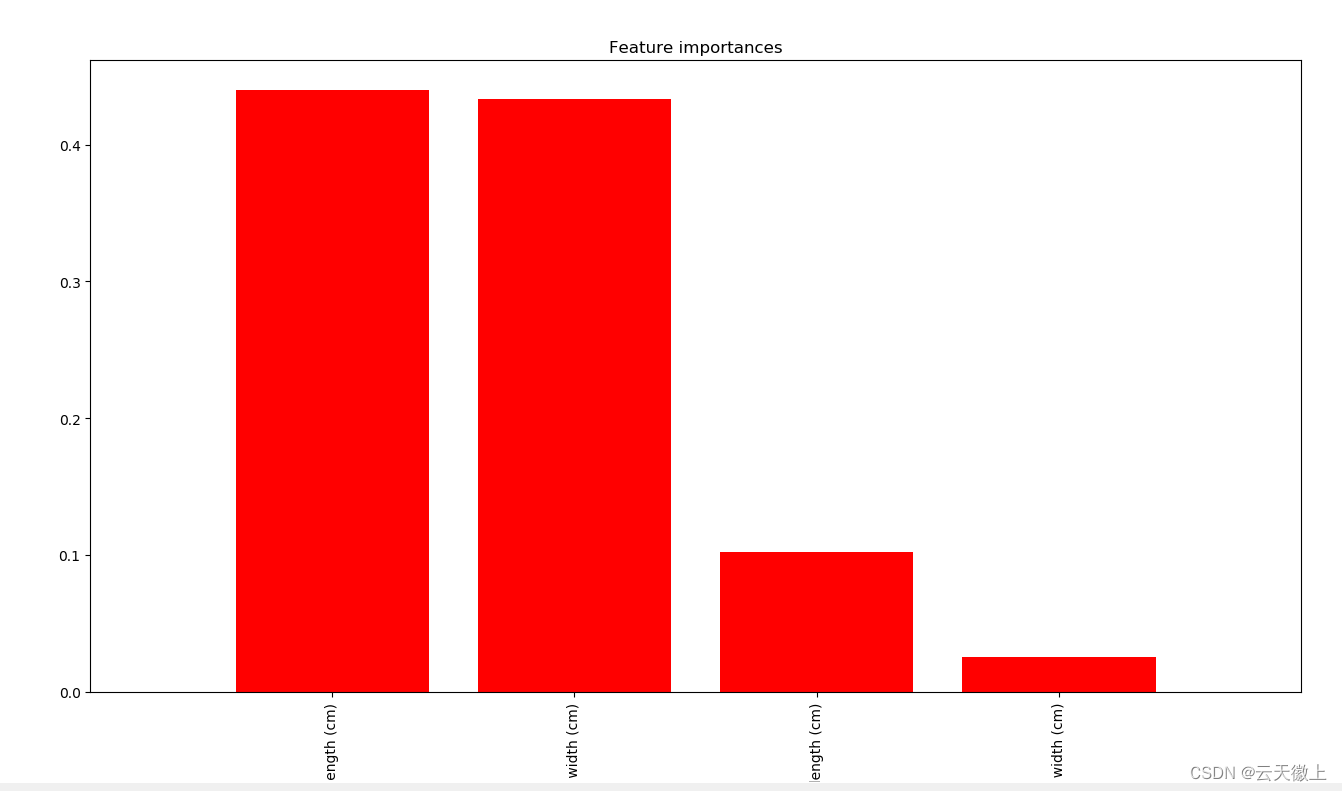

六、微调的数据质量

数据(集)的质量直接反应在微调的效果上

七、微调结果评价