Scrapy 保存数据案例-小说保存

spider

import scrapy

class XiaoshuoSpiderSpider(scrapy.Spider):

name = 'xiaoshuo_spider'

allowed_domains = ['zy200.com']

url = 'http://www.zy200.com/5/5943/'

start_urls = [url + '11667352.html']

def parse(self, response):

info =response.xpath("/html/body/div[@id='content']/text()").extract()

href =response.xpath("//div[@class='zfootbar']/a[3]/@href").extract_first()

yield {'content':info}

if href != 'index.html':

new_url = self.url + href

yield scrapy.Request(new_url,callback=self.parse)

pipeline

class XiaoshuoPipeline(object):

def __init__(self):

self.filename = open("dp1.txt", "w",encoding="utf-8")

def process_item(self, item, spider):

content = item["title"] +item["content"] + '\n'

self.filename.write(content)

self.filename.flush()

return item

def close_spider(self, spider):

self.filename.close()

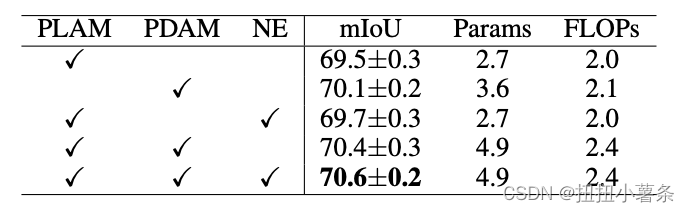

Scrapy 中 CrawlSpider 使用

在Scrapy中Spider是所有爬虫的基类,而CrawSpiders就是Spider的派生类。

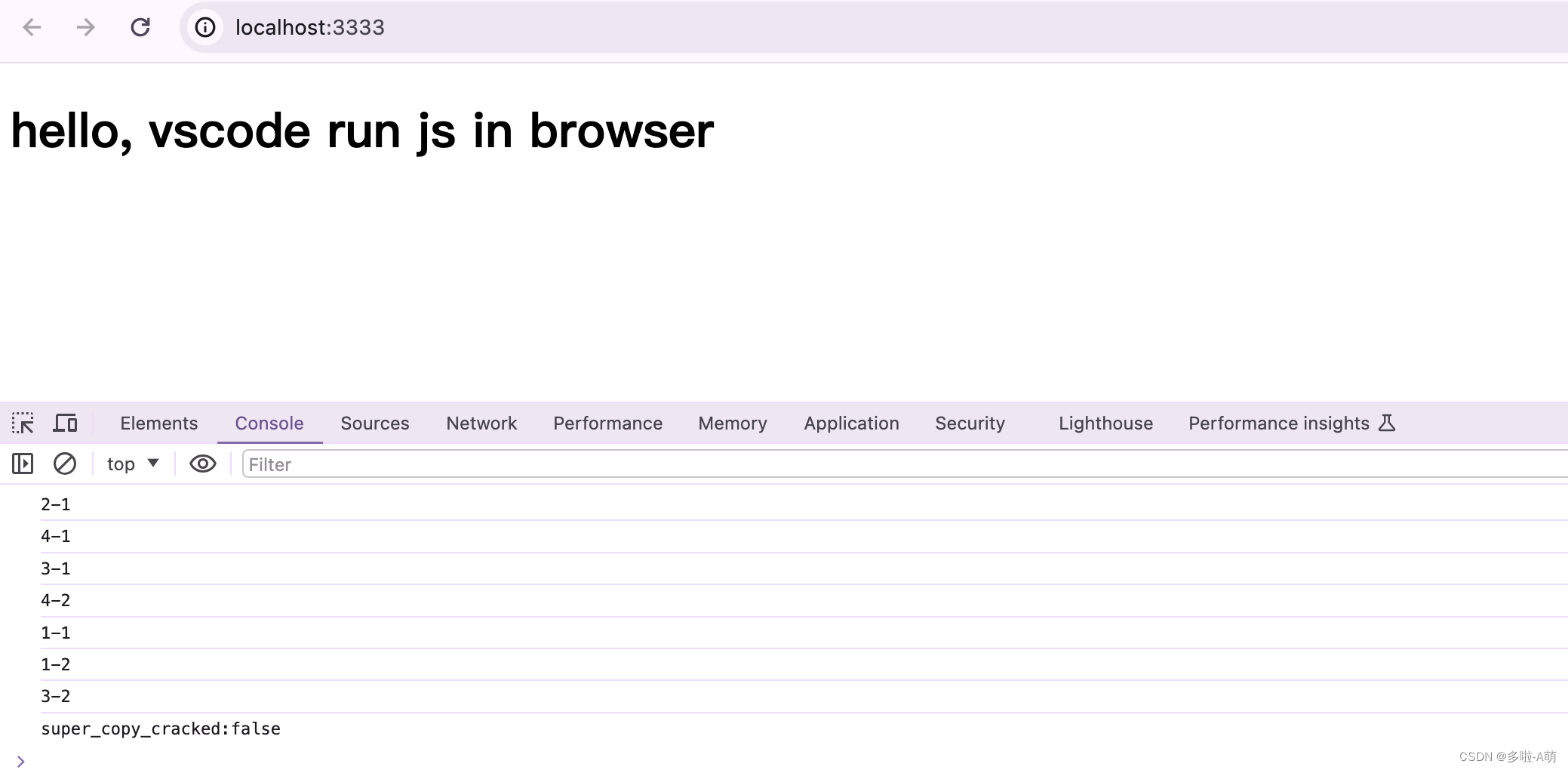

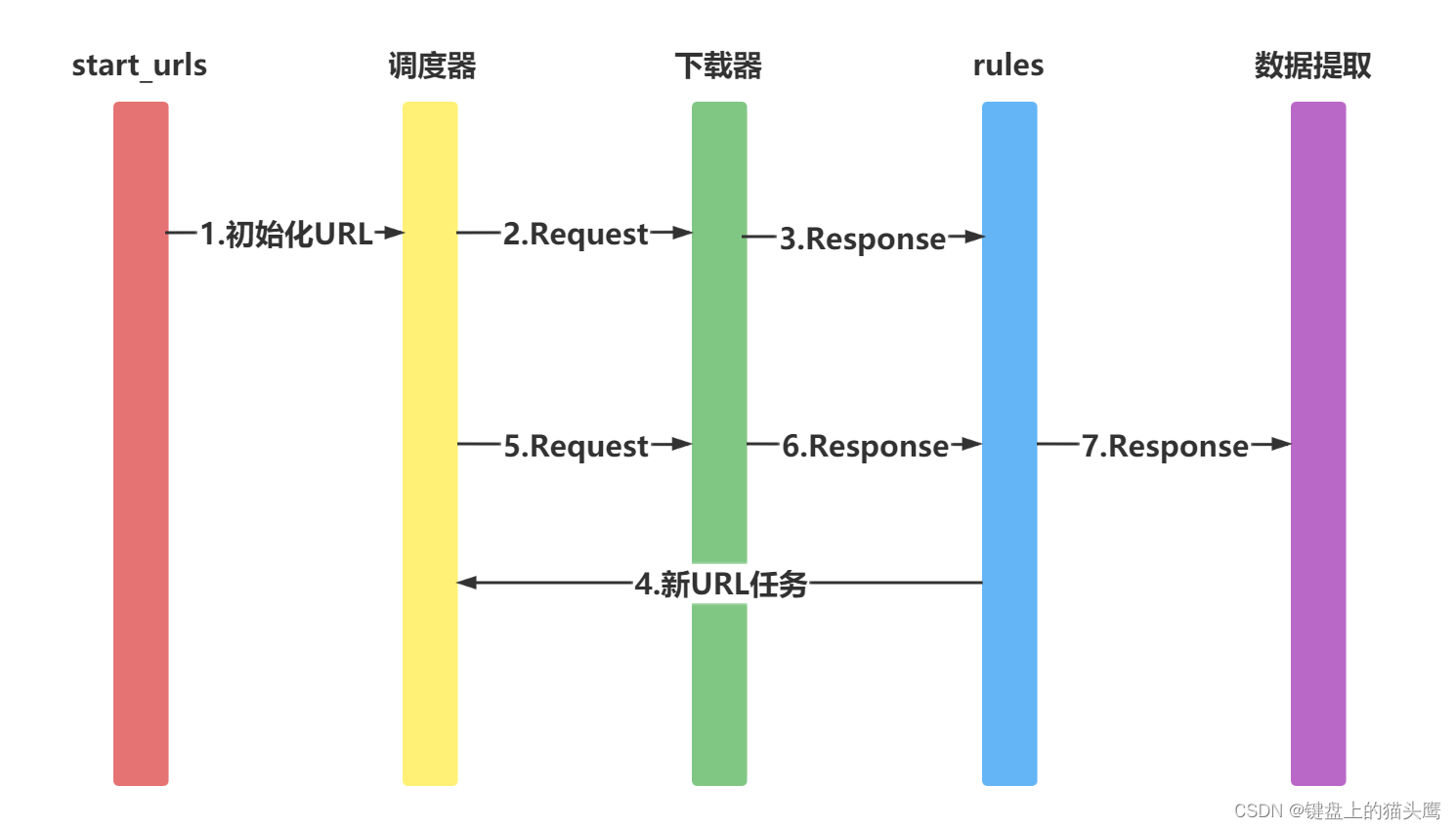

适用于先爬取start_url列表中的网页,再从爬取的网页中获取link并继续爬取的工作。运行图如下:

创建CrawlSpider

scrapy genspider -t crawl 爬虫名 (allowed_url)

使用CrawlSpider中核心的2个类对象

Rule对象

Rule类与CrawlSpider类都位于 scrapy.contrib.spiders 模块中

class scrapy.contrib.spiders.Rule(

link_extractor,

callback=None,

cb_kwargs=None,

follow=None,

process_links=None,

process_request=None)

参数含义:

- link_extractor为LinkExtractor,用于定义需要提取的链接

- callback参数:当link_extractor获取到链接时参数所指定的值作为回调函数

注意

回调函数尽量不要用parse方法,crawlspider已使用了parse方法

- follow:指定了根据该规则从response提取的链接是否需要跟进。当callback为None,默认值为True

- process_links:主要用来过滤由link_extractor获取到的链接

- process_request:主要用来过滤在rule中提取到的request

LinkExtractors

顾名思义,链接提取器

作用

response对象中获取链接,并且该链接会被接下来爬取每个LinkExtractor有唯一的公共方法是 extract_links(),它接收一个 Response 对象,并返回一个 scrapy.link.Link 对象

使用

class scrapy.linkextractors.LinkExtractor(

allow = (),

deny = (),

allow_domains = (),

deny_domains = (),

deny_extensions = None,

restrict_xpaths = (),

tags = ('a','area'),

attrs = ('href'),

canonicalize = True,

unique = True,

process_value = None

)

主要参数:

- allow:满足括号中“正则表达式”的值会被提取,如果为空,则全部匹配。

- deny:与这个正则表达式(或正则表达式列表)不匹配的URL一定不提取。

- allow_domains:会被提取的链接的domains。

- deny_domains:一定不会被提取链接的domains。

- restrict_xpaths:使用xpath表达式,和allow共同作用过滤链接(只选到节点,不选到属性)

- restrict_css:使用css表达式,和allow共同作用过滤链接(只选到节点,不选到属性)

查看效果-shell中验证

首先运行

scrapy shell'https://www.zhhbqg.com/1_1852/835564.html'

继续import相关模块

from scrapy.linkextractors import LinkExtractor

提取当前网页中获得的链接

link = LinkExtractor(restrict_xpaths=(r'//a'))调用LinkExtractor实例的extract_links()方法查询匹配结果

link.extract_links(response)

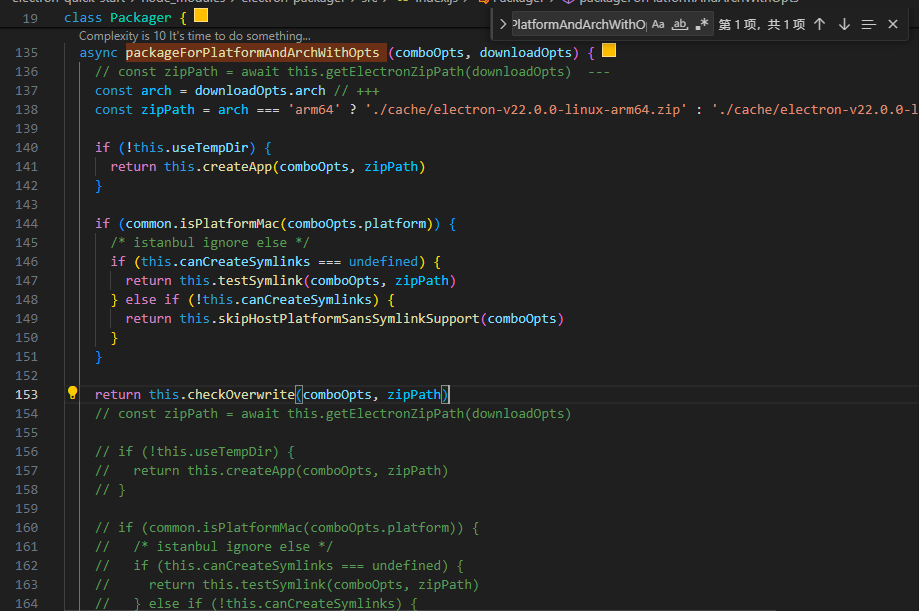

查看效果 CrawlSpider版本

from scrapy.linkextractors import

LinkExtractor

from scrapy.spiders import CrawlSpider, Rule

from xiaoshuo.items import XiaoshuoItem

class XiaoshuoSpiderSpider(CrawlSpider):

name = 'xiaoshuo_spider'

allowed_domains = ['fhxiaoshuo.com']

start_urls =['http://www.fhxiaoshuo.com/read/33/33539/17829387.shtml']

rules = [ Rule(LinkExtractor(restrict_xpaths=(r'//div[@class="bottem"]/a[4]')),callback='parse_item'),]

def parse_item(self, response):

info =

response.xpath("//div[@id='TXT']/text()").extract()

it = XiaoshuoItem()

it['info'] = info

yield it

注意

callback后面函数名用引号引起

函数名不要用parse

参数的括号嵌套,不要出问题

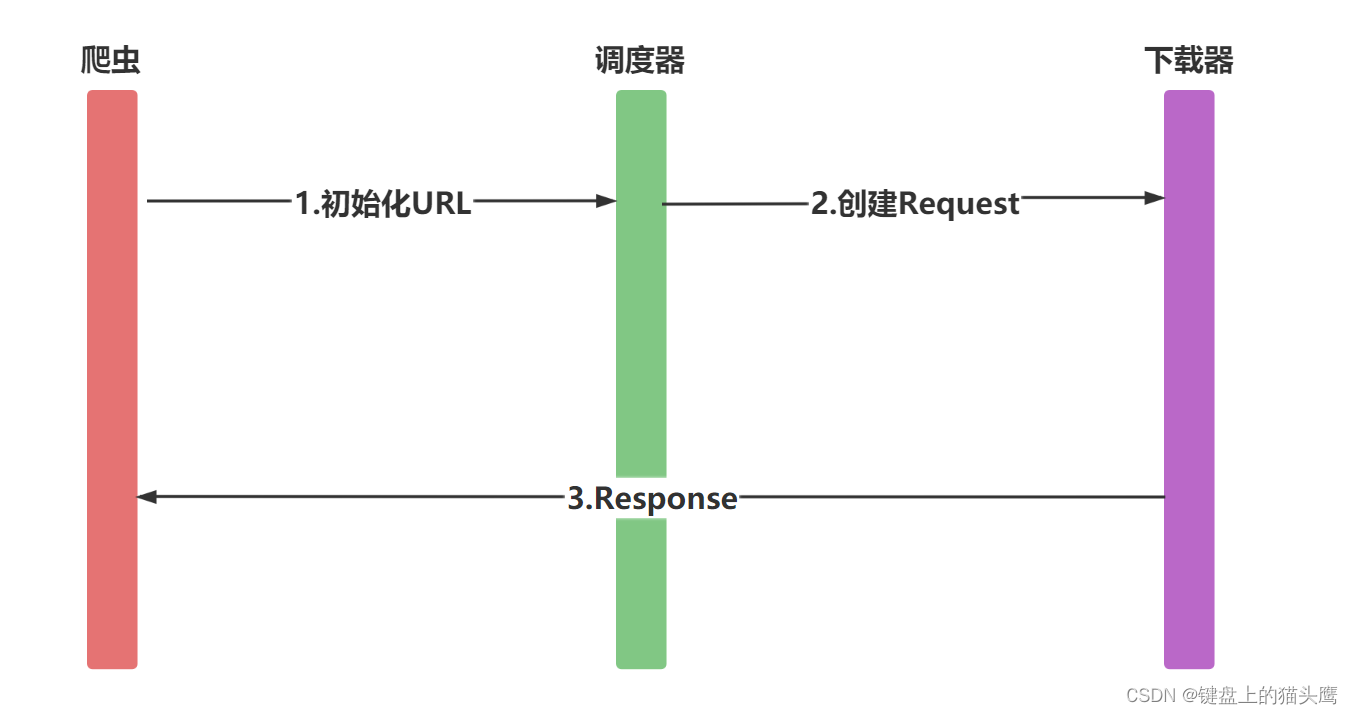

Scrapy 中 Request 的使用

爬虫中请求与响应是最常见的操作,Request对象在爬虫程序中生成并传递到下载器中,后者执行请求并返回一个Response对象

Request对象

class scrapy.http.Request(url[, callback,method='GET', headers, body, cookies, meta,

encoding='utf-8', priority=0,dont_filter=False, errback])

一个Request对象表示一个HTTP请求,它通常是在爬虫生成,并由下载执行,从而生成Response

- 参数

- url(string) - 此请求的网址

- callback(callable) - 将使用此请求的响应(一旦下载)作为其第一个参数调用的函数。有关更多信息,请参阅下面的将附加数据传递给回调函数。如果请求没有指定回调,

parse()将使用spider的 方法。请注意,如果在处理期间引发异常,则会调用errback。 - method(string) - 此请求的HTTP方法。默认为'GET'。可设置为"GET", "POST", "PUT"等,且保证字符串大写

- meta(dict) - 属性的初始值Request.meta,在不同的请求之间传递数据使用

- body(str或unicode) - 请求体。如果unicode传递了,那么它被编码为 str使用传递的编码(默认为utf-8)。如果body没有给出,则存储一个空字符串。不管这个参数的类型,存储的最终值将是一个str(不会是unicode或None)。

- headers(dict) - 这个请求的头。dict值可以是字符串(对

于单值标头)或列表(对于多值标头)。如果 None作为值

传递,则不会发送HTTP头.一般不需要 - encoding: 使用默认的 'utf-8' 就行

- dont_filter:是否过滤重复的URL地址,默认为 False 过滤

- cookie(dict或list) - 请求cookie。这些可以以两种形式发送。

- 使用dict:

request_with_cookies = Request(url="http://www.sxt.cn/index/login/login.html",) - 使用列表:

request_with_cookies = Request(url="http://www.example.com", cookies= [{'name': 'currency', 'value': 'USD', 'domain': 'example.com', 'path': '/currency'}])后一种形式允许定制 cookie的属性domain和path属性。这只有在保存Cookie用于以后的请求时才有用

request_with_cookies = Request(url="http://www.example.com", cookies={'currency': 'USD', 'country': 'UY'}, meta={'dont_merge_cookies': True})

- 使用dict:

将附加数据传递给回调函数

请求的回调是当下载该请求的响应时将被调用的函数。将使用下载的Response对象作为其第一个参数来调用回调函数

def parse_page1(self, response):

item = MyItem()

item['main_url'] = response.url

request =scrapy.Request("http://www.example.com/some_page.html",

callback=self.parse_page2)

request.meta['item'] = item

return request

def parse_page2(self, response):

item = response.meta['item']

item['other_url'] = response.url

return item

Scrapy 中 FormRequest 的使用

FormRequest是Request的扩展类,具体常用的功能如下:

- 请求时,携带参数,如表单数据

- 从Response中获取表单的数据

FormRequest类可以携带参数主要原因是:增加了新的构造函数的参数 formdata 。其余的参数与Request类相同.

- formdata参数类型为:dict

class scrapy.http.FormRequest(url[, formdata, ...])

class method from_response(response[,

formname=None, formid=None, formnumber=0,

formdata=None, formxpath=None, formcss=None,

clickdata=None, dont_click=False, ...])

返回一个新FormRequest对象,其中的表单字段值已预先 <form> 填充在给定响应中包含的HTML 元素中.

参数:

- response(Responseobject) - 包含将用于预填充表单字段的HTML表单的响应

- formname(string) - 如果给定,将使用name属性设置为此值的形式

- formid(string) - 如果给定,将使用id属性设置为此值的形式

- formxpath(string) - 如果给定,将使用匹配xpath的第一个表单

- formcss(string) - 如果给定,将使用匹配css选择器的第一个形式

- formnumber(integer) - 当响应包含多个表单时要使用的表单的数量。第一个(也是默认)是0

- formdata(dict) - 要在表单数据中覆盖的字段。如果响应元素中已存在字段,则其值将被在此参数中传递的值覆盖

- clickdata(dict) - 查找控件被点击的属性。如果没有提供,表单数据将被提交,模拟第一个可点

- 击元素的点击。除了html属性,控件可以通过其相对于表单中其他提交表输入的基于零的索引,通

- 过nr属性来标识

- dont_click(boolean) - 如果为True,表单数据将在不点击任何元素的情况下提交

请求使用示例

通过HTTP POST发送数据

FormRequest(

url="http://www.example.com/post/action",

formdata={'name': 'John Doe','age': '27'},

callback=self.after_post

)

通过FormRequest.from_response()发送数据

FormRequest.from_response(

response,

formdata={'username': 'john','password': 'secret'},

callback=self.after_login

)

响应对象

class scrapy.http.Response(url[, status=200,

headers=None, body=b'', flags=None,request=None])一个Response对象表示的HTTP响应,这通常是下载器下载后,并供给到爬虫进行处理

参数:

- url(string) - 此响应的URL

- status(integer) - 响应的HTTP状态。默认为200

- headers(dict) - 这个响应的头。dict值可以是字符串(对于单值标头)或列表(对于多值标头)

- body(bytes) - 响应体。它必须是str,而不是unicode,除非你使用一个编码感知响应子类,如TextResponse

- flags(list) - 是一个包含属性初始值的 Response.flags列表。如果给定,列表将被浅复制

- request(Requestobject) - 属性的初始值Response.request。这代表Request生成此响应

- text 获取文本

Scrapy中下载中间件

下载中间件是Scrapy请求/响应处理的钩子框架。这是一个轻、低层次的应用。

通过可下载中间件,可以处理请求之前和请求之后的数据。

每个中间件组件都是一个Python类,它定义了一个或多个以下方法,我们可能需要使用方法如下:

- process_request()

- process_response()

process_request(self, request, spider)

当每个request通过下载中间件时,该方法被调用

必须返回以下其中之一

- 返回 None

- Scrapy 将继续处理该 request,执行其他的中间件的相应方法,直到合适的下载器处理函数(download handler)被调用,该 request 被执行(其 response 被下载)

- 返回一个 Response 对象

- Scrapy 将不会调用 任何 其他的 process_request()或 process_exception()方法,或相应地下载函数; 其将返回该 response。已安装的中间件的 process_response()方法则会在每个response 返回时被调用

- 返回一个 Request 对象

- Scrapy 则停止调用 process_request 方法并重新调度返回的 request。当新返回的 request被执行后, 相应地中间件链将会根据下载的 response 被调用

- raise IgnoreRequest

- 如果抛出 一个 IgnoreRequest 异常,则安装的下载中间件的 process_exception() 方法会被调用。如果没有任何一个方法处理该异常, 则 request 的 errback(Request.errback)方法会被调用。如果没有代码处理抛出的异常, 则该异常被忽略且不记录(不同于其他异常那样)

参数:

- request (Request 对象) – 处理的request

- spider (Spider 对象) – 该request对应的spider

process_response(self, request, response, spider)

当下载器完成http请求,传递响应给引擎的时候调用

process_response()应该是:返回一个 Response 对象,则返回一个Request 对象或引发 IgnoreRequest 例外情况。

- 如果它返回 Response (可能是相同的给定响应,也可能是全新的响应),该响应将继续使用 process_response() 链中的下一个中间件

- 如果它返回一个 Request 对象时,中间件链将暂停,返回的请求将重新计划为将来下载。这与从返回请求的行为相同process_request()

- 如果它引发了 IgnoreRequest 异常,请求的errback函数 ( Request.errback)。如果没有代码处理引发的异常,则忽略该异常,不记录该异常(与其他异常不同)。

- 参数

- request (is a Request object) -- 发起响应的请求

- response ( Response object) -- 正在处理的响应

- spider ( Spider object) -- 此响应所针对的蜘蛛