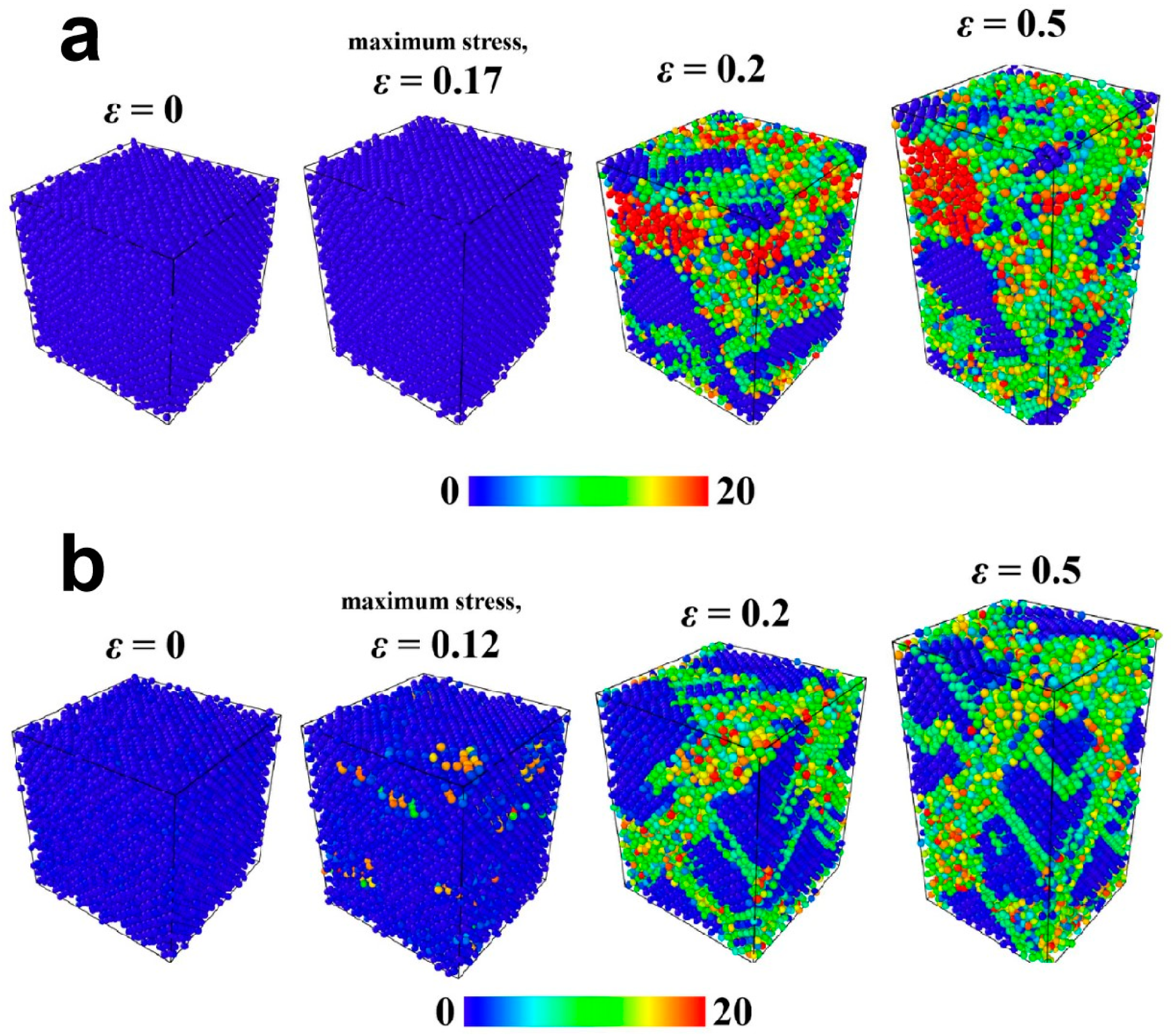

本文重点

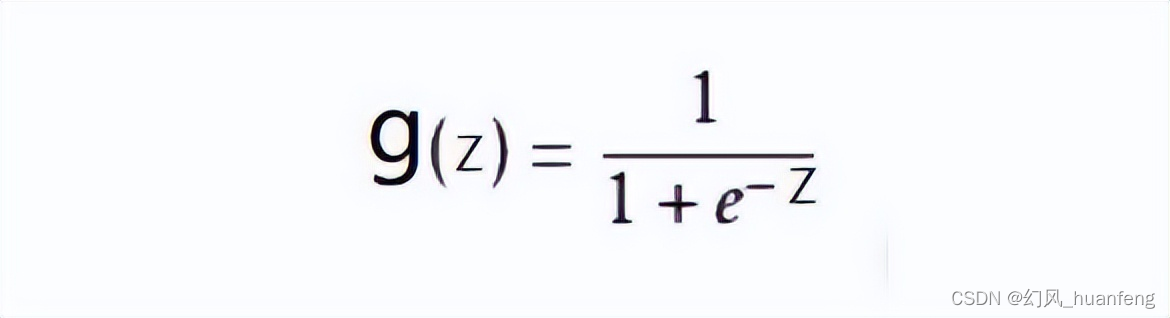

我们在机器学习专栏中已经学习了逻辑回归算法,本次课程我们将重温逻辑回归算法,该算法适用于二分类的问题,本文主要介绍逻辑回归的假设函数。我们在学习线性回归算法的时候,我们已经知道了线性回归算法的假设hθ(x)=θTX(参数θ的转置*X),但是对于逻辑回归而言,我们要把这个假设函数稍微给改一下,逻辑回归的假设函数改为:hθ(x)=g(θTX),g函数是什么呢?

函数g

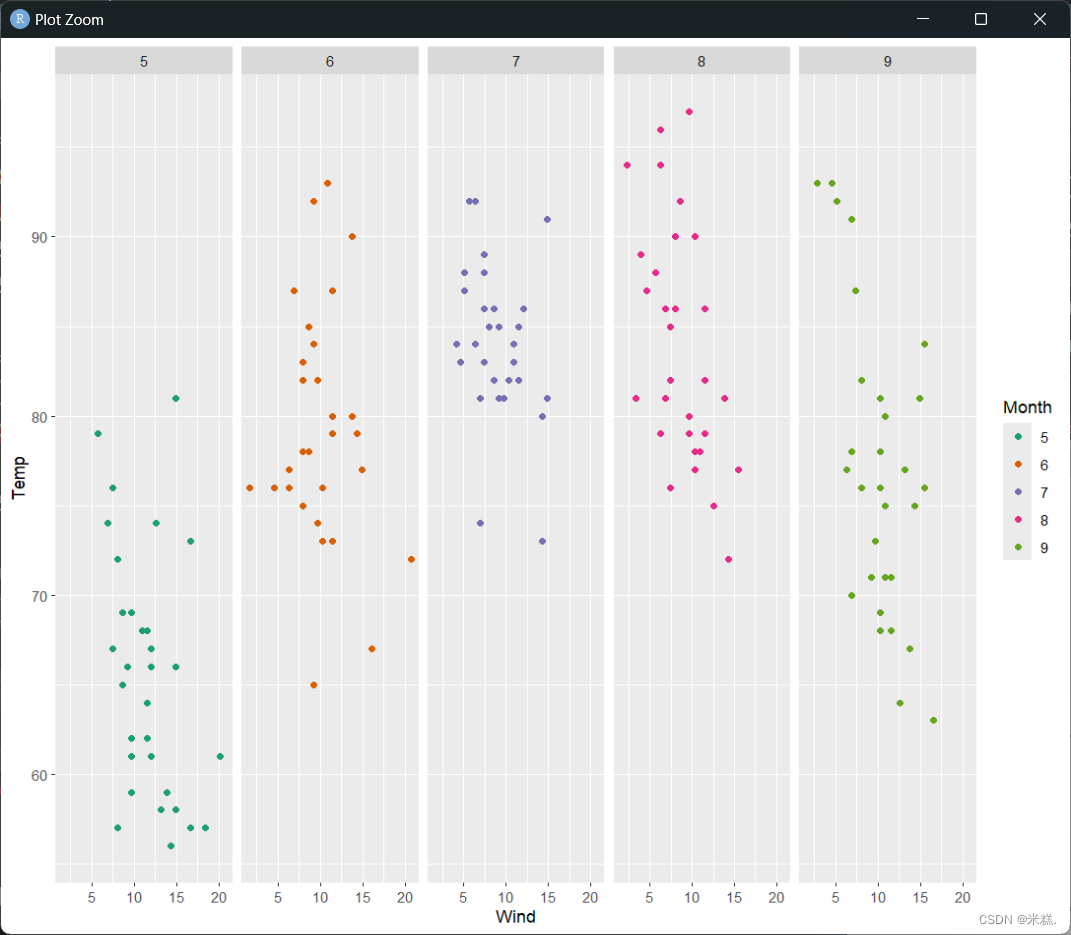

其中g函数的图像为:

上图sigmid的图像,它的自变量是z也就是θTx。

对于sigmoid函数来说只要自变量z大于0,那么它的因变量值就大于0.5,那么此时就表示此时样本是正类,如果z小于0,那么h(θ)的值就小于0.5,就表示样本为负类。所以我们通过阈值0.5来判断我们的样本是正类还是负类。Z如果非常大,那么g(z)将近似等于1,反之就会近似等于0。

逻辑回归的假设在计算什么

我们可以理解为逻辑回归的假设的含义是:对于给定的输入变量x,根据选择的参数θ计算输出变量y=1 的可能性,也就是该样本类别为1的概率