目录

- 概述

- 细节

- 错误分析

概述

本文是基于单目图像的3D目标检测方法。

【2021】【MonoDLE】

研究的问题:

-

核心问题:如何提高基于单目图像的3D目标检测的效果。作者量化了每个子任务的整体影响,观察到以下现象

-

观察一:定位误差是制约目标检测性能的关键因素,当然还有深度估计以及3D中心的2D投影。

-

观察二:随着深度的增加,检测性能显著下降(对于很近的物体,性能也很差),甚至超过一定距离几乎不可能准确检测。我们将这些几乎无法准确检测的远距离样本称为坏样本,这些样本会降低模型对于易于检测样本的表示,危害整体性能

-

观察三:尺寸估计也是制约目标检测性能的重要因素。现存的研究倾向于单独优化边界框的各个部分,未能考虑每个部分对于最终的指标(3DIOU)的贡献

解决方法:

- 重新审视了2D边界框中心与3D边界框中心投影的不对齐。认为需要2D目标检测的分支,因为有助于学习3D检测的共享特征(这个观点和SMOKE刚好相反)

- 在训练集中移除坏样本或者减少这些样本的训练权重

- 一种面向3D IOU的尺寸估计损失,根据样本对于3D IOU的贡献动态调整损失权重

细节

错误分析

目标:检测物体的类别、2D检测框以及3D检测框

基准模型:CenterNet+7个检测头

错误分析方法:将预测值替换为真值并且评估性能

错误分析的结果:可以发现,基准模型的评估指标是11.12,各个部分如果完全预测准确,都能带来性能的提升(比如第一个3D边界框中心投影预测准确是的评估指标达到了23.90),其中带来提升最大的就是3D位置预测,而这个部分需要3D边界框中心投影预测+深度预测。其中深度预测是困难的,所以我们可以在3D边界框中心投影预测上下功夫。

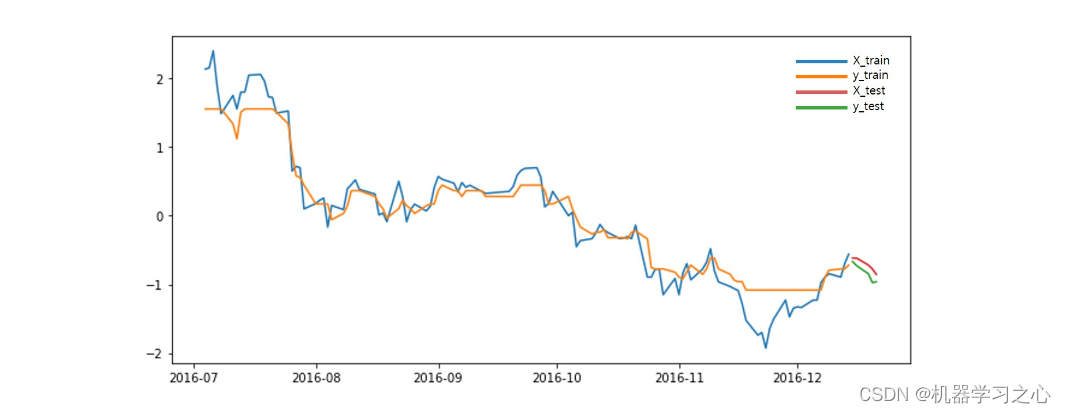

定位错误产生的影响:3D边界框中心投影预测在不同深度下产生偏移带来的影响:3D边界框中心投影预测偏移

(

2

,

2

)

(2,2)

(2,2)会导致60m处的物体偏移0.24m,5m处的物体偏移0.02m。

注意,上面的偏移还是在深度估计完全准确的情况下,但事实上,单目的深度估计也会有很大的误差。这也就说明,当前从单目图像中准确估计远处物体的3D包围框几乎是不可能的任务。