公众号:Halo咯咯,欢迎关注~

前文回顾:

- Transformers -- 以通俗易懂的方式解释 - Part 1

- Transformers -- 未知英雄 - Part 2

世界正在为人工智能和生成式人工智能而疯狂,特别是 2023 年的 ChatGPT 和大型语言模型。在我们讨论本系列后续部分的技术细节之前,让我们先从它的想法和生态系统开始。

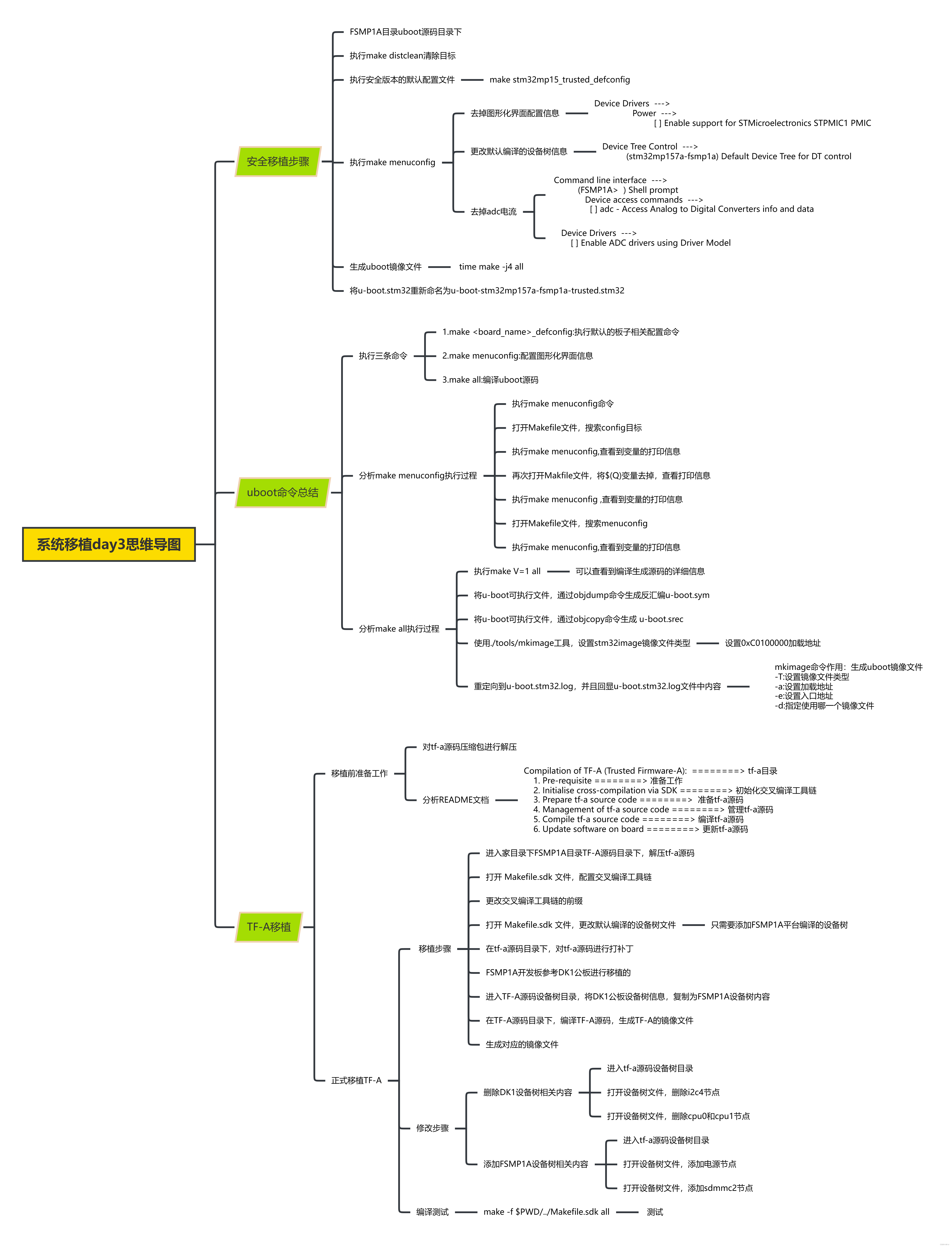

Transformers 架构

在2017年,谷歌发布了一篇具有里程碑意义的论文——《Attention Is All You Need》,该论文提出了一种名为Transformers的创新架构,这一架构为自然语言处理领域带来了革命性的变革。Transformers摒弃了传统的循环神经网络(RNNs)和卷积神经网络(CNNs),转而采用注意力机制,从而显著提升了模型的性能和效率。得益于其出色的并行处理能力,Transfor

![[数据结构]排序](https://img-blog.csdnimg.cn/direct/4e2be02c5f9a4590885da734d4f569a7.png)