SCI一区 | Matlab实现RIME-TCN-BiGRU-Attention霜冰算法优化时间卷积双向门控循环单元融合注意力机制多变量时间序列预测

目录

- SCI一区 | Matlab实现RIME-TCN-BiGRU-Attention霜冰算法优化时间卷积双向门控循环单元融合注意力机制多变量时间序列预测

- 预测效果

- 基本介绍

- 模型描述

- 程序设计

- 参考资料

预测效果

基本介绍

1.基于RIME-TCN-BiGRU-Attention霜冰算法优化时间卷积双向门控循环单元融合注意力机制多变量时间序列预测,要求Matlab2023版以上,自注意力机制,一键单头注意力机制替换成多头注意力机制;

2.输入多个特征,输出单个变量,考虑历史特征的影响,多变量时间序列预测;

3.data为数据集,main.m为主程序,运行即可,所有文件放在一个文件夹;

4.命令窗口输出R2、MSE、MAE、MAPE和RMSE多指标评价;

5.优化学习率,神经元个数,注意力机制的键值, 正则化参数。

模型描述

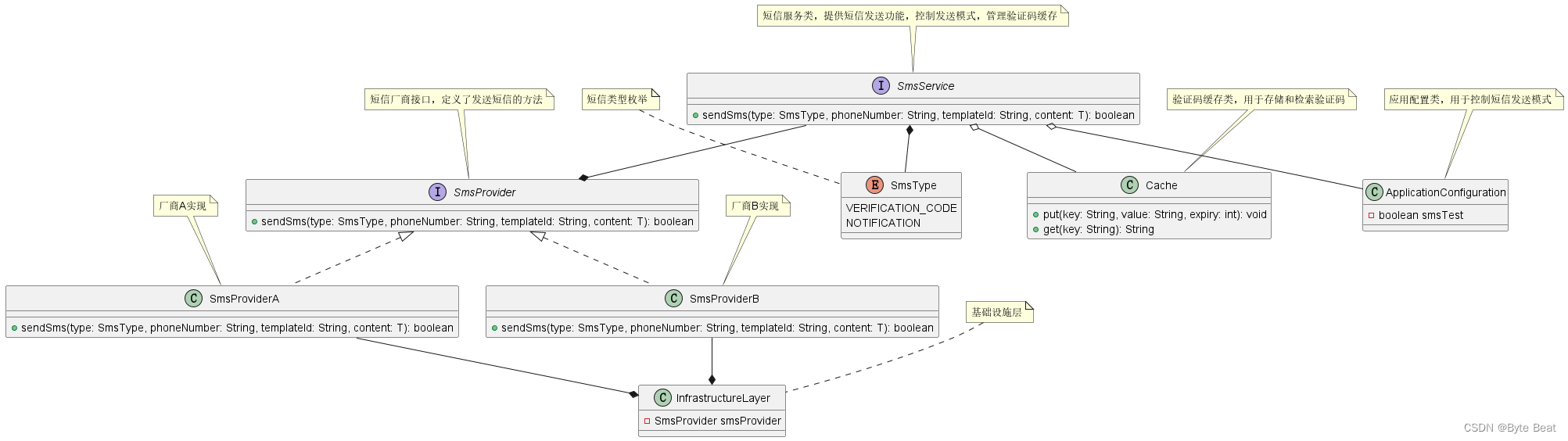

RIME-TCN-BiGRU-Attention算法结合了霜冰算法(RIME)、时间卷积网络(TCN)、双向门控循环单元(BiGRU)以及注意力机制(Attention),旨在优化多变量时间序列预测。下面是对这一算法的详细解析:

霜冰算法(RIME):霜冰算法是一种优化算法,其灵感来源于雾霾冰生长机制。通过模拟软霜冰粒子的运动,该算法提出了一种用于算法搜索的霜冰搜索策略。在RIME-TCN-BiGRU-Attention中,霜冰算法可能用于优化模型的参数,提高预测精度。

时间卷积网络(TCN):TCN是一种特殊的卷积神经网络,特别适用于处理时间序列数据。通过捕捉数据中的局部和全局依赖关系,TCN能够提取出时间序列中的关键特征。在RIME-TCN-BiGRU-Attention中,TCN可能用于从原始时间序列数据中提取有用的特征。

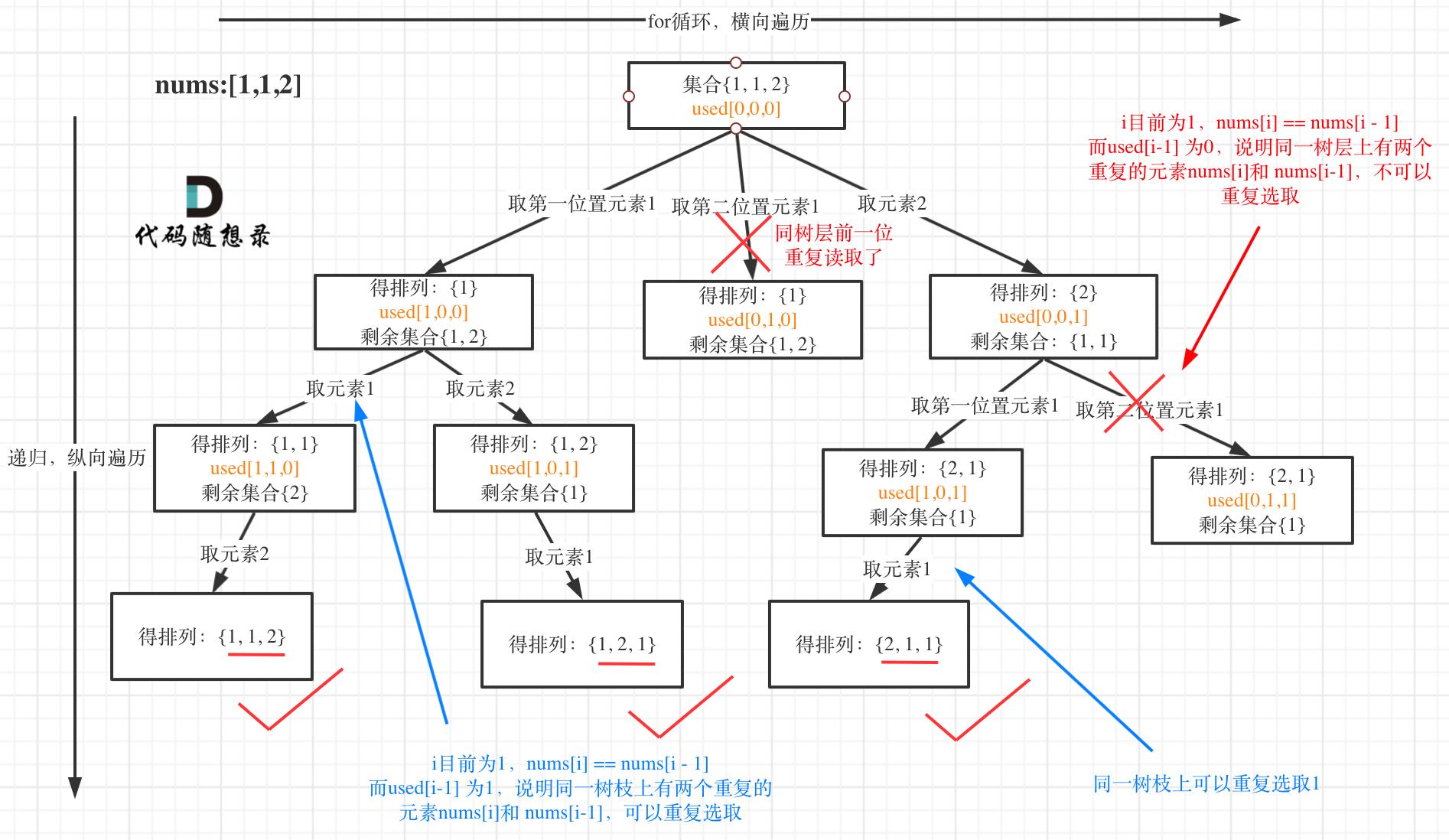

双向门控循环单元(BiGRU):BiGRU是RNN的一种变体,能够同时捕捉序列数据中的正向和反向依赖关系。这使得BiGRU在处理时间序列数据时具有更强的表征能力。在RIME-TCN-BiGRU-Attention中,BiGRU可能用于进一步处理TCN提取的特征,并捕捉时间序列中的长期依赖关系。

注意力机制(Attention):注意力机制能够赋予模型关注输入数据中重要部分的能力,从而提高模型的预测性能。在RIME-TCN-BiGRU-Attention中,注意力机制可能用于增强模型对关键时间步长的关注,进一步提高预测精度。

综上所述,RIME-TCN-BiGRU-Attention算法通过结合霜冰算法、时间卷积网络、双向门控循环单元以及注意力机制,旨在充分利用多变量时间序列数据中的信息,提高预测精度和性能。该算法在实际应用中可能具有广泛的应用前景,如金融预测、能源管理、交通流量预测等领域。

需要注意的是,算法的性能和效果往往受到多种因素的影响,包括数据质量、模型参数设置、训练策略等。因此,在实际应用中,需要根据具体情况进行模型调整和优化,以达到最佳的预测效果。

程序设计

- 完整源码和数据获取方式私信博主回复Matlab实现RIME-TCN-BiGRU-Attention霜冰算法优化时间卷积双向门控循环单元融合注意力机制多变量时间序列预测。

convolution1dLayer(filterSize,numFilters,DilationFactor=dilationFactor,Padding="causal")

layerNormalizationLayer

reluLayer

dropoutLayer(dropoutFactor)

additionLayer(2,Name="add_"+i)];

% Add and connect layers.

lgraph = addLayers(lgraph,layers);

lgraph = connectLayers(lgraph,outputName,"conv1_"+i);

% Skip connection.

if i == 1

% Include convolution in first skip connection.

layer = convolution1dLayer(1,numFilters,Name="convSkip");

lgraph = addLayers(lgraph,layer);

lgraph = connectLayers(lgraph,outputName,"convSkip");

lgraph = connectLayers(lgraph,"convSkip","add_" + i + "/in2");

else

lgraph = connectLayers(lgraph,outputName,"add_" + i + "/in2");

end

% Update layer output name.

outputName = "add_" + i;

end

tempLayers = flattenLayer("Name","flatten");

lgraph = addLayers(lgraph,tempLayers);

tempLayers = gruLayer(NumNeurons,"Name","gru1");

lgraph = addLayers(lgraph,tempLayers);

tempLayers = [

FlipLayer("flip3")

gruLayer(NumNeurons,"Name","gru2")];

lgraph = addLayers(lgraph,tempLayers);

tempLayers = [

concatenationLayer(1,2,"Name","concat")

参考资料

[1] https://blog.csdn.net/kjm13182345320/article/details/128577926?spm=1001.2014.3001.5501

[2] https://blog.csdn.net/kjm13182345320/article/details/128573597?spm=1001.2014.3001.5501