文章目录

- 自我介绍

- MySQL

- 索引

- 索引种类、B+树

- 聚簇索引、非聚簇索引

- 联合索引、最左前缀匹配原则

- 索引下推

- 索引失效

- 索引优化

- 日志、缓冲池

- redo log(重做日志)

- 刷盘时机

- 日志文件组

- bin log(归档日志)

- 记录格式

- 写入机制

- 两阶段提交

- undo log(回滚日志)

- Buffer Pool缓冲池

- 主从复制、分库分表

- **主从复制**

- **分库分表**

- 事务、MVCC

- ACID特性

- 隔离级别

- MVCC

- 隐藏字段

- ReadView

- undo-log

- 数据可见性算法

- RC 和 RR 隔离级别下 MVCC 的差异

- MVCC+临建锁防止幻读

- 可重复读不完全解决幻读

- InnoDB、插入缓存、预读

- 四大特性

- MyISAM和InnoDB有什么区别?

- sql语句执行过程、mysql架构

- sql语句执行过程

- mysql基本架构概览

- 慢查询、执行计划

- mysql中的锁

- 表级锁和行级锁对比

- 记录锁、间隙锁、临建锁、插入意向锁(行锁)

- 共享锁和排他锁

- 意向锁(表锁)

- 数据存储、行格式

- 表空间文件结构

- 行格式

- 行溢出

- 磁盘IO过高优化

- mysql、sql语句优化

- 框架

- Spring

- IOC

- Bean 的作用域

- Bean 是线程安全的吗?

- Bean 的生命周期

- 循环依赖/循环引用

- AOP

- Spring 框架的设计模式

- Spring 事务

- 管理事务的方式

- 事务传播行为

- 工作原理

- 事务失效

- SpringMVC

- 核心组件

- 执行流程/工作原理

- SpringBoot

- 自动装配/自动配置

- Mybatis

- 执行流程

- 分页插件

- 延迟加载

- 多级缓存

- 一级缓存

- 二级缓存

- JVM

- jvm参数

- 监控工具

- java内存区域

- 运行时数据区

- 程序计数器

- 程序计数器为什么是私有的?

- java虚拟机栈

- 虚拟机栈和本地方法栈为什么是私有的?

- 本地方法栈

- 堆

- 方法区

- 运行时常量池

- 字符串常量池

- JDK 1.7 为什么要将字符串常量池移动到堆中?

- 直接内存

- 对象创建、布局、访问过程

- 对象的创建

- 对象的内存布局

- 对象的访问定位

- jvm垃圾回收

- 内存分配和回收原则

- 死亡对象判断方法、GCRoots

- 四种引用类型

- **如何判断一个类是无用类**?

- 垃圾回收算法

- 标记清除

- 标记复制

- 标记整理

- 分代收集

- 垃圾收集器

- Serial收集器

- ParNew收集器

- Parallel Scavenge收集器

- Serial Old收集器

- Parallel Old收集器

- CMS收集器

- G1收集器

- ZGC收集器

- STW

- 类文件结构

- Class文件结构

- 类加载过程

- 类的生命周期

- 类加载过程

- 加载

- 验证

- 准备

- 解析

- 初始化

- 类卸载

- 类加载器

- 类加载器加载规则

- 3个内置类加载器

- 自定义类加载器

- 双亲委派模型

- 执行流程

- 好处

- 打破双亲委派、tomcat

- JUC

- 四大锁、锁升级、锁降级、锁粗化、锁消除

- 读锁为什么不能升级为写锁?

- 共享锁和独占锁

- 可中断锁和不可中断锁

- 公平锁和非公平锁

- 乐观锁和悲观锁

- 乐观锁存在哪些问题

- JMM、指令重排、并发三特性

- 指令重排序

- volatile如何禁止指令重排序?

- JMM、happens-before

- Java 内存区域和 JMM 有何区别?

- happens-before 原则

- happens-before 常见规则有哪些?

- happens-before 和 JMM 什么关系?

- 并发三个特性

- 原子性

- volatile 可以保证原子性么?

- 可见性

- volatile如何保证变量的可见性?

- 有序性

- 线程池

- Executor框架

- 工作原理/流程

- `Runnable` vs `Callable`

- `execute()` vs `submit()`

- `shutdown()`VS`shutdownNow()`

- `isTerminated()` VS `isShutdown()`

- 常见内置线程池

- FixedThreadPool

- SingleThreadExecutor

- CachedThreadPool

- ScheduledThreadPool

- 为什么不推荐使用内置线程池?

- 线程池常见参数

- 线程池饱和策略(拒绝策略)

- AQS

- AQS核心思想

- AQS 资源共享方式

- 常见同步工具类

- Semaphore(信号量)

- CountDownLatch(倒计时器)

- CyclicBarrier(循环栅栏)

- Atomic原子类

- ThreadLocal

- 数据结构

- Hash 冲突、过期清理

- set()

- 扩容机制

- get()详解

- 内存泄露

- CompletableFuture

- CompletableFuture 类有什么用?

- 并发和并行

- 同步、异步、阻塞、非阻塞

- 四种组合

- 线程间协作方式

- 线程生命周期和状态

- 线程上下文切换

- 什么是线程死锁?如何避免死锁?

- sleep() 方法和 wait() 方法

- Sychronized

- 概述

- 构造方法可以用synchronized修饰吗?

- synchronized底层原理

- ReentrantLock

- synchronized 和 ReentrantLock 有什么区别?

- ReentrantReadWriteLock

- ReentrantReadWriteLock 适合什么场景?

- StampedLock

- StampedLock 的性能为什么更好?

- StampedLock 适合什么场景?

- StampedLock 的底层原理

- Future

- Future有什么用?

- Callable 和 Future 有什么关系?

- 集合

- ArrayList

- 扩容机制

- ArrayList和LinkedList区别

- HashMap

- 添加和扩容

- 扩容时先插入再扩容还是先扩容再插入

- HashMap 为什么线程不安全?

- ConcurrentHashMap

- ConcurrentHashMap 1.7

- ConcurrentHashMap 1.8

- ConcurrentHashMap 和 Hashtable 的区别?

- LinkedHashMap

- CopyOnWriteArrayList

- BlockingQueue

- ArrayBlockingQueue 和 LinkedBlockingQueue 有什么区别?

- PriorityQueue

- Comparable 和 Comparator 的区别

- 集合转换

- 集合转 Map

- 集合遍历

- 集合去重

- 集合转数组

- 数组转集合

- Java

- 异常

- 反射

- Unsafe

- 深拷贝、浅拷贝、引用拷贝

- String

- String为什么不可变?

- 字符串拼接+

- Java 9 为何要将 `String` 的底层实现由 `char[]` 改成了 `byte[]` ?

- String#intern 方法有什么作用?

- 常用字符编码所占字节数?

- 新特性

- final

- IO模型(BIO、NIO、AIO)

- 值传递还是引用传递

- Redis

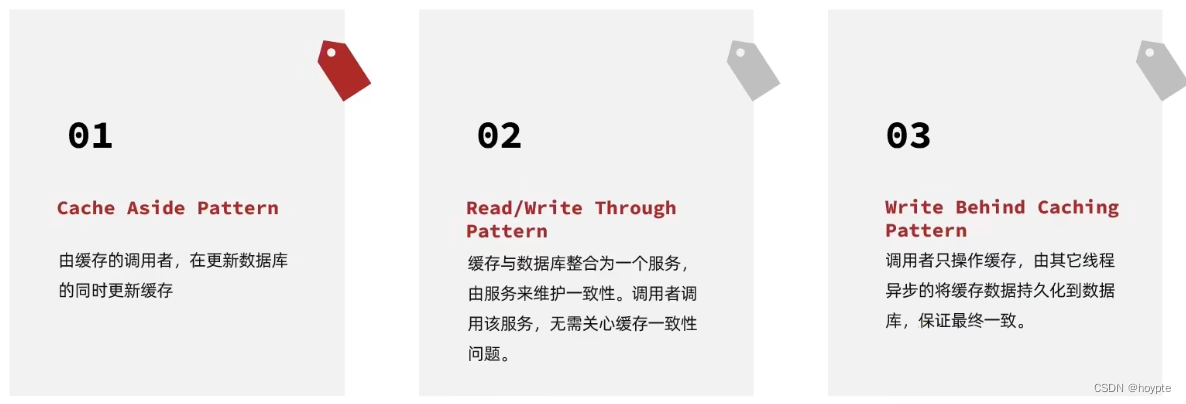

- 缓存一致性、旁路缓存

- 旁路缓存

- 读写穿透

- 异步缓存写入

- 数据结构、跳表

- 五大数据结构

- 底层数据结构

- 3种特殊数据结构

- 跳表

- RDB

- AOF

- 工作基本流程

- AOF 重写

- AOF为什么是在执行完命令之后记录日志?

- AOF校验机制了解吗?

- RDB和AOF混合持久化

- 如何选择 RDB 和 AOF?

- 分布式锁setnx

- 常见阻塞原因、大Key

- 单线程、IO模型、性能

- Redis 为什么这么快、高性能?

- 单线程模型、Reactor 模式

- 多线程

- 后台线程

- 五种IO模型、IO多路复用

- Redis 到底是单线程还是多线程?

- 过期删除

- 内存淘汰

- 事务

- 什么是 Redis 事务?

- 如何使用 Redis 事务?

- Redis 事务支持原子性吗?

- Redis 事务支持持久性吗?

- 如何解决 Redis 事务的缺陷?

- 性能优化

- 缓存穿透、缓存击穿、缓存雪崩

- 缓存穿透

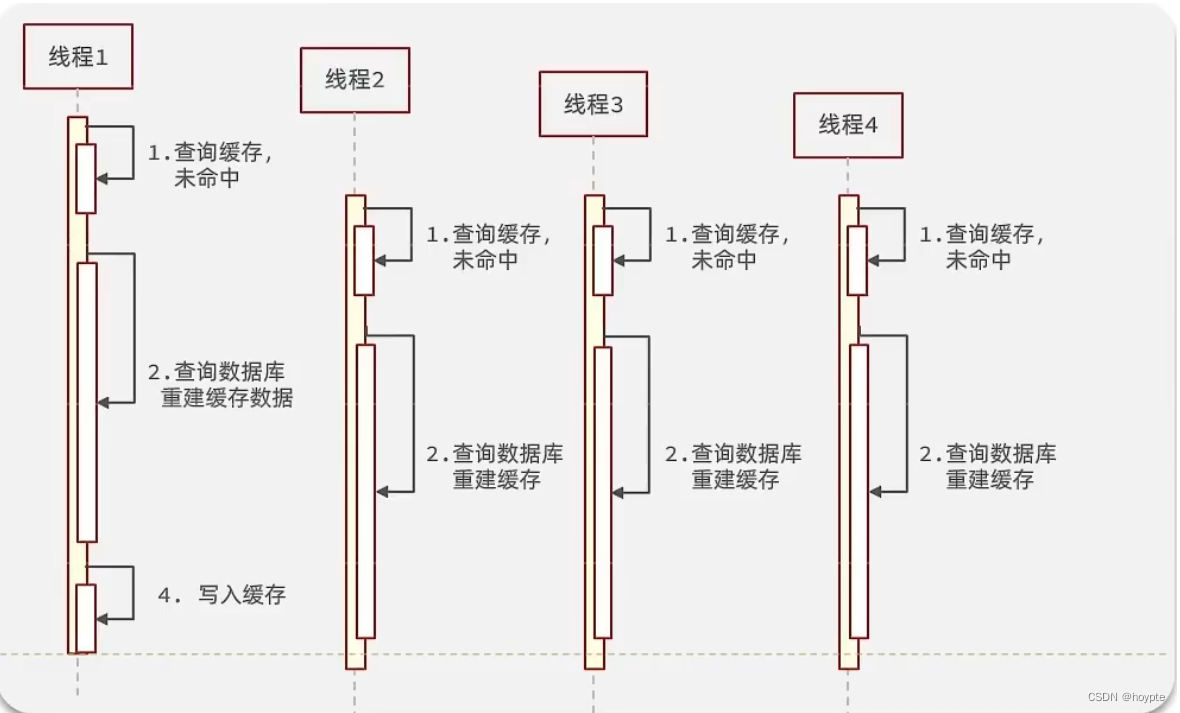

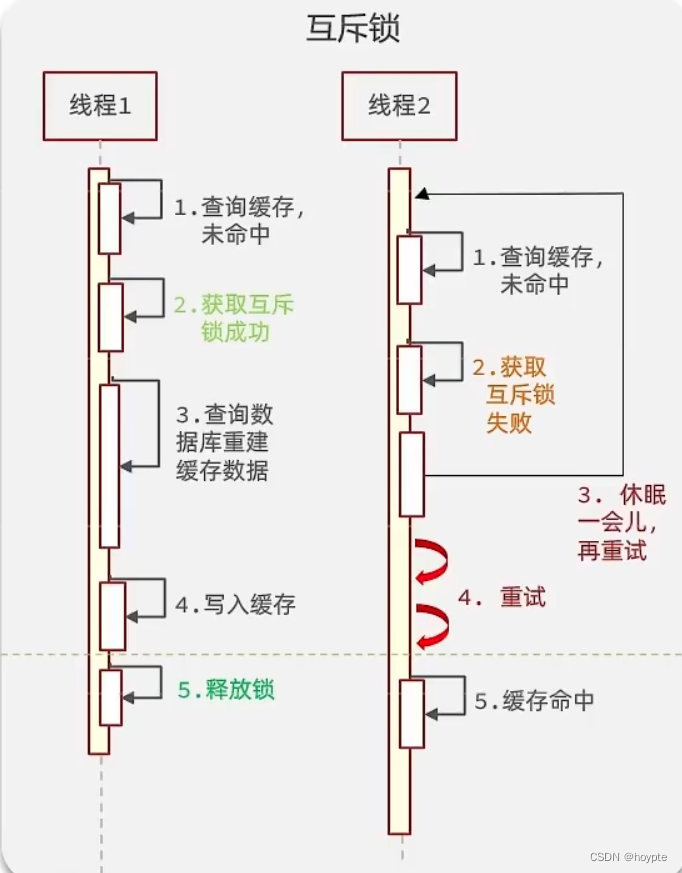

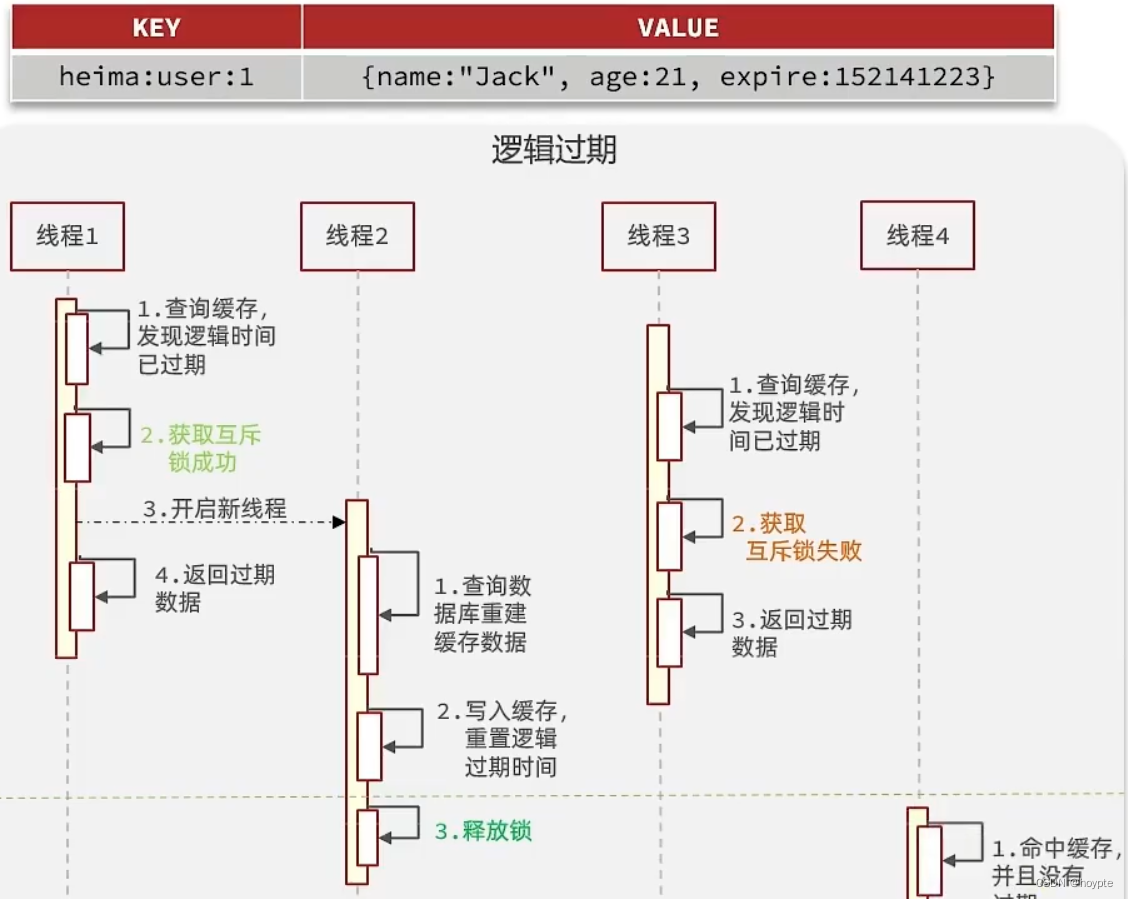

- 缓存击穿

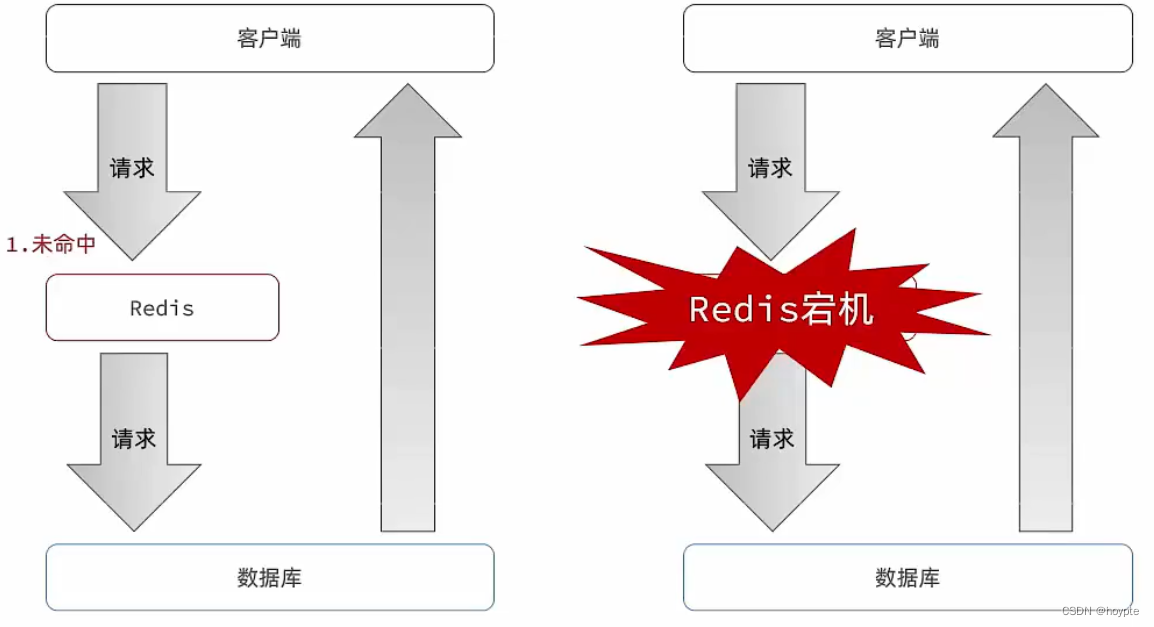

- 缓存雪崩

- 主从复制、集群

- 哨兵模式

- 分片

- Redission

- 延迟队列

- 计算机网络

- 网络模型、输入URL

- TCP/IP 四层网络模型

- OSI 七层模型

- 输入URL会发生什么?(DNS)

- HTTP

- HTTP状态码、报文结构

- HTTP 常见的状态码有哪些?

- HTTP 报文结构

- GET与POST

- 区别

- GET 和 POST 方法都是安全和幂等的吗?

- HTTP缓存

- 强制缓存

- 协商缓存

- HTTP1.1

- 断点续传

- 优点

- 缺点

- 长连接、管道传输

- 优化方案

- HTTPS

- 和HTTP区别

- HTTPS 解决的问题,为什么安全

- 建立连接过程

- 证书校验流程

- 保证完整性

- HTTPS 一定安全可靠吗?

- 优化方案

- HTTP1.1、HTTP2.0、HTTP3.0

- HTTP/1.1 相比 HTTP/1.0 提高了什么性能?

- HTTP2.0 做了什么优化?

- HTTP/3 做了哪些优化?

- 既然有 HTTP 协议,为什么还要有 RPC?

- HTTP 和 RPC 有什么区别?

- WebSocket

- TCP

- TCP介绍

- TCP头格式

- TCP 保活

- MSS 和 MTU

- TCP 保证可靠性

- UDP 和 TCP

- 区别和使用场景

- TCP 和 UDP 可以使用同一个端口吗?

- 三次握手

- 三次握手过程

- 为什么是3次握手?不是2次、4次

- 初始序列号作用

- 第一次握手丢失会发生什么?

- 第二次握手丢失会发生什么?

- 第三次握手丢失会发生什么?

- SYN 攻击、如何避免

- SYN 报文丢弃情况、PAWS

- 没 accept 建立连接

- 没 listen 建立连接

- 已建立连接的TCP收到 SYN

- 四次挥手、TIMEOUT

- 四次挥手

- 四次挥手过程

- 为什么挥手需要四次?

- 四次挥手,可以变成三次吗?

- 第一次挥手丢失会发生什么?

- 第二次挥手丢失会发生什么?

- 第三次挥手丢失会发生什么?

- 第四次挥手丢失会发生什么?

- TIMEWAIT

- TIME_WAIT 等待 2MSL

- TIME_WAIT 优化

- TIME_WAIT 收到 SYN

- TIME_WAIT 收到RST

- 收到乱序的 FIN 包

- 重传机制

- 滑动窗口

- 接收窗口和发送窗口的大小是相等的吗?

- 滑动窗口是如何影响传输速度的?

- 流量控制

- 拥塞控制

- 半连接队列和全连接队列

- 什么是 TCP 半连接队列和全连接队列?

- 如何防御SYN攻击?

- 优化 TCP

- 三次握手的性能提升

- 四次挥手的性能提升

- 传输数据的性能提升

- 如何确定最大传输速度?

- 怎样调整缓冲区大小?

- 粘包

- TLS 和 TCP 能同时握手吗?

- TCP Keepalive 和 HTTP Keep-Alive

- TCP 协议有什么缺陷?

- 如何基于 UDP 协议实现可靠传输?

- 用了 TCP 协议,数据一定不会丢吗?

- TCP 序列号和确认号是如何变化的?

- 如果客户端发送的第三次握手ACK丢失了,处于SYN_RCVD状态服务端收到了客户端第一个TCP数据报文会发生什么?

- IP

- IP基础

- CIDR无分类地址

- IP分片与重组

- IPv6

- DNS

- ARP

- RARP

- DHCP

- NAT

- ICMP

- ping的工作原理

- 断网了,还能 ping 通 127.0.0.1 吗?

- 设计模式

- 单例模式

- 双重检验锁实现单例模式

- 适配器模式

- 装饰器模式

- 适配器模式和装饰器模式有什么区别

- 观察者模式(发布订阅模式)

- 代理模式

- JDK 动态代理和 CGLIB 动态代理对比

- 静态代理和动态代理对比

- 排序

- 冒泡排序

- 选择排序

- 插入排序

- 希尔排序

- 归并排序

- 快速排序

- 堆排序

- 计数排序

- 桶排序

- 基数排序

- LRU算法(lru)(链表+hashmap)

- 消息队列

- RPC 和消息队列的区别

- 分布式消息队列技术选型

- RabbitMQ

- 基础

- 消费模型,组成

- AMQP

- 消息堆积

- 惰性队列

- 死信交换机、死信队列

- 延迟队列

- 优先级队列

- 工作模式

- 消息传输

- 消息的不丢失、可靠性

- 消息的重复消费、顺序性

- 高可用

- 延时和过期失效

- Kafka

- 概述、CAP

- 分区同步三个参数

- 消息模型

- 高性能设计、为什么吞吐量高

- 高可用、分区备份机制

- 分区备份机制

- Zookeeper和Kafka

- 消费顺序性

- 消息不丢失/可靠性

- 消息重复消费

- Rebalance

- 重试机制

- 数据清理、文件存储机制

- 操作系统

- 中断

- 内存管理

- 虚拟内存

- 内存分段

- 内存分页

- 段页式内存管理

- 内存分配过程

- 预读失效和缓存污染

- 进程生命周期,状态

- 进程、线程间通信方式

- 线程

- 线程和进程比较

- 多线程互斥和同步

- 死锁

- 进程、线程调度算法

- 内存页面置换算法

- 文件系统

- 网络系统

- DMA(直接内存访问)

- 零拷贝

- PageCache

- 高性能网络模式:Reactor和Proactor

- 一致性哈希

- 五种IO模型、IO多路复用

- Linux命令

- 性能指标

- 网络配置

- socket信息

- 网络吞吐率和PPS

- 连通性和延时

- 分析日志

- Nginx

- 反向代理

- 静态映射

- 负载均衡策略

- Zookeeper

- 应用场景

- 集群

- 分布式/微服务

- Cookie 和 Session

- token 和 JWT

- 单点登录SSO

- 分布式锁

- CAP和BASE

- 分布式事务

- Seata

- MQ分布式事务

- 分布式算法

- Paxos算法

- 一致性Hash算法

- 雪花算法

- SpringCloud/alibaba五大组件

- 服务雪崩

- 降级熔断

- 服务降级

- 服务熔断

- 限流

- 固定窗口计数器算法

- 滑动窗口计数器算法

- 漏桶算法(Sentine排队等待算法)

- 令牌桶算法(Sentine预热限流算法)

- git 手动

- 实战篇Redis

- 开篇导读

- 1、短信登录

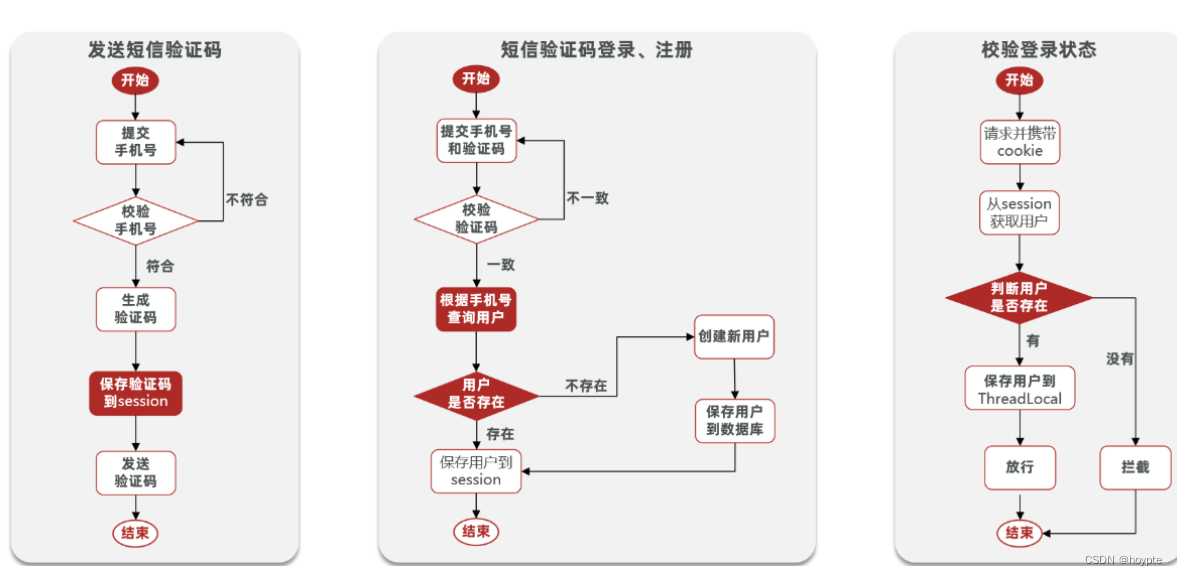

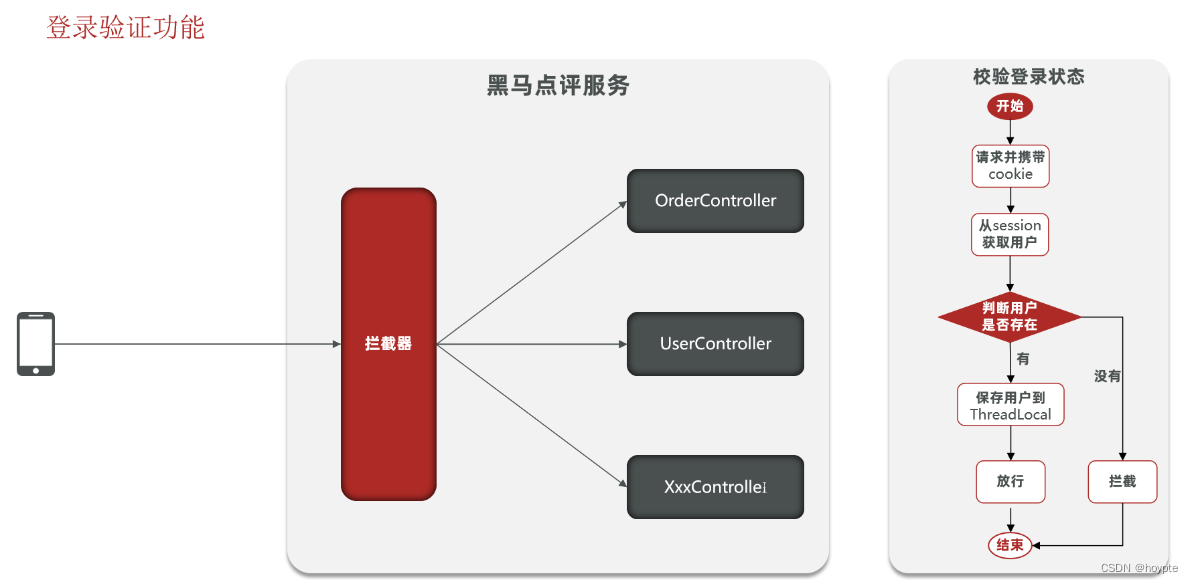

- 1.2 、基于Session实现登录流程

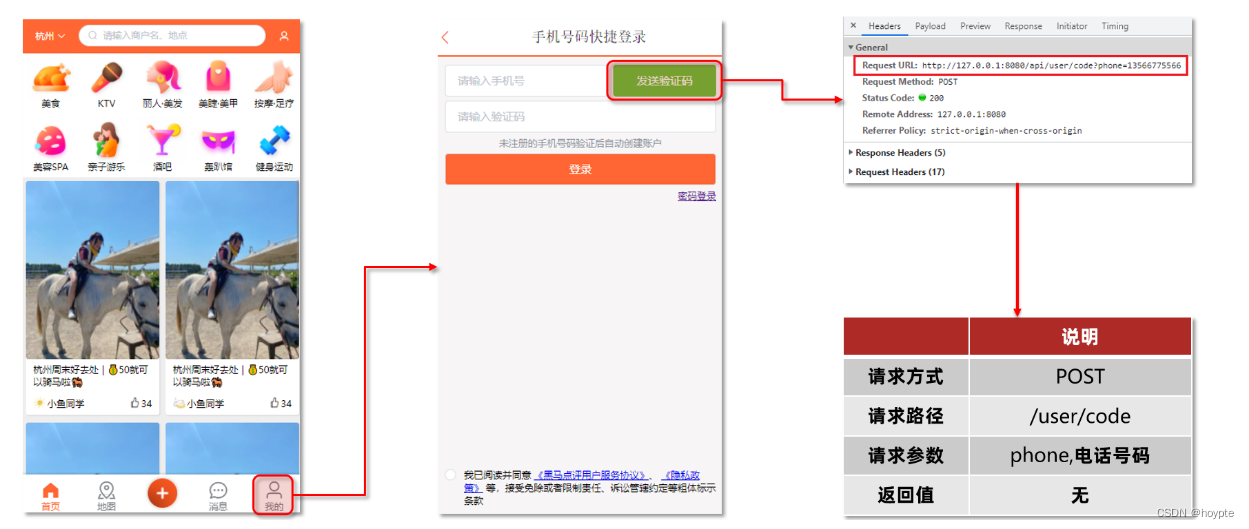

- 1.3 、实现发送短信验证码功能

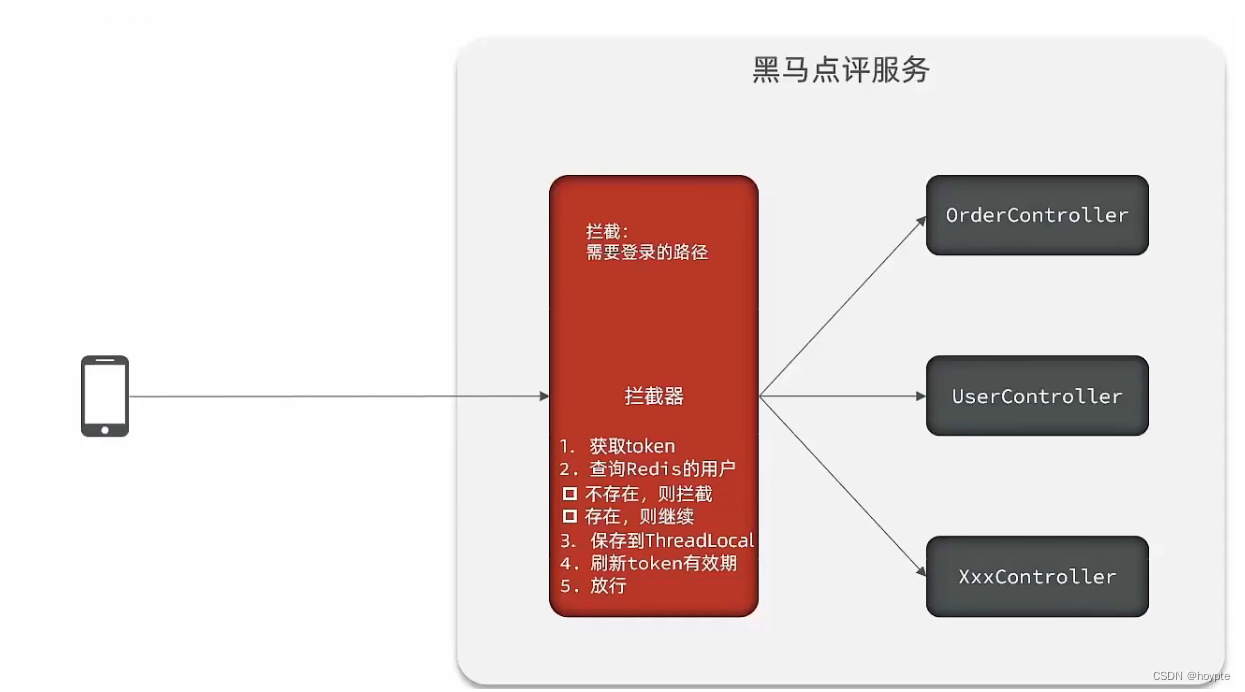

- 1.4、实现登录拦截功能

- 1.5、隐藏用户敏感信息

- 1.6、session共享问题

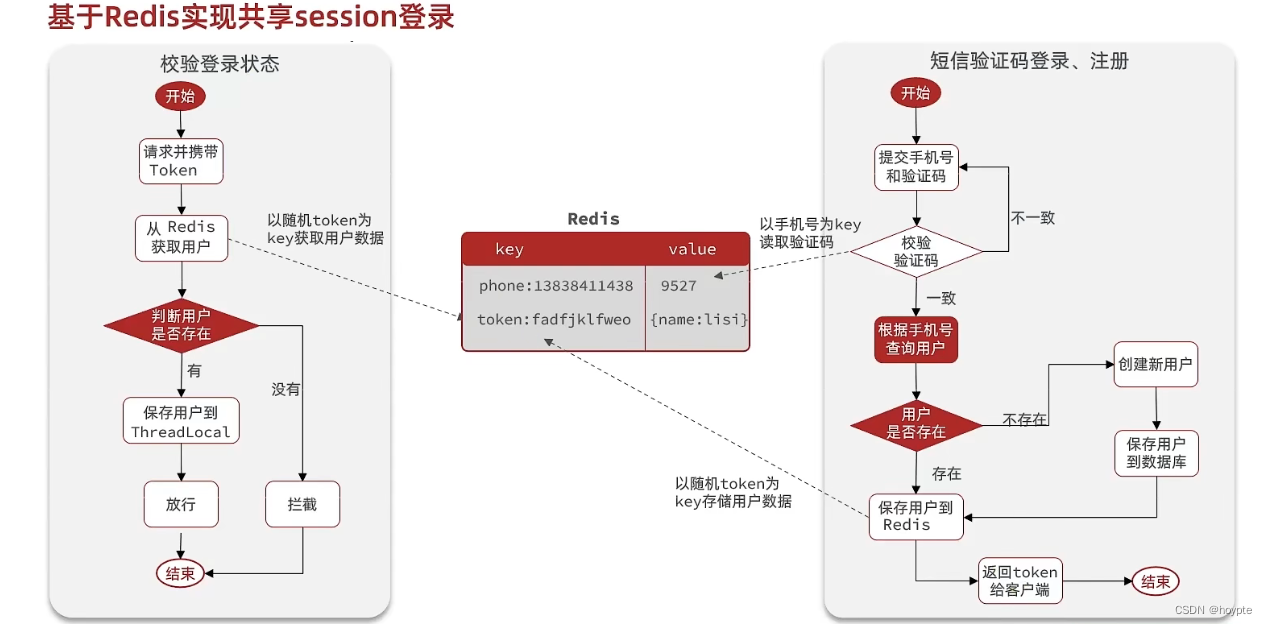

- 1.7 Redis代替session的业务流程

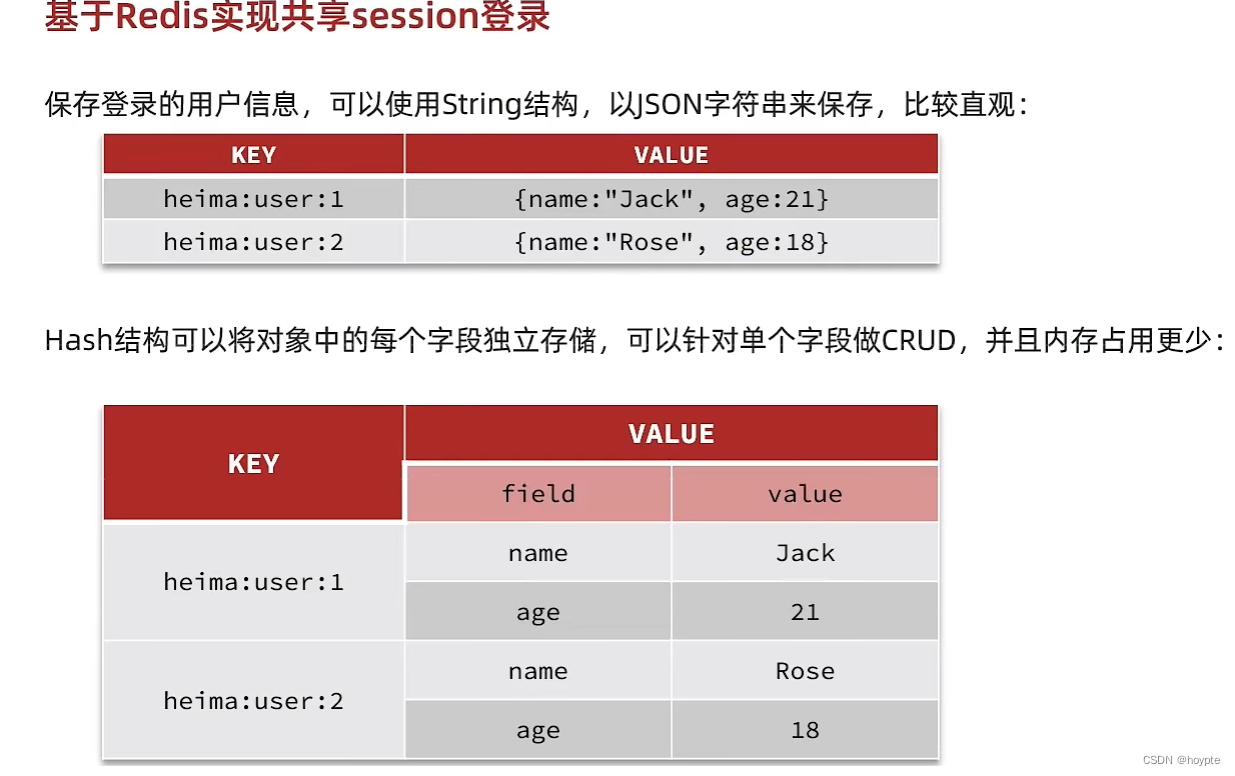

- 1.7.1、设计key的结构

- 1.7.2、设计key的具体细节

- 1.7.3、整体访问流程

- 1.8 基于Redis实现短信登录

- 1.9 解决状态登录刷新问题

- 1.9.1 初始方案思路总结:

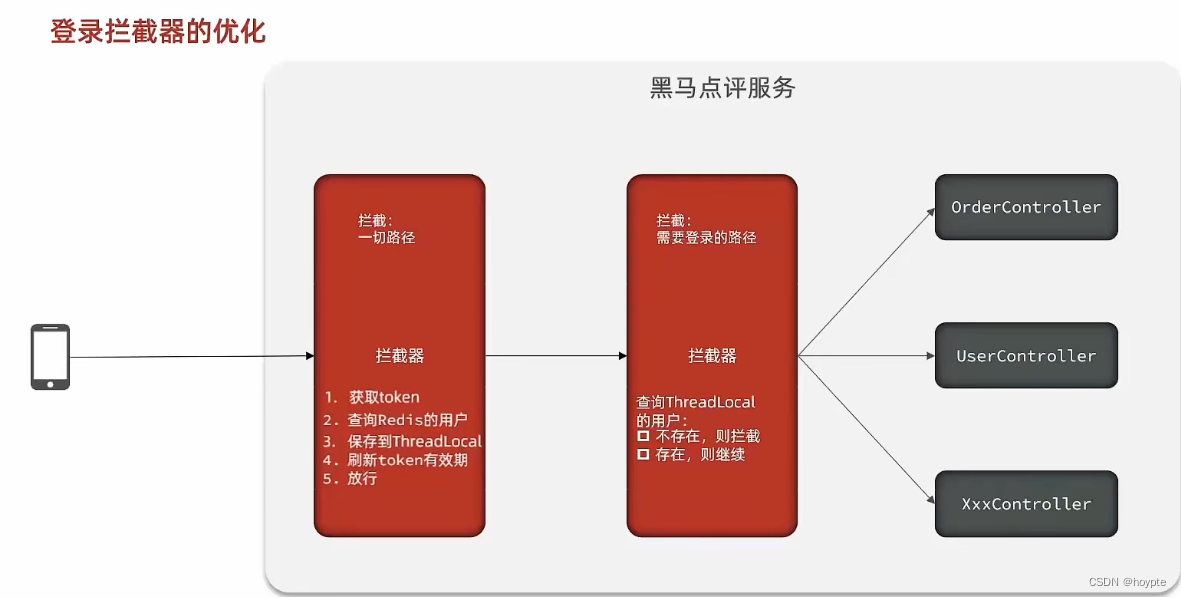

- 1.9.2 优化方案

- 1.9.3 代码

- 2、商户查询缓存

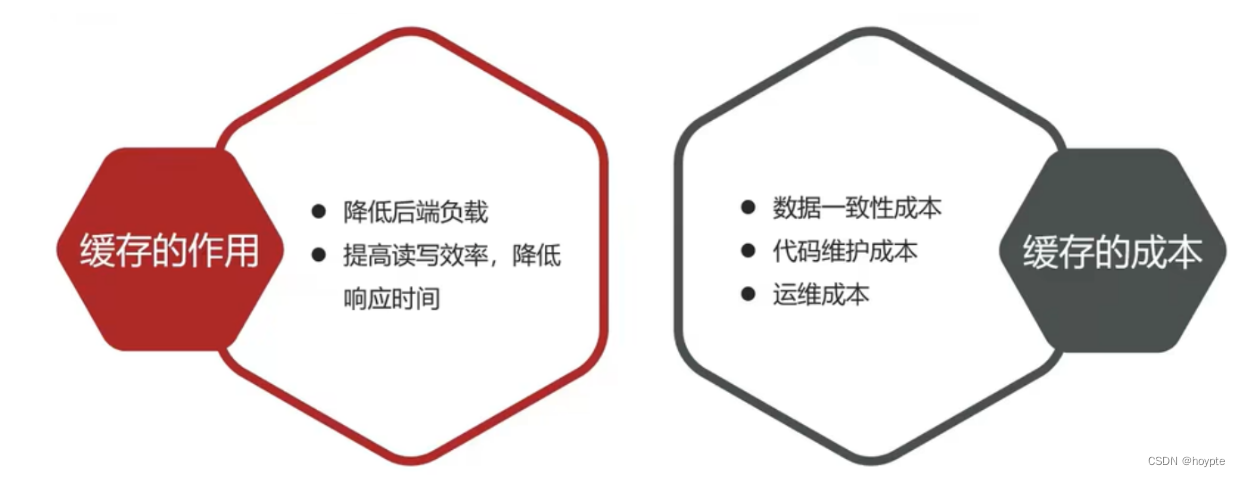

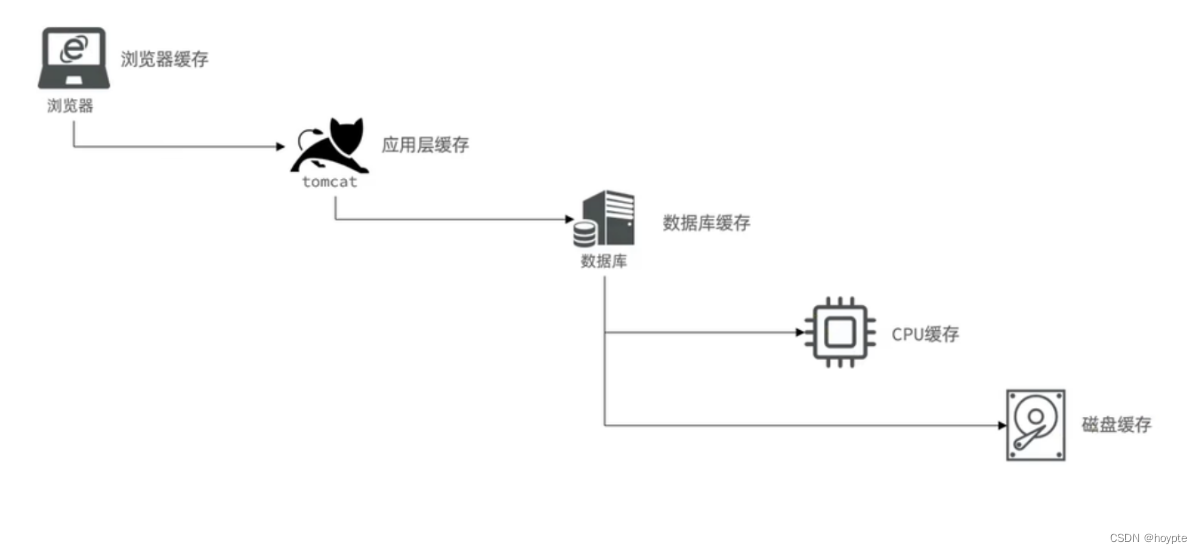

- 2.1 什么是缓存?

- 2.1.1 为什么要使用缓存

- 2.1.2 如何使用缓存

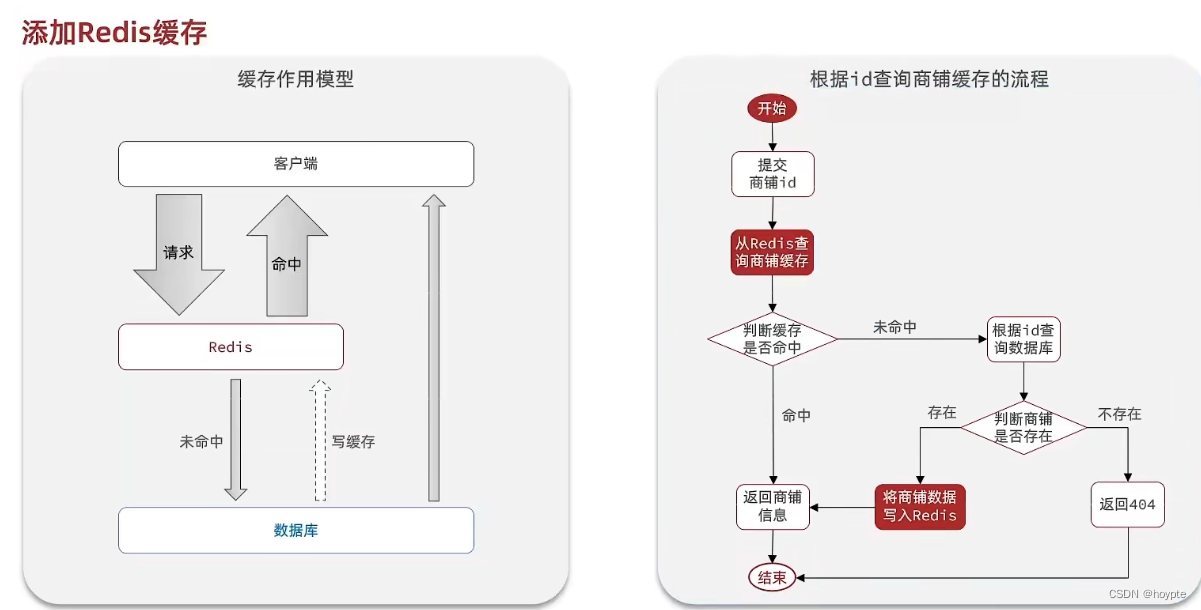

- 2.2 添加商户缓存

- 2.2.1 、缓存模型和思路

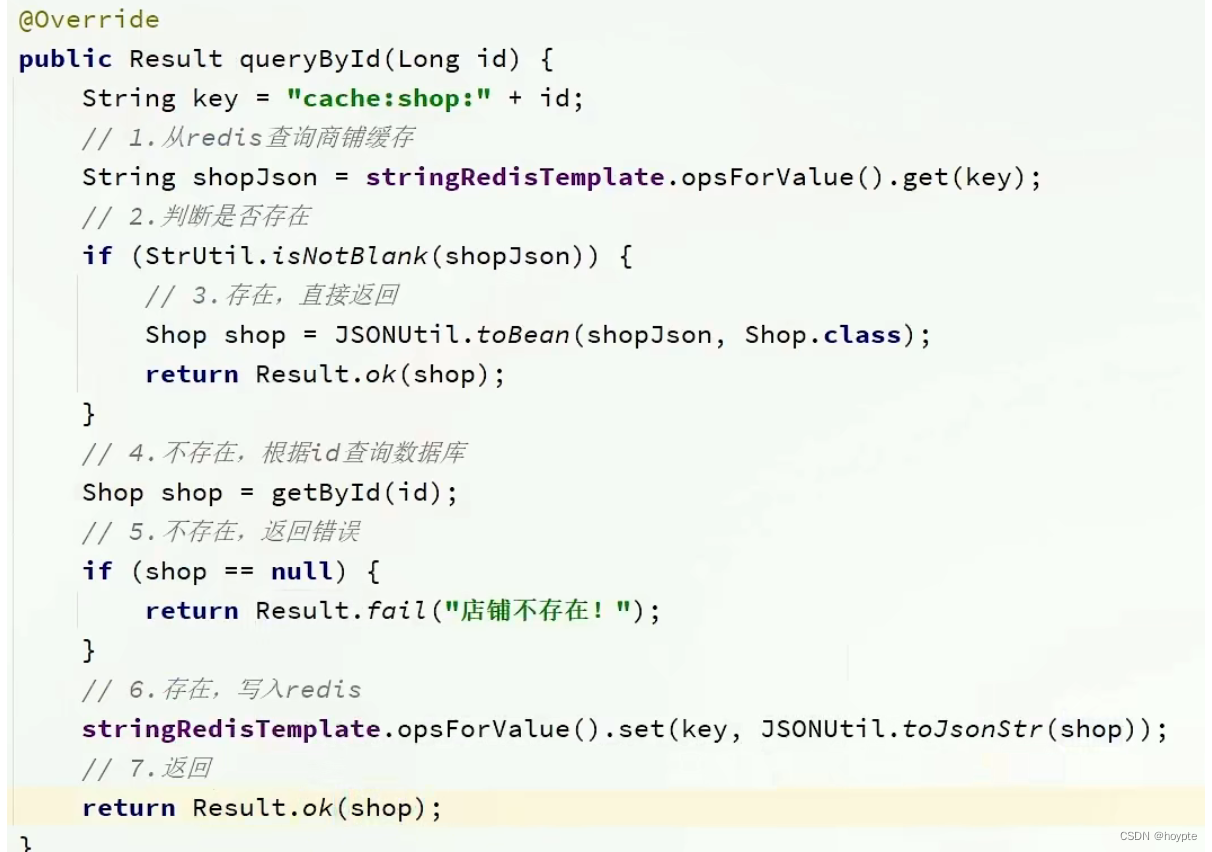

- 2.1.2、代码如下

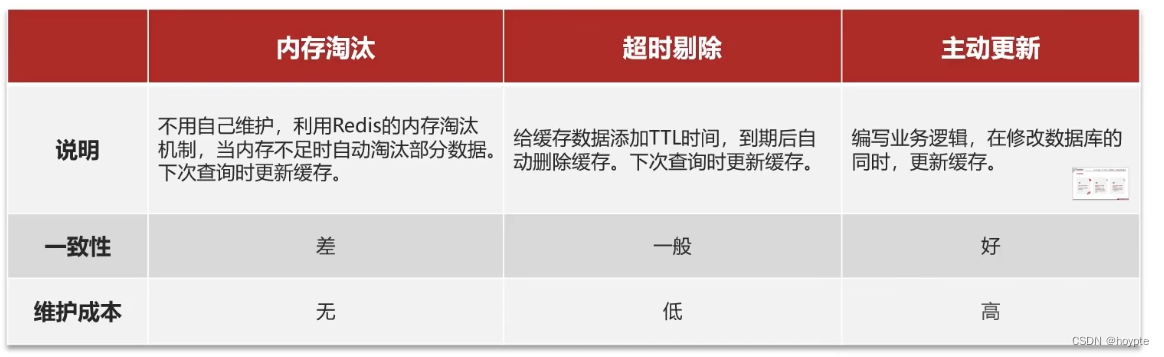

- 2.3 缓存更新策略

- 2.3.1 、数据库缓存不一致解决方案:

- 2.3.2 、数据库和缓存不一致采用什么方案

- 2.4 实现商铺和缓存与数据库双写一致

- 2.5 缓存穿透问题的解决思路

- 2.6 编码解决商品查询的缓存穿透问题:

- 2.7 缓存雪崩问题及解决思路

- 2.8 缓存击穿问题及解决思路

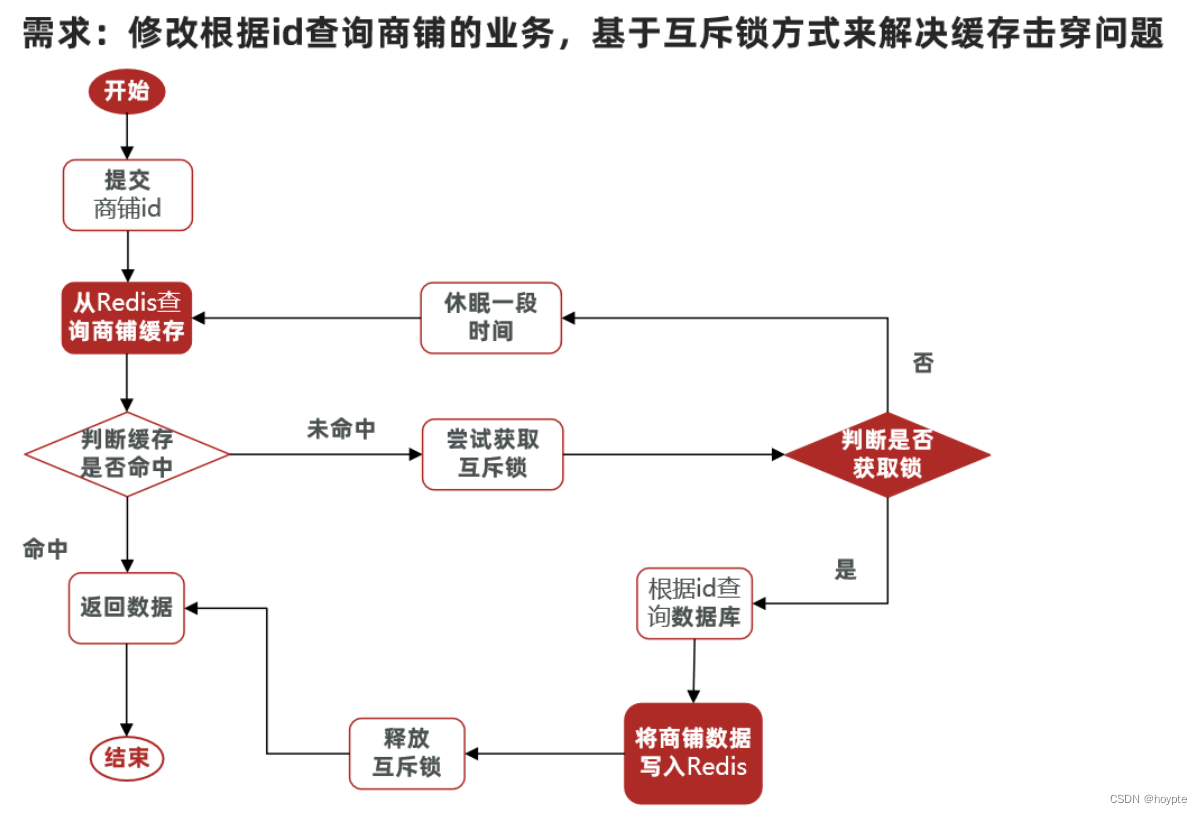

- 2.9 利用互斥锁解决缓存击穿问题

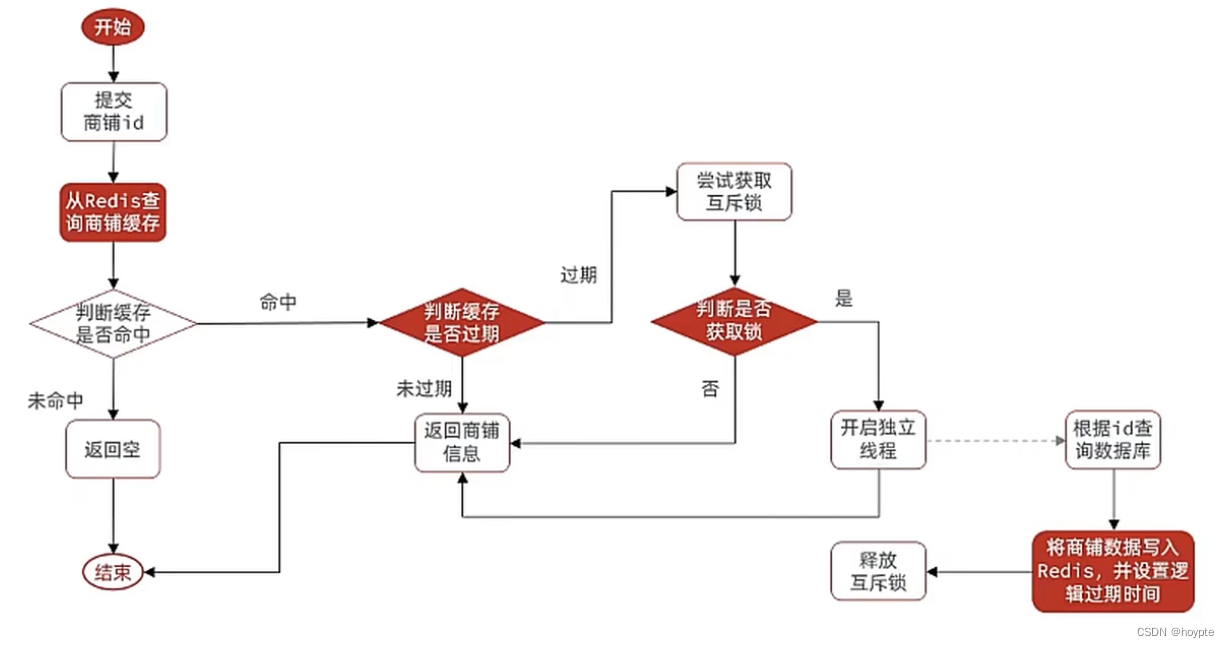

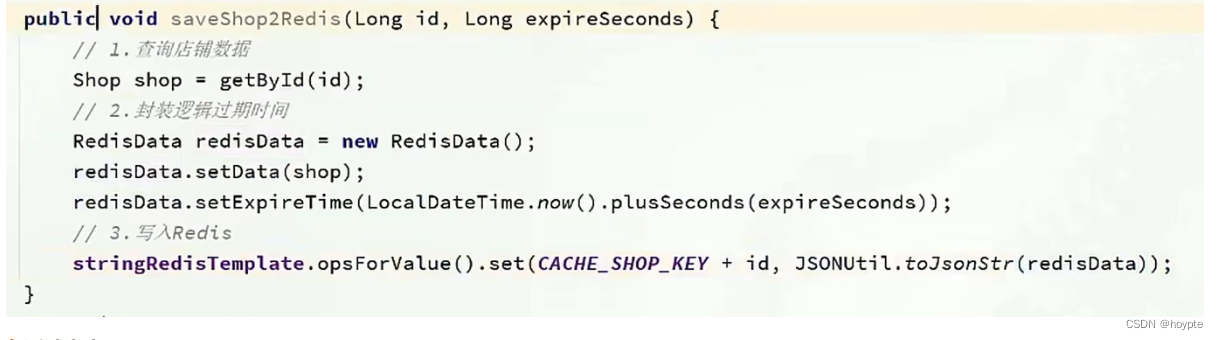

- 3.0 、利用逻辑过期解决缓存击穿问题

- 3.1、封装Redis工具类

- 3、优惠卷秒杀

- 3.1 -全局唯一ID

- 3.2 -Redis实现全局唯一Id

- 3.3 添加优惠卷

- 3.4 实现秒杀下单

- 3.5 库存超卖问题分析

- 3.6 乐观锁解决超卖问题

- 3.6 优惠券秒杀-一人一单

- 3.7 集群环境下的并发问题

- 4、分布式锁

- 4.1 、基本原理和实现方式对比

- 4.2 、Redis分布式锁的实现核心思路

- 4.3 实现分布式锁版本一

- 4.4 Redis分布式锁误删情况说明

- 4.5 解决Redis分布式锁误删问题

- 4.6 分布式锁的原子性问题

- 4.7 Lua脚本解决多条命令原子性问题

- 4.8 利用Java代码调用Lua脚本改造分布式锁

- 5、分布式锁-redission

- 5.1 分布式锁-redission功能介绍

- 5.2 分布式锁-Redission快速入门

- 5.3 分布式锁-redission可重入锁原理

- 5.4 分布式锁-redission锁重试和WatchDog机制

自我介绍

面试官你好,感谢贵公司给我一个面试的机会,我叫薛君宝,来自西安邮电大学计算机学院软件工程专业,现在是一名大三在校生,在大一期间我自学了c语言,加入了我们学校的实验室,选择java后端方向,先后学习了java基础,jdbc,mysql,ssm框架以及springboot框架,之后又学习了一些常用的中间件,比如redis和Kafka。在校期间完成了简历上的两个项目,第一个项目是在大二完成的一个校园订餐管理系统,实现了用户一键登录注册、点餐,餐厅管理菜单处理订单等功能。第二个项目是我在大三上学期的时候写的一个啾咪宠物托管平台,主要实现了用户购买和领养宠物,后台管理宠物以及订单和用户信息的功能。以上就是我的自我介绍。

MySQL

索引

索引种类、B+树

-

Hash表:不支持范围查找,每次io只能取一个

-

二叉搜索树:依赖于它的平衡程度

-

AVL树:自平衡二叉搜索树,操作时间复杂度都是 O(logn)。需要频繁地进行旋转操作来保持平衡,每次io只能取一个

-

红黑树:自平衡二叉查找树,大致平衡。可能会导致树的高度较高,红黑树在插入和删除节点时只需进行 O(1) 次数的旋转和变色操作,每次io只能取一个

-

B+树:B 树也称 B-树,全称为 多路平衡查找树 ,B+ 树是 B 树的一种变体。

-

只有叶子节点存放 key 和 data,其他内节点只存放 key

-

页之间是双向链表,同一个页内的数据是单向链表

-

叶子节点的顺序检索很明显。

-

B+树的范围查询,只需要对链表进行遍历即可

-

多叉路衡查找树

数据页中有一个页目录,一个页目录有多个槽,每个槽对应一个分组最大的行记录,所有记录会分组,最小记录单独是一组,最大记录和最后一组在一块

先二分查找页,再二分查找到数据在哪个槽,再遍历槽内所有记录

-

聚簇索引、非聚簇索引

-

聚簇索引:索引结构和数据一起存放的索引,如innodb的主键索引

-

优点:

- 查询速度快:整个B+树是多叉平衡树,叶子节点有序

- 对排序查找和范围查找优化:对主键的排序查找和范围查找速度快

- 缺点:

-

依赖于有序的数据:如果索引数据不有序,就需要在插入的时候排序

-

更新代价大:如果索引列的数据被修改,对应的索引也会被修改,修改代价比较大,所以主键一般不可修改

-

-

非聚簇索引:索引结构和数据分开存放的索引,如二级索引,MyISAM里,不管主键还是非主键,都是非聚簇索引

-

优点:

- 更新代价更小,叶子节点不存放数据,而是存放数据的指针

-

缺点:

-

依赖于有序的数据:也依赖有序数据

-

可能会有二次查询(回表):最大缺点,查到索引对应的指针或主键后,可能还需要根据指针或主键到数据文件或表中查询

-

-

联合索引、最左前缀匹配原则

联合索引,mysql会根据联合索引的字段顺序,从左到右依次到查询条件匹配,如果查询条件存在与最左侧字段相匹配的字段,就会使用该字段过滤一批数据,直到联合索引全部字段匹配完成,或者在执行过程中遇到范围查询(如>或<)才会停止匹配,对于(>=、<=、BETWEEN、like)前缀匹配的范围查询,不会停止匹配,所以在创建联合索引的时候,可以将区分度高的字段放在最左边,可以过滤更多数据

比如联合索引(a,b),在a相同时b是有序的,在a=1 and b=2的情况下是可以走到索引的,而你执行a > 1 and b = 2时,a字段能用到索引,b字段用不到索引。因为a的值此时是一个范围,不是固定的,在这个范围内b值不是有序的,因此b字段用不上索引。

索引下推

在非聚簇索引遍历过程中,对索引中包含的字段先做判断,过滤掉不符合条件的记录,减少回表次数。

将过滤条件推到存储引擎层处理,减少回表次数

比如select * from t where name like ‘a%’ and age=1,联合索引是name,age,传统会找联合索引以a开头,之后将所有以a开头的记录回表查询,开启索引下推后,会继续查找age=1的索引记录,之后再进行回表操作

索引失效

-

创建了联合索引,但查询条件未遵守最左匹配原则

- 不一定会失效:如果字段都是索引,也会走全扫描二级索引树,因为优化器认为成本低

-

在索引列上计算、函数、类型转换等操作

- 因为索引保存的是初始值,不是函数计算后的值

-

以%开头的like

- 不一定会失效:看字段,如果字段只有主键和二级索引,就不会走全表扫描,而是走全扫描二级索引树,优化器选择

-

查询条件使用or,同时or的前后条件中有一个列没有索引,涉及的索引都不会被使用到

- 因为or就是满足一个就可以,因此只有一个条件列是索引列就没意义,只要有条件列不是索引列,就要进行全表扫描

-

发生隐式转换:索引字段是字符串类型,查询时输入参数是整型的话,就走全表扫描。如果索引是整型,输入参数是字符串,就不会导致索引失效,因为mysql会自动把字符串转为数字(用函数)

索引优化

- 选择合适的字段

- 不为NULL:数据为NULL时,数据库较难优化

- 被频繁查询的字段

- 被作为条件查询的字段:

- 高区分度的列,男女低区分度

- 频繁需要排序的字段

- 被经常频繁用于连接的字段:提高多表连接查询的效率

- 被频繁更新的字段应该慎重简建立索引

- 虽然查询快,但维护成本较高,如果一个字段不经常查询,但经常被修改,就不应该在这种字段上建立索引

- 限制每张表上的索引数量

- 单表不超过5个

- 索引会增加查询效率,同时会降低插入和更新的效率

- mysql优化器在选择如何优化查询时,会对每一个可以用到的索引进行评估,生成一个最好的执行计划,如果同时有很多个索引都可以用于查询,就会增加mysql优化器生成执行计划的时间,同时降低查询性能

- 尽可能考虑建立联合索引而不是单列索引

- 每个索引都对应一颗B+树,如果表的字段过多,索引过多,数据变多时,索引占用空间会很大,修改索引耗费的时间会更多,联合索引会节约磁盘空间,修改数据的操作效率会提升

- 注意避免冗余索引

- 索引功能相同,能命中(a,b)就肯定可以命中(a),那么索引(a)就是冗余索引。优先选择扩展索引而不是创建新索引

- 字符串类型的字段使用前缀索引代替普通索引

- 前缀索引仅限于字符串,会占用更小的空间

- 删除长期未使用的索引

- 直到如何分析语句是否走索引查询

- EXPLAIN分析sql的执行计划,执行计划是一条sql语句在经过mysql的查询优化器的优化过后,具体的执行方式

- 避免索引失效

日志、缓冲池

redo log(重做日志)

物理日志,记录在某个数据页做了什么修改,循环写,边写边擦

innodb独有,让innodb有了崩溃恢复能力

-

mysql的innodb引擎使用redo log(重做日志)保证事务持久性

-

将写操作从随机写变为顺序写,写入redo log用了追加操作,所以磁盘操作是顺序写,而写入数据需要先找到写入位置,然后再写到磁盘,所以磁盘操作是随机写,因为顺序写高效,所以redo log写入磁盘开销更小

redo log buffer默认16MB

刷盘时机

- mysql正常关闭

- redo log buffer写入量大于一半时

- 后台线程每1秒将redo log buffer持久化

- 每次事务提交时将redologbuffer的数据直接持久化到磁盘

InnoDB 存储引擎为 redo log 的刷盘支持三种策略:

-

0:设置为 0 的时候,事务提交时不进行刷盘操作(容忍丢1秒)

- 如果

MySQL挂了或宕机可能会有1秒数据的丢失。

- 如果

-

1:设置为 1 的时候,事务提交时都将进行刷盘操作(最安全,默认值)

- 只要事务提交成功,

redo log记录就一定在硬盘里,不会有任何数据丢失

- 只要事务提交成功,

-

2:设置为 2 的时候,事务提交时都只把 redo log buffer 内容写入 page cache(折中,操作系统不宕机就不丢失1秒)

- mysql崩溃不丢失,操作系统崩溃或断电丢失1秒

innodb有一个后台线程,每隔1秒,就会将redo log buffer的内容写到文件系统缓存(page cache)然后调用fsync刷盘

redolog刷盘但事务未提交

mysql在重启后执行崩溃恢复,发现redo日志包含未提交的事务的更改,就回滚此事务,确保数据的一致性

日志文件组

redo log 不止一个,以日志文件组形式存在

采用环形数组,写满后,写下一个文件

- write pos 是当前记录的位置

- checkpoint 是当前要擦除的位置

每次刷盘 redo log 记录到日志文件组中,write pos 位置就会后移更新。

每次 MySQL 加载日志文件组恢复数据时,会清空加载过的 redo log 记录,并把 checkpoint 后移更新。

write pos 和 checkpoint 之间的还空着的部分可以用来写入新的 redo log 记录。

如果 write pos 追上 checkpoint ,表示日志文件组满了,这时候不能再写入新的 redo log 记录,MySQL 得停下来,将缓冲池的脏页刷盘,再标记redo log哪些记录可以被擦除,擦除腾空间后 checkpoint 后移

bin log(归档日志)

用于数据备份和主从复制

binlog是逻辑日志,记录语句的原始逻辑,比如给这个字段+1,属于Server层

完成更新操作后,Server都会产生binlog日志,事务提交后,会将事务执行过程的所有binlog统一写入binlog文件

binlog会记录所有涉及更新数据的逻辑操作,并且是顺序写。

记录格式

binlog 日志有三种格式,可以通过binlog_format参数指定。

- statement默认:记录原始sql,但可能有实时性函数导致不一致

- row:记录行数据最终被修改成的样子,缺点时每行数据的变化都会记录,批量修改产生大量数据,而在默认情况下只记录一个update

- mixed:根据不同情况使用上面两个

写入机制

事务执行时,先把日志写到binlog cache(Server层的cache),事务提交的时候,再把binlog cache写到binlog文件

一个事务的binlog不能被拆开,确保一次性写入,所以系统会给每个线程分配一个块内存作为binlog cache

每个线程都向page cache里write,再fsync到磁盘,虽然每个线程都有自己的binlog cache,但最终都写入同一个binlog文件

write和fsync的时机,默认是0。

- 0:提交事务只write,不fsync,由操作系统决定fsync

- 一旦异常重启,每持久化的数据就丢失

- 1最安全:每次提交事务都write,然后马上fsync

- 最多丢失一个事务的binlog

- n(>1):每次提交事务都write,累积n个事务后fsync

- 如果能容少量binlog日志丢失的风险,为了提高性能,就设置100-1000

两阶段提交

避免两份日志之间的逻辑不一致的问题,内部XA事务,两阶段提交这个事务

事务提交后,redo log和bin log都要持久化到磁盘,但两个独立,造成逻辑不一致

过程:把redo log的写入拆分成准备和提交,中间穿插写入binlog

- 准备:写入redo log,同时将redo log对应的事务状态设置为准备,再将redo log持久化到磁盘

- 提交:写入bin log,然后将binlog持久化到磁盘,接着提交事务,将redo log状态设置为commit,write到page cache,因为只要binlog写磁盘成功,即使redo log的状态还是prepare一样会被认为事务已经执行成功

如果redolog写入磁盘,binlog没写入磁盘,或者redolog和binlog都写入磁盘,但还没commit标识,此时redo log都处于prepare状态,mysql重启后会扫描redo log文件,发现prepare状态的redo log后,会去bin log查看是否存在对应XA事务id,如果存在就说明redolog和binlog都刷盘了,就直接提交事务,不存在就说明只有redolog刷盘,binlog没刷盘,此时回滚事务

redo log 可以在事务没提交之前持久化到磁盘,但是 binlog 必须在事务提交之后,才可以持久化到磁盘。

缺点:

- 磁盘IO次数高:每个事务两次刷盘

- 锁竞争激烈:多事务需要加锁保证两个日志提交顺序一致

解决方法:组提交:多个事务提交时,会将多个binlog刷盘操作合并为一个,减少磁盘IO,prepare不变,commit分为三个阶段

- flush:多个事务按顺序将binlog写入page cache

- sync:对binlog做fsync,合并刷盘

- commit:各个事务按顺序提交

每个阶段都有一个队列,每个阶段有锁保护,第一个事务是leader,此时,锁只针对每个队列进行保护,不再锁住提交事务的整个过程,锁粒度变小,提高并发效率

undo log(回滚日志)

逻辑日志

- 实现事务回滚,保证事务的原子性,在事务没提交之前,mysql会先记录更新前的操作到undo log日志,事务回滚时利用undo log回滚。并且回滚日志会先持久化到磁盘上(依靠redo log,对undo的修改会记录到redo log),保证了数据库宕机的情况,用户再次启动数据库时,数据库能够通过查询回滚日志回滚之前未完成的事务

- 实现MVCC的因素之一:undo log为每条记录保存多份历史数据,快照读时会根据Read View的信息,顺着undo log版本链找到满足可见性的记录

Buffer Pool缓冲池

缓存表数据和索引数据,磁盘数据加载到缓冲池,避免每次磁盘io,提高数据库的读写性能

- 读数据时,如果数据存在缓冲池,就直接读取缓冲池的数据,否则去磁盘读取

- 修改数据时,如果数据存在缓冲池,就直接修改缓冲池数据所在的页,设置为脏页,为了减少磁盘io,不会立即将脏页写入磁盘,时机由后台线程选择

缓冲池是连续的内存空间,里面的页是缓存页,有索引页、数据页、Undo页、插入缓存、自适应哈希索引、锁信息等

查询记录时会缓存整个页的数据

每个缓存页都有控制块(缓存页的表空间,页号,缓存页地址,链表节点),控制块和缓存页之间的部分为碎片空间(每个控制块都有缓存页,剩余不够一对控制块和缓存页的大小就是碎片)

空闲链表:空闲缓存页的控制块作为链表节点,有空闲链表后,每次从磁盘加载页到缓冲池后,就从空闲链表取出一个空闲的缓存页,把缓存页对应的控制块信息填上,再把缓存页对应的控制块从空闲链表删除

Flush链表:快速知道哪些缓存页是脏的,链表节点也是控制块,后台线程就可以遍历Flush链表,将脏页写入磁盘

主从复制、分库分表

主从复制

主要涉及三个线程: binlog 线程、I/O 线程和 SQL 线程。

- binlog 线程 : 负责将主服务器上的数据更改写入binlog。

- I/O 线程 : 负责从主服务器上读取binlog,并写入从服务器的Relay log中继日志中。

- SQL 线程 : 负责读取Relay log中继日志并重放其中的 SQL 语句。

全同步复制

所有的从库都执行完成后才返回给客户端

半同步复制

从库写入日志成功后返回ACK确认给主库,主库收到至少一个从库的确认就认为写操作完成。

分库分表

项目业务数据增多,业务发展迅速,单表数据量到1000w或20G、优化解决不了性能问题、IO瓶颈(磁盘、网络)、CPU瓶颈(聚合查询、连接太多)

垂直

- 垂直分库:以表为依据,根据业务将不同表拆分到不同库,如不同微服务对应不同的库

- 按业务对数据分级管理

- 高并发提高磁盘io和数据量连接数

- 垂直分表:以字段为依据,根据字段属性将不同字段拆分到不同表。把不常用字段单独放在一张表,如id和描述、id和其他信息

- 冷热数据分离

- 减少Io过度争抢,两表互不影响

水平

- 水平分库:将一个库的数据拆分到多个库中,可以根据Id节点驱魔,将一个业务的库拆分到多个库

- 解决单库大数量,高并发性能瓶颈

- 提高系统稳定性和可用性

- 水平分表:将一个表的数据拆分到多个表(可以在一个库)

- 优化单一表数据量大的性能维妮塔

- 避免io较少缩表几率

事务、MVCC

ACID特性

- 原子性:一个事务的所有操作,要么全部完成,要么全部不完成,执行时发生错误会回滚

- undo log(回滚日志)保证

- 一致性:事务操作前和操作后,数据满足完整性约束,保持一致性状态

- 持久性+原子性+隔离性保证

- 隔离性:允许多个并发事务同时对数据进行读写和修改的能力,多个事务使用相同数据

- MVCC或锁机制保证

- 持久性:事务提交后,修改是永久的

- redo log(重做日志)保证

隔离级别

sql标准定义的隔离级别

- 读未提交:允许读取尚未提交的数据变更

- 读已提交:允许读取并发事务已经提交的数据

- 可重复读:对同一字段的多次读取结果都是一致的,除非数据是被本身事务自己所修改

- 可串行化:所有的事务依次逐个执行

innodb的可重复读可以很大程度解决幻读,有两种情况

- 快照读:用MVCC保证不出现幻读,可重复读下,读取一致性数据

- 当前读:使用Next-key Lock加锁保证不出现幻读,Next-key Lock是行锁和间隙锁的结合,行锁只能锁住已经存在的行,为了避免插入新行,需要依赖间隙

MVCC

多版本并发控制,多个并发事务同时读写数据的时候保证数据的一致性和隔离性,通过在每行维护多个版本的数据实现,当一个事务要修改数据时,MVCC会为该事务创建一个数据快照,而不是直接修改实际数据行

MVCC的实现依赖:隐藏字段、Read View、undo log。在内部实现中,InnoDB 通过数据行的事务id和 Read View 来判断数据的可见性,如不可见,则通过数据行的 回滚指针找到 undo log 中的历史版本。每个事务读到的数据版本可能是不一样的,在同一个事务中,用户只能看到该事务创建 Read View 之前已经提交的修改和该事务本身做的修改

隐藏字段

到底清楚不

每行数据有三个隐藏字段

DB_TRX_ID(6字节):表示最后一次插入或更新该行的事务 id。此外,delete操作在内部被视为更新,只不过会在记录头Record header中的deleted_flag字段将其标记为已删除DB_ROLL_PTR(7字节)回滚指针,指向该行的undo log。如果该行未被更新,则为空

ReadView

Read View主要用来做可见性判断,里面保存了当前对本事务不可见的其他活跃事务

主要有以下字段:

m_low_limit_id:目前出现过的最大的事务 ID+1,大于等于这个 ID 的数据版本均不可见m_up_limit_id:活跃事务列表m_ids中最小的事务 ID,小于这个 ID 的数据版本均可见(已经提交)m_ids:Read View创建时其他未提交的活跃事务 ID 列表。创建Read View时,将当前未提交事务 ID 记录下来,后续即使它们修改了记录行的值,对于当前事务也是不可见的。m_ids不包括当前事务自己和已提交的事务(正在内存中)m_creator_trx_id:创建该Read View的事务 ID

undo-log

当读取记录时,若该记录被其他事务占用或当前版本对该事务不可见,则可以通过 undo log 读取之前的版本数据,以此实现非锁定读

在 InnoDB 存储引擎中 undo log 分为两种:insert undo log 和 update undo log:

-

insert undo log:指在insert操作中产生的undo log。因为insert操作的记录只对事务本身可见,对其他事务不可见,故该undo log可以在事务提交后直接删除。 -

update undo log:update或delete操作中产生的undo log。该undo log可能需要提供MVCC机制,因此不能在事务提交时就进行删除。提交时放入undo log链表,等待purge线程进行最后的删除

不同事务或者相同事务的对同一记录行的修改,会使该记录行的 undo log 成为一条链表,链首就是最新的记录,链尾就是最早的旧记录。

数据可见性算法

ReadView中主要就是有个列表来存储我们系统中当前活跃着的读写事务,也就是begin了还未提交的事务。通过这个列表来判断记录的某个版本是否对当前事务可见。假设当前列表里的事务id为[80,100]。

a) 如果你要访问的记录版本的事务id为50,比当前列表最小的id80小,那说明这个事务在之前就提交了,所以对当前活动的事务来说是可访问的。

b) 如果你要访问的记录版本的事务id为90,发现此事务在列表id最大值和最小值之间,那就再判断一下是否在列表内,如果在那就说明此事务还未提交,所以版本不能被访问。如果不在那说明事务已经提交,所以版本可以被访问。

c) 如果你要访问的记录版本的事务id为110,那比事务列表最大id100都大,那说明这个版本是在ReadView生成之后才发生的,所以不能被访问。

这些记录都是去undo log 链里面找的,先找最近记录,如果最近这一条记录事务id不符合条件,不可见的话,再去找上一个版本再比较当前事务的id和这个版本事务id看能不能访问,以此类推直到返回可见的版本或者结束。

RC 和 RR 隔离级别下 MVCC 的差异

- 在 RC 隔离级别下的

每次select查询前都生成一个Read View(m_ids 列表),后续查询都利用这个Read View,通过这个Read View就可以在undo log版本链找到事务开始时的数据,所以每次查询的数据都一样 - 在 RR 隔离级别下只在事务开始后

第一次select数据前生成一个Read View(m_ids 列表)

s

MVCC+临建锁防止幻读

RR级别通过MVCC和临建锁解决幻读

- 普通select会以MVCC快照读方式读取数据,RR只会在事务开启的第一次查询生成read view,所以其他事务的更新、插入对当前事务不可见,实现可重复读和防止快照读下的幻读

- 执行

select...for update、插入、修改、删除等当前读:当前读下,读取的都是最新的数据,如果其他事务插入新的数据,并且刚好在事务查询范围里,就会产生幻读,使用临建锁防止幻读,执行当前读时,锁定读取到的记录的同时,锁定间隙,防止其他事务在查询范围插入数据。只要不插入,就不会幻读

可重复读不完全解决幻读

- 可重复读时,事务1第一次普通select生成Read View,之后事务2新添加记录并提交,然后事务1对那条记录进行更新,此时这条记录的trx_id就变成事务1的事务id,之后事务1就可以用普通select查询该条记录

- 事务1先快照读,事务2插入一条记录,事务1再次当前读就会读到事务2插入的记录,幻读

- 解决时:在开启事务之后,立刻执行当前读,因为会对记录加临建锁,避免其他事务在对应范围插入新纪录

InnoDB、插入缓存、预读

四大特性

- 插入缓存(写缓存):change buffer(增删改操作有效)是insert buffer(只对insert有效)的增强,提升插入性能,降低磁盘io

- 对于非唯一普通索引页(唯一索引在插入时需要判断唯一,要读取辅助索引页到缓冲池)才能使用,不在缓冲池,对页进行写操作,不会立刻加载到缓冲池,仅仅记录缓冲变更,等下次读取时再将数据合并恢复到缓冲池(还有后台线程在数据库空闲时、缓冲池不够时、数据库正常关闭、redolog写满时都会触发刷新)

- 插入时先判断插入的索引页是否在缓冲池,在就直接插入,不在就先放入insert buffer,再进行合并操作,写回磁盘,通常把多个插入合并到一个操作,减少随机io,比如Insert buffer有1,99,2,100,合并之前需要4次插入,合并之后1、2可能一个页,99、100可能一个页,变成两次插入

- 适合大部分使用非唯一索引,业务写多读少,不是写后立刻读取

- 二次写:doublewrite缓存在系统表空间,缓存innodb的数据页从buffer pool中flush之后并写入数据文件之前,如果操作系统或数据库在数据页写入磁盘时崩溃,可以在二次写缓存找到数据页备份再恢复,数据页写入二次写缓存快,刷新脏页时会先写入二次写缓存

- 自适应哈希:innodb监控二级索引的查找,如果发现有二级索引被频繁访问,就给该索引建立哈希索引加速查询,只是等值查询,范围查找不行

- 预读:线性预读和随机预读,异步把磁盘的页读取到buffer pool里,预料这些页很快会被读到。

-

mysql没有使用传统lru缓冲池,因为有预读失效和缓冲池污染

-

预读失效:预读把页放到缓冲池,但没被访问

- 优化:让预读失败的页在缓冲池lru时间尽量短,让真正被读取的页挪到lru头部

- 将lru分为新生代和老年代,新生代在前,新页加入老年代头部,如果数据被读取,再加入新生代头部,否则就比新生代的热数据更早淘汰出去

- 优化:让预读失败的页在缓冲池lru时间尽量短,让真正被读取的页挪到lru头部

-

缓冲池污染:sql扫描大量数据时可能把缓冲池所有页替换出去,导致大量热数据被换出,同时新数据很少访问

- 解决:mysql缓冲池加入一个老年代停留时间窗口机制,数据先插入老年代头部,只有满足被访问并且在老年代停留时间大于1他,才放入新生代头部,此时短时间大量加载的页并不会立刻插入新生代头部,而是优先淘汰短期仅访问一次的页

-

MyISAM和InnoDB有什么区别?

- InnoDB 支持行级别的锁粒度,MyISAM 不支持,只支持表级别的锁粒度。

- MyISAM 不提供事务支持。InnoDB 提供事务支持

- MyISAM 不支持 MVCC,而 InnoDB 支持。

- MyISAM 不支持数据库异常崩溃后的安全恢复,而 InnoDB 支持。

sql语句执行过程、mysql架构

sql语句执行过程

- MySQL 主要分为 Server 层和引擎层,Server 层主要包括连接器、查询缓存、分析器、优化器、执行器,同时还有一个日志模块(binlog),这个日志模块所有执行引擎都可以共用,redolog 只有 InnoDB 有。

- 引擎层是插件式的,目前主要包括,MyISAM,InnoDB,Memory 等。

- 查询语句的执行流程如下:权限校验(如果命中缓存)—>查询缓存—>分析器—>优化器—>权限校验—>执行器—>引擎

- 更新语句执行流程如下:分析器---->权限校验---->执行器—>引擎—redo log(prepare 状态)—>binlog—>redo log(commit 状态)

mysql基本架构概览

-

连接器: 身份认证和权限相关(登录 MySQL 的时候)。

-

查询缓存: 执行查询语句的时候,会先查询缓存(MySQL 8.0 版本后移除,因为这个功能不太实用)。

-

分析器: 没有命中缓存的话,SQL 语句就会经过分析器,分析器说白了就是要先看你的 SQL 语句要干嘛,再检查你的 SQL 语句语法是否正确。

- 词法分析:sql语句由多个字符串组成,先提取关键字,如select

- 语法分析:判断sql是否符合语法

-

优化器: 按照 MySQL 认为最优的方案去执行。

-

执行器: 执行前会校验用户有没有权限,没有就会返回错误信息,有就会调用引擎的接口,返回接口执行的结果。

mysql分为server层和存储引擎层

- server层:包括连接器、查询缓存、分析器、优化器、执行器等,跨存储引擎的功能在这一层实现,如存储过程、触发器、视图、函数等,还有一个通用日志模块binlog

- 存储引擎:负责数据的存储和读取,支持Innodb,MyISAM,Memory,innodb有日志模块redo log,mysql5.5时是默认innodb存储引擎

慢查询、执行计划

定位:慢查询日志记录所有执行时间超过默认10秒的sql,要配置开启慢查询( slow_query_log = 1),查询命令show variables like 'long_query_time';

原因:explain或者desc加上查询sql

执行计划是一条sql在经过mysql查询优化器后具体的执行方式

-

select_type:查询的类型,主要用于区分普通查询、联合查询、子查询等复杂的查询,常见的值有:

- UNION:在 UNION 语句中,UNION 之后出现的 SELECT。

- DERIVED:在 FROM 中出现的子查询将被标记为 DERIVED。

-

type:查询执行的类型,描述了查询是如何执行的。所有值的顺序从最优到最差排序为:system > const > eq_ref > ref > fulltext > ref_or_null > index_merge > unique_subquery > index_subquery > range > index > ALL

-

possible_keys:可能使用的索引,没有就为NULL

-

key:实际用的索引,NULL表示没用到索引

-

key_len:实际使用索引的最大长度,联合索引时可能是多个列的长度和

-

rows:估算找到所需记录需要读取的行数,越小越好

-

Extra:额外信息

- Using index:表明查询使用了覆盖索引,不用回表,查询效率非常高。

- Using index condition:表示查询优化器选择使用了索引下推这个特性。

mysql中的锁

表级锁和行级锁对比

表级锁和行级锁对比:

- 表级锁: MySQL 中锁定粒度最大的一种锁(全局锁除外),是针对非索引字段加的锁,对当前操作的整张表加锁,MyISAM 和 InnoDB 引擎都支持表级锁。

- 行级锁: MySQL 中锁定粒度最小的一种锁,是 针对索引字段加的锁 ,只针对当前操作的行记录进行加锁。 行级锁能大大减少数据库操作的冲突。其加锁粒度最小,并发度高,但加锁的开销也最大,加锁慢,会出现死锁。行级锁和存储引擎有关,是在存储引擎层面实现的。

记录锁、间隙锁、临建锁、插入意向锁(行锁)

InnoDB 行锁是通过对索引数据页上的记录加锁实现的,MySQL InnoDB 支持三种行锁定方式:

- 记录锁(Record Lock):也被称为记录锁,属于单个行记录上的锁。

- 有共享锁S和排他锁X

- 间隙锁(Gap Lock):锁定一个范围,不包括记录本身。锁前开后开

- 多个事务可以同时持有相同间隙范围的间隙锁,不存在互斥关系

- 临键锁(Next-Key Lock):Record Lock+Gap Lock,锁定一个范围,包含记录本身,主要目的是为了解决幻读问题。记录锁只能锁住已经存在的记录,为了避免插入新记录,需要依赖间隙锁。是加锁基本单位,锁前开后闭

- 用唯一索引等值查询时,如果查询记录存在,临建锁会退化为记录锁,如果不存在,临建锁会退化为间隙锁

- 用唯一索引范围查询时,会对每个扫描的索引加间隙锁,但如果是大于等于就会退化为记录锁,小于或小于等于就会退化为间隙锁

- 用普通索引等值查询时,会同时对主键索引和普通索引加锁,但对主键索引加锁时只有满足查询条件的记录才对主键加锁

- 如果查询记录存在,由于肯定存在索引值相同的记录,所以是一个扫描的过程,直到第一个不符合条件的二级索引就停止,途中加的是临建锁,第一个不符合条件的退化为间隙锁,符合查询条件的加记录锁

- 如果查询记录不存在,扫描到第一条不符合条件的二级索引记录,该索引的临建锁退化为间隙锁,因为不存在满足条件的记录,就不会对主键索引加锁

- 用普通索引范围查询时,临建锁不会退化,都是临建锁

- 没加索引的查询,当前读查询时,没有用索引列作为查询条件或查询语句没走索引,导致全表扫描,那么每一条记录都会加临建锁,相当于锁全表

- 避免方法:设置安全更新,update必须满足1(用where,并且条件必须有索引列)2(用limit)3(同时用where和limit,where可以没索引列)其中之一才能执行成功,delete必须满足同时用where和limit,where可以没索引列才能执行成功,如果where带了索引但优化器还是选择全表,可以用force index告诉优化器使用哪个索引

- 插入意向锁:锁定一个点,是特殊的间隙锁,如事务1在准备插入的时候发现已经被事务2加了间隙锁,插入就会阻塞,此时事务1生成一个插入意向锁(处于等待状态,不意味事务1获取到锁,只有正常状态才能获取到锁),此时事务1发生阻塞,直到事务2提交了事务。注意两个事务在同一时间不能一个拥有间隙锁,另一个拥有对应间隙的插入意向锁

共享锁和排他锁

不论是表级锁还是行级锁,都存在共享锁(Share Lock,S 锁)和排他锁(Exclusive Lock,X 锁)这两类:

- 共享锁(S 锁):又称读锁,事务在读取记录的时候获取共享锁,允许多个事务同时获取(锁兼容)。

- 排他锁(X 锁):又称写锁/独占锁,事务在修改记录的时候获取排他锁,不允许多个事务同时获取。如果一个记录已经被加了排他锁,那其他事务不能再对这条事务加任何类型的锁(锁不兼容)。

意向锁(表锁)

快速判断是否可以对某个表使用表锁

意向锁是表级锁,共有两种:

- 意向共享锁(Intention Shared Lock,IS 锁):事务有意向对表中的某些记录加共享锁(S 锁),加共享锁前必须先取得该表的 IS 锁。

- 意向排他锁(Intention Exclusive Lock,IX 锁):事务有意向对表中的某些记录加排他锁(X 锁),加排他锁之前必须先取得该表的 IX 锁。

意向锁是由数据引擎自己维护的,用户无法手动操作意向锁,在为数据行加共享/排他锁之前,InooDB 会先获取该数据行所在在数据表的对应意向锁。

意向锁之间是互相兼容的。意向锁和共享锁和排它锁互斥(这里指的是表级别的共享锁和排他锁,意向锁不会与行级的共享锁和排他锁互斥)。

数据存储、行格式

表空间文件结构

系统表空间(共享表空间):数据、索引页,insert buffer

临时表空间:存放用户创建的临时表和磁盘内部的临时表

undo表空间:

段、区、页、行

- 行

- 页:InnoDB以页为单位读写

- 区:InnoDB的B+树,表中数据量大的时候,给索引分配空间以区为单位1MB,连续64个页一个区,这样相邻页的物理位置相邻,就能用顺序IO

- 段:

- 索引段:放B+树的非叶子节点

- 数据段:放B+树的叶子节点

- 回滚段:回滚数据集合

行格式

- Redundant:不紧凑,古老

- Compact:紧凑,5.1默认,额外信息和真实数据

- 额外信息:变长字段列表、空值列表、记录头信息

- 变长字段:varchar会存实际数据长度,varchar(n)里面n是字符数量,最大65535字节,只出现在有变长字段的时候

- 空值列表:每个列对应二进制位,只出现在表的字段存在可以空的时候

- 记录头信息:标识数据是否被删除、下一条记录的位置、当前记录的类型(非叶子节点、最小、最大、普通)

- 真实数据:还有三个隐藏字段,主键id、事务id、回滚指针

- 主键id:没指定同时没唯一约束,就使用这个

- 事务id:标识数据是哪个事务生成的

- 回滚指针:记录上一个版本的指针

- 额外信息:变长字段列表、空值列表、记录头信息

- Dynamic:紧凑,5.7默认

- Compressed:紧凑

行溢出

单个记录过大,一个页存不了一条记录,多的数据会存到溢出页

发生页溢出时,记录的真实数据处只保存该列的一部分数据,剩余数据在溢出页,在真实数据保存溢出页地址,这是Compact行格式的策略。Dynamic和Compressed都是把所有数据都保存在溢出页,然后只保存溢出页地址

磁盘IO过高优化

延迟binlog和redolog的刷盘时机,降低磁盘IO的频率

- 设置组提交参数延迟binlog刷盘时机

- 设置累积n个事务再提交binlog,延迟binlog刷盘时机

- redolog参数设置2,每次写入page cache,由操作系统决定什么时候持久化

mysql、sql语句优化

-

表设计优化:数据类型,char(定长效率高)和varchar

-

索引优化:优化创建原则和索引失效

-

sql语句优化

- select避免使用*,可能不能使用覆盖索引

- 避免索引失效

- unionall替代union(多一次过滤)

- 尽量inner join,以小表为驱动,内连接会优化把小表放到外边

-

主从复制、读写分离:解决数据库的写入,影响查询的效率

-

分库分表

-

limit优化:limit 10000,10 和 limit 0,10 性能差距大,因为执行逻辑是

-

从表读取10条记录到数据集中

-

重复第一步直到读到第10010调记录

-

根据offset抛弃前面10000条数

-

返回剩余10条数据

- 优化方法1:给该字段加索引,但只是因为查询简单

- 优化2:SELECT * FROM product WHERE ID > =(select id from product limit 10000, 1) limit 10

- 优化3:SELECT * FROM product a JOIN (select id from product limit 10000, 20) b ON a.ID = b.id

-

框架

Spring

IOC

Bean 的作用域

- singleton : IoC 容器中只有唯一的 bean 实例。Spring 中的 bean 默认都是单例的,是对单例设计模式的应用。

- prototype : 每次获取都会创建一个新的 bean 实例。也就是说,连续

getBean()两次,得到的是不同的 Bean 实例。 - request (仅 Web 应用可用): 每一次 HTTP 请求都会产生一个新的 bean(请求 bean),该 bean 仅在当前 HTTP request 内有效。

- session (仅 Web 应用可用) : 每一次来自新 session 的 HTTP 请求都会产生一个新的 bean(会话 bean),该 bean 仅在当前 HTTP session 内有效。

- application/global-session (仅 Web 应用可用):每个 Web 应用在启动时创建一个 Bean(应用 Bean),该 bean 仅在当前应用启动时间内有效。

Bean 是线程安全的吗?

Spring 框架中的 Bean 是否线程安全,取决于其作用域和状态。

单例时可能存在线程安全问题,针对有状态对象(如每个请求都可以修改一个成员变量),可以使用ThreadLocal

Bean 的生命周期

spring实例化时,根据 BeanDefinition 创建对象

-

构造函数

-

依赖注入

-

检查Aware相关接口并设置相关依赖(传入bean名称、bean类加载器、bean工厂实例)

-

BeanPostProcessor后置处理器在初始化方法之前处理

-

初始化方法

- 检查是不是InitializingBean来决定是否调用afterPropertiesSet方法

- 检查是否配置有自定义的iit-method

-

BeanPostProcessor后置处理器在初始化方法之后处理

-

销毁bean

- 如果bean实现了DisposableBean接口, 就执行destroy()

- 销毁bean的时候,如果bean在配置文件包含destroy-method属性,就执行对应方法

循环依赖/循环引用

两个或两个以上的bean互相持有对象,最终形成闭环,比如a依赖b,b依赖a

三级缓存解决大部分循环依赖

- 一级缓存:单例池,缓存已经经历完整生命周期,初始化完成的bean对象

- 二级缓存:缓存早期的bean对象(生命周期没走完)

- 避免多次调用对象工厂产生多例,每次生成对象不同,所以使用工厂生产好的对象直接放到二级缓存,使用时都是同一个

- 只使用一二级缓存可以解决一般对象的循环依赖,但如果是代理对象,就应该注入代理对象,但spring都是在创建完bean之后才创建对应的代理(代理在后置处理的初始化后完成aop代理),不提前创建代理对象,在出现循环依赖被其他对象注入时,才生成代理对象放入二级缓存(设计原则),所以引入三级缓存

- 三级缓存:缓存ObjectFactory,主要用来创建代理对象,代理对象再放到二级缓存

先实例化a,a生成一个对象工厂放到三级缓存,注入b的时候需要实例化b,此时b生成一个对象工厂放到三级缓存,b里需要注入a,通过三级缓存里a的对象工厂创建代理对象一个(也可以是指定的其他对象)放入二级缓存,再从二级缓存把a的代理对象注入到b,b创建成功后放入单例池,把b注入a后放入单例池

构造方法的循环依赖需要使用@Lazy进行懒加载,需要对象再进行bean对象的创建,因为bean的生命周期中构造函数第一个执行,框架不能解决构造函数的依赖注入

AOP

面向切面编程能将与业务无关,却为业务逻辑调用相同的逻辑封装起来。减少重复代码

基于动态代理,如果要代理的对象实现某个接口,就用jdk动态代理,其他使用cglib动态代理

AspectJ是AOP的框架

前置、后置、返回(方法结束返回结果值之前)、异常、环绕通知

@Order自定义切面顺序

Spring 框架的设计模式

- 工厂设计模式 : Spring 使用工厂模式通过

BeanFactory或ApplicationContext创建 bean 对象。- BeanFactory:延迟注入(使用bean的时候注入)

- ApplicationContext:容器启动的时候一次性创建所有bean,扩展了BeanFactory

- 代理设计模式 : Spring AOP 功能的实现。

- 单例设计模式 : Spring 中的 Bean 默认都是单例的。

- ConcurrentHashMap实现,给这个map添加的时候synchronized这个map

- 模板方法模式 : Spring 中

jdbcTemplate、hibernateTemplate等以 Template 结尾的对数据库操作的类,它们就使用到了模板模式。 - 装饰者设计模式 : 我们的项目需要连接多个数据库,而且不同的客户在每次访问中根据需要会去访问不同的数据库。这种模式让我们可以根据客户的需求能够动态切换不同的数据源。

- 观察者模式: Spring 事件驱动模型就是观察者模式很经典的一个应用。

- 适配器模式 : Spring AOP 的增强或通知(Advice)使用到了适配器模式、spring MVC 中也是用到了适配器模式适配

Controller。- AOP中,每个类型的通知都有对应的拦截器,通知要通过对应的适配器,是配成MethodInterceptor接口类型的对象,通过调用getInterceptor,适配成MethodBeforeAdviceInterceptor

- MVC中,DispatcherServlet调用HandlerMapping,解析请求对应的Handler,解析到对应的Handler(Controller),再由HandlerAdapter适配器处理,Controller作为需要适配的类,因为Controller太多,不同Controller要通过不同方法对请求处理,所以让适配器执行处理

Spring 事务

管理事务的方式

- 编程式事务:在代码中硬编码(不推荐使用) : 通过

TransactionTemplate或者TransactionManager手动管理事务,实际应用中很少使用,但是对于你理解 Spring 事务管理原理有帮助。 - 声明式事务:在 XML 配置文件中配置或者直接基于注解(推荐使用) : 实际是通过 AOP 实现(基于

@Transactional的全注解方式使用最多)

事务传播行为

事务传播行为是为了解决业务层方法之间互相调用的事务问题。

四种正确的行为

- REQUIRED:默认,如果存在事务就加入该事务,如果当前没有事务,就创建一个新事务

- REQUIRES_NEW:创建一个新事务,如果存在当前事务,就把当前事务挂起

- NESTED:如果当前存在事务,就创建一个事务作为当前事务的嵌套事务运行,如果当前没有事务,就创建一个新事务

- MANDATORY:如果当前存在事务,就加入该事务,如果当前没有事务,就抛出异常

三种错误的行为,事务可能不会回滚:

- SUPPORTS:如果当前存在事务,就加入该事务,如果当前没有事务,就以非事务的方式继续运行

- NOT_SUPPORTED:以非事务方式运行,如果当前存在事务,就把当前事务挂起

- NEVER:以非事务方式运行,如果当前存在事务,就抛出异常

工作原理

基于AOP动态代理,一个方法添加@Transactional注解之后,spring会基于这个类生成一个代理对象,会把这个代理对象作为bean,使用这个代理对象的时候,如果有事务处理,就先把事务的自动提交关闭,再执行具体的业务,如果业务没有出现异常,spring会提交事务,如果出现异常,会回滚

事务失效

- 异常捕获处理:事务通知只有捕捉到目标抛出的异常才能进行回滚,如果目标自己处理,事务通知就无法回滚,可以在catch后再次throw

- 抛出检查异常:比如读文件编译异常,文件并不存在,因为spring默认只回滚非检查异常,可以配置rollbackFor属性为Exception.class

- 非public方法导致事务失效:spring为方法创建代理,添加事务通知,前提条件是方法是public的

SpringMVC

核心组件

DispatcherServlet:核心的中央处理器,负责接收请求、分发,并给予客户端响应。HandlerMapping:处理器映射器,根据 URL 去匹配查找能处理的Handler,并会将请求涉及到的拦截器和Handler一起封装。HandlerAdapter:处理器适配器,根据HandlerMapping找到的Handler,适配执行对应的Handler;Handler:请求处理器,处理实际请求的处理器。ViewResolver:视图解析器,根据Handler返回的逻辑视图 / 视图,解析并渲染真正的视图,并传递给DispatcherServlet响应客户端

执行流程/工作原理

- 客户端(浏览器)发送请求,

DispatcherServlet前端控制器拦截请求。 DispatcherServlet根据请求信息调用HandlerMapping处理器映射器 。HandlerMapping根据 URL 去匹配查找能处理的Handler(Controller控制器) ,并会将请求涉及到的拦截器和Handler一起封装。返回处理器执行链DispatcherServlet调用HandlerAdapter处理器适配器执行Handler。Handler完成对用户请求的处理后,会返回一个ModelAndView对象给DispatcherServlet,Model是返回的数据对象,View是个逻辑上的View。- 前端控制器调用

ViewResolver视图解析器 把逻辑视图转换为真正视图返回给前端控制器 - 渲染视图

- 把

View返回给请求者(浏览器)

SpringBoot

自动装配/自动配置

SpringBoot 在启动时会扫描外部引用 jar 包中的META-INF/spring.factories文件,将文件中配置的类型信息加载到 Spring 容器,并执行类中定义的各种操作。对于外部 jar 来说,只需要按照 SpringBoot 定义的标准,就能将自己的功能装置进 SpringBoot。

引入第三方依赖只需要引入一个starter,再通过注解和一些配置就可以使用

核心注解@SpringBootApplication

@EnableAutoConfiguration:启用 SpringBoot 的自动配置机制- 自动装配核心功能的实现实际是通过

AutoConfigurationImportSelector类。实现了ImportSelector接口,也就实现了这个接口中的selectImports方法,该方法主要用于获取所有符合条件的类的全限定类名,这些类需要被加载到 IoC 容器中。 - 在selectImports方法里,

getAutoConfigurationEntry()方法,这个方法主要负责加载自动配置类的。- 先判断自动装配开关是否打开,找@EnableAutoConfiguration注解

- 再获取该注解排除的类信息

- 接着获取需要自动装配的所有配置类,读取所有Starter下的

META-INF/spring.factories(starter扩展包都有META-INF) - 接着筛选需要装配的类,通过@ConditionalOnXXX,所有条件都满足该类才生效,比如一些类依赖其他bean,就有这个条件,根据条件决定是否加载bean

- 自动装配核心功能的实现实际是通过

@Configuration:允许在上下文中注册额外的 bean 或导入其他配置类@ComponentScan:扫描被@Component(@Service,@Controller)注解的 bean,注解默认会扫描启动类所在的包下所有的类 ,可以自定义不扫描某些 bean。

Mybatis

执行流程

- 构建会话工厂sqlSessionFactory,全局一个,生产sqlSession

- 创建会话SqlSession,项目与数据库的会话,包含执行sql的所有方法,每次操作一次会话

- Executor执行器,真正操作数据库接口,维护缓存

- MappedStatement对象,读取存储mapper里的一个方法信息,代表某一次数据库的操作

- 输入参数映射

- 输出结果映射

分页插件

原理:分页插件的基本原理是使用 MyBatis 提供的插件接口,实现自定义插件,在插件的拦截方法内拦截待执行的 sql,然后重写 sql,根据 dialect 方言,添加对应的物理分页语句和物理分页参数。

MyBatis 使用 JDK 的动态代理,为需要拦截的接口生成代理对象以实现接口方法拦截功能

延迟加载

MyBatis支持延迟加载。 延迟加载是指在查询对象时,只加载其基本属性,而将关联对象的数据暂不加载,等到真正需要使用关联对象时再去查询加载

它的原理是,使用 CGLIB 创建目标对象的代理对象,当调用目标方法时,进入拦截器方法,比如调用 a.getB().getName() ,拦截器 invoke() 方法发现 a.getB() 是 null 值,那么就会单独发送事先保存好的查询关联 B 对象的 sql,把 B 查询上来,然后调用 a.setB(b),于是 a 的对象 b 属性就有值了,接着完成 a.getB().getName() 方法的调用。这就是延迟加载的基本原理。

多级缓存

一级缓存

一级缓存的生命周期和SqlSession一致

每个SqlSession中持有了Executor,每个Executor中有一个LocalCache。当用户发起查询时,MyBatis根据当前执行的语句生成MappedStatement,在Local Cache进行查询,如果缓存命中的话,直接返回结果给用户,如果缓存没有命中的话,查询数据库,结果写入Local Cache,最后返回结果给用户。一级缓存只在数据库会话内部共享。

SqlSession向用户提供操作数据库的方法,但和数据库操作有关的职责都会委托给Executor。Local Cache的查询和写入是在Executor内部完成的,BaseExecutor成员变量之一的PerpetualCache,是对Cache接口最基本的实现,其实现非常简单,内部持有HashMap,对一级缓存的操作实则是对HashMap的操作,比如查询操作,会在执行的最后判断一级缓存是不是STATEMENT级别,如果是就清空缓存,所以STATEMENT级别的一级缓存无法共享localCache,其他操作会统一走update流程,执行update前会先清空localCache

只有会话提交或关闭后,一级缓存的数据才会转移到二级缓存

可以配置两个级别

- SESSION:默认,一个会话的所有语句共享一个缓存

- 在修改数据后查询,一级缓存会失效

- STATEMENT:缓存只对当前执行的这一个Statement有效

二级缓存

多个sqlsession共享缓存,使用CachingExecutor装饰Executor,进入一级缓存的查询流程前,先在CachingExecutor进行二级缓存的查询

二级缓存开启后,同一个namespace下的所有操作语句,都影响着同一个Cache,即二级缓存被多个SqlSession共享,是一个全局的变量。使用时要配置开启二级缓存

两个sqlsession的相同查询,如果第一个查询没有提交,第二个就不会使用二级缓存,如果更新并提交,之前的缓存还是查不到

默认的设置中SELECT语句不会刷新缓存,insert/update/delte会刷新缓存

JVM

jvm参数

-XX:+PrintGCDetails 打印基本 GC 信息

-Xms<size>: 指定JVM的初始堆大小

-Xmx<size>: 指定JVM的最大堆大小

-Xss<size>: 指定每个线程的堆栈大小

-XX:+UseG1GC: 启用G1垃圾收集器

-XX:+PrintFlagsFinal命令来查看当前JVM的所有参数及其默认值。

监控工具

这些命令在 JDK 安装目录下的 bin 目录下:

-

jps(JVM Process Status): 类似 UNIX 的ps命令。用于查看所有 Java 进程的启动类、传入参数和 Java 虚拟机参数等信息; -

jstat(JVM Statistics Monitoring Tool): 用于收集 HotSpot 虚拟机各方面的运行数据; -

jinfo(Configuration Info for Java) : Configuration Info for Java,显示虚拟机配置信息;- 加上jps后的进程Id

-

jmap(Memory Map for Java) : 生成堆转储快照; -

jhat(JVM Heap Dump Browser) : 用于分析 heapdump 文件,它会建立一个 HTTP/HTML 服务器,让用户可以在浏览器上查看分析结果; -

jstack(Stack Trace for Java) : 生成虚拟机当前时刻的线程快照,线程快照就是当前虚拟机内每一条线程正在执行的方法堆栈的集合。- 加上jps后的进程id

JConsole 是基于 JMX 的可视化监视、管理工具。可以很方便的监视本地及远程服务器的 java 进程的内存使用情况。

java内存区域

运行时数据区

- 线程共享:堆(字符串常量池)、方法区(运行时常量池)1.7在堆,1.8在本地内存、直接内存

- 线程私有:虚拟机栈、本地方法栈、程序计数器

程序计数器

当前线程所执行的字节码的行号指示器

- 字节码解释器通过改变程序计数器来依次读取指令,从而实现代码的流程控制

- 在多线程的情况下,程序计数器用于记录当前线程执行的位置,从而当线程被切换回来的时候能够知道该线程上次运行到哪儿了。

程序计数器是唯一一个不会出现 OutOfMemoryError 的内存区域,它的生命周期随着线程的创建而创建,随着线程的结束而死亡。

程序计数器为什么是私有的?

主要是为了线程切换后能恢复到正确的执行位置

java虚拟机栈

方法调用的数据需要通过栈进行传递,每一次方法调用都会有一个对应的栈帧被压入栈中,每一个方法调用结束后,都会有一个栈帧被弹出。

-

局部变量表 主要存放了编译期可知的各种数据类型(boolean、byte、char、short、int、float、long、double)、对象引用(reference 类型,它不同于对象本身,可能是一个指向对象起始地址的引用指针,也可能是指向一个代表对象的句柄或其他与此对象相关的位置)。

-

操作数栈 主要作为方法调用的中转站使用,用于存放方法执行过程中产生的中间计算结果。另外,计算过程中产生的临时变量也会放在操作数栈中。

-

动态链接 主要服务一个方法需要调用其他方法的场景。Class 文件的常量池里保存有大量的符号引用比如方法引用的符号引用。当一个方法要调用其他方法,需要将常量池中指向方法的符号引用转化为其在内存地址中的直接引用。动态链接的作用就是为了将符号引用转换为调用方法的直接引用,这个过程也被称为 动态连接 。

-

方法返回地址

StackOverFlowError: 若栈的内存大小不允许动态扩展,那么当线程请求栈的深度超过当前 Java 虚拟机栈的最大深度./t 的时候,就抛出 StackOverFlowError 错误。

OutOfMemoryError: 如果栈的内存大小可以动态扩展, 如果虚拟机在动态扩展栈时无法申请到足够的内存空间,则抛出OutOfMemoryError异常。hotspot栈容量不能动态扩展,所以不会因为无法扩展导致oom,但如果申请空间就失败,还是会oom

虚拟机栈和本地方法栈为什么是私有的?

为了保证线程中的局部变量不被别的线程访问到

本地方法栈

虚拟机栈为虚拟机执行 Java 方法 (也就是字节码)服务,而本地方法栈则为虚拟机使用到的 Native 方法服务。

堆

此内存区域的唯一目的就是存放对象实例,几乎所有的对象实例以及数组都在这里分配内存。

从 JDK 1.7 开始已经默认开启逃逸分析,如果某些方法中的对象引用没有被返回或者未被外面使用(也就是未逃逸出去),那么对象可以直接在栈上分配内存。

年龄增加到一定程度(默认为 15 岁),就会被晋升到老年代中。对象晋升到老年代的年龄阈值,可以通过参数 -XX:MaxTenuringThreshold 来设置。

Hotspot 遍历所有对象时,按照年龄从小到大对其所占用的大小进行累积,当累积的某个年龄大小超过了 survivor 区的一半时,取这个年龄和 MaxTenuringThreshold 中更小的一个值,作为新的晋升年龄阈值”

java.lang.OutOfMemoryError: GC Overhead Limit Exceeded:当 JVM 花太多时间执行垃圾回收并且只能回收很少的堆空间时,就会发生此错误。

java.lang.OutOfMemoryError: Java heap space :假如在创建新的对象时, 堆内存中的空间不足以存放新创建的对象, 就会引发此错误。(和配置的最大堆内存有关,且受制于物理内存大小。最大堆内存可通过-Xmx参数配置,若没有特别配置,将会使用默认值

方法区

方法区属于是 JVM 运行时数据区域的一块逻辑区域,是各个线程共享的内存区域。

当虚拟机要使用一个类时,它需要读取并解析 Class 文件获取相关信息,再将信息存入到方法区。方法区会存储已被虚拟机加载的 类信息、字段信息、方法信息、常量、静态变量、即时编译器编译后的代码缓存等数据。

元空间里面存放的是类的元数据,这样加载多少类的元数据就不由 MaxPermSize 控制了, 而由系统的实际可用空间来控制,这样能加载的类就更多了。

运行时常量池

Class 文件中除了有类的版本、字段、方法、接口等描述信息外,还有用于存放编译期生成的各种字面量(Literal)和符号引用(Symbolic Reference)的 常量池表(Constant Pool Table) 。

字面量包括整数、浮点数和字符串字面量。常见的符号引用包括类符号引用、字段符号引用、方法符号引用、接口方法符号。

常量池表会在类加载后存放到方法区的运行时常量池中。

字符串常量池

字符串常量池 是 JVM 为了提升性能和减少内存消耗针对字符串(String 类)专门开辟的一块区域,主要目的是为了避免字符串的重复创建。

JDK1.7 之前,字符串常量池存放在永久代。JDK1.7 字符串常量池和静态变量从永久代移动了 Java 堆中。

JDK 1.7 为什么要将字符串常量池移动到堆中?

主要是因为永久代(方法区实现)的 GC 回收效率太低,只有在整堆收集 (Full GC)的时候才会被执行 GC。Java 程序中通常会有大量的被创建的字符串等待回收,将字符串常量池放到堆中,能够更高效及时地回收字符串内存

直接内存

JDK1.4 中新加入的 NIO(Non-Blocking I/O,也被称为 New I/O),引入了一种基于**通道(Channel)**与**缓存区(Buffer)*的 I/O 方式,它可以直接使用 Native 函数库直接分配堆外内存,然后通过一个存储在 Java 堆中的 DirectByteBuffer 对象作为这块内存的引用进行操作。这样就能在一些场景中显著提高性能,因为*避免了在 Java 堆和 Native 堆之间来回复制数据。

直接内存是一种特殊的内存缓冲区,并不在 Java 堆或方法区中分配的,而是通过 JNI (是一种编程框架,使得Java虚拟机中的Java程序可以调用本地应用/或库,也可以被其他程序调用)的方式在本地内存上分配的。

堆外内存就是把内存对象分配在堆(新生代+老年代+永久代)以外的内存,这些内存直接受操作系统管理(而不是虚拟机),这样做的结果就是能够在一定程度上减少垃圾回收对应用程序造成的影响。

对象创建、布局、访问过程

对象的创建

-

类加载检查:先去常量池定位这个类的符号引用,检查这个符号引用的类是否已经被加载过、解析和初始化,没有就先执行对应类加载

-

分配内存:对象内存大小在类加载完成后就确定了。分配方式有指针碰撞和空闲列表,选择方法由java堆是否规整决定,java堆是否规整由所采用的垃圾收集器是否带有压缩整理功能决定

- 指针碰撞:内存规整,用过的内存和没用的内存中间有一个分界指针,只用往没用的内存方向移动就好,Serial,ParNew

- 空闲列表:内存不规整,虚拟机维护一个空闲列表,分配的时候根据列表找,之后更新列表,CMS

java堆是否规整,取决于GC收集器是标记-清除还是标记-整理(也叫标记-压缩),复制算法内存是规整的

内存分配的并发问题

- CAS+失败重试:冲突失败就重试,虚拟机采用CAS配失败重试保证更新操作的原子性

- TLAB:为每一个线程在Eden区分配一块内存,JVM给线程中的对象分配内存时,先在TLAB中分配,当对象大于TLAB中的剩余内存或TLAB内存耗尽时,再用CAS+失败重试

-

初始化零值:不包括对象头,保证对象的实例字段不赋初值就直接使用

-

设置对象头:对象是哪个类的实例,如何找到类的元数据信息,对象哈希码,对象GC分代年龄等,存放在对象头中,还会根据虚拟机当前运行状态不同,是否启用偏向锁等,会有不同的设置方式

-

执行init方法:从虚拟机角度看,对象已经产生了,但从java程序看,对象创建刚开始

对象的内存布局

在HotSpot虚拟机中,对象在内存布局分为3块:对象头,实例数据,对齐填充

对象头:包括两部分数据,第一部分用于存储对象自身的运行时数据(哈希码,GC分代年龄,锁状态标志等),另一部分是类型指针,即对象指向它的类元数据的指针,虚拟机通过这个指针确定这个对象是哪个类的实例

实例数据:对象真正存储的有效信息,也就是程序定义的各种类型的字段

对其填充:非必须,仅仅占位作用,因为 Hotspot 虚拟机的自动内存管理系统要求对象起始地址必须是 8 字节的整数倍,换句话说就是对象的大小必须是 8 字节的整数倍。而对象头部分正好是 8 字节的倍数(1 倍或 2 倍),因此,当对象实例数据部分没有对齐时,就需要通过对齐填充来补全。

对象的访问定位

对象的访问方式由虚拟机实现而定,主流有使用句柄,直接指针

句柄

如果使用句柄的话,那么 Java 堆中将会划分出一块内存来作为句柄池,reference 中存储的就是对象的句柄地址,而句柄中包含了对象实例数据与对象类型数据各自的具体地址信息。

直接指针

这两种对象访问方式各有优势。使用句柄来访问的最大好处是 reference 中存储的是稳定的句柄地址,在对象被移动时只会改变句柄中的实例数据指针,而 reference 本身不需要修改。使用直接指针访问方式最大的好处就是速度快,它节省了一次指针定位的时间开销。

HotSpot 虚拟机主要使用的就是这种方式来进行对象访问。

jvm垃圾回收

内存分配和回收原则

-

对象优先在Eden区分配:Eden区空间不足时,虚拟机发起Minor GC,发现无法存入Survivor空间时,会通过分配担保机制把新生代的对象转移到老年代

-

大对象直接进入老年代:避免为大对象分配内存时由于分配担保机制带来的复制降低效率

-

长期存活的对象进入老年代:对象在 Survivor 中每熬过一次 MinorGC,年龄就增加 1 岁,当它的年龄增加到一定程度(默认为 15 岁),就会被晋升到老年代中。对象晋升到老年代的年龄阈值,可以通过参数

-XX:MaxTenuringThreshold来设置。 -

主要进行GC的区域:

-

部分收集(Partial GC):

- 新生代收集(Minor GC / Young GC):只对新生代进行垃圾收集;

-

老年代收集(Major GC / Old GC):只对老年代进行垃圾收集。需要注意的是 Major GC 在有的语境中也用于指代整堆收集;

-

混合收集(Mixed GC):对整个新生代和部分老年代进行垃圾收集。

-

整堆收集 (Full GC):收集整个 Java 堆和方法区。

-

-

空间分配担保:确保Minor GC之前老年代本身还有容纳新生代所有对象的剩余空间。JDK 6 Update 24 之后的规则变为只要老年代的连续空间大于新生代对象总大小或者历次晋升的平均大小,就会进行 Minor GC,否则将进行 Full GC。

死亡对象判断方法、GCRoots

垃圾回收前要判断哪些对象已经死亡

-

引用计数法:给对象添加一个引用计数器,被引用就+1,失效就-1,0就不能被使用,实现简单,但存在对象循环引用问题

-

可达性算法分析:通过一系列GC Roots的对象为起点,从这些节点开始向下搜索,走过的路径称为引用链,当一个对象到GC Roots没有任何引用链相连,就证明对象不可用,需要被回收。可以作为GC Roots的对象:

-

虚拟机栈(栈帧中的本地变量表)中引用的对象

-

本地方法栈(Native方法)中引用的对象

-

方法区中类静态属性引用的对象

-

方法区中常量引用的对象

-

所有被同步锁持有的对象

-

即使不可达,但也不一定被回收,对象真正死亡至少经历两次标记,可达性分析法中不可达的对象被第一次标记并且进行一次筛选,筛选的条件是此对象是否有必要执行 finalize 方法。当对象没有覆盖 finalize 方法,或 finalize 方法已经被虚拟机调用过时,虚拟机将这两种情况视为没有必要执行。

被判定为需要执行的对象将会被放在一个队列中进行第二次标记,除非这个对象与引用链上的任何一个对象建立关联,否则就会被真的回收。

jdk9及以后各个类的finalize方法会被逐渐弃用移除

四种引用类型

-

强引用

不回收

-

软引用

空间够就不回收,空间不够就回收,可以用来实现内存敏感的高速缓存,可以和

ReferenceQueue联合使用,如果软引用引用的对象被回收,虚拟机就会把这个软引用加入到与之关联的队列软引用可以加速 JVM 对垃圾内存的回收速度,可以维护系统的运行安全,防止内存溢出(OutOfMemory)等问题的产生。

-

弱引用

只要发生垃圾回收,垃圾回收器线程扫描它所管辖的内存区域中,如果发现只具有弱引用的对象,就会直接回收,但垃圾回收器优先级很低的线程,发现会慢一点,弱引用也可以加入

ReferenceQueue中,如果弱引用所引用的对象被垃圾回收,Java 虚拟机就会把这个弱引用加入到与之关联的引用队列中。 -

虚引用

如果一个对象仅持有虚引用,那么它就和没有任何引用一样,在任何时候都可能被垃圾回收。

虚引用主要用来跟踪对象被垃圾回收的活动

虚引用与软引用和弱引用的一个区别在于: 虚引用必须和引用队列(ReferenceQueue)联合使用。当垃圾回收器准备回收一个对象时,如果发现它还有虚引用,就会在回收对象的内存之前,把这个虚引用加入到与之关联的引用队列中。程序可以通过判断引用队列中是否已经加入了虚引用,来了解被引用的对象是否将要被垃圾回收。程序如果发现某个虚引用已经被加入到引用队列,那么就可以在所引用的对象的内存被回收之前采取必要的行动。

如何判断一个类是无用类?

方法区主要回收无用的类,无用类满足3条

- 该类所有实例已经被回收

- 加载该类的ClassLoader已经被回收

- 该类对应的Class对象没有在任何地方被引用,无法在任何地方通过反射访问该类的方法

满足后仅仅可以被回收,不是必然

垃圾回收算法

标记清除

首先标记不需要回收的对象,标记完成后统一回收掉没有标记的对象

问题:

- 效率:标记和清除效率都不高

- 空间:会产生大量不连续内存碎片

标记复制

为了解决标记清除的效率和碎片问题,将内存分为大小相同的两块,每次使用其中的一块,当这一块内存使用完成后,将还存活的对象复制到另一块,然后再把之前的空间全部清理掉,每次内存回收一半

问题:

- 可用内存变小:可用内存缩小为原来的一半

- 不适合老年代:如果存活数量比较大,复制性能会变差

标记整理

根据老年代特点的标记算法,标记过程和标记清除一样,但不是直接回收可回收对象,而是将所有存活对象向一端移动,然后直接清理另外一端,因为多了整理,所以效率不高,适合老年代这种垃圾回收频率不高的场景

分代收集

根据对象存活周期的不同

一般将java堆分为新生代和老年代

在新生代,可用选择标记复制算法,每次收集都有大量对象死去,只需要付出少量对象的复制成本就可用完成垃圾收集,但老年代对象存活几率比较高,而且没有额外空间进行分配担保,所以使用标记清除或标记整理

垃圾收集器

垃圾收集器是内存回收的具体体现

默认收集器

- JDK 8:Parallel Scavenge(新生代)+ Parallel Old(老年代)

- JDK 9 ~ JDK20: G1

Serial收集器

串行收集器,单线程

新生代标记复制

老年代标记整理

没有线程交互的开销,简单高效

应用:Client 模式下的虚拟机

ParNew收集器

本质是Serial收集器的多线程版本,除了使用多线程进行垃圾收集,其他行为无区别

新生代标记复制

老年代标记整理

除了Serial,只有它可用和CMS收集器配合工作

应用:Server 模式下的虚拟机

并行和并发概念补充:

- 并行(Parallel):指多条垃圾收集线程并行工作,但此时用户线程仍然处于等待状态。

- 并发(Concurrent):指用户线程与垃圾收集线程同时执行(但不一定是并行,可能会交替执行),用户程序在继续运行,而垃圾收集器运行在另一个 CPU 上。

Parallel Scavenge收集器

使用标记复制的多线程收集器,看上去和ParNew一样

关注吞吐量(高效率利用CPU)CMS等垃圾收集器关注用户线程的停顿时间(提高用户体验)。吞吐量就是CPU中用于运行用户代码的时间和CPU总消耗时间的比值

Parallel Scavenge 收集器提供了很多参数供用户找到最合适的停顿时间或最大吞吐量,如果对于收集器运作不太了解,手工优化存在困难的时候,使用 Parallel Scavenge 收集器配合自适应调节策略,把内存管理优化交给虚拟机去完成也是一个不错的选择。

新生代标记复制

老年代标记整理

JDK1.8 默认使用的是 Parallel Scavenge + Parallel Old

Serial Old收集器

serial收集器的老年代版本,单线程

用途:

- jdk1.5及以上与Parallel Scavenge 收集器搭配

- 作为CMS收集器的后备方案

Parallel Old收集器

Parallel Scavenge收集器的老年代版本,使用多线程和标记整理算法,在注重吞吐量以及CPU资源的场合优先考虑Parallel Scavenge收集器和 Parallel Old收集器

CMS收集器

以获取最短回收停顿时间为目标,注重用户体验

HotSpot第一款真正意义上的并发收集器,第一次实现了让垃圾收集线程和用户线程基本上同时工作

标记清除算法

步骤:

- 初始标记:暂停所有其他线程,记录直接和root相连的对象,快

- 并发标记:同时开启 GC 和用户线程,用一个闭包结构去记录可达对象。但在这个阶段结束,这个闭包结构并不能保证包含当前所有的可达对象。因为用户线程可能会不断的更新引用域,所以 GC 线程无法保证可达性分析的实时性。所以这个算法里会跟踪记录这些发生引用更新的地方。

- 重新标记:为了修正并发标记期间因为用户线程继续运行导致标记产生变动的那部分对象的标记记录,比初始慢,比并发快

- 并发清除:开启用户线程,同时GC线程开始对未标记的区域做清扫

初始标记和重新标记会stw

优点:并发收集,低延迟

缺点:对CPU资源敏感,无法处理浮动垃圾,标记清除产生大量碎片

G1收集器

面向服务器,极高概率满足GC停顿时间同时具备高吞吐量性能特征

- 并行与并发:G1充分利用CPU和多核环境的硬件优势,使用多个CPU缩短stw时间。G1可用通过并发方式让java程序和gc同时执行

- 分代收集:不需要和其他收集器配合

- 空间整合:和CMS的标记清除不同,G1整体看是标记整理,局部看是标记复制

- 可预测的停顿:建立可预测的停顿时间模型,明确在一个长度M毫秒的时间内,消耗在垃圾回收上的时间不超过N毫秒

步骤:

- 初始标记

- 并发标记

- 最终标记

- 筛选回收

内存的回收是以region作为基本单位的;

G1收集器在后台维护优先列表,每次根据允许的收集时间,优先回收价值最大的Region。Region划分内存空间以及有优先级的区域回收方式,保证G1收集器在有限时间尽可能高的收集效率

jdk9成为默认垃圾收集器

ZGC收集器

和CMS中的ParNew和G1类似,采用标记复制,不过改进了算法,stw更少,java15可以使用

STW

整个虚拟机应用线程暂停工作

确保标记的时候不会有对象的引用被修改

类文件结构

Class文件结构

ClassFile {

u4 magic; //Class 文件的标志

u2 minor_version;//Class 的小版本号

u2 major_version;//Class 的大版本号

u2 constant_pool_count;//常量池的数量

cp_info constant_pool[constant_pool_count-1];//常量池

u2 access_flags;//Class 的访问标记

u2 this_class;//当前类

u2 super_class;//父类

u2 interfaces_count;//接口数量

u2 interfaces[interfaces_count];//一个类可以实现多个接口

u2 fields_count;//Class 文件的字段属性数量

field_info fields[fields_count];//一个类可以有多个字段

u2 methods_count;//Class 文件的方法数量

method_info methods[methods_count];//一个类可以有个多个方法

u2 attributes_count;//此类的属性表中的属性数

attribute_info attributes[attributes_count];//属性表集合

}

类加载过程

类的生命周期

类从加载到虚拟机内存到卸载出内存,生命周期7个阶段

- 加载

- 验证

- 准备

- 解析

- 初始化

- 使用

- 卸载

验证,准备,解析统称为连接

类加载过程

class文件需要加载到虚拟机后才能运行和使用,加载class文件分为3步,加载-连接-初始化,连接又分为验证-准备-解析

加载

- 通过全类名获取该类的二进制字节流(无要求,zip,jar,网络,动态代理等)

- 将字节流的静态存储结构转换为方法区的运行时数据结构

- 在内存生成一个代表该类的Class对象,作为方法区这些数据的访问入口

通过类加载器完成,具体哪个类加载器由双亲委派模型决定(但也可以打破)

每个类都有一个引用指向加载它的类加载器,但数组类不是通过ClassLoader加载的,而是JVM在需要的时候自动创建的,数组类通过getClassLoader()方法获取 ClassLoader 的时候和该数组的元素类型的 ClassLoader 是一致的。

加载阶段与连接阶段的部分动作(如一部分字节码文件格式验证动作)是交叉进行的,加载阶段尚未结束,连接阶段可能就已经开始了。

验证

连接的第一步,目的是确保Class文件的字节流包含的信息符合规范,运行后不会危害虚拟机安全

这一步耗费资源较多,也可以用参数关闭大部分类验证,缩短加载时间,4个阶段

- 文件格式验证(Class 文件格式检查)是否符合Class文件格式规范,如是否魔数开头…

- 元数据验证(字节码语义检查)类似这个类是否有父类,是否继承了不能继承的类…

- 字节码验证(程序语义检查)类似参数类型,类型转换是否正确…

- 符号引用验证(类的正确性检查)类似该类使用的其他类,方法,字段是否存在,还有访问权限,这一步发生在解析阶段,在 JVM将符号引用转化为直接引用的时候。确保解析阶段正常执行

后三个验证不会再读取操作字节流

方法区是JVM运行时数据区的一块逻辑区域,是各个线程共享的内存区域,方法区会存储已被虚拟机加载的 类信息、字段信息、方法信息、常量、静态变量、即时编译器编译后的代码缓存等数据。

准备

正式为类变量分配内存并设置初始值,这些内存都在方法区分配

- 此时只分配类变量(静态变量,static修饰),不包括实例变量。实例变量会在对象实例化时随着对象一块分配在堆

- 概念上讲,类变量使用的内存应当在方法区,但jdk7之前使用永久代实现方法区时符合这个概念。但在jdk7及之后,Hotspot把原来在永久代的字符串常量池,静态变量等移动到堆,此时类变量会随着Class对象存放在堆

- 初始值是默认零值,但如果是static final的变量,特殊情况:比如给 value 变量加上了 final 关键字

public static final int value=111,那么准备阶段 value 的值就被赋值为 111

解析

虚拟机讲常量池的符号引用替换为直接引用的过程,解析动作主要针对类或接口、字段、类方法、接口方法、方法类型、方法句柄和调用限定符 7 类符号引用进行。解析阶段是虚拟机将常量池内的符号引用替换为直接引用的过程,也就是得到类或者字段、方法在内存中的指针或者偏移量。

初始化

初始化阶段是执行初始化方法 <clinit> ()方法的过程,是类加载的最后一步,这一步 JVM 才开始真正执行类中定义的 Java 程序代码(字节码)。

clinit是带锁线程安全

初始化阶段,只有6种情况,必须对类进行初始化

- 当遇到 new、getstatic、putstatic、invokestatic 这 4 条字节码指令时,比如 new 一个类,读取一个静态字段(未被 final 修饰)、或调用一个类的静态方法时。

- 当 jvm 执行

new指令时会初始化类。即当程序创建一个类的实例对象。 - 当 jvm 执行

getstatic指令时会初始化类。即程序访问类的静态变量(不是静态常量,常量会被加载到运行时常量池)。 - 当 jvm 执行

putstatic指令时会初始化类。即程序给类的静态变量赋值。 - 当 jvm 执行

invokestatic指令时会初始化类。即程序调用类的静态方法。

- 当 jvm 执行

- 使用

java.lang.reflect包的方法对类进行反射调用时如Class.forname("..."),newInstance()等等。如果类没初始化,需要触发其初始化。 - 初始化一个类,如果其父类还未初始化,则先触发该父类的初始化。

- 当虚拟机启动时,用户需要定义一个要执行的主类 (包含

main方法的那个类),虚拟机会先初始化这个类。 MethodHandle和VarHandle可以看作是轻量级的反射调用机制,而要想使用这 2 个调用, 就必须先使用findStaticVarHandle来初始化要调用的类。- 「补充,来自issue745open in new window」 当一个接口中定义了 JDK8 新加入的默认方法(被 default 关键字修饰的接口方法)时,如果有这个接口的实现类发生了初始化,那该接口要在其之前被初始化。

类卸载

3个要求

- 该类所有实例对象已回收

- 该类没有被其他地方引用

- 该类的类加载器实例被回收

由JVM自带的类加载器加载的类不会被卸载,由自定义的类加载器加载的类可能被卸载

JDK 自带的 BootstrapClassLoader, ExtClassLoader, AppClassLoader 负责加载 JDK 提供的类,所以它们(类加载器的实例)肯定不会被回收。而我们自定义的类加载器的实例是可以被回收的,所以使用我们自定义加载器加载的类是可以被卸载掉的。

类加载器

类加载器是一个负责加载类的对象,ClassLoader是一个抽象类。给定类的二进制名称,类加载器会尝试定位和生成构成类定义的数据。典型策略是将名称转换为文件名,然后从文件系统中读取该名称的类文件

主要作用:加载java类的字节码.class文件到jvm中(在内存中生成一个代表该类的class对象),其实还可以加载其他东西(文本,图像等),但只讨论加载类

类加载器加载规则

jvm启动并不会加载所有类,而是根据需要动态加载,用到的时候再加载

已经加载的类会放到classloader中,类加载时,会先判断类是否被加载过,加载过就直接返回,否则才加载,相同二进制名称的类只会被加载一次

3个内置类加载器

jvm内置3个classloader

- BootstrapClassLoader(启动类加载器):最顶层加载类,c++实现,主要加载jdk核心类库,(

%JAVA_HOME%/lib目录下的rt.jar(基础类库)、resources.jar、charsets.jar等 jar 包和类)以及被-Xbootclasspath参数指定的路径下的所有类。 - ExtensionClassLoader(扩展类加载器):主要负责加载

%JRE_HOME%/lib/ext目录下的 jar 包和类以及被java.ext.dirs系统变量所指定的路径下的所有类。 AppClassLoader(应用程序类加载器):面向我们用户的加载器,负责加载当前应用 classpath 下的所有 jar 包和类。

java9时,扩展类加载器改名为平台类加载器,大部分都是平台类加载器加载的

我们可以对 Java 类的字节码( .class 文件)进行加密,加载时再利用自定义的类加载器对其解密。

自定义类加载器

BootstrapClassLoader 其他类加载器均由 Java 实现且全部继承自java.lang.ClassLoader。如果我们要自定义自己的类加载器,很明显需要继承 ClassLoader抽象类。

protected Class loadClass(String name, boolean resolve):加载指定二进制名称的类,实现了双亲委派机制 。name 为类的二进制名称,resove 如果为 true,在加载时调用 resolveClass(Class<?> c) 方法解析该类。

protected Class findClass(String name):根据类的二进制名称来查找类,默认实现是空方法。

官方建议 ClassLoader的子类重写 findClass(String name)方法而不是loadClass(String name, boolean resolve) 方法。

不想打破双亲委派模型就重写findClass()方法,无法被父类加载器加载的类最终会通过这个方法被加载。但是,如果想打破双亲委派模型则需要重写 loadClass() 方法。

双亲委派模型

ClassLoader类使用委托模型搜索类和资源

双亲委派模型要求除了启动类加载器之外,其他类加载器都有自己的父加载器

ClassLoader实例会在亲自查找类之前,将任务委托给其父类加载器

双亲委派模型是jdk官方推荐的,也可以打破,类加载器的父子关系一般不是以继承实现的,而是组合

public abstract class ClassLoader {

...

// 组合

private final ClassLoader parent;

protected ClassLoader(ClassLoader parent) {

this(checkCreateClassLoader(), parent);

}

...

}

组合优于继承

执行流程

流程:

- 类加载时,先判断当前类是否被加载过,加载过就会直接返回,否则才尝试加载

- 加载时,首先不会自己区尝试加载这个类,而是调用父加载器的loadClass(),所有请求都会传送到顶层启动类加载器

- 只有父加载器无法加载时,子加载器才会尝试自己加载(自己的findClass())

jvm判定两个java类是否相同:不仅看类的全名,还看加载该类的类加载器是否一样,都相同时类才相同

好处

保证java程序的稳定运行,避免类的重复加载,保证核心api不被篡改

打破双亲委派、tomcat

自定义类加载器,继承ClassLoader,如果我们不想打破双亲委派模型,就重写 ClassLoader 类中的 findClass() 方法即可,无法被父类加载器加载的类最终会通过这个方法被加载。但是,如果想打破双亲委派模型则需要重写 loadClass() 方法(因为在loadClass()方法里面,首先不会自己加载这个类,而是把这个请求委派给父类加载器完成)。

Tomcat 服务器为了能够优先加载 Web 应用目录下的类,然后再加载其他目录下的类,就自定义了类加载器 WebAppClassLoader 来打破双亲委托机制。这也是 Tomcat 下 Web 应用之间的类实现隔离的具体原理。

如tomcat:因为tomcat是web服务器,上面可能有多个web应用,为了相互实现隔离,使用自定义类加载器,每个web应用程序对应也给类加载器,这样Tomcat中每个应用就可以使用自己的类加载器去加载自己的类,从而达到应用之间的类隔离,不出现冲突。另外,tomcat还利用自定义加载器实现了热加载功能。

JUC

四大锁、锁升级、锁降级、锁粗化、锁消除

-

无锁:无阻塞不同步,CAS实现原子操作,适用于并发高争抢少,开销较低

- 转为偏向锁:无锁状态下被另一个线程访问

-

偏向锁:适用单线程,获取锁时将线程id标记在锁对象的对象头,适用频繁获取锁的单线程,开销较低,有竞争才释放锁,

- 撤销:撤销需要等到全局安全点(没有正在执行的字节码),先暂停拥有偏向锁的线程,再检查拥有偏向锁线程是否存活,不存活就将对象头设置无锁,存活就变更锁标识,最后唤醒暂停线程

- 只有一个线程访问同步代码块时,对象标记为偏向锁,之后该线程进入该同步代码块直接进入同步状态

-

轻量级锁:自旋等待,偏向锁撤销或多线程竞争时,CAS替换对象头,适用于短时间的锁竞争,开销中等。

- 加锁:线程执行同步代码块之前,jvm先在当前线程栈帧创建存储锁记录的空间,把对象头的martword复制到锁记录,然后尝试cas替换对象头的markword为指向锁记录的指针,成功就获取到锁,失败就表示其他线程竞争锁,当前线程就自旋

- 解锁:cas将markword替换对象头,成功就表示没竞争,失败就膨胀为重量级锁

-

重量级锁:阻塞,线程竞争激烈,适用操作系统的互斥机制,适用长时间的锁竞争,开销高

- 此时其他线程试图获取锁时,都会被阻塞,当持有锁的线程释放锁才唤醒这些线程,再竞争

- 多个线程激烈竞争时,对象标记为重量级锁,需要操作系统的介入

锁粗化:这是一种将多次连续的锁定操作合并为一次的优化手段。假如一个线程在一段代码中反复对同一个对象进行加锁和解锁,那么 JVM 就会将这些锁的范围扩大(粗化),即在第一次加锁的位置加锁,最后一次解锁的位置解锁,中间的加锁解锁操作则被省略

锁消除:这是一种删除不必要的锁操作的优化手段。在 Java 程序中,有些锁实际上是不必要的,例如在只会被一个线程使用的数据上加的锁。JVM 在 JIT 编译的时候,通过一种叫做逃逸分析的技术,可以检测到这些不必要的锁,然后将其删除。

锁升级:

- 偏向锁升级:当一个线程访问同步块时,首先会尝试获取偏向锁。如果当前对象没有被其他线程竞争过,并且持有偏向锁的线程仍然存活,那么当前线程可以直接获取偏向锁,不会发生锁升级。

- 轻量级锁(自旋锁)升级:如果获取偏向锁失败,表示当前对象存在竞争,那么偏向锁会升级为轻量级锁。这时,JVM会通过CAS操作将对象头中的锁标记改为指向线程栈中的锁记录(Lock Record)的指针,并将对象的内容复制到锁记录中。如果轻量级锁获取失败,即有多个线程竞争同一个对象的锁,那么轻量级锁会升级为自旋锁。自旋锁不会使线程阻塞,而是让线程执行忙等待,尝试反复获取锁。这样可以避免线程切换带来的性能损失。

- 重量级锁升级:当自旋锁尝试获取锁的次数达到一定阈值,或者等待时间超过一定限制时,自旋锁会升级为重量级锁。重量级锁会使线程阻塞,将竞争锁的线程放入等待队列,等待锁释放后进行唤醒。

锁降级:锁通常不会主动降级,但重量级锁在释放时可以降级为轻量级锁,但是jep有个锁降级的草案被撤回了,因为降级时安全暂停时间太长了,尝试了工作线程和空闲列表。现在在实验尝试不在安全点操作,

读锁为什么不能升级为写锁?

写锁可以降级为读锁,读锁不能升级为写锁,因为读锁升级为写锁会引起线程的争夺,因为写锁是独占锁

另外,还可能会有死锁问题发生。举个例子:假设两个线程的读锁都想升级写锁,则需要对方都释放自己锁,而双方都不释放,就会产生死锁。

共享锁和独占锁

- 共享锁:一把锁可以被多个线程同时获得

- 独占锁:一把锁只能被一个线程获得

可中断锁和不可中断锁

- 可中断锁:获取锁的过程中可以被中断,不需要一直等到获取锁之后才能进行其他逻辑处理,如ReetrantLock

- 不可中断锁:一旦线程申请了锁,就只能等到拿到锁之后才能进行其他逻辑处理,synchronized属于不可中断锁

公平锁和非公平锁

- 公平锁:锁被释放之后,先申请的线程先得到锁,性能差一些,但保证时间上绝对顺序,上下文切换更频繁

- 非公平锁:锁被释放之后,后申请的线程可能会先获取到锁,性能更好,但可能导致某些线程永远无法获取锁

乐观锁和悲观锁

悲观锁:用于写多读少,避免频繁失败重试影响性能

- 悲观锁总是假设最坏情况,认为每次访问共享资源都会被修改,所以每次访问资源的时候都会加锁。保证共享资源每次只给一个线程使用,其他线程阻塞。

- synchronized和ReentrantLock等独占锁就是悲观锁的实现

- 高并发的场景下,激烈的锁竞争会造成线程阻塞,大量阻塞线程会导致系统的上下文切换,增加系统的性能开销。并且,悲观锁还可能会存在死锁问题,影响代码的正常运行。

乐观锁:用于写少读多,避免频繁加锁影响性能,但乐观锁主要针对的对象是单个共享变量

-

总是假设最好情况,认为每次访问共享资源不会出现问题,无需加锁也无需等待,只是在提交修改的时候去验证对应资源是否被其他线程修改了(版本号或cas)

java.util.concurrent.atomic包下的原子变量类就是使用cas实现乐观锁

LongAdder 在高并发场景下会比 AtomicInteger 和 AtomicLong 的性能更好 代价就是会消耗更多的内存空间(空间换时间) -

高并发下,乐观锁相比于悲观锁,不存在锁竞争导致的线程阻塞,也不会死锁,性能更好,但如果冲突频繁(写多),会频繁失败和重试,这样会影响性能,导致cpu飙升

-

LongAdder以空间换时间的方式解决大量失败重试问题

-

乐观锁一般会使用版本号机制或 CAS 算法实现

- CAS 的全称是 Compare And Swap(比较与交换) ,用于实现乐观锁,被广泛应用于各大框架中。CAS 的思想很简单,就是用一个预期值和要更新的变量值进行比较,两值相等才会进行更新。

- 乐观锁的问题:ABA 问题、循环时间长开销大、只能保证一个共享变量的原子操作。

乐观锁存在哪些问题

- ABA是乐观锁常见问题

一个变量第一次读是A值,在准备赋值的时候还是A值,也不能说明它的值没有被其他线程修改,因为可能被其他线程改完之后又改回去了

解决方法:

在变量前追加版本号或时间戳

JDK 1.5 以后的 AtomicStampedReference 类就是用来解决 ABA 问题的,其中的 compareAndSet() 方法就是首先检查当前引用是否等于预期引用,并且当前标志是否等于预期标志,如果全部相等,则以原子方式将该引用和该标志的值设置为给定的更新值。

- 循环时间长开销大

cas经常自旋重试,不成功就一直循环,如果长时间不成功,会给cpu带来很大的执行开销

- 只能保证一个共享变量的原子操作

cas只对单个共享变量有效,当操作涉及多个共享变量时cas无效,但是从 JDK 1.5 开始,提供了AtomicReference类来保证引用对象之间的原子性,你可以把多个变量放在一个对象里来进行 CAS 操作.所以我们可以使用锁或者利用AtomicReference类把多个共享变量合并成一个共享变量来操作。

JMM、指令重排、并发三特性

JMM(Java 内存模型)主要定义了共享内存中多线程程序读写操作的行为规范,内存分为线程私有工作内存,线程共享主内存,线程之间交互需要主内存

指令重排序

指令重排序就是:系统在执行代码的时候不一定按照编写代码的顺序依次执行

常见指令重排序:

- 编译器优化重排:编译器在不改变单线程程序语义的前提下,重新安排语句的执行顺序。通过禁止特定类型的编译器重排序的方式禁止重排序

- 指令并行重排:现代处理器的指令级并行技术,将多条指令重叠执行。如果不存在数据依赖性,处理器可以改变语句对应机器指令的执行顺序。通过插入**内存屏障(一种cpu指令,禁止重排序,保障有序性,也会使处理器写入、读取值之前,将主内存的值写入高速缓存,清空无效队列,从而保障变量的可见性)**的方式禁止特定类型的处理器重排序。指令并行重排和内存系统重排都是处理器级别的指令重排序

Java 源代码会经历 编译器优化重排 —> 指令并行重排 —> 内存系统重排 的过程,最终才变成操作系统可执行的指令序列。

指令重排序可以保证串行语义一致,但是没有义务保证多线程间的语义也一致

volatile如何禁止指令重排序?

变量使用volatie修饰,在对这个变量进行读写操作的时候,会通过插入特定的内存屏障的方式禁止指令重排序

JMM、happens-before

程序运行在操作系统上,操作系统屏蔽了底层硬件的操作细节,将各种硬件资源虚拟化,所以操作系统也同样需要解决内存缓存不一致的问题

操作系统通过内存模型定义一系列规范解决这个问题,不同操作系统内存模型不同,java语言是跨平台的,所以需要提供一套内存模型屏蔽系统差异,还有一个原因是jmm可以看作是java定义的并发编程相关的一组规范,抽象了线程和主内存的关系,规定了java从源代码到cpu可执行指令的转换过程要遵守的原则和规范,目的是为了简化多线程编程,增强程序可移植性

Java 内存区域和 JMM 有何区别?

完全不一样

- Java内存区域和Java虚拟机的运行时区域相关,定义了JVM在运行时如何分区存储数据,如堆存放对象实例

- Java内存模型(JMM)和Java并发编程有关,抽象了线程和主内存之间的管理,如线程的共享变量必须在主内存,规定Java源代码到CPU可执行指令的转化要遵守的原则和规范,目的是为了简化多线程编程、增强程序可移植性

happens-before 原则

前一个操作的结果对于后一个操作可见,无论这两个操作是否在同一个线程

程序员追求易于理解和编程的强内存模型,遵守规则编码,编译器和处理器追求较少约束的弱内存模型,让他们尽力优化性能

- 为了对编译器和处理器的约束尽可能少,只要不改变结果,编译器和处理器可以进行重排序优化

- 对于会改变程序运行结果的重排序,JMM要求编译器和处理器必须禁止

happens-before 原则的定义

- 如果一个操作happens-before另一个操作,那么第一个操作的结果对第二个操作可见,并且执行顺序排在第二个操作之前

- 两个操作之间存在happens-before 关系,并不意味java平台具体实现必须按照happens-before 指定的顺序执行。如果重排序之后的结果和按happens-before执行的结果一致,那么JMM也允许这样的操作

happens-before 常见规则有哪些?

- 程序顺序规则:一个线程内,按照代码顺序,前面的操作happens-before于后面的操作

- 解锁规则:解锁happens-before于加锁

- volatile变量规则:对一个volatile的写操作happens-before后面对这个变量的读操作。即写操作的结果对于后面的操作可见

- 传递规则:

- 线程启动规则:Thread对象的start()方法happens-before该线程的每一个动作

如果两个操作不满足上面任意一个规则,那么这两个操作可以重排序

happens-before 和 JMM 什么关系?

程序员使用happens-before规则,规则的底层由JMM实现

并发三个特性

原子性

一次操作或多次操作,要么所有操作全部执行不中断,要么都不执行

synchronized和各种Lock可以保证任一时刻只有一个线程访问该代码块,因此可以保障原子性

各种原子类利用cas操作保证原子操作

volatile 可以保证原子性么?

volatile可以保证变量的可见性,不能保证对变量操作是原子性的

自增操作变量++不是原子性,是一个复合操作,先读取变量值,再+1,再将变量值写回内存,即使变量使用volatile修饰,也不能保证原子性

可见性

当一个线程对共享变量进行修改,其他线程可以立即看到被修改的最新值

将变量声明为volatile,表明这个变量共享且不稳定,每次使用都到主存中读取

volatile如何保证变量的可见性?

原始意义是禁用cpu缓存,变量使用volatile修饰,表示变量是共享且不稳定的,每次使用都要去主内存读取

内存模型和happens-before规则(监视器锁规则:对同一个监视器的解锁,happens-before于对该监视器的加锁,获取锁之前要先释放锁)

Lock前缀指令会把当前处理器缓存行的数据写回主内存同时会让其他cpu缓存了该内存地址的数据无效

有序性

因为指令重排序,所以代码的执行顺序不一定是编写代码的顺序

指令重排序可以保证串行语义一致,但没有保证多线程间的语义一致

volatile可以禁止指令重排序

线程池

管理一系列线程的资源池,处理任务直接从线程池获取线程,处理完成之后线程并不会立即被销毁

线程池一般用于执行多个不相关联的耗时任务,没有多线程时,任务顺序执行,用了线程池可以让多个不相关联的任务同时进行

- 降低资源损耗:重复利用已创建的线程降低线程创建和销毁的消耗

- 提高响应速度:任务到达时不用等到线程创建就可以立即执行

- 提高线程可管理性:统一分配、调优和监控

Executor框架

在 Java 5 之后,通过 Executor 来启动线程比使用 Thread 的 start 方法更好,除了更易管理,效率更好(用线程池实现,节约开销)外,还有关键的一点:有助于避免 this 逃逸问题。

this 逃逸是指在构造函数返回之前其他线程就持有该对象的引用,调用尚未构造完全的对象的方法可能引发令人疑惑的错误。

三大部分:

-

任务(

Runnable/Callable)执行任务都必须实现这两个接口之一

-

任务的执行(

Executor)核心接口

Executor,以及继承自Executor接口的ExecutorService接口。ThreadPoolExecutor和ScheduledThreadPoolExecutor这两个关键类实现了ExecutorServiceScheduledThreadPoolExecutor实际上是继承了ThreadPoolExecutor并实现了ScheduledExecutorService,而ScheduledExecutorService又实现了ExecutorService -

异步计算的结果(

Future)Future接口以及Future接口的实现类FutureTask类都可以代表异步计算的结果。当我们把

Runnable接口 或Callable接口 的实现类提交给ThreadPoolExecutor或ScheduledThreadPoolExecutor执行。(调用submit()方法时会返回一个FutureTask对象)- 主线程创建实现Runnable或Callable接口的任务对象

- 把任务对象提交给ExecutorService执行,

ExecutorService.execute(Runnable command))或者ExecutorService.submit(Runnable task) - 如果执行submit,就返回一个实现Future接口的对象

- 主线程执行FutureTask.get()方法等待任务执行成功,也可以取消任务执行

工作原理/流程

execute(任务)流程

- 如果当前运行的线程数小于核心线程数,就会新建一个线程执行任务

- 如果当前运行的线程数大于或等于核心线程数,但是小于最大线程数,就把该任务放入任务队列里

- 如果任务队列满,但是当前运行的线程数小于最大线程数,就新建一个线程执行任务

- 如果当前运行的线程数已经是最大线程数,就会执行拒绝策略

在 execute 方法中,多次调用 addWorker 方法。addWorker 这个方法主要用来创建新的工作线程,如果返回 true 说明创建和启动工作线程成功,否则的话返回的就是 false。ReentrantLock都会加锁(类中的全局锁)

Runnable vs Callable

Callable在1.5被引入,为了处理Runnable不支持的用例

Runnable不会返回结果或抛出异常,Callable可以

Executors 可以实现将 Runnable 对象转换成 Callable 对象。(Executors.callable(Runnable task) 或 Executors.callable(Runnable task, Object result))。

execute() vs submit()

execute()方法用于提交不需要返回值的任务,所以无法判断任务是否被线程池执行成功与否;submit()方法用于提交需要返回值的任务。线程池会返回一个Future类型的对象,通过这个Future对象可以判断任务是否执行成功,并且可以通过Future的get()方法来获取返回值,get()方法会阻塞当前线程直到任务完成,而使用get(long timeout,TimeUnit unit)方法的话,如果在timeout时间内任务还没有执行完,就会抛出 `java.util.concurrent.TimeoutException

shutdown()VSshutdownNow()

shutdown():关闭线程池,线程池的状态变为SHUTDOWN。线程池不再接受新任务了,但是队列里的任务得执行完毕。shutdownNow():关闭线程池,线程池的状态变为STOP。线程池会终止当前正在运行的任务,并停止处理排队的任务并返回正在等待执行的 List。

isTerminated() VS isShutdown()

isShutDown当调用shutdown()方法后返回为 true。isTerminated当调用shutdown()方法后,并且所有提交的任务完成后返回为 true

常见内置线程池

FixedThreadPool

可重用固定线程数(最大线程数和固定线程数相同,就算最大线程数更大,也只会创建固定线程,因为任务队列是无界的(只有到达任务队列最大值才会创建额外线程))的线程池

FixedThreadPool 使用的是容量为 Integer.MAX_VALUE 的 LinkedBlockingQueue(无界队列)

运行流程:

- 如果当前运行线程数小于核心线程数,新任务会创建新线程

- 如果运行线程数等于核心线程数,新任务会加入 LinkedBlockingQueue

- 线程池中的线程执行完任务后,会循环从队列中取任务

SingleThreadExecutor

只有一个线程的线程池

SingleThreadExecutor 的 corePoolSize 和 maximumPoolSize 都被设置为 1,其他参数和 FixedThreadPool 相同,也使用LinkedBlockQueue

执行流程:

- 运行线程数小于核心线程数,创建新线程执行任务

- 有一个运行的线程之后,任务加入LinkedBlockingQueue

- 线程执行完任务之后,会反复从队列中获取任务

CachedThreadPool

根据需要创建新线程

核心线程数为0,最大线程数int最大,意味着如果主线程提交任务的速度高于线程处理任务的速度,CachedThreadPool会不断创建新线程

执行流程:

- 先提交任务到任务队列,如果空闲线程还未销毁,主线程就把任务交给空闲线程,否则执行2

- 初始线程为0或没有空闲线程时,此时会创建新线程来执行任务

ScheduledThreadPool

给定的延迟后运行任务或定期执行任务,基本不用

无界阻塞队列

ScheduledThreadPool 是通过 ScheduledThreadPoolExecutor 创建的,使用的DelayedWorkQueue(延迟阻塞队列)作为线程池的任务队列。

延迟队列按照延迟时间长短对任务进行排序,采用堆,保证每次出队的任务都是当前队列中执行时间最靠前的,添加元素满了之后会自动扩容原来的一般,永远不阻塞,所以最多只会创建核心线程数的线程

ScheduledThreadPoolExecutor 继承了 ThreadPoolExecutor,所以创建 ScheduledThreadExecutor 本质也是创建一个 ThreadPoolExecutor 线程池

为什么不推荐使用内置线程池?

FixedThreadPool和SingleThreadExecutor:使用无界LinkedBlockingQueue,可能堆积大量请求导致OOMCachedThreadPool:同步队列SynchronousQueue,允许创建线程数量无限,可能创建大量线程导致OMMScheduledThreadPool和SingleThreadScheduledExecutor:无界阻塞队列DelayedWorkQueue,可能堆积大量请求导致OOM

线程池常见参数

ThreadPoolExecutor 3 个最重要的参数:

corePoolSize: 任务队列未达到队列容量时,最大可以同时运行的线程数量。maximumPoolSize: 任务队列中存放的任务达到队列容量的时候,当前可以同时运行的线程数量变为最大线程数。workQueue: 新任务来的时候会先判断当前运行的线程数量是否达到核心线程数,如果达到的话,新任务就会被存放在队列中。

ThreadPoolExecutor其他常见参数 :

keepAliveTime:线程池中的线程数量大于corePoolSize的时候,如果这时没有新的任务提交,核心线程外的线程不会立即销毁,而是会等待,直到等待的时间超过了keepAliveTime才会被回收销毁;unit:keepAliveTime参数的时间单位。threadFactory:executor 创建新线程的时候会用到。handler:饱和策略。关于饱和策略下面单独介绍一下。

线程池饱和策略(拒绝策略)

如果当前同时运行的线程数量达到最大线程数量并且队列也已经被放满了任务时

ThreadPoolExecutor.AbortPolicy: 抛出RejectedExecutionException来拒绝新任务的处理。默认ThreadPoolExecutor.CallerRunsPolicy: 调用执行自己的线程运行任务,也就是直接在调用execute方法的线程中运行(run)被拒绝的任务,如果执行程序已关闭,则会丢弃该任务。因此这种策略会降低对于新任务提交速度,影响程序的整体性能。如果您的应用程序可以承受此延迟并且你要求任何一个任务请求都要被执行的话,你可以选择这个策略。ThreadPoolExecutor.DiscardPolicy: 不处理新任务,直接丢弃掉。ThreadPoolExecutor.DiscardOldestPolicy: 此策略将丢弃最早的未处理的任务请求。

AQS

AbstractQueuedSynchronizer抽象队列同步器

AQS 就是一个抽象类,为了构建锁和同步器,提供了一些通用功能的实现

比如我们提到的 ReentrantLock,Semaphore,其他的诸如 ReentrantReadWriteLock,SynchronousQueue等等皆是基于 AQS 的。

AQS核心思想

如果请求的共享资源空闲,就将当前请求资源的线程设置为有效的工作线程,再将共享资源设置为锁定状态。如果被请求的共享资源被占用,那么就需要一套线程阻塞等待以及被唤醒时锁分配的机制,这个机制 AQS 是基于 CLH 锁 (Craig, Landin, and Hagersten locks) 实现的。

CLH锁是对自旋锁的改进,是一个虚拟的双向队列(不存在队列实例,只存在节点之间的关联关系),暂时获取不到锁的线程将被加入该队列,AQS将每条请求共享资源的线程封装成一个CLH队列锁的一个节点(Node),在CLH队列,一个节点代表一个线程,保存线程的引用(thread)、当前节点在队列的状态(waitStatus)、前驱节点(prev)、后继节点(next)

state 表示同步状态,由 volatile 修饰

ReentrantLock 为例,它的内部维护了一个 state 变量,用来表示锁的占用状态。state 的初始值为 0,表示锁处于未锁定状态。当线程 A 调用 lock() 方法时,会尝试通过 tryAcquire() 方法独占该锁,并让 state 的值加 1。如果成功了,那么线程 A 就获取到了锁。失败就会被加入到一个等待队列(CLH队列),直到其他线程释放该锁。如果线程A获取锁成功,释放锁之前,A线程可以重复获取该锁(state累加),可重入体现:一个线程可以多次获取同一个锁而不会阻塞

CountDownLatch将任务分为n个子线程执行,state初始化n,让n个子线程执行任务,每执行完一个子线程,就调用一次countDown(),该方法尝试用CAS让state-1,所有子线程执行完毕后,调用unpart(),唤醒主线程,主线程可以从await()返回,继续执行后续操作

AQS 资源共享方式

两种方式:Exclusive(独占,只有一个线程能执行,如ReentrantLock)和Share(共享,多个线程可以同时执行,如Semaphore/CountDownLatch)

也有支持独占和共享两种方式的ReentrantReadWriteLock

常见同步工具类

Semaphore(信号量)

synchronized 和 ReentrantLock 都是一次只允许一个线程访问某个资源,而Semaphore(信号量)可以用来**控制同时访问特定资源的线程数量。**其他线程都会阻塞,常用于限流

当初始的资源个数为 1 的时候,Semaphore 退化为排他锁。

Semaphore 有两种模式:。

- 公平模式: 调用

acquire()方法的顺序就是获取许可证的顺序,遵循 FIFO; - 非公平模式: 抢占式的。

Semaphore 通常用于那些资源有明确访问数量限制的场景比如限流(仅限于单机模式,实际项目中推荐使用 Redis +Lua 来做限流)。

原理:

Semaphore 是共享锁的一种实现,只有拿到许可证的线程才能执行,它默认构造 AQS 的 state 值为 permits(许可证的数量)

acquire时线程尝试获取锁,如果state>0就可以获取成功(尝试使用CAS修改-1,CAS失败了会循环重新获取最新的值尝试获取,如果获取失败就会创建一个Node节点加入阻塞队列,挂起当前线程,自旋判断state是否大于0),释放许可证成功之后,会唤醒同步队列中的一个线程,被唤醒的线程会尝试获取锁,失败就重新进入阻塞队列,挂起线程

Sync 是 CountDownLatch 的内部类 , 继承了 AbstractQueuedSynchronizer ,重写了其中的某些方法。并且,Sync 对应的还有两个子类 NonfairSync(对应非公平模式) 和 FairSync(对应公平模式)。

CountDownLatch(倒计时器)

允许 count 个线程阻塞在一个地方,直至所有线程的任务都执行完毕。

CountDownLatch 是一次性的,计数器只能初始化一次

CountDownLatch 是共享锁的一种实现,它默认构造 AQS 的 state 值为 count

线程调用countDown()时,其实是调用CAS操作减少state,state为0时,表示所有线程都调用了countDown方法,那么在CountDownLatch上等待的线程就会被唤醒并继续执行

调用await()等待(加锁)时,如果state不为0,证明任务还没有执行完毕,await()就会一直阻塞,即await()之后的语句不会被执行(main线程被加入等待队列也就是在CLH队列中),然后CountDownLatch会自旋CAS判断state==0,如果为0就会释放所有等待的线程,执行await()之后的语句

典型用法:

- 启动一个服务时,主线程需要等待多个组件加载完毕,之后继续执行,将计数器设为n,等到0的时候,在CountDownLatch上await()的线程就会被唤醒

- 实现多个线程执行任务的最大并行性,强调多个线程在同一时刻同时开始执行。类似将多个线程放到起点,同时开跑,做法是初始化一个共享的CountDownLatch对象时将计数器初始化1,多个线程开始执行任务前首先await(),当主线程调用countDown()时,计数器变为0,此时多个线程同时被唤醒

CyclicBarrier(循环栅栏)

和 CountDownLatch 非常类似

CountDownLatch 的实现是基于 AQS 的,而 CycliBarrier 是基于 ReentrantLock(ReentrantLock 也属于 AQS 同步器)和 Condition 的。

可循环使用的屏障:让一组线程到达一个屏障(同步点)时被阻塞,直到最后一个线程到达屏障时才开门,所有被拦截的线程才会继续干活,每个线程调用 await() 方法告诉 CyclicBarrier 我已经到达了屏障,然后当前线程被阻塞。

原理:

内部通过一个 count 变量作为计数器,count 的初始值为 parties 属性的初始化值,每一个线程到栅栏后就-1计数器,为0表示最后一个线程到达,就尝试执行任务

Atomic原子类

Atomic是指一个操作不可中断,多个线程在一起执行时,一个操作一旦开始,就不会被其他线程干扰

基本类型

使用原子的方式更新基本类型,优势:多线程环境使用原子类保证线程安全,比如对原子类型变量自增不用加锁。原理:主要利用CAS + volatile和native方法保证原子操作,避免synchronized的高开销,CAS原理是拿期望的值和原本的值作比较,如果相同就更新

ThreadLocal

数据结构

Thread类有一个类型为ThreadLocal.ThreadLocalMap的实例变量threadLocals

每个线程都有自己的 threadLocals,是ThreadLocal.ThreadLocalMap类型的Map,这个map里有一个内部类Entry, 它的key是ThreadLocal<?> k ,继承自WeakReference(key是ThreadLocal的弱引用)

ThreadLocal只是一个key,存储ThreadLocal是为了使用多个ThreadLocal时能找到自己想使用的ThreadLocal

如果entry是强引用,key是ThreadLocal是一个static的,ThreadLocal就一直不被gc则entry也不能gc,value也不能gc,就造成内存泄漏

Hash 冲突、过期清理

在set过程中,如果遇到了key过期的Entry数据,实际上是会进行一轮探测式清理操作的

ThreadLocalMap的两种过期key数据清理方式:探测式清理(每次操作都会先检查当前线程的ThreadLocalMap中是否有已经过期的key,如果有,就清理掉这些key对应的value,并且把这些key从ThreadLocalMap中移除。)和启发式清理(在ThreadLocalMap中维护一个全局的清理阈值,当已经使用的entry数量超过了这个阈值时,就会进行一次清理操作。清理操作会遍历整个ThreadLocalMap,清理掉已经过期的key对应的value,并且把这些key从ThreadLocalMap中移除)。

启发式清理是在ThreadLocalMap的set, get, remove等操作之外进行的,探测式清理是在操作之内

启发式清理相对于探测式清理来说,可以更快地清理掉已经过期的key,但是会占用一定的系统资源。

set()

- 哈希计算后的槽位对应的Entry为空时,直接设置数据

- 槽位不为空,key值和当前ThreadLocal的哈希值相同,更新

- 槽位不为空,key值不同,继续向后遍历,遍历到Entry为null之前没有过期Entry(key为null),将数据放入Entry为null

- 遍历到Entry为null之前遇到key过期的Entry,就会执行replaceStateEntry()方法替换过期数据,从过期位置开始向前(下标变小)进行探测式清理,找到过期数据就更新起始清理位置(用来判断当前过期槽位

staleSlot之前是否还有过期元素。),直到Entry为null结束,接着会以开始过期位置向后迭代,如果找到了key值相同的Entry数据,就更新Entry的值并交换初始过期位置元素,最后进行过期Entry清理工作,如果在向后迭代的过程中没有找到相同key的Entry(直到Entry为null都没找到)就创建新的Entry,替换初始过期位置,替换完成也是进行过期元素的清理工作

如果在清理工作完成后,没清理任何数据,且size超过阈值(数组长度2/3),就进行rehash(),rehash()会先进行一轮探测式清理,清理过期key,清理完成后如果size >= threshold - threshold / 4,就执行真正的扩容

扩容机制

在set()方法最后,如果没清理任何数据,且当前size超过len的2/3,就执行rehash():

先进行探测式清理,清理完成之后,table中可能有一些key为null的Entry数据被清理掉,所以此时通过判断size >= threshold - threshold / 4 也就是size >= threshold * 3/4 来决定是否扩容。

扩容大小是之前的2倍,然后重新计算哈希

get()详解

如果槽位有值但key值不同,就继续向后迭代查找,发现key为null时会触发一次探测式数据回收操作

内存泄露

ThreadLocalMap 中使用的 key 为 ThreadLocal 的弱引用,而 value 是强引用。所以,如果 ThreadLocal 没有被外部强引用的情况下,在垃圾回收的时候,key 会被清理掉,而 value 不会被清理掉。

ThreadLocalMap 中就会出现 key 为 null 的 Entry,value 永远无法被 GC 回收,这个时候就可能会产生内存泄露,ThreadLocalMap在调用 set()、get()、remove() 方法的时候,会清理掉 key 为 null 的记录。使用完 ThreadLocal方法后最好手动调用remove()方法

CompletableFuture

CompletableFuture 同时实现了 Future 和 CompletionStage 接口

boolean cancel(boolean mayInterruptIfRunning):尝试取消执行任务。boolean isCancelled():判断任务是否被取消。boolean isDone():判断任务是否已经被执行完成。get():等待任务执行完成并获取运算结果。get(long timeout, TimeUnit unit):多了一个超时时间。

如果你不需要从回调函数中获取返回结果,可以使用 thenAccept() 或者 thenRun()。这两个方法的区别在于 thenRun() 不能访问异步计算的结果。

你可以通过 handle() 方法来处理任务执行过程中可能出现的抛出异常的情况。

那 thenCompose() 和 thenCombine() 有什么区别呢?

thenCompose()可以链接两个CompletableFuture对象,并将前一个任务的返回结果作为下一个任务的参数,它们之间存在着先后顺序。thenCombine()会在两个任务都执行完成后,把两个任务的结果合并。两个任务是并行执行的,它们之间并没有先后依赖顺序。

通过 CompletableFuture 的 allOf()这个静态方法来并行运行多个 CompletableFuture 。

allOf() 方法会等到所有的 CompletableFuture 都运行完成之后再返回

CompletableFuture 类有什么用?

Future 在实际使用过程中存在一些局限性比如不支持异步任务的编排组合、获取计算结果的 get() 方法为阻塞调用。

Java 8 才被引入CompletableFuture 类可以解决Future 的这些缺陷。CompletableFuture 除了提供了更为好用和强大的 Future 特性之外,还提供了函数式编程、异步任务编排组合(可以将多个异步任务串联起来,组成一个完整的链式调用)等能力。

CompletableFuture 同时实现了 Future 和 CompletionStage 接口

并发和并行

并发:两个及两个以上线程在同一时间段执行

并行:两个及两个以上线程在同一时刻执行

关键在于是否同时执行

同步、异步、阻塞、非阻塞

IO两个阶段:数据准备、内核空间数据复制到用户空间

-

同步:用户线程发起io操作后需要等待或者轮询内核io完成后才能继续执行

-

阻塞、非阻塞、io多路复用、信号驱动io都是同步,因为阶段2阻塞

-

阻塞可以是实现同步的一种手段!例如两个东西需要同步,一旦出现不同步情况,我就阻塞快的一方,使双方达到同步。

同步是两个对象之间的关系,而阻塞是一个对象的状态。

-

-

异步:用户线程发起io操作后用户线程仍需要继续执行,内核io操作完成后通知用户线程,或者调用用户线程注册的回调函数

-

阻塞:io操作需要彻底完成才返回用户空间

-

非阻塞:io操作被调用后立即返回一个状态值,无需等待io操作彻底完成

阻塞和非阻塞(线程内调用)

- 阻塞和非阻塞区别:阶段1的io请求是否被阻塞,不阻塞就是非阻塞

- 一个线程在某个时刻要么阻塞要么非阻塞

- 关注程序在等待调用结果(返回值)时的状态

- 阻塞调用是调用结果返回之前,当前线程被挂起,调用线程只有在得到结果之后才会返回

- 非阻塞调用是在不能立刻得到结果之前,该调用不会阻塞当前线程

同步和异步(线程间调用)

- 同步和异步区别在于第二步是否阻塞,如果是不阻塞,操作系统返回结果,就是异步io

- 两个线程间要么同步要么异步

- 同步时,调用者需要等待被调用者返回结果才进行下一步

- 异步时,调用者不需要等待被调用者返回结果,直接进行下一步,被调用者通过回调通知调用者结果

- 同步是调用返回就知道结果,异步是返回不一定知道结果,通过回调函数等获取结果

- 发送方和接收方是否步调一致

四种组合

- 同步阻塞:发送方发送请求一直等待响应,接收方等待准备好结果后才响应发送方,期间不能进行其他工作

- 同步非阻塞:接收方处理时如果不能马上响应,就立刻返回,做其他事情,但不响应,操作完成后再响应

- 异步阻塞:发送方发送请求后不等待响应,继续处理自己的。接收方等待准备好结果后才响应,期间不能进行其他工作(不使用)

- 异步非阻塞:接收方处理时如果不能马上响应,就立即返回,做其他事情,但不响应,操作完成后再响应

线程间协作方式

- join():b线程调用a线程的join方法后,b线程会等待a线程结束再继续执行

- wait():使线程在等待,等待时会被挂起,其他线程调用notify或notifyAll唤醒挂起线程,线程会释放锁,因为,如果没有释放锁,那么其它线程就无法进入对象的同步方法或者同步控制块中,那么就无法执行 notify() 或者 notifyAll() 来唤醒挂起的线程,造成死锁。notify是通知在该对象上的其他线程,告诉他们可以尝试重新竞争锁并继续执行了

- await() signal() signalAll():可以在 Condition 上调用 await() 方法使线程等待,其它线程调用 signal() 或 signalAll() 方法唤醒等待的线程。相比于 wait() 这种等待方式,await() 可以指定等待的条件,因此更加灵活。

线程生命周期和状态

Java 线程在运行的生命周期中的指定时刻只可能处于下面 6 种不同状态的其中一个状态:

- NEW: 初始状态,线程被创建出来但没有被调用

start()。 - RUNNABLE: 运行状态,线程被调用了

start()等待运行的状态。 - BLOCKED:阻塞状态,需要等待锁释放。

- WAITING:等待状态,表示该线程需要等待其他线程做出一些特定动作(通知或中断)。

- TIME_WAITING:超时等待状态,可以在指定的时间后自行返回而不是像 WAITING 那样一直等待。

- TERMINATED:终止状态,表示该线程已经运行完毕。

线程在生命周期中并不是固定处于某一个状态而是随着代码的执行在不同状态之间切换。

在操作系统层面,线程有 READY 和 RUNNING 状态;而在 JVM 层面,只能看到 RUNNABLE 状态

JVM没有区分这两种状态是因为线程切换太快了,没必要区分,时间分片

- 当线程执行

wait()方法之后,线程进入 WAITING(等待) 状态。进入等待状态的线程需要依靠其他线程的通知才能够返回到运行状态。

- 当线程进入

synchronized方法/块或者调用wait后(被notify)重新进入synchronized方法/块,但是锁被其它线程占有,这个时候线程就会进入 BLOCKED(阻塞) 状态。

线程上下文切换

任务从保存到再加载的过程就是一次上下文切换

线程在执行过程中会有自己的运行条件和状态(上下文),线程切换意味保存当前线程上下文,等到线程下次占用CPU的时候恢复线程,并加载下一个将要占用CPU的线程上下文

因为需要保存信息和恢复信息,就会占用CPU,内存等资源,所以频繁切换会降低效率

当出现如下情况的时候,线程会从占用 CPU 状态中退出。

- 主动让出 CPU,比如调用了

sleep(),wait()等。 - 时间片用完,因为操作系统要防止一个线程或者进程长时间占用 CPU 导致其他线程或者进程饿死。

- 调用了阻塞类型的系统中断,比如请求 IO,线程被阻塞。

- 被终止或结束运行

这其中前三种都会发生线程切换

什么是线程死锁?如何避免死锁?

线程死锁是:多个线程同时被阻塞,一个或多个等待某个资源的释放,导致线程无限期阻塞,比如互相持有锁

产生死锁的四个必要条件:

- 互斥条件:该资源任意一个时刻只由一个线程占用。

- 请求与保持条件:一个线程因请求资源而阻塞时,对已获得的资源保持不放。

- 不剥夺条件:线程已获得的资源在未使用完之前不能被其他线程强行剥夺,只有自己使用完毕后才释放资源。

- 循环等待条件:若干线程之间形成一种头尾相接的循环等待资源关系。

预防死锁

- 破坏请求与保持条件:一次性申请所有的资源。

- 破坏不剥夺条件:占用部分资源的线程进一步申请其他资源时,如果申请不到,可以主动释放它占有的资源。

- 破坏循环等待条件:靠按序申请资源来预防。按某一顺序申请资源,释放资源则反序释放。破坏循环等待条件。

避免死锁

避免死锁就是在资源分配时,借助于算法(比如银行家算法)对资源分配进行计算评估,使其进入安全状态(线程按顺序分配资源。

sleep() 方法和 wait() 方法

共同点:两者都可以暂停线程的执行

区别:

- sleep()没有释放锁,wait()释放锁

- wait()通常用于线程间通信,sleep()通常用于暂停执行

- wait()被调用后,线程不会自动苏醒,需要别的线程调用同一个对象上的notify()或notifyAll()方法。sleep()方法执行完成后,线程会自动苏醒

- sleep()是Thread的静态本地方法,wait()是Object的本地方法

wait()是让获得对象锁的线程实现等待,会自动释放当前线程占有的对象锁,每个对象都有对象锁,所以为了操作对象而不是线程,就使用Object类

因为sleep()方法是让当前线程暂停执行,不涉及对象类,也不需要获得对象锁

Sychronized

概述

主要解决多个线程之间访问资源的同步性,可以保证被它修饰的方法或代码块在任何时刻只能有一个线程执行

java早期,synchronized是重量级锁,效率低。这是因为监视器锁(monitor)是依赖于底层的操作系统的 Mutex Lock 来实现的(有三个属性,获得锁的线程owner、阻塞的线程entrylist、wait的线程waitset),Java 的线程是映射到操作系统的原生线程之上的。如果要挂起或者唤醒一个线程,都需要操作系统帮忙完成,而操作系统实现线程之间的切换时需要从用户态转换到内核态,这个状态之间的转换需要相对比较长的时间,时间成本相对较高。

java6之后,synchronized 引入了大量的优化如自旋锁、适应性自旋锁、锁消除、锁粗化、偏向锁、轻量级锁等技术来减少锁操作的开销,这些优化让 synchronized 锁的效率提升了很多。因此, synchronized 还是可以在实际项目中使用的,像 JDK 源码、很多开源框架都大量使用了 synchronized 。

构造方法可以用synchronized修饰吗?

不能

构造方法本身属于线程安全,不存在同步的构造方法这一说

synchronized底层原理

- 修饰代码块时

synchronized 同步语句块的实现使用的是 monitorenter 和 monitorexit 指令,其中 monitorenter 指令指向同步代码块的开始位置,monitorexit 指令则指明同步代码块的结束位置。

包含一个 monitorenter 指令以及两个 monitorexit 指令,这是为了保证锁在同步代码块代码正常执行以及出现异常的这两种情况下都能被正确释放。

当执行 monitorenter 指令时,线程试图获取锁也就是获取 对象监视器 monitor 的持有权。

在Hotspot中,monitor基于c++实现,每个对象都内置了一个ObjectMonitor对象,wait/notify等方法也依赖monitor对象,所以只有在同步块或同步方法中才能调用wait/notify等方法,否则会抛出java.lang.IllegalMonitorStateException的异常

在执行monitorenter时,会尝试获取对象的锁,如果锁的计数器为 0 则表示锁可以被获取,获取后将锁计数器设为 1 也就是加 1。如果获取对象锁失败,那当前线程就要阻塞等待,直到锁被另外一个线程释放为止。

对象锁的的拥有者线程才可以执行 monitorexit 指令来释放锁。在执行 monitorexit 指令后,将锁计数器设为 0,表明锁被释放,其他线程可以尝试获取锁。

- 修饰方法时

没有 monitorenter 指令和 monitorexit 指令,取得代之的确实是 ACC_SYNCHRONIZED 标识,该标识指明了该方法是一个同步方法,如果是实例方法,JVM 会尝试获取实例对象的锁。如果是静态方法,JVM 会尝试获取当前 class 的锁。

本质都是获取对象monitor

ReentrantLock

ReentrantLock实现了Lock接口,是一个可重入的独占锁,比synchronized更灵活强大

ReentrantLock有一个内部类Sync,继承AQS(AbstractQueueSynchronizer),加锁和释放锁的大部分操作在Sync中实现,Sync 有公平锁 FairSync 和非公平锁 NonfairSync 两个子类。默认使用非公平锁

ReentrantLock 的底层就是由 AQS 来实现的

synchronized 和 ReentrantLock 有什么区别?

二者都是可重入锁(递归锁:线程可以再次获取自己的锁),Lock实现类和synchronized都是可重入的

synchronized依赖于jvm而ReentrantLock依赖于api

- synchronized依赖于jvm实现

- ReetrantLock是jdk层面实现的,比synchronized增加了一些高级功能

- 等待可中断:可以中断等待锁的线程,

lock.lockInterruptibly()来实现这个机制。也就是说正在等待的线程可以选择放弃等待,改为处理其他事情。 - 可实现公平锁:可以指定公平还是非公平,synchronized只是非公平

- 可实现选择性通知(锁绑定多个条件):

synchronized关键字与wait()和notify()/notifyAll()方法相结合可以实现等待/通知机制。ReentrantLock类当然也可以实现,但是需要借助于Condition接口与newCondition()方法。Condition可以实现多路通知功能,就是在一个Lock对象中可以创建多个Condition实例(对象监视器),线程对象可以注册在指定的Condition中,从而可以有选择性的进行通知,在调度线程更灵活。如果使用notify()/notifyAll()方法进行通知,被通知的线程是jvm选择的,用ReentrantLock类结合Condition实例可以实现选择性通知,synchronized相当于整个Lock对象中只有一个Condition实例,如果执行notifyAll()就会通知所有等待的线程,Condition的signalAll()方法,只会唤醒注册在该Condition实例的所有等待线程

- 等待可中断:可以中断等待锁的线程,

ReentrantReadWriteLock

ReentrantReadWriteLock 实现了 ReadWriteLock ,是一个可重入的读写锁,既可以保证多个线程同时读的效率,同时又可以保证有写入操作时的线程安全。

一般锁是读读互斥,读写互斥,写写互斥,读写锁是读读不互斥

ReentrantReadWriteLock 其实是两把锁,一把是 WriteLock (写锁),一把是 ReadLock(读锁)

读是共享锁,写是独占锁,读锁可以同时被多个线程持有,写锁最多只能同时被一个线程持有

和 ReentrantLock 一样,ReentrantReadWriteLock 底层也是基于 AQS 实现的。也支持公平锁和非公平锁(默认)

ReentrantReadWriteLock 适合什么场景?

ReentrantReadWriteLock既可以保证多个线程同时读的效率,又可以保证写入操作的线程安全,适合读多写少的场景

StampedLock

StampedLock 是 JDK 1.8 引入的性能更好的读写锁,不可重入且不支持条件变量 Conditon。

不同于一般的 Lock 类,StampedLock 并不是直接实现 Lock或 ReadWriteLock接口,而是基于 CLH 锁 独立实现的(AQS 也是基于这玩意)。

StampedLock 提供了三种模式的读写控制模式:读锁、写锁和乐观读。

- 写锁:独占锁,一把锁只能被一个线程获得。当一个线程获取写锁后,其他请求读锁和写锁的线程必须等待。类似于

ReentrantReadWriteLock的写锁,不过这里的写锁是不可重入的。 - 读锁 (悲观读):共享锁,没有线程获取写锁的情况下,多个线程可以同时持有读锁。如果己经有线程持有写锁,则其他线程请求获取该读锁会被阻塞。类似于

ReentrantReadWriteLock的读锁,不过这里的读锁是不可重入的。 - 乐观读:允许多个线程获取乐观读以及读锁。同时允许一个写线程获取写锁。

StampedLock 在获取锁的时候会返回一个 long 型的数据戳,该数据戳用于稍后的锁释放参数,如果返回的数据戳为 0 则表示锁获取失败。当前线程持有了锁再次获取锁还是会返回一个新的数据戳,这也是StampedLock不可重入的原因。

StampedLock 的性能为什么更好?

相比于传统读写锁多出来的乐观读是StampedLock比 ReadWriteLock 性能更好的关键原因。StampedLock 的乐观读允许一个写线程获取写锁,所以不会导致所有写线程阻塞,也就是当读多写少的时候,写线程有机会获取写锁,减少了线程饥饿的问题,吞吐量大大提高。

StampedLock 适合什么场景?

和 ReentrantReadWriteLock 一样,StampedLock 同样适合读多写少的业务场景,可以作为 ReentrantReadWriteLock的替代品,性能更好。

不过,需要注意的是StampedLock不可重入,不支持条件变量 Conditon,对中断操作支持也不友好(使用不当容易导致 CPU 飙升)。如果你需要用到 ReentrantLock 的一些高级性能,就不太建议使用 StampedLock 了。

StampedLock 的底层原理

StampedLock 不是直接实现 Lock或 ReadWriteLock接口,而是基于 CLH 锁 实现的(AQS 也是基于这玩意),CLH 锁是对自旋锁的一种改良,是一种隐式的链表队列。StampedLock 通过 CLH 队列进行线程的管理,通过同步状态值 state 来表示锁的状态和类型。

Future

Future有什么用?

异步思想

当执行某一耗时任务时,可以将这个耗时任务交给一个子线程异步执行,再通过Future获取耗时任务的执行结果

Callable 和 Future 有什么关系?

FutureTask 提供了 Future 接口的基本实现,常用来封装 Callable 和 Runnable,具有取消任务、查看任务是否执行完成以及获取任务执行结果的方法。ExecutorService.submit() 方法返回的其实就是 Future 的实现类 FutureTask 。

FutureTask相当于对Callable 进行了封装

集合

Set:

- TreeSet:红黑树,查找效率 o(logN)

- HashSet:哈希表

- LinkedHashSet:链表,哈希表,继承HashSet,内部用双向链表维护元素插入顺序

List:

- ArrayList:数组

- Vector:数组,线程安全

- LinkedList:链表,双向链表(1.6之前是循环链表)

Queue:

- LinkedList:链表,双向链表

- PriorityQueue:堆,可实现优先队列

Map:

- TreeMap:红黑树(自平衡排序二叉树)

- HashMap:哈希表

- Hashtable:哈希表,线程安全

- LinkedHashMap:链表,双向链表

ArrayList

底层数组,容量动态增长,在添加大量元素之前,主动使用 ensureCapacity 增加容量

可以添加 NULL

默认大小10,构造器也可以指定集合的列表

ensureCapacity(int minCapacity 所需的最小容量),如果最小容量大于已有的最大容量,就调用ensureExplicitCapacity(minCapacity),判断是否需要扩容,调用grow(minCapacity)进行扩容,新容量为旧容量的1.5倍,此时如果新容量还是小于需要的最小容量,就将新容量设置为需要的最小容量, 再检查新容量是否超过最大容量,最后 elementData = Arrays.copyOf(elementData, newCapacity);

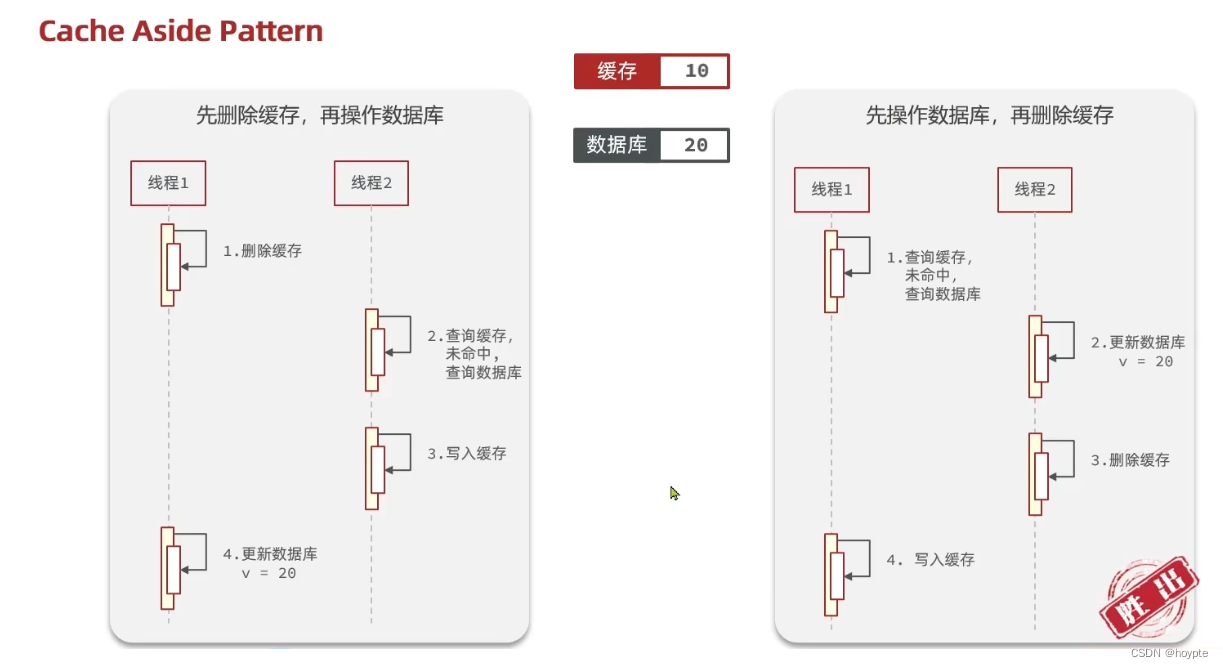

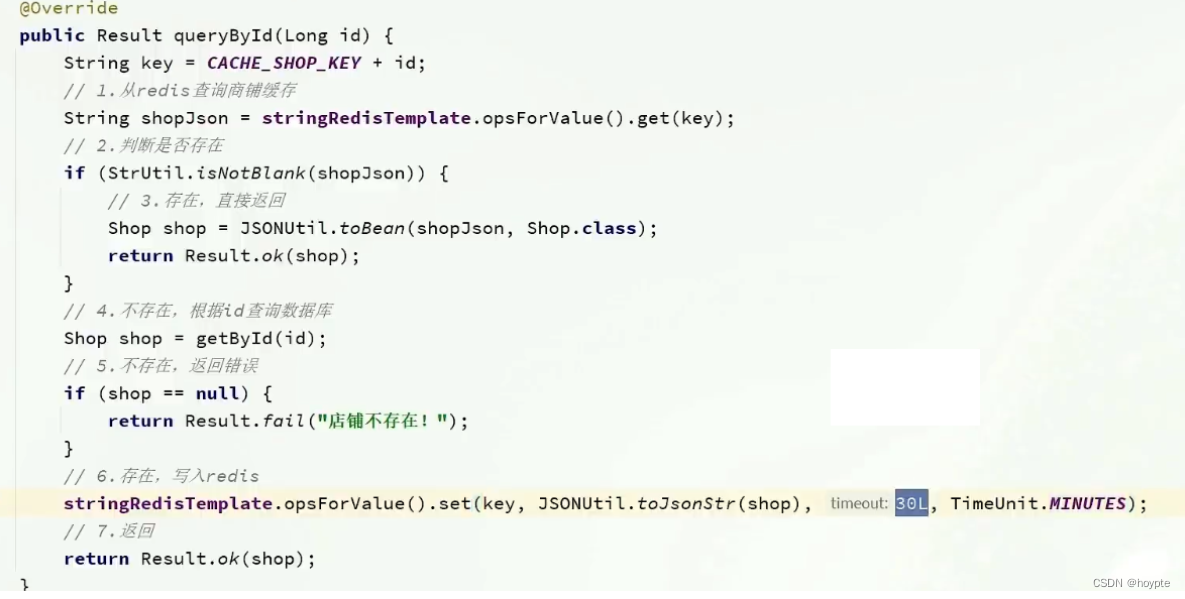

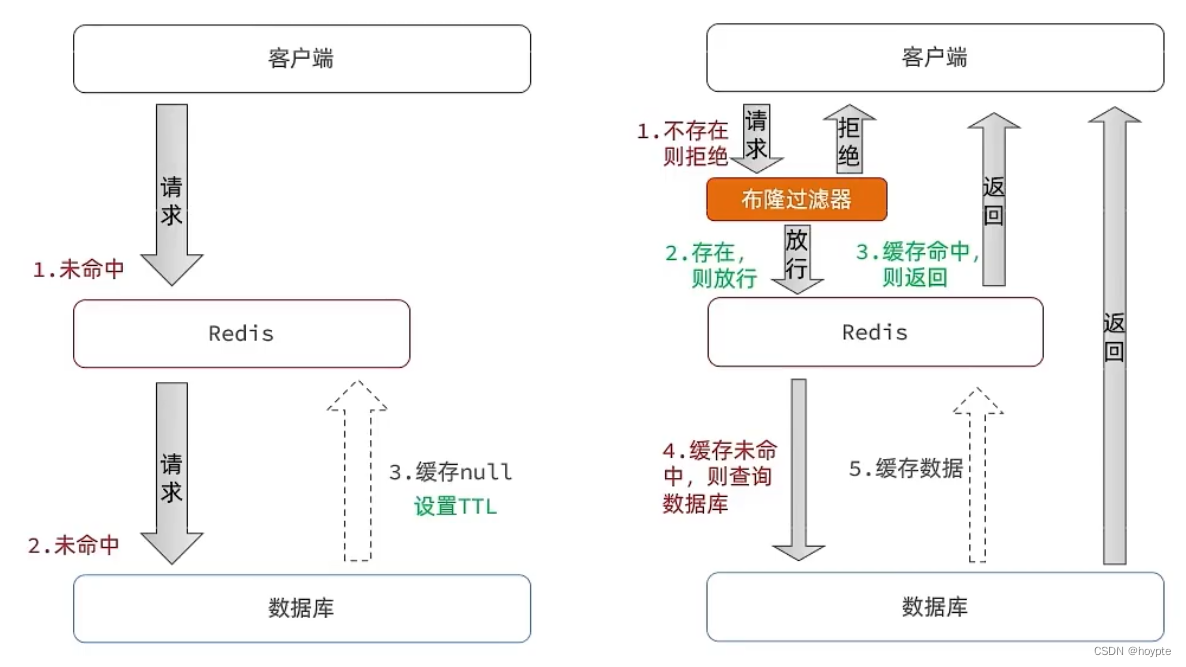

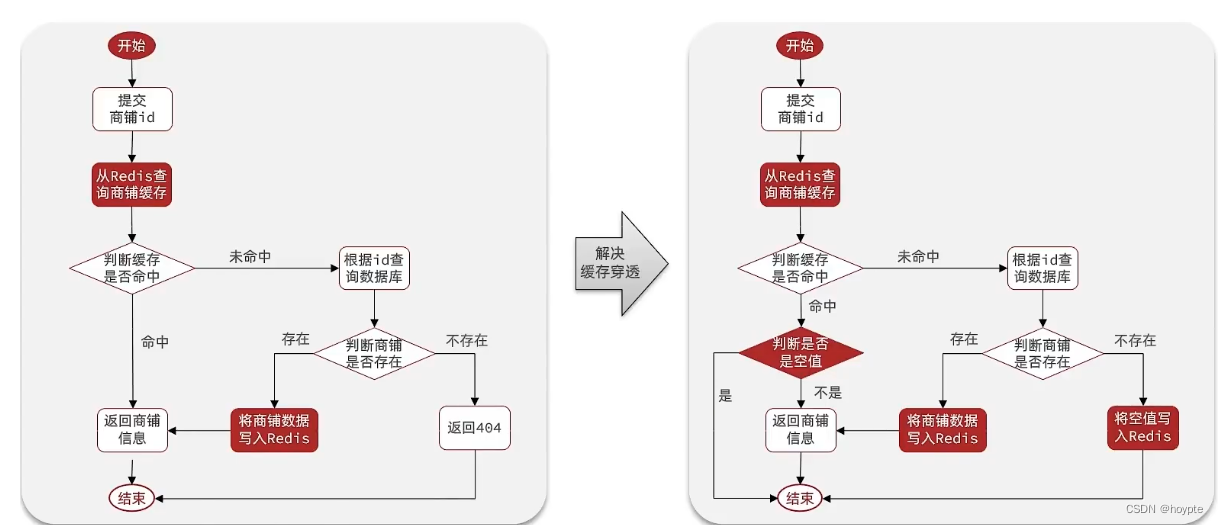

扩容机制