像OpenAI的GPT-4这样的大型语言模型(LLMs)已经风靡全球。它们可以自动执行各种任务,如回答问题、翻译语言、分析文本等。LLMs是第一种真正感觉像“人工智能”的机器学习类型。

然而,在将LLMs应用于实际产品时仍然存在挑战。特别是其中一个最棘手和繁琐的挑战是LLM的管理。如果我们想要构建由LLMs驱动的应用程序,我们需要管理以下几个方面:

不同类型的LLM —— OpenAI、Anthropic、开源等

模型版本 —— 随着我们更新到最新版本

提示版本 —— 随着不断调整和改进提示

模型链接 —— 可能需要结合或链接多个LLM的输入和输出以获得最终结果

要独自完成所有这些工作将需要大量工作,这就是LangChain发挥作用的地方!

介绍LangChain

LangChain使构建由LLMs驱动的应用程序变得简单。它提供了极大简化上述所有挑战的工具。使用LangChain,我们可以在统一的界面中轻松与不同类型的LLMs进行交互,管理模型版本,管理提示版本,并将LLMs连接在一起。所有这些功能都打包在易于使用的API中,因此我们可以快速在应用程序中利用LLMs。

安装

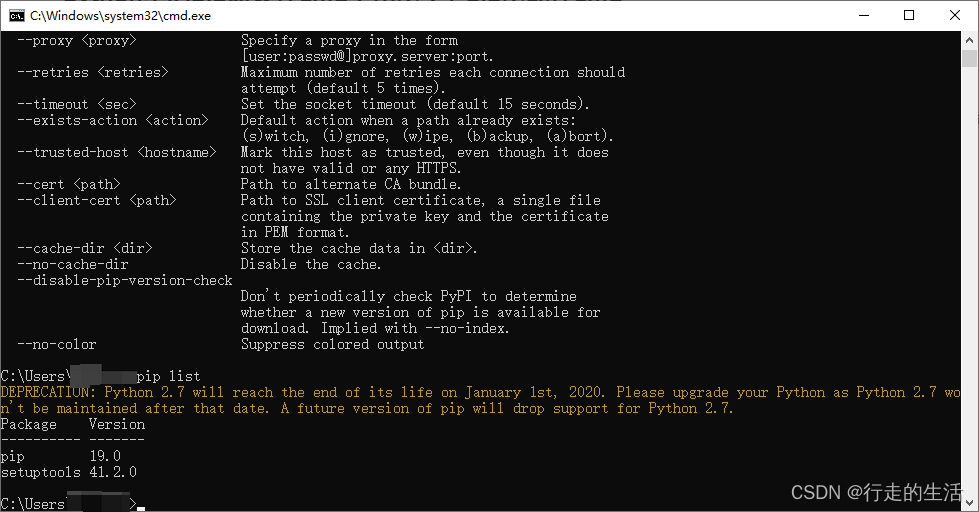

开始使用LangChain很容易。我们可以使用pip进行安装,如下所示:

pip install langchain或者使用conda:

conda install langchain -c conda-forge最后,如果想要所有最新的功能,可以直接从其GitHub存储库构建该库。

设置

为了充分利用LangChain,将希望将其与不同的组件,如模型提供商和API,集成在一起。可以为希望连接到的每个提供商设置环境变量。例如,对于OpenAI,可以设置OpenAI API密钥:

export OPENAI_API_KEY="..."或者,可以在使用LangChain的Python应用程序中启动后,在代码中设置变量:

from langchain.llms import OpenAI

llm = OpenAI(openai_api_key="...")LangChain的关键部分

LangChain之所以伟大,是因为它灵活且模块化。它将语言处理分解为单独的部分,让开发者创建自定义工作流程。以下是它的关键部分:

组件和链:执行语言处理特定任务的模块。链将这些组件连接起来,形成自定义工作流程

提示模板:可重复使用的提示,可以更改其中的特定值。例如,一个询问用户姓名的提示可以被个性化

向量存储:通过文档的数字意义来保存和搜索信息

索引和检索器:存储和查找有关模型训练数据的详细信息,以获得更好的响应

输出解析器:管理和精炼模型的响应,使其更有结构

示例选择器:从模型的训练数据中选择正确的例子,提高响应准确性

代理:具有特定任务的唯一实例,如聊天机器人或移动应用程序

在LangChain中构建一个由LLM驱动的应用程序

LangChain的LLM类连接到不同的语言模型提供商,如OpenAI和Hugging Face。我们可以轻松使用LangChain构建一个带有提示的应用程序,并得到输出。例如:

import os

from langchain.llms import OpenAI

llm = OpenAI(model_name="gpt-3.5-turbo",

openai_api_key=os.environ["OPENAI_API_KEY"])

print(llm("Tell me a joke about pizza!"))这可能会得到类似这样的输出:

Why did the pizza maker go to art school?

Because they wanted to get a "pizza" the creative action!

Hahahaha….. so funny Mr. gpt-3.5-turbo….如果我们想要切换模型,只需在代码中更改一些细节即可。

在LangChain中管理LLMs的提示

LLMs需要正确的提示才能得到正确的输出。LangChain中的PromptTemplate通过使用模板生成提示,帮助生成提示。可以在保持主结构的同时轻松更改值。例如:

from langchain.llms import OpenAI

from langchain import PromptTemplate

import os

USER_INPUT = "chocolate cake"

llm = OpenAI(model_name="gpt-3.5-turbo",

openai_api_key=os.environ["OPENAI_API_KEY"])

template = """I'm interested in making {dish}. Can you provide me with a simple recipe for it, including the main ingredients and basic instructions?"""

prompt = PromptTemplate(input_variables=["dish"], template=template)

final_prompt = prompt.format(dish=USER_INPUT)

print(f"LLM Output: {llm(final_prompt)}")这使得管理所有提示并处理动态输入变得非常容易。

在多步骤工作流中结合LLMs和提示

在LangChain中进行链接意味着将LLMs与其他元素组合用于应用程序。我们可以:

使用一个LLM的输出作为另一个LLM的输入。

将LLMs与模板结合使用。

将LLMs与外部数据或聊天历史结合使用。

例如:

from langchain.llms import OpenAI

from langchain.chains import LLMChain, SimpleSequentialChain

from langchain import PromptTemplate

import os

llm = OpenAI(model_name="gpt-3.5-turbo",

openai_api_key=os.environ["OPENAI_API_KEY"])

# 链中的第一步

template = "Can you provide a brief summary of the movie {movie_title}? Please keep it concise."

first_prompt = PromptTemplate(input_variables=["movie_title"],

template=template)

chain_one = LLMChain(llm=llm, prompt=first_prompt)

# 链中的第二步

second_prompt = PromptTemplate(input_variables=["actor"],

template="Can you list three movies featuring {actor}?")

chain_two = LLMChain(llm=

llm, prompt=second_prompt)

# 结合第一和第二链

overall_chain = SimpleSequentialChain(chains=[chain_one, chain_two], verbose=True)

final_answer = overall_chain.run("Inception")此示例构建了一个两步链,用于查找有关城市的旅游信息。

深入学习

LangChain是一个Python框架,让我们可以使用LLMs构建应用程序。它与各种模型连接,使与LLM和提示管理有关的一切变得简单。要了解更多信息,请查看精彩的LangChain文档,其中包含有关各种功能和示例的信息。

· END ·

HAPPY LIFE

本文仅供学习交流使用,如有侵权请联系作者删除

![maven打包失败 Cannot create resource output directory[已解决]](https://img-blog.csdnimg.cn/direct/1f1472eda744492d8a1fdec93874718c.png)