目录

往期精彩内容:

前言

1 数据集和特征提取

1.1 数据集导入

1.2 扰动信号特征提取

2超强模型XGBoost——原理介绍

2.1 原理介绍

2.2 特征数据集制作

3 模型评估和对比

3.1 随机森林分类模型

3.2 支持向量机SVM分类模型

3.3 XGBoost分类模型

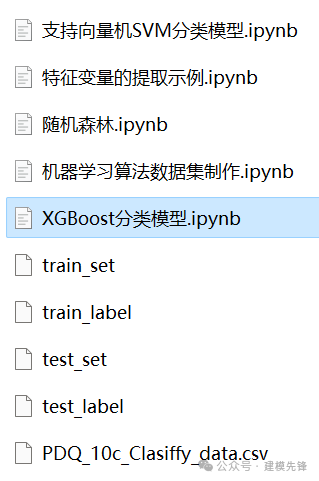

代码、数据如下:

创新度高!!!需要发论文的同学即买即用

往期精彩内容:

电能质量扰动信号数据介绍与分类-Python实现-CSDN博客

Python电能质量扰动信号分类(一)基于LSTM模型的一维信号分类-CSDN博客

Python电能质量扰动信号分类(二)基于CNN模型的一维信号分类-CSDN博客

Python电能质量扰动信号分类(三)基于Transformer的一维信号分类模型-CSDN博客

Python电能质量扰动信号分类(四)基于CNN-BiLSTM的一维信号分类模型-CSDN博客

Python电能质量扰动信号分类(五)基于CNN-Transformer的一维信号分类模型-CSDN博客

基于FFT + CNN -Transformer时域、频域特征融合的电能质量扰动识别模型-CSDN博客

前言

本文基于Python仿真的电能质量扰动信号,先经过数据预处理进行数据集的制作和加载,然后通过特征提取和机器学习方法进行扰动信号识别,特征提取是通过从原始PQD信号中提取有意义的特征来减少数据维度,并捕捉到信号的关键信息,机器学习方法能够基于这些特征建立模型,并通过训练和学习来识别不同的扰动信号。

Python仿真电能质量扰动信号的详细介绍可以参考下文(文末附10分类数据集):

电能质量扰动信号数据介绍与分类-Python实现_python给电压数据做分类-CSDN博客

部分扰动信号类型波形图如下所示:

1 数据集和特征提取

1.1 数据集导入

在参考IEEE Std1159-2019电能质量检测标准与相关文献的基础上构建了扰动信号的模型,生成包括正常信号在内的10中单一信号和多种复合扰动信号。参考之前的文章,进行扰动信号10分类的预处理:

第一步,按照公式模型生成单一信号

单一扰动信号可视化:

根据信号时间步长为 1024 制作数据集

形成5000个样本, 单个样本长度 1024,加上一个标签类别。

1.2 扰动信号特征提取

(1) 峭度(Kurtosis):衡量信号的尖锐程度,用于检测信号中的高频成分

(2) 熵值(Entropy):衡量信号的复杂程度和随机性,用于检测信号的频谱特性

(3) 分形值(Fractal Dimension):衡量信号的自相似性和复杂度,用于分析信号的分形特征

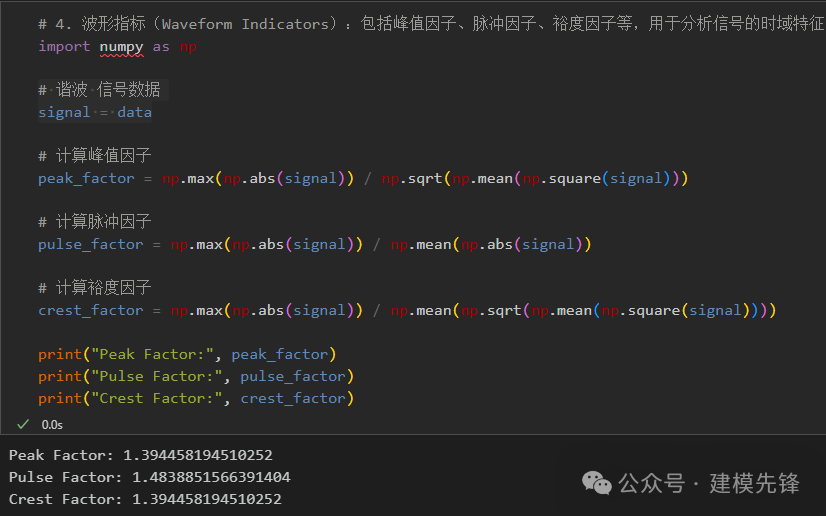

(4) 波形指标(Waveform Indicators):包括峰值因子、脉冲因子、裕度因子等,用于分析信号的时域特征

(5) 频谱指标(Spectral Indicators):包括峰值频率、能量比值、谱线形指标等,用于分析信号的频域特征

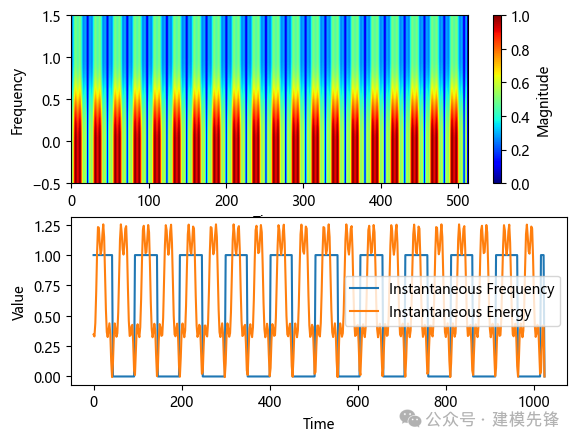

(6) 频域指标(Time-Frequency Indicators):包括瞬时频率、瞬时能量等,用于分析信号的时频特征

(7) 统计特征(Statistical Features):包括均值、方差、偏度等,用于描述信号的统计特性

(8) 小波包特征(Wavelet Packet Features):通过小波变换提取的特征,用于分析信号的时频局部特性

(9) 振动特征(Vibration Features):包括峰值振动、有效值振动等,用于描述信号的振动特性

选择了多种特征提取方法来捕捉信号的不同特征,共提取9类13个特征指标,来作为机器学习模型的训练与识别。

2超强模型XGBoost——原理介绍

2.1 原理介绍

论文链接:

XGBoost | Proceedings of the 22nd ACM SIGKDD International Conference on Knowledge Discovery and Data Mining

GBoost模型(eXtreme Gradient Boosting)是一种梯度提升框架,由Tianqi Chen在2014年开发,并在机器学习领域广泛应用。XGBoost的核心思想是通过迭代地训练多个弱学习器,并将它们组合起来,实现强大的预测能力。它在梯度提升算法的基础上进行了改进和优化,具有高效、灵活和可扩展的特点。

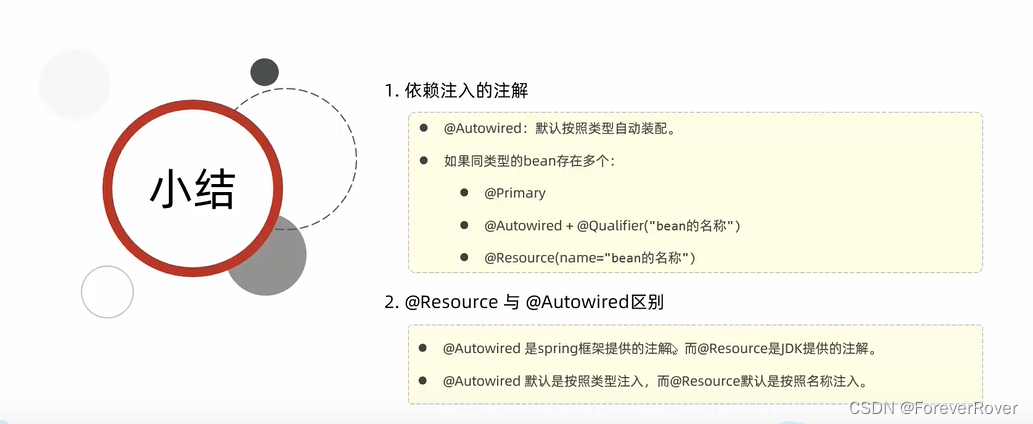

下面是XGBoost的一些关键特性和原理:

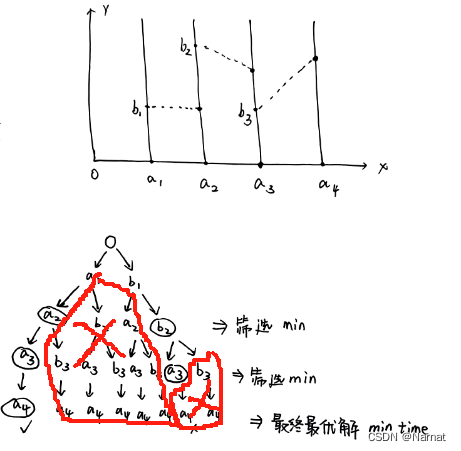

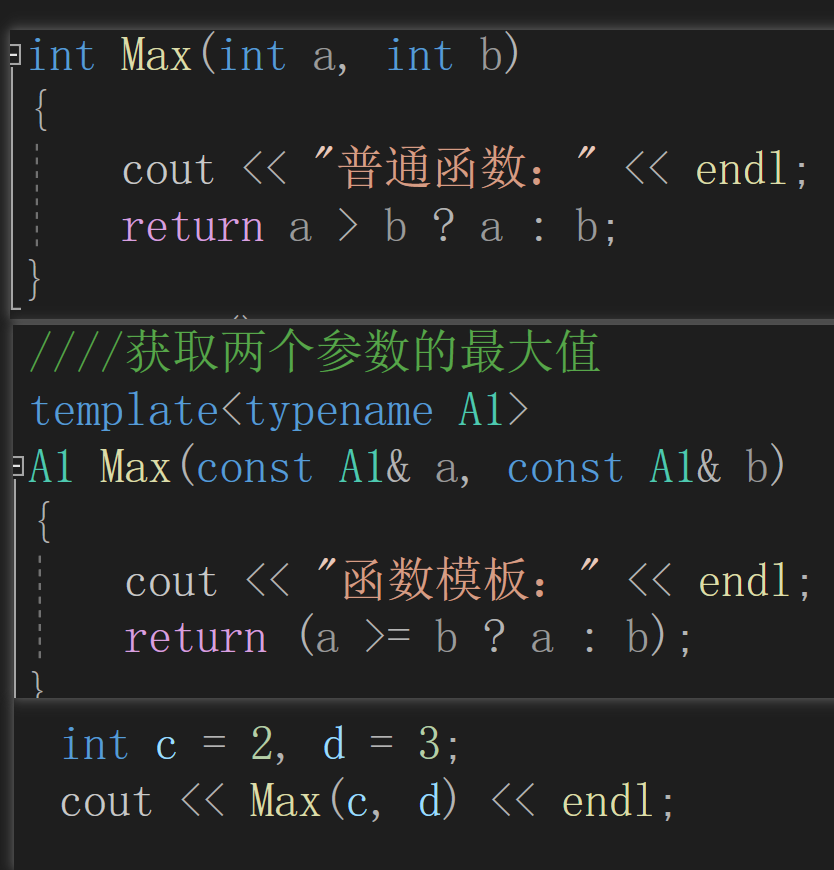

1. 梯度提升:XGBoost使用了梯度提升算法,也称为增强学习(Boosting)算法。它通过迭代地训练多个弱学习器,并通过梯度下降的方式来优化模型的预测能力。每个弱学习器都是在前一个弱学习器的残差上进行训练,从而逐步减小预测误差。

2. 基于树的模型:XGBoost采用了基于树的模型,即决策树。决策树是一种非常灵活和可解释的模型,能够学习到复杂的非线性关系。XGBoost使用了CART(Classification and Regression Trees)作为默认的基学习器,每个决策树都是通过不断划分特征空间来实现分类或回归任务。

3. 正则化策略:为了防止过拟合,XGBoost引入了正则化策略。它通过控制决策树的复杂度来限制模型的学习能力。常用的正则化策略包括限制决策树的最大深度、叶子节点的最小样本数和叶子节点的权重衰减等。

4. 特征选择和分裂:XGBoost在构建决策树时,通过特征选择和分裂来最大化模型的增益。特征选择基于某种评估准则(如信息增益或基尼系数),选择对当前节点的划分最有利的特征。特征分裂则是确定特征划分点的过程,使得划分后的子节点能够最大程度地减小预测误差。

5. 并行计算:为了提高模型的训练速度,XGBoost使用了并行计算的策略。它通过多线程和分布式计算等技术,将训练任务分解为多个子任务,并在不同的处理器上同时进行计算。这样可以加快模型的训练速度,特别是在处理大规模数据集时表现优异。

6. 自定义损失函数:XGBoost允许用户自定义损失函数,以适应不同的任务和需求。用户可以根据具体问题的特点,定义适合的损失函数,并在模型训练过程中使用它。

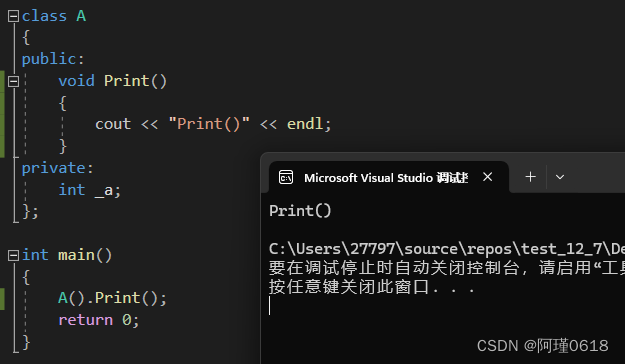

XGBoost模型通过梯度提升算法和基于树的模型,在许多机器学习任务中都取得了很好的效果,包括分类、回归、排序和推荐等。我们利用其高效、灵活和可扩展的特性,使用XGBoost来构建一个梯度提升模型,通过迭代地训练多个决策树来实现轴承故障识别。

2.2 特征数据集制作

3 模型评估和对比

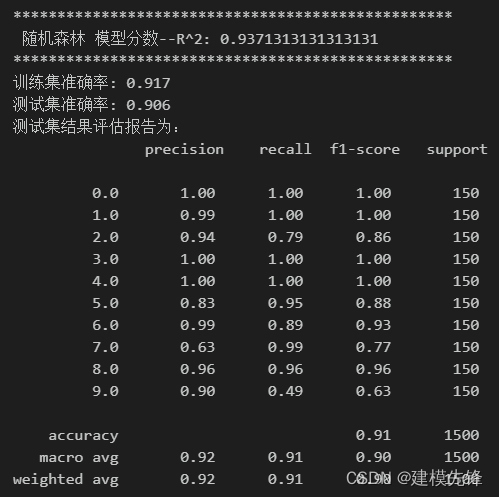

3.1 随机森林分类模型

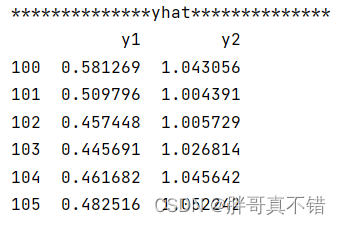

模型分数、准确率、精确率、召回率、F1 Score

扰动信号十分类混淆矩阵

3.2 支持向量机SVM分类模型

模型分数、准确率、精确率、召回率、F1 Score

扰动信号十分类混淆矩阵:

3.3 XGBoost分类模型

模型分数、准确率、精确率、召回率、F1 Score

扰动信号十分类混淆矩阵:

实验结果表明,所提取的各种特征都对电能质量扰动信号识别有一定的贡献。峭度、熵值和分形值能够帮助捕捉信号的尖锐程度、复杂程度和自相似性,从而有效地区分不同类型的扰动信号。波形指标、频谱指标和频域指标能够提供信号的时域和频域特征,有助于识别扰动信号的时频特性。统计特征、小波包特征和振动特征则能够描述信号的统计特性和振动特性,从而更好地区分扰动信号。

对比可以看出来, XGBoost分类模型性能最好,在训练集、测试集上的表现最优,模型分数也是最高,在扰动信号识别中取得了良好的效果。通过准确地捕捉到信号的特征和模式,能够对不同类型和程度的信号类型进行准确的识别和分类,准确率达到98%,速度快,性能好,创新度高。

代码、数据如下: