CV及LLM常见名词解释

看论文的时候,有些术语虽然常见但是却让人很难理解具体含义,如noise等,这里是一些常见术语的解释,同时也给出了这些术语所在的上下文及模型

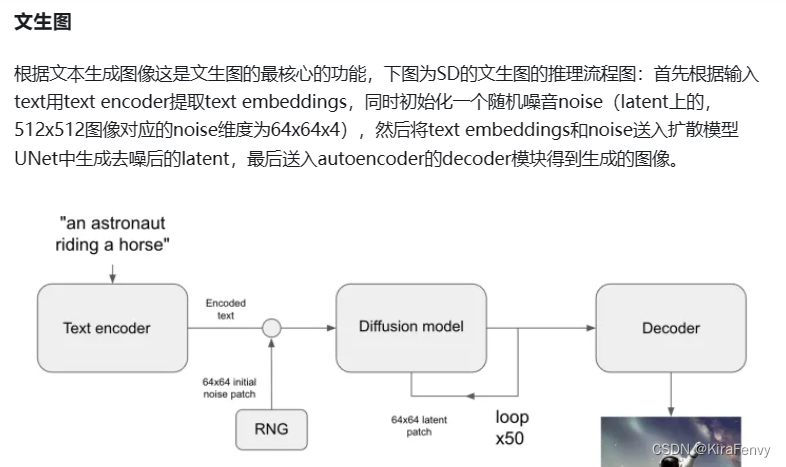

例1:Stable Diffusion的文生图模块

- Embedding:这是指将输入的文本(如“an astronaut riding a horse”)转换成一个高维空间中的向量表示。这个过程通常通过一个文本编码器(Text encoder)完成,它可以捕捉和编码文本的语义信息。Embedding向量是一个密集的向量,它将文本的信息压缩进一个固定长度的格式,以便模型可以处理。

- Latent:这是指在模型中的隐藏层表示,它是一个在生成过程中的中间状态。在图像生成模型中,latent通常是指从初始噪声(noise)状态逐渐转换成有意义图像的那些中间状态的数据表示。它是模型内部的一个或多个层的输出,这些层试图捕捉输入数据的抽象特征。

- Noise:在这个上下文中,noise是指在生成过程的开始被引入的随机数据。在图中的模型中,它通常是一个随机生成的初始图像(或图像块),这个随机噪声图像通过循环经过一个扩散模型(Diffusion model)被逐渐转换成一个具有特定意义的图像。在扩散模型中,噪声是被逐步减少的,而与之相对的,图像的特征则逐步增强。

- Encoder:在深度学习模型中,encoder通常是一个神经网络结构,它的目的是将高维数据(如图像或文本)转换成一个低维的、密集的表示,即latent空间。这个过程涉及信息的压缩,encoder试图捕捉输入数据的核心特征。在文本到图像的生成模型中,encoder通常指的是将文本信息编码成向量的文本编码器。

- Decoder:decoder是encoder的对偶,它的任务是将encoder输出的低维、密集的latent表示重新构建回原始数据的高维空间。在图像生成模型中,decoder负责将latent空间的数据“解码”成可识别的图像。这个过程通常涉及数据的扩张和细化,以生成高质量的输出图像。

- RNG (Random Number Generator):RNG是一个生成随机数的系统,它在深度学习和模拟过程中非常关键。在文本到图像的生成模型中,RNG可以用于生成初始的噪声图像,这个噪声图像随后会通过decoder变换成有意义的图像。RNG的随机性保证了生成过程的多样性和不可预测性,是探索生成空间的重要工具。