文章目录

- 6.1 提高爬虫的效率

- 6.1.1 重点基础知识讲解

- 6.1.2 重点案例:使用 asyncio 和 aiohttp 实现异步爬虫

- 6.1.3 拓展案例 1:利用 Scrapy 的并发特性

- 6.1.4 拓展案例 2:使用缓存来避免重复请求

- 6.2 处理大规模数据爬取

- 6.2.1 重点基础知识讲解

- 6.2.2 重点案例:使用 Scrapy-Redis 实现分布式爬虫

- 6.2.3 拓展案例 1:使用队列管理待抓取 URL

- 6.2.4 拓展案例 2:实现去重策略

- 6.3 爬虫的维护与监控

- 6.3.1 重点基础知识讲解

- 6.3.2 重点案例:使用 Python logging 模块记录日志

- 6.3.3 拓展案例 1:使用 Prometheus 和 Grafana 监控爬虫

- 6.3.4 拓展案例 2:设置自动化报警

6.1 提高爬虫的效率

在数据爬虫的世界里,效率意味着更快地获取数据,同时尽量减少资源的消耗。让我们一起探索如何让你的爬虫跑得更快,同时更加环保。

6.1.1 重点基础知识讲解

- 并发和异步请求:并发请求可以让你的爬虫同时处理多个任务,而不是一次完成一个任务再移动到下一个。异步请求则允许你的爬虫在等待响应时继续执行其他任务,从而提高效率。

- 缓存利用:通过缓存网页响应,爬虫可以避免重复抓取相同的内容,减少不必要的网络请求。

- 请求批处理:将多个请求合并为批处理,可以减少网络往返次数,提高数据处理速度。

- 资源管理:合理管理网络连接和内存使用,确保爬虫在长时间运行时不会消耗过多资源或导致内存泄漏。

6.1.2 重点案例:使用 asyncio 和 aiohttp 实现异步爬虫

假设我们需要从多个URL并发抓取数据。使用 Python 的 asyncio 库和 aiohttp 可以轻松实现异步 HTTP 请求。

import asyncio

import aiohttp

async def fetch(url, session):

async with session.get(url) as response:

return await response.text()

async def main(urls):

async with aiohttp.ClientSession() as session:

tasks = [fetch(url, session) for url in urls]

return await asyncio.gather(*tasks)

urls = ["https://www.example.com", "https://www.example.org"]

loop = asyncio.get_event_loop()

results = loop.run_until_complete(main(urls))

for result in results:

print(result[:100]) # 打印每个结果的前100个字符

6.1.3 拓展案例 1:利用 Scrapy 的并发特性

Scrapy 是一个强大的爬虫框架,它天生支持并发抓取。通过调整 CONCURRENT_REQUESTS 设置,你可以控制 Scrapy 同时发出的请求数量。

# 在 Scrapy 项目的 settings.py 文件中设置

CONCURRENT_REQUESTS = 16 # 根据目标网站的承受能力调整这个值

6.1.4 拓展案例 2:使用缓存来避免重复请求

对于经常访问的URL,使用请求缓存可以显著提高爬虫的效率。以下示例使用 requests_cache 库来自动缓存 HTTP 请求。

import requests

import requests_cache

requests_cache.install_cache('demo_cache')

# 第一次请求会从网上获取数据

response = requests.get('https://www.example.com')

print(response.from_cache) # False

# 第二次请求会从缓存中获取数据

response = requests.get('https://www.example.com')

print(response.from_cache) # True

通过这些方法,你的爬虫将变得更加高效和智能。并发和异步请求可以让你的爬虫在同一时间做更多的事情,而缓存和资源管理则确保它不会浪费宝贵的网络和计算资源。现在,让我们把这些策略应用到你的爬虫项目中,让它飞快地运行起来吧!

6.2 处理大规模数据爬取

当面对需要抓取大量数据的任务时,我们的爬虫就像是一只在数据海洋中航行的小船。要想不在这片浩瀚的海洋中迷失方向,就需要采取一些特别的策略来提高效率和稳定性。

6.2.1 重点基础知识讲解

- 分布式爬虫:通过在多台机器上运行爬虫的不同实例来分担抓取任务,可以显著提高数据抓取的速度。这种方式需要合理的任务分配和协调机制。

- 负载均衡:合理分配请求到不同的目标服务器,避免对单一服务器造成过大压力,同时提高爬虫的抓取效率。

- 队列管理:使用队列来管理待抓取的URL,可以有效地控制爬虫的抓取流程,保证爬虫稳定运行。

- 去重策略:对于大规模的数据抓取任务,避免重复抓取相同的URL是非常重要的。使用哈希表或布隆过滤器等数据结构可以高效地实现去重。

6.2.2 重点案例:使用 Scrapy-Redis 实现分布式爬虫

Scrapy 是一个强大的爬虫框架,而 Scrapy-Redis 是一个基于 Redis 的Scrapy 扩展,用于支持分布式爬取。

# 假设你已经有一个 Scrapy 爬虫项目

# settings.py 配置如下

SCHEDULER = "scrapy_redis.scheduler.Scheduler"

DUPEFILTER_CLASS = "scrapy_redis.dupefilter.RFPDupeFilter"

REDIS_URL = 'redis://localhost:6379'

# 爬虫文件

import scrapy

from scrapy_redis.spiders import RedisSpider

class MyDistributedSpider(RedisSpider):

name = 'my_distributed_spider'

redis_key = 'my_spider:start_urls'

def parse(self, response):

# 处理抓取逻辑

pass

6.2.3 拓展案例 1:使用队列管理待抓取 URL

对于大规模爬取任务,使用消息队列(如 RabbitMQ)来管理待抓取的URL可以提高爬虫的可扩展性和效率。

import pika

import requests

# 连接到 RabbitMQ

connection = pika.BlockingConnection(pika.ConnectionParameters('localhost'))

channel = connection.channel()

# 声明队列

channel.queue_declare(queue='url_queue')

# 从队列获取 URL 并抓取

def callback(ch, method, properties, body):

url = body.decode()

response = requests.get(url)

print(f"抓取 {url} 完成")

channel.basic_consume(queue='url_queue', on_message_callback=callback, auto_ack=True)

print(' [*] 等待 URL。退出请按 CTRL+C')

channel.start_consuming()

6.2.4 拓展案例 2:实现去重策略

在大规模爬取过程中,有效去重是提高效率的关键。以下是一个使用布隆过滤器进行去重的简单示例。

from pybloom_live import BloomFilter

import requests

# 初始化布隆过滤器

bloom_filter = BloomFilter(capacity=100000, error_rate=0.001)

urls = ["https://www.example.com", "https://www.example.com", "https://www.example.org"]

for url in urls:

if url in bloom_filter:

print(f"{url} 已经抓取,跳过")

else:

bloom_filter.add(url)

response = requests.get(url)

print(f"抓取 {url} 完成")

通过采用这些策略,我们的爬虫就能够在数据的海洋中自由航行,即使面对大规模的数据抓取任务,也能保持高效和稳定。记住,优秀的爬虫不仅要会抓取数据,还要懂得如何在复杂的网络世界中灵活航行。

6.3 爬虫的维护与监控

爬虫的维护和监控就像是对一艘航行在数据海洋中的船只进行定期的检查和导航。没有人希望自己的船只因为小问题而停止航行或偏离航道。因此,确保爬虫的健康和效率是每个数据侠的必修课。

6.3.1 重点基础知识讲解

- 日志记录:日志是爬虫维护和监控的基石。合理配置日志可以帮助开发者快速定位问题。

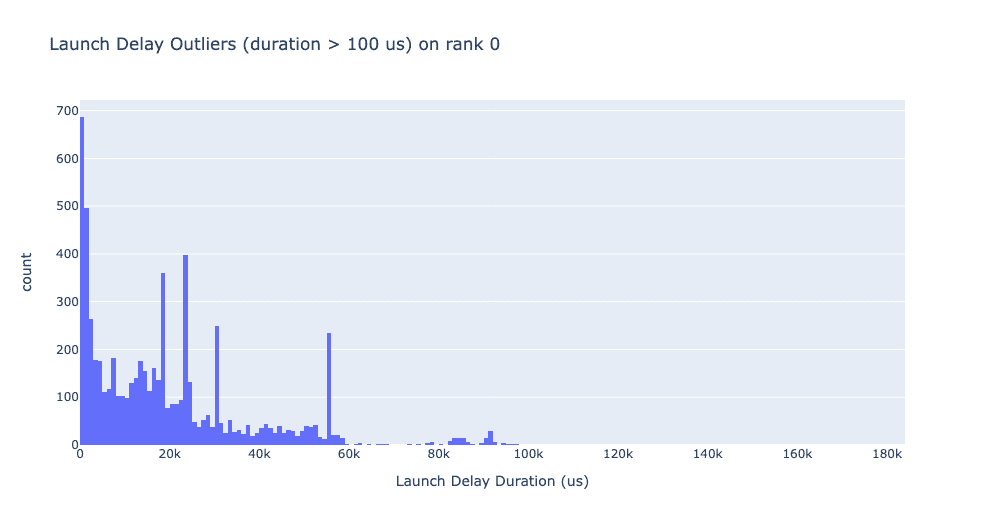

- 性能监控:监控爬虫的性能,包括请求速率、响应时间和成功率等,可以帮助开发者评估爬虫的效率和稳定性。

- 错误处理:合理的错误处理机制可以确保爬虫在遇到问题时不会直接崩溃,而是尝试恢复或安全地停止。

- 自动化报警:通过设置阈值和自动化报警,开发者可以在爬虫出现问题时及时得到通知。

6.3.2 重点案例:使用 Python logging 模块记录日志

配置日志是爬虫维护的第一步。以下是一个使用 Python logging 模块为爬虫配置日志的示例。

import logging

# 配置日志

logging.basicConfig(filename='spider.log', level=logging.INFO, format='%(asctime)s - %(levelname)s - %(message)s')

# 在爬虫中记录日志

logging.info('爬虫启动')

try:

# 模拟爬虫操作

logging.info('正在抓取数据...')

# 抓取逻辑...

logging.info('数据抓取完成')

except Exception as e:

logging.error(f'抓取过程中发生错误: {e}')

6.3.3 拓展案例 1:使用 Prometheus 和 Grafana 监控爬虫

Prometheus 是一个开源的监控解决方案,Grafana 是一个跨平台的开源分析和可视化工具,两者结合可以为爬虫提供强大的监控能力。

# 这是一个概念性示例,具体实施需要安装和配置 Prometheus 和 Grafana

# 假设你已经在 Prometheus 中配置了监控目标(你的爬虫)

# 并且在你的爬虫代码中加入了 Prometheus 客户端库来记录指标

from prometheus_client import start_http_server, Summary

# 创建一个摘要指标来记录请求处理时间

REQUEST_TIME = Summary('request_processing_seconds', 'Time spent processing request')

@REQUEST_TIME.time()

def process_request(t):

"""模拟请求处理"""

time.sleep(t)

# 启动 Prometheus 指标服务器

start_http_server(8000)

# 模拟请求处理

process_request(1)

6.3.4 拓展案例 2:设置自动化报警

自动化报警是及时响应爬虫问题的关键。以下是一个使用 Python 发送报警邮件的示例。

import smtplib

from email.mime.text import MIMEText

from email.header import Header

# 邮件发送者和接收者

sender = 'your_email@example.com'

receivers = ['receiver_email@example.com']

# 邮件内容

message = MIMEText('爬虫异常,请及时处理!', 'plain', 'utf-8')

message['From'] = Header("爬虫监控系统", 'utf-8')

message['To'] = Header("管理员", 'utf-8')

subject = '爬虫异常报警'

message['Subject'] = Header(subject, 'utf-8')

try:

smtpObj = smtplib.SMTP('localhost')

smtpObj.sendmail(sender, receivers, message.as_string())

print("报警邮件发送成功")

except smtplib

.SMTPException as e:

print(f"无法发送邮件,异常:{e}")

通过这些方法,你的爬虫就像是配备了最先进的导航和警报系统的船只,即使在数据海洋的风浪中也能稳健航行。记得定期检查和维护你的爬虫,确保它始终保持最佳状态!