目标

- 光流的概念以及Lucas-Kanade 光流法

- 使用函数cv2.calcOpticalFlowPyrLK() 对图像中的特征点进行跟踪

光流

介绍

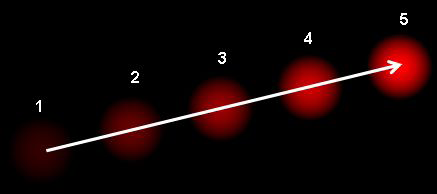

由于目标对象或者摄像机的移动造成的图像对象在连续两帧图像中的移动被称为光流。它是一个2D 向量场,可以用来显示一个点从第一帧图像到第二帧图像之间的移动。如下图所示:

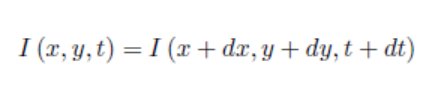

上图显示了一个点在连续的五帧图像间的移动。箭头表示光流场向量。光流算法是一种用于估计图像序列中像素运动的计算机视觉技术。它基于一个简单的假设:1. 在连续的两帧图像之间(目标对象)的像素的灰度值不改变。2. 相邻的像素具有相同的运动.根据这个假设,光流算法通过计算相邻帧之间的像素差异来确定像素的运动方向和速度。第一帧图像中的像素I (x,y,t) 在时间 dt 后移动到第二帧图像的(x+dx,y+dy)处。根据第一条假设:灰度值不变。所以我们可以得到:

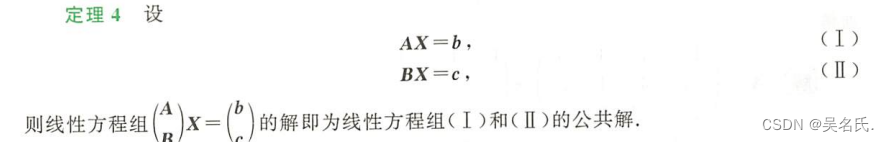

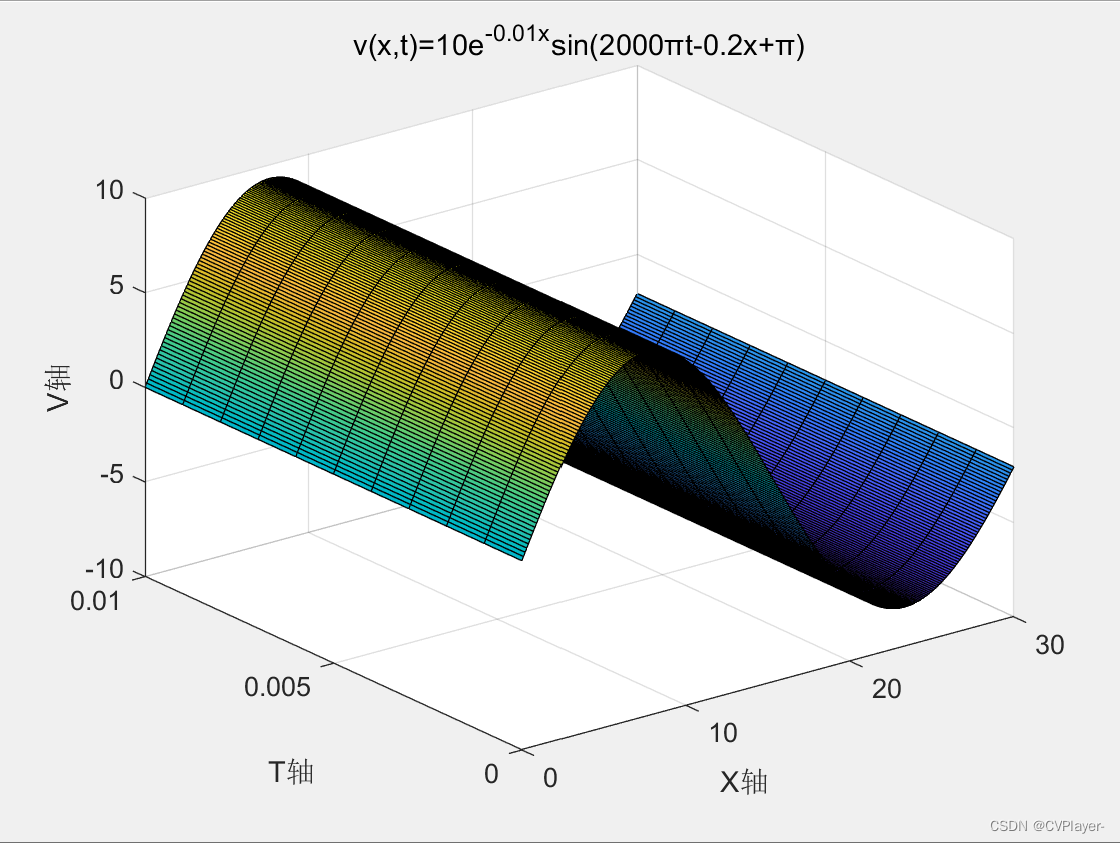

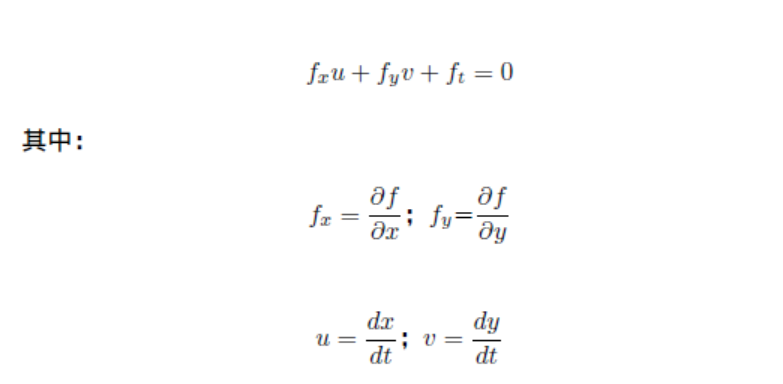

对等号右侧进行泰勒级数展开,消去相同项,两边都除以dt,得到如下方程:

上面的等式叫做光流方程。其中fx 和fy 是图像梯度,同样ft 是时间方向的梯度。但(u,v)是不知道的。我们不能在一个等式中求解两个未知数。有几个方法可以帮我们解决这个问题,其中的一个是Lucas-Kanade 法 。

原理及应用

光流算法的基本原理是,对于两个连续的图像帧,我们可以将第一个图像的每个像素点在第二个图像中进行寻找。通过在第二个图像中找到与第一个图像中每个像素最相似的像素,我们可以得到一个像素点的位移向量。这个位移向量表示了该像素在两个图像帧之间的运动。在实际应用中,光流算法通常使用稀疏特征点来估计像素运动。首先,在第一个图像帧中检测到一组特征点,如角点或边缘点。然后,使用光流算法来追踪这些特征点在第二个图像帧中的位置。最常用的光流算法之一是Lucas-Kanade算法,它使用金字塔图像结构来提高计算的效率。

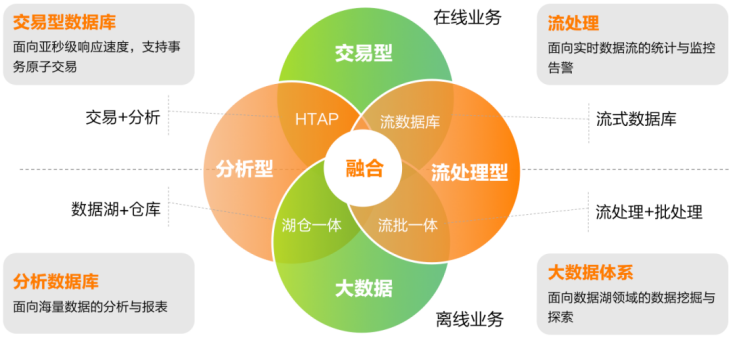

光流算法在计算机视觉中有广泛的应用。它可以用于运动分析(运动重建结构)、目标跟踪、视频及图像稳定、视频压缩等任务。例如,在运动分析中,光流算法可以帮助我们理解相机运动、物体运动和场景的深度信息。在目标跟踪中,光流算法可以用于估计目标的运动轨迹,并预测目标的未来位置。在图像稳定中,光流算法可以用于校正由于相机抖动引起的图像模糊。

Lucas-Kanade算法

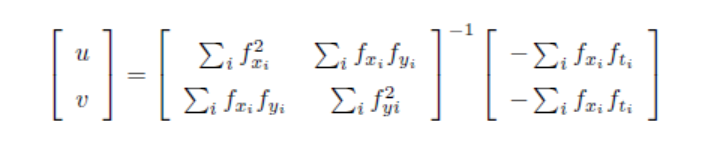

现在我们使用第二条假设,邻域内的所有点都有相似的运动。Lucas-Kanade 法就是利用一个3x3 邻域中的9 个点具有相同运动的这一点。这样我们就可以找到 9 个点的光流方程,用它们组成一个具有两个未知数9 个等式的方程组,这是一个约束条件过多的方程组。一个好的解决方法就是使用最小二乘拟合。下面就是求解结果:

有没有发现上面的逆矩阵与Harris 角点检测器非常相似,这说明角点很适合用来做跟踪。

从使用者的角度来看,想法很简单,我们取跟踪一些点,然后我们就会获得这些点的光流向量。但是还有一些问题。直到现在我们处理的都是很小的运动。如果有大的运动怎么办呢?图像金字塔。我们可以使用图像金字塔的顶层,此时小的运动被移除,大的运动转换成了小的运动,现在再使用Lucas-Kanade算法,我们就会得到尺度空间上的光流。

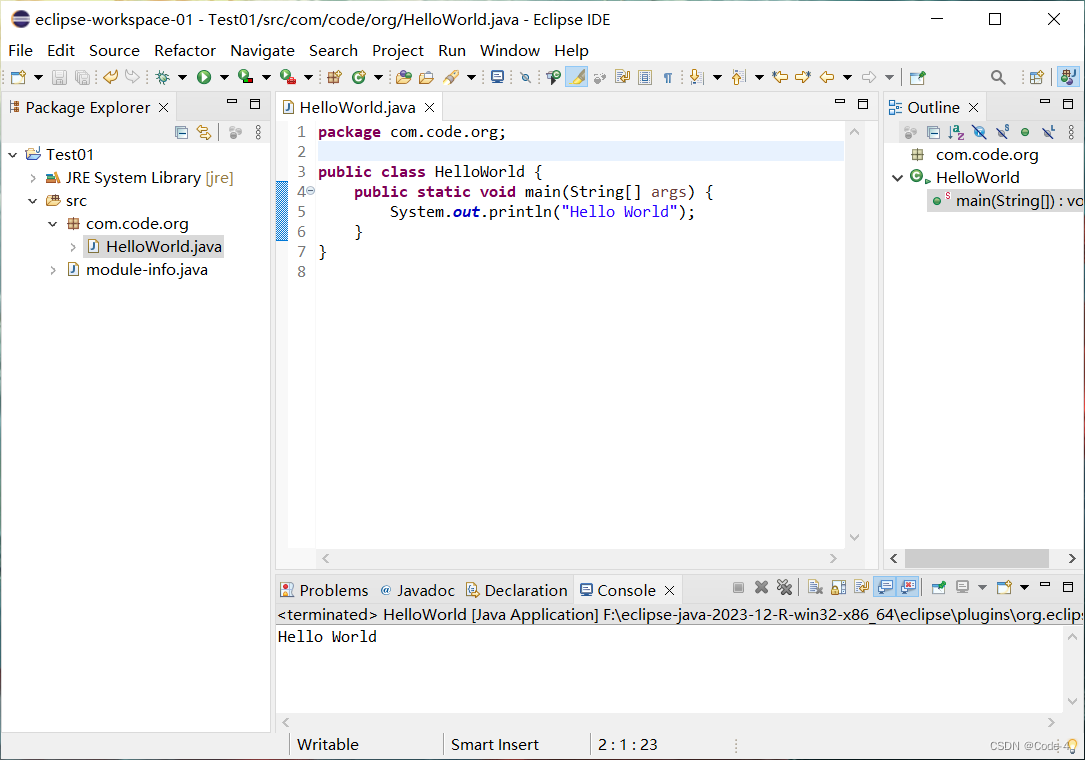

OpenCV中的Lucas-Kanade光流

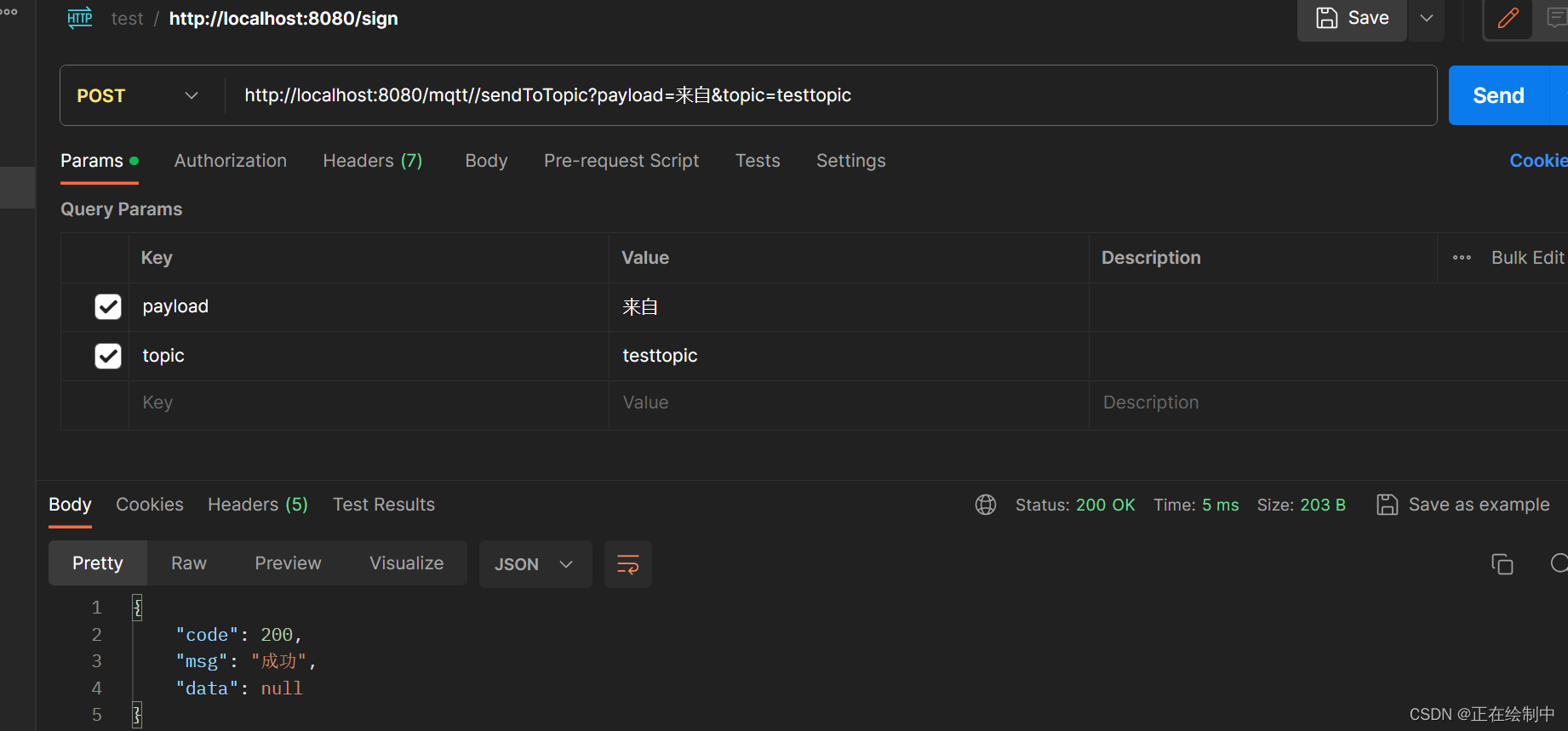

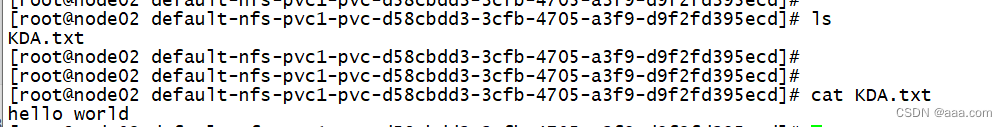

上面所有过程都被OpenCV 打包成了一个函数:cv2.calcOpticalFlowPyrLK()。现在我们使用这个函数创建一个小程序来跟踪视频中的一些点。要跟踪哪些些点呢?我们使用函数cv2.goodFeatureToTrack() 来确定要跟踪的点。我们首先在视频的第一帧图像中检测一些Shi-Tomasi 角点,然后我们使用Lucas-Kanade 算法迭代跟踪这些角点。我们要给函数cv2.calcOpticlaFlowPyrLK()传入前一帧图像和其中的点,以及下一帧图像。函数将返回带有状态数的点,如果状态数是1,说明在下一帧图像中找到了这个点(上一帧中角点)如果状态数是0,就说明没有在下一帧图像中找到这个点。我们再把这些点作为参数传给函数,如此跌代下去实现跟踪。代码如下:

import numpy as np

import cv2

cap = cv2.VideoCapture('slow.flv')

# params for ShiTomasi corner detection

feature_params = dict( maxCorners = 100,

qualityLevel = 0.3,

minDistance = 7,

blockSize = 7 )

# Parameters for lucas kanade optical flow

#maxLevel 为使用的图像字塔层数

lk_params = dict( winSize = (15,15),

maxLevel = 2,

criteria = (cv2.TERM_CRITERIA_EPS | cv2.TERM_CRITERIA_COUNT, 10, 0.03))

# Create some random colors

color = np.random.randint(0,255,(100,3))

# Take first frame and find corners in it

ret, old_frame = cap.read()

old_gray = cv2.cvtColor(old_frame, cv2.COLOR_BGR2GRAY)

p0 = cv2.goodFeaturesToTrack(old_gray, mask = None, **feature_params)

# Create a mask image for drawing purposes

mask = np.zeros_like(old_frame)

while(1):

ret,frame = cap.read()

frame_gray = cv2.cvtColor(frame, cv2.COLOR_BGR2GRAY)

# calculate optical flow 能够获取点的新位置

p1, st, err = cv2.calcOpticalFlowPyrLK(old_gray, frame_gray, p0, None,**lk_params)

# Select good points

good_new = p1[st==1]

good_old = p0[st==1]

# draw the tracks

for i,(new,old) in enumerate(zip(good_new,good_old)):

a,b = new.ravel()

c,d = old.ravel()

mask = cv2.line(mask, (a,b),(c,d), color[i].tolist(), 2)

frame = cv2.circle(frame,(a,b),5,color[i].tolist(),-1)

img = cv2.add(frame,mask)

cv2.imshow('frame',img)

k = cv2.waitKey(30) & 0xff

if k == 27:

break

# Now update the previous frame and previous points

old_gray = frame_gray.copy()

p0 = good_new.reshape(-1,1,2)

cv2.destroyAllWindows()

cap.release()(上面的代码没有对返回角点的正确性进行检查。图像中的一些特征点甚至在丢失以后,光流还会找到一个预期相似的点。所以为了实现稳定的跟踪,我们应该每个一定间隔就进行一次角点检测。OpenCV 的官方示例中带有这样一个例子,它是每5 帧进行一个特征点检测。它队对光流点使用反向检测来获取好的点进行跟踪,示例为/samples/python2/lk_track.py)