系列文章目录

文章目录

- 系列文章目录

- 前言

- 一、用colab薅羊毛

- 二、使用百度飞浆操作

- 三、

- 二、使用步骤

- 1.引入库

- 2.读入数据

- 总结

前言

一、用colab薅羊毛

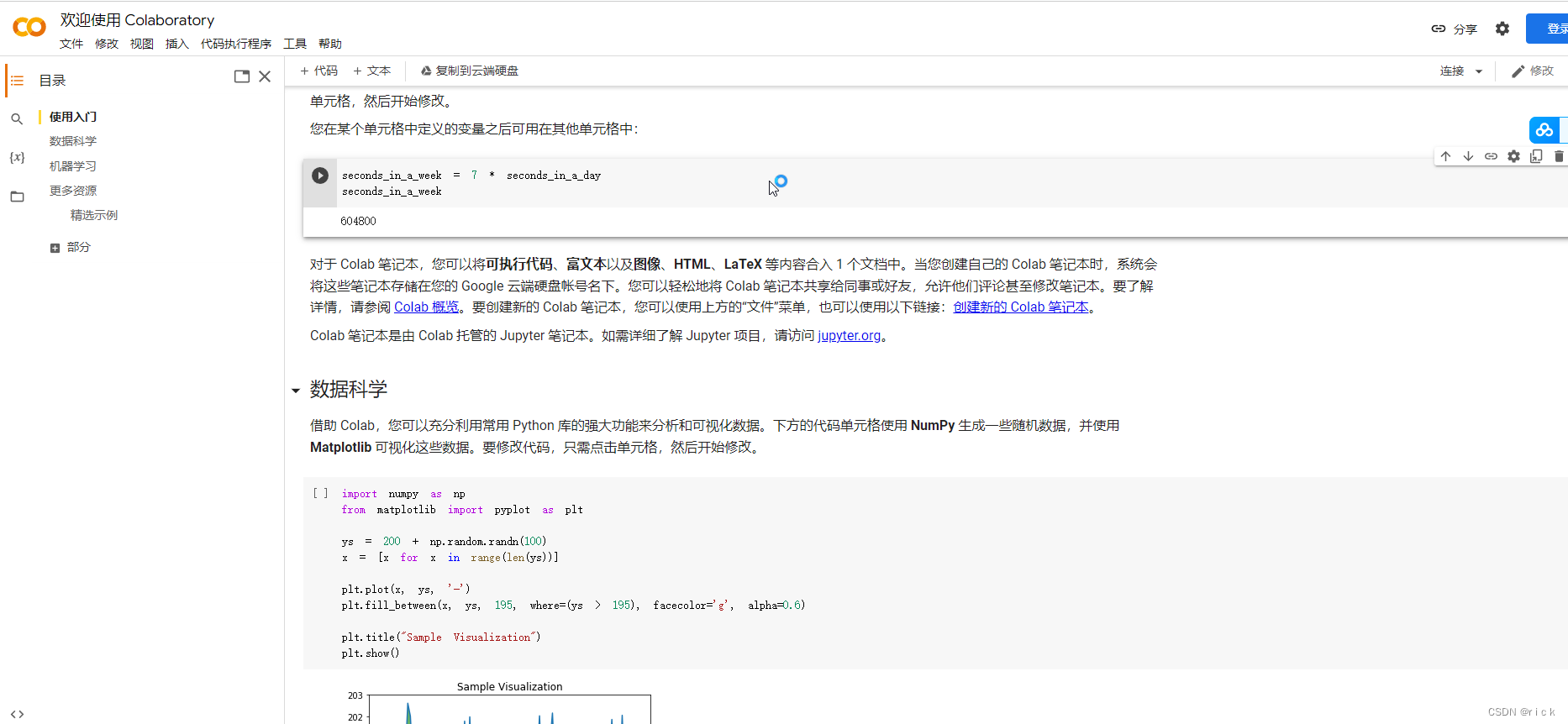

Colaboratory 简称“Colab”,是 Google Research 团队开发的一款产品。在 Colab 中,任何人都可以通过浏览器编写和执行任意 Python 代码。它尤其适合机器学习、数据分析和教育目的。从技术上说,Colab 是一种托管式 Jupyter 笔记本服务。用户无需进行设置,就可以直接使用,同时还能获得 GPU 等计算资源的免费使用权限。

Google Colab免费GPU 超详细使用教程

- 需要准备的东西

ibcn和谷歌账号

有了上面两个东西后便可跳转到:colab

加载谷歌driver

from google.colab import drive

drive.mount('/content/drive')

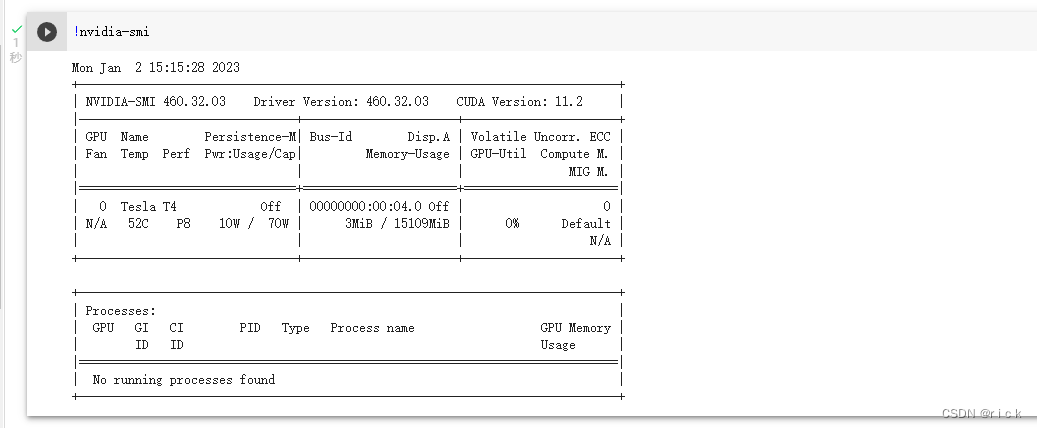

注意,colab操作与Linux系统下操作是一样的,所以一些命令也是共通的,因为colab本身就是在Linux系统上,通过网页来操作而已,可以通过命令查看显卡使用情况,需要加!号

!nvidia-smi

查看cuda版本及显卡型号

结果显示pytorch版本是1.13,cuda版本是11.6

显卡型号是:Tesla T4

- 使用colab跑Yolov5代码

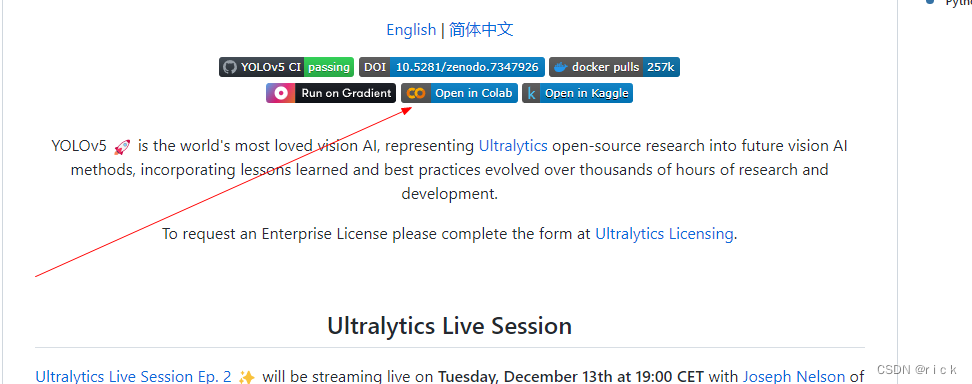

Yolov4在github官方代码:ultralytics/yolov5

选择Open in colab,如箭头所示

- 首先连接官方GPU

- 步骤

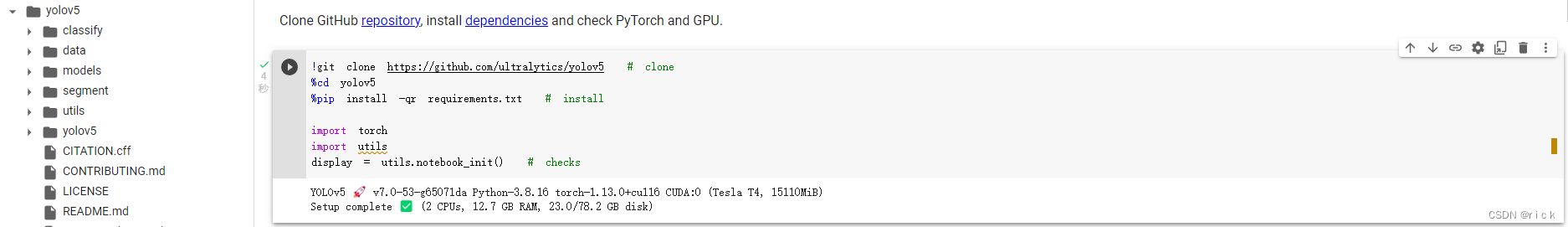

- 步骤一:拷贝代码到当前目录下,并且配置环境

!git clone https://github.com/ultralytics/yolov5 # clone

%cd yolov5

%pip install -qr requirements.txt # install

import torch

import utils

display = utils.notebook_init() # checks

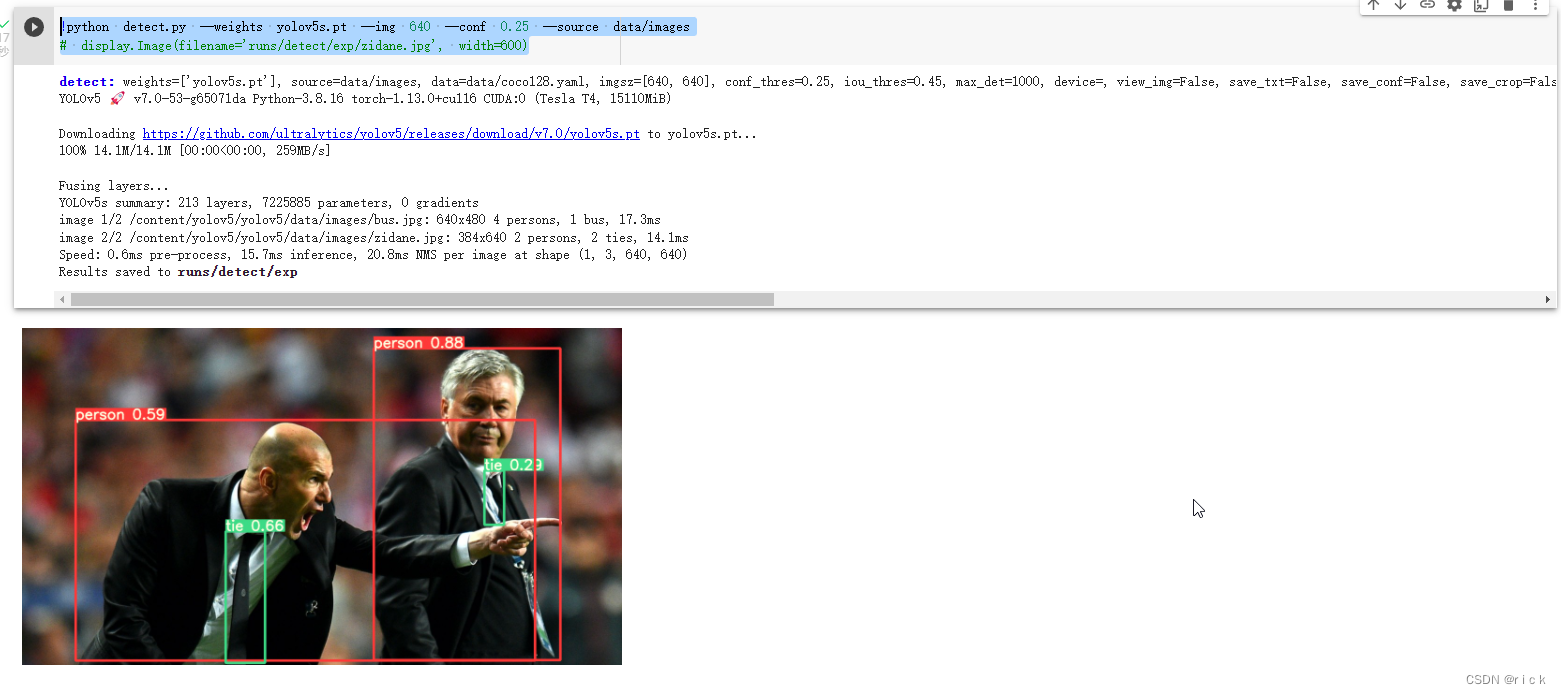

- 步骤二:下载训练好的模型并测试

!python detect.py --weights yolov5s.pt --img 640 --conf 0.25 --source data/images

# display.Image(filename='runs/detect/exp/zidane.jpg', width=600)

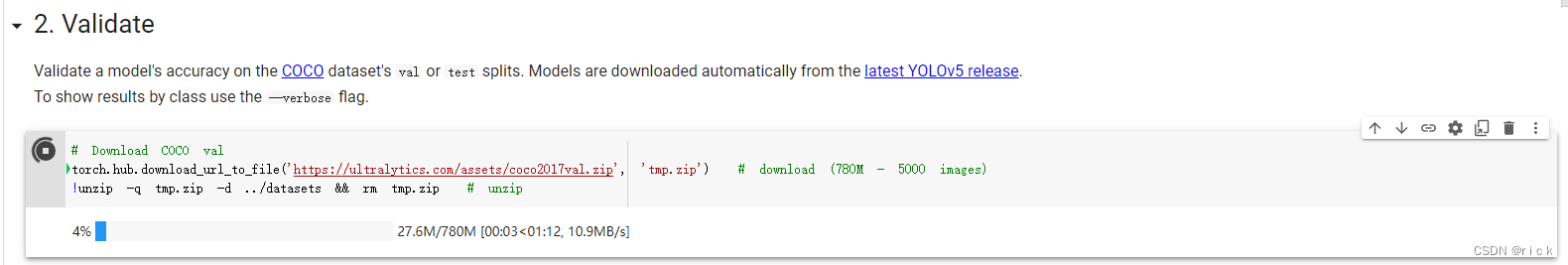

- 步骤三:下载coco验证集看模型的精度

coco数据集大概有80个类

# Download COCO val

torch.hub.download_url_to_file('https://ultralytics.com/assets/coco2017val.zip', 'tmp.zip') # download (780M - 5000 images)

!unzip -q tmp.zip -d ../datasets && rm tmp.zip # unzip

可以看到网速能达到:10MB/s,速度还是客观的。

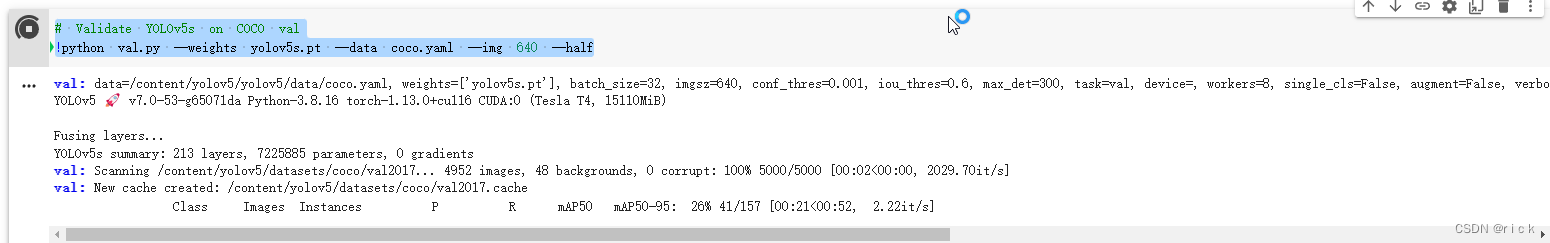

验证

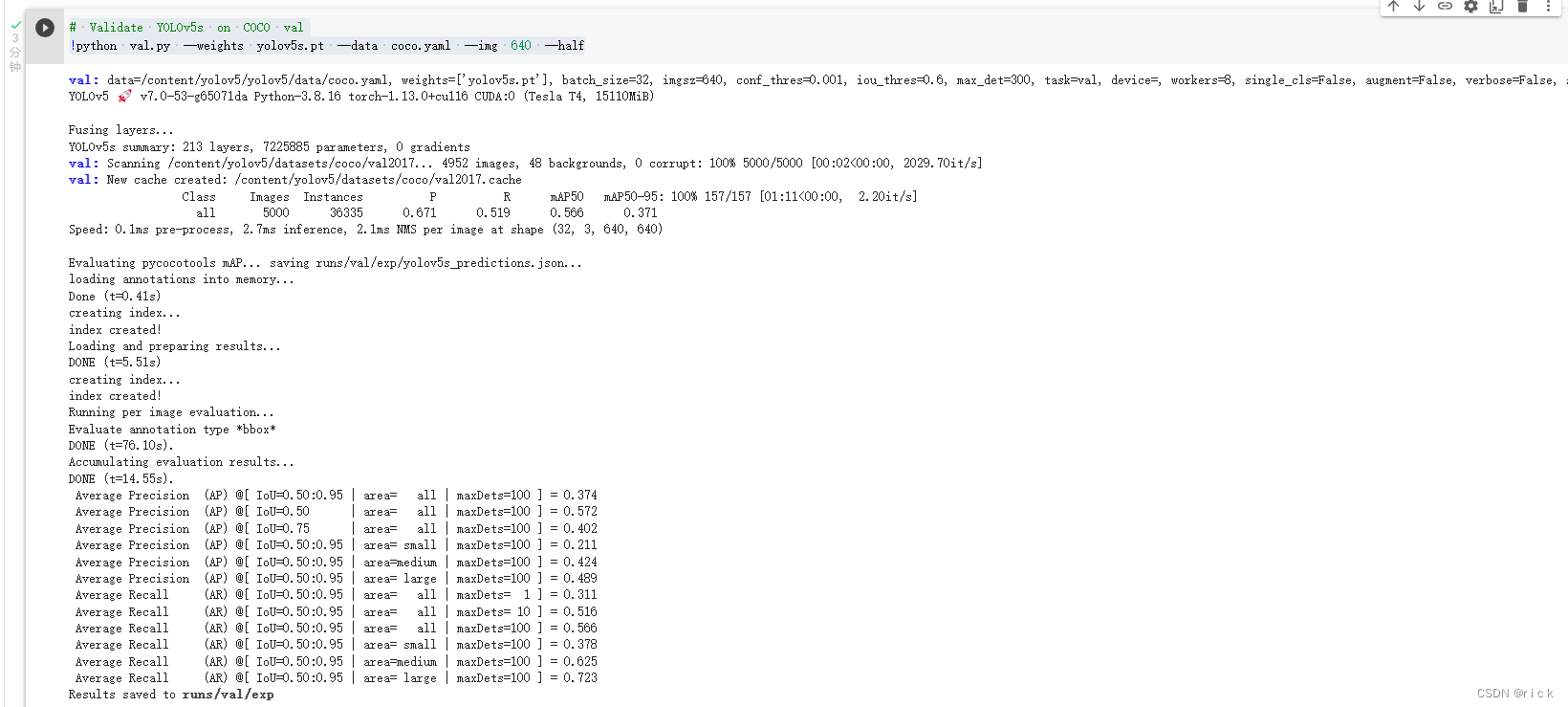

# Validate YOLOv5s on COCO val

!python val.py --weights yolov5s.pt --data coco.yaml --img 640 --half

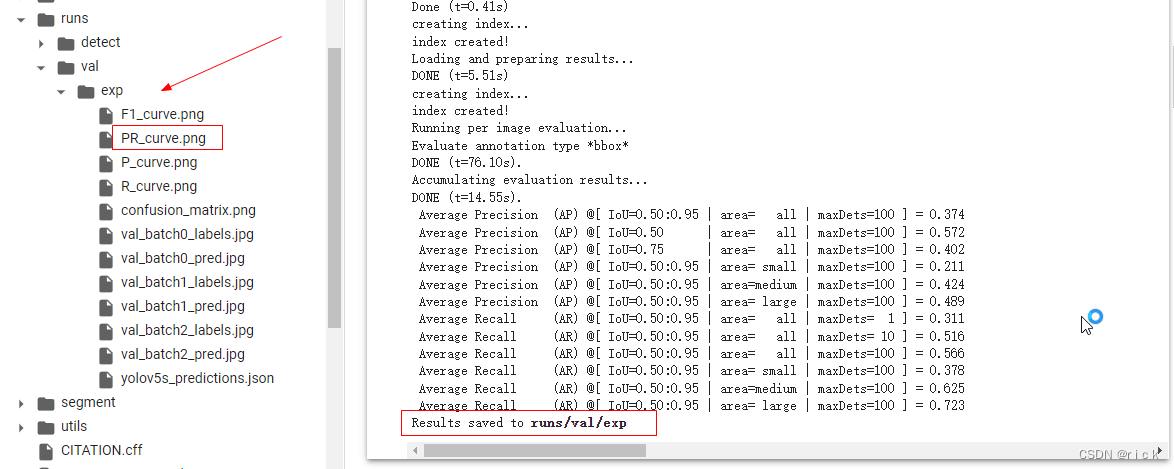

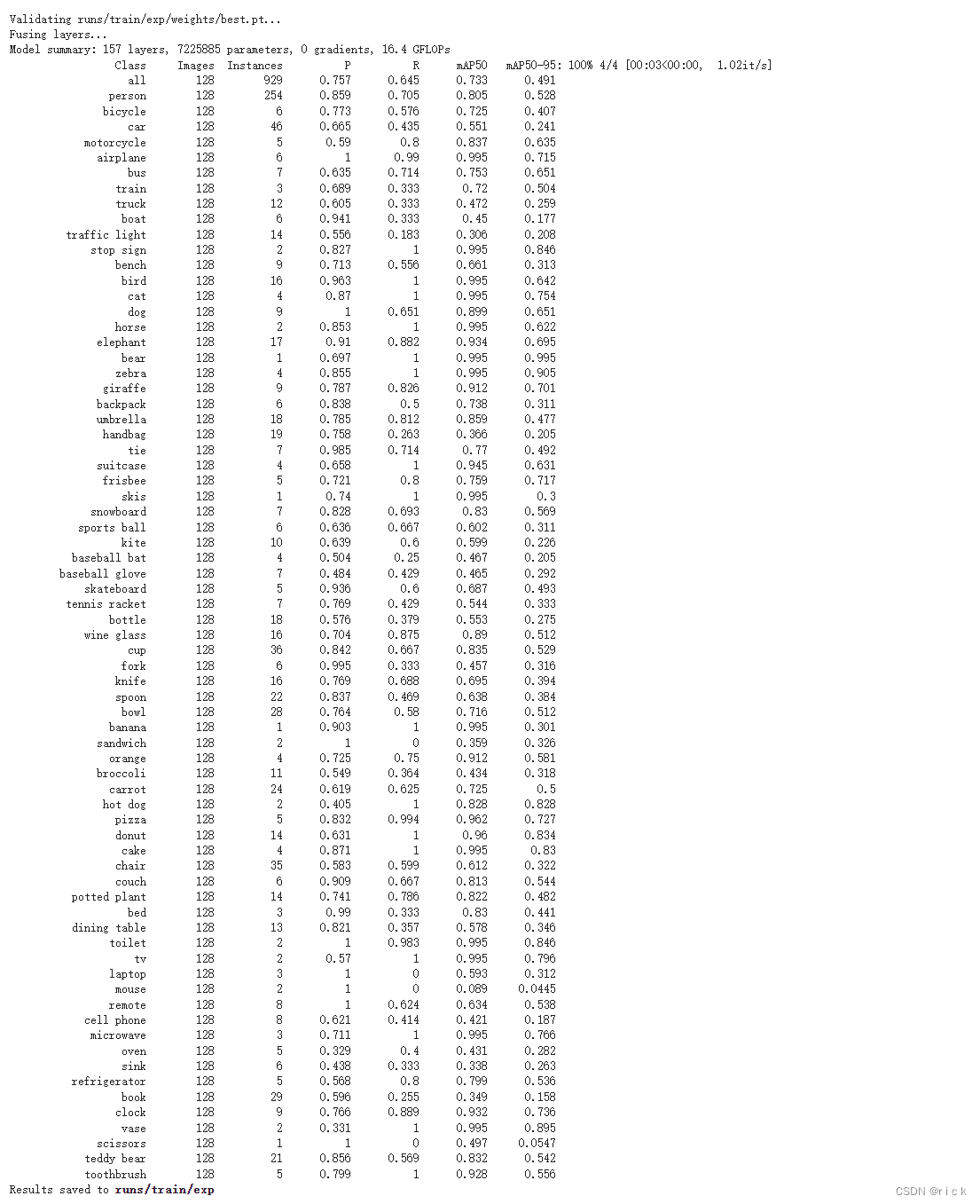

得到验证的结果

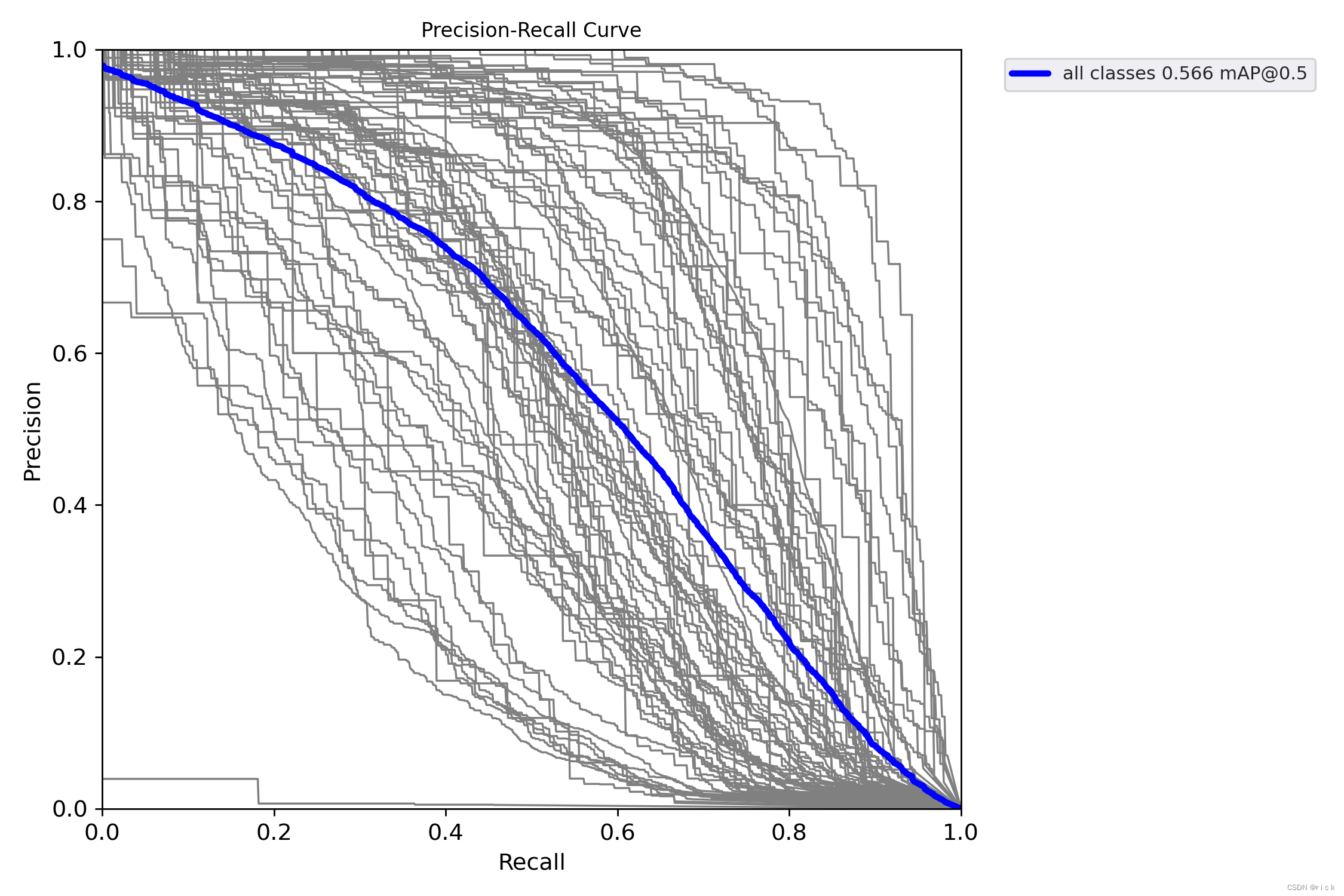

PR曲线

打的标签图片(val_batch0_label.jpg)

验证的图片(val_batch0_pred.jpg)

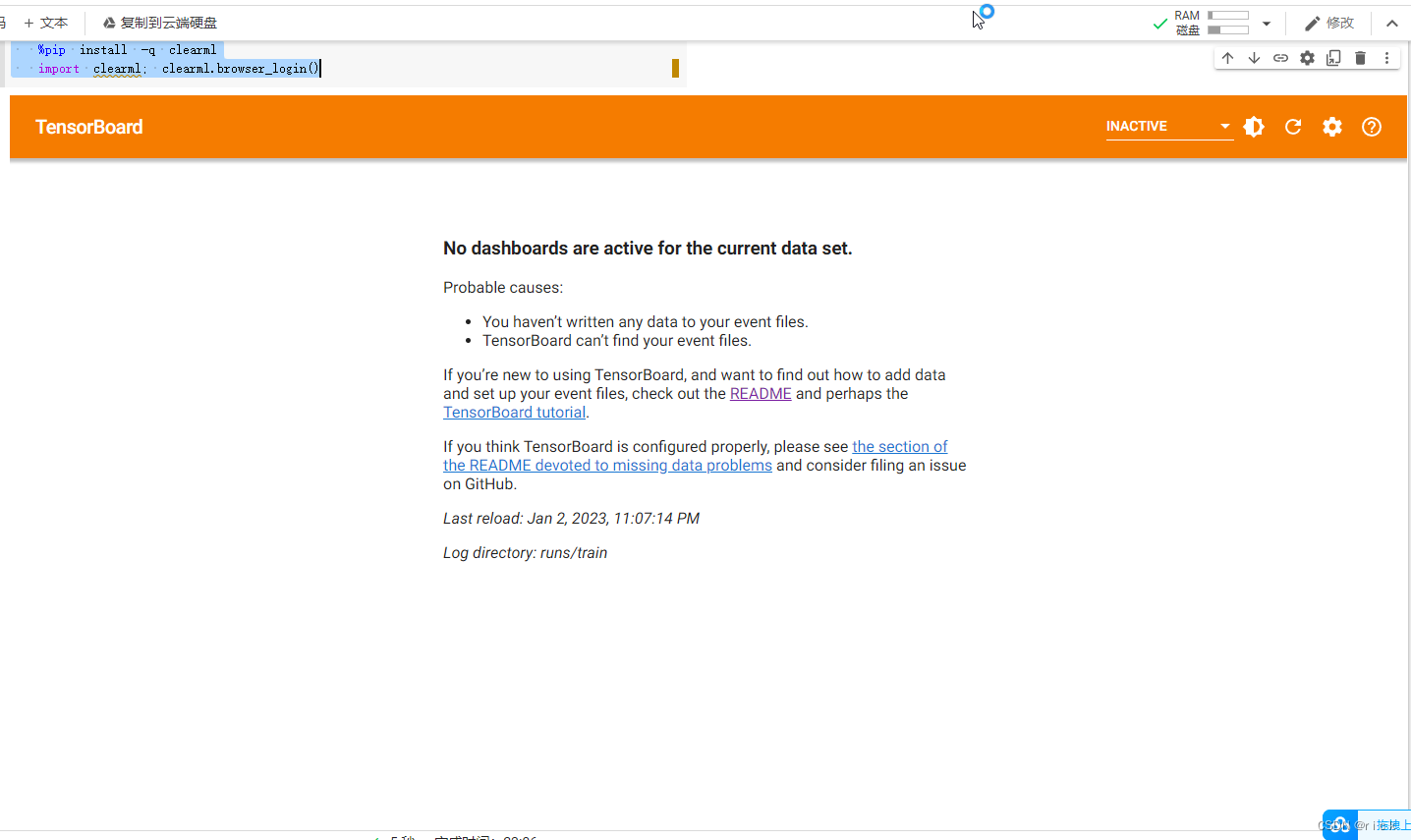

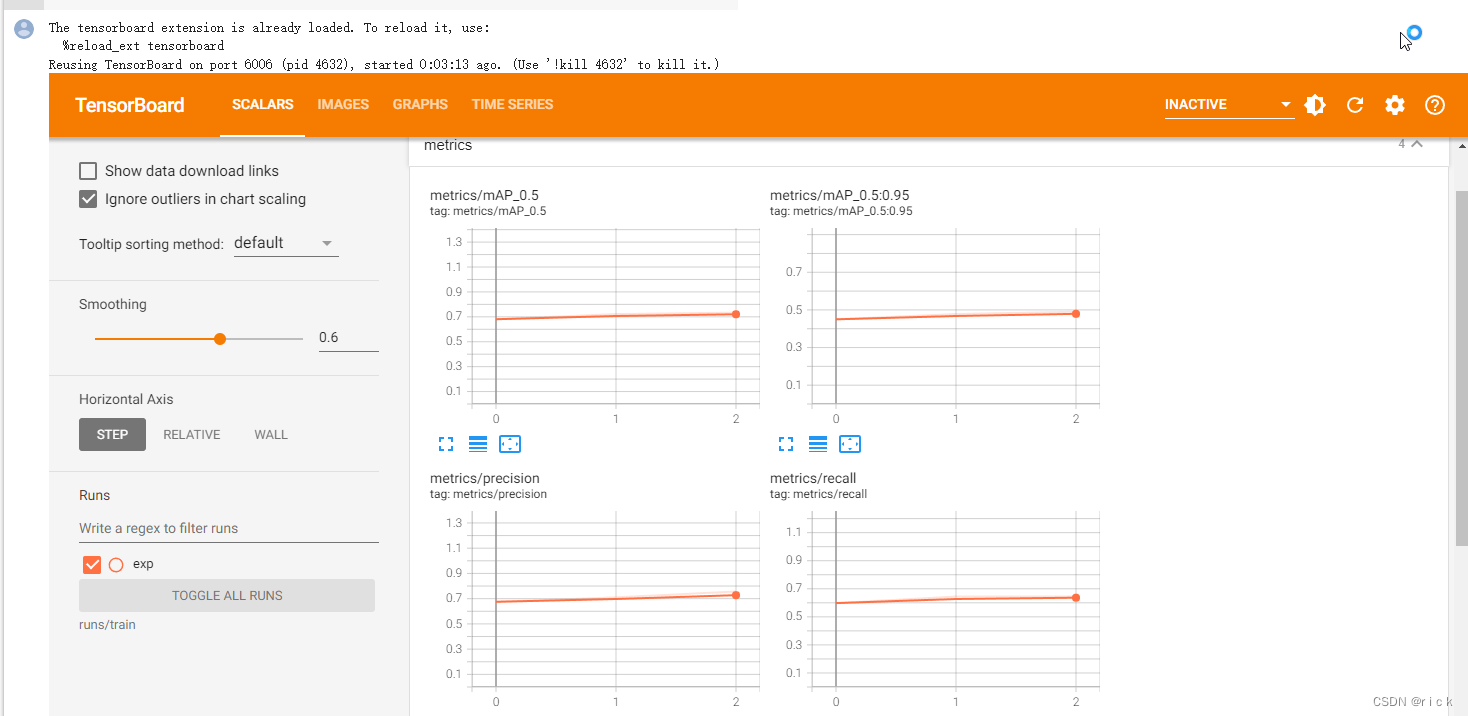

- 步骤四:选择tensorboard可视化结果

#@title Select YOLOv5 🚀 logger {run: 'auto'}

logger = 'TensorBoard' #@param ['TensorBoard', 'Comet', 'ClearML']

if logger == 'TensorBoard':

%load_ext tensorboard

%tensorboard --logdir runs/train

elif logger == 'Comet':

%pip install -q comet_ml

import comet_ml; comet_ml.init()

elif logger == 'ClearML':

%pip install -q clearml

import clearml; clearml.browser_login()

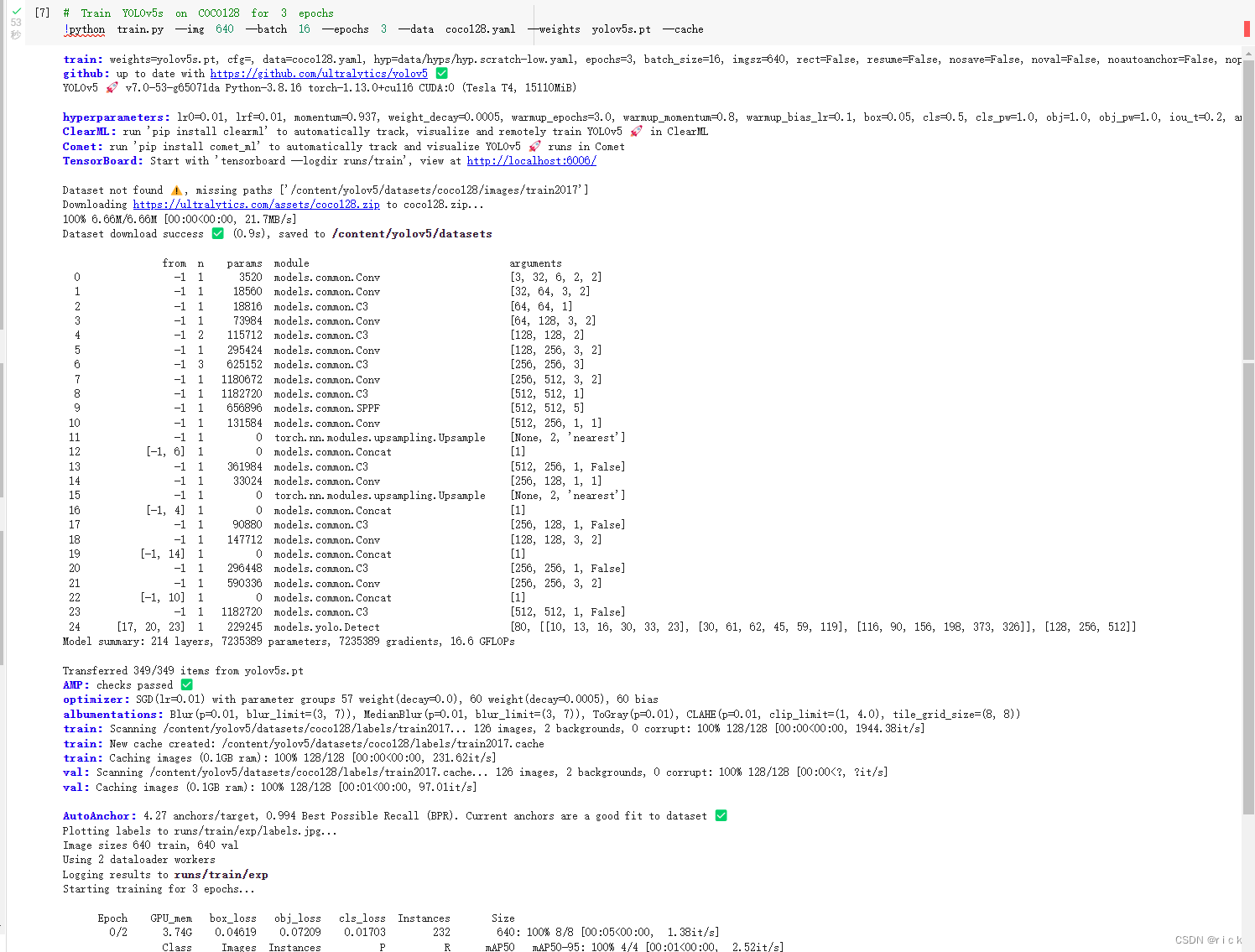

- 步骤五:run起来

# Train YOLOv5s on COCO128 for 3 epochs

!python train.py --img 640 --batch 16 --epochs 3 --data coco128.yaml --weights yolov5s.pt --cache

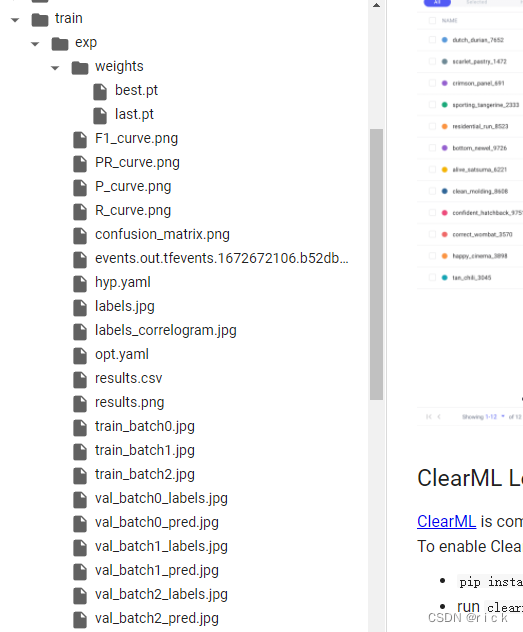

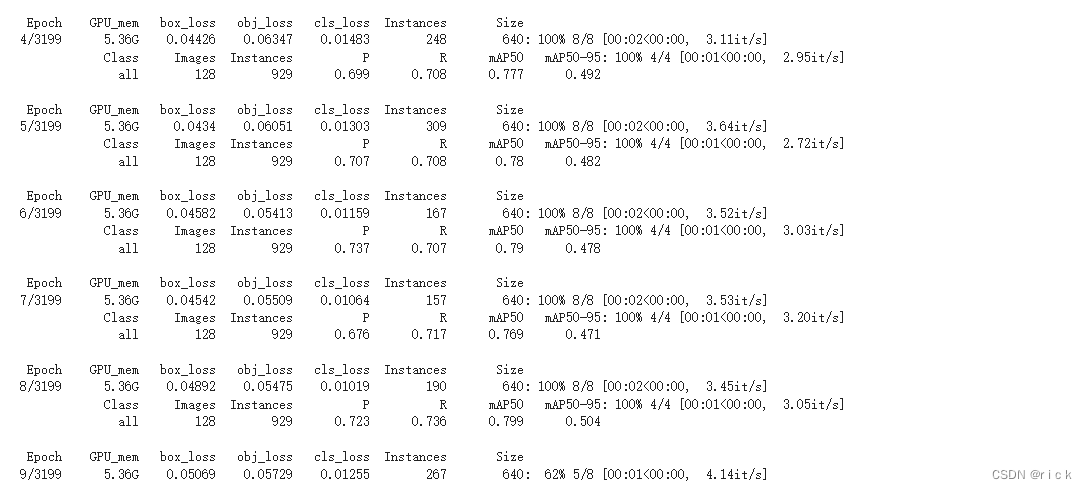

训练三轮后得到可视化结果

修改为训练3200轮试一下

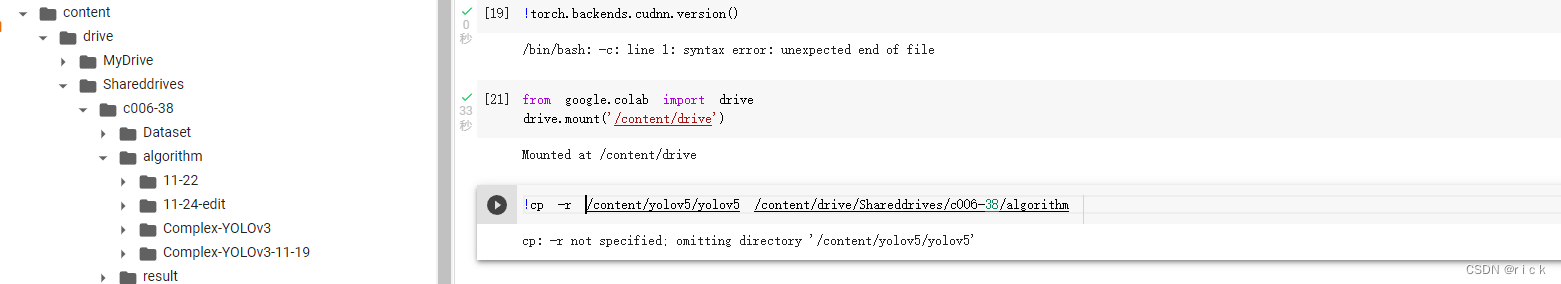

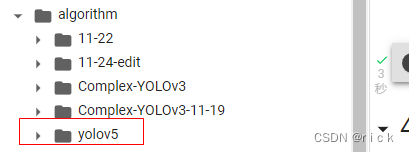

经过以上步骤训练完YoloV4,接下来将结果或代码复制到driver中

!cp -r /content/yolov5/yolov5 /content/drive/Shareddrives/c006-38/algorithm

复制成功

二、使用百度飞浆操作

1.首先,进入百度飞浆官网注册账号。

2. 找到项目:无需Avatarify使用PaddleGAN一键生成多人版 「蚂蚁呀嘿」视频

3. 操作步骤如下:

- 步骤一:启动环境,选择基础版即可

- 步骤二:安装paddlehub

首先我们需要安装PaddleHub,利用其中的face detection功能来定位照片中人脸。

安装方法如下:

!pip install paddlehub==1.6.0

- 步骤三:安装之后paddlehub之后,还需要安装一下人脸检测的模型,命令如下:

!hub install ultra_light_fast_generic_face_detector_1mb_640

- 步骤四:安装PaddleGAN

生成「蚂蚁呀嘿」视频需要用到PaddleGAN套件中的动作迁移功能,所以下一步需要安装PaddleGAN套件。因为我修改了PaddleGAN套件部分代码,这个代码已经保存在AI Studio环境中,直接安装就可以了。也可以从以下地址下载:https://gitee.com/txyugood/PaddleGAN.git

使用以下命令安装PaddleGAN。

%cd /home/aistudio/PaddleGAN/

!pip install -v -e .

-

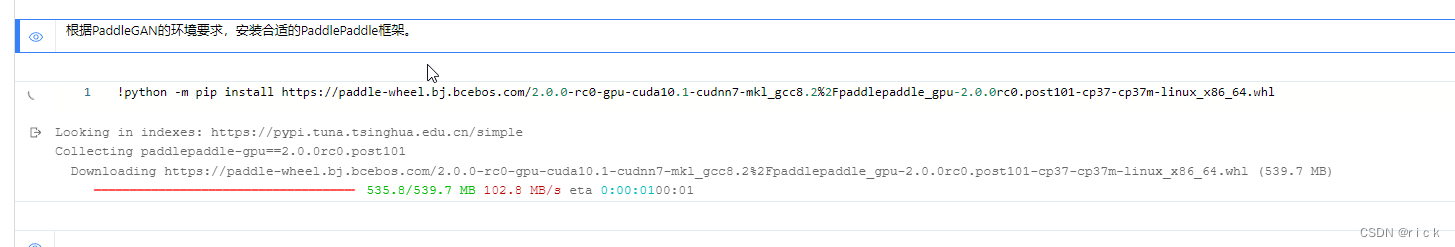

步骤五:根据PaddleGAN的环境要求,安装合适的PaddlePaddle框架。

-

步骤六:运行脚本,得到结果

%cd /home/aistudio/PaddleGAN/applications/

!python -u tools/first-order-mayi.py \

--driving_video /home/aistudio/MaYiYaHei.mp4 \

--source_image /home/aistudio/10.jpg \

--audio_file /home/aistudio/MYYH.mp3 \

--relative --adapt_scale \

--output /home/aistudio/output \

--ratio 1.0

MaYiYaHei

三、

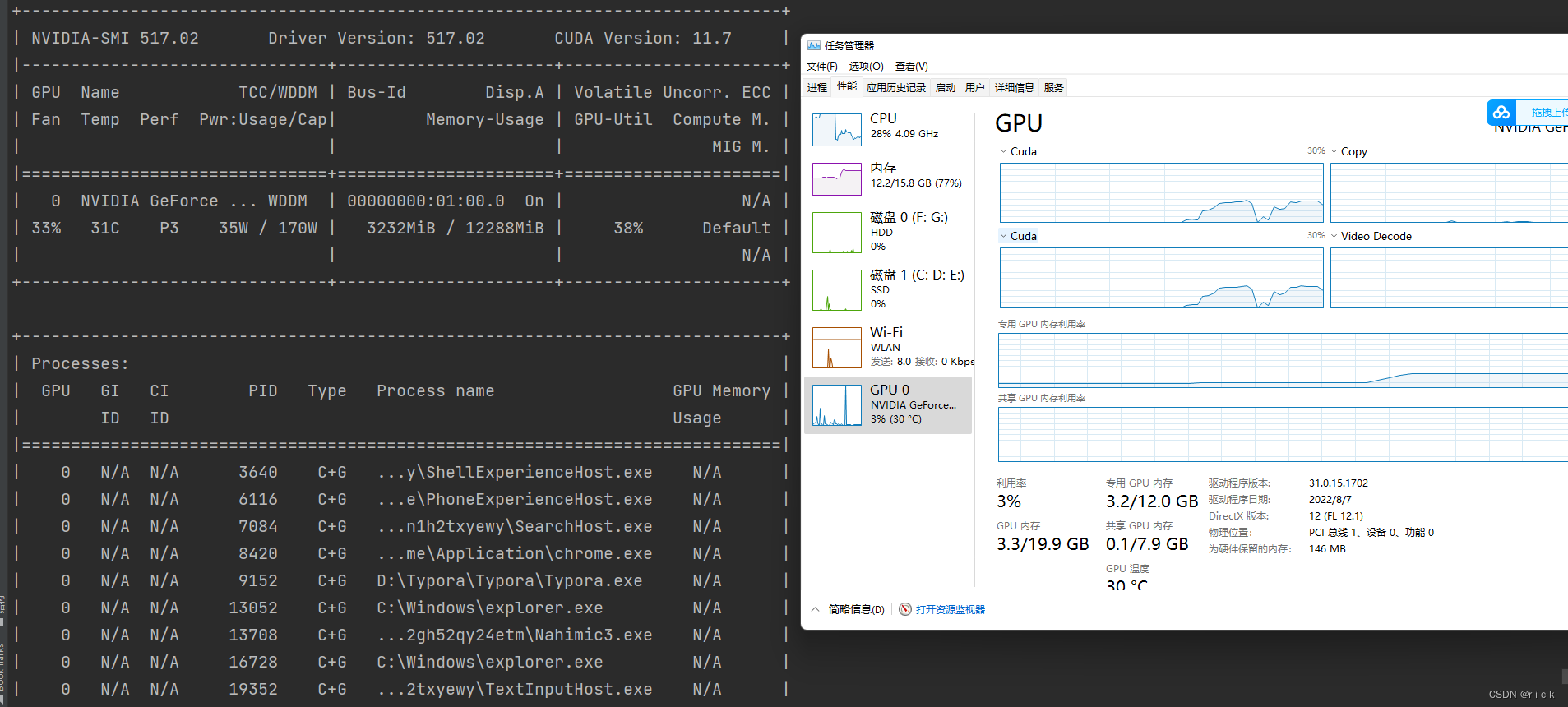

- 在终端用命令查看GPU情况

nvidia-smi -l 1

在任务管理器->性能里面,需要选择cuda查看,默认是3d,看不出来使用情况。

二、使用步骤

1.引入库

代码如下(示例):

import numpy as np

import pandas as pd

import matplotlib.pyplot as plt

import seaborn as sns

import warnings

warnings.filterwarnings('ignore')

import ssl

ssl._create_default_https_context = ssl._create_unverified_context

2.读入数据

代码如下(示例):

data = pd.read_csv(

'https://labfile.oss.aliyuncs.com/courses/1283/adult.data.csv')

print(data.head())

该处使用的url网络请求的数据。

总结

提示:这里对文章进行总结:

例如:以上就是今天要讲的内容,本文仅仅简单介绍了pandas的使用,而pandas提供了大量能使我们快速便捷地处理数据的函数和方法。