1)案例需求:

使用 Flume 监听整个目录的文件,并上传至 HDFS

2)需求分析:

3)实现步骤:

(1)创建配置文件 flume-dir-hdfs.conf

创建一个文件

vim flume-dir-hdfs.conf 添加如下内容

a3.sources = r3

a3.sinks = k3

a3.channels = c3

# Describe/configure the source

a3.sources.r3.type = spooldir

a3.sources.r3.spoolDir = /opt/module/flume/upload

a3.sources.r3.fileSuffix = .COMPLETED

a3.sources.r3.fileHeader = true

#忽略所有以.tmp 结尾的文件,不上传

a3.sources.r3.ignorePattern = ([^ ]*\.tmp)

# Describe the sink

a3.sinks.k3.type = hdfs

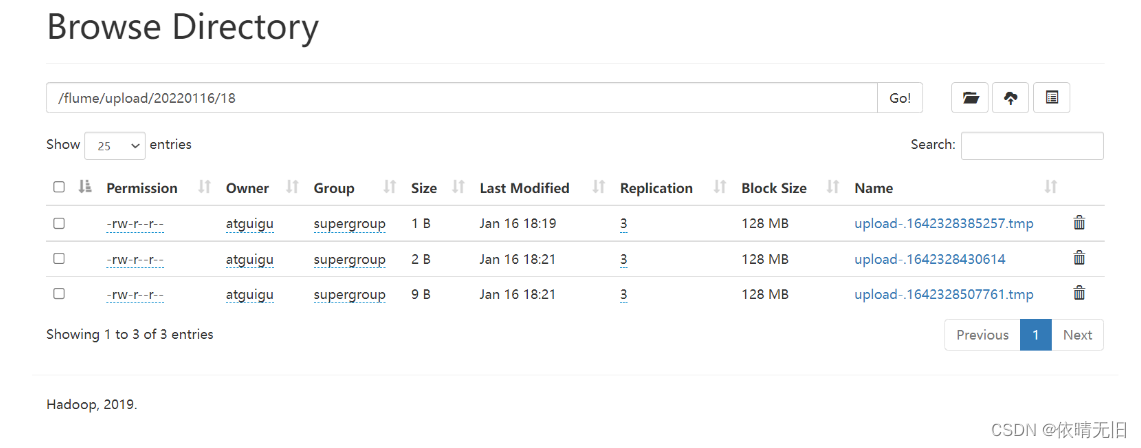

a3.sinks.k3.hdfs.path = hdfs://hadoop100:8020/flume/upload/%Y%m%d/%H

#上传文件的前缀

a3.sinks.k3.hdfs.filePrefix = upload-

#是否按照时间滚动文件夹

a3.sinks.k3.hdfs.round = true

#多少时间单位创建一个新的文件夹

a3.sinks.k3.hdfs.roundValue = 1

#重新定义时间单位

a3.sinks.k3.hdfs.roundUnit = hour

#是否使用本地时间戳

a3.sinks.k3.hdfs.useLocalTimeStamp = true

#积攒多少个 Event 才 flush 到 HDFS 一次

a3.sinks.k3.hdfs.batchSize = 100

#设置文件类型,可支持压缩

a3.sinks.k3.hdfs.fileType = DataStream

#多久生成一个新的文件

a3.sinks.k3.hdfs.rollInterval = 60

#设置每个文件的滚动大小大概是 128M

a3.sinks.k3.hdfs.rollSize = 134217700

#文件的滚动与 Event 数量无关

a3.sinks.k3.hdfs.rollCount = 0

# Use a channel which buffers events in memory

a3.channels.c3.type = memory

a3.channels.c3.capacity = 1000

a3.channels.c3.transactionCapacity = 100

# Bind the source and sink to the channel

a3.sources.r3.channels = c3

a3.sinks.k3.channel = c3

(2)启动监控文件夹命令

bin/flume-ng agent --conf conf/ --name a3 --conf-file job/flume-dir-hdfs.conf 说明:在使用 Spooling Directory Source 时,不要在监控目录中创建并持续修改文件;上传完成的文件会以.COMPLETED 结尾;被监控文件夹每 500 毫秒扫描一次文件变动。

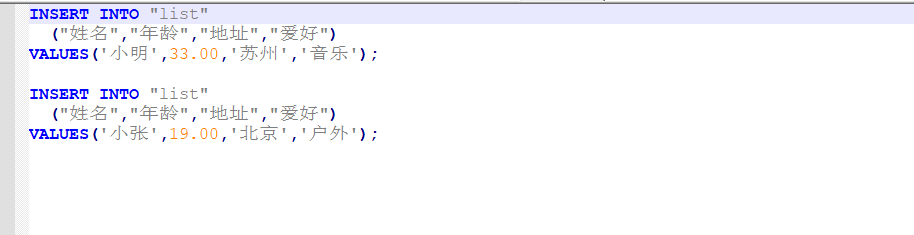

(3)向 upload 文件夹中添加文件

在/opt/module/flume 目录下创建 upload 文件夹

[root@hadoop100 flume]$ mkdir upload向 upload 文件夹中添加文件

[root@hadoop100 upload]$ touch atguigu.txt

[root@hadoop100 upload]$ touch atguigu.tmp

[root@hadoop100 upload]$ touch atguigu.log(4)查看 HDFS 上的数据

flume只会上传新目录,.tmp文件不会上传,自己加的.COMPLETED也不会上传。同时已经上传了的文件再修改upload文件里面的内容,hdfs是不会同步内容的。如果删除upload文件中的文件,在创建同名的,flume只会把它当作一个新文件上传到hdfs,不会覆盖原来同名的文件。

- Exec:不能断点续传

- spooldir:不能监控动态变化的文件