1. 摘要

对抗训练在单图像超分辨率任务中非常成功,因为它可以获得逼真、高度细致的输出结果。因此,当前最优的视频超分辨率方法仍然支持较简单的范数(如 L2)作为对抗损失函数。直接向量范数作损失函数求平均的本质可以轻松带来时间流畅度和连贯度,但生成图像缺乏空间细节。该研究提出了一种用于视频超分辨率的对抗训练方法,可以使分辨率具备时间连贯度,同时不会损失空间细节。

该研究聚焦于新型损失的形成,并基于已构建的生成器框架展示了其性能。研究者证明时间对抗学习是获得照片级真实度和时间连贯细节的关键。除了时空判别器以外,研究者还提出新型损失函数 Ping-Pong,该函数可以有效移除循环网络中的时间伪影,且不会降低视觉质量。之前的研究并未解决量化视频超分辨率任务中时间连贯度的问题。该研究提出了一组指标来评估准确率和随时间变化的视觉质量。用户调研结果与这些指标判断的结果一致。总之,该方法优于之前的研究,它能够得到更加细节化的图像,同时时间变化更加自然。

2. 模型方法

该研究提出的 VSR 架构包含三个组件:循环生成器、流估计网络和时空判别器。生成器 G 基于低分辨率输入循环地生成高分辨率视频帧。流估计网络 F 学习帧与帧之间的动态补偿,以帮助生成器和时空判别器

D

s

,

t

D_s,t

Ds,t。

训练过程中,生成器和流估计器一起训练,以欺骗时空判别器

D

s

,

t

D_s,t

Ds,t。该判别器是核心组件,因为它既考虑空间因素又考虑时间因素,并对存在不现实的时间不连贯性的结果进行惩罚。这样,就需要 G 来生成与之前帧连续的高频细节。训练完成后,

D

s

,

t

D_s,t

Ds,t 的额外复杂度不会有什么影响,除非需要 G 和 F 的训练模型来推断新的超分辨率视频输出。

图 2:具备动态补偿(motion compensation)的循环生成器。

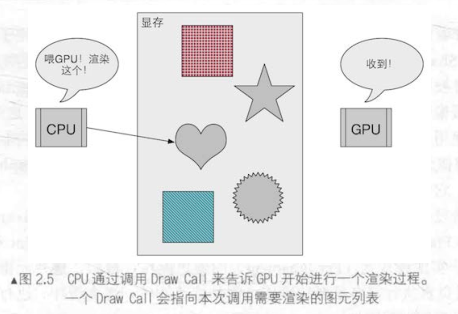

该研究提出的判别器结构如图 3 所示。它接收了两组输入:真值和生成结果。

图 3:时空判别器的输入。

3. 损失函数

为了移除不想要的细节长期漂移,研究者提出一种新型损失函数「Ping-Pong」(PP) 损失。

图 4:a)不使用 PP 损失训练出的结果。b)使用 PP 损失训练出的结果。后者成功移除了漂移伪影(drifting artifact)。

如图 4b 所示,PP 损失成功移除了漂移伪影,同时保留了适当的高频细节。此外,这种损失结构可以有效增加训练数据集的规模,是一种有用的数据增强方式。

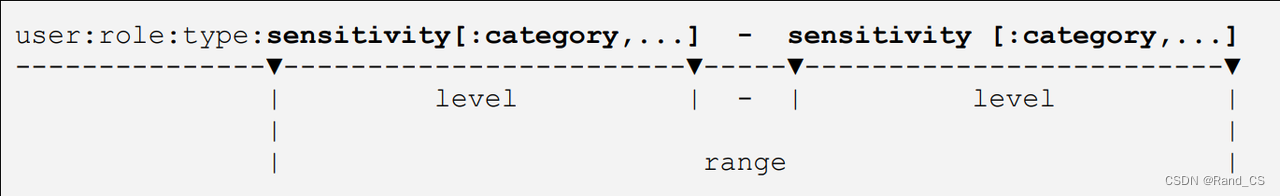

该研究使用具备 ping-pong ordering 的扩展序列来训练网络,如图 5 所示。即最终附加了逆转版本,该版本将两个「leg」的生成输出保持一致。PP 损失的公式如下所示:

图 5:使用该研究提出的 Ping-Pong 损失,

g

t

g_t

gt 和之间的

L

2

L_2

L2 距离得到最小化,以移除漂移伪影、改进时间连贯度。

4. 实验结果

研究者通过控制变量研究说明了

L

(

G

,

F

)

L_(G,F)

L(G,F) 中单个损失项的效果。

图 6:树叶场景对比。对抗模型(ENet、DsOnly、DsDt、DsDtPP、TecoGAN)。

![[线代]不挂科猴博士](https://img-blog.csdnimg.cn/direct/015ddc93d75141cf8c190dbd0f3aaa6f.png)