12月14日,著名生成式AI开源平台Stability.ai在官网开源了,图片生成高质量3D模型——Stable Zero123。

Stable Zero123是基于今年3月,丰田研究院和哥伦比亚大学联合开源的Zero123模型开发而成。主要通过更改渲染数据集和分数蒸馏对模型进行了大幅度优化,不仅生成的3D模型效果比Zero123更好,训练效率也提升了40倍。

值得一提的是,Stable Zero123可以与Stability.ai最新开源的高精准图片模型SDXL相结合使用,相当于3D模型扩展插件。

Stable Zero123开源地址:https://huggingface.co/stabilityai/stable-zero123

zero123开源地址:https://github.com/cvlab-columbia/zero123

zero123论文:https://arxiv.org/abs/2303.11328

Stable Zero123生成的3D模型示例

高质量数据集

高质量数据集已成为预训练大模型的重要环节之一,甚至超过了更多的神经元。

所以,Stability.ai对一个超过1000万个3D模型数据集Objaverse-XL进行了过滤,只保留高质量、精准、数据标注准确的模型。

这可以让Stable Zero123在生成的过程中更好的理解和生成3D模型。Zero123的最新模型XL也是基于该数据集训练而成。

Objaverse-XL地址:https://github.com/allenai/objaverse-xl

Stable Zero123简单介绍

由于Stable Zero123暂时没有开放论文,只能用Zero123为大家解读了。

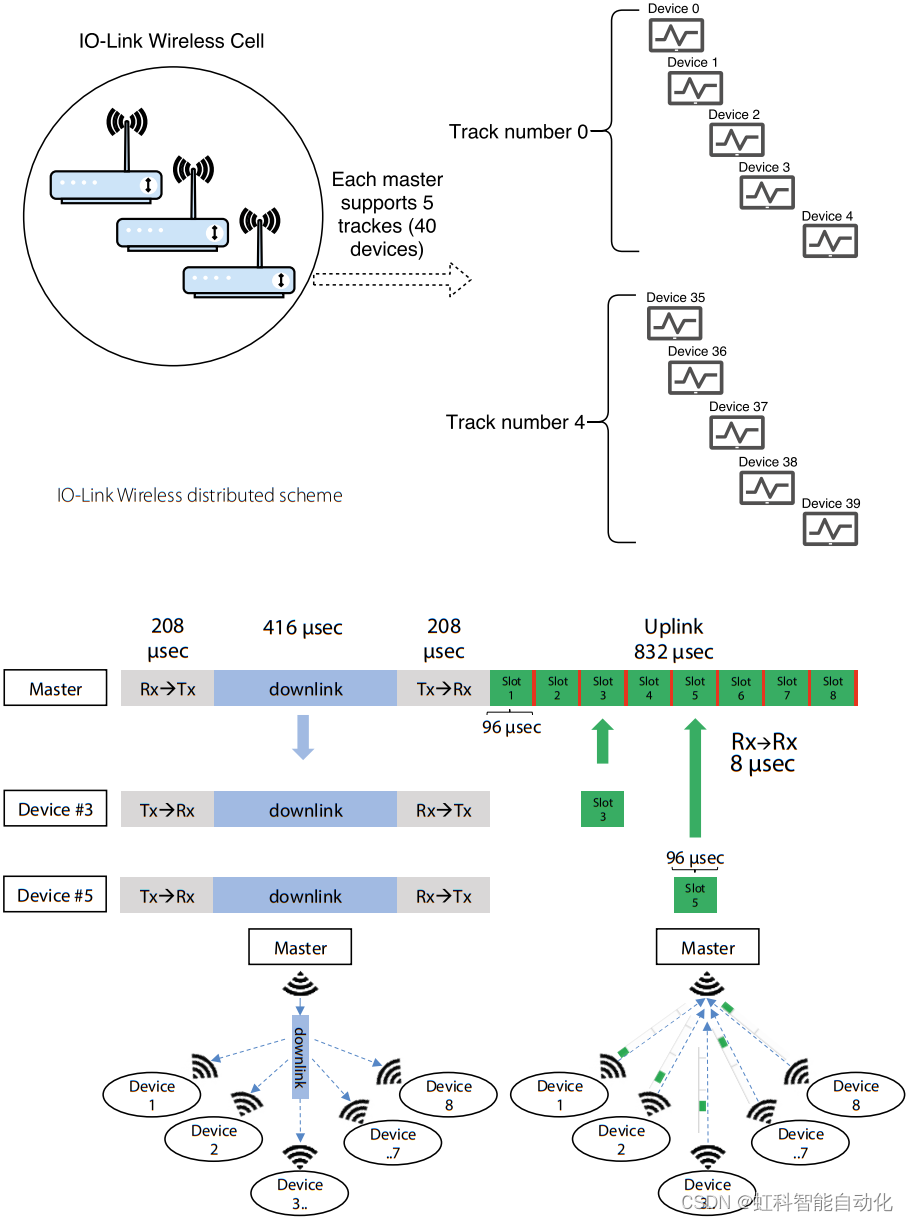

其实这两个模型挺有意思的是互相学习。Zero123是基于Stability.ai开源的文生图模型Stable Diffusion进行了创新、微调,使其学会了控制相机的相对视角变换,然后基于视角的扩散方法进行去噪,最后使用3D重建方法进行模型重塑。

学习控制相机视角:Zero123通过一个合成数据集微调预训练了Stable Diffusion模型,使其学会相对相机视角变换的控制,而不破坏模型中的其他表示。

基于视角的扩散:将图像的CLIP嵌入与相对视角变换拼接作为条件信息,指导去噪过程。同时也将输入图像与正在去噪的图像拼接,帮助保持目标物体的识别度和细节。

两款模型生成效果的细节对比

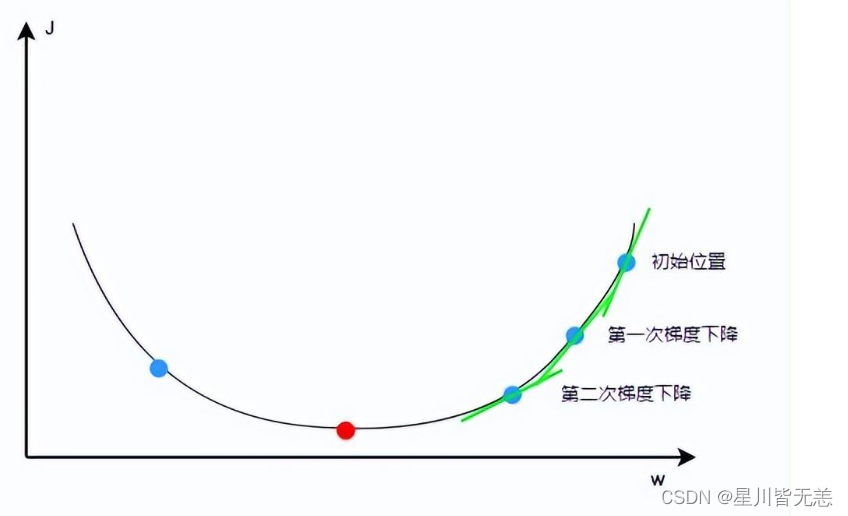

3D模型重建:通过SJC优化一个体素辐射场表示,并使用基于视角的扩散模型进行监督。随机采样视角,利用Zero123合成对应视角下的图像,计算图像与体素渲染结果之间的得分,更新体素场。

这就能使Stable Diffusion模型输出的丰富2D纹理和形状,被完美地注入到了3D建模的过程中,形成3D模型。

目前,Stable Zero123模型主要用于研究,未来会开放商用。

![leetcode -- 209 长度最小的子数组[滑动窗口/c++]](https://img-blog.csdnimg.cn/img_convert/240484095d0029dfbce6e0b4e998c6eb.png)