基于Transformer的U型医学图像分割网络综述

论文来自 计算机应用 2023

摘 要:目前,医学图像分割模型广泛采用基于全卷积网络(FCN)的U型网络(U-Net)作为骨干网,但卷积神经网络(CNN)在捕捉长距离依赖能力上的劣势限制了分割模型性能的进一步提升。针对上述问题,研究者们将Transformer应用到医学图像分割模型中以弥补CNN的不足,结合Transformer和U型结构的分割网络成为研究热点之一。在详细介绍U-Net和Transformer之后,按医学图像分割模型中Transformer模块所处的位置,包括仅在编码器或解码器、同时在编码器和解码器、作为过渡连接和其他位置进行分类,讨论各模型的基本内容、设计理念以及可改进的地方,并分析了 Transformer处于不同位置的优缺点。根据分析结果可知,决定 Transformer所在位置的最大因素是目标分割任务的特点,而且 Transformer结合 U-Net的分割模型能更好地利用 CNN 和 Transformer各自的优势,提高模型的分割性能,具有较大的发展前景和研究价值。

Transformer

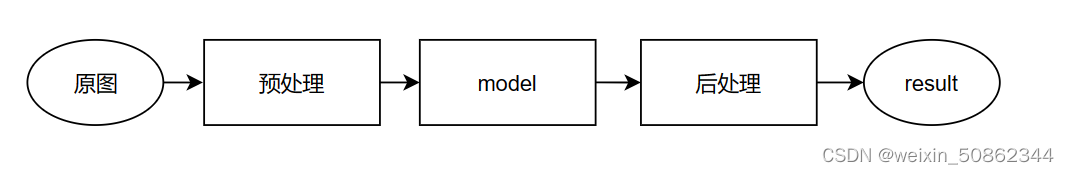

Vaswani等首次提出 Transformer,因其独特的设计赋予了 Transformer 能处理不定长输入、捕捉长距离依赖和序列到序列(seq2seq)任务的特性。Transformer 主要包含解码器和编码器,每个编码器包括位置编码、多头注意力机制、层正则化(Layer Normalization,LN)、前馈神经网络(Feed Forward Network, FFN)和跳跃连接,而解码器除在输入层增加了一个掩码多头注意力机制以外,其余部分与编码器相同。Transformer结构如下图所示。

主要模块

主要模块

好的,下面是 Transformer 模型中的关键组件和公式:

-

位置编码(Positional Encoding):

位置编码的作用是为输入序列中的每个位置添加一个表示其位置的向量。这是因为 Transformer 不考虑序列的顺序信息,而位置编码能够为模型提供关于词语在序列中相对位置的信息。

具体位置编码的公式为:

P E ( p o s , 2 i ) = sin ( p o s 1000 0 2 i / d model ) PE(pos, 2i) = \sin\left(\frac{{pos}}{{10000^{2i/d_{\text{model}}}}}\right) PE(pos,2i)=sin(100002i/dmodelpos)

P E ( p o s , 2 i + 1 ) = cos ( p o s 1000 0 2 i / d model ) PE(pos, 2i + 1) = \cos\left(\frac{{pos}}{{10000^{2i/d_{\text{model}}}}}\right) PE(pos,2i+1)=cos(100002i/dmodelpos)其中 p o s pos pos 是位置, i i i是维度, d model d_{\text{model}} dmodel是模型的维度。

-

自注意力机制(Scaled Dot-Product Attention):

给定一个查询向量 Q Q Q、一个键向量 K K K 和一个数值向量 V V V,自注意力机制计算加权和,其中权重由查询和键之间的相似度确定:

Attention ( Q , K , V ) = softmax ( Q K T d k ) V \text{Attention}(Q, K, V) = \text{softmax}\left(\frac{{QK^T}}{{\sqrt{d_k}}}\right) V Attention(Q,K,V)=softmax(dkQKT)V其中 d k d_k dk 是键向量的维度。

-

多头注意力(Multi-Head Attention):

多头注意力通过并行运行多个自注意力机制,并将它们的输出连接在一起。这可以学习多个不同的表示空间,有助于模型更全面地捕捉序列信息。

MultiHead ( Q , K , V ) = Concat ( head 1 , … , head h ) W O \text{MultiHead}(Q, K, V) = \text{Concat}(\text{head}_1, \ldots, \text{head}_h)W_O MultiHead(Q,K,V)=Concat(head1,…,headh)WO其中 head i = Attention ( Q W Q i , K W K i , V W V i ) \text{head}_i = \text{Attention}(QW_{Qi}, KW_{Ki}, VW_{Vi}) headi=Attention(QWQi,KWKi,VWVi), W Q i W_{Qi} WQi、 W K i W_{Ki} WKi、 W V i W_{Vi} WVi 和 W O W_O WO是权重矩阵。

-

前馈神经网络(Feedforward Neural Network):

前馈神经网络由两个线性变换和一个激活函数组成:

FFN ( x ) = max ( 0 , x W 1 + b 1 ) W 2 + b 2 \text{FFN}(x) = \max(0, xW_1 + b_1)W_2 + b_2 FFN(x)=max(0,xW1+b1)W2+b2其中 W 1 W_1 W1、 b 1 b_1 b1、 W 2 W_2 W2 和 b 2 b_2 b2 是权重矩阵和偏置。

-

残差连接和层归一化(Residual Connections and Layer Normalization):

在每个子层(如自注意力、前馈神经网络)的输出上应用残差连接和层归一化:

LayerNorm ( x + Sublayer ( x ) ) \text{LayerNorm}(x + \text{Sublayer}(x)) LayerNorm(x+Sublayer(x))

残差连接使梯度更容易流过网络,层归一化有助于稳定训练。

以上是 Transformer 模型中的一些关键组件和公式。这些公式提供了模型如何计算自注意力、前馈神经网络等操作的具体细节。请注意,这里给出的是一般形式,实际应用中可能会有一些变种或调整。

Swin Transformer 是一种基于 Transformer 架构的深度学习模型,特别适用于计算机视觉任务。它采用了一种新颖的层次化的窗口注意力机制,以及分层的、分组的感受野设计,以更好地处理图像的全局和局部信息。Swin Transformer 的名称"Swin"即来源于"窗口注意力"(Window Attention)的缩写。

Swin Transformer 的一些关键特点:

- 层次化窗口注意力(Hierarchical Window Attention):

Swin Transformer 引入了层次化的窗口注意力机制,将输入图像分割成多个窗口,每个窗口进行自注意力计算。然后通过窗口间的交互来获取全局信息。这种窗口化的设计使得模型能够更有效地处理大尺寸图像。 - 分层感受野(Hierarchical Receptive Field):

Swin Transformer 通过堆叠不同层次的块,每个块内使用局部的窗口注意力,实现对多尺度信息的建模。这种分层的感受野设计使得模型能够同时捕捉图像的全局和局部结构。 - 小型窗口的计算效率:

为了降低计算复杂度,Swin Transformer 使用了小型的窗口,从而减小了窗口注意力的计算量。这使得 Swin Transformer 能够在处理大图像时保持较低的计算开销。 - 深度和宽度:

Swin Transformer 通过堆叠多个Swin Block,增加深度,并通过分组卷积实现较大的宽度。这种结构增加了模型的表示能力。

Swin Transformer 的窗口注意力机制和感受野设计使得它在处理大尺寸图像时能够取得较好的性能,尤其在计算机视觉领域的任务中表现出色,比如图像分类、目标检测等。