1. 图神经网络概念

https://cloud.tencent.com/developer/article/2334518?areaId=106001

https://blog.csdn.net/qq_44689178?type=blog; 先参考阅读这篇博主;

该文献中,介绍了 多视图 的 图神经网络的学习;

以及多视图 图神经网络的 对比学习,

需要阅读;

Deep multi-view learning methods: A review

Xiaoqiang Yan a, Shizhe Hu a, Yiqiao Mao a, Yangdong Ye a,⇑, HuiYu b,⇑

a School of Information Engineering, Zhengzhou University, Zhengzhou 450052, China

b School of Creative Technologies, University of Portsmouth, PO1 2DJ, United Kingdom

1.1 基本概念

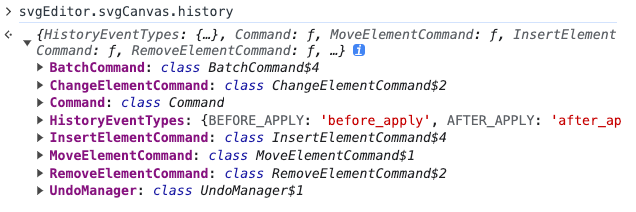

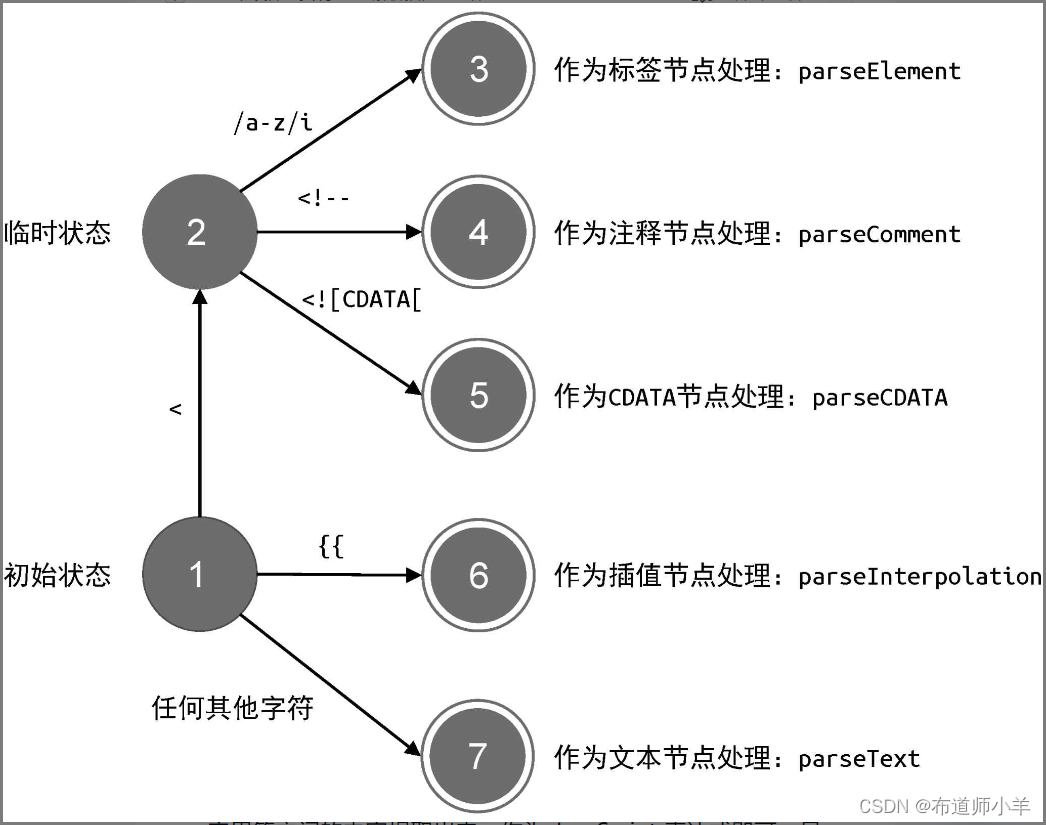

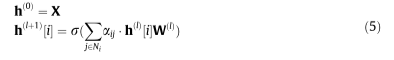

图神经网络(Graph neural networks, GNN)[73]在学习表示方面协调了图在建模交互中与深度模型的表达能力,并因其对图结构数据的建模能力而受到越来越多的关注。他们处理变大小的置换不变图,并通过从拓扑邻居传递、转换和聚合表示的迭代过程来学习低维表示。近年来,GNN在图结构数据分析方面表现突出,如社会网络[74]和知识图[75]。首先,我们简要回顾了GNN的基本背景知识。设G¼fV;Eg表示图形,表示GNN的输入数据,变量V¼fvig和E¼feijg表示节点和边的集合。每条边eij¼ðvi;VjÞ连接vi和vj,每个节点vi包含一个表示其属性的特性xi。GNN的聚合过程可以表示为:

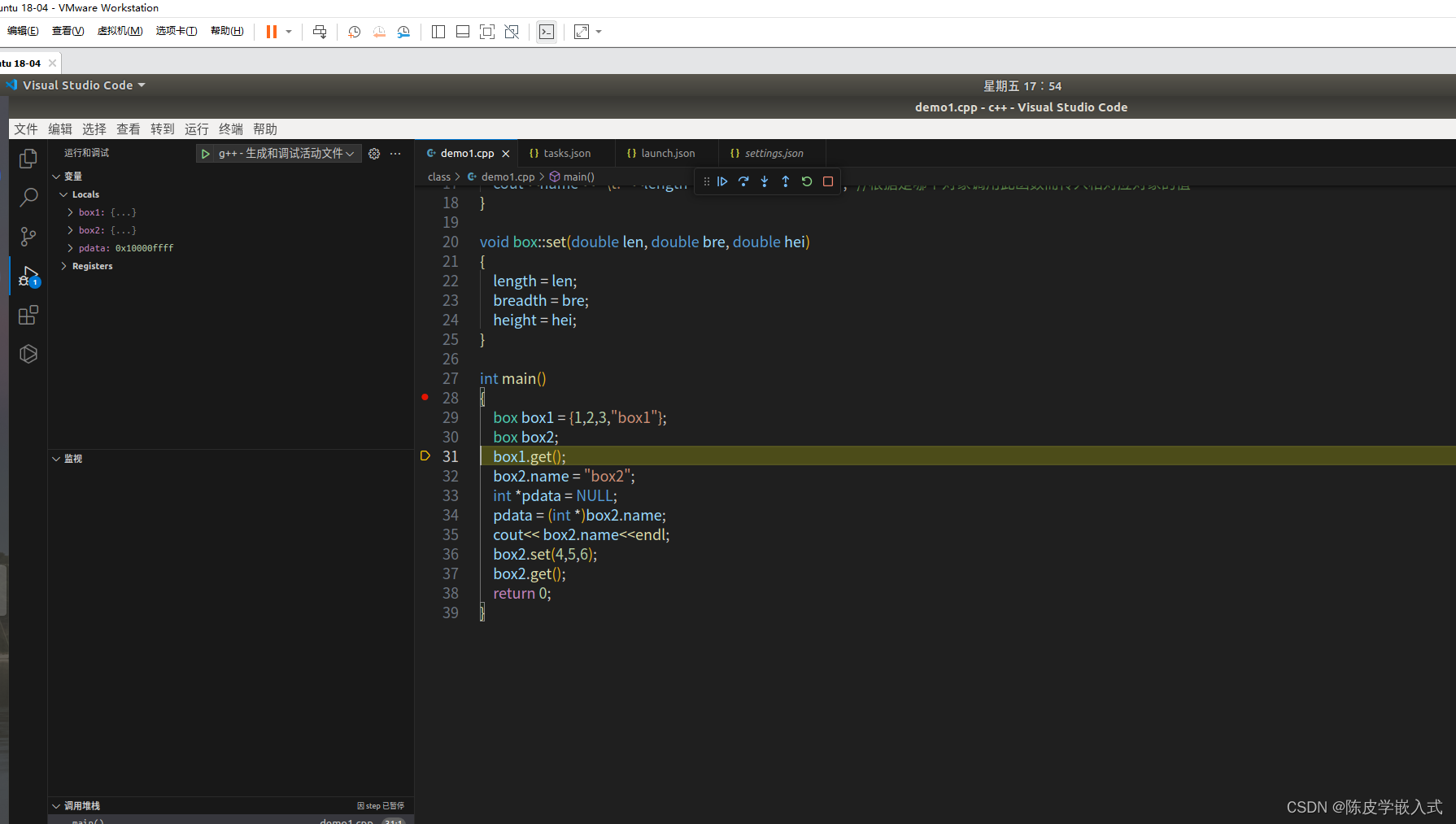

其中,变量X表示图G中所有节点的输入特征;r为类似Relu的非线性函数,hðlÞ½i表示节点i在第l层的隐藏特征,a为邻接矩阵的变体,WðlÞ为可学习线性转移矩阵。

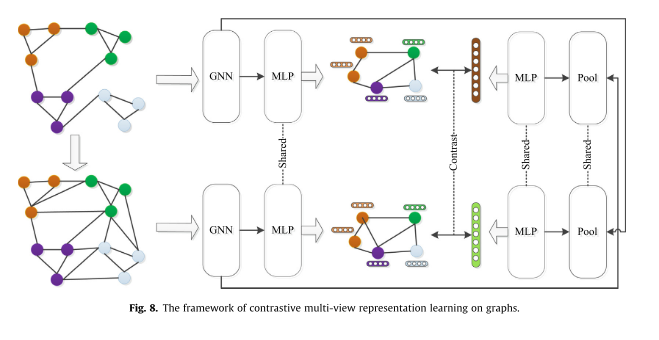

近年来,GNN在MVL场景中也取得了很好的性能,如多图聚类和多视图图传统网络。我们以图的多视图表示学习为例。Hassani等人[76]提出了一种基于图的对比性多视图特征学习方法,该方法表明将视图数量增加到2个以上并不能提高性能。

在图神经网络学习中, 将视图的数量提高两个以上, 使用对比学习时,并不能提高更好的性能。

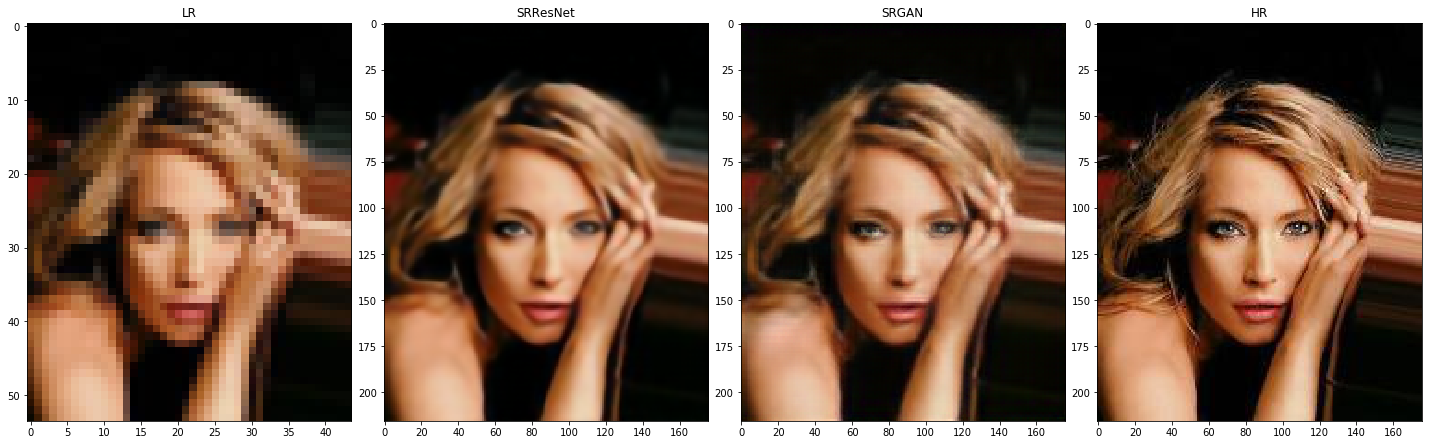

如图8所示,本文模型在节点和图的两个层次上进行。首先,采用图扩散方法创建目标视图的附加图视图,并将其馈送给两个gnn,随后使用共享多层感知器(MLP)学习节点表示。然后,学习到的特征表示被输入到一个图池中,后面跟着一个共享的MLP来学习图表示

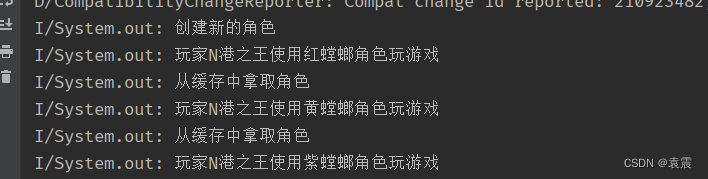

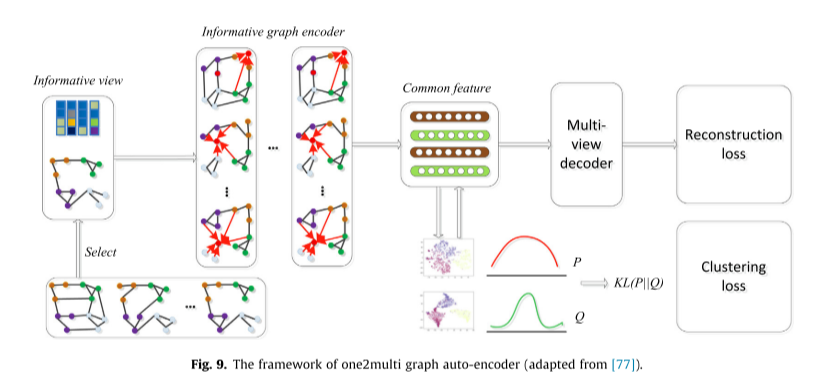

基于GNN的多图聚类是一个活跃的研究方向,近年来得到了广泛的关注。如Fan等[77]设计了一种one2multi图自动编码器,该编码器能够利用内容信息从多个视图重构图结构,学习节点嵌入。该模型由两个主要部分组成:多图自动编码器和图的自监督聚类机制。

如图9所示,one2multi由一个基于图的编码器体系结构和一个基于图的多视图解码器体系结构组成,其中信息最丰富的视图通过启发式度量模块来选择。

以全球贫困分析、分子性质预测、多视角相机再定位和压缩伪影抑制为例,对多视角GNN的应用进行了综述。Khan等[78]提出了一种卷积算法基于图结构的网络分析全球贫困状况。这种方法被应用于三项任务:(1)预测金融包容性的采用;(2) 预测一个人是否生活在贫困线以下;(3) 预测手机用户的性别。对于分子性质预测,Ma等人[79]根据以下观察结果提出了一个多视图图神经网络:原子和键都会显著影响分子的化学性质,因此明智的做法是同时利用节点(原子)和边(键)信息来建立表达模型。薛等人[80]重新设计GNN,与CNN合作指导特征提取和信息传播过程,以获得多视点图像的特征表示。

1.2 图神经网络与因果学习的结合

https://cloud.tencent.com/developer/article/1887977

https://hub.baai.ac.cn/view/17067

2. 实践

https://www.pytorchtutorial.com/pytorch-geometric-for-gnn/;

https://zhuanlan.zhihu.com/p/94491664