目录

基本概念

变量之间的关系

相关分析

回归分析

相关分析和回归分析的关系

一元线性回归模型

总体回归函数

样本回归函数

线性回归模型的假定

普通最小二乘法(Ordinary Least Squares,OLS)

拟合优度指标

回归系数估计量的性质

回归系数估计量的线性性

回归系数估计量的无偏性

回归系数估计量的有效性

回归系数估计量检验(t检验)

参考文献

基本概念

变量之间的关系

变量之间的关系,一般可以分成两类,确定性关系和非确定性的依存关系。

(1)确定性关系

如果一个变量的值能被一个或若干个其他变量值

按某一规律唯一的确定,则这类变量之间就具有完全确定的关系。可以写成如下形式:

这里就是“按某一规律唯一的确定”中的那个唯一的规律。确定性关系通常也称为函数关系。事实上,上式就是我们熟悉的多元函数。其中

为自变量,

为因变量。

例如:假设每吨水的价格为10元时,居民应缴纳水费(元),与用水量

(吨)之间的关系就是一个确定性关系,确定性关系如下:

(2)非确定性关系

如果一个变量的值与一个或若干个其他变量值

之间存在着密切的数量关系,却无法由

的值精确求出。在基于大量统计数据的基础之上,可以判别这类变量之间的数量关系具有一定的规律性,称为统计相关关系。

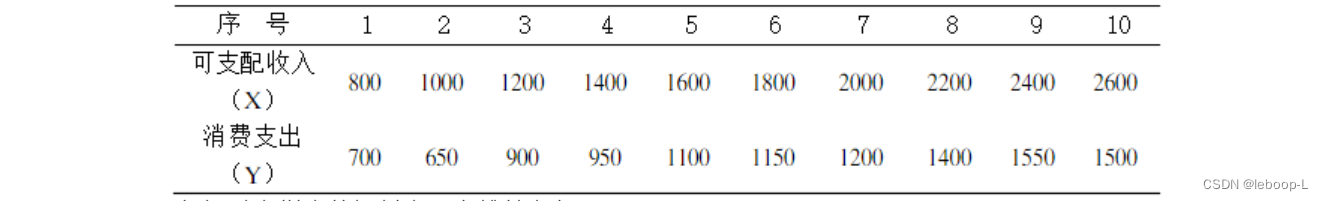

例如:居民消费支出,与可支配收入

之间存在着密切的数量关系。在一定范围内,可支配收入增加,居民的消费支出也会相应增加。但是,根据可支配收入并不能精确求出消费支出。也就是它们之间的关系是非确定性的。

相关分析

相关分析是通过对变量之间依存关系的分析,找出变量之间依存关系的形式和相关程度,以及依存关系的变动规律。

从依存关系的形式来看,可分为线性相关和非线性相关。线性相关反映变量之间的依存关系近似表示为一条直线。而非线性相关无法近似的表示为一条直线。

变量之间的相关程度,可以通过相关系数来度量。例如可以使用Pearson相关系数来度量两个连续型变量之间的相关程度(线性相关,Pearson相关系数为0只能说明变量之间不存在线性关系,但无法说明变量之间不存在关系)。

关于Pearson相关系数可以参见皮尔逊相关系数(百度百科)。

回归分析

回归分析是研究某一被解释变量(因变量),与另一个或多个解释变量(自变量)间的依存关系,其目的在于根据已知的解释变量值来估计和预测被解释变量的总体平均值。

在研究某一社会经济现象的发展变化规律时,所研究的现象或对象称为被解释变量。它是分析的对象,把引起这一现象变化的因素称为解释变量。它是引起这一现象变化的原因。

按照回归分析模型中自变量的个数,分为一元回归分析和多元回归分析。一元回归分析是指分析模型中只有一个自变量,多元回归分析是指回归分析模型中有两个或两个以上的自变量。

按照回归分析模型中参数与被解释变量(因变量)之间是否线性,分为线性回归分析和非线性回归分析。注意这里是针对参数,而不是自变量。

本文将重点研究一元线性回归分析,也就是文章标题所写的“简单线性回归”。

相关分析和回归分析的关系

相关分析是回归分析的前提和基础,回归分析是相关分析的深入和继续。

相关分析需要依靠回归分析来表现变量之间数量关系的具体形式。而回归分析则需要依靠相关分析来表现变量之间数量变化的相关程度。

相关分析只研究变量之间相关的方向(正相关、负相关)和相关的程度(使用相关系数来度量),不能推断变量之间的相关关系的具体形式,也无法从一个变量的变化来推测另一个变量的变化情况。

一元线性回归模型

总体回归函数

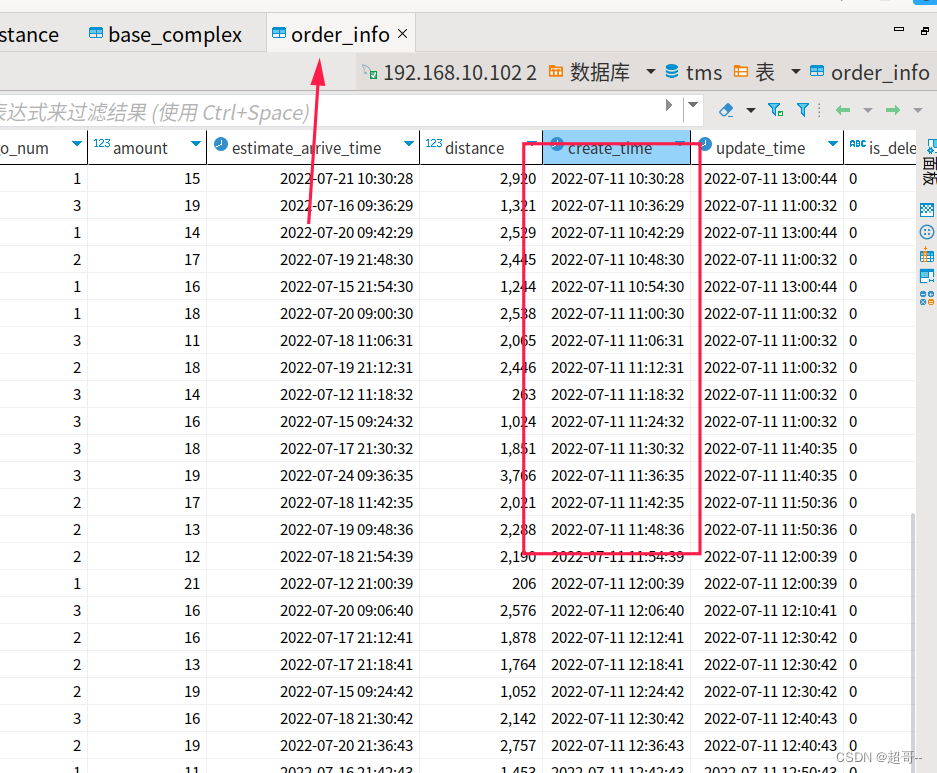

假若我们要研究的问题是:某市城镇居民家庭的可支配收入和消费支出

之间的关系。则全市城镇居民家庭构成了研究的总体。某市全部城镇居民家庭可支配收入和消费支出统计数据如下:

| 可支配收入 | 消费支出 | 户数 | 平均消费支出 |

| ...... | ...... | ...... | ...... |

| ...... | ...... | ...... | ...... |

第1列是可支配收入,分为

个不同的收入水平

。

第2列是消费支出,对于某一个收入水平,总共有

户家庭的消费支出数据与之对应,反映了在给定某一收入水平下,有关消费支出的条件分布。根据条件分布可以计算出在某一收入水平下的平均消费支出

,即条件均值。

可以看出,对于每一个收入水平,仅有唯一的一个条件均值

与之对应。这种一一对应关系,可以表示成如下函数关系:

(1)

该函数被称为总体回归函数(Population Regression Function, PRF),总体回归函数反映了在给定自变量下,因变量

的分布的总体均值随自变量

的变化关系。

总体回归函数若是线性函数,有:

(2)

其中是未知而固定的参数,称为回归系数(Regression Coefficients),特别地,

称为截距系数,

称为斜率系数。这里所谓的未知而固定,指的是通常研究的总体变量之间的关系是无法知道的,但又是客观存在的,只能根据样本数据来进行近似估计。(2)式也被称为一元线性总体回归函数。

事实上,仅仅反映了在某一收入水平

下,平均消费支出水平。但是对于某一居民的家庭消费支出

不一定与该水平一致。或多或少存在一些偏差。该偏差用

表示。即:

则有

总体回归函数若是线性函数,则

(3)

是除可支配收入外,其他一个或多个影响消费支出的因素的综合影响,是一个不可观测的随机变量,称为随机误差项。注意到上式中下标i仅仅表达的是第i个收入水平,是一个随机变量,并不是第i个样本,所以,可以写成如下更一般的形式:

该式就是本文要讨论的一元线性回归函数。式中的各个项都是真实值,不是预测值或估计值。注意到求解总体回归函数就是求解出回归系数。下面介绍样本回归函数。

样本回归函数

根据总体可以建立总体回归函数,揭示被解释变量(因变量)随解释变量的变化而变化的规律。但在大多数实际情况中,总体的信息往往无法全部获得,我们所掌握的不过是与某些固定的值相对应的

值样本,需要根据已知的样本信息去估计总体回归函数。

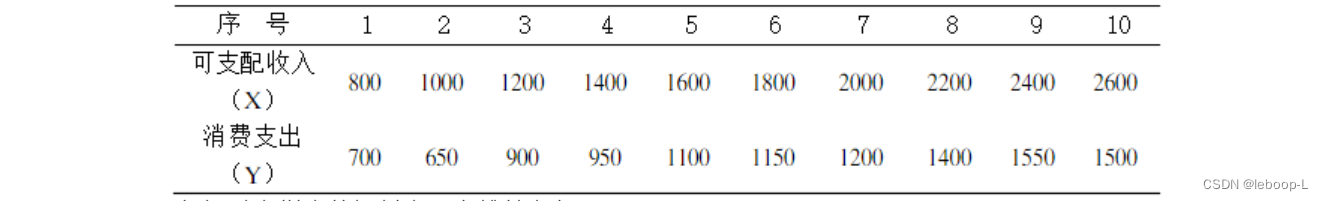

假设现在不知道建立总体回归函数的统计数据,仅仅掌握了来自总体的一组样本数据,例如:

根据以上样本数据拟合如下线性函数:

该式称为样本回归函数。比较该式与总体回归函数

假如无限接近

,

无限接近

,就可以用样本回归函数值

去估计总体回归函数

的值,即

。

估计值与真实值

存在一定的误差,该偏差用

表示。如下:

即

得到如下一元线性样本回归函数:

称为样本剩余项,或残差。

线性回归模型的假定

(1)线性于参数

即讨论的模型是关于参数的线性函数。即:

当然这里是一元情形,可以写成多元形式。

(2)扰动项与自变量不相关,期望值为0

即

(3)扰动项之间相互独立且服从方差相等的同一个正态分布

即

普通最小二乘法(Ordinary Least Squares,OLS)

如何根据样本数据信息估计回归系数呢?直觉告诉我们,预测值或估计值尽可能接近观测值

。OLS的原理就是让残差平方和达到最小,来确定回归分析模型中的参数,也就是回归系数。即:

下面来估计和推导。由

得到残差平方和:

对于给定的样本,是关于

的二元函数。即:

根据最小二乘法原理,要求使得

最小。借助微积分求极值方法。上式两边分别对

求偏导数,如下:

,

求偏导数,得到:

化简后得到:

(1)

(2)

(1)式两边除以n,

,即:

将其代入(2)式,求得:

化简后得到:

我们以如下样本为例:

拟合优度指标

根据最小二乘法原理,已经估计出回归系数,从而可以得到样本回归函数:

那么,如何判断拟合的效果怎么样呢?这就要使用拟合优度指标了,在介绍拟合优度指标之前。我们先证明一个恒等式。

其中,为总离差平方和,或者总平方和(Total Sum of Squares),如下计算:

为回归平方和,或者解释平方和(Explained Sum of Squares),如下计算:

为残差平方和,或者剩余平方和(Residual Sum of Squares),如下计算:

这个等式表明:因为引入模型,SST被分解成了两部分SSE和SSR。证明思路也是如此。

现在只需要证明最后一项为0即可,根据线性回归分析模型中的如下三个结论:

有:

因此

所以,

因为在样本给定的情况下,SST不会变,而最小二乘法原理是使得残差平方和最小,即SSR最小,也就是SSE最大。我们如下定义线性回归拟合优度指标:

显然,

越大,拟合效果越好。一般来说,如果

大于0.8,则说明拟合效果非常好。

回归系数估计量的性质

回归系数估计量的线性性

回归系数的估计量

是随机变量

的线性函数,这就是所谓的回归系数估计量的线性性。先给出结论:

,其中

,其中

下面一一证明。

(1)先证明估计量的线性性。根据OLS得到的

如下:

将上式分子拆开,得到:

注意到:

所以得到:

如果令,则

只与自变量有关,与

无关,最终得到:

可以看出回归系数估计量是随机变量

的线性函数。

(2)证明估计量的线性性。根据OLS得到的

如下:

将

(平均值的定义)

(估计量

的线性性)

代入上式,得到:

如果令,则

只与自变量有关,与

无关,得到

可以看出回归系数估计量是随机变量

的线性函数。

回归系数估计量的无偏性

如果估计量的均值等于总体参数,则称估计量就是无偏估计量,对于回归系数估计量来说,就是

怎么理解无偏性呢。我们以为例,

是使用样本数据估计得到的一个估计值,它可能比真实的总体参数

要大,如果换一组样本数据,

的估计值可能就比真实的总体参数

要小,当然,也可能是相等的,如果通过换更多组的样本数据,得到很多个

,虽然大小不一,但是它们的均值是真实值的总体参数。也就是无论你怎么更换样本数据,

的值在真实值左右摆动。

(1)先证明估计量的无偏性

由回归系数估计量的线性性

,其中

以及

得到

因为

容易验证:

,

,

所以得到:

(该式表明了估计量与真实值之间的关系)

上式两边取期望,根据期望性质,得到:

根据模型假定,

,得到

(2)证明估计量的无偏性

由回归系数估计量的线性性

,其中

以及

得到:

容易验证:

得到:

(该式表明了估计量与真实值之间的关系)

上式两边取期望,所以

所以

回归系数估计量的有效性

所谓回归系数估计量的有效性是指,在所有关于总体参数真实值,

的无偏估计

,

中,

,

的方差

,

最小。我们先给出使用OLS得到的回归系数估计量的方差。

(1)的方差

因为估计量与真实值

有如下关系

两边取方差,得到

根据模型假定,所以

因为

得到:

最终

(2)的方差

因为估计量与真实值

有如下关系

,其中

,

两边取方差,有

即:

(3)有效性

设是使用其他方法得到的

的线性无偏估计量。由线性性可知:

,该式两边取方差,得到

(4)有效性

可类似证明。

由上面的推导知道:

可以看出,

都是干扰项

的线性函数。而

,由正态分布的性质,得到回归系数估计量

,

均服从如下正态分布:

这里遗憾的是,回归系数估计量,

的方差中的扰动项方差

是未知的。

回归系数估计量检验(t检验)

估计出一元回归分析的回归系数后,需要对其进行检验。假设问题如下:

(1)原假设:

(2)备择假设:

类似,这里不再累述。

构造如下统计量:

其中

,

下面我们来证明该统计量在原假设下服从自由度为n-2的t分布。

参见《一些常见分布-正态分布、对数正态分布、伽马分布、卡方分布、t分布、F分布等》

根据t分布的如下定义:

只需要分子构造一个标准正态分布,分母构造一个自由度为n-2的卡方分布

,则如下

分布

就是一个自由度为n-2的t分布。

因为

则如下构造的分布服从标准正态分布

构造如下H分布:

则Z分布如下:

因为原假设成立,即

所以现在只需要证明

这里参照《多元线性回归参数检验服从t分布的证明》证明。

参考文献

线性回归R2-F-t检验 - 360文档中心

多元线性回归参数检验服从t分布的证明 - 知乎线性回归的四个假设 The Four Assumptions of Linear Regression - 知乎