最近多模态相关的论文好火,原因就不多说了(懂得都懂),因为有不少想发paper的同学来问了,我就火速整理了一部分来和你们分享。

这次整理了6篇最新的多模态论文,还有12篇经典的文章,主要涉及预训练、表征学习、多模态融合等热门细分方向,论文包大家可以看文末领取!

6篇最新论文

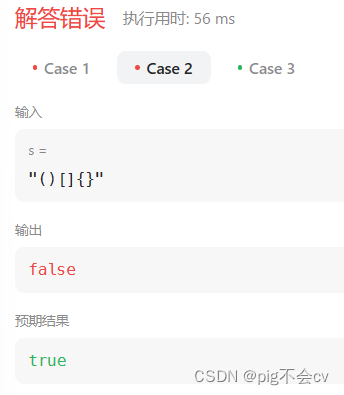

1.CLIP-VG: Self-paced Curriculum Adapting of CLIP via Exploiting Pseudo-Language Labels for Visual Grounding

作者提出了CLIP-VG,利用预训练模型CLIP和伪语言标签进行自定进度课程适应,实现无监督地理定位。另外,作者也设计了端到端网络,并提出单/多源课程适应算法。

CLIP-VG超过最新无监督方法6.78-14.87%,甚至超过弱监督方法。

2.ChatGPT-Like Large-Scale Foundation Models for Prognostics and Health Management: A Survey and Roadmaps

作者系统阐述了关键组成部分和最新 LSF模型的发展,回答了如何构建适用于PHM任务的LSF模型,并概述了挑战和未来这种研究范式的发展路线图。

3.MiniGPT4: Enhancing Vision-Language Understanding with Advanced Large Language Models

作者提出MiniGPT-4,使用一个投影层将视觉编码器和语言模型Vicuna对齐,可以根据给定图像写故事和诗歌,为图像中显示的问题提供解决方案,以及根据食品照片教用户烹饪等。

4.InternGPT: Solving Vision-Centric Tasks by Interacting with ChatGPT Beyond Language

作者提出了交互视觉框架InternGPT,简称iGPT。该框架集成了具有计划和推理功能的聊天机器人功能,例如 ChatGPT,具有指向等非语言指令,使用户能够直接操作图像或视频的动作。

5.LLaVA: Visual Instruction Tuning

作者首次尝试使用仅语言的GPT-4生成多模态语言图像遵循指令的数据。

通过在这样生成的数据上进行指令调整,作者提出LLaVA:大型语言和视觉助手。这是一种端到端训练的大型多模态模型,它将视觉编码器和LLM连接起来,用于通用的视觉和语言理解。

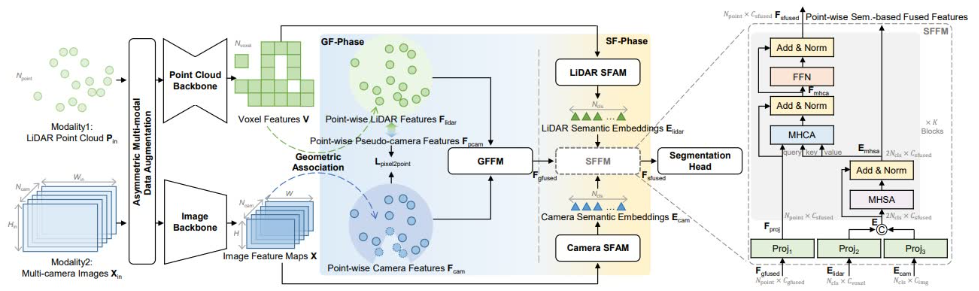

6.MSeg3D: Multi-modal 3D Semantic Segmentation for Autonomous Driving

作者提出了多模态3D语义分割模型MSeg3D,通过联合模态特征和跨模态融合以解决多模态困难。

4篇预训练

1.Learning Transferable Visual Models From Natural Language Supervision

作者提出通过预测图像和文本配对来预训练视觉模型,达到SOTA性能,证明这种无监督预训练可以有效地学习视觉表示,并在30+下游任务上进行实验,表现出非平凡的泛化能力,有时甚至超过完全监督的模型。

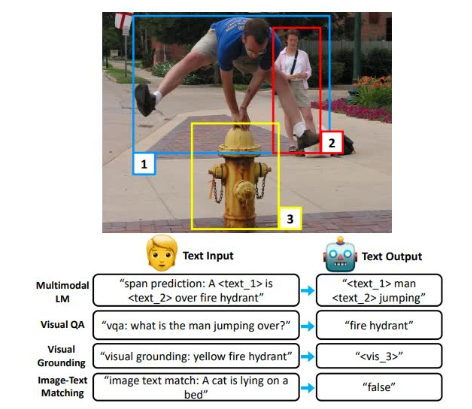

2.Unifying Vision-and-Language Tasks via Text Generation

作者提出一个统一的框架,在单个架构中采用相同的语言建模目标来学习不同的任务,即多模态条件文本生成,其中该模型基于视觉和文本输入生成文本中的标签。

3.UNIMO: Towards Unified-Modal Understanding and Generation via Cross-Modal Contrastive Learning

作者提出了一个统一的模态预训练架构,即UNIMO,可以有效适应两种单一模式,以及多模态理解和生成任务。

通过利用大规模的自由文本语料库和图像集合,提高了视觉和文本理解的能力,并通过跨模态对比学习(CMCL)将文本和视觉信息对齐到一个统一的语义空间中。

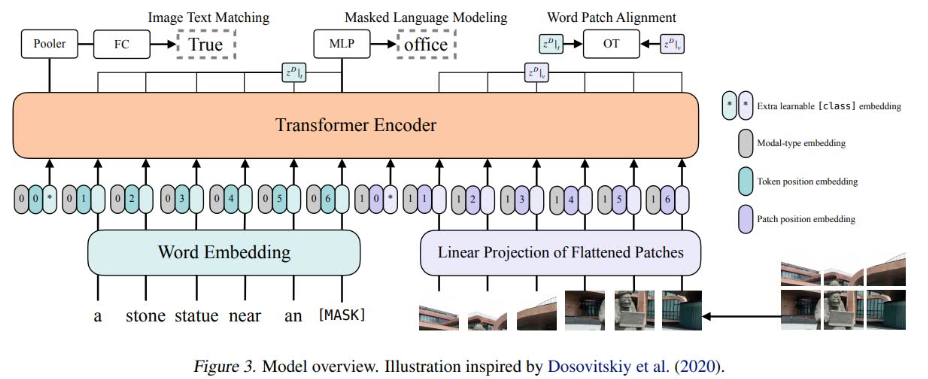

4.ViLT: Vision-and-Language Transformer Without Convolution or Region Supervision

作者提出了一个最小的VLP模型Vision-and-Language Transformer (ViLT),在处理视觉输入方面极大地简化为与处理文本输入完全相同的无卷积方式。

2篇表征学习

-

Deep Multimodal Representation Learning: A Survey

-

Watching the World Go By: Representation Learning from Unlabeled Videos

6篇多模态融合

-

Align before Fuse: Vision and Language Representation Learning with Momentum Distillation

-

DeepFusion: A Robust and Modular 3D Object Detector for Lidars, Cameras and Radars

-

Hybrid Contrastive Learning of Tri-Modal Representation for Multimodal Sentiment Analysis

-

Multi-modal Sensor Fusion for Auto Driving Perception: A Survey

-

P4Contrast: Contrastive Learning with Pairs of Point-Pixel Pairs for RGB-D Scene Understanding

-

SCA-CNN: Spatial and Channel-wise Attention in Convolutional Networks for Image Captioning

关注下方《学姐带你玩AI》🚀🚀🚀

回复“多模态”获取全部论文合集

码字不易,欢迎大家点赞评论收藏