AutoDL初体验

真的很给力!

相同的配置,在华为云上价格令人望而却步,AutoDL真的良心价!

搞了个4090体验一下,一小时只要两块五(主要是,之前没有GPU,好多想玩的LLM开源项目都体验不了,实在是太难受了😭😭😭😭😭)

文章目录

- AutoDL初体验

- 一.注册及认证

- 二.租用实例

- 三.如何开放端口

- 四.我的几个测试

- 1.flask开放端口进行简单的get和post测试

- 简单get

- 简单post

- 2.langchain-chatchat项目

一.注册及认证

- https://www.autodl.com 点击登陆注册即可

- 前往学生认证可以95折

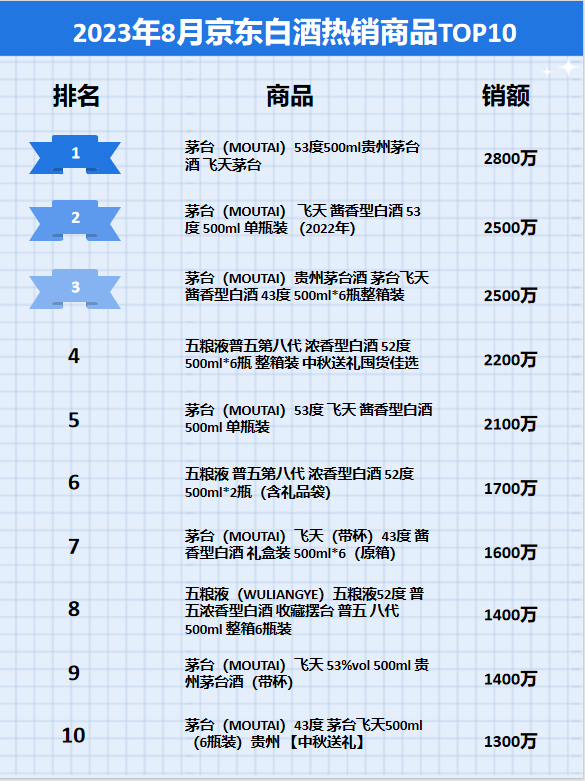

二.租用实例

-

这个价格真的实惠

-

可以直接选择别人创建好的镜像:https://www.codewithgpu.com/image

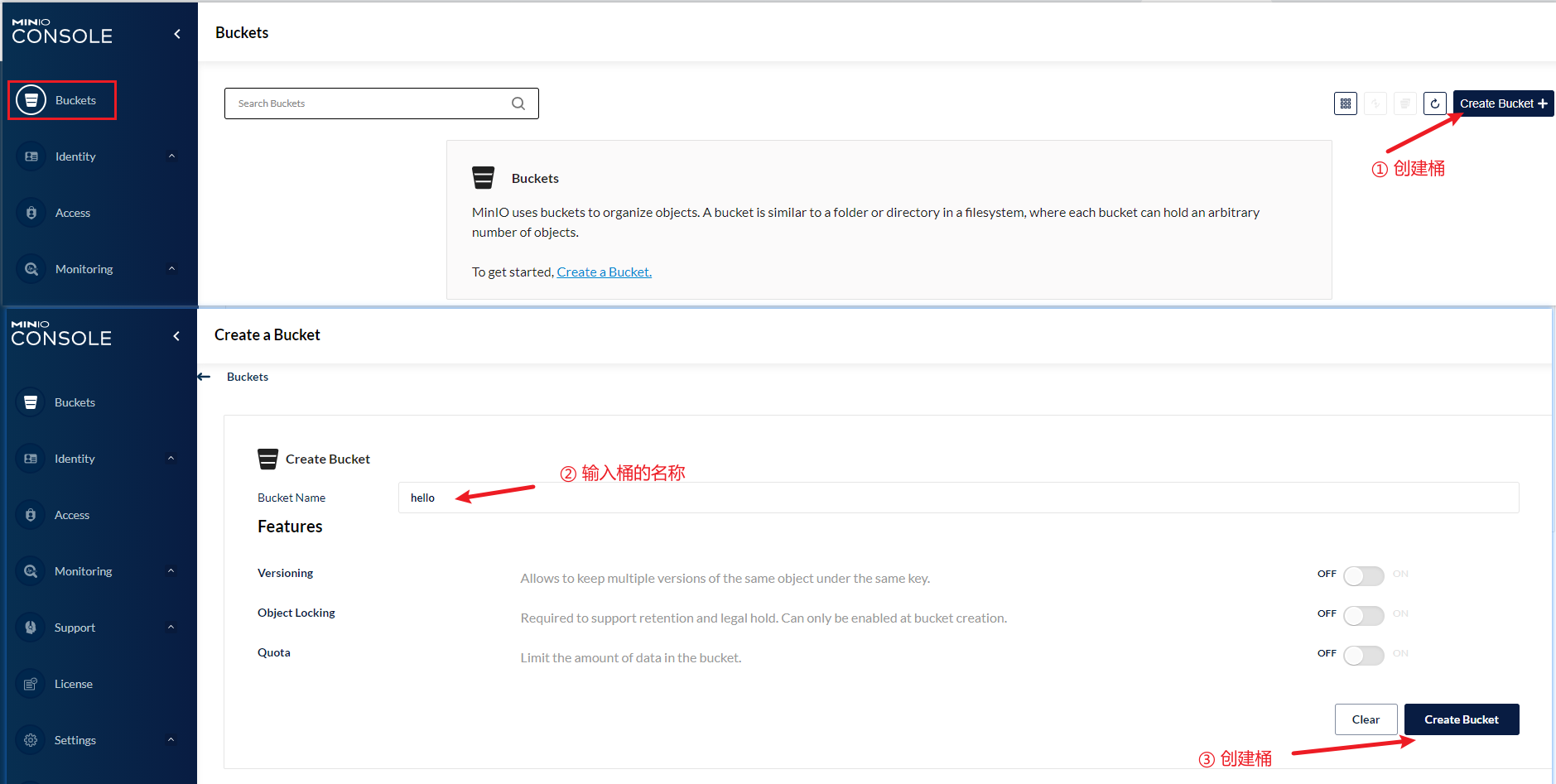

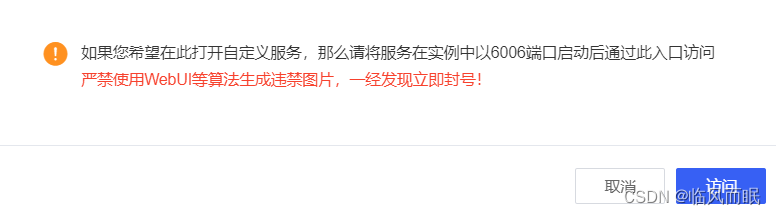

三.如何开放端口

需要实名认证

- 官方说明在这里:https://www.autodl.com/docs/port/

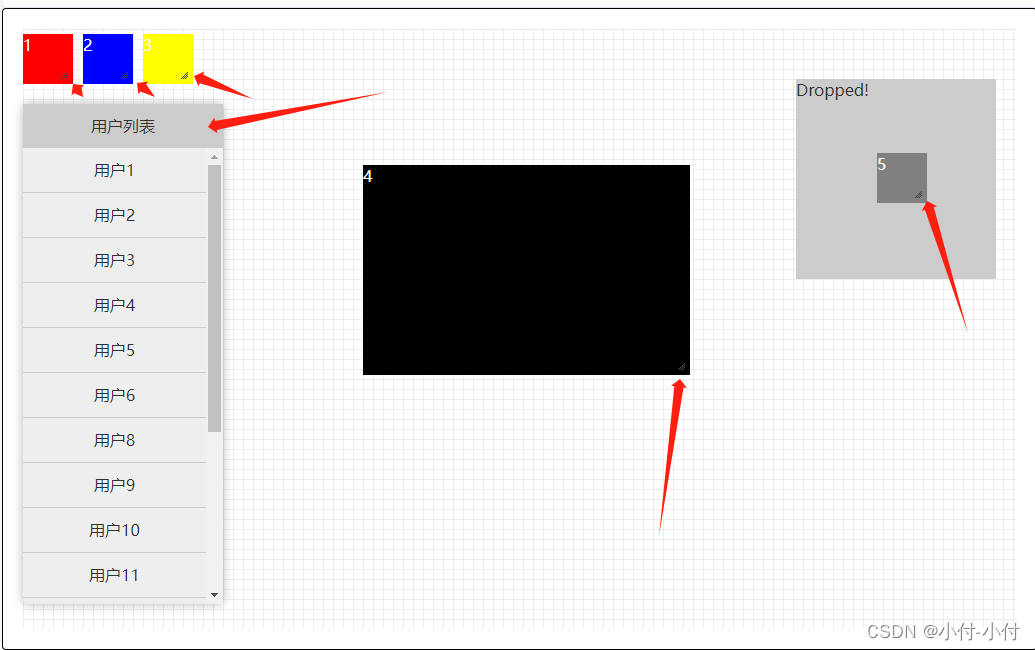

- 点击控制台,找到需要开放端口的实例

点击下面的访问,就会得到一个分配的公网IP

四.我的几个测试

我们要做的是在程序里开放本地的6006端口,映射到上述的分配的公网IP上面

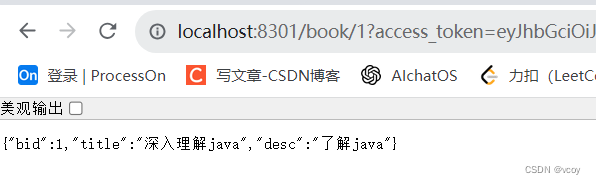

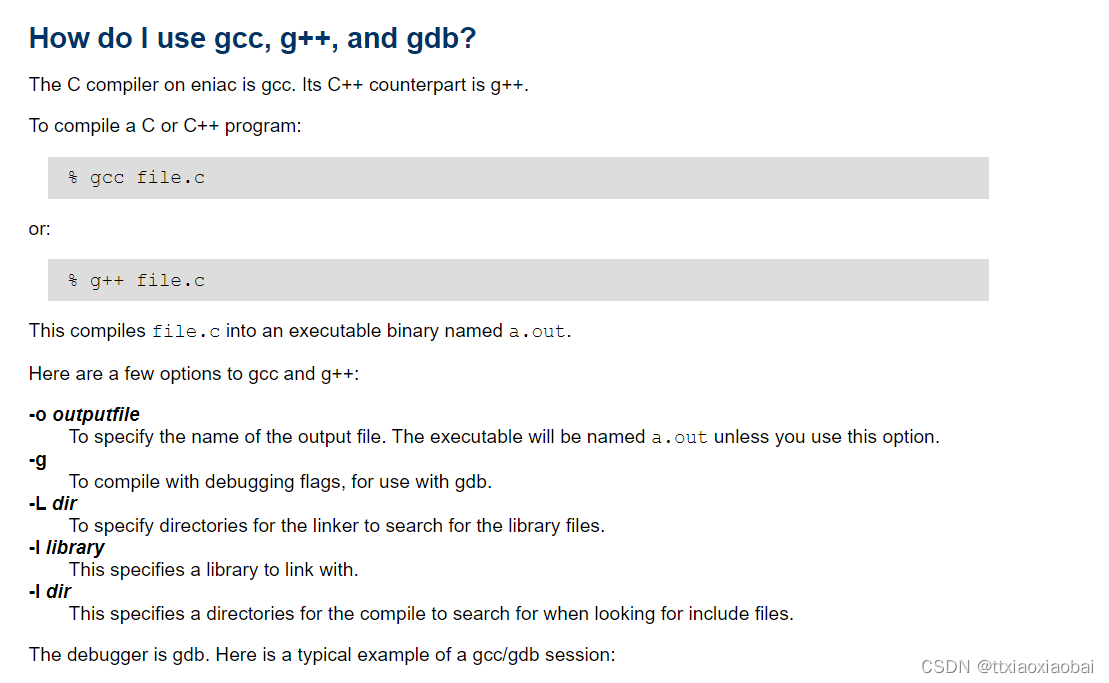

1.flask开放端口进行简单的get和post测试

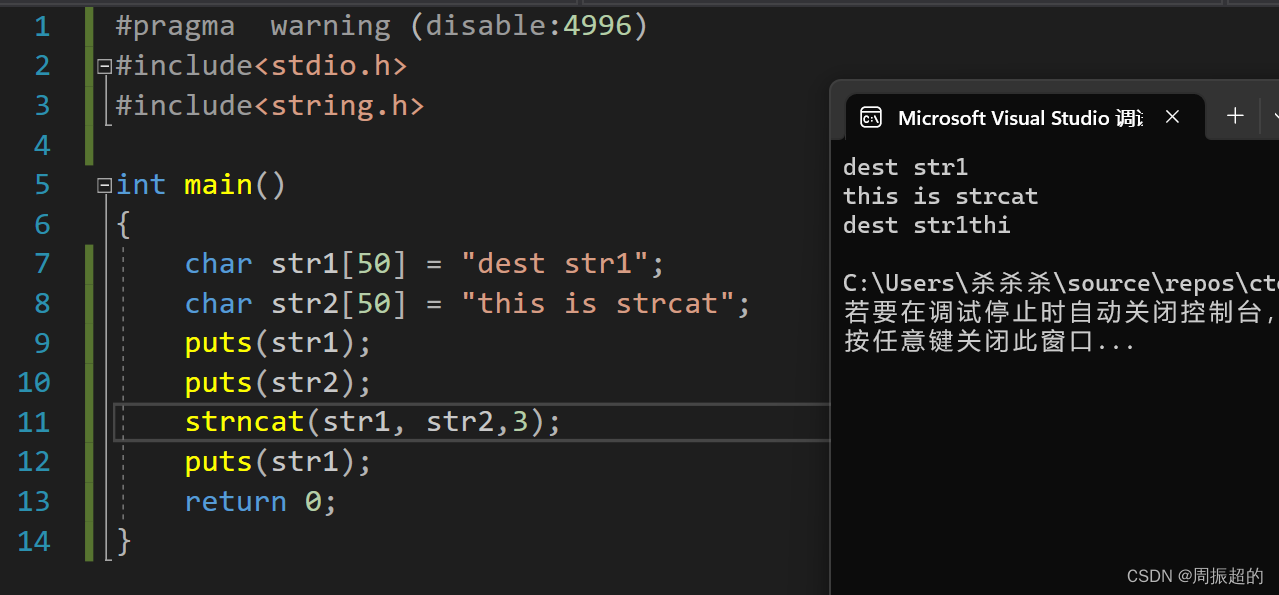

简单get

经典hello world

from flask import Flask

from flask_cors import CORS

app = Flask(__name__)

CORS(app)

@app.route('/')

def hello_world():

return 'Hello, World!'

if __name__ == '__main__':

app.run(host='0.0.0.0', port=6006)

用apifox或者其他代码测试即可,url是前面说的点击访问后,分配的url,复制即可

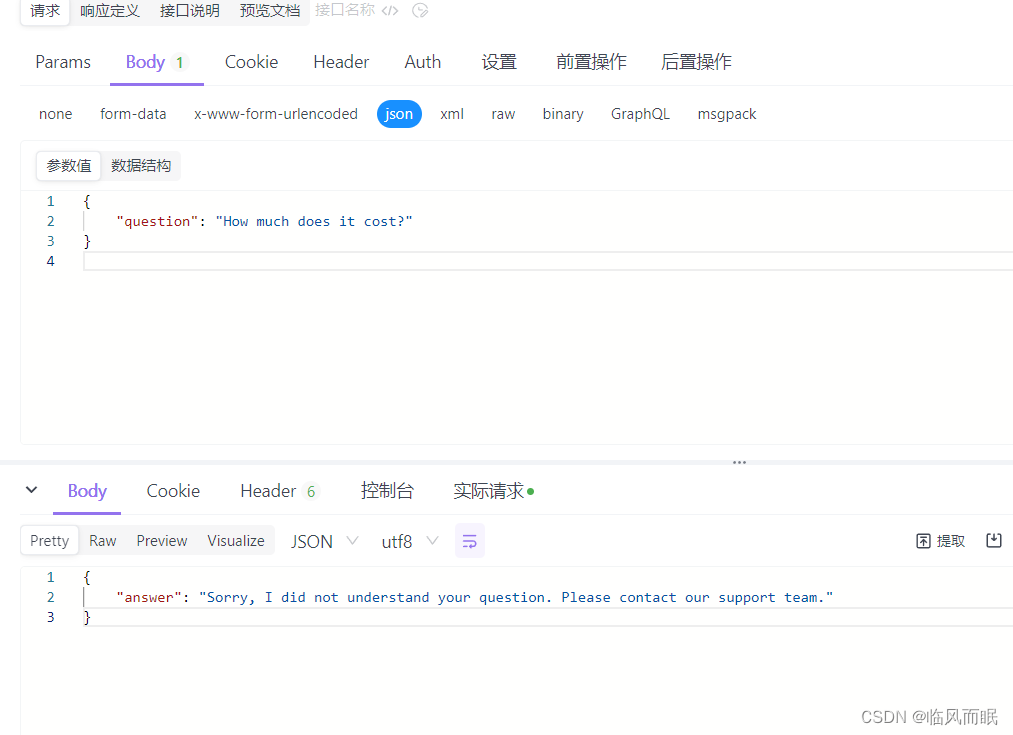

简单post

那就试试最简单的基于规则的聊天机器人

from flask import Flask, request, jsonify

from flask_cors import CORS

app = Flask(__name__)

CORS(app)

@app.route('/customer-service', methods=['POST'])

def customer_service():

# 获取用户的问题

user_question = request.json.get('question', '').lower()

# 基于规则的回答

if 'price' in user_question:

return jsonify({'answer': 'Our products range from $50 to $500 depending on the model.'})

elif 'delivery' in user_question or 'shipping' in user_question:

return jsonify({'answer': 'Delivery takes 3-5 business days.'})

elif 'return' in user_question or 'refund' in user_question:

return jsonify({'answer': 'You can return products within 30 days of purchase.'})

else:

return jsonify({'answer': 'Sorry, I did not understand your question. Please contact our support team.'})

if __name__ == '__main__':

app.run(host='0.0.0.0', port=6006)

测试的时候记得url加上 /customer-service

{

"question": "How much does it cost?"

}

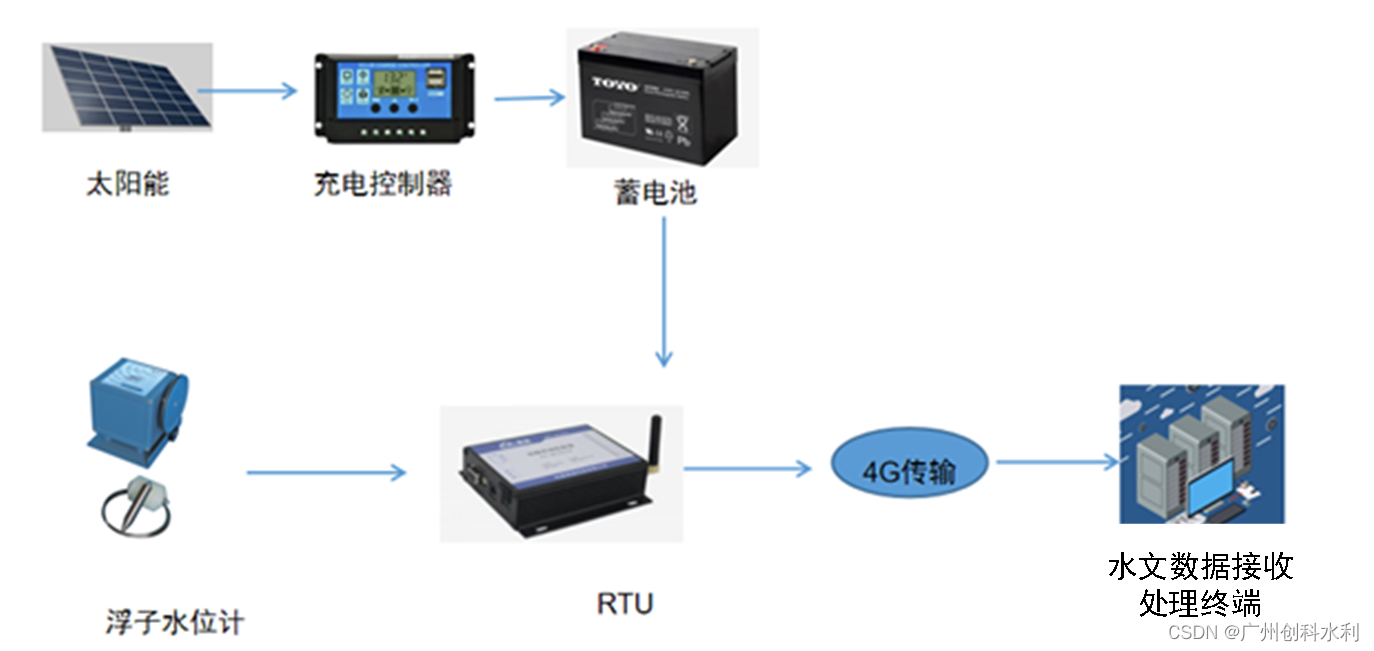

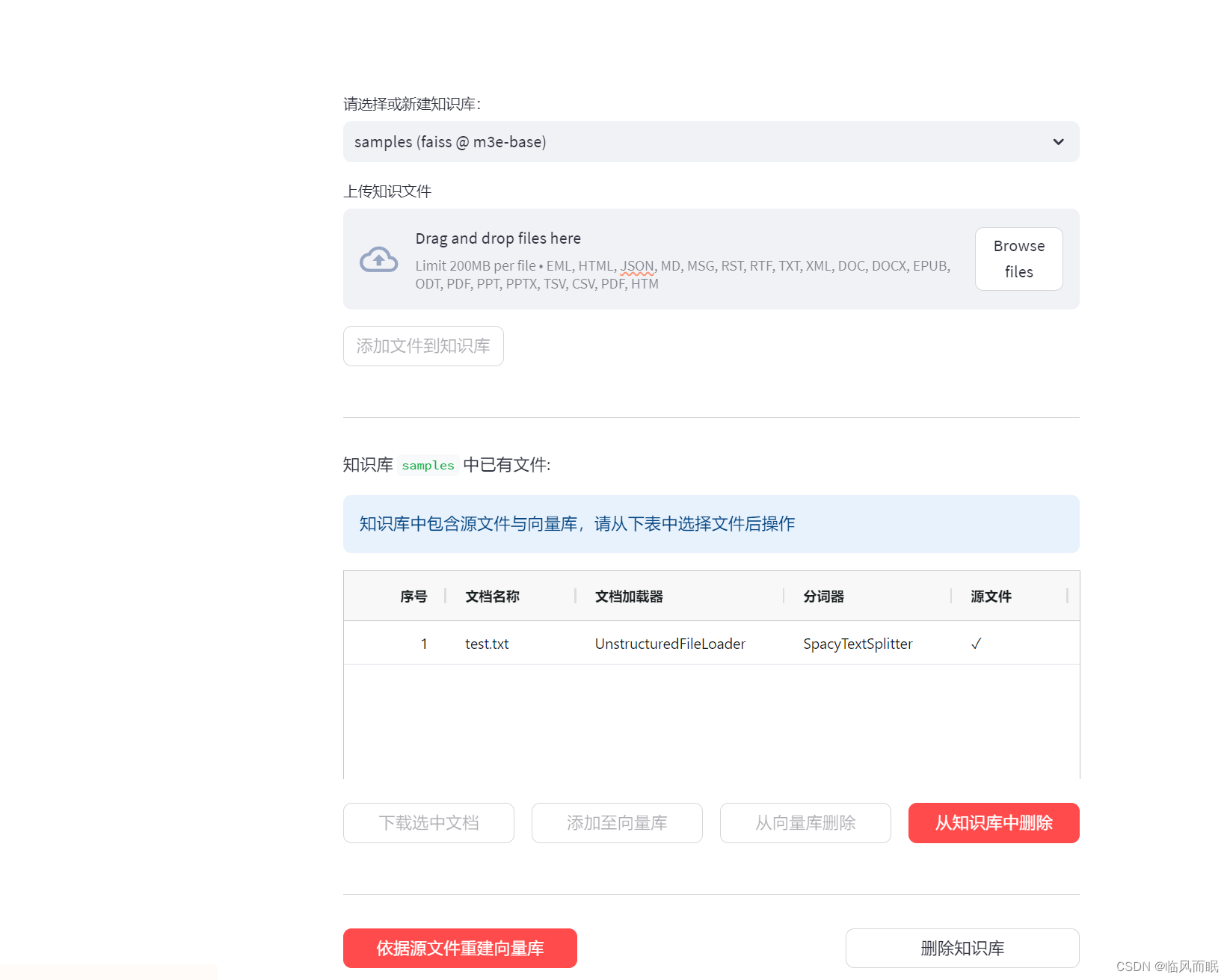

2.langchain-chatchat项目

-

这位大佬把自己的镜像上传到autodl了,我直接克隆的他的镜像

Langchain-Chatchat + 阿里通义千问Qwen 保姆级教程 | 次世代知识管理解决方案 - SeASnAkE的文章 - 知乎

https://zhuanlan.zhihu.com/p/651189680 -

这个开源项目之前很早就关注了,现在终于有算力可以体验了

十分推荐上面贴的知乎链接那篇作者写的文章,写的很不错!