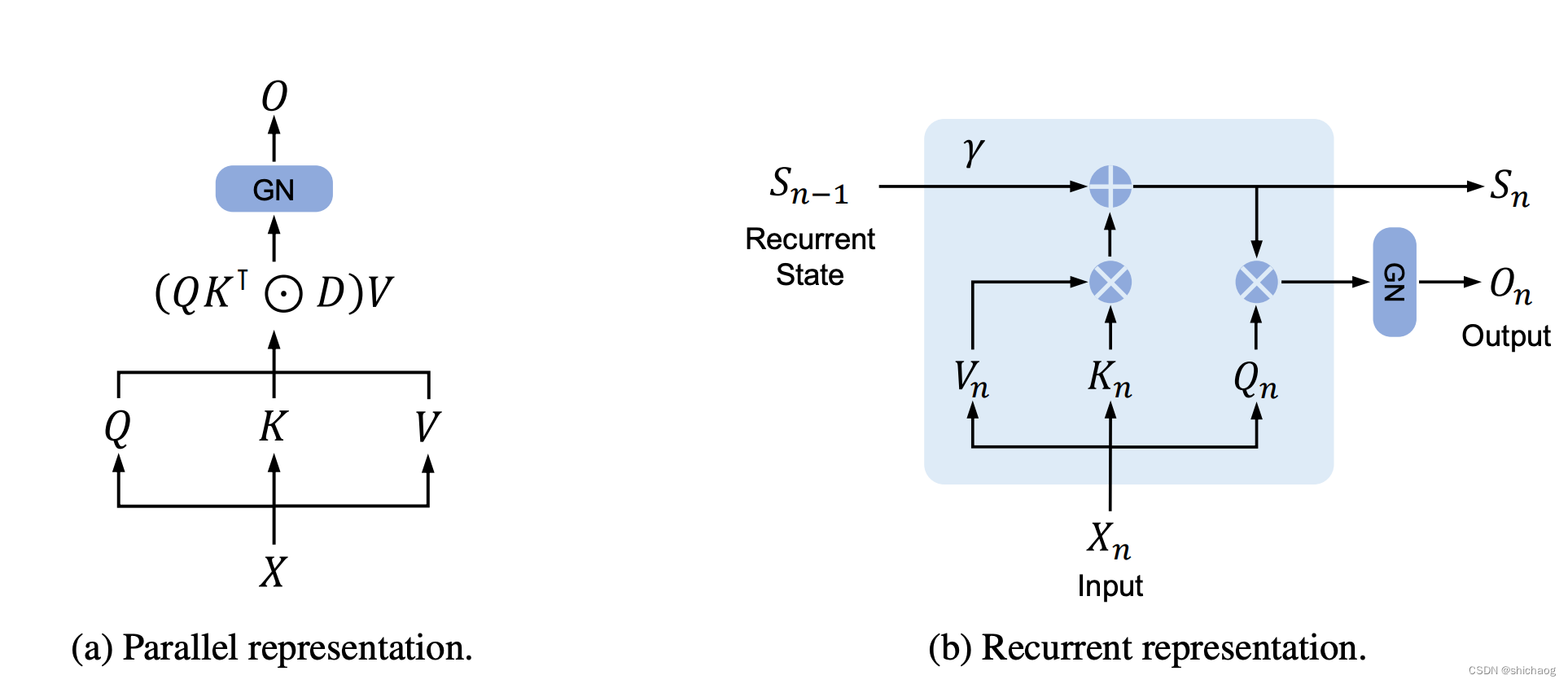

recurrent layers一般是特定的结构,在语音识别和创作用的比较多,又RNN,LSTM,GRU一些东西。

transform 层nlp常用,在cv领域表现得很不错

线性层,infeature和outfeature还有一个偏置

dropout层,是为了防止过拟合,把其中的一些值以概率为p转换成0

embedding是处理自然语言的一个层

distance function是计算两个点的误差,用什么函数来衡量的

loss function也是衡量误差来使用的

torchvison中有很多model,用于图形处理现成的,包括alexmodel,可以直接调用,语音方面也会有,但是文字当面没有

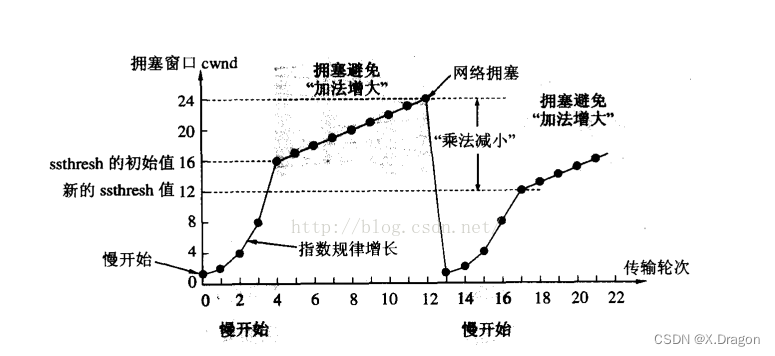

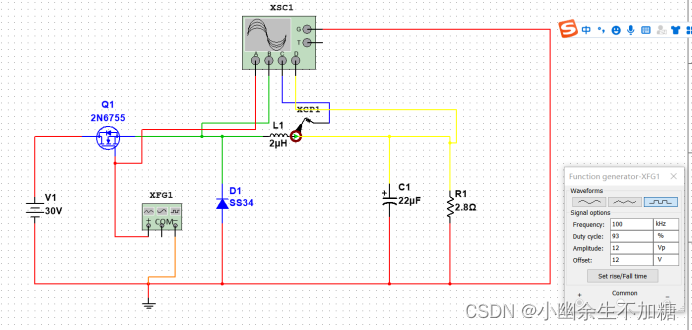

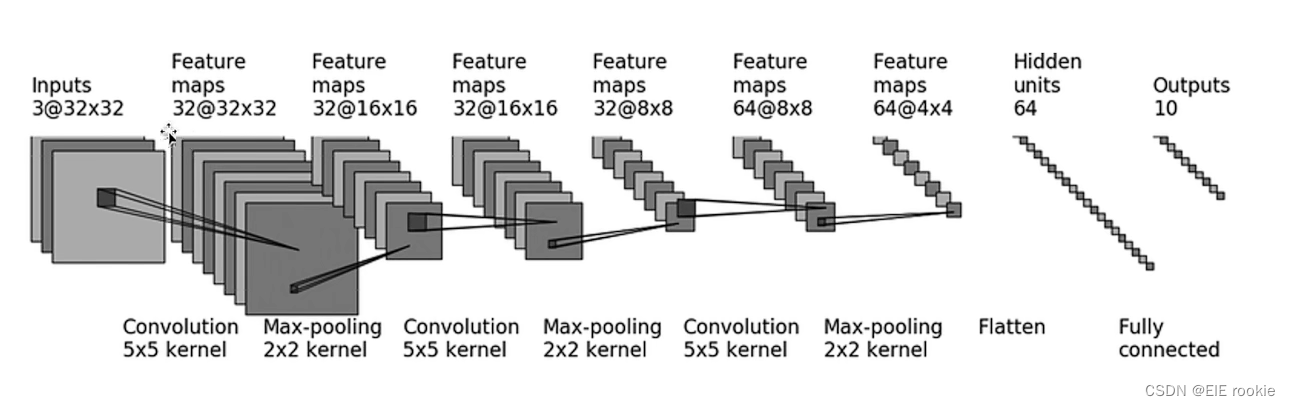

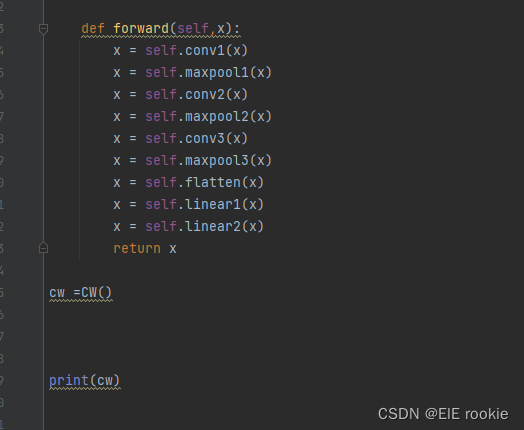

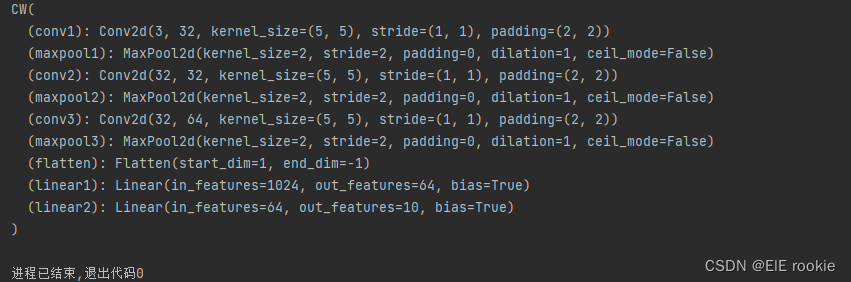

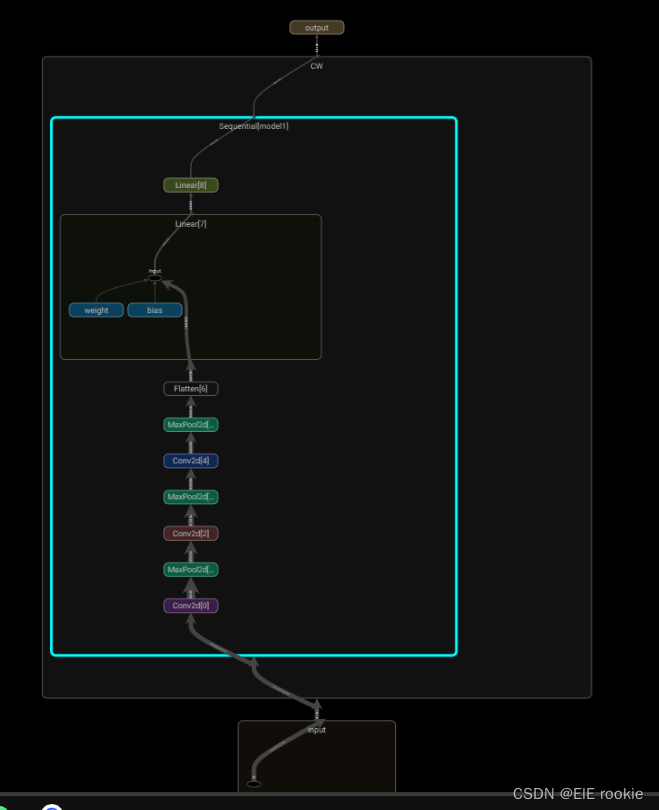

CIF10图片的神经网络:卷积--最大池化--卷积--池化--卷积--池化--展平变换--全连接

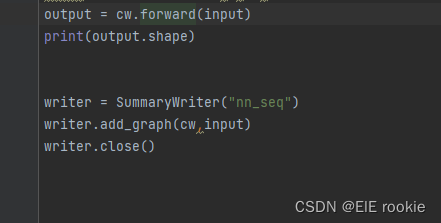

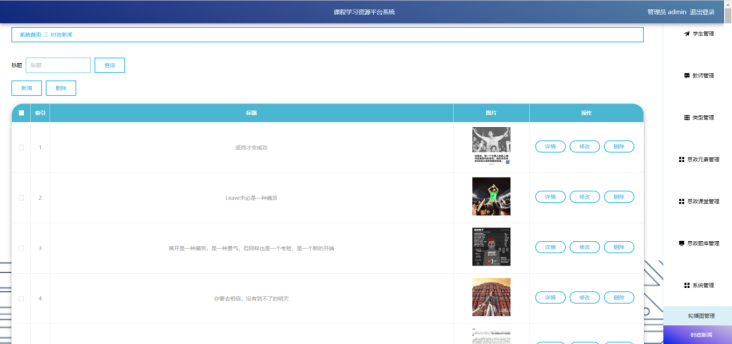

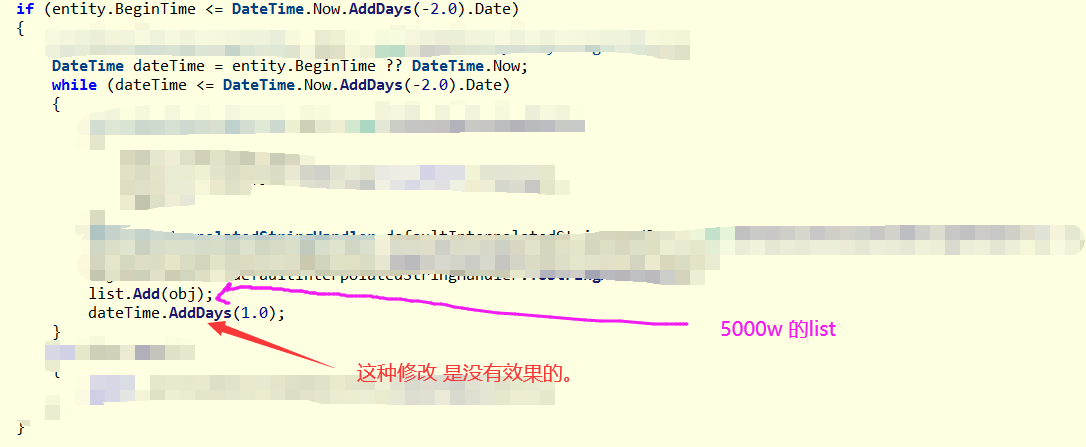

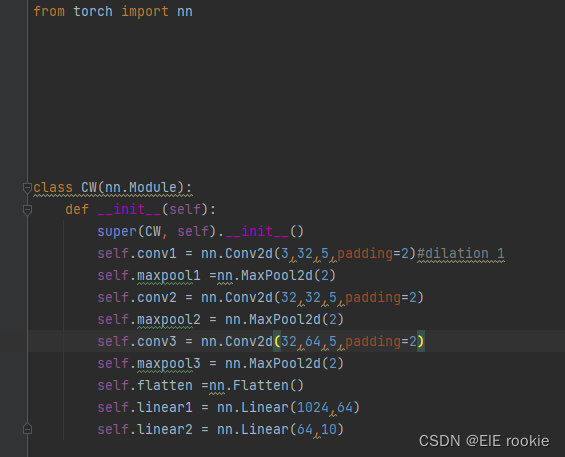

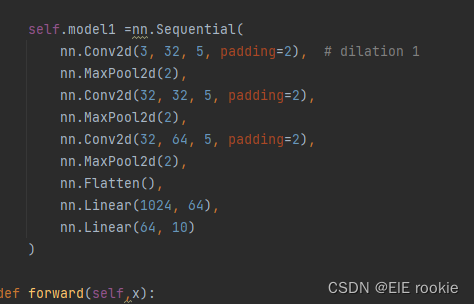

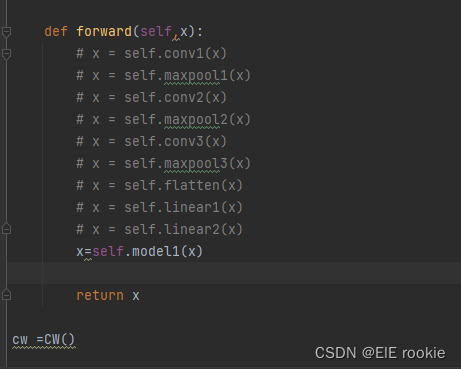

代码实现:

![]()

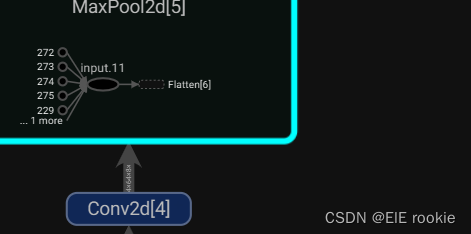

如果1024不会算,可以删除后面两部,先进行下去

![]()

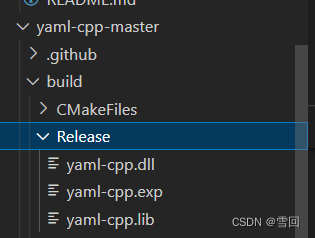

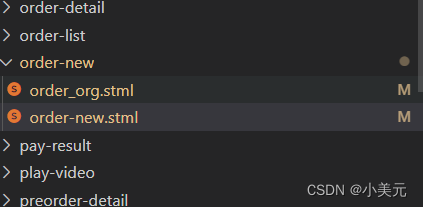

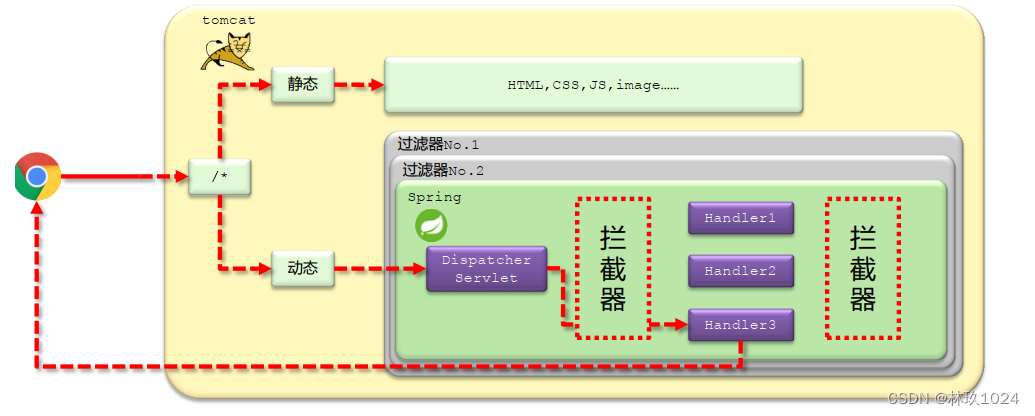

双击每个单元都可以查看里面的结构