【三维重建】【深度学习】【数据集】基于COLMAP制作个人Gen6D测试数据集

提示:最近开始在【三维重建】方面进行研究,记录相关知识点,分享学习中遇到的问题已经解决的方法。

文章目录

- 【三维重建】【深度学习】【数据集】基于COLMAP制作个人Gen6D测试数据集

- 前言

- 下载安装colmap软件

- 拍摄视频采集图像

- 恢复相机姿势

- 手动指定对象区域

- 安装CloudCompare

- 保存目标对象点云

- 指定目标对象的X正方向和Z正方向

- 总结

前言

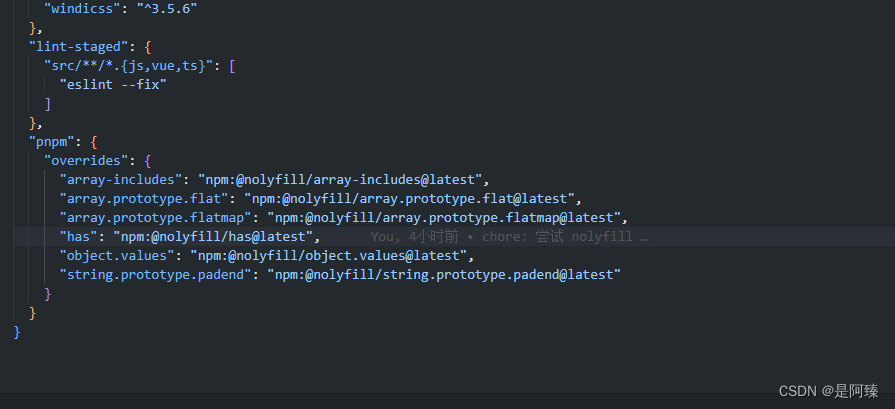

Gen6D不需要CAD模型或者可渲染模型就可以泛化到新物体的位姿估计算法,本文基于COLMAP用手机拍摄的视频制作成个人的测试数据集。官方参考

下载安装colmap软件

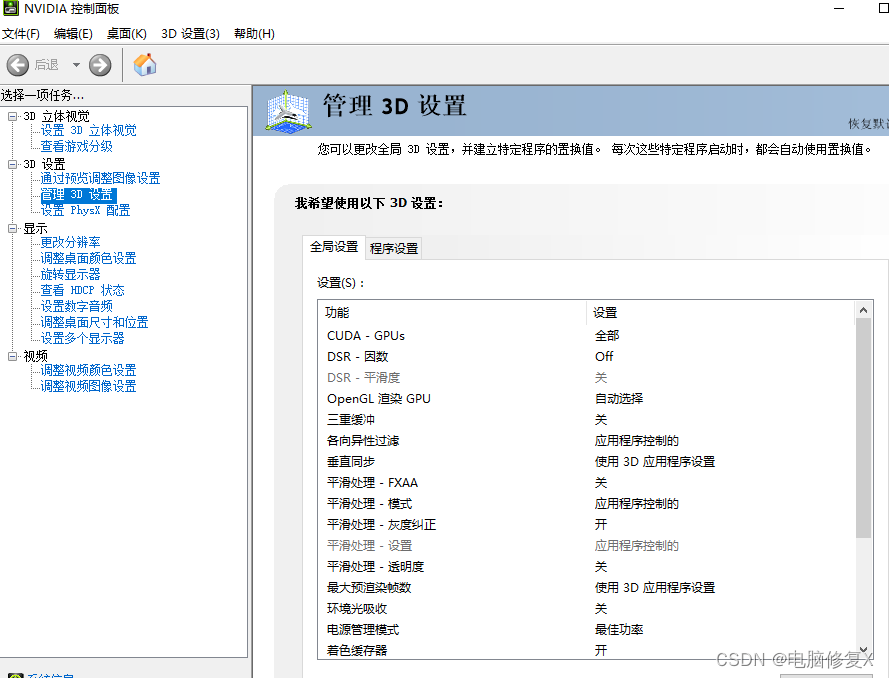

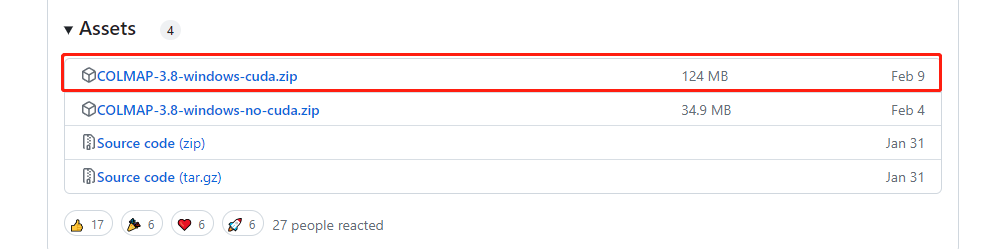

下载COLMAP软件【下载地址】,本文使用的是Windows下的CUDA版本:

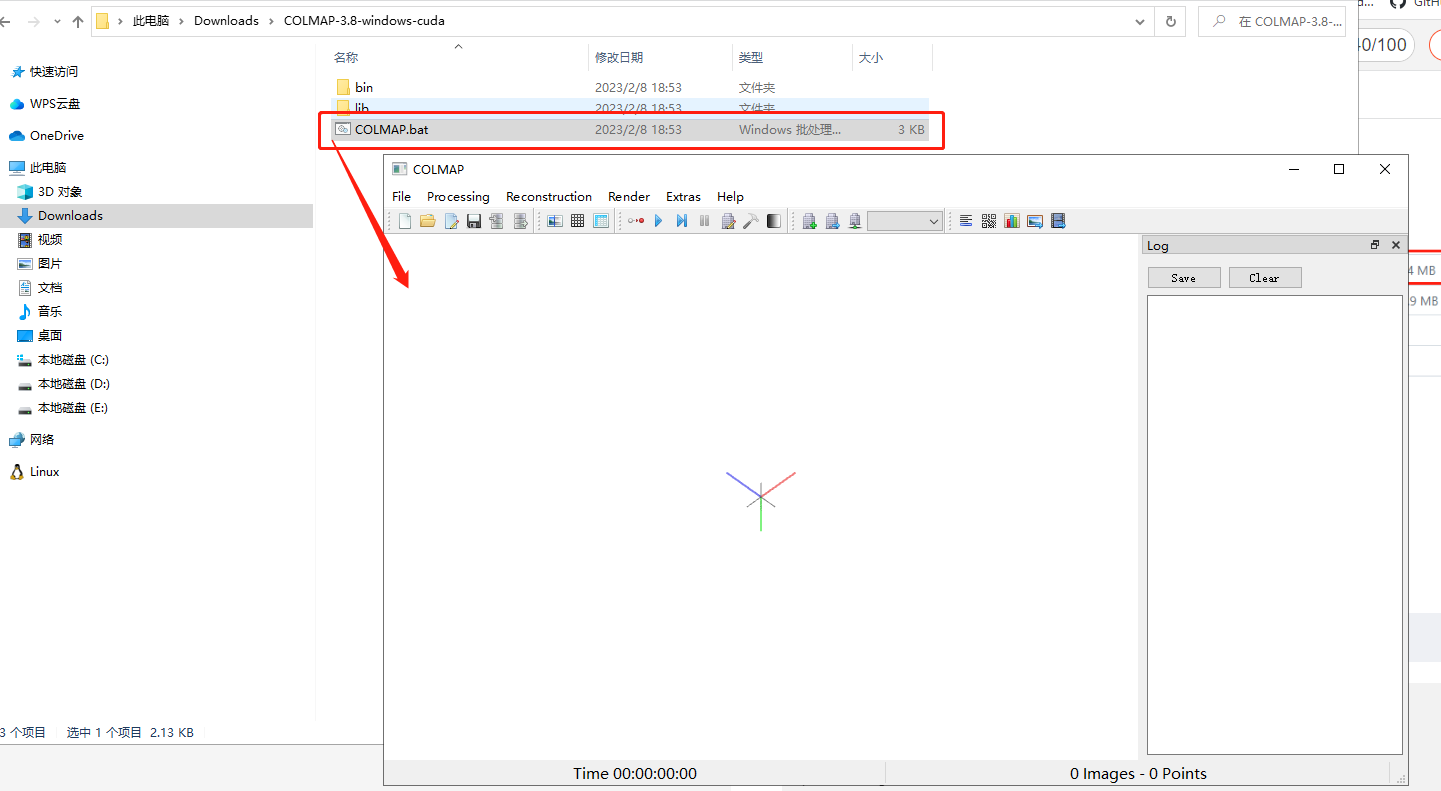

解压后双击打开COLMAP.bat,出现如下界面软件安装成功:

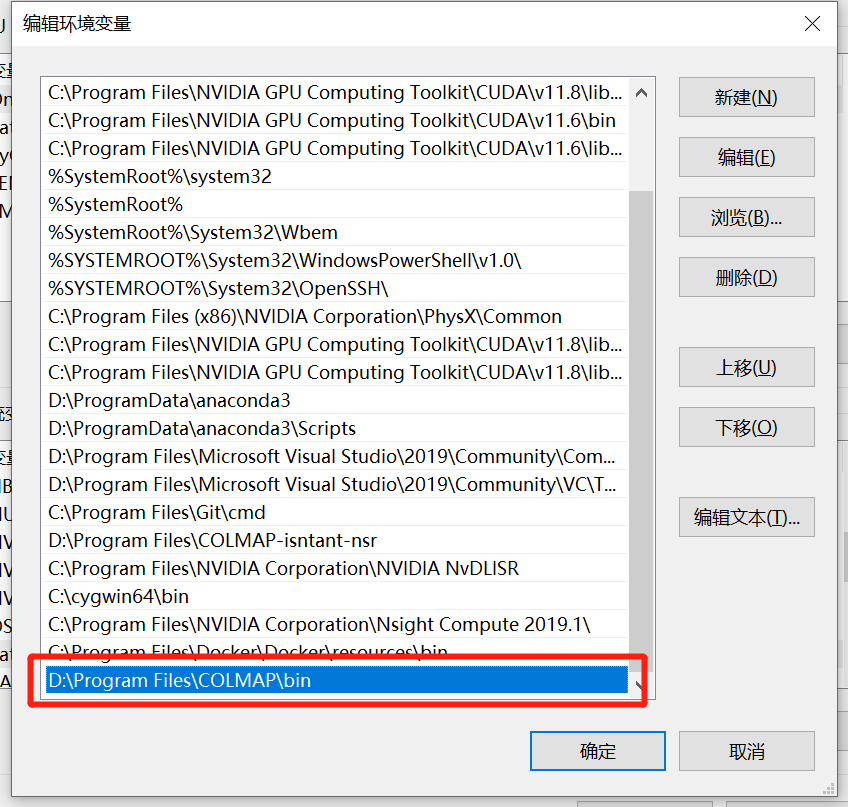

将COLMAP工程放在合适的位置,可以重命名,然后加入到环境变量里:

拍摄视频采集图像

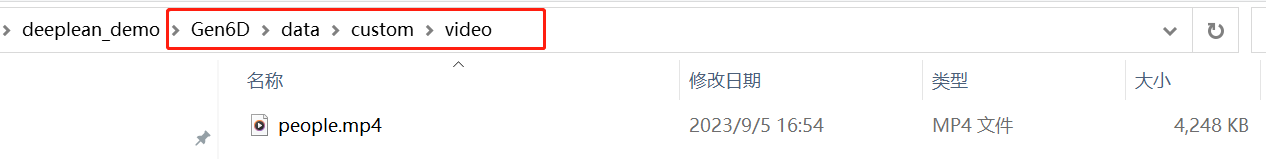

将拍摄好的视频存放在Gen6D/data\custom\video路径下:

拍摄视频的目标对象一定是要静止的,假如目标对象没有纹理,那背景的纹理必须要足够丰富。

将拍摄视频分割成图像:

# 激活虚拟环境

conda activate gen6d

# 进入Gen6D工程目录下

cd XXX

# 分割视频

# --transpose 解决图片颠倒

python prepare.py --action video2image --input data/custom/video/people.mp4 --output data/custom/people/images --frame_inter 10 --image_size 960 --transpose

在Gen6D\data\custom\people\images路径下查看分割完成的图片:

图像尺寸进行了缩放,如果图像的尺寸太大,后面会有一系列存储不够等问题。

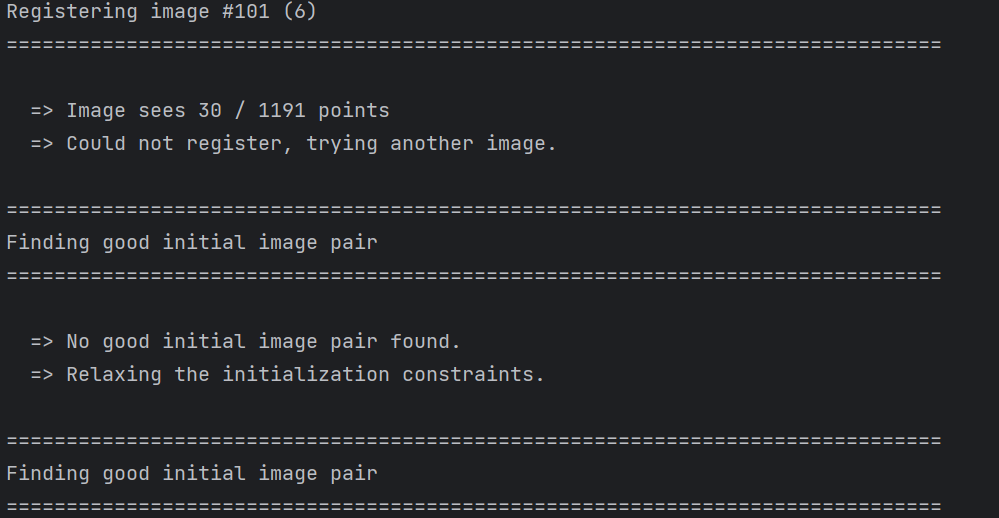

恢复相机姿势

# colmap假如没有添加环境变量就需要colmap.exe的完整路径

python prepare.py --action sfm --database_name custom/people --colmap colmap.exe

手动指定对象区域

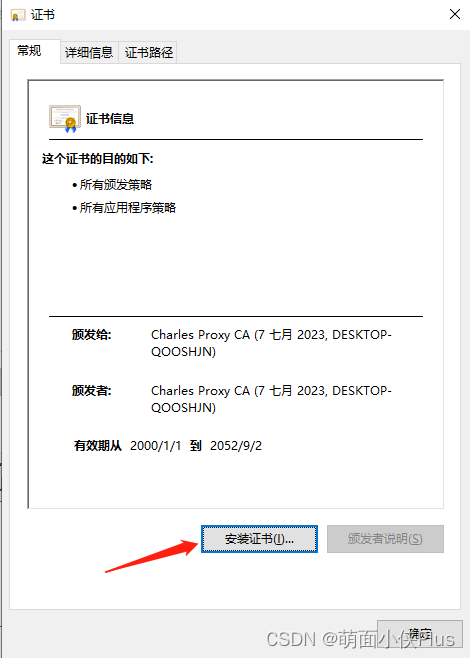

安装CloudCompare

安装CloudCompare,点击Next–>自定义安装路径–>一路默认选择

保存目标对象点云

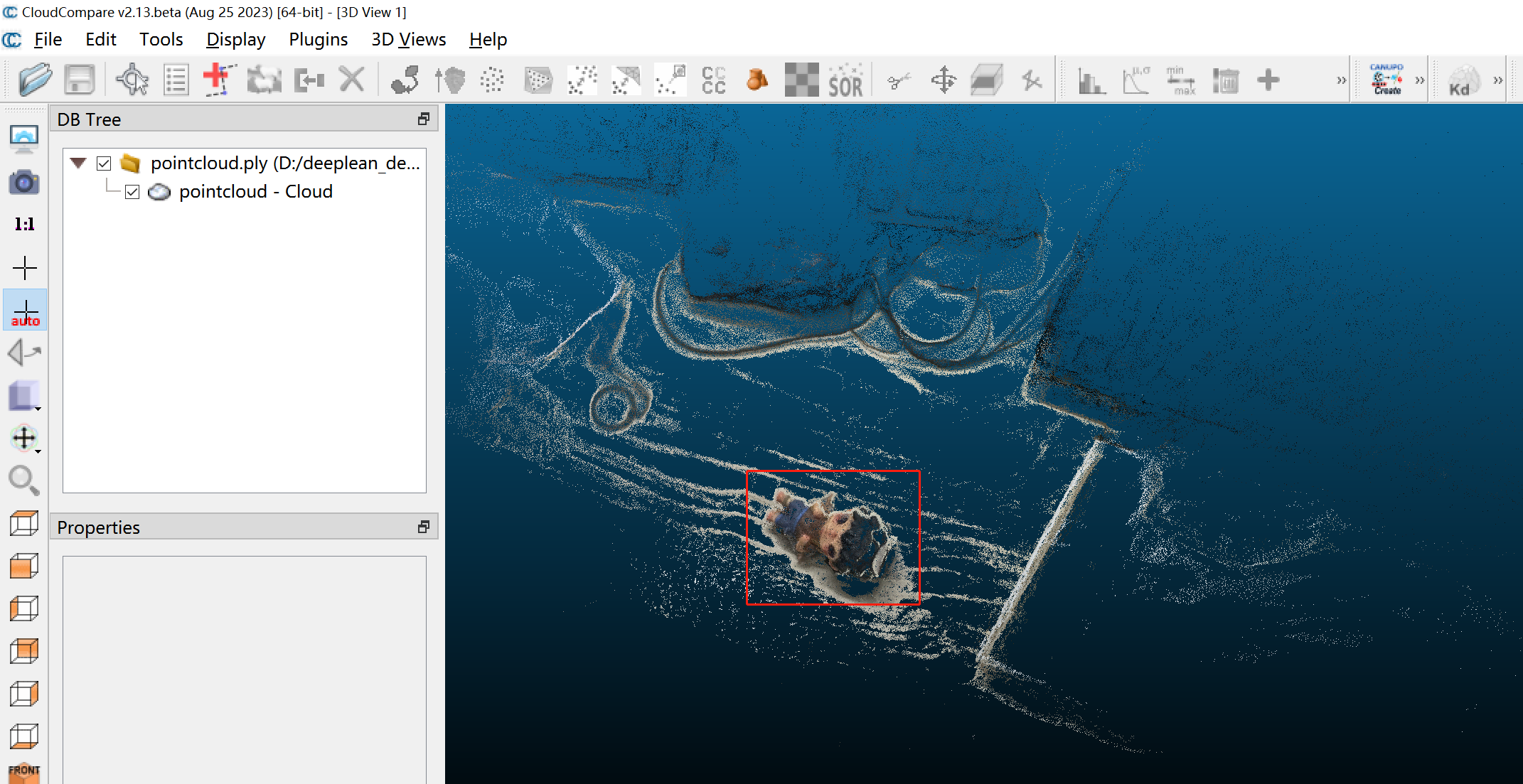

使用CloudCompar打开Gen6D/data/custom/people/colmap/pointcloud.ply:

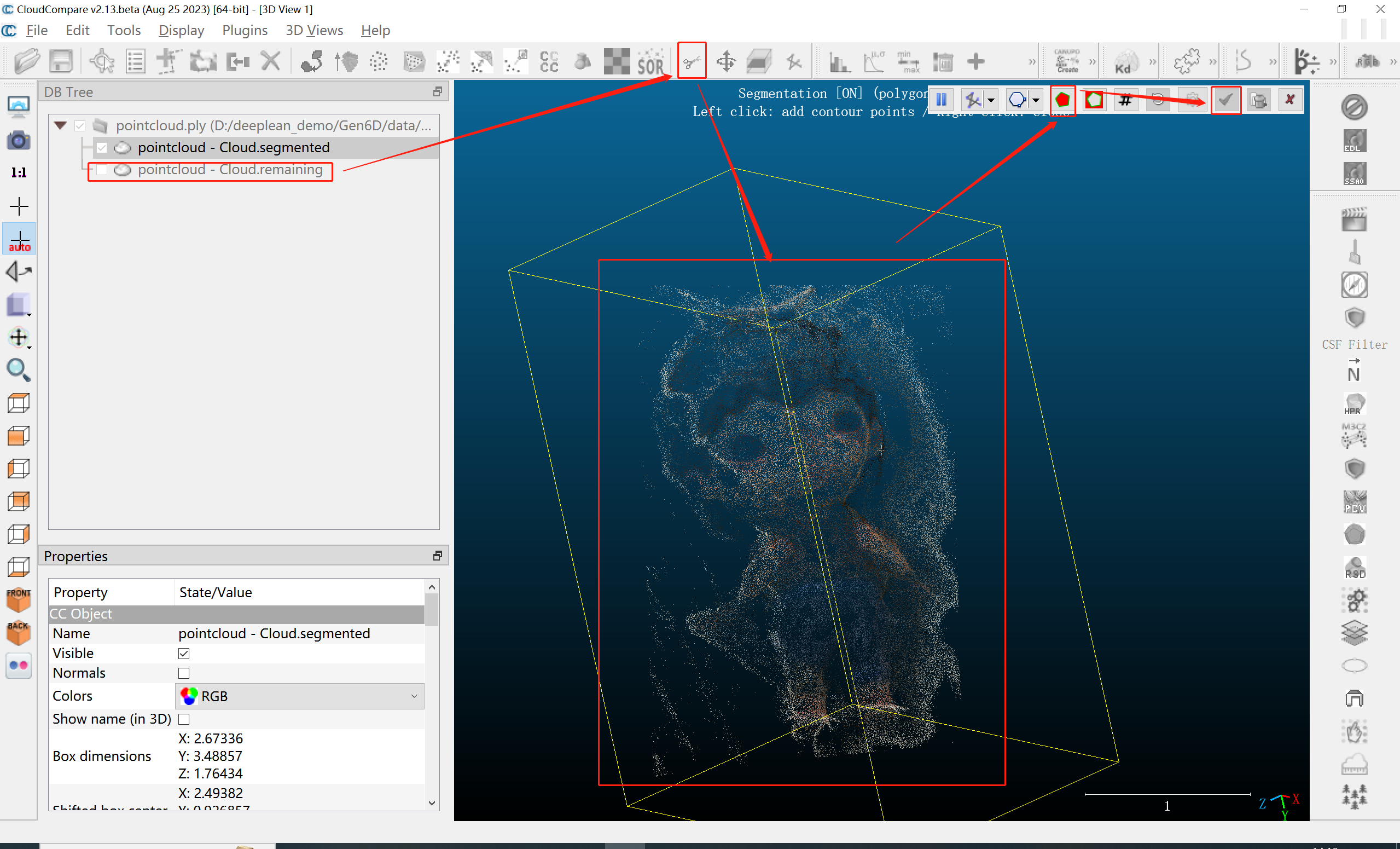

手动指定目标区域:裁剪目标对象点云。

将裁剪后的目标对象点云导出:需要取消remaining部分,只选择segmented,用binary格式保存在Gen6D/data/custom/people/目录下,命名为object_point_cloud.ply。

指定目标对象的X正方向和Z正方向

使用CloudCompar打开刚保存的Gen6D/data/custom/people/object_point_cloud.ply。

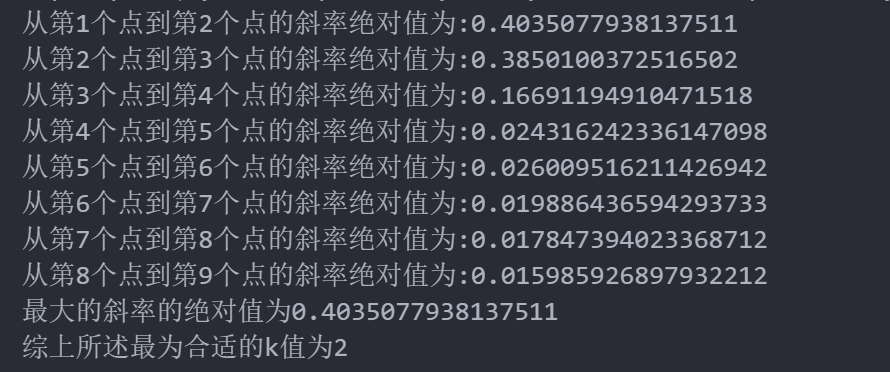

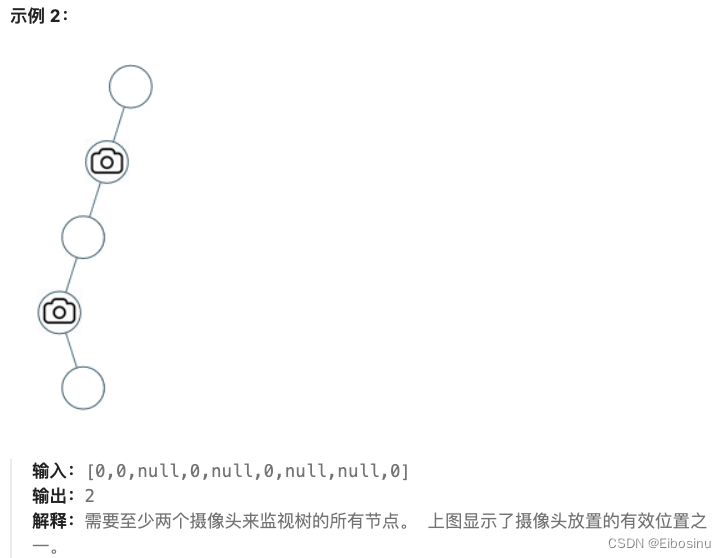

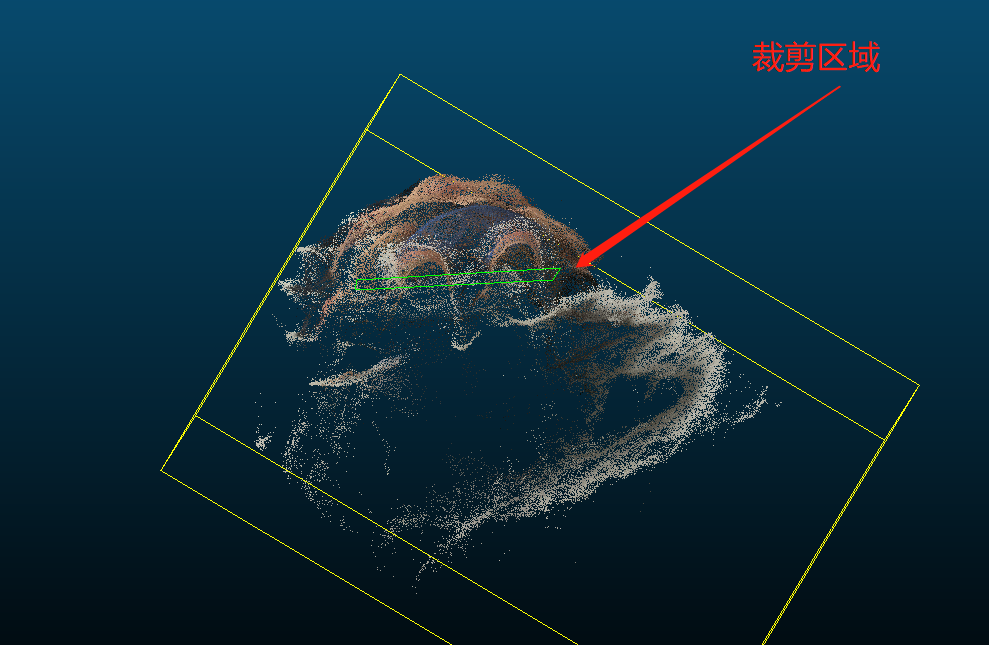

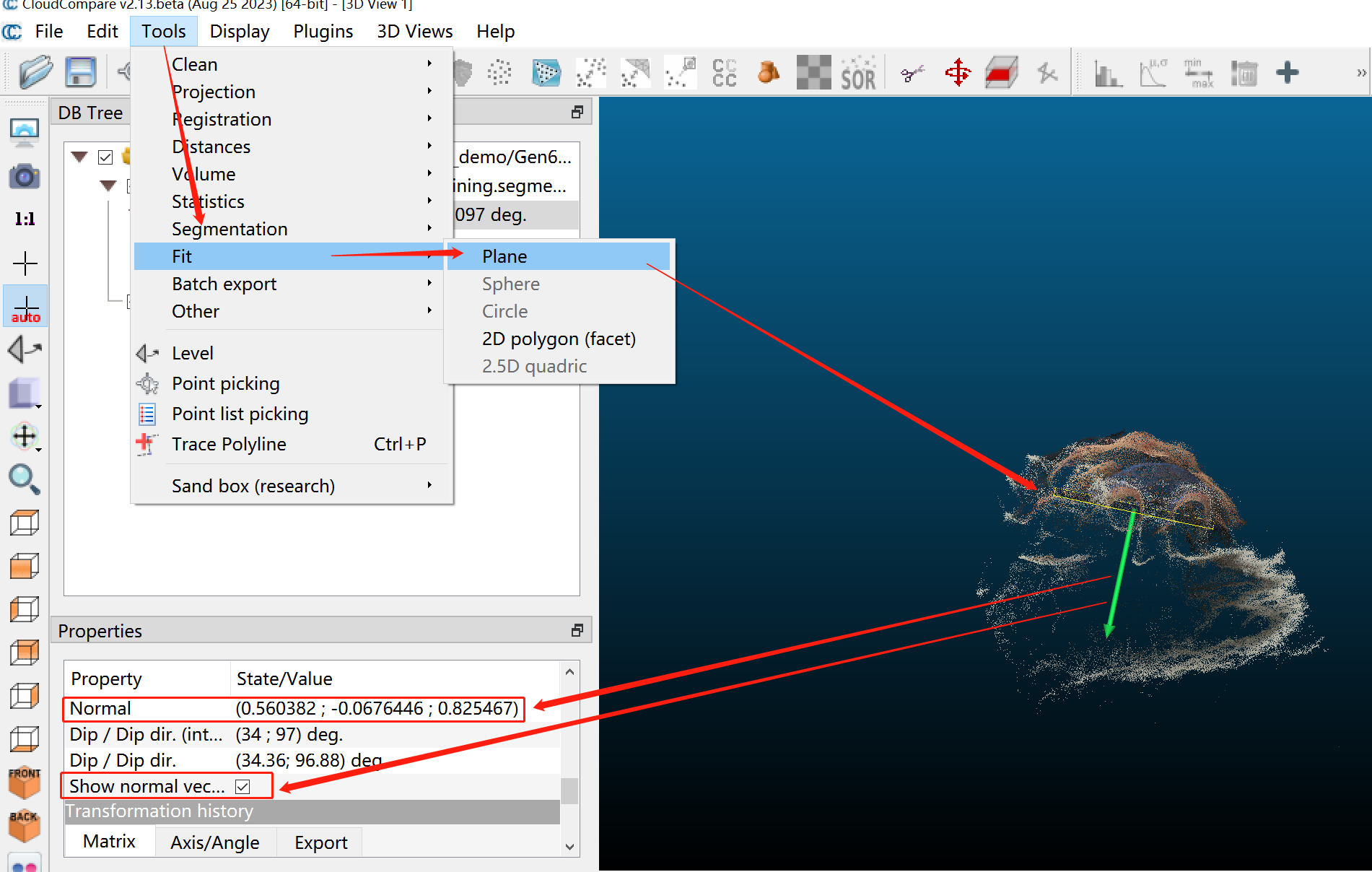

- Z正方向的向量:拟合一个平面,其法线作为Z正方向的向量。

同样先裁剪一片区域: 只选择segmented—>Tools—>Fit—>Plane拟合一个目标物体放置(平行)的水平面,使用其法线作为Z正方向的向量。

只选择segmented—>Tools—>Fit—>Plane拟合一个目标物体放置(平行)的水平面,使用其法线作为Z正方向的向量。

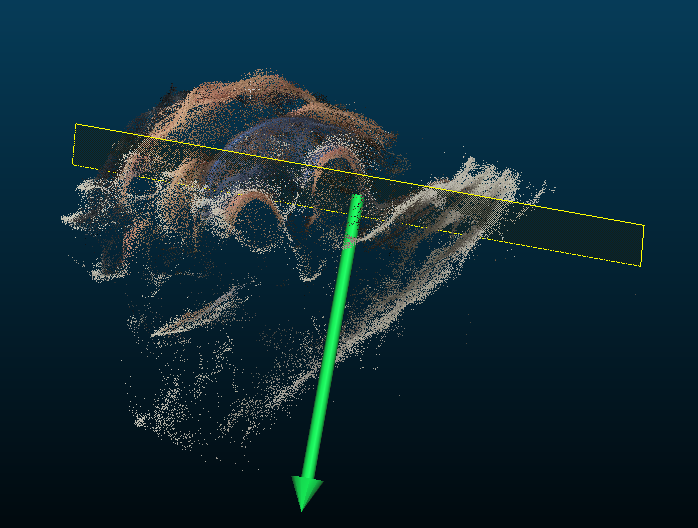

拟合平面是根据所有选中点云拟合的,因此点云的选取十分关键,下图这种就很糟糕,完全不是目标物体所放置的平面。

拟合平面是根据所有选中点云拟合的,因此点云的选取十分关键,下图这种就很糟糕,完全不是目标物体所放置的平面。

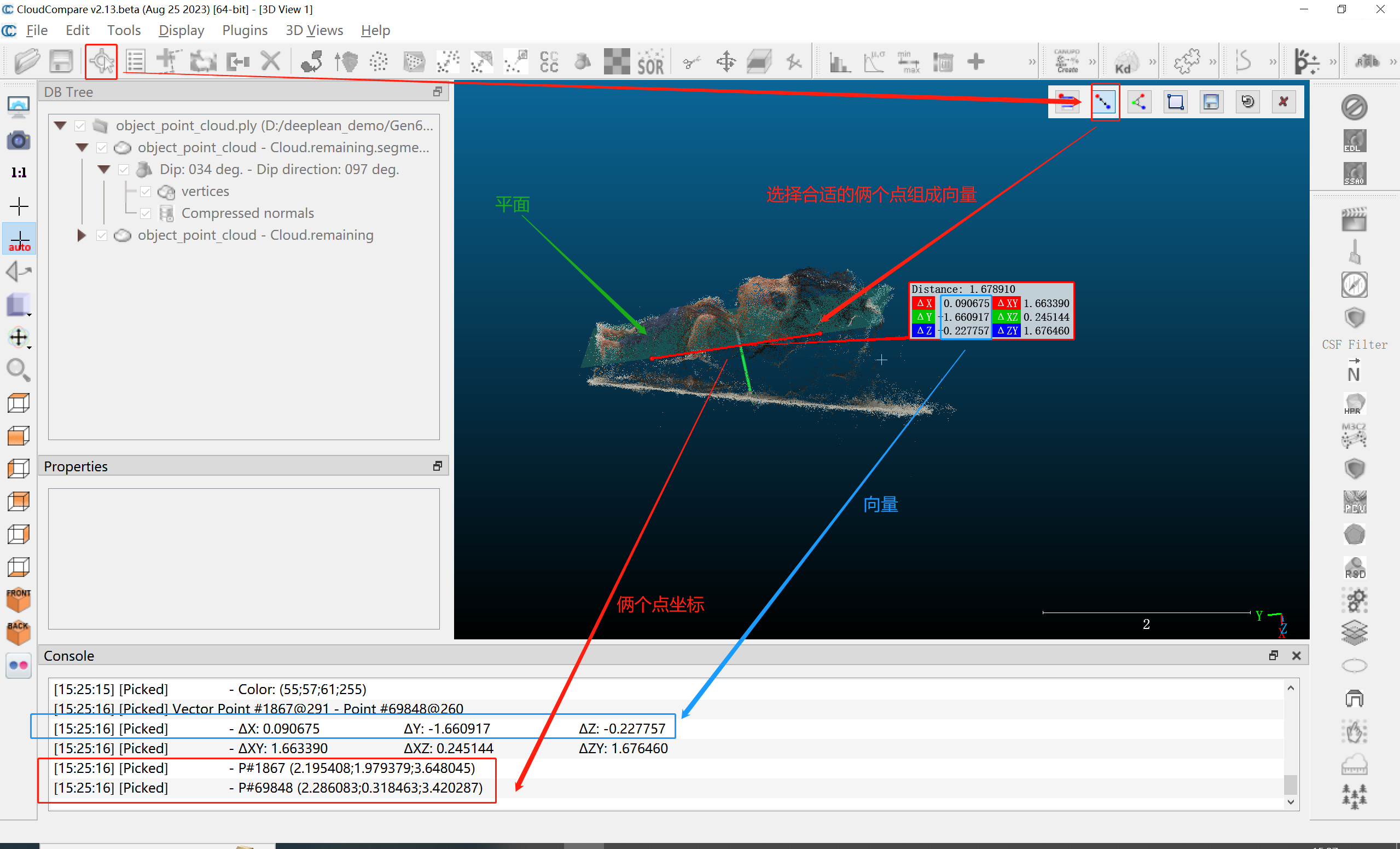

- X正方向的向量:通过选择俩个点计算出X正方向的向量。

在Gen6D/data/custom/people/目录下创建meta_info.txt将X正方向和Z正方向记录下来(好像不能复制粘贴要手打)。0.090675 -1.660917 -0.227757 0.560382 -0.0676446 0.825467

总结

尽可能简单、详细的讲解了基于COLMAP将手机拍摄的视频制作成个人Gen6D测试数据集的流程。