目的:写一个爬虫程序,可以进入http开头的网页,将网页的源代码显示出来.

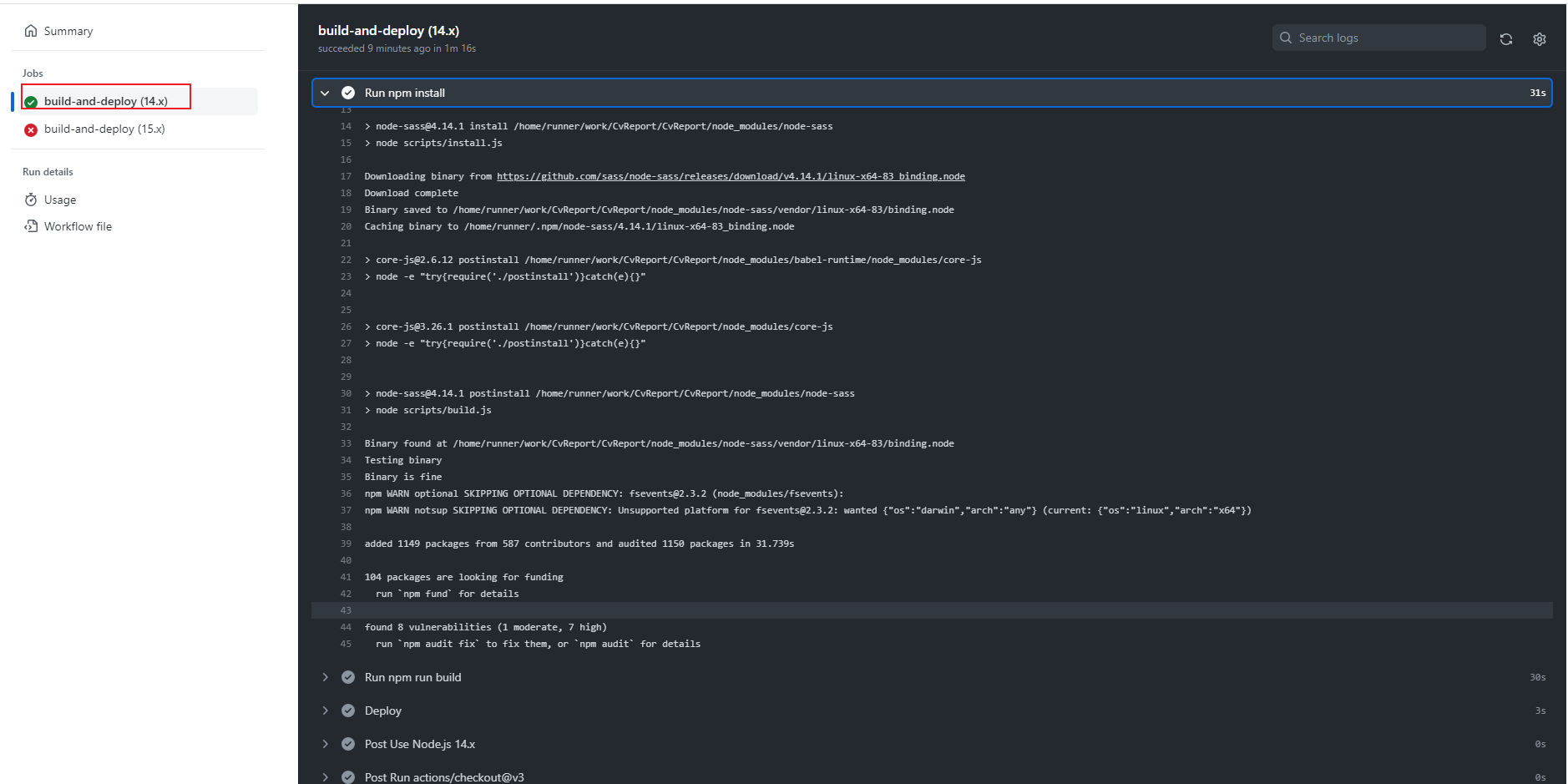

结果展示:

思路:

1.解析网址

2.连接服务器->发请求

3.接收源代码并存储起来

函数:

1.解析网址函数:

http://......./......

//....../之间的字符我们将其存储到urlAddr[]当中

/......之后的字符我们将其存储到urlPath[]当中

//存放网址

char urlAddr[256];

//存放网址后面的路径

char urlPath[256];//解析网址

void analysisAddr(char* str)

{

//每次解析之前先把数组清空

memset(urlAddr,0,256);

memset(urlPath,0, 256);

//找str字符串当中的 "http://" 如果找到则输出"http://"地址给了*p

char* p = strstr(str, "http://");

if (p == NULL)

{

return;

}

p += 7;

//scanf 从cmd输入 sscanf 从第一个参数输入

sscanf(p, "%[^/]%s", urlAddr,urlPath);

printf("网站:%s\n",urlAddr);

printf("网站后面:%s\n", urlPath);

}strstr(str,"http://");的含义在于,先找到str字符串当中"http://"的位置

如果str字符串当中不存在"http://"字符 则返回

否则+7,因为"http://"是7个字符

sscanf从p当前的第一个参数输入,urlAddr字符串的内容一直从p的开端到"/"字符

urlPath字符串的内容是从/之后

然后将两个字符串打印在窗口上.

2.连接服务器->发请求

void connectAddr(char* urlAddr)

{

//设置网络协议版本

//选中按下f12可以看这个函数的内容

WSADATA wsaData;

WSAStartup(MAKEWORD(2,2),&wsaData);

//创建socket

s_socket = socket(AF_INET, SOCK_STREAM, NULL);

//绑定

SOCKADDR_IN addr = { 0 };

addr.sin_family = AF_INET;

int r = bind(s_socket, (sockaddr*)&addr, sizeof addr);

if (r == -1)

{

printf("绑定失败!\n");

return;

}

printf("绑定成功!\n");

//获取主机的IP地址

//从字符串变成一个IP地址

struct hostent* p = gethostbyname(urlAddr);

if (NULL == p)

{

printf("获取主机地址失败!\n");

return;

}

printf("获取主机地址成功!\n");

//把服务器的协议地址zu设置好

memcpy(&addr.sin_addr, p->h_addr, 4);

addr.sin_port = htons(80);

//连接主机

r = connect(s_socket,(sockaddr*)&addr, sizeof addr);

if (-1 == r)

{

printf("连接服务器失败!\n");

}

printf("连接服务器成功!\n");

//发请求

string reqInfo = "GET " + (string)urlPath + "HTTP/1.1\r\nhost:"+

(string)urlAddr + "\r\nConnection:Close\r\n\r\n";

r = send(s_socket, reqInfo.c_str(), reqInfo.size(), NULL);

if (r <= 0)

{

printf("发送失败!\n");

return;

}

printf("发送请求到服务器成功!\n");

}3.接收源代码并存储起来

//接收源代码并存储起

void getHtml()

{

string allHtml;//存放网页源代码的字符串

int r;

char buff[1024];

while (1)

{

//从服务器接收数据并放到buff里

r = recv(s_socket, buff, 1023, NULL);

if (r > 0)

{

buff[r] = 0;//添加结束符号

allHtml += buff;

}

else//没有接到

{

break;

}

}

printf("------------------我们获得的网页源代码如下--------------------");

cout << allHtml << endl;

}可以将上面三个函数封装在一个函数当中

//爬

void snapJpg(char* begAddr)\

{

//解析网址 -> http:// -> pic.yesky.com 网络的IP地址别名 网站的地址和二级地址<二级地址也就是路径>

analysisAddr(begAddr);

//连接服务器

//发请求

connectAddr(urlAddr);

//接收源代码并存储起

getHtml();

}主函数:

int main()

{

char buff[256] = { 0 };//安放网页链接

printf("请输入一个网页链接:");

scanf("%s",buff);

snapJpg(buff);

while (1);

return 0;

}总代码:

#include<graphics.h>

#include<cstdio>

#include<stdio.h>

#include<cstring>

#include<stdlib.h>

#include<winsock2.h>

#pragma comment(lib,"ws2_32.lib")

#include<windows.h>

#include<iostream>

#include<string.h>

using namespace std;

#pragma warning(disable:4996)//忽略4996错误提示

//服务器套接字

SOCKET s_socket;

//存放网址

char urlAddr[256];

//存放网址后面的路径

char urlPath[256];

//连接服务器

//发请求

void connectAddr(char* urlAddr);

//接收源代码并存储起

void getHtml();

//解析网址

void analysisAddr(char*str);

//封装一个爬图片的函数

void snapJpg(char* begAddr);

int main()

{

char buff[256] = { 0 };//安放网页链接

printf("请输入一个网页链接:");

scanf("%s",buff);

snapJpg(buff);

while (1);

return 0;

}

//爬图片

void snapJpg(char* begAddr)\

{

//解析网址 -> http:// -> pic.yesky.com 网络的IP地址别名 网站的地址和二级地址<二级地址也就是路径>

analysisAddr(begAddr);

//连接服务器

//发请求

connectAddr(urlAddr);

//接收源代码并存储起

getHtml();

}

//解析网址

void analysisAddr(char* str)

{

//每次解析之前先把数组清空

memset(urlAddr,0,256);

memset(urlPath,0, 256);

//找str字符串当中的 "http://" 如果找到则输出"http://"地址给了*p

char* p = strstr(str, "http://");

if (p == NULL)

{

return;

}

p += 7;

//scanf 从cmd输入 sscanf 从第一个参数输入

sscanf(p, "%[^/]%s", urlAddr,urlPath);

printf("网站:%s\n",urlAddr);

printf("网站后面:%s\n", urlPath);

}

//连接服务器

void connectAddr(char* urlAddr)

{

//设置网络协议版本

//选中按下f12可以看这个函数的内容

WSADATA wsaData;

WSAStartup(MAKEWORD(2,2),&wsaData);

//创建socket

s_socket = socket(AF_INET, SOCK_STREAM, NULL);

//绑定

SOCKADDR_IN addr = { 0 };

addr.sin_family = AF_INET;

int r = bind(s_socket, (sockaddr*)&addr, sizeof addr);

if (r == -1)

{

printf("绑定失败!\n");

return;

}

printf("绑定成功!\n");

//获取主机的IP地址

//从字符串变成一个IP地址

struct hostent* p = gethostbyname(urlAddr);

if (NULL == p)

{

printf("获取主机地址失败!\n");

return;

}

printf("获取主机地址成功!\n");

//把服务器的协议地址zu设置好

memcpy(&addr.sin_addr, p->h_addr, 4);

addr.sin_port = htons(80);

//连接主机

r = connect(s_socket,(sockaddr*)&addr, sizeof addr);

if (-1 == r)

{

printf("连接服务器失败!\n");

}

printf("连接服务器成功!\n");

//发请求

string reqInfo = "GET " + (string)urlPath + "HTTP/1.1\r\nhost:"+

(string)urlAddr + "\r\nConnection:Close\r\n\r\n";

r = send(s_socket, reqInfo.c_str(), reqInfo.size(), NULL);

if (r <= 0)

{

printf("发送失败!\n");

return;

}

printf("发送请求到服务器成功!\n");

}

//接收源代码并存储起

void getHtml()

{

string allHtml;//存放网页源代码的字符串

int r;

char buff[1024];

while (1)

{

//从服务器接收数据并放到buff里

r = recv(s_socket, buff, 1023, NULL);

if (r > 0)

{

buff[r] = 0;//添加结束符号

allHtml += buff;

}

else//没有接到

{

break;

}

}

printf("------------------我们获得的网页源代码如下--------------------");

cout << allHtml << endl;

}

爬虫 :

限制:http网页服务器

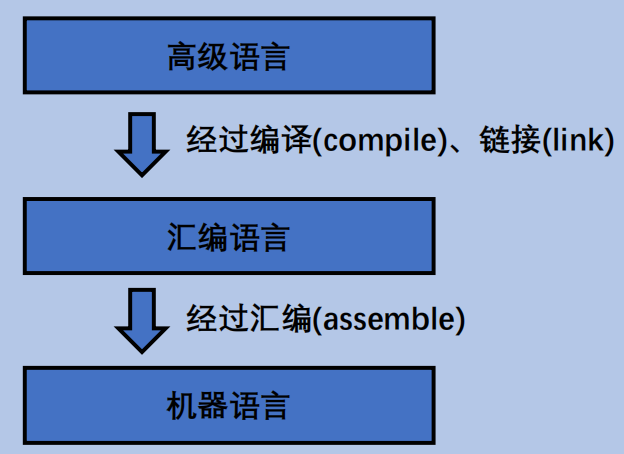

主要知识点:http协议 广度优先遍历算法 stl之map,vector,queue 正则表达式 文件操作

思路: http://.....进入网站页面

获取这个网页的源代码

注意:

搜索http://pic.yesky.com/ 会导致403 Forbidden

403 Forbidden错误一般在爬虫采集数据时出现的频率比较多,在爬虫使用代理IP的时候因为不停地访问服务器终端,频发请求时,服务器终端压力过大,触发了反爬虫机制,导致服务器会拒绝这个IP的访问请求,这个时候如果不切换掉被禁用的IP地址,肯定会影响正常的数据采集效率,所以就需要设置时间来定时切换IP地址。IP代理最核心的功能,就是可以更换各个城市不同的IP地址,而且可以隐藏本地的真实IP地址。

分析爬虫全代码:

引用博客:

C/C++实现最简单的爬虫_Mason_Zhao的博客-CSDN博客_c++实现爬虫

![Zookeeper[1]-Zookeeper介绍与安装以及集群环境准备](https://img-blog.csdnimg.cn/f19a5e1031f64c74bd8aec8685b68db1.png)

![[附源码]Python计算机毕业设计SSM基于Web课堂签到管理系统(程序+LW)](https://img-blog.csdnimg.cn/6b8c6c6687a7407194ff1702f23b5bf6.png)