python爬虫2:requests库-原理

前言

python实现网络爬虫非常简单,只需要掌握一定的基础知识和一定的库使用技巧即可。本系列目标旨在梳理相关知识点,方便以后复习。

目录结构

文章目录

- python爬虫2:requests库-原理

- 1. 概述

- 2. response对象

- 2.1 encoding属性

- 2.2 url属性

- 2.3 status_code属性

- 2.4 cookies属性

- 2.5 request.headers属性

- 2.6 headers属性

- 2.7 text属性

- 2.8 content属性

- 3. GET请求

- 3.1 方法概述

- 3.2 常用参数

- 3.2 参数的用法举例

- 4. POST请求

- 5. 代理设置

- 6. 会话维持

- 7. ssl证书

- 8. 总结

1. 概述

python其实自带一个请求库,即urllib,不过这个库并不是很好使,因此大部人都还是采用的第三方库requests。

Request支持HTTP连接保持和连接池,支持使用cookie保持会话,支持文件上传,支持自动响应内容的编码,支持国际化的URL和POST数据自动编码。

在python内置模块的基础上进行了高度的封装,从而使得python进行网络请求时,变得人性化,使用Requests可以轻而易举的完成浏览器可有的任何操作。

另外,requests的安装十分简单,仅需要pip一下即可:

pip install requests

如果网不好,还可以指定镜像源,下载更快:

pip install requests -i https://pypi.tuna.tsinghua.edu.cn/simple some-package

可以使用以下代码检验是否安装成功:

import requests

# 网址

url = 'https://www.baidu.com'

# 请求

response = requests.get(url)

# 打印返回结果

print(response.content.decode('utf-8'))

返回结果如下:

2. response对象

当我们使用get、post或者其他方式去请求的时候,我们就会得到一个response对象(比如上面测试代码中get函数返回的对象),你可以称呼它为响应对象,下面我们来学习这个对象的常用属性和方法。

2.1 encoding属性

作用: 返回网页的编码格式。

代码:

import requests

# 网址

url = 'https://www.baidu.com'

# 请求

response = requests.get(url)

# 打印返回结果

print(response.encoding)

打印结果为:

ISO-8859-1

这个结果也是编码的一种,不过是我们国内的标准,其他常见的有utf-8之类的。

2.2 url属性

作用: 返回响应服务器的url。

代码:

import requests

# 网址

url = 'https://www.baidu.com'

# 请求

response = requests.get(url)

# 打印返回结果

print(response.url)

打印结果为:

https://www.baidu.com/

不要小瞧这个属性。有时候我们访问的是:http://www.test.com,但是由于这个网站有重定向,因此我们实际访问的是: http://www.good.com ,这样我们通过这个属性确定我们真实访问的网址。

2.3 status_code属性

作用: 返回响应的状态码。

代码:

import requests

# 网址

url = 'https://www.baidu.com'

# 请求

response = requests.get(url)

# 打印返回结果

print(response.status_code)

打印结果为:

200

什么是状态码?

简单来说就是你访问的这个网站状态怎么样,是正常访问,还是说服务器错误,还是网络有问题等等。

这里介绍一下常见的相应状态码:

2xx | 正常

3xx | 重定向

4xx | 错误

5xx | 服务器错误

2.4 cookies属性

作用: 返回cookie对象。

代码:

import requests

# 网址

url = 'https://www.baidu.com'

# 请求

response = requests.get(url)

# 打印返回结果

print(response.cookies)

打印结果:

<RequestsCookieJar[<Cookie BDORZ=27315 for .baidu.com/>]>

什么是cookie?

这里简单说明一下什么是cookie,可以简单理解为一个存在我们电脑本地的临时身份文件,比如你访问一个网站,你首次登录了它,然后你把这个网站关掉,再次打开,发现不需要重新登录,这就是cookie发挥了作用,当你登陆后,在本地创建了一个临时文件用于后期登录。

2.5 request.headers属性

作用: 返回请求头。

代码:

import requests

# 网址

url = 'https://www.baidu.com'

# 请求

response = requests.get(url)

# 打印返回结果

print(response.request.headers)

打印的值为:

{'User-Agent': 'python-requests/2.31.0', 'Accept-Encoding': 'gzip, deflate', 'Accept': '*/*', 'Connection': 'keep-alive'}

什么是请求头?

简单来说,你访问一个网站,比如百度搜索,你肯定会搜索某个东西,那么自然你请求这个网站,发送给这个网站的信息中带有这个东西,我们一般称之为请求头,其包含了你所请求的所有信息。

从上面的返回值可以看出一点:百度网站知道你是python脚本,从'User-Agent': 'python-requests/2.31.0'就可以看出。因此,我们写爬虫的时候必须要做一定的伪装,不然直接就被识别出来是爬虫了。

2.6 headers属性

作用: 返回响应头。

代码:

import requests

# 网址

url = 'https://www.baidu.com'

# 请求

response = requests.get(url)

# 打印返回结果

print(response.headers)

打印结果:

{'Cache-Control': 'private, no-cache, no-store, proxy-revalidate, no-transform', 'Connection': 'keep-alive', 'Content-Encoding': 'gzip', 'Content-Type': 'text/html', 'Date': 'Fri, 04 Aug 2023 05:36:28 GMT', 'Last-Modified': 'Mon, 23 Jan 2017 13:23:55 GMT', 'Pragma': 'no-cache', 'Server': 'bfe/1.0.8.18', 'Set-Cookie': 'BDORZ=27315; max-age=86400; domain=.baidu.com; path=/', 'Transfer-Encoding': 'chunked'}

什么是响应头?

响应头就是服务器/网站自身返回给我们的部分信息、

2.7 text属性

作用: 返回网页的源码,但是是按照chardet模块推测出的编码进行解码的结果(不准确)。

代码:

import requests

# 网址

url = 'https://www.baidu.com'

# 请求

response = requests.get(url)

# 打印返回结果

print(response.text)

返回结果:

<!DOCTYPE html>

<!--STATUS OK--><html> <head><meta http-equiv=content-type content=text/html;charset=utf-8><meta http-equiv=X-UA-Compatible content=IE=Edge><meta content=always name=referrer><link rel=stylesheet type=text/css href=https://ss1.bdstatic.com/5eN1bjq8AAUYm2zgoY3K/r/www/cache/bdorz/baidu.min.css><title>ç™¾åº¦ä¸€ä¸‹ï¼Œä½ å°±çŸ¥é“</title></head> <body link=#0000cc> <div id=wrapper>

....

# 部分结果

说明:text返回的是网页源码,但是解码时是推测的,有时候并不准确。因此,我们更加常用content属性,加上自己解码,更加准确。

2.8 content属性

作用: 返回网页源代码的bytes形式的结果。

代码:

import requests

# 网址

url = 'https://www.baidu.com'

# 请求

response = requests.get(url)

# 打印返回结果

print(response.content.decode('utf-8'))

打印的部分结果:

<!DOCTYPE html>

<!--STATUS OK--><html> <head><meta http-equiv=content-type content=text/html;charset=utf-8><meta http-equiv=X-UA-Compatible content=IE=Edge><meta content=always name=referrer><link rel=stylesheet type=text/css href=https://ss1.bdstatic.com/5eN1bjq8AAUYm2zgoY3K/r/www/cache/bdorz/baidu.min.css><title>百度一下,你就知道</title></head> <body link=#0000cc> <div id=wrapper> <div id=head>

....

# 部分结果

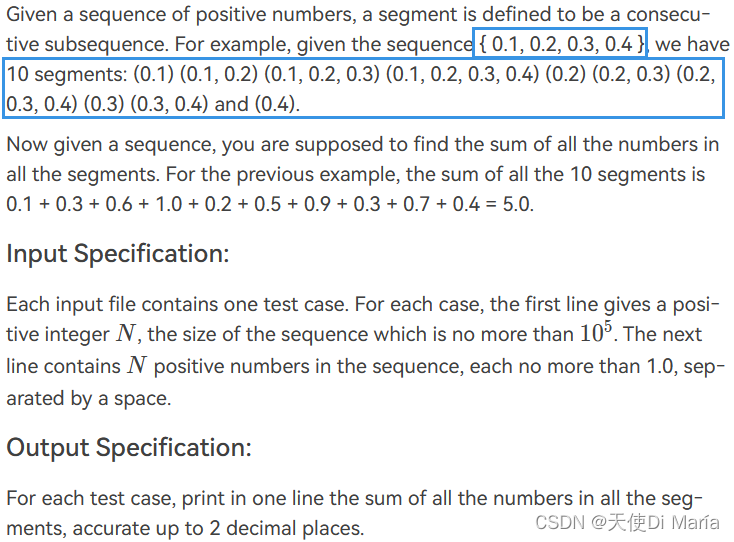

如何判断网页编码形式?

这个简单,随便打开一个网页,比如百度,点击鼠标右键,查看源码,找到下图中的内容(html网页源码整体框架是固定的,因此你在任何网页上都可以找到类似的内容):

3. GET请求

3.1 方法概述

get请求是平时我们最常用的请求方式之一。在requests模块中,提供给我们了非常方便的get请求方式:

import requests

url = 'http://www.baidu.com'

response = requests.get(url)

print(response.status_code)

3.2 常用参数

| 参数 | 作用 |

|---|---|

| url | 请求的地址 |

| headers | 请求头参数(字典) |

| params | 请求的参数(字典) |

| cookies | 请求的cookies参数(字典) |

| timeout | 超时时间设置 |

3.2 参数的用法举例

这里举一个简单的例子,来说明一下这些参数怎么用。

之前不是说了嘛,直接用脚本去访问百度网站,会被识别出是python脚本,因此我们可以利用请求头参数进行简单的伪装:

import requests

# 地址

url = 'https://www.baidu.com'

# 伪造请求头

headers = {

'User-Agent' : 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/115.0.0.0 Safari/537.36',

}

# 访问

response = requests.get(url,headers=headers)

# 打印

print(response.request.headers)

注意:传入的参数必须为字典形式,内容必须符合请求头的内容。

打印的结果如下:

{'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/115.0.0.0 Safari/537.36', 'Accept-Encoding': 'gzip, deflate', 'Accept': '*/*', 'Connection': 'keep-alive'}

可以看出,确实伪造成功了。

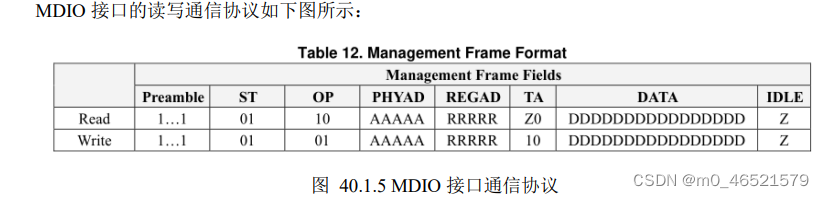

如何正确书写请求头格式?

这一点很重要也很简单,你随便打开一个网页,鼠标右键,选择”检查“(Google浏览器为例),然后按下图操作,即可看见请求头内容:

这里我介绍一下最常见的请求头参数内容:

User-Agent : 客户端浏览器的版本信息

Host : 服务器的主机

Referer:表示从哪个页面跳转到当前的页面

Cookie:用于记录客户端的身份信息,例如通过cookie登录网站

x-forward-for:表示客户端的IP地址,一般被称为”XXF“头,服务器通过这个字段可以知道客户端的真实IP或代理IP

(params参数后面单独出一个案例讲解)

4. POST请求

post请求也是我们网站中最常用的请求方式之一,一般提交表单几乎都是post请求。而,在requests模块中,post请求与get请求的使用方法上差别在于参数(params变为了data,headers参数和其他参数是相同的):

data: 接收一个字典,里面爬虫发出的数据

5. 代理设置

使用代理,可以减少我们自己真实IP暴漏的概率。

简单来说,代理就是使用别人IP来访问网站,这样网站如果进行检测,只能检测到别人的IP地址,根本不知道其实是你在访问他的网站。

一般代理IP按照匿名程度分为:

- 高匿:

- 别人不知道你的真实IP

- 透明:

- 别人知道你的真实IP

而,在requests库中,get、post请求方法中都有一个参数 proxies ,这个参数就是设置代理使用的。

使用方法如下:

import requests

proxies = {

'http/https':'http/https:ip:port',

'http/https':'http/https:ip:port',

'http/https':'http/https:ip:port',

'http/https':'http/https:ip:port'

}

requests.get(url,proxies=proxies)

当我们需要追求效率时,除了可以采用多任务的方式,还有一个方式就是使用代理。比如我们需要下载图片,为了不被网站检测出我们是爬虫,我们不得不牺牲效率,比如说每爬取一张图片就休息一秒钟,这样的效率显然很低。但是一旦我们一秒钟爬取个几百张图片,非常容易被网站检测出这个用户不是一个人,因为真正的人不可能一秒钟下载几百张图片,于是网站便会短时间封禁我们的ip,导致我们无法继续访问,以至于爬虫失效。

这时我们需要代理,这样我们就可以在爬取的时候使用不同的ip地址了。

那么总结一下,为什么需要代理呢?

- 减少自己真实IP暴漏的概率

- 可以使用多个代理IP来实现快速访问

因为,现在的网站几乎都会屏蔽速度过快的访问,比如一秒几十次乃至几百、上千万次的访问,这样的访问一看就不正常,因此站长几乎都会屏蔽乃至禁止你的IP,因此我们可以使用多个代理IP,比如我们使用100个,那么我们每秒就会访问100次都不会有任何的问题

6. 会话维持

我们有时候遇见一些网站会强制你登录才能去获取数据。此时你知道想要登录网站需要去使用post方式请求,但是当你请求成功后再用get方式去访问网站,你会发现你被拒绝了,这意味着你的get请求是一个新的请求,而不是在post请求成功后以post为基础的请求。如果你无法理解上面的话,你可以这样理解,一个get就是打开一个浏览器,两个浏览器之间是无法通信的,所以你第二次请求相当于打开一个新的浏览器,自然无法获取内容。

因此,我们需要一些方法来搞定这个问题。

参考代码如下:

#下面给出的是思路,不是具体的代码,具体的代码还是根据实际案例来讲

import requests

#创建session对象

session = requests.session()

#使用session对象去发送post请求

session.post(.....) #这里post的用法和requests.post()用法一致

#请求成功后再用session对象去请求只有登录才能访问的页面

response = session.get(....) #这里post的用法和requests.get()用法一致

#接下来再去操作即可

(这个也会单独出一篇讲解案例)

7. ssl证书

有时候,我们的爬虫需要忽略ssl证书,即我们手动访问的时候会显示这个网页不安全/ssl证书过期等提示。

忽略的方法很简单,参考如下:

import requests

response = requests.get('https://www.baidu.com',verify=False)

print(response.status_code)

8. 总结

本篇文章主要梳理了requests常用方法,接下来的文章会对本文中涉及的一些方法进行举例说明。

![cordova 12 编译失败Could not find method compile() for arguments [com....]](https://img-blog.csdnimg.cn/bca2d04c468341308f92dc408fb31e51.png)