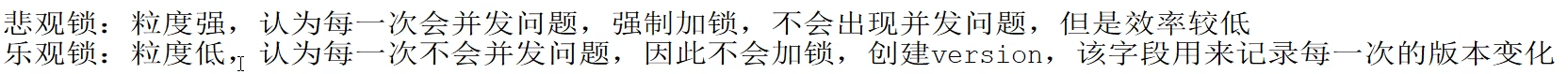

1.什么是饱和(非饱和)激活函数

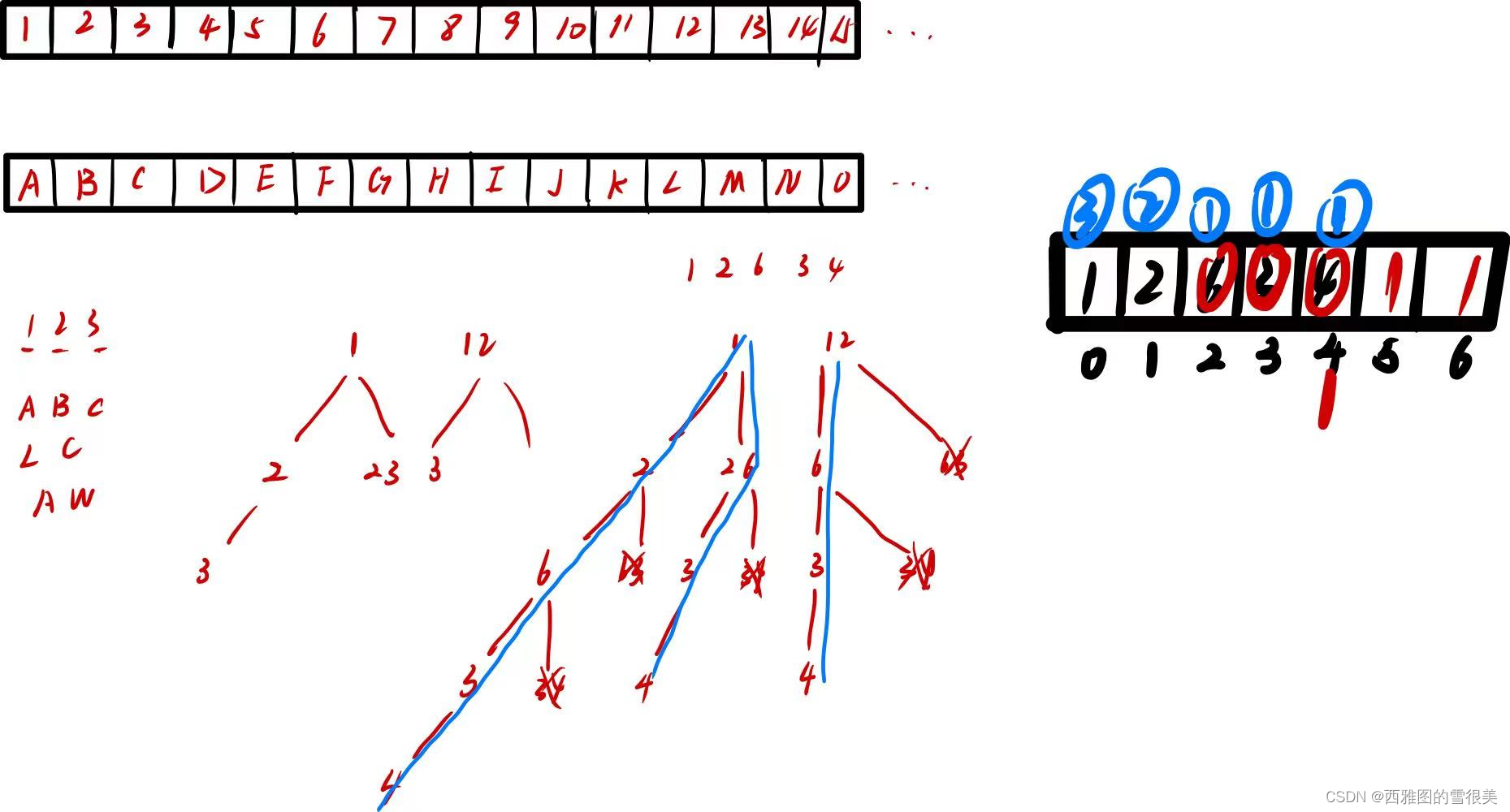

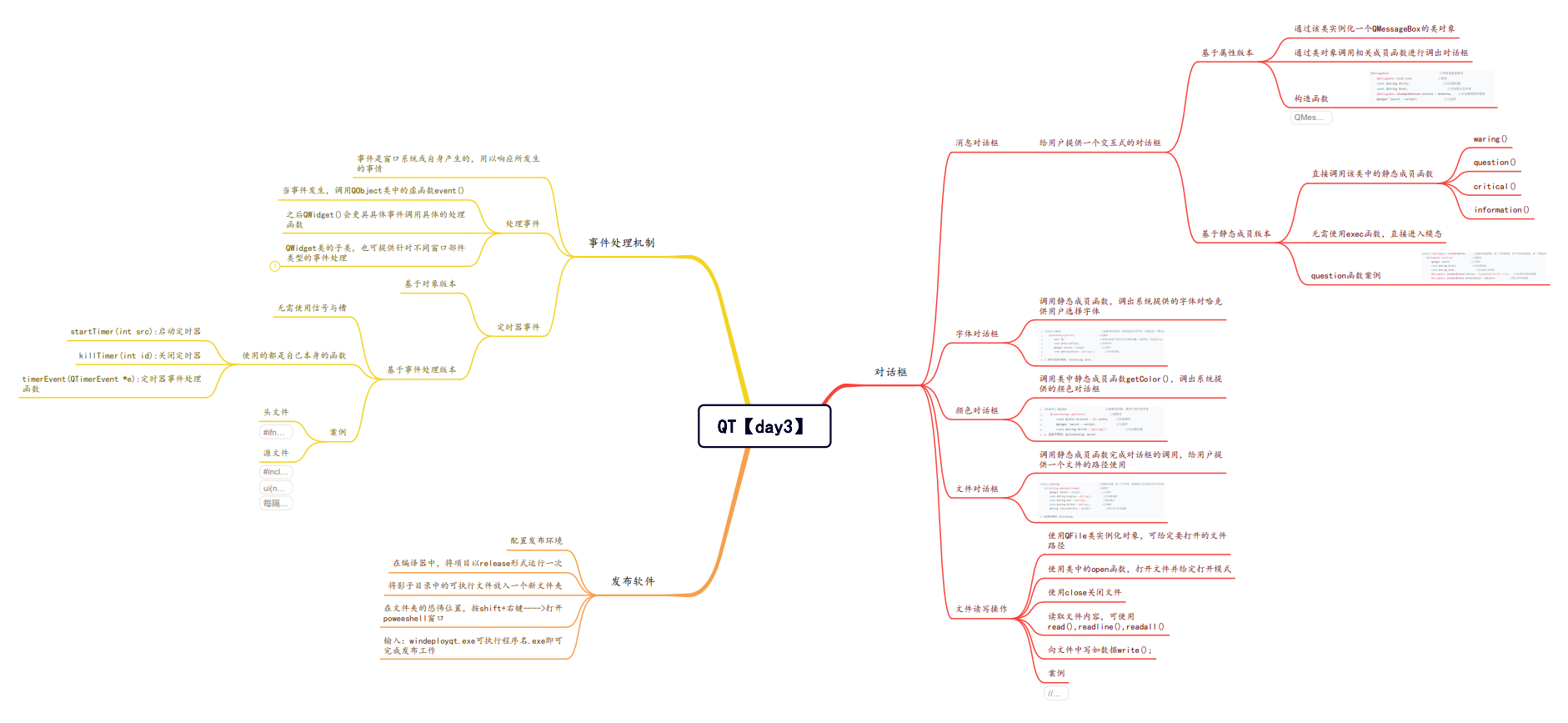

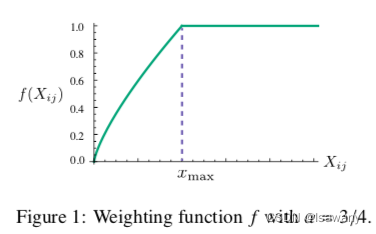

若h(x)满足:![]() ,则h(x)称为饱和激活函数,例如sigmoid和tanh,否则为非饱和激活函数,例如Relu及其变体。

,则h(x)称为饱和激活函数,例如sigmoid和tanh,否则为非饱和激活函数,例如Relu及其变体。

2.非饱和激活函数的优势有两点

- 能解决所谓的“梯度消失”问题

- 加快模型收敛速度

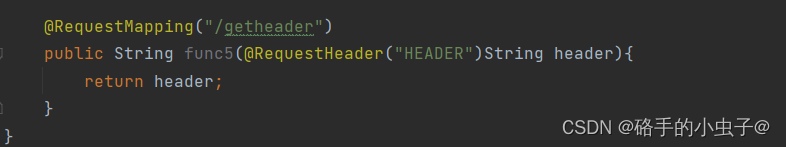

3.ReLU(Rectified Linear Units)

- 由于其线性、非饱和的形式,能够加速收敛

- 比起sigmoid和tanh中的指数运算,relu计算简单

- x>0是,梯度始终为1,有效缓解了梯度弥散、梯度爆炸

- 提供了神经网络的稀疏表达能力(relu会使部分神经元的输出为0,减轻可神经元之间的过度依赖问题,缓解了过拟合问题的发生

缺点: - Dead ReLU Problem:随着训练的进行,神经出现“死亡”,流经神经元的梯度从这一点开始将永远为0,导致权重无法继续更新