1、卷积神经网络cnn究竟是怎样一步一步工作的

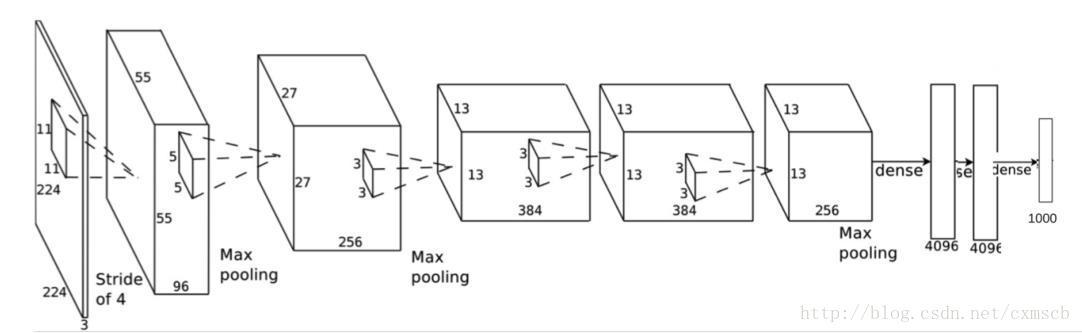

用一个卷积核滑动图片来提取某种特征(比如某个方向的边),然后激活函数用ReLU来压制梯度弥散。对得到的结果用另一个卷积核继续提取+reLU,然后池化(保留区域最大或者用区域平均来替换整个局部区域的值,保证平移不变性和一定程度上对过拟合的压制)

之后“深度”的话,就会需要对池化后的结果继续用不同的卷积核进行 “卷积+relu”再池化的工作。最后得到的实质是一个图片的深度特征,然后实际分类需要另外加一层,一般是softmax。

(也就是说如果对一个现成的已经训练完毕的卷积神经网络模型,只保留除了最后一层之外的部分,然后输入训练图片,把网络的输出重新送入一个多类的SVM再训练,最后也能得到差不多的结果,取决于svm的参数。)

2、卷积神经网络通俗理解

卷积神经网络通俗理解如下:

卷积神经网络(CNN)-结构

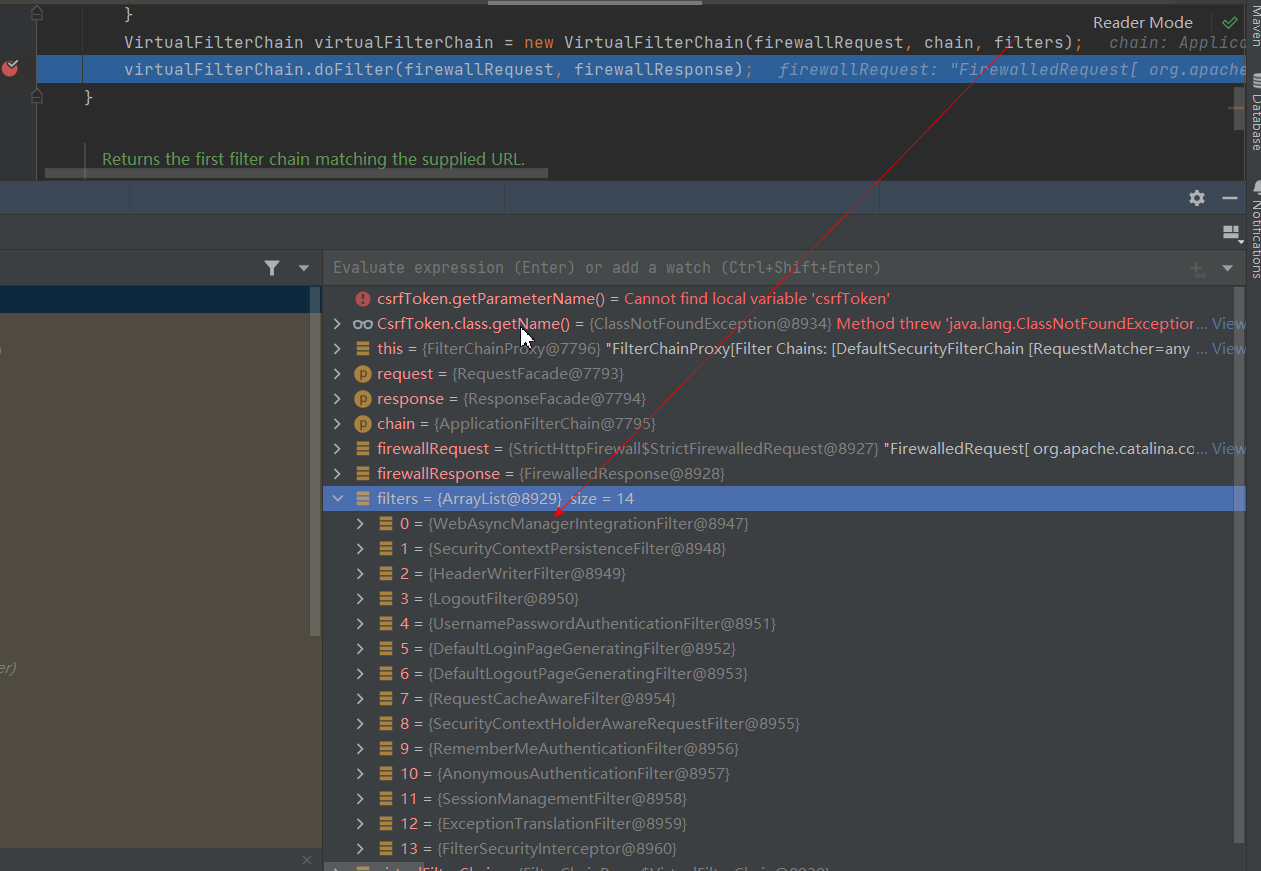

① CNN结构一般包含这几个层:

② 中间还可以使用一些其他的功能层:

卷积神经网络(CNN)-输入层

① CNN的输入层的输入格式保留了图片本身的结构。

② 对于黑白的 28×28的图片,CNN 的输入是一个 28×28 的二维神经元。

③ 对于 RGB 格式的 28×28 图片,CNN 的输入则是一个3×28×28 的三维神经元(RGB中的每一个颜色通道都有一个 28×28 的矩阵)

2)卷积神经网络(CNN)-卷积层

-

输入层:用于数据的输入

-

卷积层:使用卷积核进行特征提取和特征映射

-

激励层:由于卷积也是一种线性运算,因此需要增加非线性映射

-

池化层:进行下采样,对特征图稀疏处理,减少数据运算量卷积神经网络的模型怎么用。

-

全连接层:通常在CNN的尾部进行重新拟合,减少特征信息的损失

-

输出层:用于输出结果

-

归一化层(Batch Normalization):在CNN中对特征的归一化

-

切分层:对某些(图片)数据的进行分区域的单独学习

-

融合层:对独立进行特征学习的分支进行融合

-

请点击输入图片描述

-

感受视野

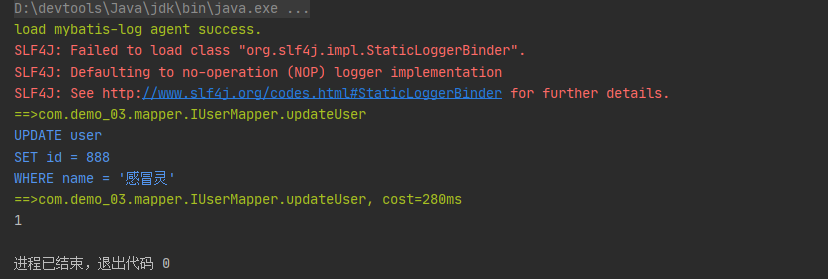

① 在卷积层中有几个重要的概念:

② 假设输入的是一个 28×28 的的二维神经元,我们定义 5×5 的 一个 local receptive fields(感受视野),即 隐藏层的神经元与输入层的 5×5 个神经元相连,这个 5*5 的区域就称之为 Local Receptive Fields,

-

local receptive fields(感受视野)

-

shared weights(共享权值)

![[附源码]Python计算机毕业设计SSM基于旅游服务平台(程序+LW)](https://img-blog.csdnimg.cn/9065ba7b472b4fd88ff50972910f3388.png)