单机版本

上传对应文件,解压文件,并查看

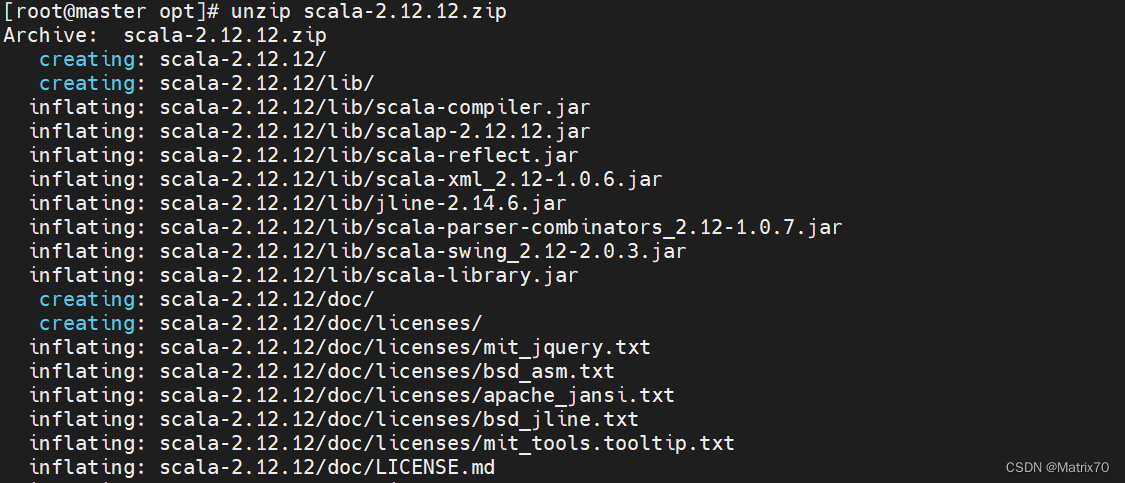

unzip scala-2.12.12.zip

tar -xzf spark-3.2.0-bin-hadoop2.7.tgz

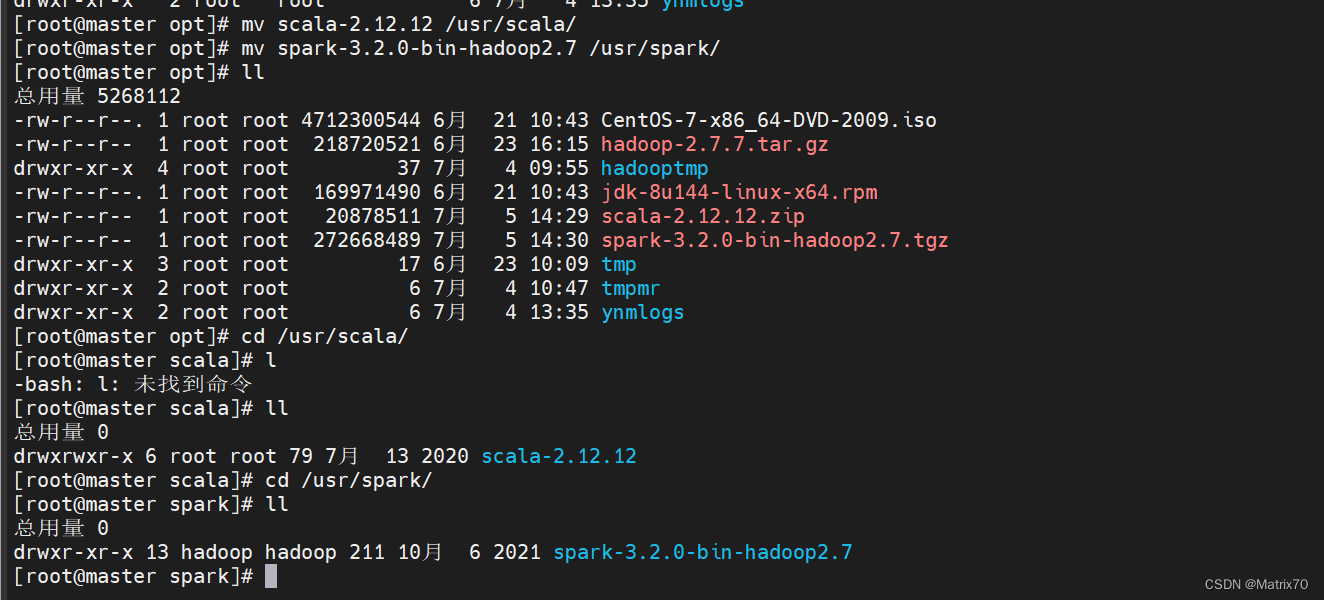

移动scala及spark安装包到指定目录下

在opt目录下移动该文件到/usr目录下

mv scala-2.12.12 /usr/scala/

mv spark-3.2.0-bin-hadoop2.7 /usr/spark/

配置环境变量

配置环境变量

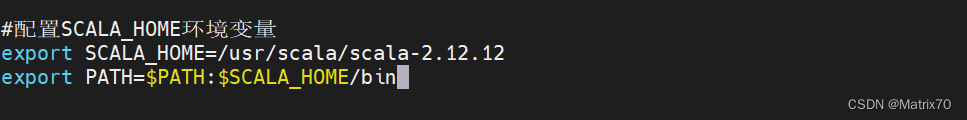

配置scala环境变量

编辑配置文件

vi /etc/profile

#配置SCALA_HOME环境变量

export SCALA_HOME=/usr/scala/scala-2.12.12

export PATH=$PATH:$SCALA_HOME/bin

保存退出,并source使其生效

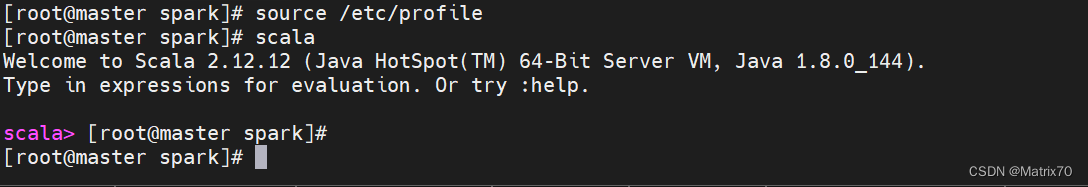

source完毕后输入scala并回车,验证scala配置是否成功,出现如下内容说明配置成功。

source /etc/profile

配置Spark环境变量

编辑配置文件

vi /etc/profile

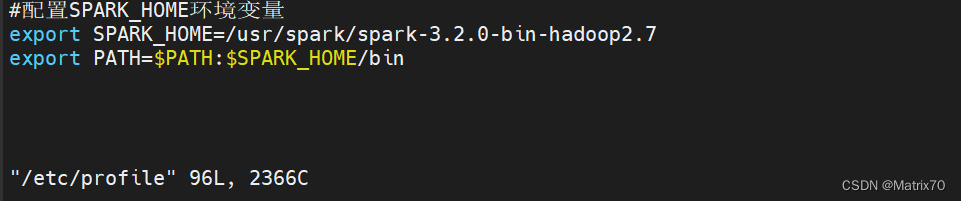

#配置SPARK_HOME环境变量

export SPARK_HOME=/usr/spark/spark-3.2.0-bin-hadoop2.7

export PATH=$PATH:$SPARK_HOME/bin

保存退出,并source使其生效

source

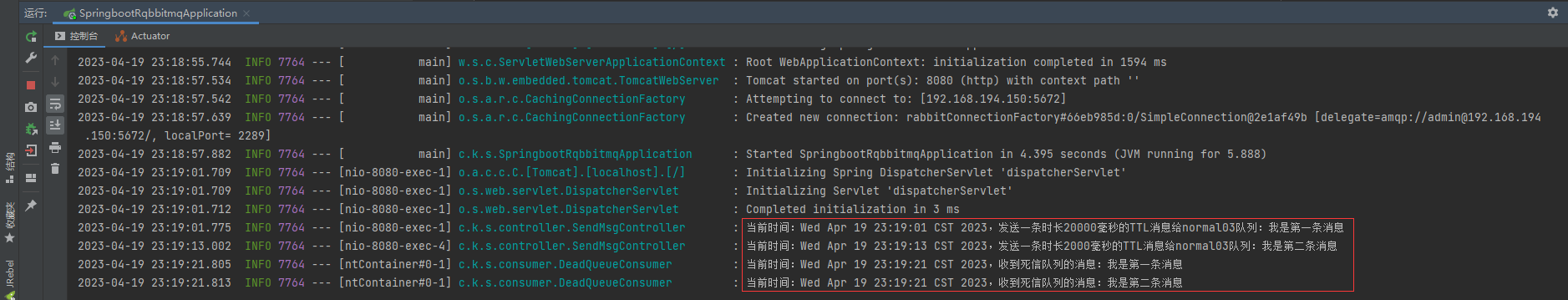

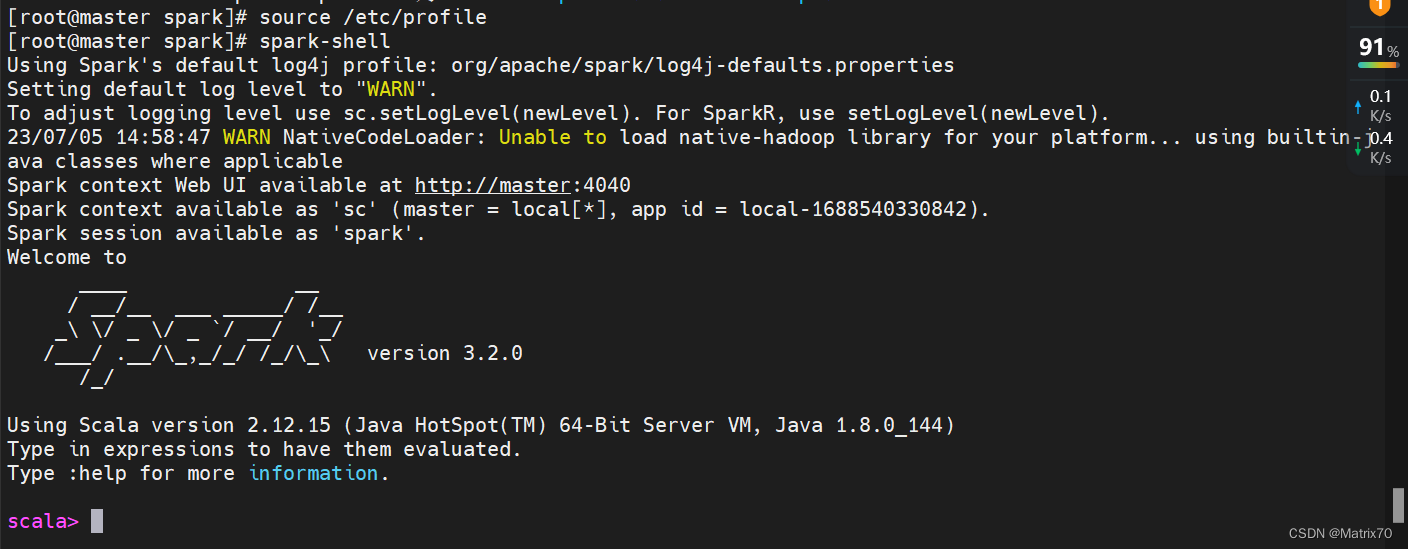

完毕后输入spark-shell并回车,验证spark配置是否成功,出现如下内容说明配置成功。

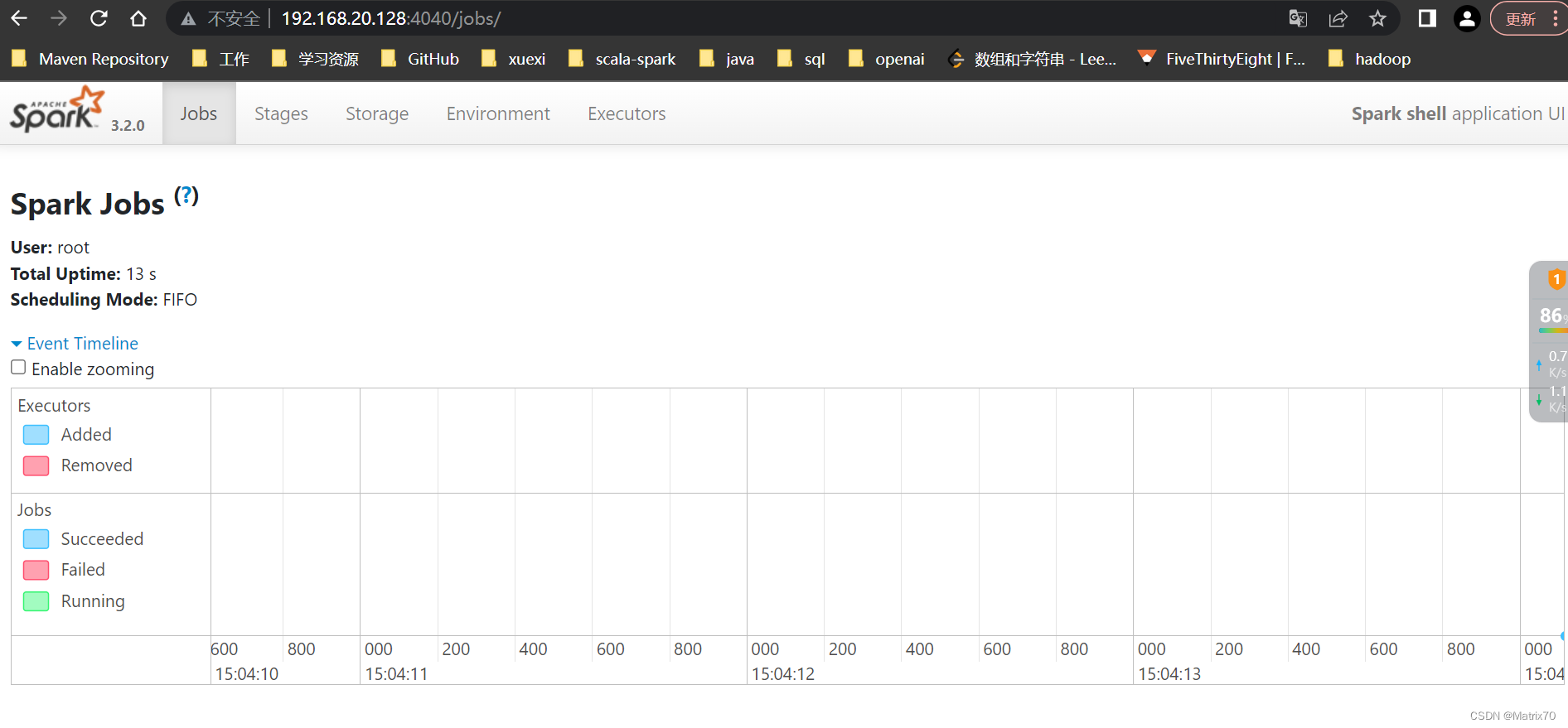

当启动spark完毕,我们可以在主机界面看到单机版版本Spark-UI界面

http://192.168.20.128:4040/jobs/

集群版本

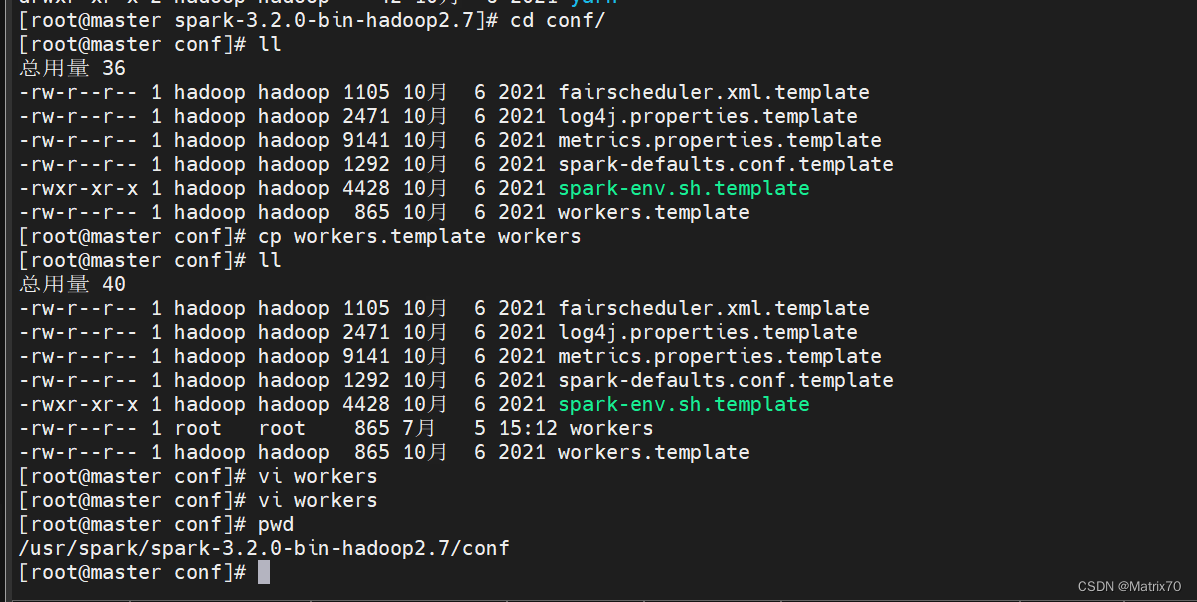

修改对应配置文件workers.tmplate,加入主机名

进入到/usr/spark/spark-3.2.0-bin-hadoop2.7/conf,操作如下

cp workers.template workers

vi workers

(注:低版本的spark是slaves.template)

修改对应配置文件spark-env.sh.template为spark-env.sh

cp spark-env.sh.template spark-env.sh

vi spark-env.sh

#配置Java环境变量

export JAVA_HOME=/usr/java/jdk1.8.0_144

#配置hadoop环境变量

export HADOOP_HOME=/usr/local/hadoop-2.7.7

export PATH=.:$HADOOP_HOME/bin:$JAVA_HOME/bin:$PATH

export HADOOP_CONF_DIR=/usr/local/hadoop-2.7.7/etc/hadoop

#配置SCALA_HOME环境变量

export SCALA_HOME=/usr/scala/scala-2.12.12

export PATH=$PATH:$SCALA_HOME/bin

#配置SPARK_HOME环境变量

export SPARK_HOME=/usr/spark/spark-3.2.0-bin-hadoop2.7

export PATH=$PATH:$SPARK_HOME/bin

export SPARK_MASTER_IP=192.168.20.128

export SPARK_WORKER_MEMORY=1024

export SPARK_WORKER_CORES=2

export SPARK_WORKER_INSTANCES=1