方法

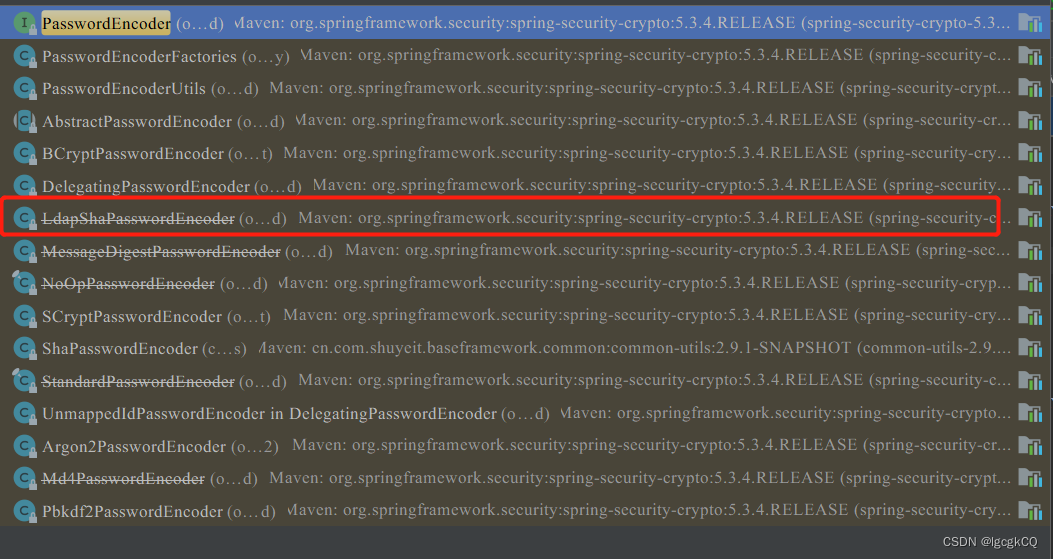

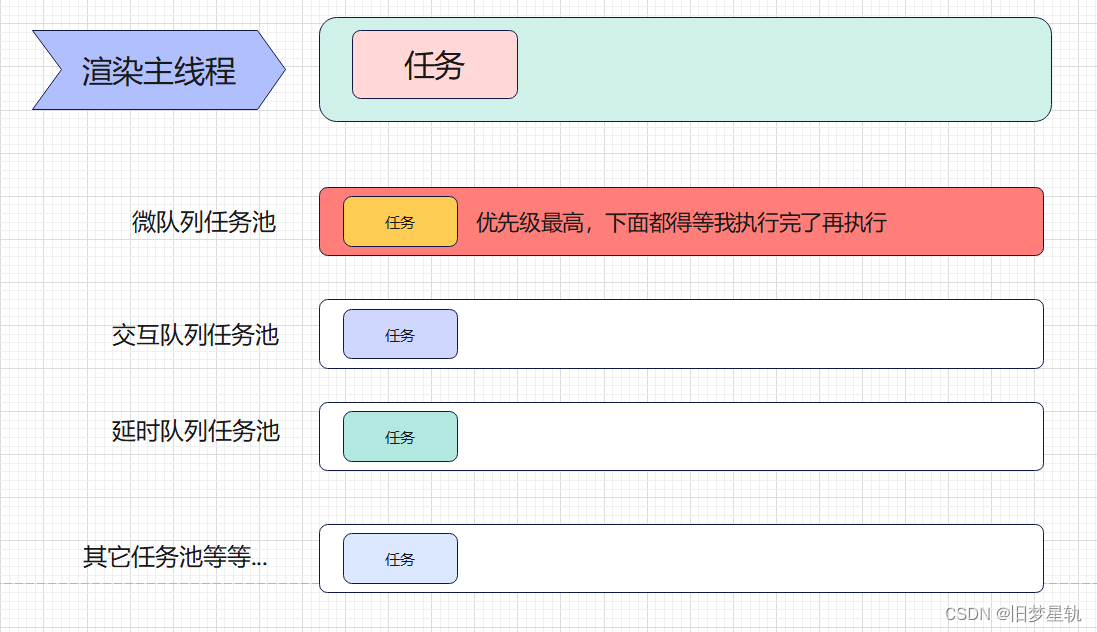

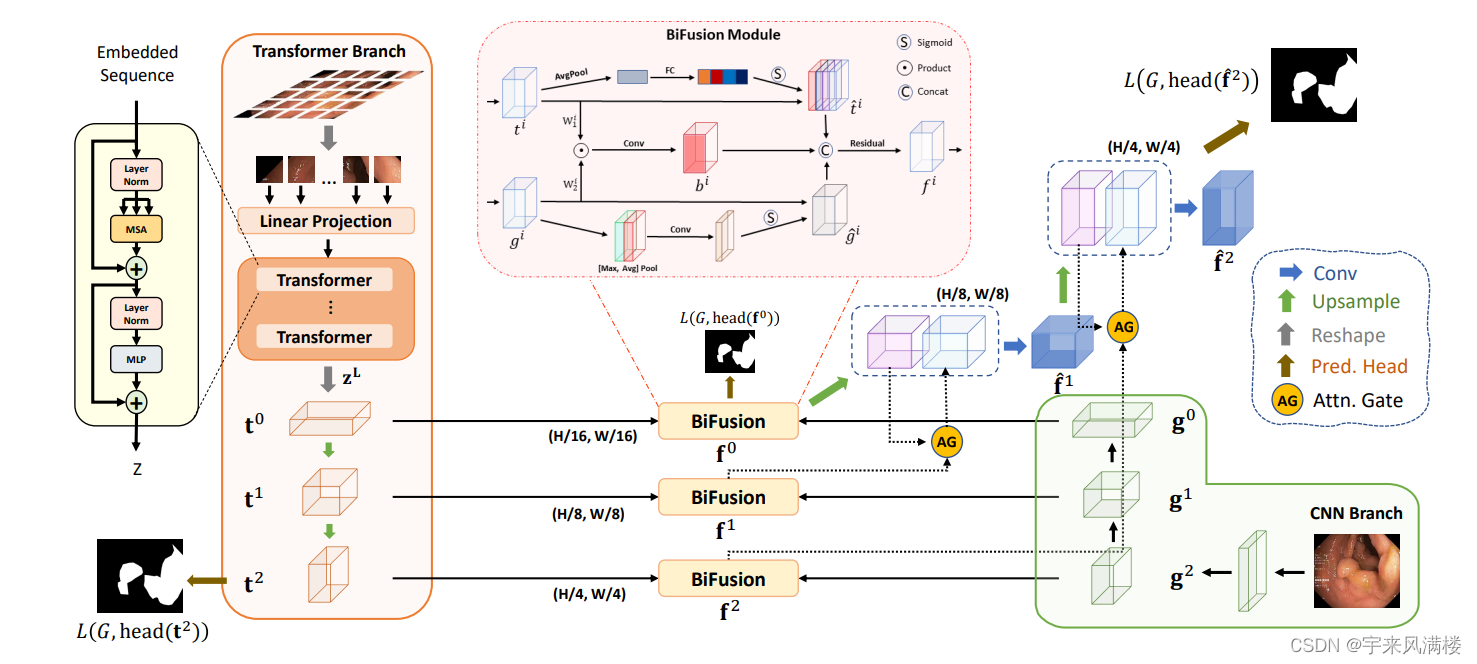

Transformer分支

将不同尺度的特征图 t 0 、 t 1 和 t 2 t^0、t^1和t^2 t0、t1和t2保存起来,之后与对应的CNN分支的特征图融合。

CNN分支

以基于ResNet的模型为例,模型通常有五个块,每个块对特征图进行两倍下采样。我们获取第 4( g 0 g^0 g0) 、3( g 1 g^1 g1) 和第2个模块( g 2 g^2 g2) 的输出,来与Transformer的结果融合。

BiFusion模块

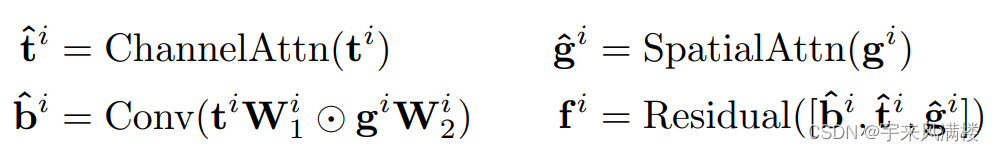

通过下面的操作获得融合的特征表征

f

i

f^i

fi,i=0,1,2

其中,

⨀

\bigodot

⨀是矩阵对应元素相乘

通道注意力用来促进Transformer分支的全局信息;采用空间滤波器用于增强局部细节并抑制不相关区域,因为CNN的低级特征可能会带噪声;点积对来自两个分支的特征之间的细粒度交互进行建模。

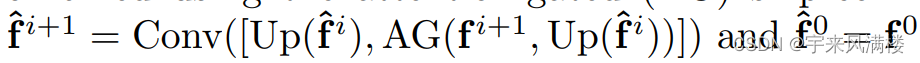

为了生成最后的分割,所有的f通过门控注意力和跳跃连接结合起来,如下

损失函数

分割预测由一个简单的头生成,它直接将输入特征图调整为原始分辨率,并应用卷积层生成M个图,其中M是类数。