《Fast Transformer Decoding: One Write-Head is All You Need》

核心贡献:优化 multi-head attention 为文中命名的 multi-query attention,减少多head相关运算,不降低精度 且 大幅提升解码速度。

具体对比如下:

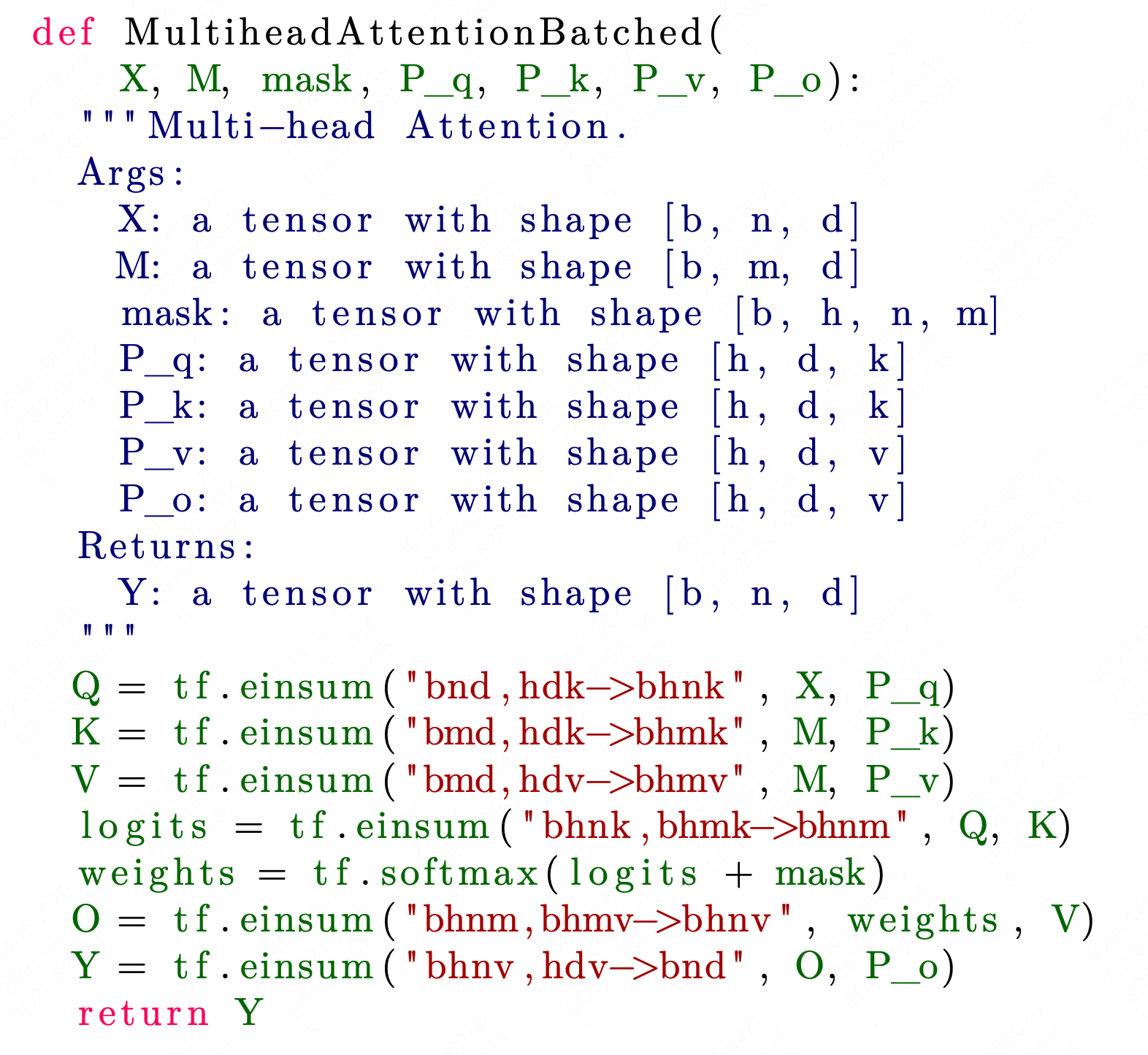

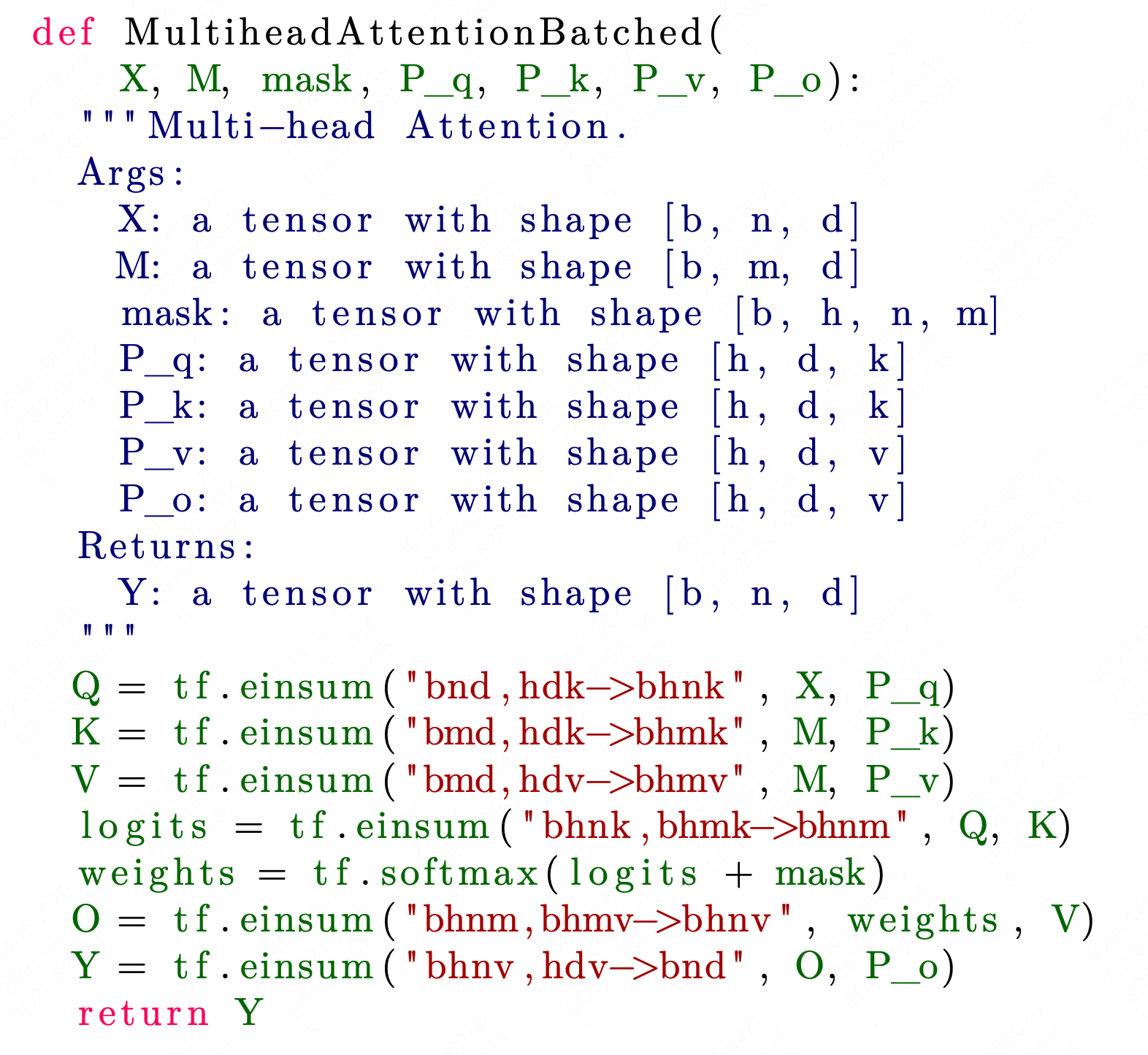

multi-head attention:

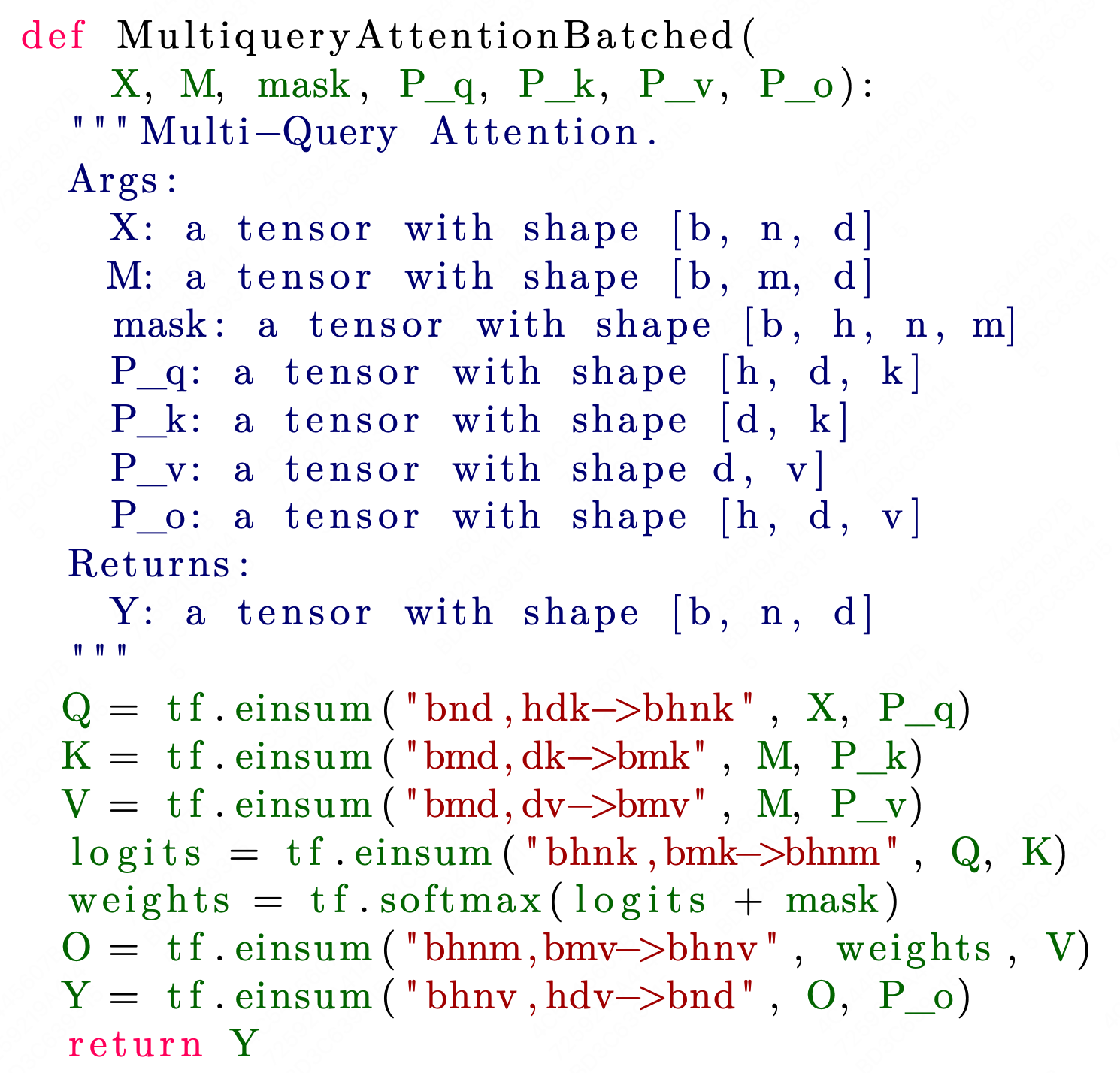

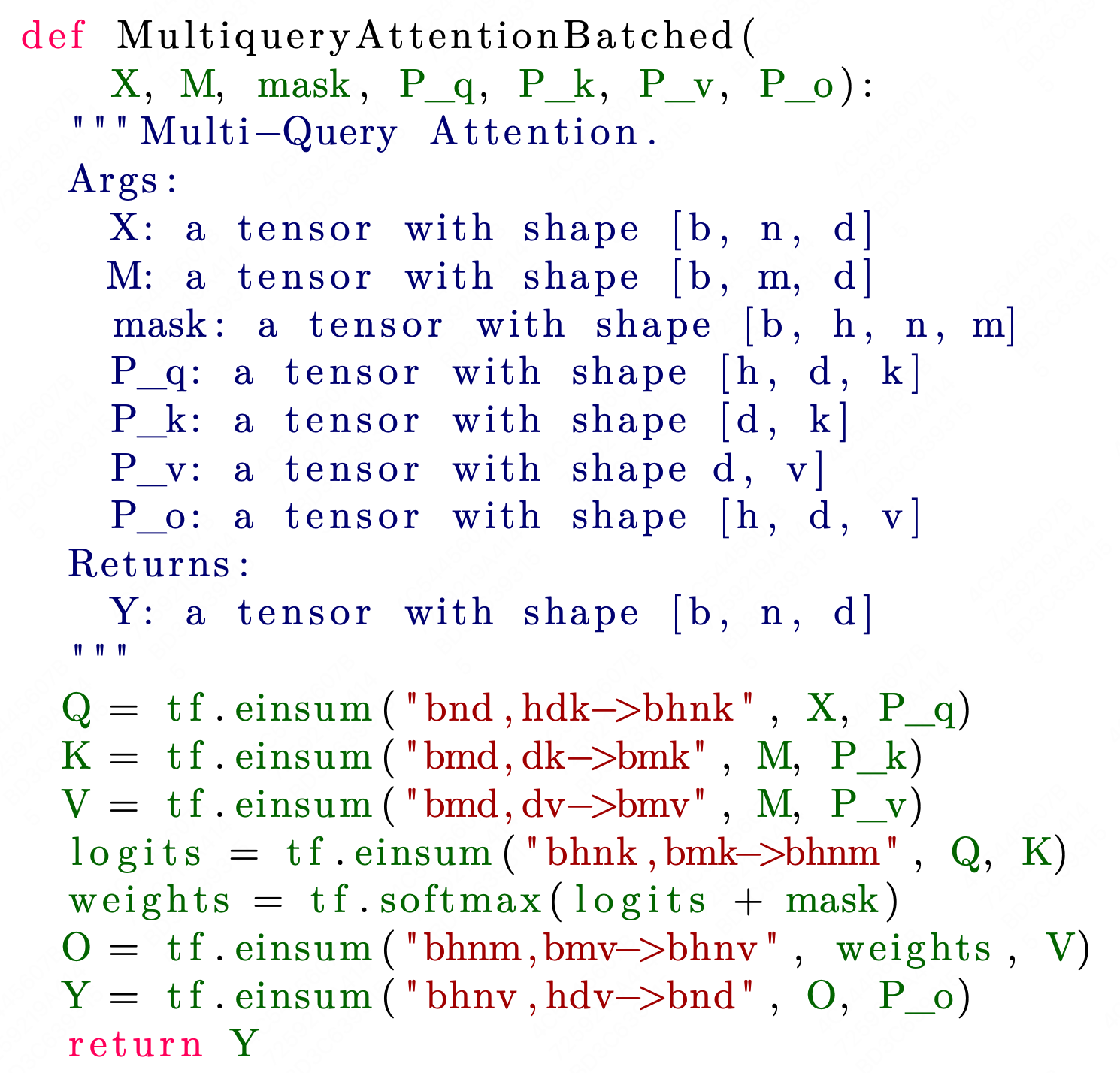

multi-query attention:

《Fast Transformer Decoding: One Write-Head is All You Need》

核心贡献:优化 multi-head attention 为文中命名的 multi-query attention,减少多head相关运算,不降低精度 且 大幅提升解码速度。

具体对比如下:

multi-head attention:

multi-query attention:

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如若转载,请注明出处:http://www.coloradmin.cn/o/694577.html

如若内容造成侵权/违法违规/事实不符,请联系多彩编程网进行投诉反馈,一经查实,立即删除!