作者 | 伍杏玲

近日,Ampere Computing 发布2023年度战略和产品路线图,并推出全新的AmpereOne系列处理器,拥有多达 192 个单线程 Ampere 核,内核数量为业界最高。这是第一款基于 Ampere 新自研核的产品,由 Ampere 自有 IP 全新打造。

很难相信,这是一家成立6年的公司,其创新力很强。两年前,笔者在《发布 128 核 Altra Max,自研内核,明年推出 5nm 处理器,“性能怪兽”Ampere 搞大事?》中曾报道过他们推出的Altra Max,仅仅两年,已自研出192 核的 AmpereOne。

一直以来,Ampere Computing 聚焦在云原生处理器上,其首席产品官 Jeff Wittich 在近日的媒体沟通会上表示,Ampere 云原生处理器专为可持续的云而设计的,其云原生处理器可以实现性能和能效的双领先。

Ampere 首席执行官 Renée James 表示:“每隔数十年,计算行业就会出现一种驱动性的新应用,或是演变出全新的性能要求,重新定义性能。人工智能正是当前具有驱动性的应用,它可以将我们对流媒体的长期应用和用户需求与其他相关的一切结合。我们不能继续把功耗作为衡量数据中心性能的关键指标。在 Ampere,我们设计的产品能够基于可持续的功耗提供最大化的性能,从而助推行业未来的发展。”

一、自研新芯片 AmpereOne,192 核为业界最高

AmpereOne 由 Ampere 全新打造,具备 192 个自研设计的 Ampere 核,基于5nm工艺节点制造。AmpereOne 为云工作负载提供更高的性能、更高的可扩展性以及更高的密度,目前AmpereOne已投产交付给客户。

192 核到底是怎样的数字?Jeff Wittich 详细介绍道,如在云环境中运行虚拟机,用192核的AmpereOne对比96核的AMD Genoa,或者60核的英特尔Sapphire Rapids,AmpereOne每机架运行的虚拟机数量是AMD Genoa的2.9倍,是英特尔Sapphire Rapids的4.3倍。

Jeff Wittich 表示:“基于这些技术创新,我们为云工作负载提供了业界最高效、最高性能的核。AmpereOne 为 Ampere 客户的云原生工作负载提供了最高的整体性能、可扩展性和密度。此外,得益于低延迟和高吞吐量,Ampere 云原生处理器在 AI 推理方面较其他 CPU 有 2 倍以上的性能优势。”

今年AIGC火爆,AmpereOne在AIGC也有一些布局,如相比AMD Genoa,AmpereOne可每秒多提供2.3倍的帧数,在运行稳定的扩散模型中胜出。此外在运行DLRM模型的推荐系统中,通过AmpereOne响应的查询数量是AMD Genoa的每秒查询数量的两倍多。

6 岁的 Ampere “朋友圈”也逐渐扩大的,从谷歌云、微软 Azure、甲骨文云、阿里巴巴和腾讯等云提供商,到 HPE 和 Supermicro 等OEM,Ampere 发展良好。

二、拥抱 AIGC 浪潮,Ampere 在AI的投入

毋庸置疑,AIGC 已变革各个领域,CPU也不例外。Jeff Wittich 表示,AI的发展对于数据中心CPU市场均产生了巨大的影响。因为 AI 是驱动数据中心算力需求提升的重要引擎之一,AIGC 加速市场对算力的需求。

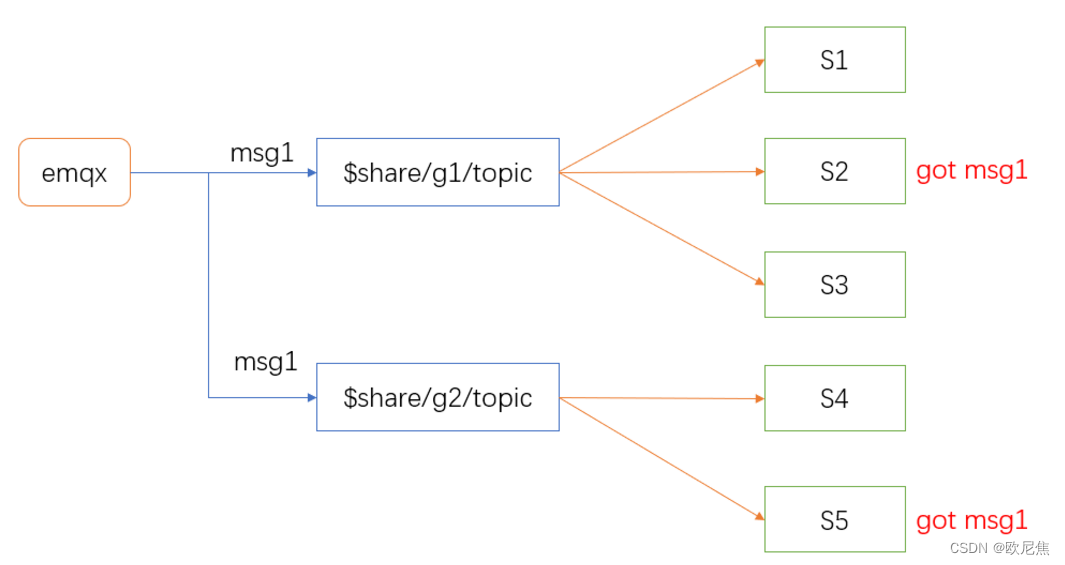

最常见的AI工作负载有以下两大场景,一是AI训练工作负载,即处理器在大量数据的基础上建立模型,对于某些大模型来说,这个过程可能要花费几个小时甚至可能要数周、数月的时间。第二个场景是AI推理,即在完成AI训练的基础上,在应用上去运行模型。

AI训练和AI推理的工作负载并不一样,AI训练发生在服务器上的CPU、GPU,但是AI推理扩展在整个云的部署中。这就意味着它对云的基础建设提出了更高的要求。所以AI训练和AI推理有三点不同,一是AI推理需要更大的规模,二是AI推理很有可能在通用服务器上和其他工作负载同时运行,三是AI推理对速度的要求更高,还需要不断地进行大量重复,来向用户快速交付结果。

Ampere提供的产品非常适用于AI推理,特别是大规模的云场景。目前,已经有许多客户都在使用Ampere Altra系列处理器进行AI推理,并且得到 TensorFlow、PyTorch、ONNX等主流框架支撑。

另外,Ampere的产品不只适用于当前常见的大型语言模型,也适用于过去几年的模型。通过Ampere云原生处理器进行AI推理,可获得卓越的可扩展性和性能,也打破了效率的瓶颈,而这正是令云服务提供商困扰的问题,因为使用GPU会带来极高的能耗,而且容量扩展会受到制约,可部署的服务器数量也会受到限制。而Ampere的云原生处理器通过提供卓越的性能和能效,恰好能够解决这些行业痛点。

不是在今年AIGC火了后,Ampere 才开始布局AI的。而是早在三年前,Ampere收购了专注于创建AI软件的OnSpecta公司,OnSpecta通过创建AI软件助力硬件在AI负载之下运行更快。过去几年Ampere AI团队的主要工作焦点包括:建立形成标准框架的库,助力人们以更高性能去运行Ampere Altra。另外,AI团队还和硬件团队、架构团队一起来优化AmpereOne,为AmpereOne的内核带来卓越的AI性能,比如 AmpereOne系列处理器提供了全新的 BF16支持。

Jeff Wittich 表示,目前有一些客户使用Ampere的处理器运行AI推理工作负载,比如Matoha有鉴别特定材料的应用程序,他们将模型运行在 Ampere 的处理器上。未来,Jeff Wittich期待看到AmpereOne被越来越多地部署到关键的AI推理中。