Python中安装jieba分词器

介绍

中文分词是文本挖掘中非常重要的一个环节,而jieba是Python中最受欢迎的中文分词器之一。jieba分词器是基于汉语词汇库进行分词,并支持多种分词模式,可以满足不同场景的分词需求。

本文将介绍如何在Python环境下安装jieba分词器,并给出一些常用功能和示例代码。

安装jieba分词器

安装jieba非常简单,可以通过pip命令进行安装。在命令行输入以下代码即可:

pip install jieba

此时,Python环境中已经安装好jieba分词器。

常用分词功能

精确模式

jieba默认是采用精确模式进行分词的,其返回完整的分词结果。使用如下代码可以得到文本的分词结果:

import jieba

text = "我爱自然语言处理"

seg_list = jieba.cut(text, cut_all=False)

print("精确模式:" + "/".join(seg_list))

输出结果为:

精确模式:我/爱/自然语言/处理

全模式

全模式将文本所有可能的词语都扫描出来,并返回其中所有的分词结果。使用如下代码可以得到文本的分词结果:

import jieba

text = "我爱自然语言处理"

seg_list = jieba.cut(text, cut_all=True)

print("全模式:" + "/".join(seg_list))

输出结果为:

全模式:我/爱/自然/自然语言/语言/处理

搜索引擎模式

搜索引擎模式在精确模式的基础上,对长词再次进行切分,提高召回率,适用于搜索引擎分词。使用如下代码可以得到文本的分词结果:

import jieba

text = "我爱自然语言处理"

seg_list = jieba.cut_for_search(text)

print("搜索引擎模式:" + "/".join(seg_list))

输出结果为:

搜索引擎模式:我/爱/自然/语言/自然语言/处理

结论

本文介绍了在Python中安装jieba分词器的方法,并给出了分词器的常用功能和示例代码。jieba分词器是一款非常优秀的中文分词器,可满足多种场景的分词需求。在做中文文本挖掘时,jieba分词器是不可或缺的工具,希望本文能帮助读者更好地理解和使用它。

最后的最后

本文由chatgpt生成,文章没有在chatgpt生成的基础上进行任何的修改。以上只是chatgpt能力的冰山一角。作为通用的Aigc大模型,只是展现它原本的实力。

对于颠覆工作方式的ChatGPT,应该选择拥抱而不是抗拒,未来属于“会用”AI的人。

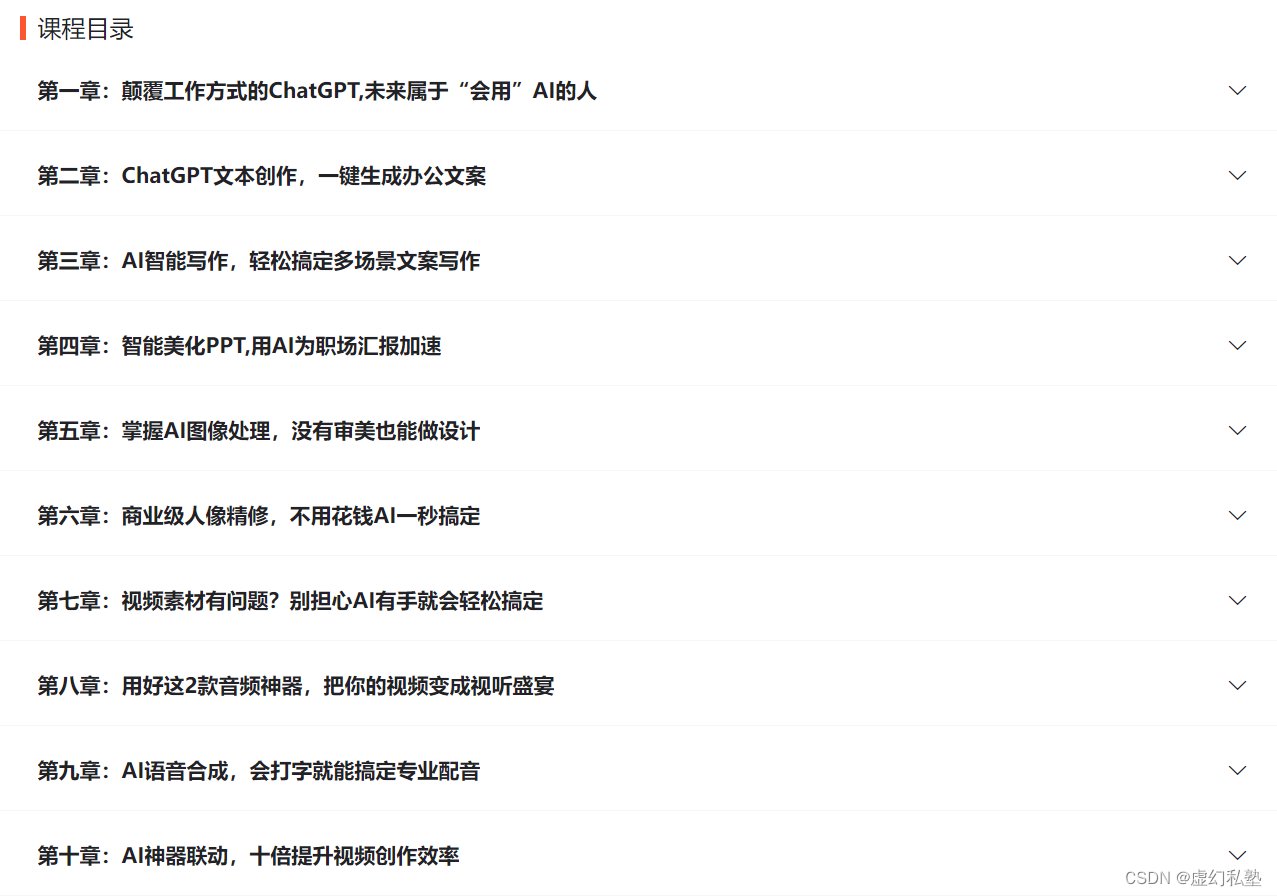

🧡AI职场汇报智能办公文案写作效率提升教程 🧡 专注于AI+职场+办公方向。

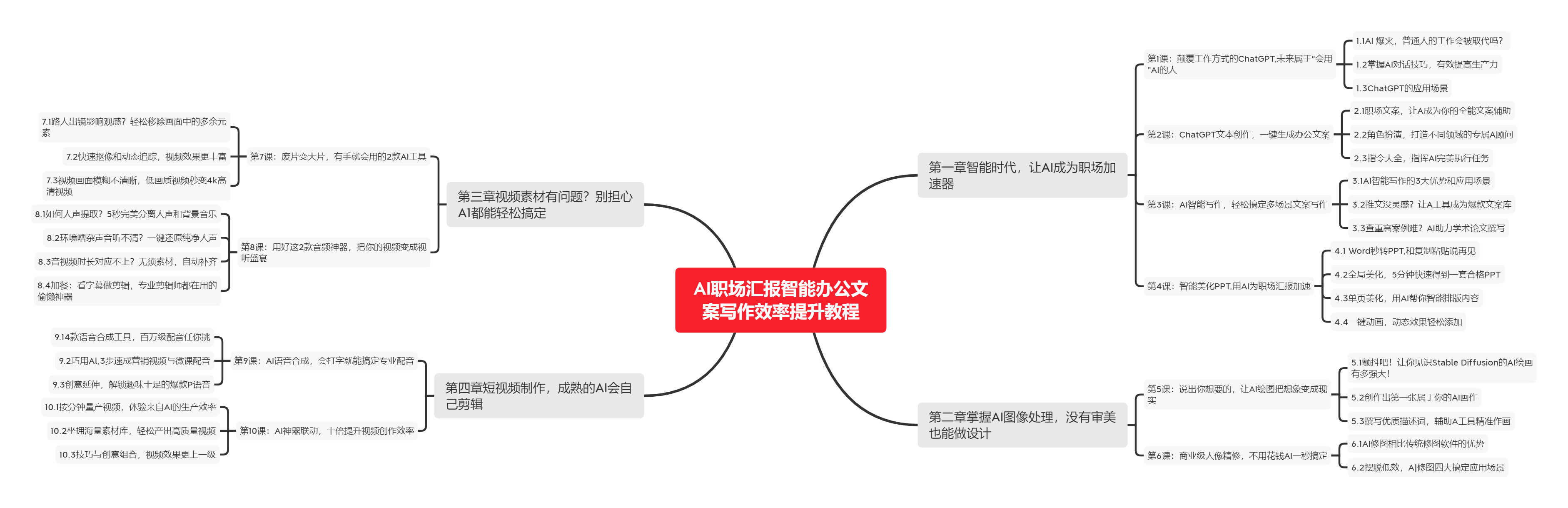

下图是课程的整体大纲

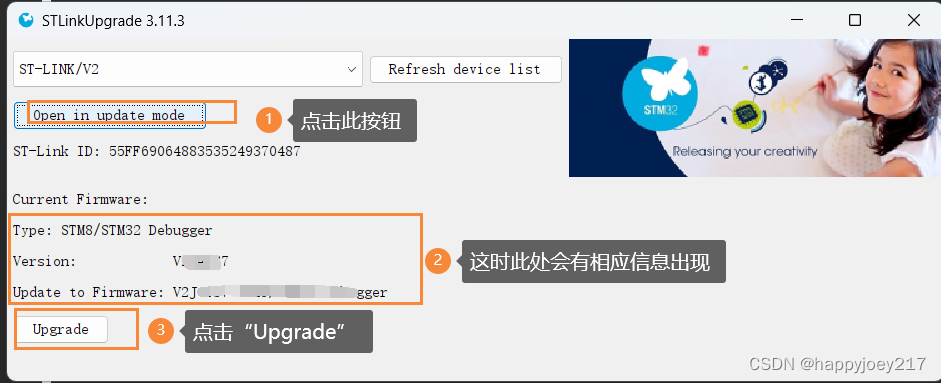

下图是AI职场汇报智能办公文案写作效率提升教程中用到的ai工具

🚀 优质教程分享 🚀

- 🎄可以学习更多的关于人工只能/Python的相关内容哦!直接点击下面颜色字体就可以跳转啦!

| 学习路线指引(点击解锁) | 知识定位 | 人群定位 |

|---|---|---|

| 🧡 AI职场汇报智能办公文案写作效率提升教程 🧡 | 进阶级 | 本课程是AI+职场+办公的完美结合,通过ChatGPT文本创作,一键生成办公文案,结合AI智能写作,轻松搞定多场景文案写作。智能美化PPT,用AI为职场汇报加速。AI神器联动,十倍提升视频创作效率 |

| 💛Python量化交易实战 💛 | 入门级 | 手把手带你打造一个易扩展、更安全、效率更高的量化交易系统 |

| 🧡 Python实战微信订餐小程序 🧡 | 进阶级 | 本课程是python flask+微信小程序的完美结合,从项目搭建到腾讯云部署上线,打造一个全栈订餐系统。 |