决策树分类器(Decision Tree Classifier)是一种常用的机器学习算法,它被广泛应用于分类和回归问题中。在人工智能(Artificial Intelligence,简称AI)领域中,决策树分类器是一种简单而有效的算法,可以用于许多应用领域,如医疗、金融、电商等。本文将详细介绍AI人工智能决策树分类器的原理、优缺点、应用场景和实现方法。

原理

决策树是一种基于树形结构的分类模型,它通过将输入特征逐层划分为不同的子集,以达到分类的目的。决策树分类器的核心思想是通过特征的有序划分来确定分类的决策规则,从而实现对数据的分类。

假设有一个二分类问题,输入特征为 x ∈ R n x\in R^n x∈Rn,输出类别为 y ∈ { 0 , 1 } y\in\{0,1\} y∈{0,1},决策树分类器的模型可以表示为:

y = f ( x ) = ∑ i = 1 k w i ⋅ I ( x ∈ R i ) y=f(x)=\sum_{i=1}^k w_i\cdot I(x\in R_i) y=f(x)=i=1∑kwi⋅I(x∈Ri)

其中 I ( x ∈ R i ) I(x\in R_i) I(x∈Ri)表示特征 x x x是否属于区间 R i R_i Ri, w i w_i wi表示区间 R i R_i Ri对应的类别标签。决策树的核心是如何构建这些区间,以及如何确定每个区间对应的类别标签。

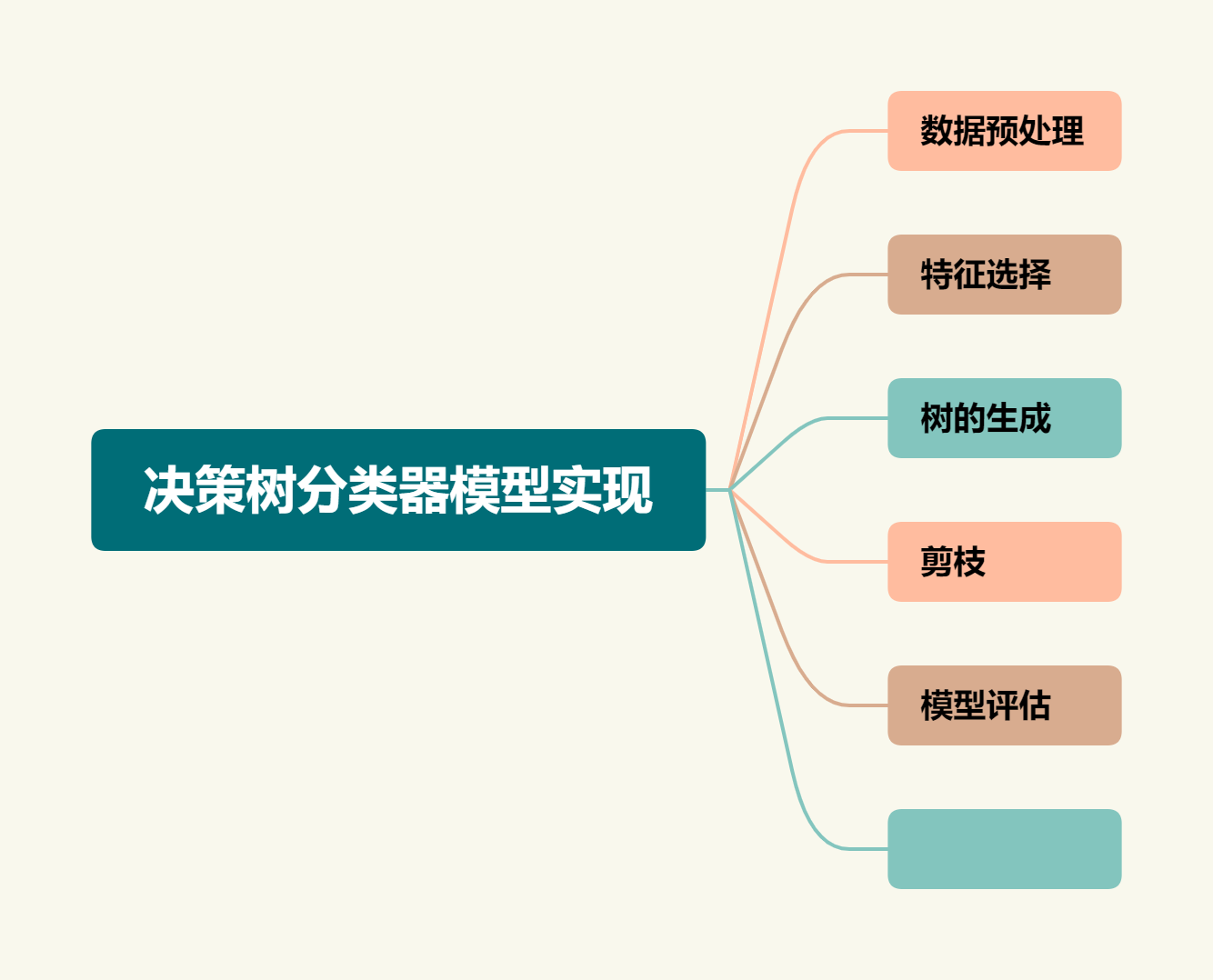

决策树的构建过程可以分为特征选择、树的生成和剪枝三个步骤。特征选择是指选择最优的特征作为划分条件,树的生成是指递归地构建决策树的过程,剪枝是指通过剪枝算法来减少树的深度和复杂度,以避免模型过拟合。

优缺点

决策树分类器作为一种简单而有效的分类算法,具有以下优缺点:

优点:

-

简单易懂:决策树是一种基于树形结构的算法,易于理解和解释。

-

鲁棒性强:决策树对噪声数据比较鲁棒,能够处理包含噪声的数据。

-

可处理多分类问题:决策树可以处理多分类问题,可以实现多个二分类器的组合。

-

特征选择灵活:决策树可以通过特征选择算法来确定最优的划分特征,可以适应不同的数据。

缺点:

-

容易过拟合:决策树容易过拟合,需要采取剪枝等方法来提高模型的泛化性能。

-

对噪声敏感:决策树对不同的噪声数据会产生不同的划分结果,需要对噪声数据进行预处理。

-

模型复杂度高:决策树的复杂度随着数据量增加而增加,需要采取剪枝等方法来降低模型的复杂度。

应用场景

决策树分类器在人工智能领域中有广泛的应用,常见的应用场景包括以下几种:

-

金融行业:决策树可以用于信用评估、欺诈检测、投资决策等应用场景。

-

医疗行业:决策树可以用于疾病诊断、药物疗效预测、医疗风险评估等应用场景。

-

电商行业:决策树可以用于商品推荐、销售预测、用户行为分析等应用场景。

-

社交媒体:决策树可以用于情感分析、事件预测、用户行为分析等应用场景。

实现方法

在实现决策树分类器模型时,通常需要进行以下几个步骤:

-

数据预处理:包括数据清洗、特征选择、特征缩放等处理过程,以提高模型的准确性和稳定性。

-

特征选择:包括信息增益、基尼指数等算法,以选择最优的特征作为划分条件。

-

树的生成:包括递归地构建决策树的过程,以确定每个区间对应的类别标签。

-

剪枝:包括预剪枝和后剪枝两种方法,以避免模型过拟合。

-

模型评估:包括模型的准确率、精度、召回率等指标的计算,以评估模型的性能。

-

模型应用:包括利用模型进行预测、推荐、分类等任务,以应用于实际问题中。

在实现决策树分类器模型时,可以使用现有的机器学习库,如scikit-learn、TensorFlow等,也可以自己编写代码实现。使用现有的机器学习库可以大大简化模型的实现过程,提高开发效率和代码质量。自己编写代码可以更好地理解决策树分类器的原理和实现方法,以便在实际问题中进行调整和优化。

总结

本文介绍了AI人工智能决策树分类器的原理、优缺点、应用场景和实现方法。决策树分类器作为一种简单而有效的分类算法,具有简单易懂、鲁棒性强、特征选择灵活等优点。决策树分类器在金融、医疗、电商、社交媒体等应用场景中有广泛的应用。在实现决策树分类器模型时,可以使用现有的机器学习库或自己编写代码实现。

![[MAUI]在.NET MAUI中复刻苹果Cover Flow](https://img-blog.csdnimg.cn/427db839c6b7434aa54ecba60c5325f8.gif)