Hadoop的HDFS文件系统

概述

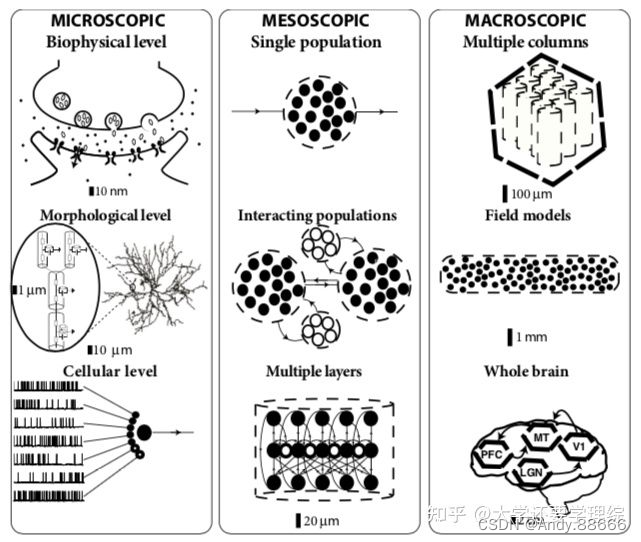

- Hadoop的HDFS文件系统是一种分布式文件系统,hadoop的核心组件之一。

- 它的设计目标是能够在普通硬件上运行,并且能够处理大量的数据。

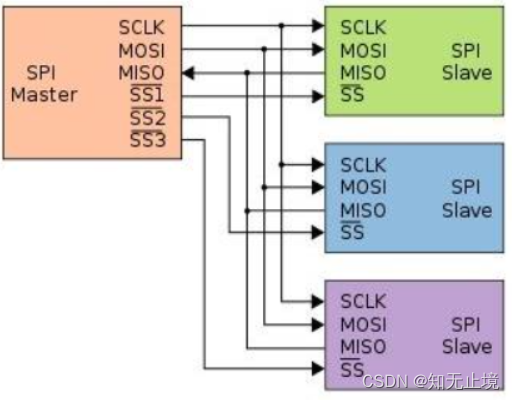

- HDFS采用了主从(Master/Slave)架构,其中有一个NameNode和多个DataNode。

- NameNode作为Master节点:负责管理文件系统的命名空间,文件块的映射关系和客户端的访问。

- DataNode作为Slave节点:则负责存储实际的数据块。

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-M3HWE1Y8-1684381238743)(E:\Java笔记\大数据\Hadoop\hadoop的HDFS文件系统\hadoop的HDFS文件系统.assets\image-20230517155828221-16843795431401.png)]](https://img-blog.csdnimg.cn/f33e04e7253842e68868607dc18a63e5.png)

这种架构的好处是可以实现可用性和容错性,因为如果一个节点出现故障,其他节点可以接替它的工作。另外,HDFS还支持数据的复制和块的备份,以保证数据的可靠性和可用性。

特点

- 可扩展性好

- 容错性强

- 适合大数据存储和处理

- 可以处理PB(数据量非常大,通常是TB或者PB级别)级别的数据,并可以在廉价的硬件上运行

- HDFS还支持多种文件系统接口,包含Hadoop的API,WebHDFS,FTP等

- . . .

常见配置

在使用hadoop的HDFS文件系统时,需要进行一些配置,以便更好地使用和管理数据。以下是hadoop的HDFS文件配置的一些常见设置:

- 配置副本数

- 在hadoop的HDFS文件系统中,每个数据块都会被复制多次,以保证数据的可靠性。副本数的设置可以通过修改hdfs-site.xml文件中的dfs.replication属性来实现。一般情况下,副本数的设置应该根据集群的规模和硬件配置来确定。

<property>

<name>dfs.replication</name>

<!-- 根据集群的规模来配置 -->

<value>3</value>

</property>

- 配置块大小

- 在hadoop的HDFS文件系统中,数据会被分成多个块进行存储。块大小的设置可以通过修改hdfs-site.xml文件中的dfs.blocksize属性来实现。一般情况下,块大小的设置应该根据数据的大小和访问模式来确定。

<property>

<name>dfs.blocksize</name>

<!--

大小设置为128M,

注意:块的大小应进行选择,因为他会对系统的性能产生重大影响。

为了保证数据的可靠性,HDFS中的每个数据块会被复制多次,可以使用dfs配置副本的数量

-->

<value>134217728</value>

<description>默认的新文件大小以字节为单位</description>

</property>

- 配置数据节点

- 在hadoop的HDFS文件系统中,数据会被存储在多个数据节点上。数据节点的设置可以通过修改hdfs-site.xml文件中的dfs.datanode.hostname属性来实现。一般情况下,数据节点的设置应该根据集群的规模和硬件配置来确定。

<!-- 配置数据节点 -->

<property>

<name>dfs.datanode.hostname</name>

<value>数据节点1,数据节点2,数据节点3</value>

</property>

- 配置NameNode

- 在hadoop的HDFS文件系统中,NameNode是整个系统的核心组件,负责管理文件系统的命名空间和数据块的位置信息。NameNode的设置可以通过修改hdfs-site.xml文件中的dfs.namenode.name.dir属性来实现。一般情况下,NameNode的设置应该根据集群的规模和硬件配置来确定。

<property>

<name>dfs.namenode.name.dir</name>

<!-- 将目录替换为NameNode元数据所在的目录 -->

<value>/path/to/name/dir</value>

</property>

- 配置Secondary NameNode

- 在hadoop的HDFS文件系统中,Secondary NameNode是NameNode的备份节点,负责定期合并编辑日志和镜像文件,以便恢复NameNode的状态。Secondary NameNode的设置可以通过修改hdfs-site.xml文件中的dfs.namenode.secondary.http-address属性来实现。一般情况下,Secondary NameNode的设置应该根据集群的规模和硬件配置来确定。

<property>

<name>dfs.namenode.secondary.http-address</name>

<!--

将Secondary - NameNode -hostname替换为备NameNode的主机名,

将50090替换为备NameNode使用的端口号。

-->

<value>secondary-namenode-hostname:50090</value>

</property>

- 配置数据块的复制策略

- 在hadoop的HDFS文件系统中,数据块的复制策略可以通过修改hdfs-site.xml文件中的dfs.block.replicator.classname属性来实现。一般情况下,数据块的复制策略应该根据集群的规模和硬件配置来确定。

<property>

<name>dfs.block.replicator.classname</name>

<!-- 放置策略的类名称 --> <value>org.apache.hadoop.hdfs.server.blockmanagement.BlockPlacementPolicyDefault</value>

</property>

- 配置数据块的压缩方式

- 在hadoop的HDFS文件系统中,数据块的压缩方式可以通过修改hdfs-site.xml文件中的io.compression.codecs属性来实现。一般情况下,数据块的压缩方式应该根据数据的类型和访问模式来确定。

<property>

<name>io.compression.codecs</name>

<!--

GzipCodec,DefaultCodec 指定的压缩编解码器,

可以按照具体需求,添加或者删除遍解码器

--> <value>org.apache.hadoop.io.compress.GzipCodec,org.apache.hadoop.io.compress.DefaultCodec</value>

</property>

- 配置数据块的加密方式

- 在hadoop的HDFS文件系统中,数据块的加密方式可以通过修改hdfs-site.xml文件中的dfs.encrypt.data.transfer属性来实现。一般情况下,数据块的加密方式应该根据数据的敏感程度和安全要求来确定。

<property>

<name>dfs.encrypt.data.transfer</name>

<!--

开启HDFS中数据块的数据传输加密,

注意:开启加密会对性能产生影响

-->

<value>true</value>

</property>

宕机处理

HDFS的容错性很强,但在某些情况下,HDFS可能会出现宕机的情况。届时,我们就需要采取一些措施处理宕机问题:

- 检查硬件设备

- HDFS运行在普通硬件上,因此,硬件故障是导致HDFS宕机的主要原因之一。如果HDFS出现宕机的情况,我们应该首先检查硬件设备,包括磁盘、内存、CPU等,以确定是否存在硬件故障。

- 检查网络连接

- HDFS是一个分布式文件系统,它的各个组件之间需要通过网络进行通信。因此,网络连接的稳定性也是影响HDFS运行的重要因素之一。如果HDFS出现宕机的情况,我们应该检查网络连接,包括网络带宽、网络延迟等,以确定是否存在网络故障。

- 检查日志文件

- HDFS的各个组件都会生成日志文件,这些日志文件可以帮助我们了解HDFS的运行情况。如果HDFS出现宕机的情况,我们应该检查日志文件,以确定是否存在软件故障。

- 恢复NameNode

- 如果HDFS的NameNode出现宕机的情况,我们需要采取一些措施来恢复NameNode。一般情况下,我们可以使用NameNode的镜像文件来恢复NameNode的状态。如果镜像文件不可用,我们可以使用Secondary NameNode来恢复NameNode的状态。

- 恢复DataNode

- 如果HDFS的DataNode出现宕机的情况,我们需要采取一些措施来恢复DataNode。一般情况下,我们可以使用DataNode的备份来恢复DataNode的状态。如果备份不可用,我们可以使用其他DataNode上的数据块来恢复DataNode的状态。

- 恢复数据

- 如果HDFS的数据块出现损坏或丢失的情况,我们需要采取一些措施来恢复数据。一般情况下,我们可以使用数据块的备份来恢复数据。如果备份不可用,我们可以使用其他DataNode上的数据块来恢复数据。

- 预防措施

- 为了避免HDFS出现宕机的情况,我们应该采取一些预防措施,包括定期备份数据、定期检查硬件设备、定期检查网络连接等。这些措施可以帮助我们提高HDFS的可靠性和稳定性。