【本地模式】:也就是在windows环境下通过hadoop-client相关jar包进行开发的,我们只需要通过本地自己写好MapReduce程序即可在本地运行。

一个Maprduce程序主要包括三部分:Mapper类、Reducer类、执行类。

- map阶段:将每一行单词提取出来转为map(key,1)的形式

- key为每一行的偏移量:第1行偏移量为0、第二行在第一行最后一个字符的下标基础上+1(包括回车符和换行符),以此类推。

- map阶段key对应的的value均为1.

- reduec阶段:将map阶段的输出结果中的相同key所对应的value合并(将key对应的 1 进行累加),输出map(key,value),此时的value为key出现次数。

Maven项目下所需依赖

<dependencies>

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-client</artifactId>

<version>3.3.0</version>

</dependency>

<dependency>

<groupId>junit</groupId>

<artifactId>junit</artifactId>

<version>4.12</version>

<scope>test</scope>

</dependency>

<dependency>

<groupId>org.slf4j</groupId>

<artifactId>slf4j-api</artifactId>

<version>1.7.30</version>

</dependency>

<dependency>

<groupId>junit</groupId>

<artifactId>junit</artifactId>

<version>3.8.2</version>

</dependency>

<dependency>

<groupId>junit</groupId>

<artifactId>junit</artifactId>

<version>4.12</version>

<scope>compile</scope>

</dependency>

</dependencies>Hadoop序列化类型

- Text: 一种可变长度的字节数组,用于表示文本数据。相当于Java中的String。

- LongWritable、IntWritable、FloatWritable、DoubleWritable: 分别用于表示长整型、整型、浮点型和双精度浮点型数据。相当于Java中的long、int、float和double。

- BooleanWritable: 用于表示布尔类型数据。相当于Java中的boolean。

- NullWritable: 用于表示空值,通常用于表示Map任务的输出中间结果数据中的值为空。相当于Java中的null。

- ArrayWritable: 用于表示数组类型数据。相当于Java中的数组。

- MapWritable: 一种可序列化的Map数据结构,可以作为Map任务的输出(中间结果数据)或Reduce任务的输入。相当于Java中的Map<>。

- WritableComparable: 一种可序列化的、可比较的数据类型接口,可以作为Map任务或Reduce任务的输入输出数据类型。

一、Mapper类

import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Mapper;

import org.apache.hadoop.util.StringUtils;

import java.io.IOException;

/**

* map阶段一次只处理一行数据

* 泛型的四个参数:

* KEYIN: map()中key的文本偏移量

* VALUEIN: 当前的一行文本内容

* KEYOUT: 经过map处理后的一个单词

* VALUEOUT: 单词每次统计的数量,在mapper中这个就是 1

*/

public class WordCountMapper extends Mapper<LongWritable,Text,Text,LongWritable> {

//尽可能节省内存资源

private Text outKey = new Text();

private LongWritable outValue = new LongWritable(1);

@Override

protected void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {

//如果当前数据不为空

if (value!=null){

//获取每一行的数据

String line = value.toString();

//将一行数据根据空格分开

// String[] words = line.split(" ");

String[] words = StringUtils.split(line,' ');//hadoop的StringUtils.split方法对大数据来说比Java自带的拥有更好的性能

//输出键值对

for (String word : words) {

outKey.set(word);

context.write(outKey,outValue);

}

}

}

}

二、Reducer类

import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Reducer;

import java.io.IOException;

/**

* reduce阶段一种key只被调用一次

* 泛型的四个参数:

* KEYIN: 当前的一个单词

* VALUEIN: map中输入过来的单词数量

* KEYOUT: 当前的一个单词

* VALUEOUT: 单词出现的总次数

*/

public class WordCountReducer extends Reducer<Text, LongWritable,Text,LongWritable> {

private LongWritable outValue = new LongWritable();

//Iterable<LongWritable>是一个集合(它是集合的最顶端的类,Collection继承了Iterable接口)

@Override

protected void reduce(Text key, Iterable<LongWritable> values, Context context) throws IOException, InterruptedException {

//累加单词的数量

long sum = 0;

//遍历单词计数数组,将值累加到sum中

for (LongWritable value : values) {

sum += value.get();

}

outValue.set(sum);

//输出每次最终的计数结果

context.write(key,outValue);

}

}

三、执行类

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.conf.Configured;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

import org.apache.hadoop.util.Tool;

import org.apache.hadoop.util.ToolRunner;

public class WordCountRunner extends Configured implements Tool {

public static void main(String[] args) throws Exception {

ToolRunner.run(new Configuration(),new WordCountRunner(),args);

}

@Override

public int run(String[] args) throws Exception {

//1.获取job

Configuration conf = new Configuration();

Job job = Job.getInstance(conf, "word count");

//2.配置jar包路径

job.setJarByClass(WordCountRunner.class);

//3.关联mapper和reducer

job.setMapperClass(WordCountMapper.class);

job.setReducerClass(WordCountReducer.class);

//4.设置map、reduce输出的k、v类型

job.setMapOutputKeyClass(Text.class);

job.setMapOutputValueClass(LongWritable.class);

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(LongWritable.class);

//5.设置统计文件输入的路径,将命令行的第一个参数作为输入文件的路径

String path = getClass().getResource("/words.txt").getPath();

FileInputFormat.setInputPaths(job,path);

//6.设置结果数据存放路径,将命令行的第二个参数作为数据的输出路径

FileOutputFormat.setOutputPath(job,new Path("./output"));

return job.waitForCompletion(true) ? 0 : 1;//verbose:是否监控并打印job的信息

}

}

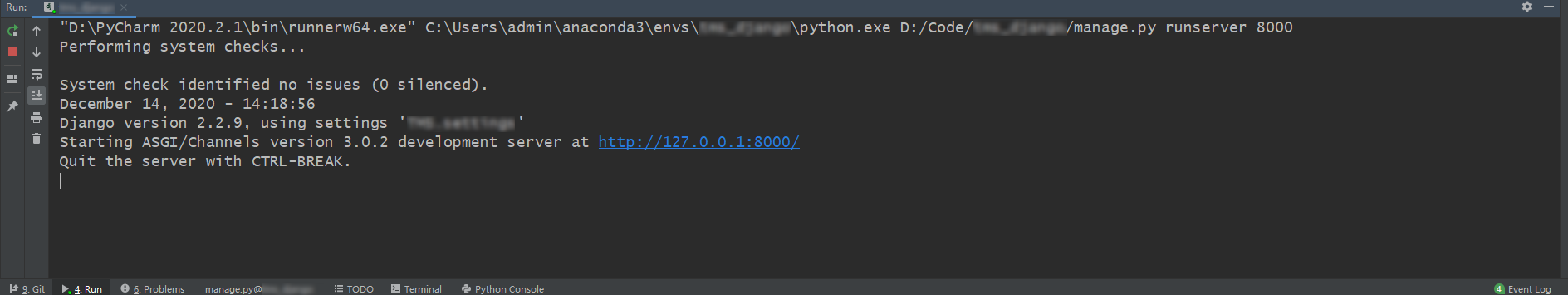

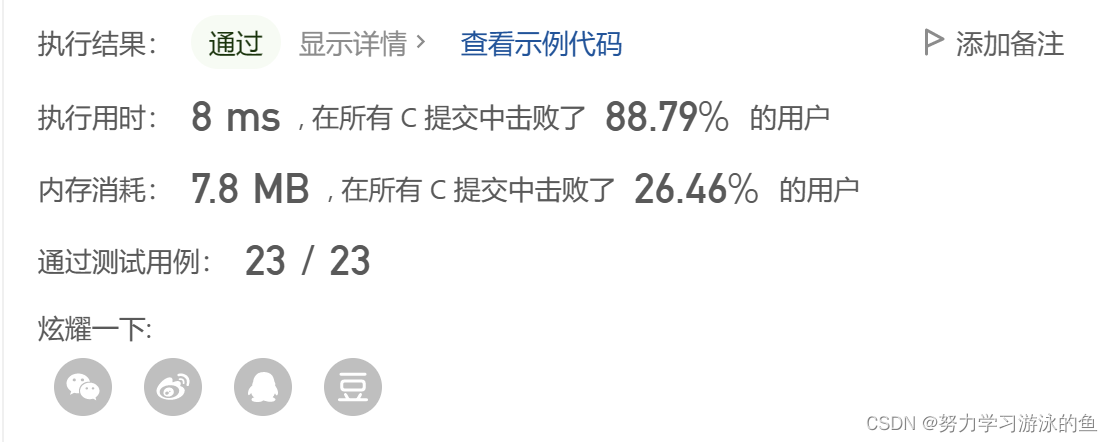

程序执行结果

- .part-r-00000.crc: 是Reduce任务输出结果文件的校验文件,用于校验Reduce任务输出结果文件的完整性和正确性。该文件由Hadoop框架自动生成,不需要手动创建,其内容是Reduce任务输出结果文件的校验和信息。

- ._SUCCESS.crc: 是表示任务执行成功的标志文件的校验文件,用于校验标志文件的完整性和正确性。该文件由Hadoop框架自动生成,其内容是标志文件的校验和信息。

- _SUCCESS: 表示任务执行成功的标志文件,文件内容为空。

- part-r-00000: 表示Reduce任务的输出结果文件,其中“00000”表示该文件是第一个Reduce任务的输出结果文件,如果有多个Reduce任务,则会生成多个该类型的文件,文件内容为每个单词出现的次数。