文章目录

- 1 这一讲任务

- 2 相关解释

- 3 代码

该专栏内容为对该视频的学习记录:【《PyTorch深度学习实践》完结合集】

专栏的全部代码、数据集和课件全放在个人GitHub了,欢迎自取。

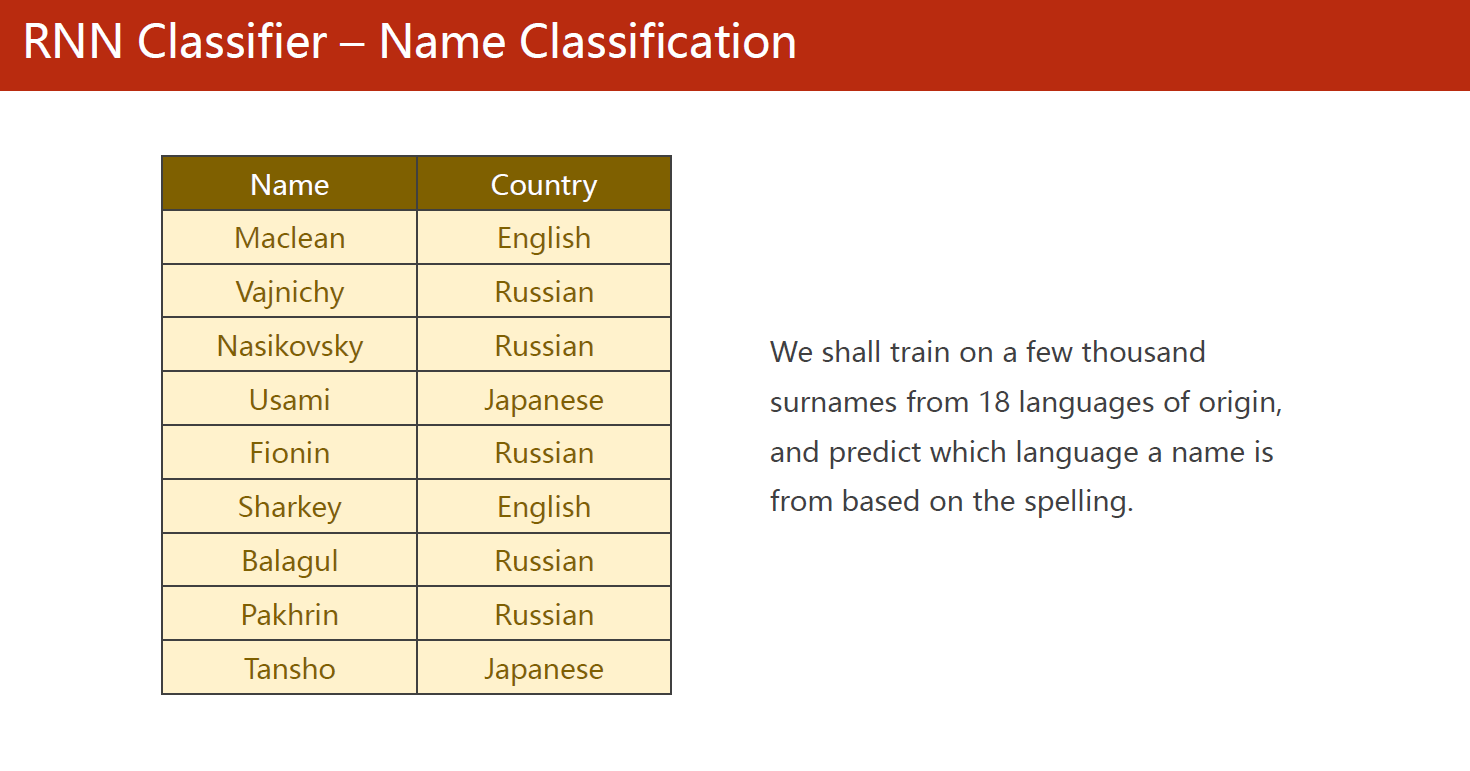

1 这一讲任务

根据名字中的字符来预测其是哪个语言地区:如"Nasikovsky"这个名字一看就是念什么什么斯基,立即推!这个人很可能就是俄语地区。

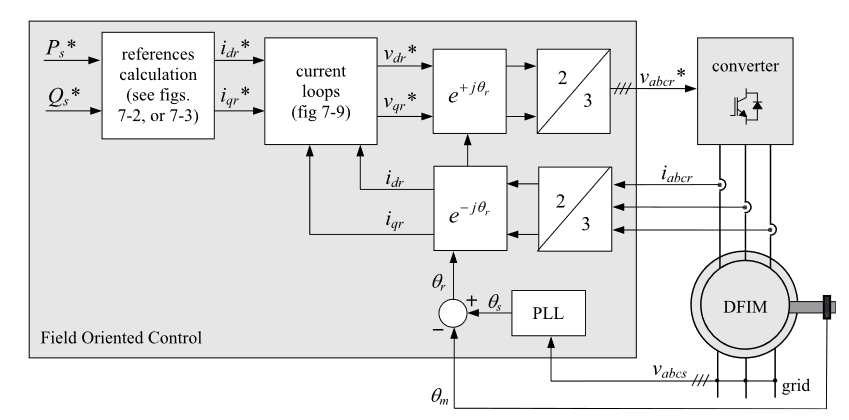

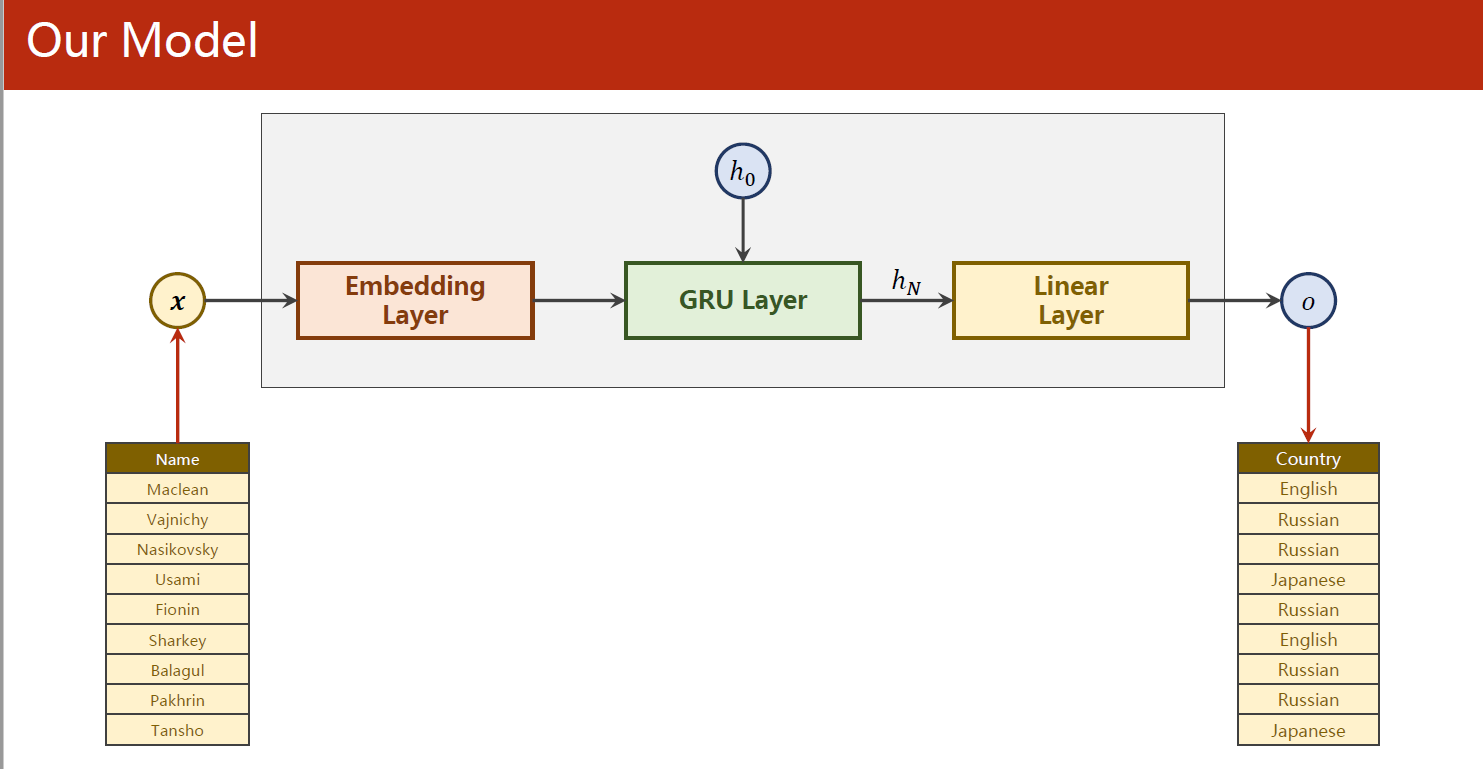

我们的模型结构:

2 相关解释

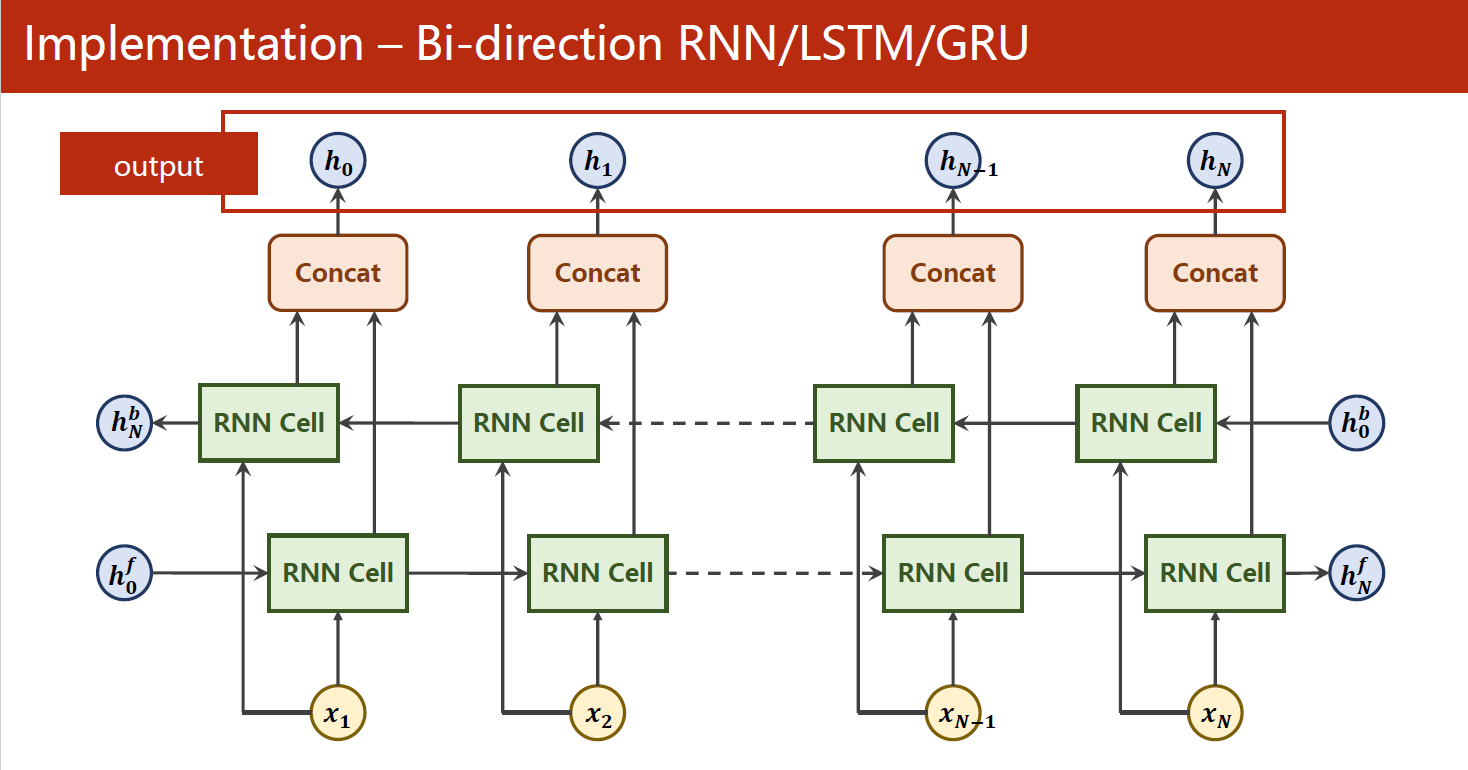

双向循环神经网络(Bidirectional Recurrent Neural Network,BiRNN)是一种常见的循环神经网络结构。与传统的循环神经网络只考虑历史时刻的信息不同,双向循环神经网络不仅考虑历史时刻的信息,还考虑未来时刻的信息。

在双向循环神经网络中,输入序列可以被看作是由两个部分组成的:正向和反向。在正向部分中,输入数据从前往后进行处理,而在反向部分中,输入数据从后往前进行处理。这两个部分在网络中分别使用独立的循环神经网络进行计算,并将它们的输出进行拼接。这样,网络就可以获得正向和反向两个方向的信息,并且能够同时考虑整个序列的上下文信息。

双向循环神经网络的作用是在处理序列数据时,提供更全面、更准确的上下文信息,能够捕获序列中前后关系,对于很多序列处理任务(例如自然语言处理、语音识别等)的效果都有很大的提升。在本代码中,设置了 bidirectional=True,意味着使用双向 GRU,提取的特征包含了正向和反向的信息。在 GRU 层输出后,通过 torch.cat() 将正向和反向的最后一个时间步的隐含状态进行拼接,从而得到一个更全面的特征表示。

3 代码

看过这系列视频的都知道这一讲是最难的,相关流程及解释可以看代码中的注释。

温馨提示:如果你有GPU加速的话,请把代码中第18行USE_GPU = False改成USE_GPU = True,同时把第154行和177行中的output = classifier(inputs, seq_lengths)改成output = classifier(inputs, seq_lengths.cpu()),否则会报错;除此之外,如果深度学习代码运行很久,千万记得让屏幕亮着,要不然它就停了!看我的运行结果epoch为97那里就发现了这是我的经验之谈。

import csv

import time

import matplotlib.pyplot as plt

import numpy as np

import math

import gzip # 用于读取压缩文件

import torch

import torch.optim as optim

from torch.utils.data import Dataset, DataLoader

from torch.nn.utils.rnn import pack_padded_sequence

# 一些超参数

HIDDEN_SIZE = 100

BATCH_SIZE = 256 # 一次训练的样本数,为256个名字

N_LAYER = 2 # RNN的层数

N_EPOCHS = 100

N_CHARS = 128 # ASCII码一共有128个字符

USE_GPU = False # 不好意思,我没GPU!

# 构造数据集

class NameDataset(Dataset):

def __init__(self, is_train_set=True):

filename = '../Data/names_train.csv.gz' if is_train_set else '../Data/names_test.csv.gz'

with gzip.open(filename, 'rt') as f: # rt表示以只读模式打开文件,并将文件内容解析为文本形式

reader = csv.reader(f)

rows = list(reader) # rows是一个列表,每个元素是一个名字和国家名组成的列表

self.names = [row[0] for row in rows] # 一个很长的列表,每个元素是一个名字,字符串,长度不一,需要转化为数字

self.len = len(self.names) # 训练集:13374 测试集:6700

self.countries = [row[1] for row in rows] # 一个很长的列表,每个元素是一个国家名,字符串,需要编码成数字

# 下面两行的作用其实就是把国家名编码成数字,因为后面要用到交叉熵损失函数

self.country_list = list(sorted(set(self.countries))) # 列表,按字母表顺序排序,去重后有18个国家名

self.country_dict = self.getCountryDict() # 字典,key是国家名,value是country_list的国家名对应的索引(0-17)

self.country_num = len(self.country_list) # 18

# 根据样本的索引返回姓名和国家名对应的索引,可以理解为(特征,标签),但这里的特征是姓名,后面还需要转化为数字,标签是国家名对应的索引

def __getitem__(self, index):

return self.names[index], self.country_dict[self.countries[index]]

# 返回样本数量

def __len__(self):

return self.len

# 返回一个key为国家名和value为索引的字典

def getCountryDict(self):

country_dict = dict() # 空字典

for idx, country_name in enumerate(self.country_list):

country_dict[country_name] = idx

return country_dict

# 根据索引(标签值)返回对应的国家名

def idx2country(self, index):

return self.country_list[index]

# 返回国家名(标签类别)的个数,18

def getCountriesNum(self):

return self.country_num

# 实例化数据集

trainset = NameDataset(is_train_set=True)

trainloader = DataLoader(trainset, batch_size=BATCH_SIZE, shuffle=True)

testset = NameDataset(is_train_set=False)

testloader = DataLoader(testset, batch_size=BATCH_SIZE, shuffle=False)

N_COUNTRY = trainset.getCountriesNum() # 18个国家名,即18个类别

# 设计神经网络模型

class RNNClassifier(torch.nn.Module):

def __init__(self, input_size, hidden_size, output_size, n_layers=1, bidirectional=True):

super(RNNClassifier, self).__init__()

self.hidden_size = hidden_size # 隐含层的大小,100

self.n_layers = n_layers # RNN的层数,2

self.n_directions = 2 if bidirectional else 1 # 是否使用双向RNN

# 词嵌入层:input_size是输入的特征数(即不同词语的个数),即128;embedding_size是词嵌入的维度(即将词语映射到的向量的维度),这里让它等于了隐含层的大小,即100

self.embedding = torch.nn.Embedding(input_size, hidden_size)

# GRU层:input_size是输入的特征数(这里是embedding_size,其大小等于hidden_size),即100;hidden_size是隐含层的大小,即100;n_layers是RNN的层数,2;bidirectional是是否使用双向RNN

self.gru = torch.nn.GRU(hidden_size, hidden_size, n_layers, bidirectional=bidirectional)

# 全连接层:hidden_size是隐含层的大小,即100;output_size是输出的特征数(即不同类别的个数),即18

self.fc = torch.nn.Linear(hidden_size * self.n_directions, output_size)

def _init_hidden(self, batch_size):

# 初始化隐含层,形状为(n_layers * num_directions, batch_size, hidden_size)

hidden = torch.zeros(self.n_layers * self.n_directions, batch_size, self.hidden_size)

return create_tensor(hidden)

def forward(self, input, seq_lengths):

# input shape:B X S -> S X B

input = input.t() # 转置,变成(seq_len,batch_size)

batch_size = input.size(1) # 256,一次训练的样本数,为256个名字,即batch_size

hidden = self._init_hidden(batch_size)

# 1、嵌入层处理,input:(seq_len,batch_size) -> embedding:(seq_len,batch_size,embedding_size)

embedding = self.embedding(input)

# pack them up

gru_input = pack_padded_sequence(embedding, seq_lengths)

# output:(*, hidden_size * num_directions),*表示输入的形状(seq_len,batch_size)

# hidden:(num_layers * num_directions, batch, hidden_size)

output, hidden = self.gru(gru_input, hidden)

if self.n_directions == 2:

hidden_cat = torch.cat([hidden[-1], hidden[-2]],

dim=1) # hidden[-1]的形状是(1,256,100),hidden[-2]的形状是(1,256,100),拼接后的形状是(1,256,200)

else:

hidden_cat = hidden[-1] # (1,256,100)

fc_output = self.fc(hidden_cat) # 返回的是(1,256,18)

return fc_output

# 下面该函数属于数据准备阶段的延续部分,因为神经网络只能处理数字,不能处理字符串,所以还需要把姓名转换成数字

def make_tensors(names, countries):

# 传入的names是一个列表,每个元素是一个姓名字符串,countries也是一个列表,每个元素是一个整数

sequences_and_lengths = [name2list(name) for name in

names] # 返回的是一个列表,每个元素是一个元组,元组的第一个元素是姓名字符串转换成的数字列表,第二个元素是姓名字符串的长度

name_sequences = [sl[0] for sl in sequences_and_lengths] # 返回的是一个列表,每个元素是姓名字符串转换成的数字列表

seq_lengths = torch.LongTensor([sl[1] for sl in sequences_and_lengths]) # 返回的是一个列表,每个元素是姓名字符串的长度

countries = countries.long() # PyTorch 中,张量的默认数据类型是浮点型 (float),这里转换成整型,可以避免浮点数比较时的精度误差,从而提高模型的训练效果

# make tensor of name, (Batch_size,Seq_len) 实现填充0的功能

seq_tensor = torch.zeros(len(name_sequences), seq_lengths.max()).long()

for idx, (seq, seq_len) in enumerate(zip(name_sequences, seq_lengths)):

seq_tensor[idx, :seq_len] = torch.LongTensor(seq)

# sort by length to use pack_padded_sequence

# perm_idx是排序后的数据在原数据中的索引,seq_tensor是排序后的数据,seq_lengths是排序后的数据的长度,countries是排序后的国家

seq_lengths, perm_idx = seq_lengths.sort(dim=0, descending=True)

seq_tensor = seq_tensor[perm_idx]

countries = countries[perm_idx]

return create_tensor(seq_tensor), create_tensor(seq_lengths), create_tensor(countries)

# 把名字转换成ASCII码,返回ASCII码值列表和名字的长度

def name2list(name):

arr = [ord(c) for c in name]

return arr, len(arr)

# 是否把数据放到GPU上

def create_tensor(tensor):

if USE_GPU:

device = torch.device('cuda:0')

tensor = tensor.to(device)

return tensor

# 训练模型

def trainModel():

total_loss = 0

for i, (names, countries) in enumerate(trainloader, 1):

inputs, seq_lengths, target = make_tensors(names, countries)

output = classifier(inputs, seq_lengths)

loss = criterion(output, target)

optimizer.zero_grad()

loss.backward()

optimizer.step()

total_loss += loss.item()

if i % 10 == 0:

print(f'[{timeSince(start)}] Epoch {epoch} ', end='') # end=''表示不换行

print(f'[{i * len(inputs)}/{len(trainset)}] ', end='')

print(f'loss={total_loss / (i * len(inputs))}') # 打印每个样本的平均损失

return total_loss # 返回的是所有样本的损失,我们并没有用上它

# 测试模型

def testModel():

correct = 0

total = len(testset)

print('evaluating trained model ...')

with torch.no_grad():

for i, (names, countries) in enumerate(testloader, 1):

inputs, seq_lengths, target = make_tensors(names, countries)

output = classifier(inputs, seq_lengths)

pred = output.max(dim=1, keepdim=True)[1] # 返回每一行中最大值的那个元素的索引,且keepdim=True,表示保持输出的二维特性

correct += pred.eq(target.view_as(pred)).sum().item() # 计算正确的个数

percent = '%.2f' % (100 * correct / total)

print(f'Test set: Accuracy {correct}/{total} {percent}%')

return correct / total # 返回的是准确率,0.几几的格式,用来画图

def timeSince(since):

now = time.time()

s = now - since

m = math.floor(s / 60) # math.floor()向下取整

s -= m * 60

return '%dmin %ds' % (m, s) # 多少分钟多少秒

if __name__ == '__main__':

classifier = RNNClassifier(N_CHARS, HIDDEN_SIZE, N_COUNTRY, N_LAYER)

if USE_GPU:

device = torch.device('cuda:0')

classifier.to(device)

# 定义损失函数和优化器

criterion = torch.nn.CrossEntropyLoss()

optimizer = optim.Adam(classifier.parameters(), lr=0.001)

start = time.time()

print('Training for %d epochs...' % N_EPOCHS)

acc_list = []

# 在每个epoch中,训练完一次就测试一次

for epoch in range(1, N_EPOCHS + 1):

# Train cycle

trainModel()

acc = testModel()

acc_list.append(acc)

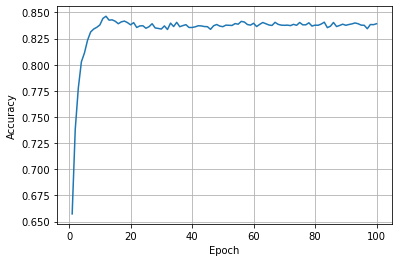

# 绘制在测试集上的准确率

epoch = np.arange(1, len(acc_list) + 1)

acc_list = np.array(acc_list)

plt.plot(epoch, acc_list)

plt.xlabel('Epoch')

plt.ylabel('Accuracy')

plt.grid()

plt.show()

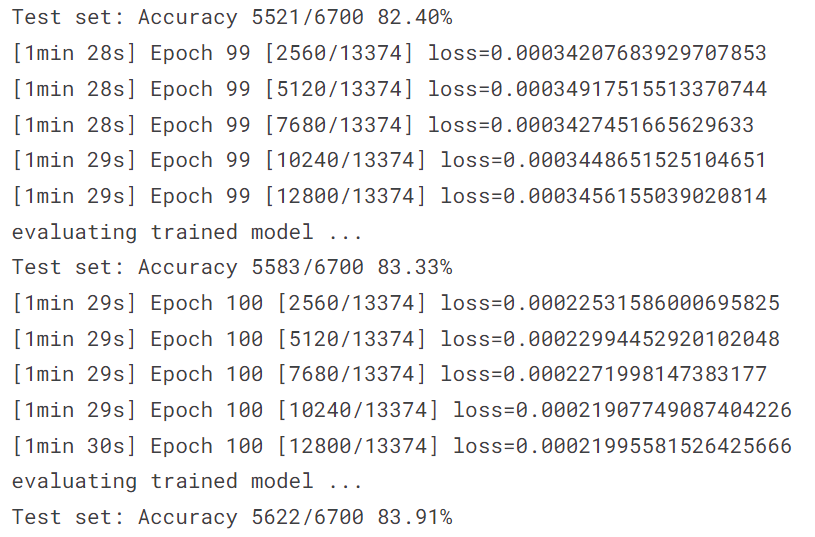

运行结果:

Training for 100 epochs...

[0min 2s] Epoch 1 [2560/13374] loss=0.00880123688839376

[0min 4s] Epoch 1 [5120/13374] loss=0.007671719812788069

[0min 6s] Epoch 1 [7680/13374] loss=0.007059914680818717

[0min 8s] Epoch 1 [10240/13374] loss=0.006611915945541114

[0min 11s] Epoch 1 [12800/13374] loss=0.006199482078664005

evaluating trained model ...

Test set: Accuracy 4404/6700 65.73%

......

太长了,这里删去了

......

Test set: Accuracy 5614/6700 83.79%

[18min 40s] Epoch 96 [2560/13374] loss=0.00011034630369977094

[18min 42s] Epoch 96 [5120/13374] loss=0.0001254687798791565

[18min 44s] Epoch 96 [7680/13374] loss=0.00013128189433094425

[18min 46s] Epoch 96 [10240/13374] loss=0.0001387107873597415

[18min 48s] Epoch 96 [12800/13374] loss=0.0001461269668652676

evaluating trained model ...

Test set: Accuracy 5613/6700 83.78%

[18min 52s] Epoch 97 [2560/13374] loss=0.0001349131613096688

[18min 54s] Epoch 97 [5120/13374] loss=0.00014072275480430106

[18min 56s] Epoch 97 [7680/13374] loss=0.00014947503271590297

[30min 41s] Epoch 97 [10240/13374] loss=0.0001497450133683742

[30min 43s] Epoch 97 [12800/13374] loss=0.00015023023312096484

evaluating trained model ...

Test set: Accuracy 5591/6700 83.45%

[30min 47s] Epoch 98 [2560/13374] loss=0.00010461835518071894

[30min 50s] Epoch 98 [5120/13374] loss=0.00012207417294121114

[30min 52s] Epoch 98 [7680/13374] loss=0.00013591610816850638

[30min 54s] Epoch 98 [10240/13374] loss=0.00014654295728178113

[30min 56s] Epoch 98 [12800/13374] loss=0.00014601548456994351

evaluating trained model ...

Test set: Accuracy 5618/6700 83.85%

[31min 0s] Epoch 99 [2560/13374] loss=0.00012085143134754617

[31min 2s] Epoch 99 [5120/13374] loss=0.00013280441216920736

[31min 3s] Epoch 99 [7680/13374] loss=0.00013986867391698374

[31min 5s] Epoch 99 [10240/13374] loss=0.00014336458771140314

[31min 7s] Epoch 99 [12800/13374] loss=0.0001451119186822325

evaluating trained model ...

Test set: Accuracy 5617/6700 83.84%

[31min 11s] Epoch 100 [2560/13374] loss=0.0001406415132805705

[31min 13s] Epoch 100 [5120/13374] loss=0.00012996229634154588

[31min 15s] Epoch 100 [7680/13374] loss=0.000135468188818777

[31min 17s] Epoch 100 [10240/13374] loss=0.0001424965994374361

[31min 19s] Epoch 100 [12800/13374] loss=0.00014370402568602002

evaluating trained model ...

Test set: Accuracy 5623/6700 83.93%

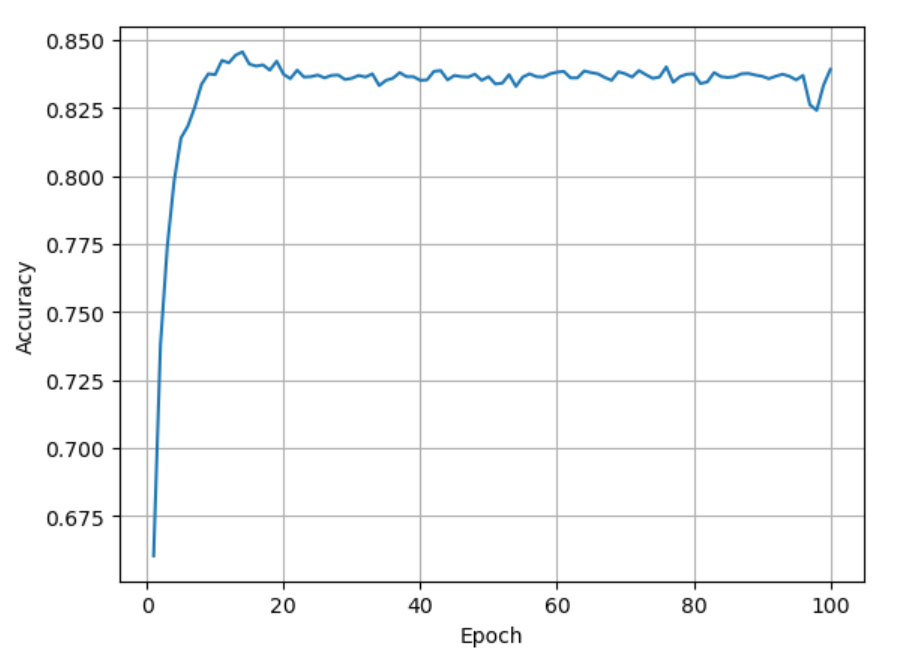

当然了,如果你也跟我一样是个喜欢白嫖的人,可以尝试用Kaggle的GPU跑,速度飞快!快了10多倍啊!不过最后的曲线肯定是差不多的,如下:

代码解释:

这是一个使用 PyTorch 实现的 RNN 分类器模型,目的是将给定的姓名(输入特征)分类到对应的国家(输出类别)。模型使用了 GRU(Gated Recurrent Unit)层作为核心组件,并且支持双向 RNN。模型的输入是姓名,即一个长度不定的字符串,需要将其转化为固定长度的向量表示。这里采用了词嵌入层将每个字符映射到一个固定长度的向量,并通过 RNN 层来提取其特征。最终输出一个大小为 18 的向量,分别代表属于每个国家的概率,使用 softmax 函数进行归一化处理。

在模型训练过程中,使用交叉熵损失函数来衡量模型预测值与真实值之间的误差,并使用 Adam 优化器来更新模型参数。同时,还使用了 DataLoader 来处理数据,以及pack_padded_sequence 函数来处理可变长度的输入序列。此外,还提供了一些辅助函数,如将国家名编码为数字、将数字解码为国家名等。

在训练时,使用了一个名为Adam的优化器,它是一种常用的优化算法,能够自适应地调节学习率,降低了手动调节超参数的难度。此外,还使用了交叉熵损失函数,用于评估模型的预测结果和真实标签之间的差异。

最后,通过一个for循环迭代训练模型,训练100个epoch,每个epoch中,将训练集分成多个batch,每个batch中包含256个样本,使用该batch训练模型,并计算损失值,然后更新模型参数。同时,在每个epoch结束后,使用测试集对模型进行测试,计算准确率和损失值,并将结果打印出来。

在机器学习中,训练数据和测试数据是两个独立的数据集,用于训练和评估模型的性能。在训练模型时,通常会对训练数据进行随机打乱,以确保每个样本都有机会被用于训练,减少模型对数据的过拟合,提高泛化能力。但是,对于测试数据,我们希望评估模型在未见过的数据上的性能,因此不应该对测试数据进行打乱,以确保模型在真实场景中的性能得到准确评估。

因此,在上述代码中,我们对训练数据集进行shuffle=True的打乱操作,以便每个batch的数据是随机的,有助于模型更好地学习到数据的分布特征;而对于测试数据集,我们设置shuffle=False,以确保测试集中的数据顺序不会影响模型的评估结果,避免测试结果受到无意义的影响。

写在最后:好好学习!为了去大公司用最高端的GPU!