大家好,我是微学AI,今天给大家介绍一下深度学习技巧应用9-模型训练中学习率的调整和假数据生成技巧与总结,我们在训练模型的时候,为了测试模型是否可以行,但是目前还没有标注好大量的数据,在缺乏数据的情况下,今天教大家如何生成假数据(测试数据)进行模型调试,并且教到家学习率如何调整来提高模型的性能,加快收敛的效果。

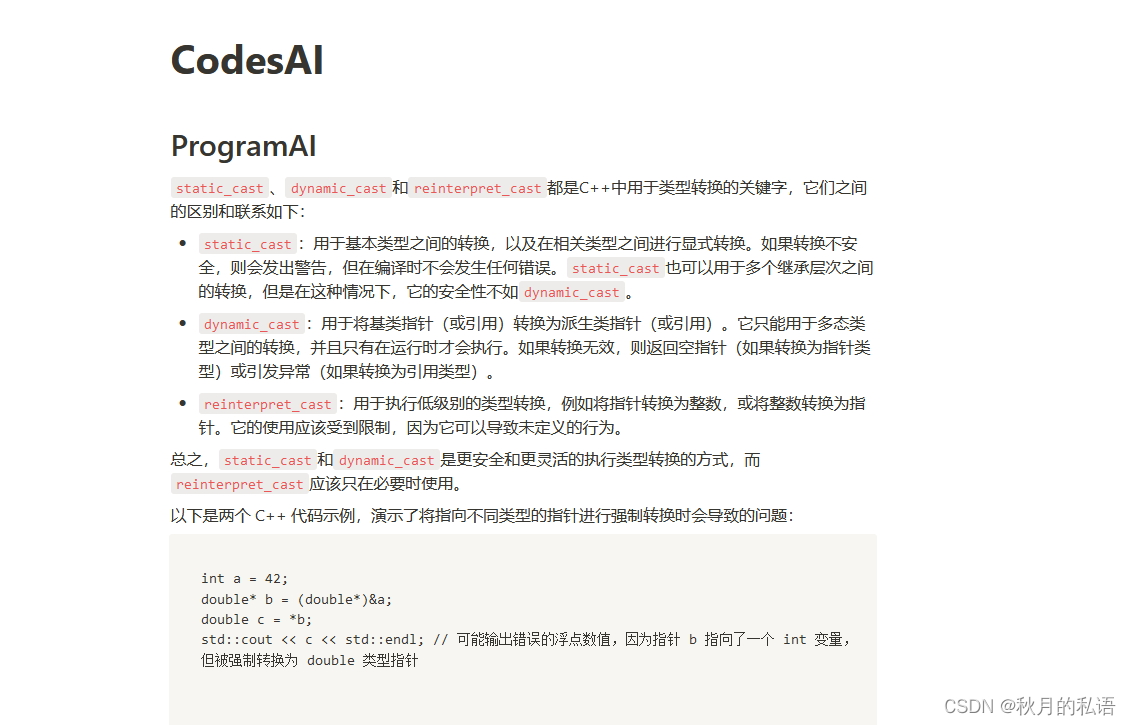

一、PyTorch框架下模型训练技巧

在PyTorch模型训练过程中,有很多可以提高训练效果和训练速度的技巧。以下是一些常见的技巧:

1. 学习率调整

2. 权重衰减

3. 使用预训练模型

4. 数据增强

5. 早停法

6. 使用不同的优化器

7. 层归一化

8. 使用更深的模型

9. 使用模型集成

后续会依依介绍,下面展开介绍其中一个技巧:学习率调整。

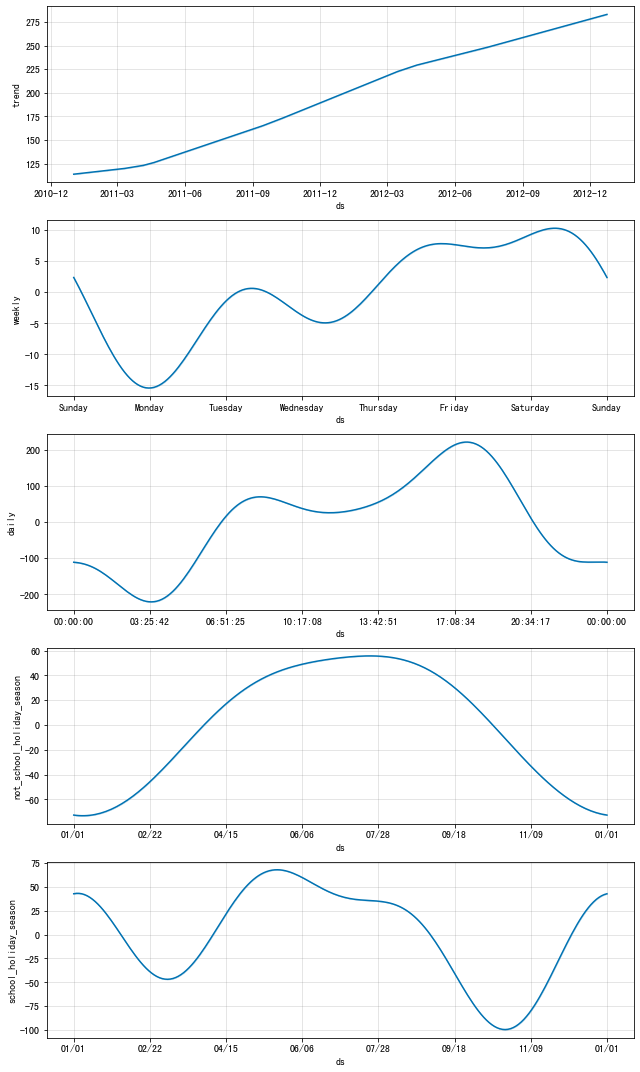

二、学习率调整技巧

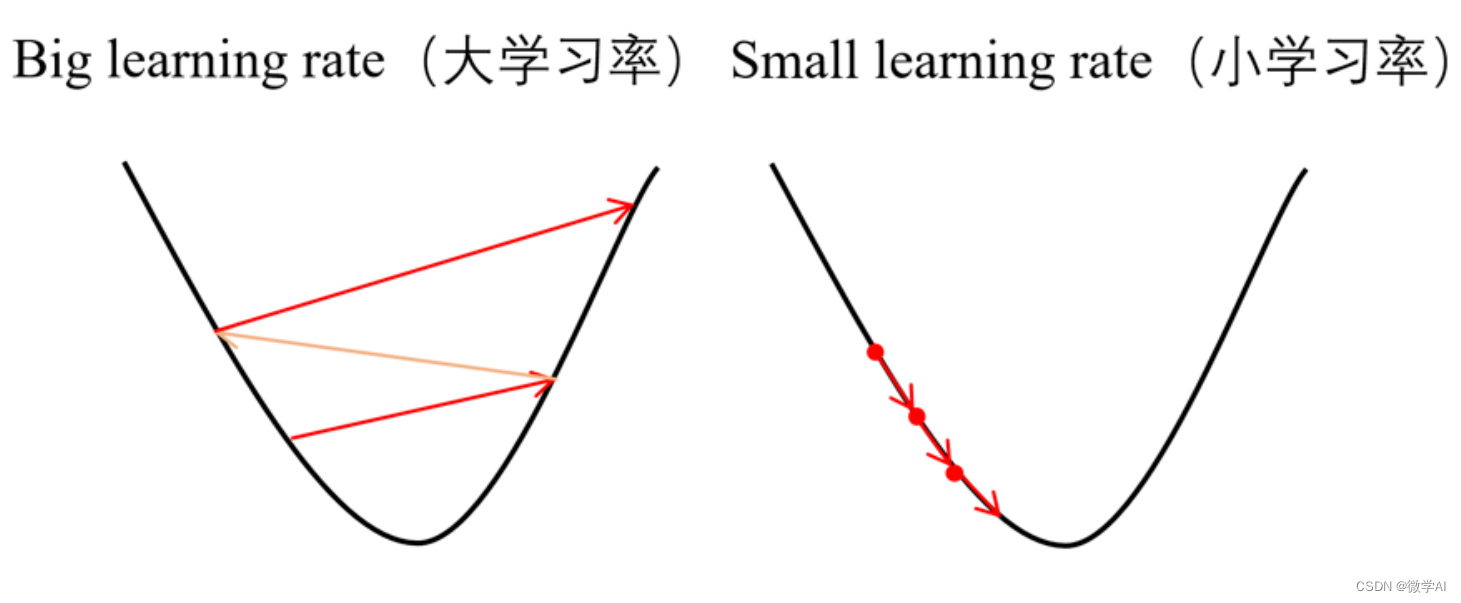

学习率调整是通过在训练过程中动态调整学习率来优化模型训练的过程。在训练初期,学习率可以设得较高,以快速收敛;当训练接近收敛时,学习率可以降低,以减少参数的震荡,使模型更稳定。PyTorch 提供了一些现成的学习率调整策略,如StepLR,ExponentialLR和ReduceLROnPlateau等。

训练过程中越到极值点的时候步长就要越小,为了防止跳跃过极值点,但是刚开始的时候学习率过

![[JavaEE初阶] 类加载机制](https://img-blog.csdnimg.cn/9198d6c8f0bd42d58b7669389dc12de8.png)