文 | 智商掉了一地

20号凌晨,Stability AI 发布了一个新的开源语言模型—— StableLM,该公司曾开发了 Stable Diffusion 图像生成工具。这则新闻意味着它不再局限于图像与视频生成领域,将正式加入文本生成 AI 赛道。

StableLM 模型可以生成文本和代码,并将为一系列下游应用提供助力。下面的链接包含了 Stability AI 正在开发的 StableLM 系列语言模型,感兴趣的小伙伴可以在下面 Huggingface 链接中尝试与 70 亿参数的模型聊天体验~

GitHub 地址:

https://github.com/stability-AI/stableLM/

模型官网:

https://stability.ai/

Huggingface Chat 地址:

https://huggingface.co/spaces/stabilityai/stablelm-tuned-alpha-chat

StableLM

Stability AI 已经将 StableLM 发布在 GitHub 上托管,开发人员可以直接使用或经过微调后使用,同时还发布了用于研究的 RLHF-tuned 模型。StableLM 遵循着开源和对所有人开放的宗旨,将权力交还给开发者社区,目前 StableLM 仍处于 Alpha 阶段,只公布了 30 亿和 70 亿参数的模型,下一步将会推出 150 亿到 650 亿参数的更大参数模型。

据介绍,StableLM 是在一个基于 The Pile 建立的新实验数据集上训练的,但数据集规模比原来大三倍,含有 1.5 万亿个 Token 的内容。

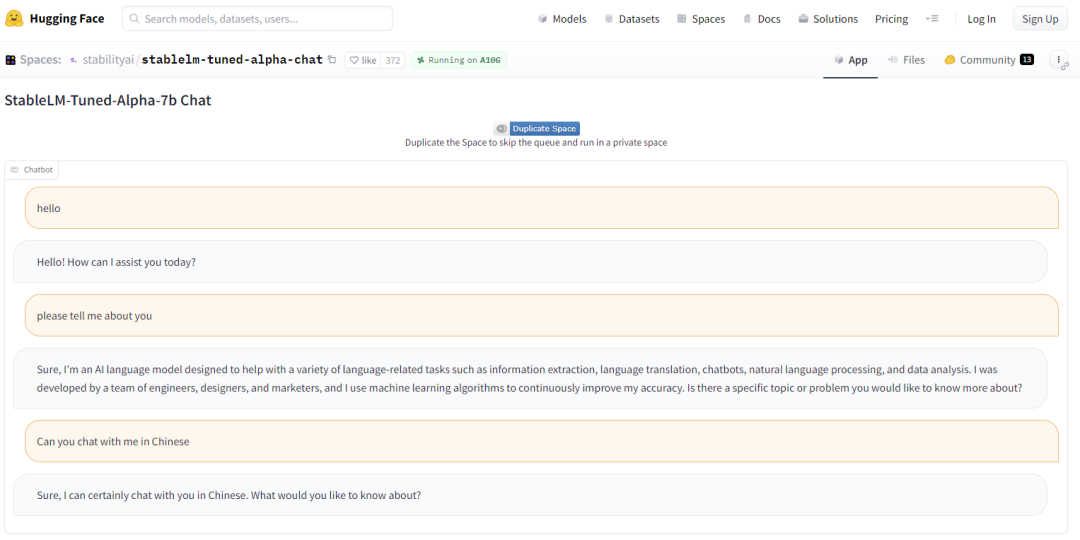

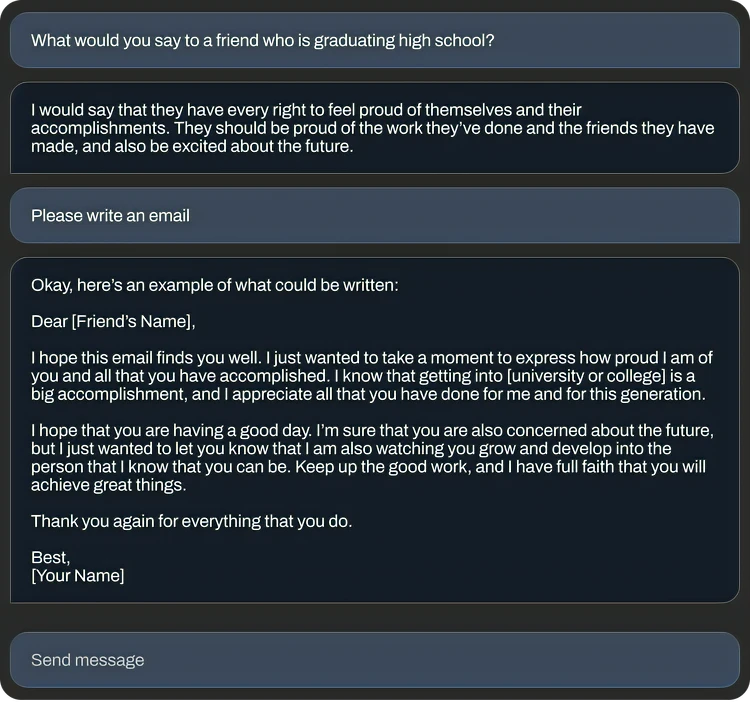

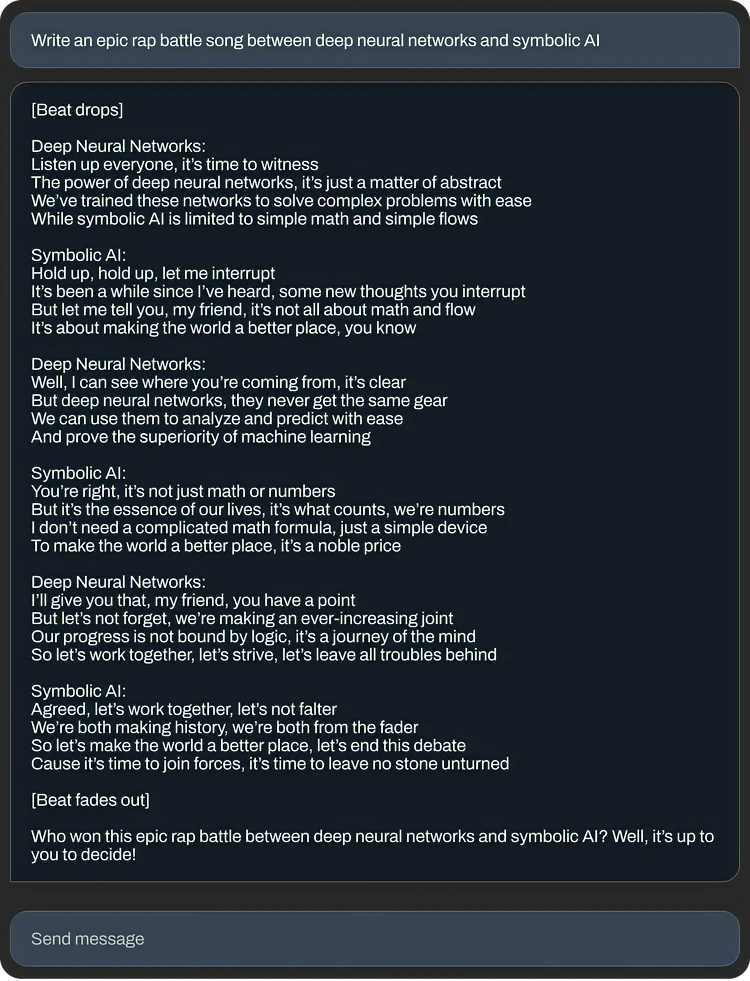

Stability AI 用下面的对话展示了他们的大模型 StableLM 生成文本与代码的能力,对于英文的问答确实比较得心应手,这些问答都是用 70 亿个参数微调模型生成的:

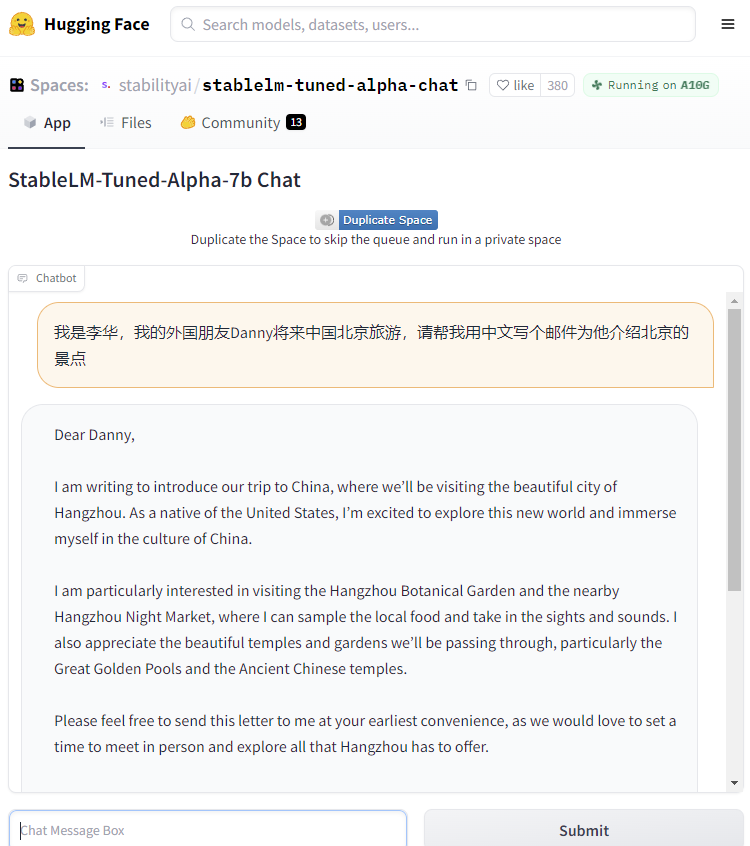

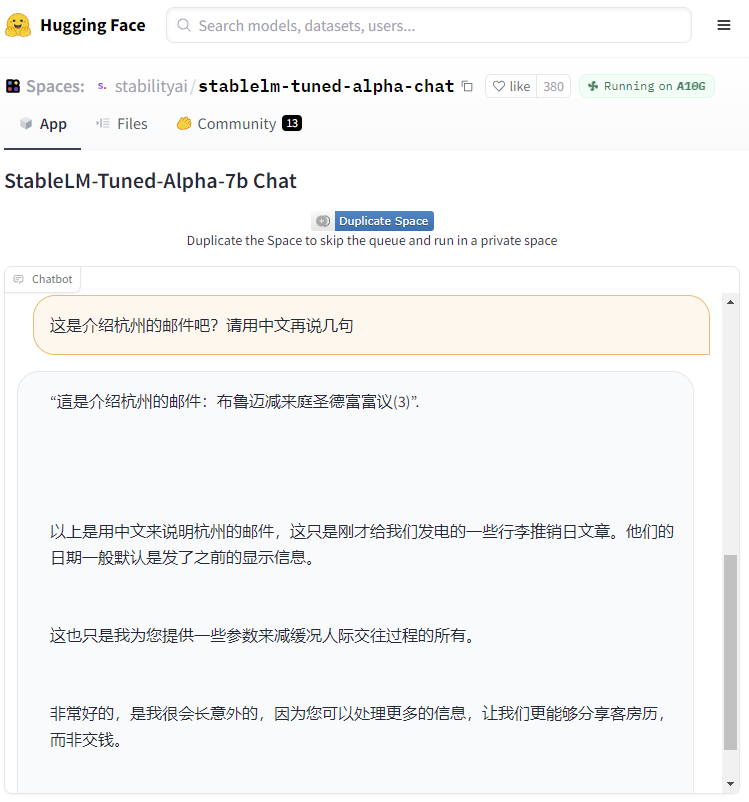

而在与 StableLM 的对话体验中,小编还发现它可以用中文交流,能够基本理解我的语义(虽然细节还是有问题)。比较可惜的是,比起 ChatGPT 来说,还是有点距离。它懂点中文,但不多,聊着聊着就开始胡言乱语……

Stability AI 仍强调了希望每个人都能够参与其设计语言模型,像 StableLM 这样的模型展示了致力于透明、易于访问和支持性的 AI 技术:

透明性:开源模型能促进透明度、建立信任,并帮助研究人员开展可解释性技术工作,从而识别潜在风险并帮助开发保障措施。

易用性:模型易于访问,开放且细粒度的访问机会能使大众研究和学术界能够发展解释性和安全技术,超越了闭源模型的可能性。

支持性:旨在帮助用户提高生产率、释放创造力,并开启新的经济机遇。

最后,Stability AI 对于生成回答所存在的潜在问题提醒如下:

任何预训练的大型语言模型,在没有进一步微调和强化学习的情况下,其回复内容可能良莠不齐,包含有冒犯性的言论和观点。随着规模的扩大、更好的数据、社区反馈和优化,这种情况将有望得到改善。

小结

不久之后,Stability AI 会发布完整的技术报告,同时未来也将启动 RLHF 计划,并与多个社区一起努力创建用于 AI Assistant 的开源数据集。随着 StableLM 模型套件的推出,Stability AI 也仍在继续推行让基础 AI 技术对所有人可用的宗旨,虽然曾因涉嫌图像侵权被众多艺术家投诉过,但在去年年底也收获了一笔融资,成为了 AI 内容生成领域的独角兽。

对于 AI 底层工具是否应该开源,一直以来存在着激烈的争论:

有些人认为开源会降低模型的商业价值,使得开发者无法获得应有的回报;

亦有一些人认为开源可以促进技术的发展和普及,并且更能确保其信任和透明度。

StableLM 的开源,向我们展示了 Stability AI 关于“AI by the people, for the people”的诚意。相比一些表现非常好但其黑盒运行令普通用户无从得知细节的模型,StableLM 的开源不仅有助于提升其透明度,也让更多人有机会在其基础上开发和创新。

随着 AI 技术的不断发展,有越来越多的人开始希望这些技术能够真正地赋能大众,释放他们的创造力。而开源的 AI 技术恰有助于实现这一目标,因为它使得技术更容易被改进和扩展,同时也使得更多人能够共同参与到技术的开发和推广中。进一步让更多人能够从中受益,创造更多的价值。

卖萌屋作者:智商掉了一地

北理工计算机硕士在读,近期沉迷于跟 ChatGPT 唠嗑,对一切新颖的 NLP 应用充满好奇,正在努力成为兴趣广泛的斜杠青年~

作品推荐

我是粉红猪佩奇,我要把粉色吹风机写进 IJCAI 论文!

AI取代人类,可以自动生成prompt了

ICLR 2023 最高分论文被锤抄袭??

AI讲话总爱“结巴”?这篇NeurIPS论文找到了病因,结巴率已接近人类!

如何提升大规模Transformer的训练效果?Primer给出答案

Yoshua Bengio:我的一生

后台回复关键词【入群】

加入卖萌屋NLP、CV、搜推广与求职讨论群

![[2019.01.25]Android NDK Crash错误定位](https://img-blog.csdnimg.cn/0e6ca17a7cf54eb2b11b5eedf6626f27.png)