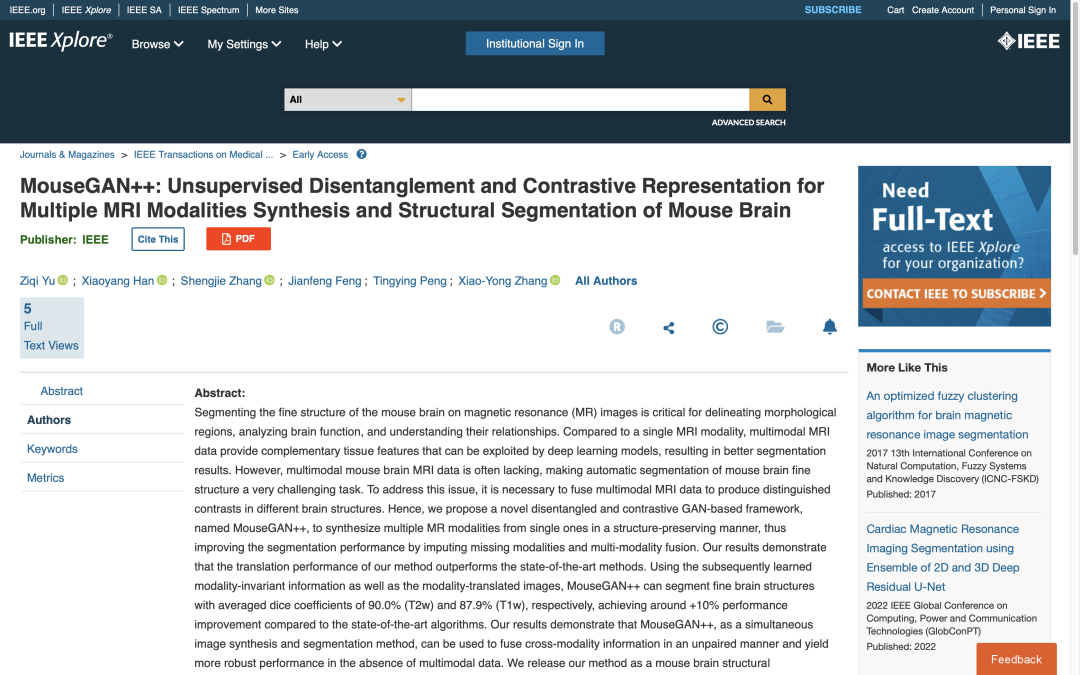

近日,复旦大学类脑智能科学与技术研究院青年研究员张孝勇课题组联合德国亥姆霍兹慕尼黑研究中心,在医学图像处理领域顶尖期刊《IEEE医学影像汇刊》(IEEE Transactions on Medical Imaging,TMI) 发表了题为《MouseGAN++:用于小鼠大脑MRI多模态合成和结构分割的无监督解耦及对比学习表征算法》(“MouseGAN++: Unsupervised Disentanglement and Contrastive Representation for Multiple MRI Modalities Synthesis and Structural Segmentation of Mouse Brain”)的研究成果,提出无监督解耦和对比学习表征算法解决小鼠大脑精细脑区分割的难题。

作为最重要的模式生物之一,小鼠在神经科学、肿瘤学和药学等领域发挥着不可替代的作用,是实现基础研究到临床应用转化的重要桥梁。由于小鼠和人类大脑在进化上具有保守性,小鼠大脑已被证明是理解人类大脑的重要基石之一。基于磁共振成像(MRI)数据,对小鼠大脑精细结构进行准确分割是理解小鼠大脑脑区功能的重要分析步骤。然而,迄今为止这仍是一项具有挑战性的任务。首先,脑结构的精确分割通常需要高分辨率的多模态MRI数据,但采集多模态数据的时间成本往往过高。再者,从模型设计上如何高效融合多模态MRI信息也面临着方法学上的挑战。其次,目前尚缺乏用于小鼠脑结构自动分割和标注的工具箱。

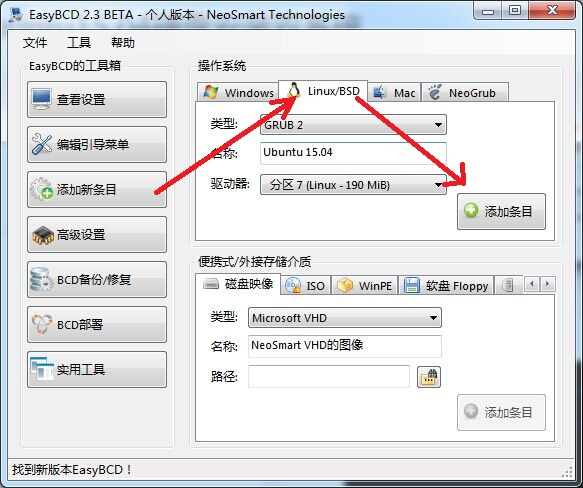

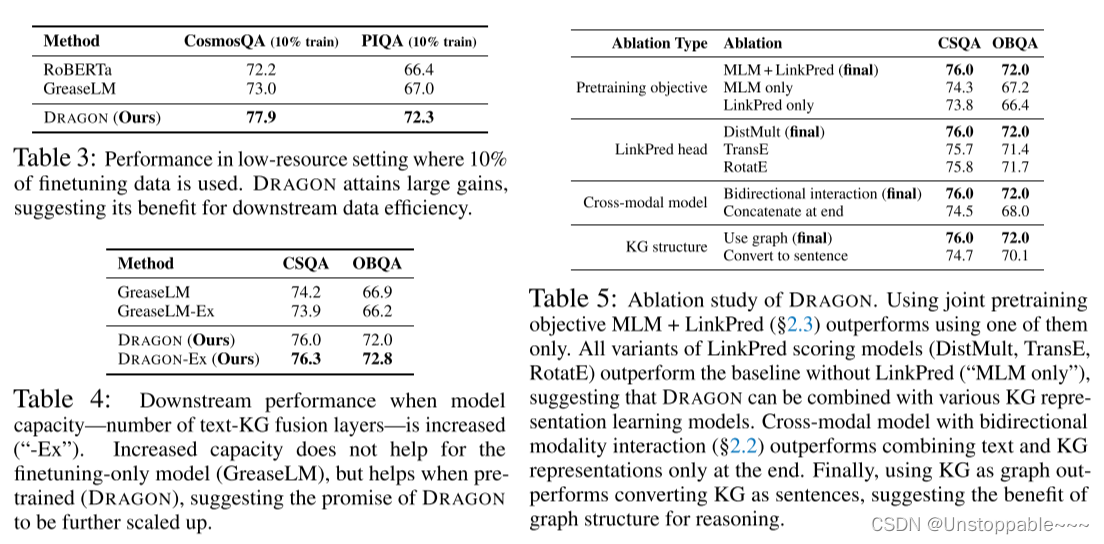

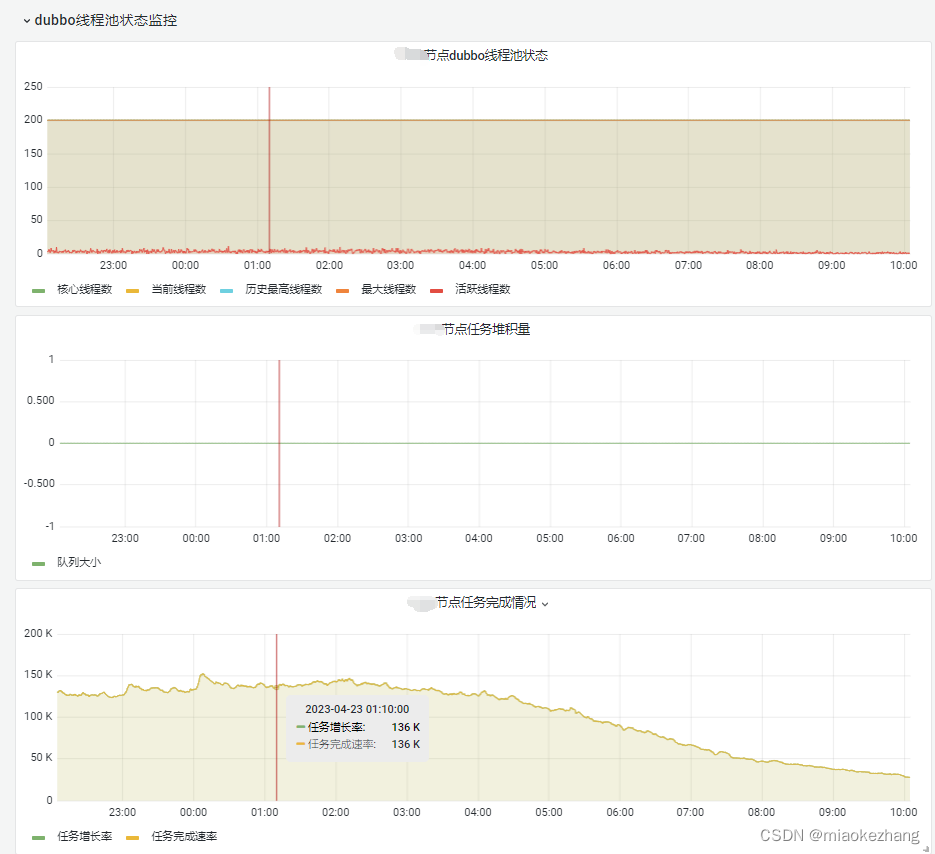

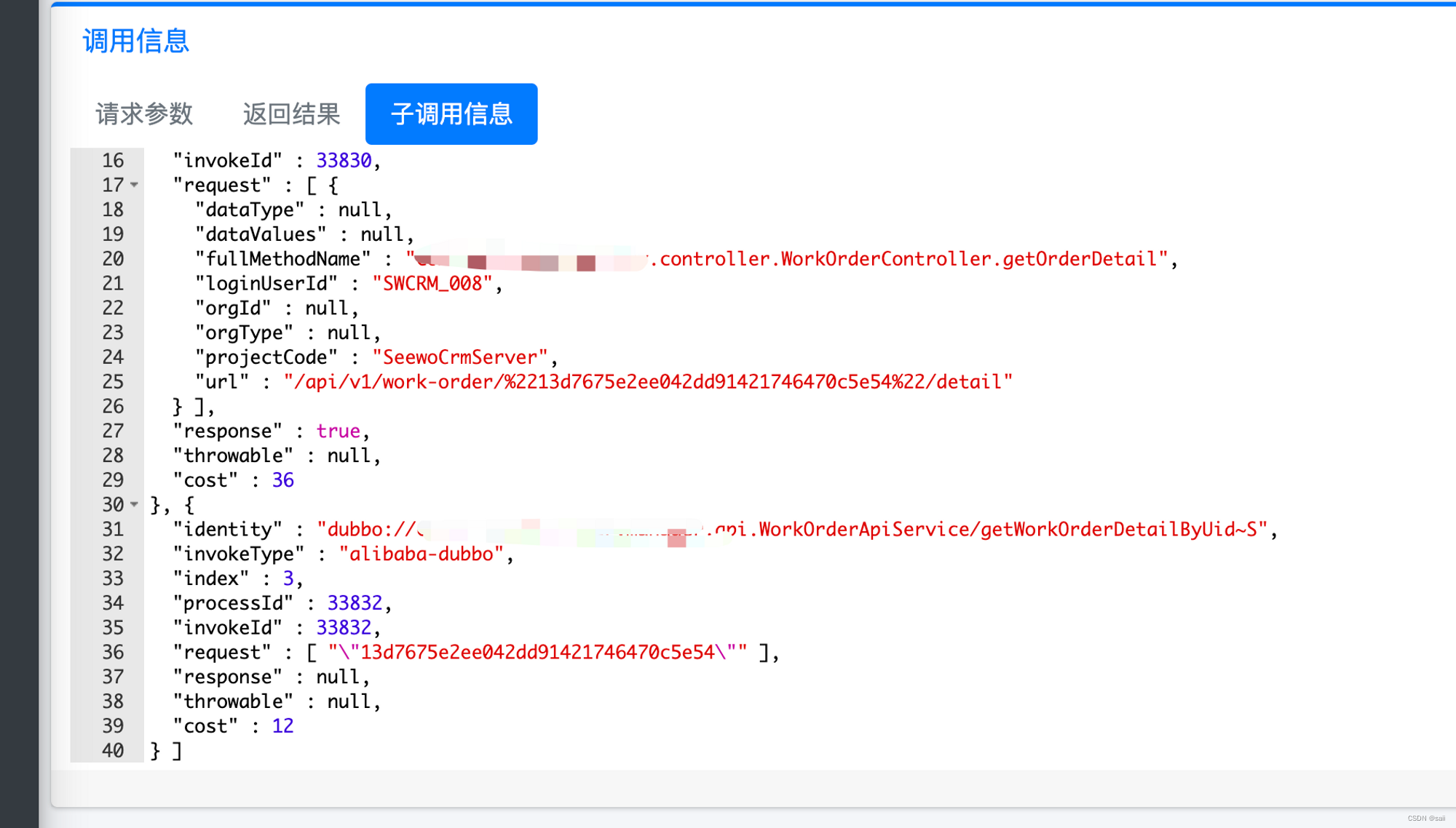

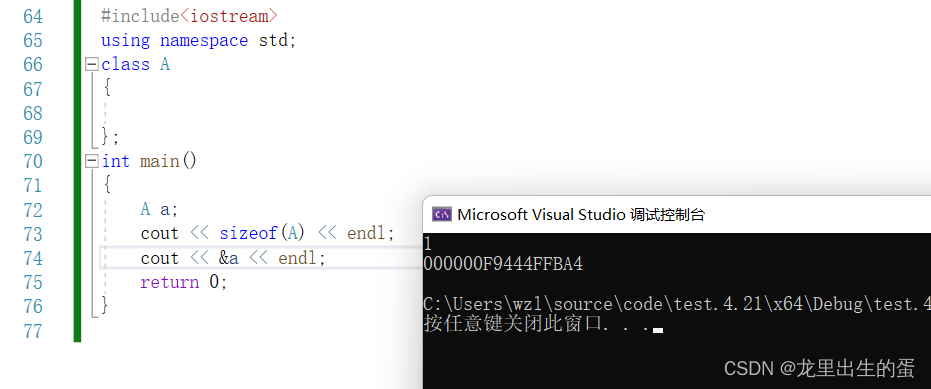

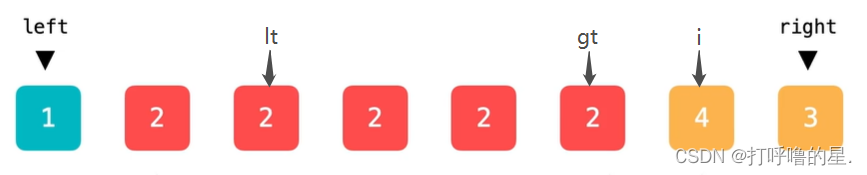

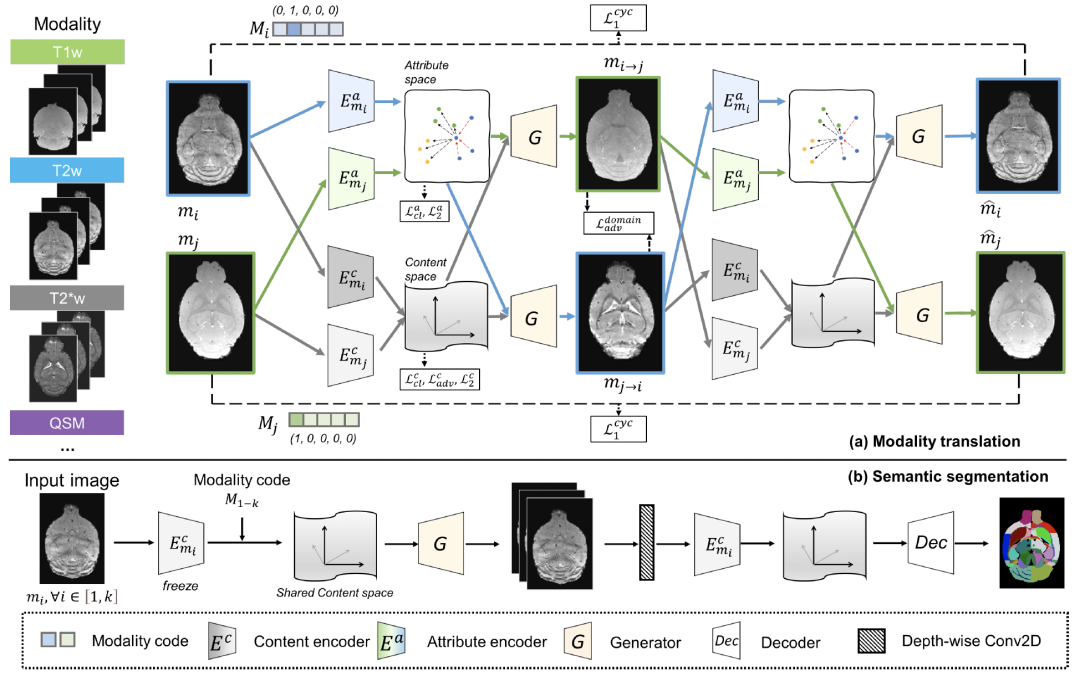

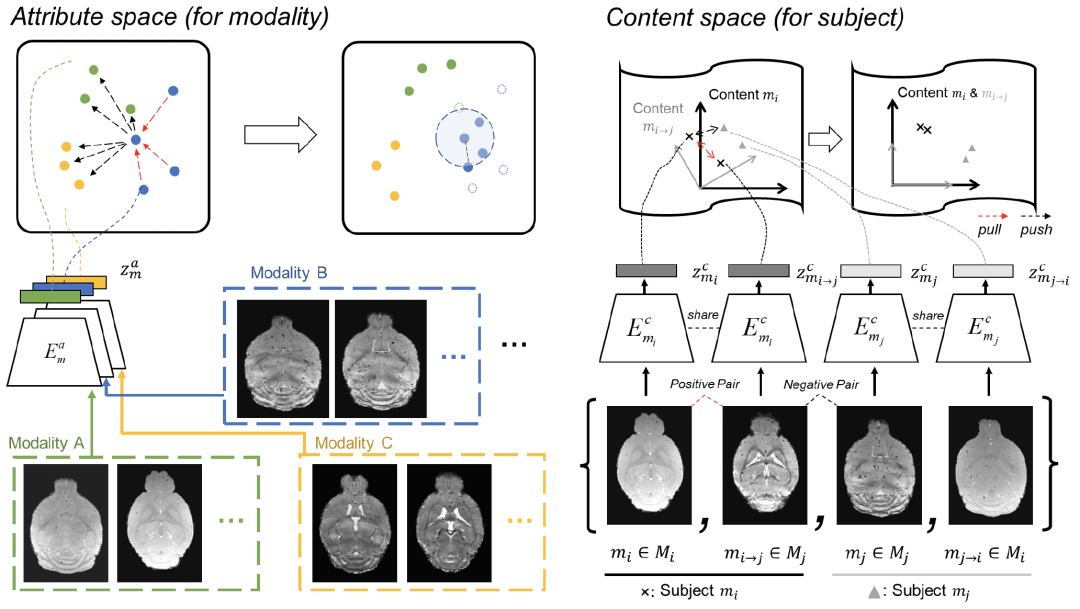

为解决这一问题,张孝勇课题组提出了一种新型深度学习框架,MouseGAN++(图1),完成“合成+分割”的任务。模型利用属性空间和个体空间的对比损失来度量样本间的相似度(图2),同时使对抗学习和对比学习在训练过程中同步交替进行,以更好地解耦出脑结构语义特征,使MRI在模态生成前后能保持结构一致性,进而促成高效的多模态图像融合来实现小鼠大脑结构的精细分割。

具体来说,针对多模态MRI自身的性质,我们将所有模态的图像分别解耦到属性空间和内容空间。现有的解耦方法通常使用高斯先验来约束属性隐空间的分布,但若用于多模态数据,可能会面临来自不同模态的属性特征之间解耦不充分的情况。为了克服这一问题,本文提出一种新的归纳偏置,即利用对比学习先验来指导网络学习属性空间的分布。

同时,考虑到脑结构的解剖特点(对称的左右脑半球的解剖结构应该具有相似的特征),若使用patch-level的训练方式,就会使网络在内容空间里区分它们,从而导致假阴性结果(错误的负样本对)。因此,本文采用轴位(slice-level)的训练方式以纳入全局语义信息。此外,对比学习通常需要设计额外的pretext-task进行预训练,pretext-task的设计质量以及它与下游任务之间的差距也会影响到模型的最终效果。

图1:MouseGAN++模型图。给定任意模态作为网络的输入,(a)模态生成模块:训练基于特征解耦和对比学习表征来合成所有模态。(b)重用内容编码器并将模态生成模块作为辅助网络插补缺失模态。

针对以上问题,MouseGAN++包含一个模态生成模块,我们在该模块引入两个新颖的对比损失函数,可将多模态图像特征投射到共享内容隐空间(用来编码模态无关的脑结构特征),以及模态相关的属性空间。随后,将内容隐空间中的向量与其他模态的属性特征向量相结合,以插补生成其他模态的图像。内容对比损失可以迫使网络在图像生成过程中避免混淆结构信息。同时,在对抗性训练期间重用属性和内容编码器,以同步优化对抗损失和对比学习损失。共享的内容空间还有助于分割模块中的解码器训练。此外,使用该模型插补模态也可以扩增训练数据集,使网络能够在多模态数据里学习模态无关的结构语义特征,从而增强多模态融合的效果。

图2:通过对比学习进行属性判别和内容判别。(左)对于属性空间,来自同一模态的样本被定义为正样本,在隐空间中相互拉近。不同模态的样本为负样本,相互推远。(右)来自同一个体的样本即使被变换了模态,都被视为正样本,它们的结构信息在内容隐空间内应保持高度一致。而相同模态下的不同个体之间则被视为负样本。

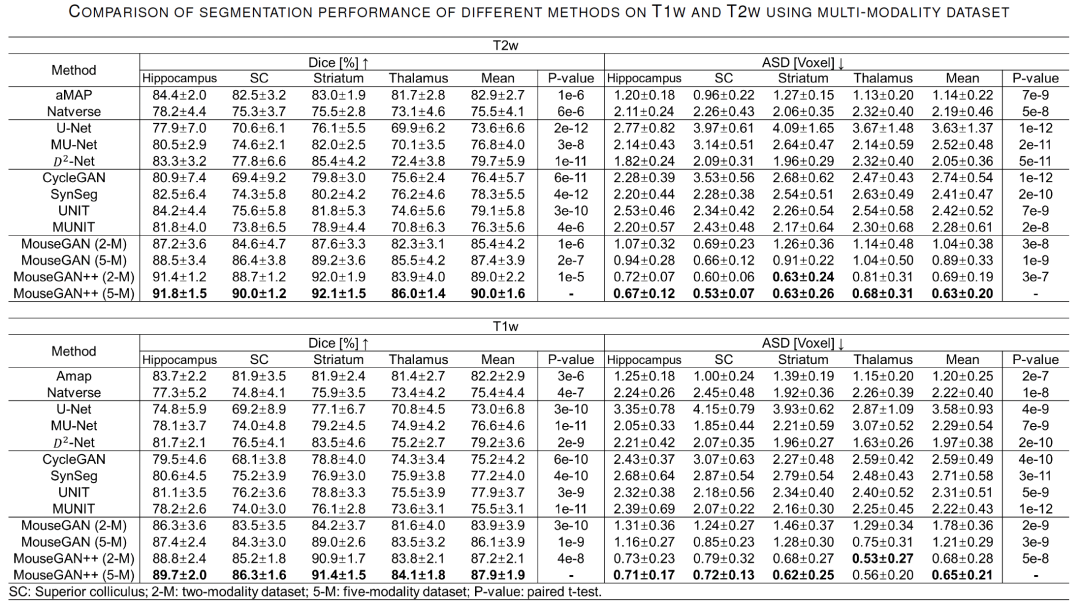

表1:MouseGAN++模型与State-of-the-art方法的性能对比。

如表1所示,与当前最先进的9种相关方法相比,以T1w和T2w为测试模态,平均DICE系数分别达到87.9%和90.0%,性能提高了约 +10%。上述图表及文中实验结果表明,MouseGAN++在生成和分割任务上都实现了显著的性能提升。本深度学习框架的源代码已开源:https://github.com/yu02019 。

在未来的工作中,一个有前景的研究方向是将我们开发的大脑提取工具(BEN)与MouseGAN++集成,形成一个鲁棒的、高通量的、端到端的神经影像处理流程。

复旦大学类脑智能科学与技术研究院张孝勇青年研究员为文章的通讯作者,德国亥姆霍兹慕尼黑研究中心彭廷莹研究员为共同通讯作者,复旦大学类脑智能科学与技术研究院冯建峰教授对本文做出重要指导。复旦大学类脑智能科学与技术研究院博士研究生余子奇为第一作者。

该研究得到了国家自然科学基金委面上项目、重大项目及上海市“脑与类脑智能基础转化应用研究”市级重大专项等的经费支持。

原文链接:

https://ieeexplore.ieee.org/document/9966838

参考文献:

Yu, Ziqi, et al. "BEN: a generalizable Brain Extraction Net for multimodal MRI data from rodents, nonhuman primates, and humans." bioRxiv (2022).(elife 接收)

张孝勇,复旦大学类脑智能科学与技术研究院青年研究员,中国图象图形学会脑图谱专委会委员,中华放射学会国际交流工作组委员,医学图像计算青年研讨会委员。

研究方向主要聚焦在大脑的磁共振成像、人工智能分析及分子影像研究。在磁共振代谢成像技术领域做出了若干原创性贡献。目前(2022.12)已发表学术论文50余篇,其中以通讯作者/第一作者发表学术论文30余篇,代表性成果发表在Advanced Science,IEEE Transactions on Medical Imaging,Cancer Research,Cell Reports等权威学术期刊。

研究成果曾被国际医学磁共振学会(ISMRM)以研究亮点报道。作为课题负责人主持多项国家自然科学基金项目及上海市项目,并以研究骨干参与国家自然科学基金重大项目、集成项目等。

来源:复旦类脑智能科学与技术研究院