使用块的网络(VGG)

本文为李沐老师《动手学深度学习》一书的学习笔记,原书地址为:Dive into Deep Learning。

另,给自己练习时没有gpu资源的小伙伴推荐下kaggle数据科学网站,每周免费训练时长30h。

1 网络结构

VGG块由一系列卷积层和一个最大汇聚层组成,块中的激活函数为ReLU函数,在原文的VGG块使用带有

3

×

3

3\times3

3×3卷积核、填充为1(保持高度和宽度)的卷积层,和带有

2

×

2

2\times2

2×2汇聚窗口、步幅为2(每个块后的分辨率减半)的最大汇聚层。而VGG网络并不只有VGG块,还包含了一系列全连接层。

原始VGG网络有5个卷积块,其中前两个块各有一个卷积层,后三个块各包含两个卷积层。 第一个模块有64个输出通道,每个后续模块将输出通道数量翻倍,直到该数字达到512。由于该网络使用8个卷积层和3个全连接层,因此它通常被称为VGG-11。

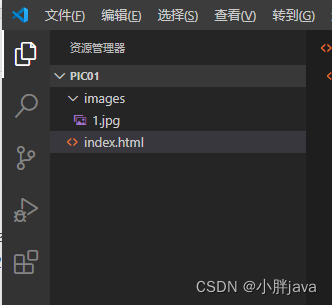

2 编码实现

- 编写生成VGG块的代码

输入参数包括:要创建的VGG块中包含的卷积层数、输入和输出通道数。

使用nn.sequential()创建神经网络,输入网络各层列表。激活函数使用ReLU,并且在最后添加一个最大汇聚层。

def vgg_block(num_convs, in_channels, out_channels):

layers=[]

for i in range(num_convs):

layers.append(nn.Conv2d(in_channels, out_channels, kernel_size=3, padding=1))

layers.append(nn.ReLU())

in_channels=out_channels

layers.append(nn.MaxPool2d(kernel_size=2, stride=2))

return nn.Sequential(*layers)

- 创建VGG-11网络

VGG-11有5个卷积块,其中前两个块各有一个卷积层,后三个块各包含两个卷积层。 第一个模块有64个输出通道,每个后续模块将输出通道数量翻倍,直到该数字达到512。在卷积层后接三个全连接层,将输出映射到数据集的十类分类中。

conv_arch = ((1, 64), (1, 128), (2, 256), (2, 512), (2, 512))

def vgg(conv_arch):

conv_blocks=[]

in_channels=1

for (nums_convs, out_channels) in conv_arch:

conv_blocks.append(vgg_block(nums_convs, in_channels, out_channels))

in_channels = out_channels

return nn.Sequential(

*conv_blocks, nn.Flatten(),

nn.Linear(out_channels*7*7, 4096), nn.ReLU(), nn.Dropout(0.5),

nn.Linear(4096, 4096), nn.ReLU(), nn.Dropout(0.5),

nn.Linear(4096, 10))

net = vgg(conv_arch)

- 网络调试

在编写全连接层代码前需要先计算输出的张量大小,然后根据输出通道数量得到扁平化后的张量大小。但是在学习过程中我有一个思路:编写网络代码时故意先略去全连接层部分,然后运行如下代码,结果的最后一行输出就包括了张量维度情况。这样可以省去个人计算时间,根据输出再去编写全连接层更加方便。(因为是初学者,不知道这样做是否存在某种隐患,若存在请留言,谢谢。)

X = torch.randn(size=(1, 1, 224, 224))

for blk in net:

X = blk(X)

print(blk.__class__.__name__,'output shape:\t',X.shape)

输出:

Sequential output shape: torch.Size([1, 64, 112, 112])

Sequential output shape: torch.Size([1, 128, 56, 56])

Sequential output shape: torch.Size([1, 256, 28, 28])

Sequential output shape: torch.Size([1, 512, 14, 14])

Sequential output shape: torch.Size([1, 512, 7, 7])

Flatten output shape: torch.Size([1, 25088])

Linear output shape: torch.Size([1, 4096])

ReLU output shape: torch.Size([1, 4096])

Dropout output shape: torch.Size([1, 4096])

Linear output shape: torch.Size([1, 4096])

ReLU output shape: torch.Size([1, 4096])

Dropout output shape: torch.Size([1, 4096])

Linear output shape: torch.Size([1, 10])

- 模型训练

# 由于VGG-11比AlexNet计算量更大,因此我们构建了一个通道数较少的网络(通道数是原来的1/4),足够用于训练Fashion-MNIST数据集。

ratio = 4

small_conv_arch = [(pair[0], pair[1] // ratio) for pair in conv_arch]

net = vgg(small_conv_arch)

# 批训练,把数据变成每128个数据进行一次训练。

# Epoch是指 “当一个完整的数据集通过了神经网络一次并且返回了一次,这个过程称为一个 epoch。”

lr, num_epochs, batch_size = 0.05, 10, 128

train_iter, test_iter = d2l.load_data_fashion_mnist(batch_size, resize=224)

d2l.train_ch6(net, train_iter, test_iter, num_epochs, lr, d2l.try_gpu())

输出:

loss 0.183, train acc 0.932, test acc 0.928

1795.3 examples/sec on gpu(0)