提示:文章写完后,目录可以自动生成,如何生成可参考右边的帮助文档

文章目录

- 逻辑回归&线性回归

- 单层神经元的缺陷

- 单层神经元的缺陷

逻辑回归&线性回归

线性回归预测的是一个连续值,

逻辑回归给出的”是”和“否”的回答.

等等,逻辑回归咋能输出 0,1呢, 前面还是神经元计算,输出的是tensor, Y_predict,

若只是和Y_real, 平方和(MSE) 做损失函数就是回归.

将损失转换成概率就是回归,所以要接一个把神经元计算的结果转化成概率的步骤.

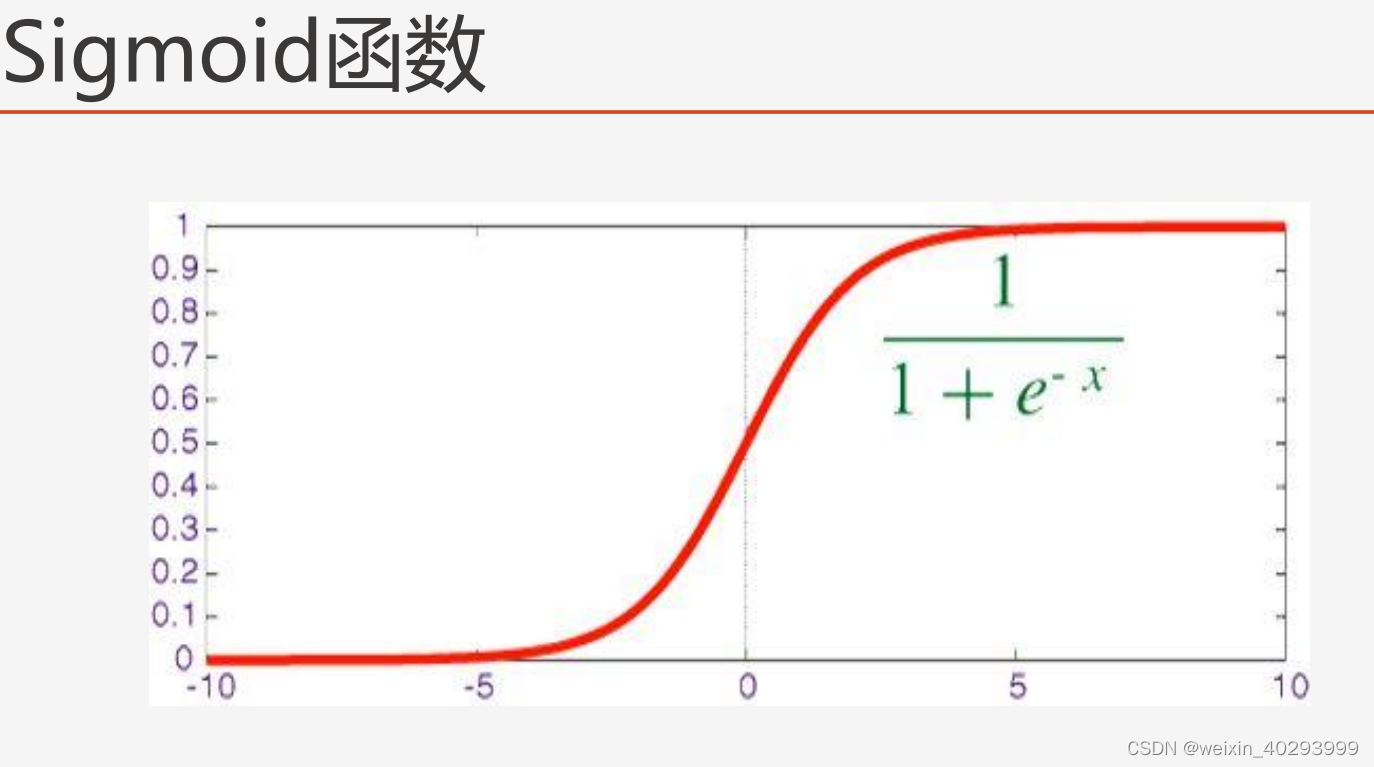

sigmoid函数是一个概率分布函数,给定某个输入,它将输出为一个概率值

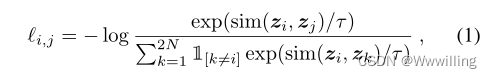

逻辑回归损失函数

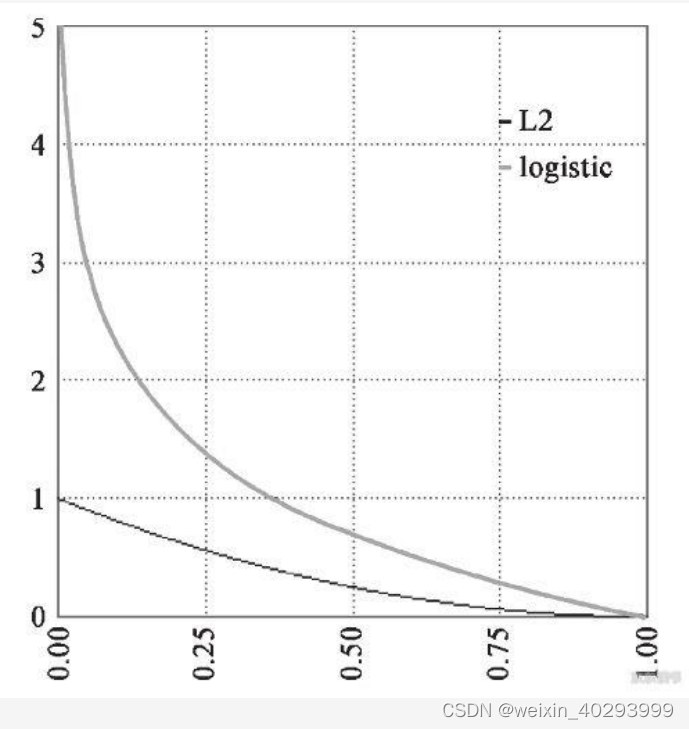

平方差所惩罚的是与损失为同一数量级的情形(线性回归)

对于分类问题,我们最好的使用交叉熵损失函数会更有效

交叉熵会输出一个更大的“损失"

交叉熵损失函数

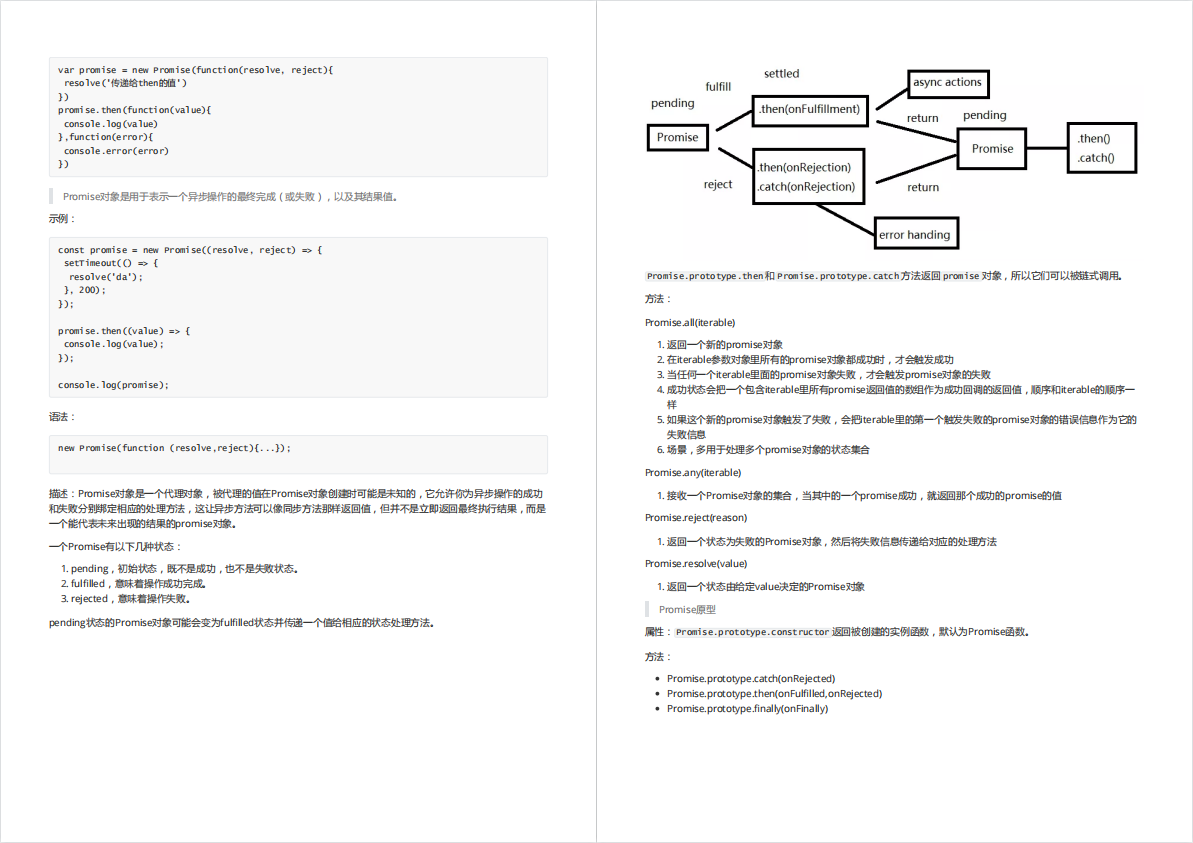

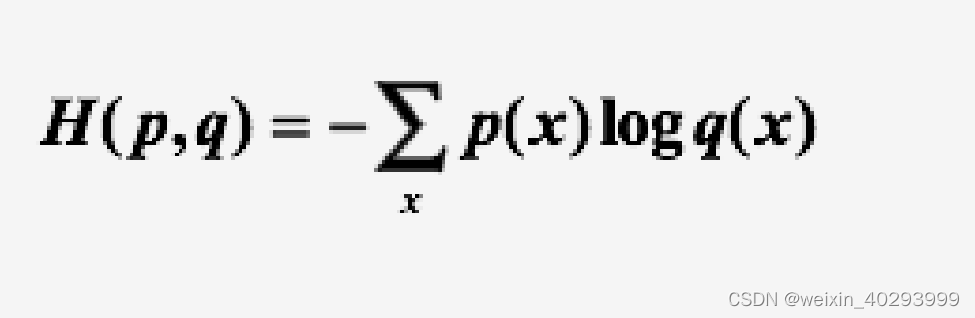

交叉熵刻画的是实际输出(概率)与期望输出(概率)的距离,也就是交叉熵的值越小,两个概率分布就越接近。假设概率分布p为期望输出,概率分布q为实际输出,H(p,q)为交叉熵,则:

上图可以看到L2 损失 在很不准的时候的loss很大…

在pytorch中,我们使用nn.BCELoss() 来计算二元交叉熵

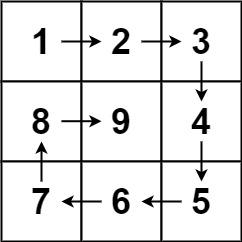

单层神经元的缺陷

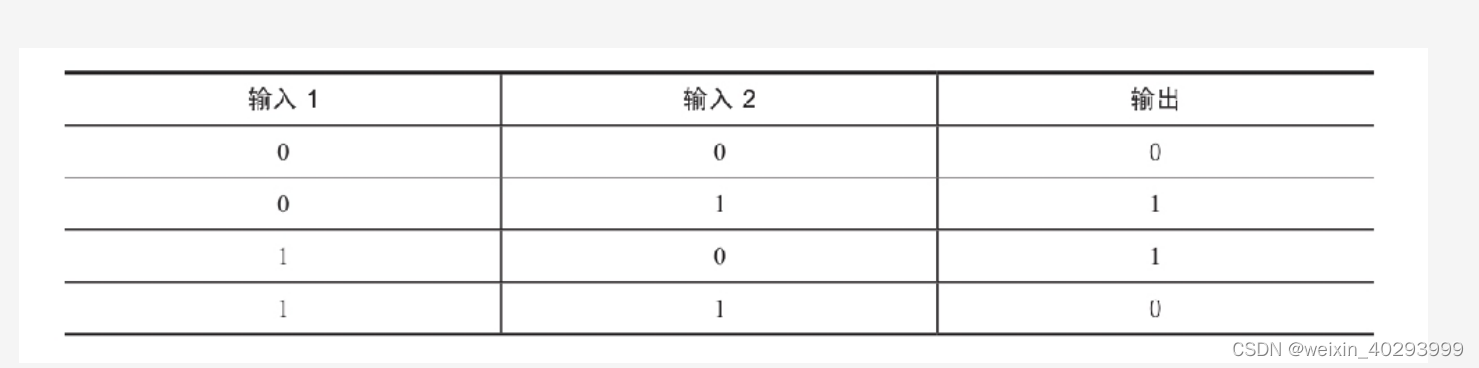

无法拟合“异或”运算,

异或 问题看似简单,使用单层的神经元确实没有办法解决

白话翻译:两个人(性别未知) 能不能领结婚证,用单层神经元是不行的,

只有男女 或者 女男的特征组合才可以。

但是 y = a1x1 + a2x2 +b

解决不了这个问题。

单层神经元的缺陷

神经元要求数据必须是线性可分的异或 问题无法找到一条直线分割两个类这个问题是的神经网络的发展停滞了很多年后来收到生物界的启发,做出了多多层感知器结构