第2篇:大模型核心术语解析:参数、Token、推理与训练

摘要

本文将用通俗易懂的语言拆解大模型领域的四大核心概念:参数、Token、训练与推理。通过案例对比、代码实战和成本计算,帮助读者快速掌握这些术语的底层逻辑与实际应用价值。

核心概念与知识点

1. 参数(Parameter)详解

什么是模型参数及其作用

参数是模型内部可调节的变量,决定了模型的“记忆力”和“学习能力”。例如,一个简单的线性回归模型的参数是斜率和截距,而大模型的参数可能达到千亿级别,每个参数都参与对输入数据的特征提取与预测。

引用:参数越多,模型的学习能力越强,但需要更多计算资源和数据支撑。

参数数量与模型能力的关系

- 亿级模型(如BERT):擅长处理特定领域任务,但泛化能力有限。

- 千亿级模型(如GPT-3):具备跨领域推理能力,可生成复杂文本。

对比:参数规模从亿级到千亿级,模型从“工具”升级为“通用大脑”。

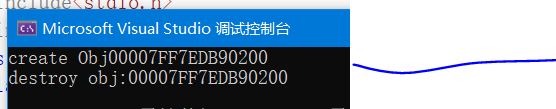

代码实战:参数数量与模型性能

import transformers

model = transformers.AutoModel.from_pretrained("bert-base-uncased")

print(f"BERT参数量:{model.num_parameters()/1e6:.1f}百万")

# 输出:BERT参数量:110.7百万

2. Token理解

分词原理与token化过程

Token是模型处理文本的最小单元,可以是单词、字符或子词(如“un”和“##pleasant”)。例如,句子“I love you”会被拆分为3个Token。

引用:Token化是语言理解与生成的基础,直接影响模型的输入输出。

不同语言的token特点

- 中文:通常按字分词(如“北京”可能拆分为“北”和“京”)。

- 英文:按空格分词,但复杂词汇可能被拆解(如“running”→“run”+“##ning”)。

- 代码:保留特殊符号(如

for i in range(10))。

Token计算与API计费

- 计费逻辑:多数API按请求的输入Token和输出Token数量收费(如OpenAI的

$0.002/1k tokens)。 - 案例:输入500个Token、输出1000个Token的请求,成本约$0.004。

3. 训练过程剖析

预训练数据集组成

- 数据来源:互联网文本、书籍、代码等(如GPT-3的训练数据包含45TB文本)。

- 数据清洗:去重、过滤敏感信息、平衡领域分布。

训练硬件需求与成本

- 硬件:需数千块GPU/TPU,训练成本可达数百万美元。

- 优化策略:

- 混合精度训练:用FP16降低内存占用。

- 模型并行:将模型拆分到多块GPU上。

4. 推理机制

自回归生成原理

模型逐Token生成文本,每一步依赖前一步的输出。例如:

# 伪代码示例

output = []

while len(output) < max_length:

next_token = model.predict(output)

output.append(next_token)

推理速度与资源消耗

- 吞吐量:批量处理(Batch Size=32)比单条处理更高效。

- 资源对比:推理阶段仅需1-10块GPU,远低于训练需求。

案例与实例

1. GPT-4的token计算实例与成本估算

假设用户输入一段包含200个Token的文本,要求生成500个Token的回复:

- 成本:输入费用 $0.002/1k * 200 = $0.0004

- 输出费用:$0.002/1k * 500 = $0.001

- 总费用:约$0.0014/次(以OpenAI定价为例)。

2. 同一句话在不同模型中的token数量对比

| 模型 | 输入句子 | Token数量 |

|---|---|---|

| BERT | “Hello, world!” | 3 |

| GPT-3 | “Hello, world!” | 2 |

| 中文模型 | “你好,世界!” | 5(按字) |

分析:分词策略差异导致Token数量不同,直接影响模型计算效率。

3. 推理资源配置实例

- 低负载场景:单GPU支持每秒10次请求,适合客服对话。

- 高并发场景:需部署多GPU集群,支持每秒1000次请求。

总结与扩展思考

- 核心术语的价值:理解参数、Token等概念,可优化模型选择与成本控制。

- 技术趋势:轻量化模型(如Llama.cpp)和分布式训练正在降低门槛。

- 未来方向:推理速度可能突破10000 Token/秒,模型参数规模或达万亿级。

下期预告:

《大模型实战:如何用Python部署你的第一个LLM》

(附代码仓库与详细部署教程)

互动提问:

“如果你要训练一个中文大模型,会如何设计分词策略?欢迎在评论区讨论!”