今天给我大家带来一篇最新的时间序列预测论文——MultiPatchFormer。这篇论文提出了一种基于Transformer的创新模型,旨在解决时间序列预测中的关键挑战,特别是在处理多尺度时间依赖性和复杂通道间相关性时的难题。MultiPatchFormer通过引入一维卷积技术,显著降低了通道维度上的计算负担和噪声干扰,同时设计了一种全新的多步解码器,有效缓解了长预测范围中的过拟合问题。这些创新设计使得模型在多个领域的时间序列预测任务中表现出色,实验结果表明,MultiPatchFormer在不同设置和输入长度下均展现了卓越的性能和鲁棒性。接下来,我将深入解析这一模型的架构设计和核心贡献。

接下来,我将深入对这篇论文展开全面解读。和以往一样,我会严格依照论文的结构框架,从研究背景、核心论点、实验设计到最终结论,逐一对文章的各个关键部分进行细致剖析 ,力求为大家呈现这篇时间序列预测论文的全貌,挖掘其中的研究价值与创新点。

1. Abstract

基于Transformer的时间序列预测模型近年来表现出色,并在该领域涌现了多种变体。然而,现有方法大多仅从单一尺度表示时间序列,这导致难以捕捉多粒度的时间特征或忽略序列间的相关性,从而可能影响预测的准确性。针对上述问题,本文提出了一种基于Transformer的模型,该模型结合了多尺度分块时间建模和通道级表示。在多尺度时间建模部分,输入时间序列被划分为不同分辨率的片段,以捕捉多尺度下的时间相关性。随后,通道级编码器对输入序列间的关系进行建模,以捕捉它们之间复杂的相互作用。此外,本文设计了一个多步线性解码器来生成最终预测,以减少过拟合和噪声的影响。通过在七个真实数据集上的大量实验,我们的模型(MultiPatchFormer)在误差指标上超越了当前主流基线模型,取得了最先进的性能,并展现出更强的泛化能力。

2. Instruction

时间序列预测在众多领域中扮演着至关重要的角色,包括金融、农业、气象和能源消耗等领域。受Transformer在自然语言处理和计算机视觉领域广泛应用的启发,研究人员对其架构进行了一些修改,并将其应用于各种时间序列任务(如预测、插值和分类)。尽管最近的研究对Transformer的性能提出了质疑,特别是在一些线性模型表现更优的情况下,但Transformer在表示复杂和非线性数据集方面的内在能力仍然具有巨大潜力。这强调了进一步改进Transformer架构的必要性,以充分发挥其在时间序列预测领域的能力。

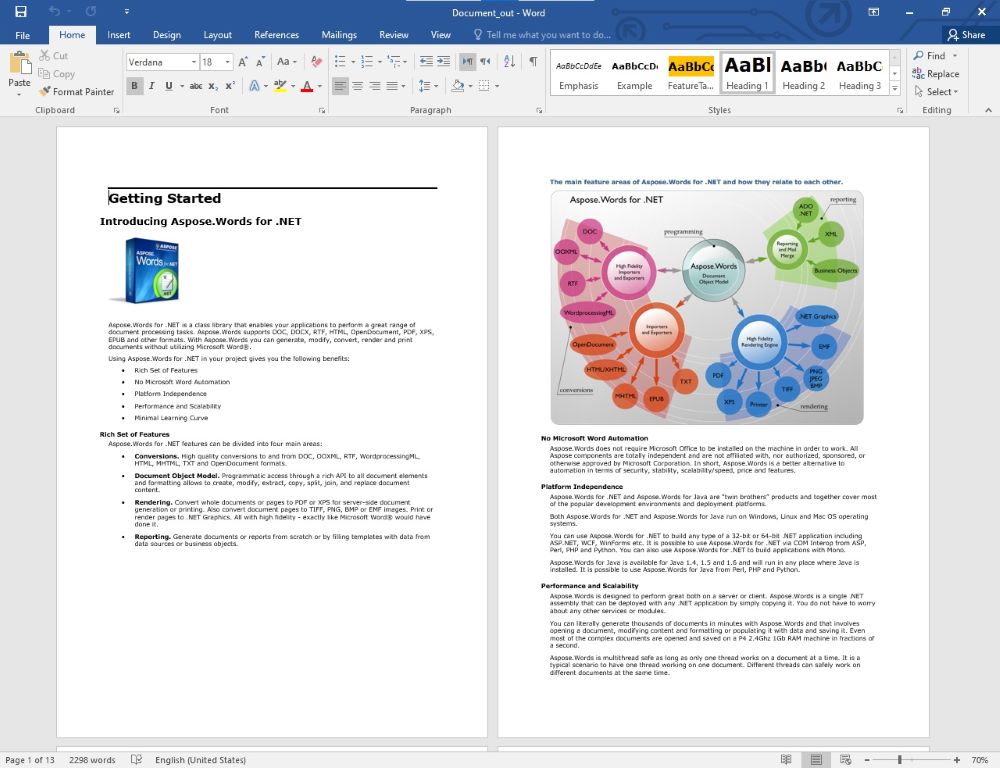

现实世界中的多元时间序列通常表现出不同变量之间的高度相关性以及多时间尺度上的波动。例如,电力消耗在季节性、每日和每小时粒度上表现出特定的时间变化。图1展示了一只股票在一年内的时间序列,其中不同尺度的片段之间的关系对于从多角度捕捉局部和全局时间依赖性至关重要。因此,对时间序列进行多尺度建模并表征序列间的相关性显得尤为重要。

详细文章链接:【技术解析】MultiPatchFormer:多尺度时间序列预测的全新突破