“ 学习是一个从围观到宏观,从宏观到微观的一个过程 ”

今天整体梳理一下大模型技术的框架,争取从大模型所涉及的理论,技术,应用等多个方面对大模型进行梳理。

01

—

大模型技术梳理

这次梳理大模型不仅仅是大模型本身的技术,而是一个以大模型为核心的涉及到多个方面的理论,技术和应用实践,也可以说是对自己学习大模型技术的总结吧。

话不多表,下面开始进入正题。

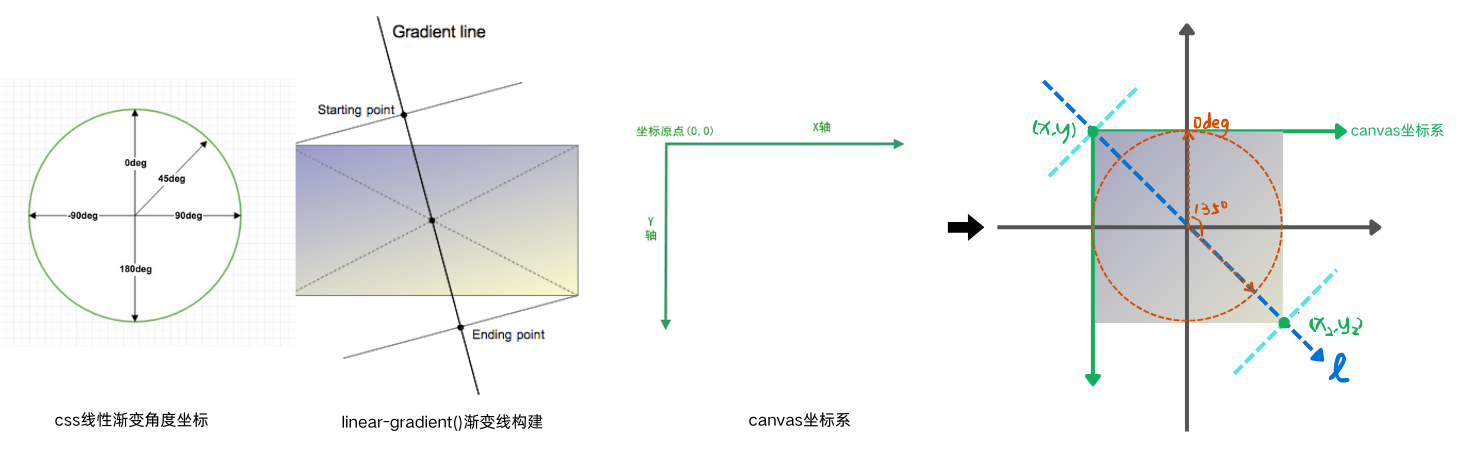

首先,大家应该明白一件事,大模型技术是人工智能技术的一个分支,是目前主流的一个研究方向,但并不是唯一的方向。

人工智能技术是一个通过某种技术手段人为的创建一个具有类人智能的系统(软件或硬件),而大模型技术是一种仿造人类学习进化的一种方式,使用深度学习(机器学习)算法模仿人类大脑神经元,来实现智能的一种方式,其主要载体是神经网络。

神经网络之所以得到发展的原因是因为,基于神经网络架构进行预训练之后,神经网络会产生一种无法解释的_涌现_能力,而这个涌现能力特别像是具有了智能一样。

_神经网络模型架构_

既然是模仿神经网络,那么就需要一种深度学习模型来模仿人类大脑神经系统,比如CNN(卷积神经网络),RNN(循环神经网络),以及目前主流的Transformer模型,还有LSTM,ResNet,GANs等。

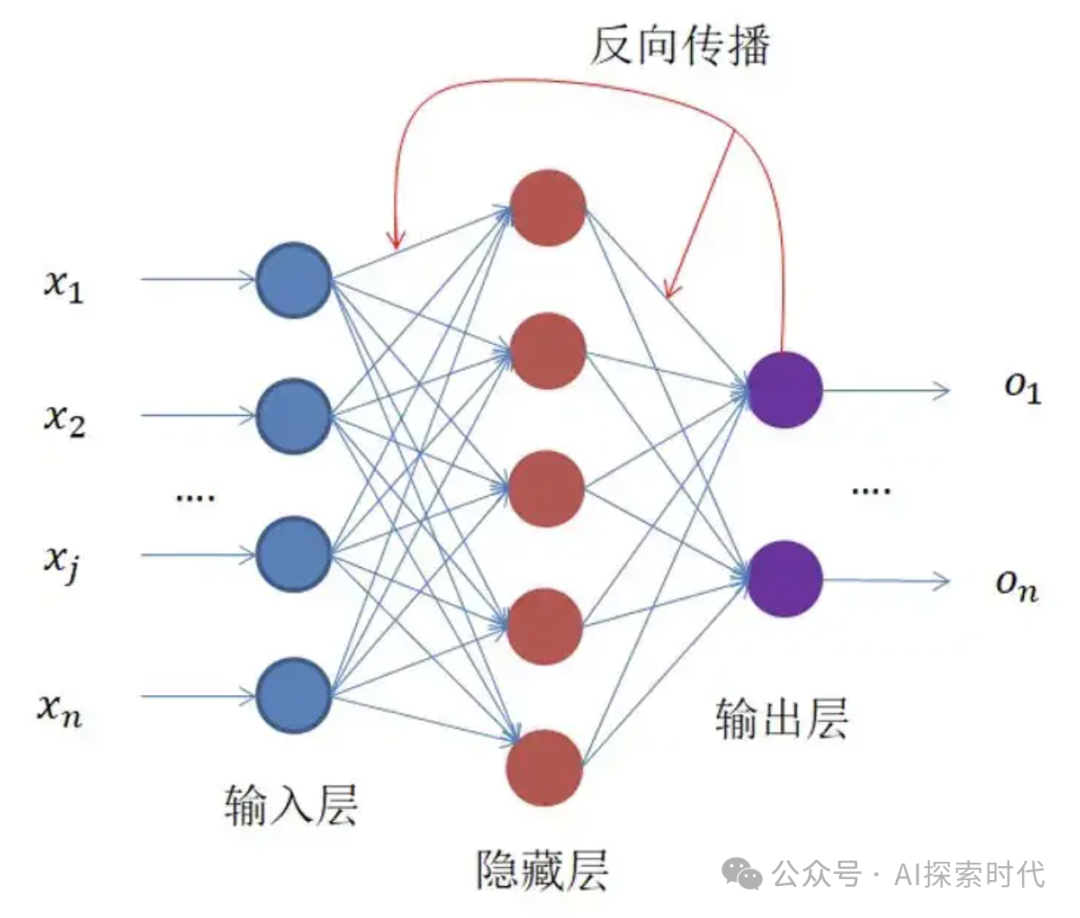

神经网络的主要结构为一个输入层,一个输出层,以及隐藏层(一个或多个层组成),不同网络层之间使用_全连接_的方式进行连接,每一个圆都代表着一个神经元,如下图所示:

在神经网络中,除了输入/输出层之外,每一个神经元都有其参数,神经网络的效果就是由这些参数值决定的。

神经网络模型通过一种叫正向传播,损失计算和反向传播的方式来调整神经网络模型中每个神经元的参数。

通过把大量的训练数据输入到神经网络中,让神经网络进行“学习”(不断的调整参数),来达到类智能的能力。

不同神经网络的架构和实现有所不同,但其核心点都是基于此模型实现的,对想学习神经网络的朋友来说,先学会基础的神经网络架构,然后再针对不同的神经网络模型进行深化是最好的选择。

目前的大模型主要采用的是预训练的方式来实现智能的,简单来说就是给神经网络模型一堆资料,让它自己学,自己看,自己总结;其中给答案的叫做监督学习,没答案的叫无监督学习。

然后根据不同的任务需求,又设计出用来解决不同类型任务的神经网络,比如分类任务,图片处理任务,自然语言处理任务等。

至于大模型技术细节方面的东西,就不详细描述了,感兴趣的可以自己学习,比如编码器,损失计算和反向传播怎么实现等。

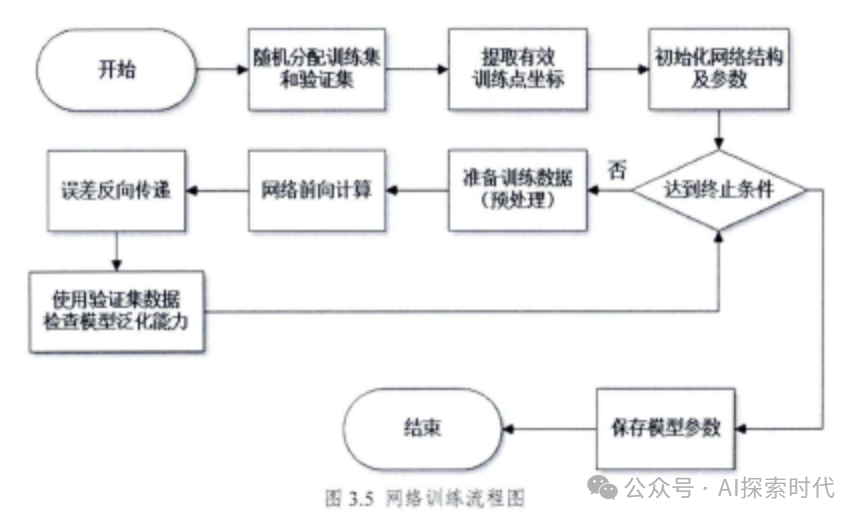

再有,设计并训练一个完整可用的神经网络模型是一个复杂的工程,比如模型的设计,训练数据的收集与处理,损失函数与反向传播算法的设计,模型过拟合,欠拟合等问题。

而且随着模型规模的增大,模型的训练难度成几何式增长,比如分布式训练,并行计算等问题;以及为了提升大模型的学习效率,节约成本而设计的强化学习,迁移学习等。

最后,为了使得大模型更像人,也为了实现真正的AGI(通用人工智能),现在多模态大模型大行其道,而多模态大模型技术比传统大模型的技术复杂度又上升了不止一个台阶。

_基于知识库的向量检索——RAG_

大模型技术虽然很强大,但其有几个明显的缺点,第一就是知识是有限制的,因为采用的是预训练方式,因此大模型的知识最多只能到训练开始的时间节点,之后产生的新的知识大模型无法获取。

其次,由于训练大模型的成本问题,导致很多企业无法承担大模型的训练成本,因此只能使用第三方的大模型,但第三方大模型没有在特定领域的数据上进行训练或微调,因此,其表现能力一般。

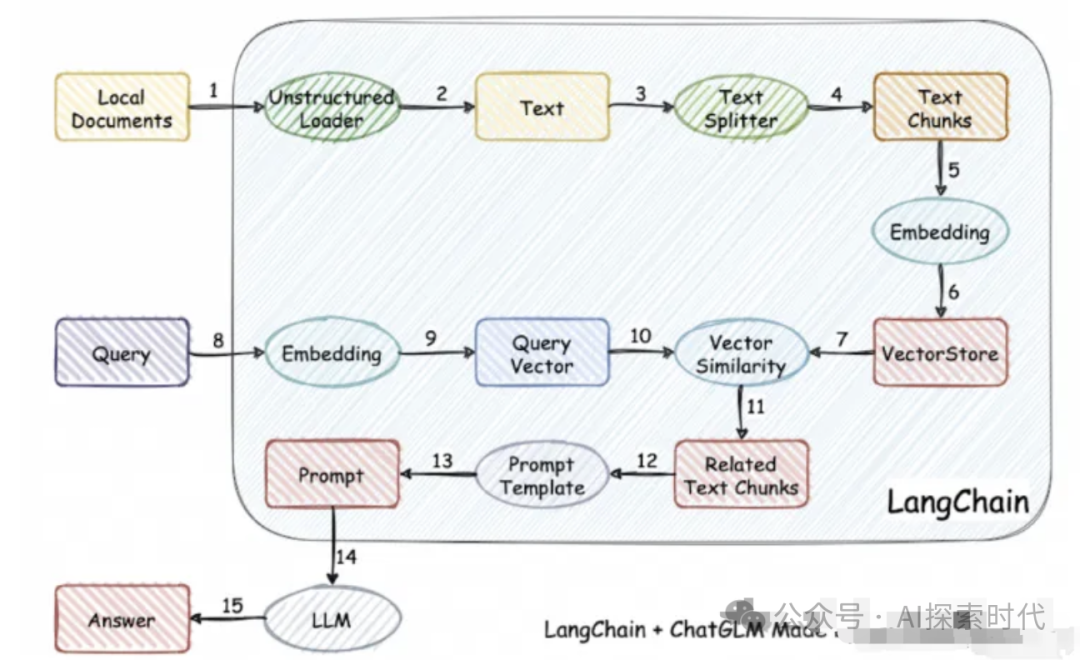

这时RAG就出现了,RAG中文是检索增强,是通过外挂知识库的方式,提问大模型之前先从向量数据库中查询数据,然后一起输入到大模型,这样大模型就相当于有了一个外部资料库,遇到不懂的问题就可以通过查资料的方式解决。

以目前的技术来说,RAG是大模型技术的一个重要节点,即是大模型能力范围的扩展,也是对大模型短板的补充。

微调与提示词工程

我们一般使用的大模型都是预训练模型,也就是用某些数据集训练过的模型;但这些模型一般情况下只会在特定领域表现出色,但如果用来解决自己的实际问题可能就不太好用了。

这时怎么让预训练模型在其它任务中表现更好就是一个值得思考的问题,而这就是微调与提示词工程存在的意义。

微调

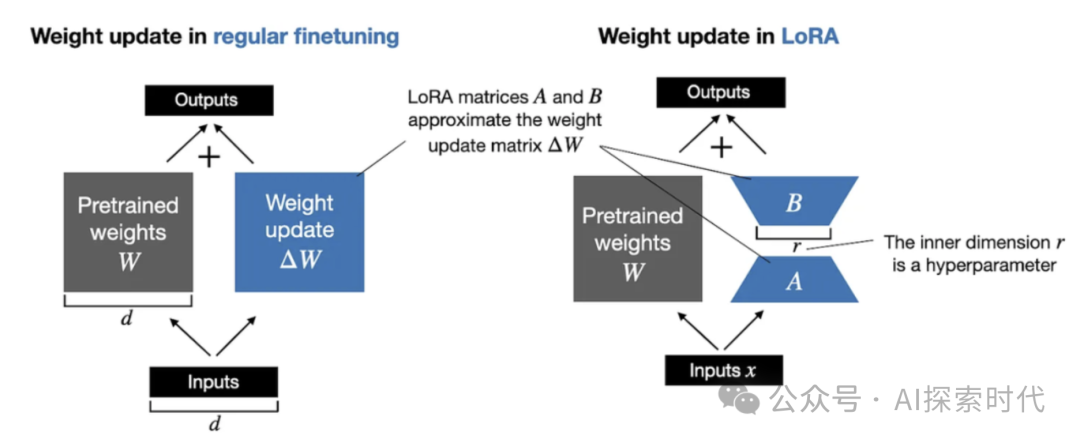

微调从技术手段上来说和模型训练没有区别,只不过微调是在相似任务的预训练模型的基础之上,通过少量的数据对模型参数进行调整,使得其能够更加适应当前任务的一种方式。由于其成本低,对资金和技术要求要比完全重新设计和训练一款模型要低的多。

因此,微调存在的意义是为了节约成本和降低门槛,如果资金充足的情况下,根据任务需求设计并训练一款模型是最好的选择,微调是退而求其次的一种方式。

提示词工程

如果说微调是为了让大模型去适应特定的任务,那么提示词的作用就是怎么更好的使用一个大模型。

根据研究发现,对待同样的问题使用不同的提示词有时会得到完全不一样的效果,因此根据这一现象就提出了提示学习的方法,具体的可以看之前的问题——提示学习。

用人类来举例就是,假如有人问你吃饭了吗这种简单的问题,你可以下意识的回答,而且可以回答的很好;大模型也是如此,如果你问大模型很简单的问题,它也能回答的比较好。

但如果问到一些复杂的问题就需要更加准确的描述,比如说根据当前的就业环境,从经济,市场,贸易,国际局势等多个方面来分析一下产生当前情况的原因,以及后续的应对方法。

这种复杂的问题,不论是问人还是问大模型,你说的越准确,它回答的才能更好,这就是提示词存在的意义。

_智能体Agent_

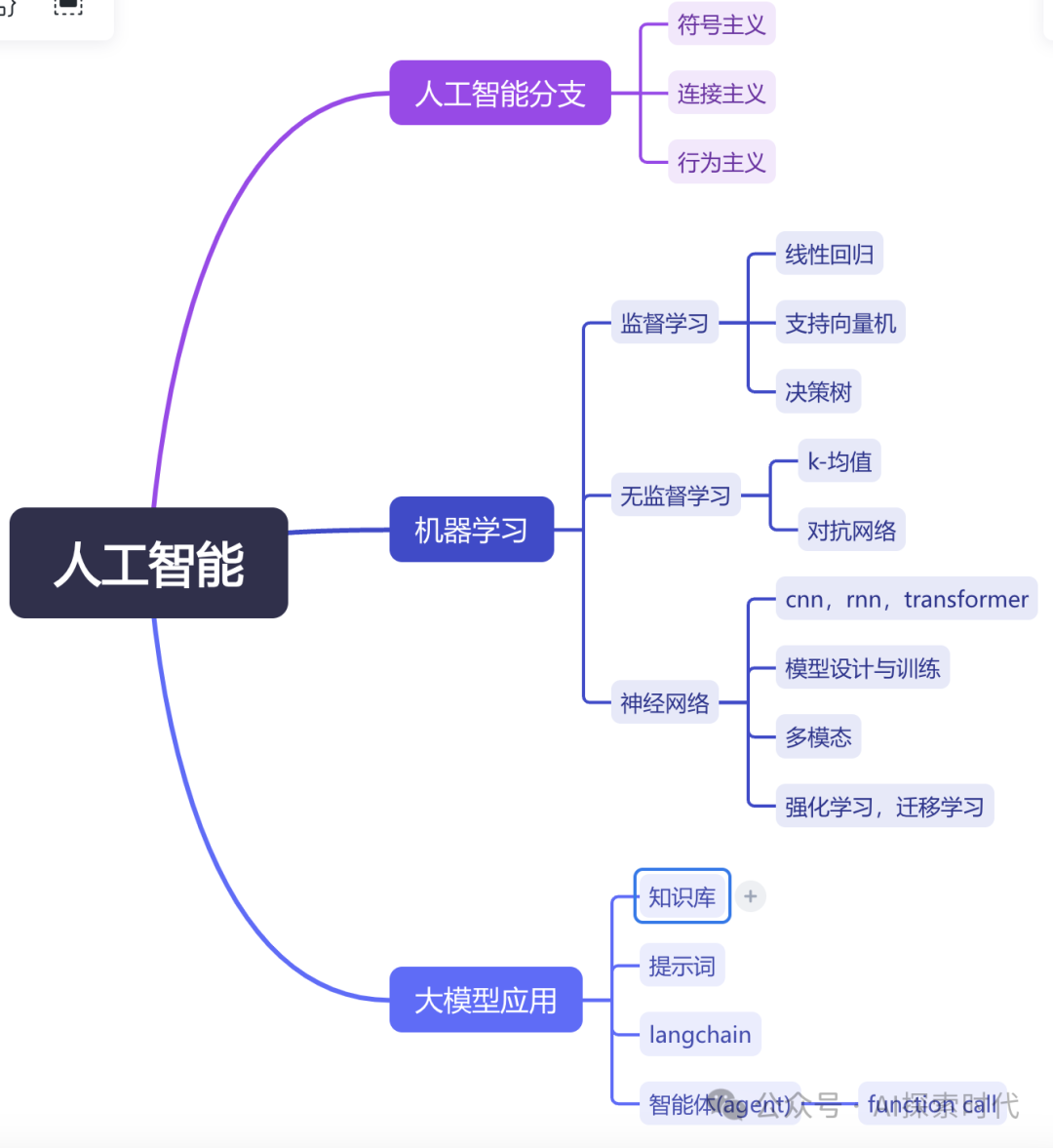

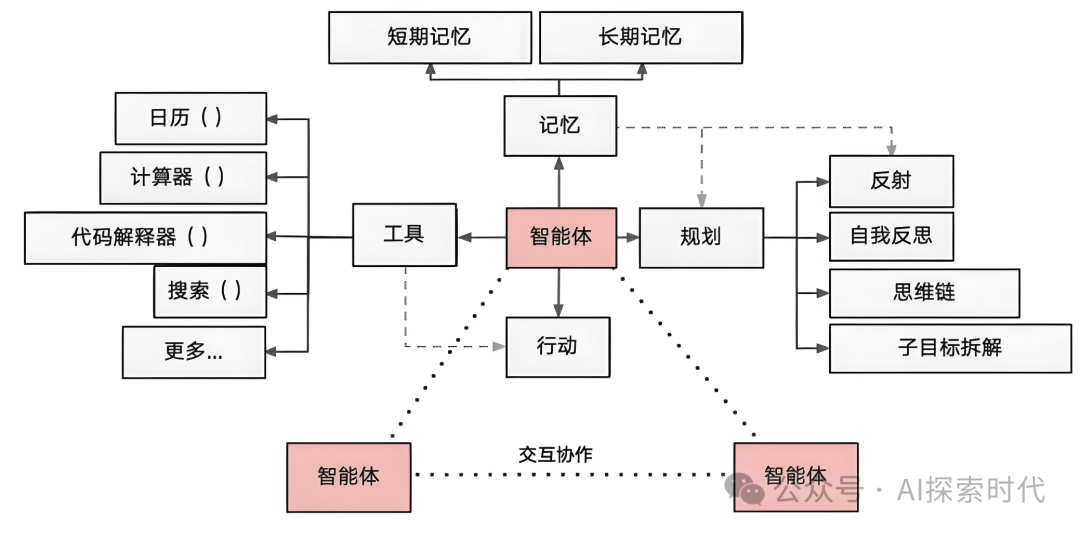

在前面的描述中,神经网络架构讲的是怎么构建一个大模型,知识库是怎么补充和强化大模型,微调和提示词是怎么更好的使用大模型,那么智能体就是真正的使用大模型,研究大模型的具体应用。

如果把大模型比做人类的大脑,那么智能体就是大模型的手和脚。

在此之前使用大模型,我们能够让它回答问题,写文章,生成图片和视频,但这都是大模型天生具备的能力,就类似于人类可以写写画画一样。

但如果让大模型完成更加复杂的任务,这时就需要借助外部工具,比如外出旅行需要设计旅行路线,定酒店和车票等。

这种任务就完全超出大模型或者人类本身的能力圈,如果想完成这些任务就需要借助外部工具,比如说手机APP。

智能体就是大模型+外部工具实现的一种能够独自分析和解决复杂任务的一种载体,利用大模型的独立规划能力,让它根据自己的判断去调用外部工具完成任务。

使用的技术主要有function call,langchain等;如上图所示,大模型使用function call的方式调用外部工具,使用自身能力完成规划和行动,并且由于大模型没有足够的记忆能力,需要增加记忆模块来记录对复杂任务的分析过程。

目前,大模型解决复杂任务,主要通过思维链(CoT)的方式来实现对复杂问题的分解。

langchain是一种人工智能开发框架,它封装了大部分调用大模型的细节,以及其它辅助功能,比如文档的加载,多个大模型的链式调用,提示词模板的封装等,与其类似的还有LlamaIndex等。

_总结_

从大的方向上来说,大模型从技术到应用,主要涉及到以上几个大的模块;而每个模块又涉及到大量的技术和细节。比如打造不同任务的神经网络模型,强化学习,迁移学习,知识蒸馏,分布式训练与存储等;以及RAG使用的向量检索,向量数据库,语义理解等,还有复杂任务的思维链(CoT),模型训练使用的LoRa等微调方法。

还有多模态模型中的知识对齐,数据融合等复杂技术。

因此,大模型技术到应用到学习是一个系统性的复杂过程,中间涉及到无数的技术细节和理论,并且还在不断的产生新的技术和理论。

千里之行,始于足下。

### 题外话

**

黑客&网络安全如何学习

今天只要你给我的文章点赞,我私藏的网安学习资料一样免费共享给你们,来看看有哪些东西。

1.学习路线图

攻击和防守要学的东西也不少,具体要学的东西我都写在了上面的路线图,如果你能学完它们,你去就业和接私活完全没有问题。

2.视频教程

网上虽然也有很多的学习资源,但基本上都残缺不全的,这是我自己录的网安视频教程,上面路线图的每一个知识点,我都有配套的视频讲解。

内容涵盖了网络安全法学习、网络安全运营等保测评、渗透测试基础、漏洞详解、计算机基础知识等,都是网络安全入门必知必会的学习内容。

(都打包成一块的了,不能一一展开,总共300多集)

因篇幅有限,仅展示部分资料,按照下面的方法领取即可

3.技术文档和电子书

技术文档也是我自己整理的,包括我参加大型网安行动、CTF和挖SRC漏洞的经验和技术要点,电子书也有200多本,由于内容的敏感性,我就不一一展示了。

因篇幅有限,仅展示部分资料,按照下面的方法领取即可

4.工具包、面试题和源码

“工欲善其事必先利其器”我为大家总结出了最受欢迎的几十款款黑客工具。涉及范围主要集中在 信息收集、Android黑客工具、自动化工具、网络钓鱼等,感兴趣的同学不容错过。

还有我视频里讲的案例源码和对应的工具包,需要的话也可以拿走。

因篇幅有限,仅展示部分资料,按照下面的方法领取即可

最后就是我这几年整理的网安方面的面试题,如果你是要找网安方面的工作,它们绝对能帮你大忙。

这些题目都是大家在面试深信服、奇安信、腾讯或者其它大厂面试时经常遇到的,如果大家有好的题目或者好的见解欢迎分享。

参考解析:深信服官网、奇安信官网、Freebuf、csdn等

内容特点:条理清晰,含图像化表示更加易懂。

内容概要:包括 内网、操作系统、协议、渗透测试、安服、漏洞、注入、XSS、CSRF、SSRF、文件上传、文件下载、文件包含、XXE、逻辑漏洞、工具、SQLmap、NMAP、BP、MSF…

因篇幅有限,仅展示部分资料,按照下面的方法领取即可

————————————————