目录:

- 1、简介

- 2、代码示例

- 3、验证

- 4、项目示例

- 5、网页数据提取

1、简介

选择Python作为爬虫开发的首选语言,主要是因为Python具有简洁易学的语法、丰富的库支持、跨平台特性、强大的社区支持、动态类型、可扩展性以及异步编程支持等优势。

- 简洁易学的语法:Python的语法非常简洁明了,代码可读性强,这使得编写和维护爬虫代码变得更加容易。对于初学者来说,Python的语法简单,可以让他们更快地上手编程,专注于解决问题而不是语言本身。

- 丰富的库支持:Python拥有丰富的标准库和第三方库,特别是对于网络爬虫来说非常关键的库,如Requests用于发送HTTP请求,BeautifulSoup或lxml用于解析HTML,以及Scrapy框架,这些都是爬取网站数据的有力工具。

- 跨平台特性:Python是跨平台的,可以在Windows、Mac OS和Linux等操作系统上运行,这为开发人员提供了极大的便利性。

- 强大的社区支持:Python有一个庞大的开发者社区和丰富的文档,当你遇到问题时,很容易找到解决方案或者获得帮助。

- 动态类型:Python是动态类型语言,这意味着在编写代码时不需要声明变量的类型,这可以提高开发效率。

- 可扩展性:Python可以轻松地与其他语言(如C++或Java)结合,这允许开发人员在需要高性能时编写关键部分的代码,而其余的代码仍然可以使用Python编写。

- 异步编程支持:Python 3引入了asyncio和Coroutines,这使得处理I/O密集型任务(如网络爬虫)变得更加高效和优雅。

综上所述,Python因其简洁的语法、丰富的库支持、跨平台特性、强大的社区支持、动态类型、可扩展性以及异步编程支持等优势,成为网络爬虫开发的首选语言之一。

2、代码示例

准备工作:

需要安装requests和beautifulsoup4库。

pip install requests

pip install beautifulsoup4

import requests

from bs4 import BeautifulSoup

# 发送HTTP请求获取百度首页的HTML内�??

url = 'https://www.baidu.com/'

response = requests.get(url)

# 检查�?�求�?否成�?

if response.status_code == 200:

# 使用BeautifulSoup解析HTML内�??

soup = BeautifulSoup(response.text, 'html.parser')

# 打印整个页面的HTML

print(soup.prettify())

else:

print('Failed to retrieve the webpage')

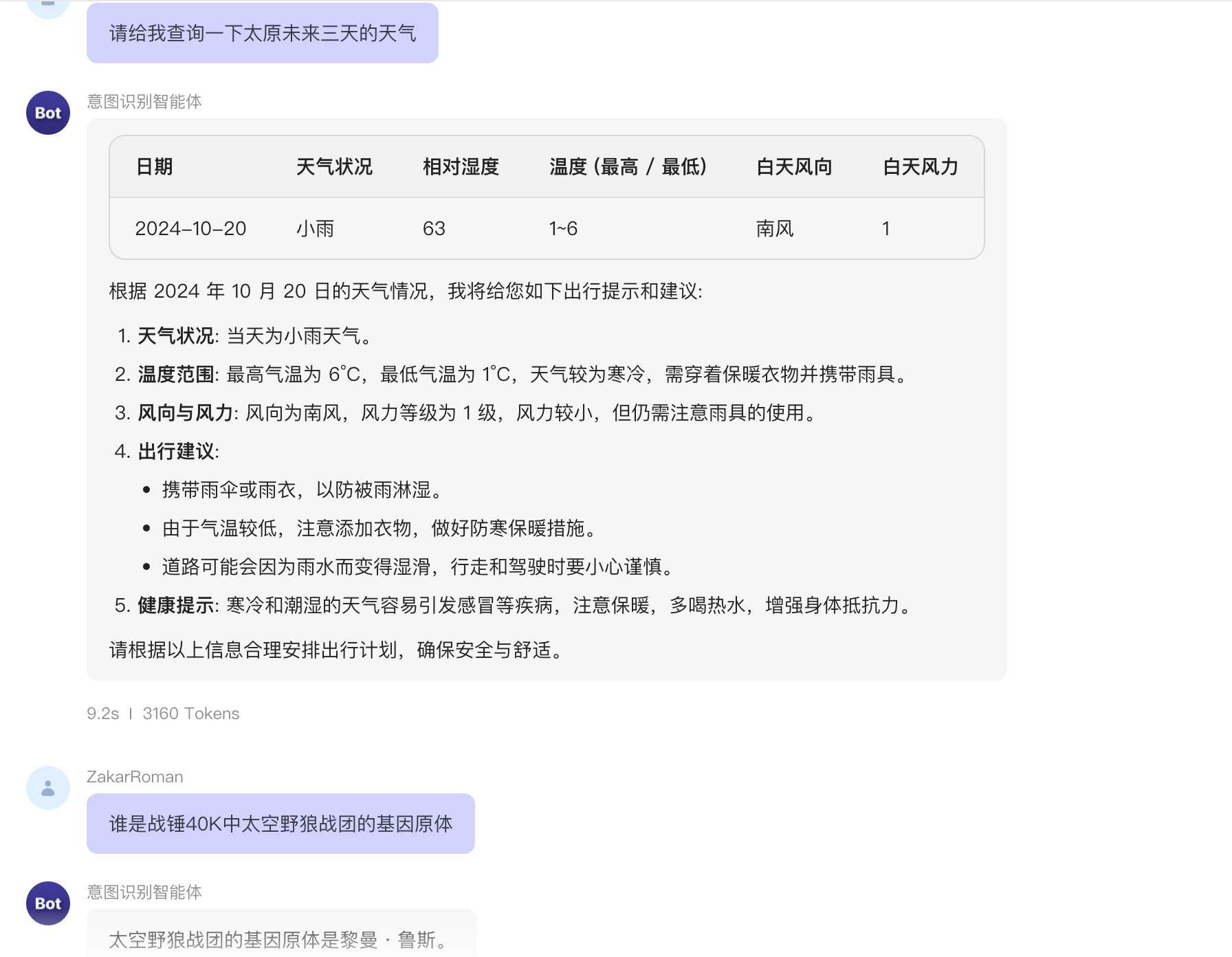

成功抓取到网页数据:

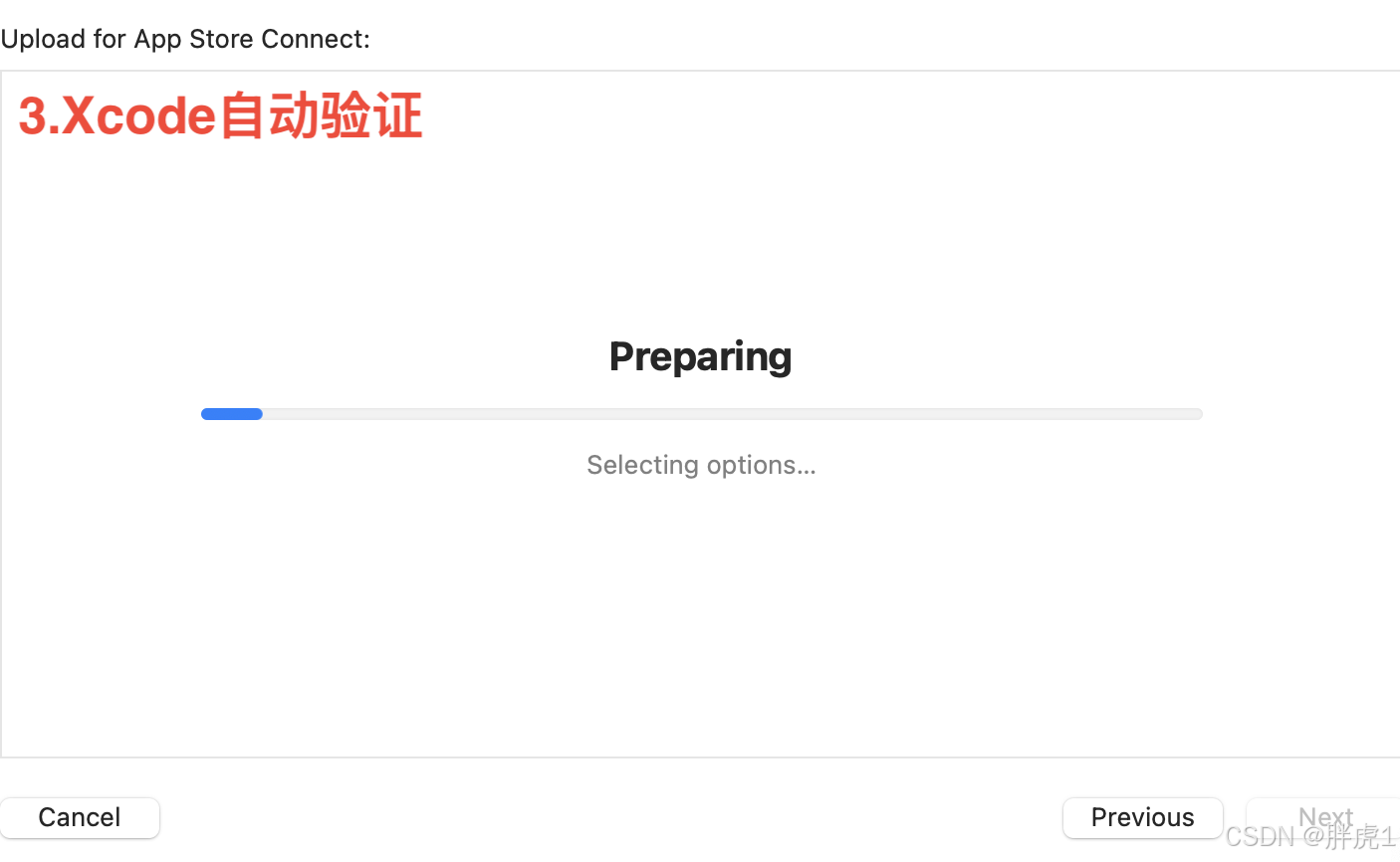

3、验证

成功拿到网页的内容了,拿到网页的内容后就可以根据自己的需求去解析这个html内容来获取数据。

4、项目示例

拿到html的数据后,可以根据数据结构解析并提取你所需要的数据。

5、网页数据提取

from bs4 import BeautifulSoup

# 示例HTML数据

html_doc = """

<html><head><title>The Dormouse's story</title></head>

<body>

<p class="title"><b>The Dormouse's story</b></p>

<div class="story">Once upon a time there were three little sisters; and their names were

<a href="http://example.com/elsie" class="sister" id="link1">Elsie</a>,

<a href="http://example.com/lacie" class="sister" id="link2">Lacie</a> and

<a href="http://example.com/tillie" class="sister" id="link3">Tillie</a>;

and they lived at the bottom of a well.</div>

<p class="story">...</p>

"""

# 使用BeautifulSoup解析HTML

soup = BeautifulSoup(html_doc, 'html.parser')

# 获取标题

title = soup.title.string

print(title) # 输出:The Dormouse's story

# 查找所有<a>标签的链接

for link in soup.find_all('a'):

print(link.get('href')) # 输出各<a>标签的href属性值