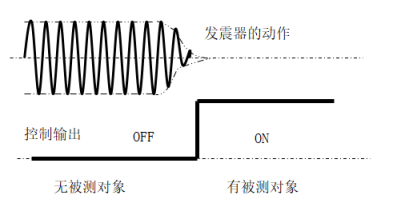

GPT和BERT都是基于Trm的应用,可以理解为GPT是decoder的应用,BERT可以说是encoder的应用

GPT

如图,就是GPT的原理,GPT是做生成式的任务的,没有办法进行下游任务改造,训练也是针对生成式的任务进行训练

BERT

左图是BERT,BERT和ELMo非常相似,只不过由于中间换成Trm之后,可以并行,也就是可以同时看到一个词的上下文,而ELMo仅仅只是对上下文分别计算,最后进行叠加。

BERT下游任务改造

- 句子相似度

如图,输入bert的时候句子除了句子本身还有分隔符[cls]和[sep],对于这个下游任务,可以把cls变成sentence1和sentence2的相似度 - 单句分类

和句子相似度类似,把cls改成标签概率的分布 - 文本问答

文本问答的输入是前面是问题,后面是答案,这里要对结果进行改造,加入一个起始位置和最终位置,通过bert求出初始位置和最终位置的最大概率。 - 文本标注

文本标注是指给一句话的各个实体标注上不同的标签,比如名词,动词,人物等。要对输入和输出进行改造,每个词对应了一个label讲label转化为数字,求出对每个词最大的label概率