一、本文介绍

本文记录的是基于EMA模块的YOLOv10目标检测改进方法研究。EMA认为跨维度交互有助于通道或空间注意力预测,并且解决了现有注意力机制在提取深度视觉表示时可能带来的维度缩减问题。在改进YOLOv10的过程中能够为高级特征图产生更好的像素级注意力,能够建模长程依赖并嵌入精确的位置信息。

文章目录

- 一、本文介绍

- 二、EMA原理

- 2.1 EMA原理

- 2.1.1 Coordinate Attention(CA)

- 2.1.2 Multi - Scale Attention(EMA)模块

- 2.2 特点

- 三、EMA的实现代码

- 四、创新模块

- 4.1 改进点1

- 4.2 改进点2⭐

- 五、添加步骤

- 5.1 修改ultralytics/nn/modules/block.py

- 5.2 修改ultralytics/nn/modules/__init__.py

- 5.3 修改ultralytics/nn/modules/tasks.py

- 六、yaml模型文件

- 6.1 模型改进版本一

- 6.2 模型改进版本二⭐

- 六、成功运行结果

二、EMA原理

Efficient Multi-Scale Attention Module with Cross-Spatial Learning

EMA(Efficient Multi - Scale Attention)注意力模块的设计的原理和优势如下:

2.1 EMA原理

2.1.1 Coordinate Attention(CA)

CA通过全局平均池化操作建模跨通道信息,将原始输入张量分解为两个并行的1D特征编码向量,嵌入空间位置信息到通道注意力图中,以增强特征聚合。但CA忽略了整个空间位置间交互的重要性,且1x1卷积核的有限感受野不利于建模局部跨通道交互和利用上下文信息。

2.1.2 Multi - Scale Attention(EMA)模块

- 特征分组:对于输入特征图

X

∈

R

C

×

H

×

W

X \in \mathbb{R}^{C \times H \times W}

X∈RC×H×W,

EMA将其在通道维度方向上划分为 G G G个子特征 X = [ X 0 , X 1 , … , X G − 1 ] X = [X_{0}, X_{1}, \ldots, X_{G - 1}] X=[X0,X1,…,XG−1], X i ∈ R C / G × H × W X_{i} \in \mathbb{R}^{C / G \times H \times W} Xi∈RC/G×H×W,假设学习到的注意力权重描述符将用于增强每个子特征中感兴趣区域的特征表示。 - 并行子网络:

EMA采用三个并行路线来提取分组特征图的注意力权重描述符,其中两个在1x1分支,第三个在3x3分支。在1x1分支中,通过两个1D全局平均池化操作分别沿两个空间方向编码通道信息,并将G组重塑和置换到批处理维度,使两个编码特征共享无维度缩减的1x1卷积。在3x3分支中,通过一个3x3卷积捕获多尺度特征表示。这样,EMA不仅编码了通道间信息来调整不同通道的重要性,还将精确的空间结构信息保留到通道中。 - 跨空间学习:引入两个张量,分别是1x1分支和3x3分支的输出。利用2D全局平均池化在1x1分支的输出中编码全局空间信息,并在通道特征的联合激活机制前将另一个分支的输出转换为对应维度形状。通过矩阵点积操作得到第一个空间注意力图,再类似地得到第二个空间注意力图。最后,每个组内的输出特征图通过两个生成的空间注意力权重值的聚合计算得到,捕获像素级成对关系并突出所有像素的全局上下文。

2.2 特点

- 建立多尺度并行子网络:采用并行子结构,避免了更多的顺序处理和大深度,有利于有效建立短程和长程依赖,以获得更好的性能。

- 避免维度缩减:仅选取

CA模块中1x1卷积的共享组件,避免了在卷积操作中进行通道维度缩减,从而更有效地学习有效的通道描述。 - 融合跨空间信息:通过跨空间学习方法,融合了不同尺度的上下文信息,使CNN能够为高级特征图产生更好的像素级注意力,能够建模长程依赖并嵌入精确的位置信息。

- 高效且有效:与其他注意力方法(如CBAM、NAM、SA、ECA和CA)相比,

EMA不仅在性能上取得了更好的结果,而且在所需参数方面更高效。在多个数据集(如CIFAR - 100、ImageNet - 1k、COCO和VisDrone2019)上的实验表明,EMA在图像分类和对象检测任务中都具有优势,模型复杂度相对较小,且在不同的基准模型(如ResNet50/101和MobileNetV2)上集成时均能有效提升性能。

论文:https://doi.org/10.1016/j.neunet.2024.106314

源码:https://github.com/Lose-Code/UBRFC-Net

三、EMA的实现代码

EMA模块的实现代码如下:

import torch

from torch import nn

class EMA(nn.Module):

def __init__(self, channels, c2=None, factor=32):

super(EMA, self).__init__()

self.groups = factor

assert channels // self.groups > 0

self.softmax = nn.Softmax(-1)

self.agp = nn.AdaptiveAvgPool2d((1, 1))

self.pool_h = nn.AdaptiveAvgPool2d((None, 1))

self.pool_w = nn.AdaptiveAvgPool2d((1, None))

self.gn = nn.GroupNorm(channels // self.groups, channels // self.groups)

self.conv1x1 = nn.Conv2d(channels // self.groups, channels // self.groups, kernel_size=1, stride=1, padding=0)

self.conv3x3 = nn.Conv2d(channels // self.groups, channels // self.groups, kernel_size=3, stride=1, padding=1)

def forward(self, x):

b, c, h, w = x.size()

group_x = x.reshape(b * self.groups, -1, h, w) # b*g,c//g,h,w

x_h = self.pool_h(group_x)

x_w = self.pool_w(group_x).permute(0, 1, 3, 2)

hw = self.conv1x1(torch.cat([x_h, x_w], dim=2))

x_h, x_w = torch.split(hw, [h, w], dim=2)

x1 = self.gn(group_x * x_h.sigmoid() * x_w.permute(0, 1, 3, 2).sigmoid())

x2 = self.conv3x3(group_x)

x11 = self.softmax(self.agp(x1).reshape(b * self.groups, -1, 1).permute(0, 2, 1))

x12 = x2.reshape(b * self.groups, c // self.groups, -1) # b*g, c//g, hw

x21 = self.softmax(self.agp(x2).reshape(b * self.groups, -1, 1).permute(0, 2, 1))

x22 = x1.reshape(b * self.groups, c // self.groups, -1) # b*g, c//g, hw

weights = (torch.matmul(x11, x12) + torch.matmul(x21, x22)).reshape(b * self.groups, 1, h, w)

return (group_x * weights.sigmoid()).reshape(b, c, h, w)

四、创新模块

4.1 改进点1

模块改进方法1️⃣:直接加入EMA模块。

EMA模块添加后如下:

注意❗:在5.2和5.3小节中需要声明的模块名称为:EMA。

4.2 改进点2⭐

模块改进方法2️⃣:基于EMA模块的C2f。

📌 第二种改进方法是对YOLOv10中的C2f模块进行改进,在C2f提取特征后,利用EMA注意力模块跨空间学习方法,融合了不同尺度的上下文信息,使模型能够为高级特征图产生更好的像素级注意力,并在局部聚合的过程中加入短程和长程依赖,来嵌入精确的位置信息以获得更好的性能。

改进代码如下:

class C2f_EMA(nn.Module):

"""Faster Implementation of CSP Bottleneck with 2 convolutions."""

def __init__(self, c1, c2, n=1, shortcut=False, g=1, e=0.5):

"""Initialize CSP bottleneck layer with two convolutions with arguments ch_in, ch_out, number, shortcut, groups,

expansion.

"""

super().__init__()

self.c = int(c2 * e) # hidden channels

self.cv1 = Conv(c1, 2 * self.c, 1, 1)

self.cv2 = Conv((2 + n) * self.c, c2, 1) # optional act=FReLU(c2)

self.m = nn.ModuleList(Bottleneck(self.c, self.c, shortcut, g, k=((3, 3), (3, 3)), e=1.0) for _ in range(n))

self.att = EMA(c2)

def forward(self, x):

"""Forward pass through C2f layer."""

y = list(self.cv1(x).chunk(2, 1))

y.extend(m(y[-1]) for m in self.m)

return self.att(self.cv2(torch.cat(y, 1)))

def forward_split(self, x):

"""Forward pass using split() instead of chunk()."""

y = list(self.cv1(x).split((self.c, self.c), 1))

y.extend(m(y[-1]) for m in self.m)

return self.att(self.cv2(torch.cat(y, 1)))

注意❗:在5.2和5.3小节中需要声明的模块名称为:C2f_EMA。

五、添加步骤

5.1 修改ultralytics/nn/modules/block.py

此处需要修改的文件是ultralytics/nn/modules/block.py

block.py中定义了网络结构的通用模块,我们想要加入新的模块就只需要将模块代码放到这个文件内即可。

将EMA和C2f_EMA模块代码添加到此文件下。

5.2 修改ultralytics/nn/modules/init.py

此处需要修改的文件是ultralytics/nn/modules/__init__.py

__init__.py文件中定义了所有模块的初始化,我们只需要将block.py中的新的模块命添加到对应的函数即可。

EMA和C2f_EMA在block.py中实现,所有要添加在from .block import:

from .block import (

C1,

C2,

...

EMA,

C2f_EMA

)

5.3 修改ultralytics/nn/modules/tasks.py

在tasks.py文件中,需要在两处位置添加各模块类名称。

首先:在函数声明中引入EMA和C2f_EMA

其次:在parse_model函数中注册EMA和C2f_EMA模块

六、yaml模型文件

6.1 模型改进版本一

在代码配置完成后,配置模型的YAML文件。

此处以ultralytics/cfg/models/v10/yolov10m.yaml为例,在同目录下创建一个用于自己数据集训练的模型文件yolov10m-EMA.yaml。

将yolov10m.yaml中的内容复制到yolov10m-EMA.yaml文件下,修改nc数量等于自己数据中目标的数量。

在骨干网络的最后一层添加EMA模块,只需要填入一个参数,通道数。

# Ultralytics YOLO 🚀, AGPL-3.0 license

# YOLOv8 object detection model with P3-P5 outputs. For Usage examples see https://docs.ultralytics.com/tasks/detect

# Parameters

nc: 1 # number of classes

scales: # model compound scaling constants, i.e. 'model=yolov8n.yaml' will call yolov8.yaml with scale 'n'

# [depth, width, max_channels]

m: [0.67, 0.75, 768] # YOLOv8m summary: 295 layers, 25902640 parameters, 25902624 gradients, 79.3 GFLOPs

# YOLOv8.0n backbone

backbone:

# [from, repeats, module, args]

- [-1, 1, Conv, [64, 3, 2]] # 0-P1/2

- [-1, 1, Conv, [128, 3, 2]] # 1-P2/4

- [-1, 3, C2f, [128, True]]

- [-1, 1, Conv, [256, 3, 2]] # 3-P3/8

- [-1, 6, C2f, [256, True]]

- [-1, 1, SCDown, [512, 3, 2]] # 5-P4/16

- [-1, 6, C2f, [512, True]]

- [-1, 1, SCDown, [1024, 3, 2]] # 7-P5/32

- [-1, 3, C2fCIB, [1024, True]]

- [-1, 1, EMA, [1024]]

- [-1, 1, SPPF, [1024, 5]] # 10

- [-1, 1, PSA, [1024]] # 11

# YOLOv8.0n head

head:

- [-1, 1, nn.Upsample, [None, 2, "nearest"]]

- [[-1, 6], 1, Concat, [1]] # cat backbone P4

- [-1, 3, C2f, [512]] # 14

- [-1, 1, nn.Upsample, [None, 2, "nearest"]]

- [[-1, 4], 1, Concat, [1]] # cat backbone P3

- [-1, 3, C2f, [256]] # 17 (P3/8-small)

- [-1, 1, Conv, [256, 3, 2]]

- [[-1, 14], 1, Concat, [1]] # cat head P4

- [-1, 3, C2fCIB, [512, True]] # 20 (P4/16-medium)

- [-1, 1, SCDown, [512, 3, 2]]

- [[-1, 11], 1, Concat, [1]] # cat head P5

- [-1, 3, C2fCIB, [1024, True]] # 23 (P5/32-large)

- [[17, 20, 23], 1, v10Detect, [nc]] # Detect(P3, P4, P5)

6.2 模型改进版本二⭐

此处同样以ultralytics/cfg/models/v10/yolov10m.yaml为例,在同目录下创建一个用于自己数据集训练的模型文件yolov10m-C2f_EMA.yaml。

将yolov10m.yaml中的内容复制到yolov10m-C2f_EMA.yaml文件下,修改nc数量等于自己数据中目标的数量。

📌 模型的修改方法是将骨干网络中的所有C2f模块替换成C2f_EMA模块。

# Ultralytics YOLO 🚀, AGPL-3.0 license

# YOLOv8 object detection model with P3-P5 outputs. For Usage examples see https://docs.ultralytics.com/tasks/detect

# Parameters

nc: 1 # number of classes

scales: # model compound scaling constants, i.e. 'model=yolov8n.yaml' will call yolov8.yaml with scale 'n'

# [depth, width, max_channels]

m: [0.67, 0.75, 768] # YOLOv8m summary: 295 layers, 25902640 parameters, 25902624 gradients, 79.3 GFLOPs

# YOLOv8.0n backbone

backbone:

# [from, repeats, module, args]

- [-1, 1, Conv, [64, 3, 2]] # 0-P1/2

- [-1, 1, Conv, [128, 3, 2]] # 1-P2/4

- [-1, 3, C2f_EMA, [128, True]]

- [-1, 1, Conv, [256, 3, 2]] # 3-P3/8

- [-1, 6, C2f_EMA, [256, True]]

- [-1, 1, SCDown, [512, 3, 2]] # 5-P4/16

- [-1, 6, C2f_EMA, [512, True]]

- [-1, 1, SCDown, [1024, 3, 2]] # 7-P5/32

- [-1, 3, C2fCIB, [1024, True]]

- [-1, 1, SPPF, [1024, 5]] # 9

- [-1, 1, PSA, [1024]] # 10

# YOLOv8.0n head

head:

- [-1, 1, nn.Upsample, [None, 2, "nearest"]]

- [[-1, 6], 1, Concat, [1]] # cat backbone P4

- [-1, 3, C2f, [512]] # 13

- [-1, 1, nn.Upsample, [None, 2, "nearest"]]

- [[-1, 4], 1, Concat, [1]] # cat backbone P3

- [-1, 3, C2f, [256]] # 16 (P3/8-small)

- [-1, 1, Conv, [256, 3, 2]]

- [[-1, 13], 1, Concat, [1]] # cat head P4

- [-1, 3, C2fCIB, [512, True]] # 19 (P4/16-medium)

- [-1, 1, SCDown, [512, 3, 2]]

- [[-1, 10], 1, Concat, [1]] # cat head P5

- [-1, 3, C2fCIB, [1024, True]] # 22 (P5/32-large)

- [[16, 19, 22], 1, v10Detect, [nc]] # Detect(P3, P4, P5)

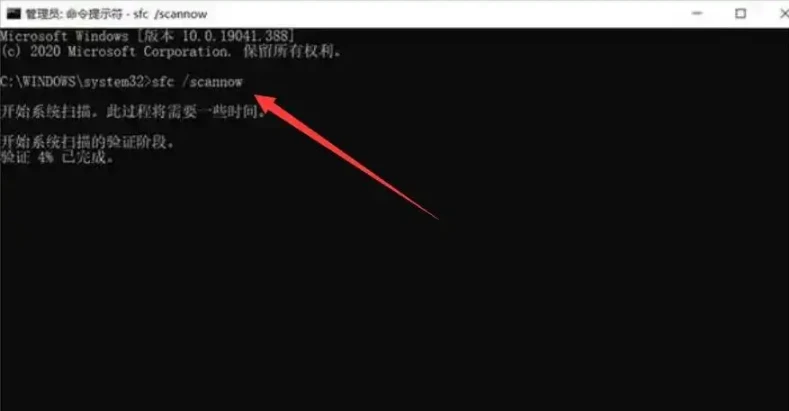

六、成功运行结果

分别打印网络模型可以看到EMA模块和C2f_EMA已经加入到模型中,并可以进行训练了。

YOLOv10m-EMA:

from n params module arguments

0 -1 1 1392 ultralytics.nn.modules.conv.Conv [3, 48, 3, 2]

1 -1 1 41664 ultralytics.nn.modules.conv.Conv [48, 96, 3, 2]

2 -1 2 111360 ultralytics.nn.modules.block.C2f [96, 96, 2, True]

3 -1 1 166272 ultralytics.nn.modules.conv.Conv [96, 192, 3, 2]

4 -1 4 813312 ultralytics.nn.modules.block.C2f [192, 192, 4, True]

5 -1 1 78720 ultralytics.nn.modules.block.SCDown [192, 384, 3, 2]

6 -1 4 3248640 ultralytics.nn.modules.block.C2f [384, 384, 4, True]

7 -1 1 228672 ultralytics.nn.modules.block.SCDown [384, 576, 3, 2]

8 -1 2 1689984 ultralytics.nn.modules.block.C2fCIB [576, 576, 2, True]

9 -1 1 3312 ultralytics.nn.modules.block.EMA [576, 576]

10 -1 1 831168 ultralytics.nn.modules.block.SPPF [576, 576, 5]

11 -1 1 1253088 ultralytics.nn.modules.block.PSA [576, 576]

12 -1 1 0 torch.nn.modules.upsampling.Upsample [None, 2, 'nearest']

13 [-1, 6] 1 0 ultralytics.nn.modules.conv.Concat [1]

14 -1 2 1993728 ultralytics.nn.modules.block.C2f [960, 384, 2]

15 -1 1 0 torch.nn.modules.upsampling.Upsample [None, 2, 'nearest']

16 [-1, 4] 1 0 ultralytics.nn.modules.conv.Concat [1]

17 -1 2 517632 ultralytics.nn.modules.block.C2f [576, 192, 2]

18 -1 1 332160 ultralytics.nn.modules.conv.Conv [192, 192, 3, 2]

19 [-1, 14] 1 0 ultralytics.nn.modules.conv.Concat [1]

20 -1 2 831744 ultralytics.nn.modules.block.C2fCIB [576, 384, 2, True]

21 -1 1 152448 ultralytics.nn.modules.block.SCDown [384, 384, 3, 2]

22 [-1, 11] 1 0 ultralytics.nn.modules.conv.Concat [1]

23 -1 2 1911168 ultralytics.nn.modules.block.C2fCIB [960, 576, 2, True]

24 [17, 20, 23] 1 2282134 ultralytics.nn.modules.head.v10Detect [1, [192, 384, 576]]

YOLOv10m-EMA summary: 506 layers, 16488598 parameters, 16488582 gradients, 64.0 GFLOPs

YOLOv10m-C2f_EMA:

from n params module arguments

0 -1 1 1392 ultralytics.nn.modules.conv.Conv [3, 48, 3, 2]

1 -1 1 41664 ultralytics.nn.modules.conv.Conv [48, 96, 3, 2]

2 -1 2 130380 ultralytics.nn.modules.block.C2f_EMA [96, 96, True]

3 -1 1 166272 ultralytics.nn.modules.conv.Conv [96, 192, 3, 2]

4 -1 4 1038336 ultralytics.nn.modules.block.C2f_EMA [192, 192, True]

5 -1 1 78720 ultralytics.nn.modules.block.SCDown [192, 384, 3, 2]

6 -1 4 4143936 ultralytics.nn.modules.block.C2f_EMA [384, 384, True]

7 -1 1 228672 ultralytics.nn.modules.block.SCDown [384, 576, 3, 2]

8 -1 2 1689984 ultralytics.nn.modules.block.C2fCIB [576, 576, 2, True]

9 -1 1 831168 ultralytics.nn.modules.block.SPPF [576, 576, 5]

10 -1 1 1253088 ultralytics.nn.modules.block.PSA [576, 576]

11 -1 1 0 torch.nn.modules.upsampling.Upsample [None, 2, 'nearest']

12 [-1, 6] 1 0 ultralytics.nn.modules.conv.Concat [1]

13 -1 2 1993728 ultralytics.nn.modules.block.C2f [960, 384, 2]

14 -1 1 0 torch.nn.modules.upsampling.Upsample [None, 2, 'nearest']

15 [-1, 4] 1 0 ultralytics.nn.modules.conv.Concat [1]

16 -1 2 517632 ultralytics.nn.modules.block.C2f [576, 192, 2]

17 -1 1 332160 ultralytics.nn.modules.conv.Conv [192, 192, 3, 2]

18 [-1, 13] 1 0 ultralytics.nn.modules.conv.Concat [1]

19 -1 2 831744 ultralytics.nn.modules.block.C2fCIB [576, 384, 2, True]

20 -1 1 152448 ultralytics.nn.modules.block.SCDown [384, 384, 3, 2]

21 [-1, 10] 1 0 ultralytics.nn.modules.conv.Concat [1]

22 -1 2 1911168 ultralytics.nn.modules.block.C2fCIB [960, 576, 2, True]

23 [16, 19, 22] 1 2282134 ultralytics.nn.modules.head.v10Detect [1, [192, 384, 576]]

YOLOv10m-C2f_EMA summary: 637 layers, 17624626 parameters, 17624610 gradients, 72.1 GFLOPs