一、本文介绍

本文记录的是基于NAM模块的YOLOv10目标检测改进方法研究。 许多先前的研究专注于通过注意力操作捕获显著特征,但缺乏对权重贡献因素的考虑,而这些因素能够进一步抑制不重要的通道或像素。而本文利用NAM改进YOLOv10,通过权重的贡献因素来改进注意力机制,提高模型精度。

文章目录

- 一、本文介绍

- 二、NAM介绍

- 2.1 NAM设计原理

- 2.2 优势

- 三、NAM的实现代码

- 四、创新模块

- 4.1 改进点1

- 4.2 改进点2⭐

- 五、添加步骤

- 5.1 修改ultralytics/nn/modules/block.py

- 5.2 修改ultralytics/nn/modules/__init__.py

- 5.3 修改ultralytics/nn/modules/tasks.py

- 六、yaml模型文件

- 6.1 模型改进版本一

- 6.2 模型改进版本二⭐

- 七、成功运行结果

二、NAM介绍

NAM: Normalization-based Attention Module

NAM(Normalization - based Attention Module)注意力模块的设计的原理和优势如下:

2.1 NAM设计原理

NAM采用了来自CBAM(Convolutional Block Attention Module)的模块集成方式,并重新设计了通道和空间注意力子模块。- 在通道注意力子模块中,使用了批归一化(Batch Normalization,BN)的缩放因子来衡量通道的方差,并表示其重要性。具体公式为: B o u t = B N ( B i n ) = γ B i n − μ B σ B 2 + ϵ + β B_{out } = BN(B_{in}) = \gamma \frac{B_{in} - \mu_{\mathcal{B}}}{\sqrt{\sigma_{\mathcal{B}}^{2} + \epsilon}} + \beta Bout=BN(Bin)=γσB2+ϵBin−μB+β,其中 μ B \mu_{B} μB和 σ B \sigma_{B} σB分别是小批量 B B B的均值和标准差; γ \gamma γ和 β \beta β是可训练的仿射变换参数(缩放和平移)。通道注意力子模块的输出特征 M c M_{c} Mc表示为: M c = s i g m o i d ( W γ ( B N ( F 1 ) ) ) M_{c} = sigmoid(W_{\gamma}(BN(F_{1}))) Mc=sigmoid(Wγ(BN(F1))),其中 γ \gamma γ是每个通道的缩放因子,权重 W γ W_{\gamma} Wγ通过 W γ = γ i / ∑ j = 0 γ j W_{\gamma} = \gamma_{i} / \sum_{j = 0} \gamma_{j} Wγ=γi/∑j=0γj获得。

- 在空间维度上也应用了BN的缩放因子来测量像素的重要性,称为像素归一化。相应的空间注意力子模块的输出 M s M_{s} Ms表示为: M s = s i g m o i d ( W λ ( B N s ( F 2 ) ) ) M_{s} = sigmoid(W_{\lambda}(BN_{s}(F_{2}))) Ms=sigmoid(Wλ(BNs(F2))),其中 X X X是缩放因子,权重 W λ W_{\lambda} Wλ通过 W λ = λ i / ∑ j = 0 λ j W_{\lambda} = \lambda_{i} / \sum_{j = 0} \lambda_{j} Wλ=λi/∑j=0λj获得。

- 为了抑制不太显著的权重,在损失函数中添加了一个正则化项,具体公式为: L o s s = ∑ ( x , y ) l ( f ( x , W ) , y ) + p ∑ g ( γ ) + p ∑ g ( λ ) Loss = \sum_{(x, y)} l(f(x, W), y) + p \sum g(\gamma) + p \sum g(\lambda) Loss=∑(x,y)l(f(x,W),y)+p∑g(γ)+p∑g(λ),其中 x x x表示输入, y y y是输出, W W W代表网络权重, l ( ⋅ ) l(\cdot) l(⋅)是损失函数, g ( − ) g(-) g(−)是 l 1 l_{1} l1范数惩罚函数, p p p是平衡 g ( γ ) g(\gamma) g(γ)和 g ( λ ) g(\lambda) g(λ)的惩罚项。

2.2 优势

- 通过抑制不太显著的特征,

NAM更高效。 - 与其他三种注意力机制(SE、BAM、CBAM)在ResNet和MobileNet上的比较表明,

NAM在单独使用通道或空间注意力时,性能优于其他四种注意力机制;在结合通道和空间注意力时,在具有相似计算复杂度的情况下,性能也更优。 - 与CBAM相比,

NAM在通道注意力模块中显著减少了参数数量,在空间注意力模块中参数增加不显著,总体上参数更少。

论文:https://arxiv.org/pdf/2111.12419

源码:https://github.com/Christian-lyc/NAM

三、NAM的实现代码

NAM模块的实现代码如下:

class Channel_Att(nn.Module):

def __init__(self, channels, t=16):

super(Channel_Att, self).__init__()

self.channels = channels

self.bn2 = nn.BatchNorm2d(self.channels, affine=True)

def forward(self, x):

residual = x

x = self.bn2(x)

weight_bn = self.bn2.weight.data.abs() / torch.sum(self.bn2.weight.data.abs())

x = x.permute(0, 2, 3, 1).contiguous()

x = torch.mul(weight_bn, x)

x = x.permute(0, 3, 1, 2).contiguous()

x = torch.sigmoid(x) * residual #

return x

class NAM(nn.Module):

def __init__(self, channels, out_channels=None, no_spatial=True):

super(NAM, self).__init__()

self.Channel_Att = Channel_Att(channels)

def forward(self, x):

x_out1=self.Channel_Att(x)

return x_out1

四、创新模块

4.1 改进点1

模块改进方法1️⃣:直接加入NAM模块。

NAM模块添加后如下:

注意❗:在5.2和5.3小节中需要声明的模块名称为:NAM。

4.2 改进点2⭐

模块改进方法2️⃣:基于NAM模块的C2f。

📌 第二种改进方法是对YOLOv10中的C2f模块进行改进,在C2f提取特征后,利用NAM重新设计通道和空间注意力子模块,从而抑制不太显著的特征,并且在与C2f结合后,对于细节特征的提取更加敏感,提高模型性能。

改进代码如下:

class C2f_NAM(nn.Module):

"""Faster Implementation of CSP Bottleneck with 2 convolutions."""

def __init__(self, c1, c2, n=1, shortcut=False, g=1, e=0.5):

"""Initialize CSP bottleneck layer with two convolutions with arguments ch_in, ch_out, number, shortcut, groups,

expansion.

"""

super().__init__()

self.c = int(c2 * e) # hidden channels

self.cv1 = Conv(c1, 2 * self.c, 1, 1)

self.cv2 = Conv((2 + n) * self.c, c2, 1) # optional act=FReLU(c2)

self.m = nn.ModuleList(Bottleneck(self.c, self.c, shortcut, g, k=((3, 3), (3, 3)), e=1.0) for _ in range(n))

self.att = NAM(c2)

def forward(self, x):

"""Forward pass through C2f layer."""

y = list(self.cv1(x).chunk(2, 1))

y.extend(m(y[-1]) for m in self.m)

return self.att(self.cv2(torch.cat(y, 1)))

def forward_split(self, x):

"""Forward pass using split() instead of chunk()."""

y = list(self.cv1(x).split((self.c, self.c), 1))

y.extend(m(y[-1]) for m in self.m)

return self.att(self.cv2(torch.cat(y, 1)))

注意❗:在5.2和5.3小节中需要声明的模块名称为:C2f_NAM。

五、添加步骤

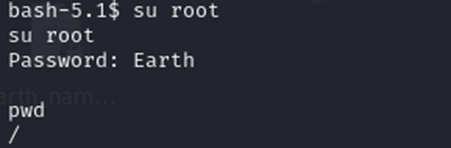

5.1 修改ultralytics/nn/modules/block.py

此处需要修改的文件是ultralytics/nn/modules/block.py

block.py中定义了网络结构的通用模块,我们想要加入新的模块就只需要将模块代码放到这个文件内即可。

将NAM和C2f_NAM模块代码添加到此文件下。

5.2 修改ultralytics/nn/modules/init.py

此处需要修改的文件是ultralytics/nn/modules/__init__.py

__init__.py文件中定义了所有模块的初始化,我们只需要将block.py中的新的模块命添加到对应的函数即可。

NAM和C2f_NAM在block.py中实现,所有要添加在from .block import:

from .block import (

C1,

C2,

...

NAM,

C2f_NAM

)

5.3 修改ultralytics/nn/modules/tasks.py

在tasks.py文件中,需要在两处位置添加各模块类名称。

首先:在函数声明中引入NAM和C2f_NAM

其次:在parse_model函数中注册NAM和C2f_NAM模块

六、yaml模型文件

6.1 模型改进版本一

在代码配置完成后,配置模型的YAML文件。

此处以ultralytics/cfg/models/v10/yolov10m.yaml为例,在同目录下创建一个用于自己数据集训练的模型文件yolov10m-NAM.yaml。

将yolov10m.yaml中的内容复制到yolov10m-NAM.yaml文件下,修改nc数量等于自己数据中目标的数量。

在骨干网络的最后一层添加NAM模块,只需要填入一个参数,通道数,和前一层通道数一致。还需要注意的是,由于PAN+FPN的颈部模型结构存在,层之间的匹配也要记得修改,维度要匹配上。

# Ultralytics YOLO 🚀, AGPL-3.0 license

# YOLOv8 object detection model with P3-P5 outputs. For Usage examples see https://docs.ultralytics.com/tasks/detect

# Parameters

nc: 1 # number of classes

scales: # model compound scaling constants, i.e. 'model=yolov8n.yaml' will call yolov8.yaml with scale 'n'

# [depth, width, max_channels]

m: [0.67, 0.75, 768] # YOLOv8m summary: 295 layers, 25902640 parameters, 25902624 gradients, 79.3 GFLOPs

# YOLOv8.0n backbone

backbone:

# [from, repeats, module, args]

- [-1, 1, Conv, [64, 3, 2]] # 0-P1/2

- [-1, 1, Conv, [128, 3, 2]] # 1-P2/4

- [-1, 3, C2f, [128, True]]

- [-1, 1, Conv, [256, 3, 2]] # 3-P3/8

- [-1, 6, C2f, [256, True]]

- [-1, 1, SCDown, [512, 3, 2]] # 5-P4/16

- [-1, 6, C2f, [512, True]]

- [-1, 1, SCDown, [1024, 3, 2]] # 7-P5/32

- [-1, 3, C2fCIB, [1024, True]]

- [-1, 1, NAM, [1024]]

- [-1, 1, SPPF, [1024, 5]] # 10

- [-1, 1, PSA, [1024]] # 11

# YOLOv8.0n head

head:

- [-1, 1, nn.Upsample, [None, 2, "nearest"]]

- [[-1, 6], 1, Concat, [1]] # cat backbone P4

- [-1, 3, C2f, [512]] # 14

- [-1, 1, nn.Upsample, [None, 2, "nearest"]]

- [[-1, 4], 1, Concat, [1]] # cat backbone P3

- [-1, 3, C2f, [256]] # 17 (P3/8-small)

- [-1, 1, Conv, [256, 3, 2]]

- [[-1, 14], 1, Concat, [1]] # cat head P4

- [-1, 3, C2fCIB, [512, True]] # 20 (P4/16-medium)

- [-1, 1, SCDown, [512, 3, 2]]

- [[-1, 11], 1, Concat, [1]] # cat head P5

- [-1, 3, C2fCIB, [1024, True]] # 23 (P5/32-large)

- [[17, 20, 23], 1, v10Detect, [nc]] # Detect(P3, P4, P5)

6.2 模型改进版本二⭐

此处同样以ultralytics/cfg/models/v10/yolov10m.yaml为例,在同目录下创建一个用于自己数据集训练的模型文件yolov10m-C2f_NAM.yaml。

将yolov10m.yaml中的内容复制到yolov10m-C2f_NAM.yaml文件下,修改nc数量等于自己数据中目标的数量。

📌 模型的修改方法是将骨干网络中的所有C2f模块替换成C2f_NAM模块。

# Ultralytics YOLO 🚀, AGPL-3.0 license

# YOLOv8 object detection model with P3-P5 outputs. For Usage examples see https://docs.ultralytics.com/tasks/detect

# Parameters

nc: 1 # number of classes

scales: # model compound scaling constants, i.e. 'model=yolov8n.yaml' will call yolov8.yaml with scale 'n'

# [depth, width, max_channels]

m: [0.67, 0.75, 768] # YOLOv8m summary: 295 layers, 25902640 parameters, 25902624 gradients, 79.3 GFLOPs

# YOLOv8.0n backbone

backbone:

# [from, repeats, module, args]

- [-1, 1, Conv, [64, 3, 2]] # 0-P1/2

- [-1, 1, Conv, [128, 3, 2]] # 1-P2/4

- [-1, 3, C2f_NAM, [128, True]]

- [-1, 1, Conv, [256, 3, 2]] # 3-P3/8

- [-1, 6, C2f_NAM, [256, True]]

- [-1, 1, SCDown, [512, 3, 2]] # 5-P4/16

- [-1, 6, C2f_NAM, [512, True]]

- [-1, 1, SCDown, [1024, 3, 2]] # 7-P5/32

- [-1, 3, C2fCIB, [1024, True]]

- [-1, 1, SPPF, [1024, 5]] # 9

- [-1, 1, PSA, [1024]] # 10

# YOLOv8.0n head

head:

- [-1, 1, nn.Upsample, [None, 2, "nearest"]]

- [[-1, 6], 1, Concat, [1]] # cat backbone P4

- [-1, 3, C2f, [512]] # 13

- [-1, 1, nn.Upsample, [None, 2, "nearest"]]

- [[-1, 4], 1, Concat, [1]] # cat backbone P3

- [-1, 3, C2f, [256]] # 16 (P3/8-small)

- [-1, 1, Conv, [256, 3, 2]]

- [[-1, 13], 1, Concat, [1]] # cat head P4

- [-1, 3, C2fCIB, [512, True]] # 19 (P4/16-medium)

- [-1, 1, SCDown, [512, 3, 2]]

- [[-1, 10], 1, Concat, [1]] # cat head P5

- [-1, 3, C2fCIB, [1024, True]] # 22 (P5/32-large)

- [[16, 19, 22], 1, v10Detect, [nc]] # Detect(P3, P4, P5)

七、成功运行结果

分别打印网络模型可以看到NAM模块和C2f_NAM 已经加入到模型中,并可以进行训练了。

yolov10m-NAM:

from n params module arguments

0 -1 1 1392 ultralytics.nn.modules.conv.Conv [3, 48, 3, 2]

1 -1 1 41664 ultralytics.nn.modules.conv.Conv [48, 96, 3, 2]

2 -1 2 111360 ultralytics.nn.modules.block.C2f [96, 96, 2, True]

3 -1 1 166272 ultralytics.nn.modules.conv.Conv [96, 192, 3, 2]

4 -1 4 813312 ultralytics.nn.modules.block.C2f [192, 192, 4, True]

5 -1 1 78720 ultralytics.nn.modules.block.SCDown [192, 384, 3, 2]

6 -1 4 3248640 ultralytics.nn.modules.block.C2f [384, 384, 4, True]

7 -1 1 228672 ultralytics.nn.modules.block.SCDown [384, 576, 3, 2]

8 -1 2 1689984 ultralytics.nn.modules.block.C2fCIB [576, 576, 2, True]

9 -1 1 1152 ultralytics.nn.modules.block.NAM [576, 576]

10 -1 1 831168 ultralytics.nn.modules.block.SPPF [576, 576, 5]

11 -1 1 1253088 ultralytics.nn.modules.block.PSA [576, 576]

12 -1 1 0 torch.nn.modules.upsampling.Upsample [None, 2, 'nearest']

13 [-1, 6] 1 0 ultralytics.nn.modules.conv.Concat [1]

14 -1 2 1993728 ultralytics.nn.modules.block.C2f [960, 384, 2]

15 -1 1 0 torch.nn.modules.upsampling.Upsample [None, 2, 'nearest']

16 [-1, 4] 1 0 ultralytics.nn.modules.conv.Concat [1]

17 -1 2 517632 ultralytics.nn.modules.block.C2f [576, 192, 2]

18 -1 1 332160 ultralytics.nn.modules.conv.Conv [192, 192, 3, 2]

19 [-1, 14] 1 0 ultralytics.nn.modules.conv.Concat [1]

20 -1 2 831744 ultralytics.nn.modules.block.C2fCIB [576, 384, 2, True]

21 -1 1 152448 ultralytics.nn.modules.block.SCDown [384, 384, 3, 2]

22 [-1, 11] 1 0 ultralytics.nn.modules.conv.Concat [1]

23 -1 2 1911168 ultralytics.nn.modules.block.C2fCIB [960, 576, 2, True]

24 [17, 20, 23] 1 2282134 ultralytics.nn.modules.head.v10Detect [1, [192, 384, 576]]

YOLOv10m-NAM summary: 501 layers, 16486438 parameters, 16486422 gradients, 64.0 GFLOPs

yolov10m-C2f_NAM:

from n params module arguments

0 -1 1 1392 ultralytics.nn.modules.conv.Conv [3, 48, 3, 2]

1 -1 1 41664 ultralytics.nn.modules.conv.Conv [48, 96, 3, 2]

2 -1 2 130560 ultralytics.nn.modules.block.C2f_NAM [96, 96, True]

3 -1 1 166272 ultralytics.nn.modules.conv.Conv [96, 192, 3, 2]

4 -1 4 1038336 ultralytics.nn.modules.block.C2f_NAM [192, 192, True]

5 -1 1 78720 ultralytics.nn.modules.block.SCDown [192, 384, 3, 2]

6 -1 4 4141056 ultralytics.nn.modules.block.C2f_NAM [384, 384, True]

7 -1 1 228672 ultralytics.nn.modules.block.SCDown [384, 576, 3, 2]

8 -1 2 1689984 ultralytics.nn.modules.block.C2fCIB [576, 576, 2, True]

9 -1 1 831168 ultralytics.nn.modules.block.SPPF [576, 576, 5]

10 -1 1 1253088 ultralytics.nn.modules.block.PSA [576, 576]

11 -1 1 0 torch.nn.modules.upsampling.Upsample [None, 2, 'nearest']

12 [-1, 6] 1 0 ultralytics.nn.modules.conv.Concat [1]

13 -1 2 1993728 ultralytics.nn.modules.block.C2f [960, 384, 2]

14 -1 1 0 torch.nn.modules.upsampling.Upsample [None, 2, 'nearest']

15 [-1, 4] 1 0 ultralytics.nn.modules.conv.Concat [1]

16 -1 2 517632 ultralytics.nn.modules.block.C2f [576, 192, 2]

17 -1 1 332160 ultralytics.nn.modules.conv.Conv [192, 192, 3, 2]

18 [-1, 13] 1 0 ultralytics.nn.modules.conv.Concat [1]

19 -1 2 831744 ultralytics.nn.modules.block.C2fCIB [576, 384, 2, True]

20 -1 1 152448 ultralytics.nn.modules.block.SCDown [384, 384, 3, 2]

21 [-1, 10] 1 0 ultralytics.nn.modules.conv.Concat [1]

22 -1 2 1911168 ultralytics.nn.modules.block.C2fCIB [960, 576, 2, True]

23 [16, 19, 22] 1 2282134 ultralytics.nn.modules.head.v10Detect [1, [192, 384, 576]]

YOLOv10m-C2f_NAM summary: 587 layers, 17621926 parameters, 17621910 gradients, 70.8 GFLOPs